变分自动编码器(VAE)是一种基于神经网络的生成模型。它的目标是学习高维数据的低维潜在变量表示,并利用这些潜在变量进行数据的重构和生成。相比传统的自动编码器,VAE通过学习潜在空间的分布,可以生成更真实且多样性的样本。下面将详细介绍VAE的实现方法。

1.VAE的基本原理

VAE的基本思想是通过将高维数据映射到低维的潜在空间,实现数据的降维和重构。它由编码器和解码器两个部分组成。编码器将输入数据x映射到潜在空间的均值μ和方差σ^2。通过这种方式,VAE可以在潜在空间中对数据进行采样,并通过解码器将采样结果重构为原始数据。这种编码器-解码器结构使得VAE能够生成新的样本,并且在潜在空间中具有良好的连续性,使得相似的样本在潜在空间中距离较近。因此,VAE不仅可以用于降维和

\begin{aligned}

\mu &=f_{\mu}(x)\

\sigma^2 &=f_{\sigma}(x)

\end{aligned}其中,f_{mu}和f_{sigma}可以是任意的神经网络模型。通常情况下,我们使用一个多层感知机(Multilayer Perceptron,MLP)来实现编码器。

解码器则将潜在变量z映射回原始数据空间,即:

x'=g(z)

其中,g也可以是任意的神经网络模型。同样地,我们通常使用一个MLP来实现解码器。

在VAE中,潜在变量$z$是从一个先验分布(通常是高斯分布)中采样得到的,即:

z\sim\mathcal{N}(0,I)这样,我们就可以通过最小化重构误差和潜在变量的KL散度来训练VAE,从而实现数据的降维和生成。具体来说,VAE的损失函数可以表示为:

\mathcal{L}=\mathbb{E}_{z\sim q(z|x)}[\log p(x|z)]-\beta\mathrm{KL}[q(z|x)||p(z)]其中,q(z|x)是后验分布,即给定输入x时潜在变量z的条件分布;p(x|z)是生成分布,即给定潜在变量$z$时对应的数据分布;p(z)是先验分布,即潜在变量z的边缘分布;beta是一个超参数,用于平衡重构误差和KL散度。

通过最小化上述损失函数,我们可以学习到一个转换函数f(x),它可以将输入数据x映射到潜在空间的分布q(z|x)中,并且可以从中采样得到潜在变量z,从而实现数据的降维和生成。

2.VAE的实现步骤

下面我们将介绍如何实现一个基本的VAE模型,包括编码器、解码器和损失函数的定义。我们以MNIST手写数字数据集为例,该数据集包含60000个训练样本和10000个测试样本,每个样本为一张28x28的灰度图像。

2.1数据预处理

首先,我们需要对MNIST数据集进行预处理,将每个样本转换成一个784维的向量,并将其归一化到[0,1]的范围内。代码如下:

# python

import torch

import torchvision.transforms as transforms

from torchvision.datasets import MNIST

# 定义数据预处理

transform = transforms.Compose([

transforms.ToTensor(), # 将图像转换成Tensor格式

transforms.Normalize(mean=(0.

2.2 定义模型结构

接下来,我们需要定义VAE模型的结构,包括编码器、解码器和潜在变量的采样函数。在本例中,我们使用一个两层的MLP作为编码器和解码器,每层的隐藏单元数分别为256和128。潜在变量的维度为20。代码如下:

import torch.nn as nn

class VAE(nn.Module):

def __init__(self, input_dim=784, hidden_dim=256, latent_dim=20):

super(VAE, self).__init__()

# 定义编码器的结构

self.encoder = nn.Sequential(

nn.Linear(input_dim, hidden_dim),

nn.ReLU(),

nn.Linear(hidden_dim, hidden_dim//2),

nn.ReLU(),

nn.Linear(hidden_dim//2, latent_dim*2) # 输出均值和方差

)

# 定义解码器的结构

self.decoder = nn.Sequential(

nn.Linear(latent_dim, hidden_dim//2),

nn.ReLU(),

nn.Linear(hidden_dim//2, hidden_dim),

nn.ReLU(),

nn.Linear(hidden_dim, input_dim),

nn.Sigmoid() # 输出范围在[0, 1]之间的概率

)

# 潜在变量的采样函数

def sample_z(self, mu, logvar):

std = torch.exp(0.5*logvar)

eps = torch.randn_like(std)

return mu + eps*std

# 前向传播函数

def forward(self, x):

# 编码器

h = self.encoder(x)

mu, logvar = h[:, :latent_dim], h[:, latent_dim:]

z = self.sample_z(mu, logvar)

# 解码器

x_hat = self.decoder(z)

return x_hat, mu, logvar在上述代码中,我们使用一个两层的MLP作为编码器和解码器。编码器将输入数据映射到潜在空间的均值和方差,其中均值的维度为20,方差的维度也为20,这样可以保证潜在变量的维度为20。解码器将潜在变量映射回原始数据空间,其中最后一层使用Sigmoid函数将输出范围限制在[0, 1]之间。

在实现VAE模型时,我们还需要定义损失函数。在本例中,我们使用重构误差和KL散度来定义损失函数,其中重构误差使用交叉熵损失函数,KL散度使用标准正态分布作为先验分布。代码如下:

# 定义损失函数

def vae_loss(x_hat, x, mu, logvar, beta=1):

# 重构误差

recon_loss = nn.functional.binary_cross_entropy(x_hat, x, reduction='sum')

# KL散度

kl_loss = -0.5 * torch.sum(1 + logvar - mu.pow(2) - logvar.exp())

return recon_loss + beta*kl_loss在上述代码中,我们使用交叉熵损失函数计算重构误差,使用KL散度计算潜在变量的分布与先验分布之间的差异。其中,beta是一个超参数,用于平衡重构误差和KL散度。

2.3 训练模型

最后,我们需要定义训练函数,并在MNIST数据集上训练VAE模型。训练过程中,我们首先需要计算模型的损失函数,然后使用反向传播算法更新模型参数。代码如下:

# python

# 定义训练函数

def train(model, dataloader, optimizer, device, beta):

model.train()

train_loss = 0

for x, _ in dataloader:

x = x.view(-1, input_dim).to(device)

optimizer.zero_grad()

x_hat, mu, logvar = model(x)

loss = vae_loss(x_hat, x, mu, logvar, beta)

loss.backward()

train_loss += loss.item()

optimizer.step()

return train_loss / len(dataloader.dataset)现在,我们可以使用上述训练函数在MNIST数据集上训练VAE模型了。代码如下:

# 定义模型和优化器

model = VAE().to(device)

optimizer = torch.optim.Adam(model.parameters(), lr=1e-3)

# 训练模型

num_epochs = 50

for epoch in range(num_epochs):

train_loss = train(model, trainloader, optimizer, device, beta=1)

print(f'Epoch {epoch+1}/{num_epochs}, Train Loss: {train_loss:.4f}')

# 测试模型

model.eval()

with torch.no_grad():

test_loss = 0

for x, _ in testloader:

x = x.view(-1, input_dim).to(device)

x_hat, mu, logvar = model(x)

test_loss += vae_loss(x_hat, x, mu, logvar, beta=1).item()

test_loss /= len(testloader.dataset)

print(f'Test Loss: {test_loss:.4f}')在训练过程中,我们使用Adam优化器和beta=1的超参数来更新模型参数。在训练完成后,我们使用测试集计算模型的损失函数。在本例中,我们使用重构误差和KL散度来计算损失函数,因此测试损失越小,说明模型学习到的潜在表示越好,生成的样本也越真实。

2.4 生成样本

最后,我们可以使用VAE模型生成新的手写数字样本。生成样本的过程非常简单,只需要在潜在空间中随机采样,然后将采样结果输入到解码器中生成新的样本。代码如下:

# 生成新样本

n_samples = 10

with torch.no_grad():

# 在潜在空间中随机采样

z = torch.randn(n_samples, latent_dim).to(device)

# 解码生成样本

samples = model.decode(z).cpu()

# 将样本重新变成图像的形状

samples = samples.view(n_samples, 1, 28, 28)

# 可视化生成的样本

fig, axes = plt.subplots(1, n_samples, figsize=(20, 2))

for i, ax in enumerate(axes):

ax.imshow(samples[i][0], cmap='gray')

ax.axis('off')

plt.show()在上述代码中,我们在潜在空间中随机采样10个点,然后将这些点输入到解码器中生成新的样本。最后,我们将生成的样本可视化展示出来,可以看到,生成的样本与MNIST数据集中的数字非常相似。

综上,我们介绍了VAE模型的原理、实现和应用,可以看到,VAE模型是一种非常强大的生成模型,可以学习到高维数据的潜在表示,并用潜在表示生成新的样本。

以上是变分自动编码器:理论与实现方案的详细内容。更多信息请关注PHP中文网其他相关文章!

最新的最佳及时工程技术的年度汇编Apr 10, 2025 am 11:22 AM

最新的最佳及时工程技术的年度汇编Apr 10, 2025 am 11:22 AM对于那些可能是我专栏新手的人,我广泛探讨了AI的最新进展,包括体现AI,AI推理,AI中的高科技突破,及时的工程,AI培训,AI,AI RE RE等主题

欧洲的AI大陆行动计划:Gigafactories,Data Labs和Green AIApr 10, 2025 am 11:21 AM

欧洲的AI大陆行动计划:Gigafactories,Data Labs和Green AIApr 10, 2025 am 11:21 AM欧洲雄心勃勃的AI大陆行动计划旨在将欧盟确立为人工智能的全球领导者。 一个关键要素是建立了AI Gigafactories网络,每个网络都有大约100,000个高级AI芯片 - 2倍的自动化合物的四倍

微软的直接代理商故事是否足以创造更多的粉丝?Apr 10, 2025 am 11:20 AM

微软的直接代理商故事是否足以创造更多的粉丝?Apr 10, 2025 am 11:20 AM微软对AI代理申请的统一方法:企业的明显胜利 微软最近公告的新AI代理能力清晰而统一的演讲给人留下了深刻的印象。 与许多技术公告陷入困境不同

向员工出售AI策略:Shopify首席执行官的宣言Apr 10, 2025 am 11:19 AM

向员工出售AI策略:Shopify首席执行官的宣言Apr 10, 2025 am 11:19 AMShopify首席执行官TobiLütke最近的备忘录大胆地宣布AI对每位员工的基本期望是公司内部的重大文化转变。 这不是短暂的趋势。这是整合到P中的新操作范式

IBM启动具有完整AI集成的Z17大型机Apr 10, 2025 am 11:18 AM

IBM启动具有完整AI集成的Z17大型机Apr 10, 2025 am 11:18 AMIBM的Z17大型机:集成AI用于增强业务运营 上个月,在IBM的纽约总部,我收到了Z17功能的预览。 以Z16的成功为基础(于2022年推出并证明持续的收入增长

5 Chatgpt提示取决于别人并完全相信自己Apr 10, 2025 am 11:17 AM

5 Chatgpt提示取决于别人并完全相信自己Apr 10, 2025 am 11:17 AM解锁不可动摇的信心,消除了对外部验证的需求! 这五个CHATGPT提示将指导您完全自力更生和自我感知的变革转变。 只需复制,粘贴和自定义包围

AI与您的思想危险相似Apr 10, 2025 am 11:16 AM

AI与您的思想危险相似Apr 10, 2025 am 11:16 AM人工智能安全与研究公司 Anthropic 最近的一项[研究]开始揭示这些复杂过程的真相,展现出一种令人不安地与我们自身认知领域相似的复杂性。自然智能和人工智能可能比我们想象的更相似。 窥探内部:Anthropic 可解释性研究 Anthropic 进行的研究的新发现代表了机制可解释性领域的重大进展,该领域旨在反向工程 AI 的内部计算——不仅仅观察 AI 做了什么,而是理解它在人工神经元层面如何做到这一点。 想象一下,试图通过绘制当有人看到特定物体或思考特定想法时哪些神经元会放电来理解大脑。A

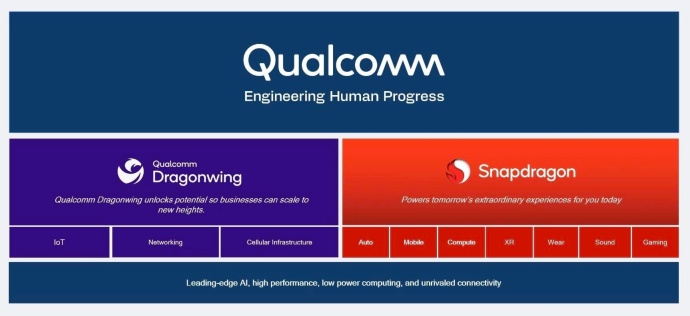

龙翼展示高通的边缘动力Apr 10, 2025 am 11:14 AM

龙翼展示高通的边缘动力Apr 10, 2025 am 11:14 AM高通的龙翼:企业和基础设施的战略飞跃 高通公司通过其新的Dragonwing品牌在全球范围内积极扩展其范围,以全球为目标。 这不仅仅是雷布兰

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

WebStorm Mac版

好用的JavaScript开发工具

DVWA

Damn Vulnerable Web App (DVWA) 是一个PHP/MySQL的Web应用程序,非常容易受到攻击。它的主要目标是成为安全专业人员在合法环境中测试自己的技能和工具的辅助工具,帮助Web开发人员更好地理解保护Web应用程序的过程,并帮助教师/学生在课堂环境中教授/学习Web应用程序安全。DVWA的目标是通过简单直接的界面练习一些最常见的Web漏洞,难度各不相同。请注意,该软件中

SublimeText3 Linux新版

SublimeText3 Linux最新版

安全考试浏览器

Safe Exam Browser是一个安全的浏览器环境,用于安全地进行在线考试。该软件将任何计算机变成一个安全的工作站。它控制对任何实用工具的访问,并防止学生使用未经授权的资源。

螳螂BT

Mantis是一个易于部署的基于Web的缺陷跟踪工具,用于帮助产品缺陷跟踪。它需要PHP、MySQL和一个Web服务器。请查看我们的演示和托管服务。