新一代 HCC 高性能计算集群,采用最新一代星星海自研服务器,搭载英伟达 H800 Tensor Core GPU。

腾讯官方称,该集群基于自研网络、存储架构,带来 3.2T 超高互联带宽、TB 级吞吐能力和千万级 IOPS。实测结果显示,新一代集群算力性能较前代提升 3 倍。

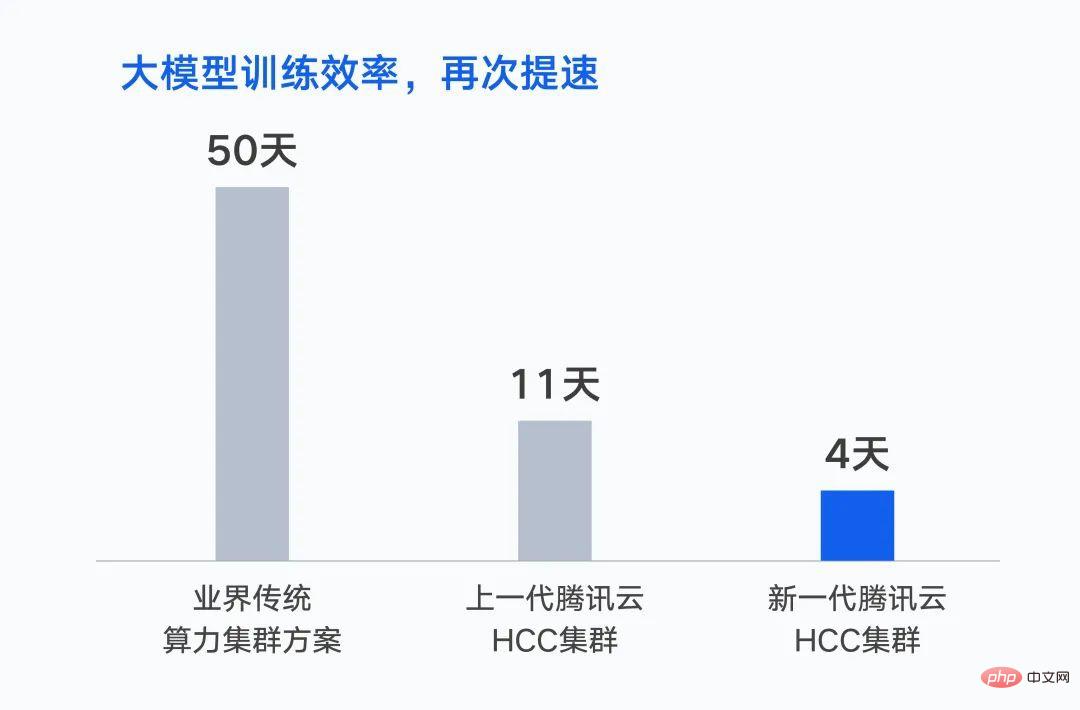

去年 10 月,腾讯完成首个万亿参数的 AI 大模型 —— 混元 NLP 大模型训练。在同等数据集下,将训练时间由 50 天缩短到 11 天。如果基于新一代集群,训练时间将进一步缩短至 4 天。

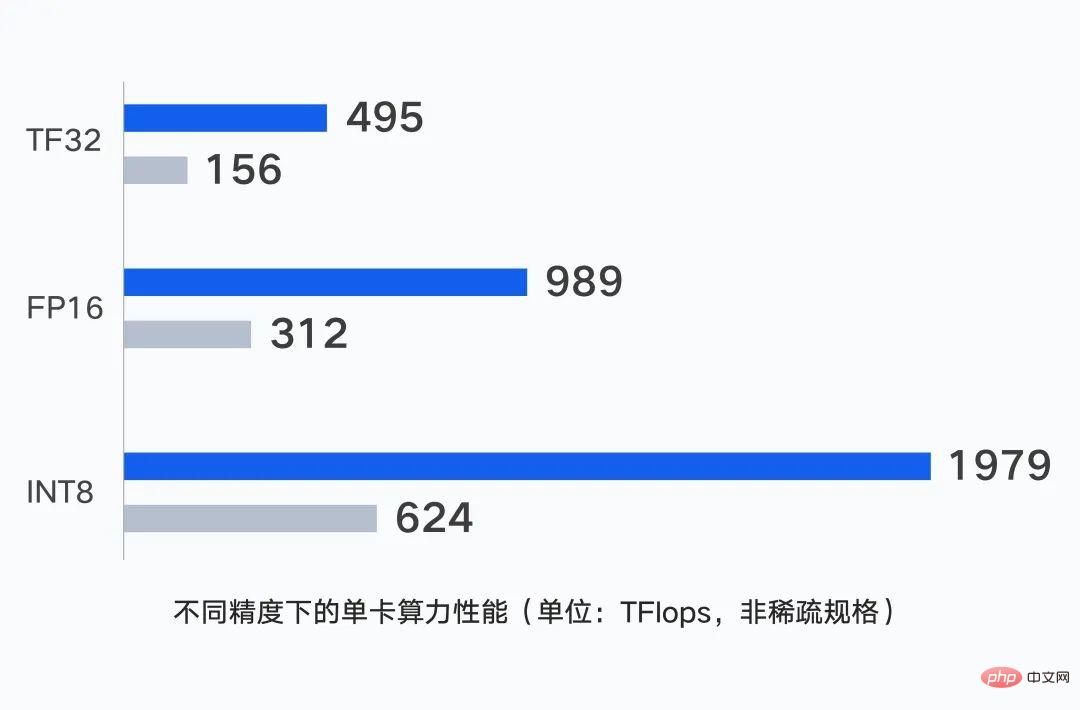

计算层面,服务器单机性能是集群算力的基础,腾讯云新一代集群的单 GPU 卡在不同精度下,支持输出最高 1979 TFlops 的算力。

针对大模型场景,星星海自研服务器采用 6U 超高密度设计,相较行业可支持的上架密度提高 30%;利用并行计算理念,通过 CPU 和 GPU 节点的一体化设计,将单点算力性能提升至更高。

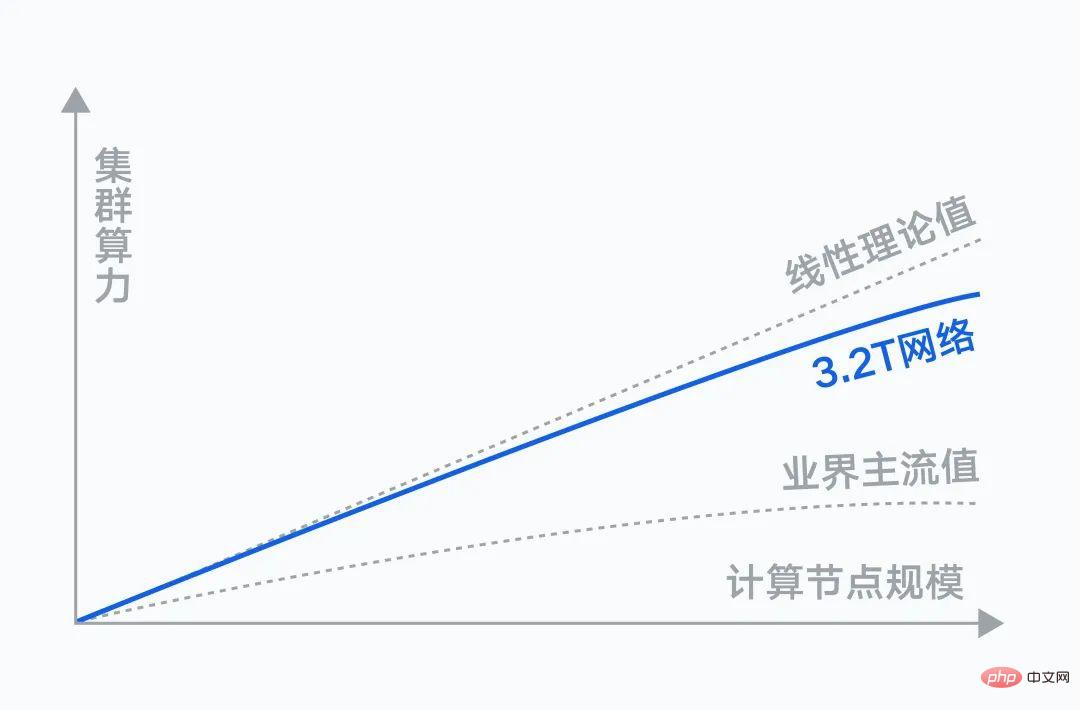

网络层面,计算节点间,存在着海量的数据交互需求。随着集群规模扩大,通信性能会直接影响训练效率,需要实现网络和计算节点的最大协同。

腾讯自研的星脉高性能计算网络,号称具备业界最高的 3.2T RDMA 通信带宽。实测结果显示,搭载同等数量的 GPU,3.2T 星脉网络相较 1.6T 网络,集群整体算力提升 20%。

同时,腾讯自研的高性能集合通信库 TCCL,融入定制设计的解决方案。相对业界开源集合通信库,为大模型训练优化 40% 负载性能,消除多个网络原因导致的训练中断问题。

存储层面,大模型训练中,大量计算节点会同时读取一批数据集,需要尽可能缩短数据加载时长,避免计算节点产生等待。

腾讯云自研的存储架构,具备 TB 级吞吐能力和千万级 IOPS,支持不同场景下对存储的需求。COS+GooseFS 对象存储方案和 CFS Turbo 高性能文件存储方案,充分满足大模型场景下高性能、大吞吐和海量存储要求。

此外,新一代集群集成了腾讯云自研的 TACO 训练加速引擎,对网络协议、通信策略、AI 框架、模型编译进行大量系统级优化,大幅节约训练调优和算力成本。

腾讯混元大模型背后的训练框架 AngelPTM,也已通过腾讯云 TACO 提供服务,帮助企业加速大模型落地。

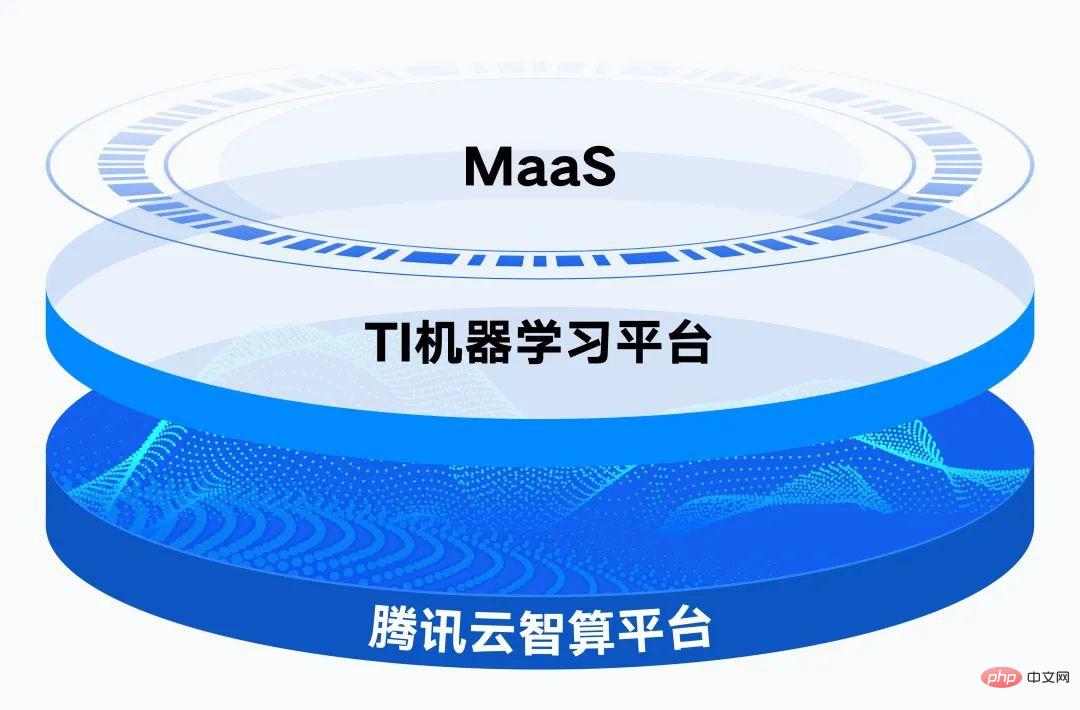

通过腾讯云 TI 平台的大模型能力和工具箱,企业可结合产业场景数据进行精调训练,提升生产效率、快速创建和部署 AI 应用。

依托分布式云原生的治理能力,腾讯云智算平台提供 16 EFLOPS 的浮点算力。

以上是腾讯发布新一代超强算力集群:面向大模型训练,性能提升 3 倍的详细内容。更多信息请关注PHP中文网其他相关文章!

最新的最佳及时工程技术的年度汇编Apr 10, 2025 am 11:22 AM

最新的最佳及时工程技术的年度汇编Apr 10, 2025 am 11:22 AM对于那些可能是我专栏新手的人,我广泛探讨了AI的最新进展,包括体现AI,AI推理,AI中的高科技突破,及时的工程,AI培训,AI,AI RE RE等主题

欧洲的AI大陆行动计划:Gigafactories,Data Labs和Green AIApr 10, 2025 am 11:21 AM

欧洲的AI大陆行动计划:Gigafactories,Data Labs和Green AIApr 10, 2025 am 11:21 AM欧洲雄心勃勃的AI大陆行动计划旨在将欧盟确立为人工智能的全球领导者。 一个关键要素是建立了AI Gigafactories网络,每个网络都有大约100,000个高级AI芯片 - 2倍的自动化合物的四倍

微软的直接代理商故事是否足以创造更多的粉丝?Apr 10, 2025 am 11:20 AM

微软的直接代理商故事是否足以创造更多的粉丝?Apr 10, 2025 am 11:20 AM微软对AI代理申请的统一方法:企业的明显胜利 微软最近公告的新AI代理能力清晰而统一的演讲给人留下了深刻的印象。 与许多技术公告陷入困境不同

向员工出售AI策略:Shopify首席执行官的宣言Apr 10, 2025 am 11:19 AM

向员工出售AI策略:Shopify首席执行官的宣言Apr 10, 2025 am 11:19 AMShopify首席执行官TobiLütke最近的备忘录大胆地宣布AI对每位员工的基本期望是公司内部的重大文化转变。 这不是短暂的趋势。这是整合到P中的新操作范式

IBM启动具有完整AI集成的Z17大型机Apr 10, 2025 am 11:18 AM

IBM启动具有完整AI集成的Z17大型机Apr 10, 2025 am 11:18 AMIBM的Z17大型机:集成AI用于增强业务运营 上个月,在IBM的纽约总部,我收到了Z17功能的预览。 以Z16的成功为基础(于2022年推出并证明持续的收入增长

5 Chatgpt提示取决于别人并完全相信自己Apr 10, 2025 am 11:17 AM

5 Chatgpt提示取决于别人并完全相信自己Apr 10, 2025 am 11:17 AM解锁不可动摇的信心,消除了对外部验证的需求! 这五个CHATGPT提示将指导您完全自力更生和自我感知的变革转变。 只需复制,粘贴和自定义包围

AI与您的思想危险相似Apr 10, 2025 am 11:16 AM

AI与您的思想危险相似Apr 10, 2025 am 11:16 AM人工智能安全与研究公司 Anthropic 最近的一项[研究]开始揭示这些复杂过程的真相,展现出一种令人不安地与我们自身认知领域相似的复杂性。自然智能和人工智能可能比我们想象的更相似。 窥探内部:Anthropic 可解释性研究 Anthropic 进行的研究的新发现代表了机制可解释性领域的重大进展,该领域旨在反向工程 AI 的内部计算——不仅仅观察 AI 做了什么,而是理解它在人工神经元层面如何做到这一点。 想象一下,试图通过绘制当有人看到特定物体或思考特定想法时哪些神经元会放电来理解大脑。A

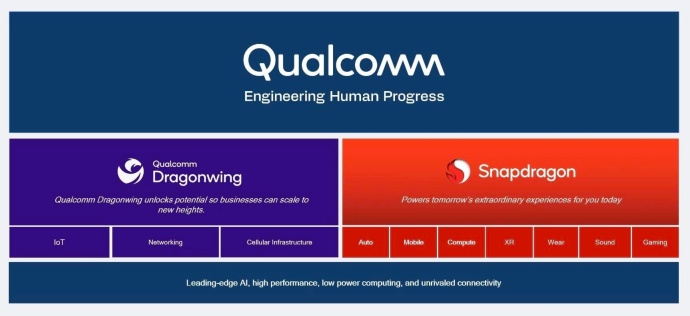

龙翼展示高通的边缘动力Apr 10, 2025 am 11:14 AM

龙翼展示高通的边缘动力Apr 10, 2025 am 11:14 AM高通的龙翼:企业和基础设施的战略飞跃 高通公司通过其新的Dragonwing品牌在全球范围内积极扩展其范围,以全球为目标。 这不仅仅是雷布兰

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

Atom编辑器mac版下载

最流行的的开源编辑器

ZendStudio 13.5.1 Mac

功能强大的PHP集成开发环境

Dreamweaver Mac版

视觉化网页开发工具

SecLists

SecLists是最终安全测试人员的伙伴。它是一个包含各种类型列表的集合,这些列表在安全评估过程中经常使用,都在一个地方。SecLists通过方便地提供安全测试人员可能需要的所有列表,帮助提高安全测试的效率和生产力。列表类型包括用户名、密码、URL、模糊测试有效载荷、敏感数据模式、Web shell等等。测试人员只需将此存储库拉到新的测试机上,他就可以访问到所需的每种类型的列表。

WebStorm Mac版

好用的JavaScript开发工具