LSTM是一種遞歸神經網路的變體,用於解決長期依賴問題。其核心思想是透過一系列的閘控單元來控制輸入、輸出和內部狀態的流動,從而有效地避免了RNN中的梯度消失或梯度爆炸問題。這種門控機制使得LSTM能夠長時間記住訊息,並根據需要選擇性地忘記或更新狀態,從而更好地處理長序列資料。

LSTM的工作原理是透過三個門控單元來控制資訊的流動和保存,這些單元包括遺忘門、輸入門和輸出門。

遺忘門:控制先前的狀態是否需要被遺忘,使得模型能夠選擇性地保留先前的狀態資訊。

輸入閘門:控制新的輸入資訊在目前狀態中的佔比,使得模型能夠選擇性地加入新的資訊。

輸出閘門:控制目前狀態資訊的輸出,使得模型能夠選擇性地輸出狀態資訊。

舉例來說,假設我們要使用LSTM來產生一段關於天氣的文字。首先,我們需要將文字轉換成數字,這可以透過將每個單字映射到一個唯一的整數來實現。然後,我們可以將這些整數輸入到LSTM中並訓練模型,使其能夠預測下一個單字的機率分佈。最後,我們可以使用這個機率分佈來產生連續的文字。

以下是實作LSTM產生文字的範例程式碼:

import numpy as np

import sys

import io

from keras.models import Sequential

from keras.layers import Dense, LSTM, Dropout

from keras.callbacks import ModelCheckpoint

from keras.utils import np_utils

# 读取文本文件并将其转换为整数

with io.open('text.txt', encoding='utf-8') as f:

text = f.read()

chars =list(set(text))

char_to_int = dict((c, i) for i, c in enumerate(chars))

# 将文本分割成固定长度的序列

seq_length = 100

dataX = []

dataY = []

for i in range(0, len(text) - seq_length, 1):

seq_in = text[i:i + seq_length]

seq_out = text[i + seq_length]

dataX.append([char_to_int[char] for char in seq_in])

dataY.append(char_to_int[seq_out])

n_patterns = len(dataX)

# 将数据转换为适合LSTM的格式

X = np.reshape(dataX, (n_patterns, seq_length, 1))

X = X / float(len(chars))

y = np_utils.to_categorical(dataY)

# 定义LSTM模型

model = Sequential()

model.add(LSTM(256, input_shape=(X.shape[1], X.shape[2]), return_sequences=True))

model.add(Dropout(0.2))

model.add(LSTM(256))

model.add(Dropout(0.2))

model.add(Dense(y.shape[1], activation='softmax'))

model.compile(loss='categorical_crossentropy', optimizer='adam')

# 训练模型

filepath="weights-improvement-{epoch:02d}-{loss:.4f}.hdf5"

checkpoint = ModelCheckpoint(filepath, monitor='loss', verbose=1, save_best_only=True, mode='min')

callbacks_list = [checkpoint]

model.fit(X, y, epochs=20, batch_size=128, callbacks=callbacks_list)

# 使用模型生成文本

int_to_char = dict((i, c) for i, c in enumerate(chars))

start = np.random.randint(0, len(dataX)-1)

pattern = dataX[start]

print("Seed:")

print("\"", ''.join([int_to_char[value] for value in pattern]), "\"")

for i in range(1000):

x = np.reshape(pattern, (1, len(pattern), 1))

x = x / float(len(chars))

prediction = model.predict(x, verbose=0)

index = np.argmax(prediction)

result = int_to_char[index]

seq_in = [int_to_char[value] for value in pattern]

sys.stdout.write(result)

pattern.append(index)

pattern = pattern[1:len(pattern)]上述程式碼中,我們首先透過io庫讀取文字文件,並將每個字元對應到一個唯一的整數。然後,我們將文字分割成長度為100的序列,並將這些序列轉換為適合LSTM的格式。接下來,我們定義一個包含兩個LSTM層和一個全連接層的模型,使用softmax作為激活函數計算下一個字元的機率分佈。最後,我們使用fit方法訓練模型,並使用predict方法產生連續的文本。

在使用模型產生文字時,我們首先從資料集中隨機選擇一個序列作為起始點。然後,我們使用模型預測下一個字元的機率分佈,並選擇機率最高的字元作為下一個字元。接著,我們將該字符添加到序列末尾,並移除序列開頭的字符,重複上述步驟直至生成1000個字符的文本。

總的來說,LSTM是一種遞歸神經網路的變體,專門設計用於解決長期依賴問題。透過使用閘控單元來控制輸入、輸出和內部狀態的流動,LSTM能夠避免梯度消失或梯度爆炸的問題,從而能夠產生連續的文字等應用。

以上是LSTM產生連續文字的方法與技巧的詳細內容。更多資訊請關注PHP中文網其他相關文章!

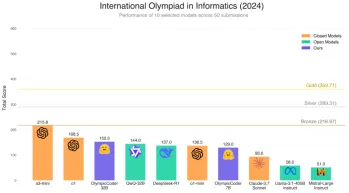

擁抱面部是否7B型號奧林匹克賽車擊敗克勞德3.7?Apr 23, 2025 am 11:49 AM

擁抱面部是否7B型號奧林匹克賽車擊敗克勞德3.7?Apr 23, 2025 am 11:49 AM擁抱Face的OlympicCoder-7B:強大的開源代碼推理模型 開發以代碼為中心的語言模型的競賽正在加劇,擁抱面孔與強大的競爭者一起參加了比賽:OlympicCoder-7B,一種產品

4個新的雙子座功能您可以錯過Apr 23, 2025 am 11:48 AM

4個新的雙子座功能您可以錯過Apr 23, 2025 am 11:48 AM你們當中有多少人希望AI可以做更多的事情,而不僅僅是回答問題?我知道我有,最近,我對它的變化感到驚訝。 AI聊天機器人不僅要聊天,還關心創建,研究

Camunda為經紀人AI編排編寫了新的分數Apr 23, 2025 am 11:46 AM

Camunda為經紀人AI編排編寫了新的分數Apr 23, 2025 am 11:46 AM隨著智能AI開始融入企業軟件平台和應用程序的各個層面(我們必須強調的是,既有強大的核心工具,也有一些不太可靠的模擬工具),我們需要一套新的基礎設施能力來管理這些智能體。 總部位於德國柏林的流程編排公司Camunda認為,它可以幫助智能AI發揮其應有的作用,並與新的數字工作場所中的準確業務目標和規則保持一致。該公司目前提供智能編排功能,旨在幫助組織建模、部署和管理AI智能體。 從實際的軟件工程角度來看,這意味著什麼? 確定性與非確定性流程的融合 該公司表示,關鍵在於允許用戶(通常是數據科學家、軟件

策劃的企業AI體驗是否有價值?Apr 23, 2025 am 11:45 AM

策劃的企業AI體驗是否有價值?Apr 23, 2025 am 11:45 AM參加Google Cloud Next '25,我渴望看到Google如何區分其AI產品。 有關代理空間(此處討論)和客戶體驗套件(此處討論)的最新公告很有希望,強調了商業價值

如何為抹布找到最佳的多語言嵌入模型?Apr 23, 2025 am 11:44 AM

如何為抹布找到最佳的多語言嵌入模型?Apr 23, 2025 am 11:44 AM為您的檢索增強發電(RAG)系統選擇最佳的多語言嵌入模型 在當今的相互聯繫的世界中,建立有效的多語言AI系統至關重要。 強大的多語言嵌入模型對於RE至關重要

麝香:奧斯汀的機器人需要每10,000英里進行干預Apr 23, 2025 am 11:42 AM

麝香:奧斯汀的機器人需要每10,000英里進行干預Apr 23, 2025 am 11:42 AM特斯拉的Austin Robotaxi發射:仔細觀察Musk的主張 埃隆·馬斯克(Elon Musk)最近宣布,特斯拉即將在德克薩斯州奧斯汀推出的Robotaxi發射,最初出於安全原因部署了一支小型10-20輛汽車,並有快速擴張的計劃。 h

AI震驚的樞軸:從工作工具到數字治療師和生活教練Apr 23, 2025 am 11:41 AM

AI震驚的樞軸:從工作工具到數字治療師和生活教練Apr 23, 2025 am 11:41 AM人工智能的應用方式可能出乎意料。最初,我們很多人可能認為它主要用於代勞創意和技術任務,例如編寫代碼和創作內容。 然而,哈佛商業評論最近報導的一項調查表明情況並非如此。大多數用戶尋求人工智能的並非是代勞工作,而是支持、組織,甚至是友誼! 報告稱,人工智能應用案例的首位是治療和陪伴。這表明其全天候可用性以及提供匿名、誠實建議和反饋的能力非常有價值。 另一方面,營銷任務(例如撰寫博客、創建社交媒體帖子或廣告文案)在流行用途列表中的排名要低得多。 這是為什麼呢?讓我們看看研究結果及其對我們人類如何繼續將

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中

MantisBT

Mantis是一個易於部署的基於Web的缺陷追蹤工具,用於幫助產品缺陷追蹤。它需要PHP、MySQL和一個Web伺服器。請查看我們的演示和託管服務。

SublimeText3漢化版

中文版,非常好用

mPDF

mPDF是一個PHP庫,可以從UTF-8編碼的HTML產生PDF檔案。原作者Ian Back編寫mPDF以從他的網站上「即時」輸出PDF文件,並處理不同的語言。與原始腳本如HTML2FPDF相比,它的速度較慢,並且在使用Unicode字體時產生的檔案較大,但支援CSS樣式等,並進行了大量增強。支援幾乎所有語言,包括RTL(阿拉伯語和希伯來語)和CJK(中日韓)。支援嵌套的區塊級元素(如P、DIV),