此前,OpenAI不Open的事件,已經引發了坊間的諸多爭議。

光放出基準和測試結果,不提供訓練資料、成本、方法,是真的要「贏家通吃」了。

眼看大語言模型似乎要被巨頭公司壟斷,如今忽然殺出一個新創公司,給了OpenAI一槍——用60億參數的「Dolly」實現了和ChatGPT相似的能力。

沒錯,我們現在只需要準備一些高品質的訓練數據,隨便拿一個開源的大語言模型,訓練30分鐘後,就能得到一個ChatGPT「平替」!

對此,Databricks自豪地表示,Dolly的發布,就是自己在人工智慧技術民主化道路上打響的第一彈。

60億參數堪比ChatGPT,30分鐘就訓好

由於ChatGPT需要消耗大量的數據和算力資源(利用數萬億個單字訓練,消耗大量GPU),所以這類大語言模型注定只能被少量巨頭所掌握。

和「CloseAI」相反,Meta在今年3月向學術界發布了一組高品質(但不是指令跟隨的)語言模型LLaMA,每個模型的訓練時間超過了80,000個GPU小時。

隨後,史丹佛大學基於LLaMA建立了Alpaca,但不同之處在於,它利用一個包含50,000個問題和答案的小資料集進行了微調。令人驚訝的是,這使得Alpaca具有了類似於ChatGPT的交互性。

而Dolly正是受到了Alpaca的啟發。

更有趣的是,擁有60億參數的Dolly並沒有利用現在最新的模型,而是選擇了一個2021年發布的開源模型——GPT-J。

由於Dolly本身是一個模型的「克隆」,所以團隊最終決定將其命名為「多利」——有史以來第一個被克隆的動物。

與目前的大型語言模型(如GPT-3)相比,Dolly允許使用者使用更小、更專業的模型,「復刻”ChatGPT的能力。

畢竟對於那些細分用戶來說,能夠利用針對本行業進行過精調的模型,可以大幅增加效能和準確性。

儘管Databricks與OpenAI並無直接競爭關係,但它似乎想透過證明建構類似ChatGPT這樣的服務並非看起來那麼困難,來搶佔OpenAI的風頭。

尤其是,OpenAI採取了「規模越大越好」的方法來開發語言模型,並對其工作越來越保密。

Databricks除了將Dolly作為開源軟體發布外,還強調Dolly只有60億個參數(在訓練過程中微調的語言模型部分),而OpenAI的GPT-3模型有1750億個參數。 (OpenAI並未透露GPT-4的參數數量)。

讓老模型,涅槃重生

#根據InstructGPT論文中描述的指令跟隨能力,對Dolly進行評估後發現,它在許多能力上的表現和ChatGPT十分類似,包括文本生成、腦力激盪和開放式問答。

在這些例子中,值得注意的不是生成文字的質量,而是在一個小型的高品質資料集上,微調一個舊的開源模型所帶來的指令跟隨能力的巨大改進。

內容生成

例如,寫一則Databricks官宣大規模語言模型Dolly發布的推特。

可以看到,原始的60億參數模型(GPT-J)所產生的內容驢唇不對馬嘴,而Dolly則給出了一個完全可用的推文— —

不僅內容符合要求,而且還貼心地加上了標籤,並提醒你記得加入發布的連結。

對於這一題,ChatGPT給出的答案也很符合期待,相較於Dolly,ChatGPT給出的推文包含了更多評述性詞句,而且標籤也更精準具體,但整體差距不大。

當要寫一則出售Nikon D-750相機的廣告時,可以看到,GPT-J所產生的內容基本上就在胡編亂造,像是在寫小說一樣杜撰購買和出售相機的劇情…

#而Dolly則根據Nikon D-750相機的特點及優勢,給出了一則吸引人的相機轉賣廣告語,但遺憾的是像素參數不對。

ChatGPT在這一題上也是圓滿完成任務,廣告詞中突出該相機的優勢,文末仍然貼心地加上了標籤。

最後一題:寫一封書給Edgar Allan Poe。

對此,古的GPT-J直接拒絕回答,究其原因竟然是--愛倫坡已經過世了,你不能寫情書給死人。

而Dolly則成功地完成了任務,效果對比起來堪稱「涅槃」。

而這個「創意」問題,顯然是ChatGPT的強項,它洋洋灑灑地寫了300多個字。

開放問答

#在事實性問題的問答測試上,團隊選擇了下面這個: 「向我解釋一下核分裂和核融合之間的區別。」

先不管對錯,GPT-J全篇都是在講太陽如何如何,雖然提到了「聚變」這個詞,但完全無視了「裂變」。

而Dolly第一句就直接點題-核分裂和核融合的區別在於釋放能量的方式,隨後簡單解釋了他們的不同。

相較之下,ChatGPT給的答案明顯要更翔實。

腦力激盪

當讓它們頭腦風暴,給出應該閱讀的五本科幻小說的名單,GPT-J則只是在喃喃自語,像是沉浸在了拖延閱讀而產生的愧疚情緒中,完全迴避了這個提問。

Dolly則一如既往的表現穩定,按照指令給出了5本科幻小說的書名及其作者。

ChatGPT對於這個問題給出了更豐富的回答,不僅包括書名和作者,還對每一本書的內容、類型作了簡要評述和介紹。

你要Close,我就Open

對於很多公司而言,寧願自己建立一個不那麼強的模型,也不願將資料傳送給那些只提供API的大語言模型供應商。

其中一個重要原因是,這些問題和資料集是公司最敏感和專有的智慧財產權,直接將其交給第三方顯然是不靠譜的。

此外,公司本身可能在模型品質、成本和期望行為方面有不同的權衡,一種可自訂化的語言模型更符合需求。

現在,Dolly的發布給了他們希望——即使是一個「過時」的開源大型語言模型(LLM),也能通過30分的訓練,賦予它神奇的類似ChatGPT的指令跟隨能力。

不難想像,大語言模式或許很快就不是AI巨頭獨佔的玩法了!

正如公司CEO Ali Ghodsi所說,「我們的信念是,讓全世界的每個組織都能利用這些技術。」

以上是0門檻克隆ChatGPT! 30分鐘訓完,60億參數表現堪比GPT-3.5的詳細內容。更多資訊請關注PHP中文網其他相關文章!

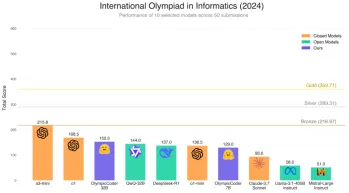

擁抱面部是否7B型號奧林匹克賽車擊敗克勞德3.7?Apr 23, 2025 am 11:49 AM

擁抱面部是否7B型號奧林匹克賽車擊敗克勞德3.7?Apr 23, 2025 am 11:49 AM擁抱Face的OlympicCoder-7B:強大的開源代碼推理模型 開發以代碼為中心的語言模型的競賽正在加劇,擁抱面孔與強大的競爭者一起參加了比賽:OlympicCoder-7B,一種產品

4個新的雙子座功能您可以錯過Apr 23, 2025 am 11:48 AM

4個新的雙子座功能您可以錯過Apr 23, 2025 am 11:48 AM你們當中有多少人希望AI可以做更多的事情,而不僅僅是回答問題?我知道我有,最近,我對它的變化感到驚訝。 AI聊天機器人不僅要聊天,還關心創建,研究

Camunda為經紀人AI編排編寫了新的分數Apr 23, 2025 am 11:46 AM

Camunda為經紀人AI編排編寫了新的分數Apr 23, 2025 am 11:46 AM隨著智能AI開始融入企業軟件平台和應用程序的各個層面(我們必須強調的是,既有強大的核心工具,也有一些不太可靠的模擬工具),我們需要一套新的基礎設施能力來管理這些智能體。 總部位於德國柏林的流程編排公司Camunda認為,它可以幫助智能AI發揮其應有的作用,並與新的數字工作場所中的準確業務目標和規則保持一致。該公司目前提供智能編排功能,旨在幫助組織建模、部署和管理AI智能體。 從實際的軟件工程角度來看,這意味著什麼? 確定性與非確定性流程的融合 該公司表示,關鍵在於允許用戶(通常是數據科學家、軟件

策劃的企業AI體驗是否有價值?Apr 23, 2025 am 11:45 AM

策劃的企業AI體驗是否有價值?Apr 23, 2025 am 11:45 AM參加Google Cloud Next '25,我渴望看到Google如何區分其AI產品。 有關代理空間(此處討論)和客戶體驗套件(此處討論)的最新公告很有希望,強調了商業價值

如何為抹布找到最佳的多語言嵌入模型?Apr 23, 2025 am 11:44 AM

如何為抹布找到最佳的多語言嵌入模型?Apr 23, 2025 am 11:44 AM為您的檢索增強發電(RAG)系統選擇最佳的多語言嵌入模型 在當今的相互聯繫的世界中,建立有效的多語言AI系統至關重要。 強大的多語言嵌入模型對於RE至關重要

麝香:奧斯汀的機器人需要每10,000英里進行干預Apr 23, 2025 am 11:42 AM

麝香:奧斯汀的機器人需要每10,000英里進行干預Apr 23, 2025 am 11:42 AM特斯拉的Austin Robotaxi發射:仔細觀察Musk的主張 埃隆·馬斯克(Elon Musk)最近宣布,特斯拉即將在德克薩斯州奧斯汀推出的Robotaxi發射,最初出於安全原因部署了一支小型10-20輛汽車,並有快速擴張的計劃。 h

AI震驚的樞軸:從工作工具到數字治療師和生活教練Apr 23, 2025 am 11:41 AM

AI震驚的樞軸:從工作工具到數字治療師和生活教練Apr 23, 2025 am 11:41 AM人工智能的應用方式可能出乎意料。最初,我們很多人可能認為它主要用於代勞創意和技術任務,例如編寫代碼和創作內容。 然而,哈佛商業評論最近報導的一項調查表明情況並非如此。大多數用戶尋求人工智能的並非是代勞工作,而是支持、組織,甚至是友誼! 報告稱,人工智能應用案例的首位是治療和陪伴。這表明其全天候可用性以及提供匿名、誠實建議和反饋的能力非常有價值。 另一方面,營銷任務(例如撰寫博客、創建社交媒體帖子或廣告文案)在流行用途列表中的排名要低得多。 這是為什麼呢?讓我們看看研究結果及其對我們人類如何繼續將

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

EditPlus 中文破解版

體積小,語法高亮,不支援程式碼提示功能

SublimeText3 英文版

推薦:為Win版本,支援程式碼提示!

MinGW - Minimalist GNU for Windows

這個專案正在遷移到osdn.net/projects/mingw的過程中,你可以繼續在那裡關注我們。 MinGW:GNU編譯器集合(GCC)的本機Windows移植版本,可自由分發的導入函式庫和用於建置本機Windows應用程式的頭檔;包括對MSVC執行時間的擴展,以支援C99功能。 MinGW的所有軟體都可以在64位元Windows平台上運作。