Heim >Technologie-Peripheriegeräte >KI >„ChatGPT wurde von Schulen und großen Unternehmen blockiert, was zu sozialer Panik führte.'

„ChatGPT wurde von Schulen und großen Unternehmen blockiert, was zu sozialer Panik führte.'

- PHPznach vorne

- 2023-04-24 17:19:091892Durchsuche

Im Dezember, als ChatGPT immer beliebter wurde, warnten viele Wissenschaftler und Forscher, dass ChatGPT wahrscheinlich Universitätsarbeiten „zerstören“ würde. Kürzlich hat das New Yorker Bildungsministerium offiziell eine Verbotsanordnung für ChatGPT erlassen.

Zufälligerweise wurde ChatGPT auch von vielen großen Internetunternehmen blockiert. Viele Programmierer, die sich daran gewöhnt haben, bei Codierungsproblemen ChatGPT zu konsultieren, brachen in Tränen aus...

Große Hersteller blockierten ChatGPT und Programmierer weinten

Kürzlich postete ein Programmierer online, dass in seiner großen Firma das WLAN in der Fabrik und im Büro deaktiviert sei ChatGPT. Das brach ihn sofort zusammen.

Der Blogger sagte, er sei ein Junior-Softwareentwickler und im Team seien die Senioren immer beschäftigt und hätten keine Zeit, ihm das Problem zu erklären.

ChatGPT ist sein Retter, wenn er bei der Arbeit nicht weiterkommt.

Aber gestern, als er sich ins Büro setzte, stellte er plötzlich fest, dass er keinen Zugriff auf ChatGPT hatte! Er durchbrach sofort die Verteidigung.

Unter seinem Beitrag machten begeisterte Internetnutzer Vorschläge.

Kaufen Sie beispielsweise einen günstigen VPS- und Domainnamen und richten Sie einen Reverse-Proxy für die offizielle ChatGPT-Website ein. Aktivieren Sie DoH und ECH im Browser. Oder senden Sie die Ausgabe per E-Mail an sich selbst .

Natürlich stimmten einige Internetnutzer der Vorgehensweise des Unternehmens zu: „Es ist für Ihr Unternehmen sinnvoll, ChatGPT zu verbieten. Denken Sie sorgfältig darüber nach. Wenn der Code, den Sie zur Lösung der Probleme des Unternehmens verwenden, leicht von Wettbewerbern erhalten werden kann.“ , Was werden die Konsequenzen sein?

Tatsächlich haben einige große Unternehmen E-Mails an Mitarbeiter gesendet, in denen es heißt: „ChatGPT ist nicht unbrauchbar, aber wenn Sie Code darauf hochladen, Wir laufen Gefahr, gefeuert zu werden, weil unser Code sehr sensibel ist. Einige Internetnutzer gaben jedoch eine herzzerreißende Antwort: „Wenn ein Junior-Entwickler seine Arbeit nicht ohne ChatGPT abschließen kann, wird er enttäuscht sein.“ Das Unternehmen ist wirklich entbehrlich.“ Verbot.“

Tatsächlich haben einige große Unternehmen E-Mails an Mitarbeiter gesendet, in denen es heißt: „ChatGPT ist nicht unbrauchbar, aber wenn Sie Code darauf hochladen, Wir laufen Gefahr, gefeuert zu werden, weil unser Code sehr sensibel ist. Einige Internetnutzer gaben jedoch eine herzzerreißende Antwort: „Wenn ein Junior-Entwickler seine Arbeit nicht ohne ChatGPT abschließen kann, wird er enttäuscht sein.“ Das Unternehmen ist wirklich entbehrlich.“ Verbot.“

Mit anderen Worten: Weder Lehrer noch Schüler können ChatGPT in den Netzwerken und Geräten öffentlicher Schulen in New York City verwenden.

Kürzlich sind auch Schulbezirke in Los Angeles und Baltimore hinzugekommen.

Jenna Lyle, Sprecherin des New Yorker Bildungsministeriums, sagte, dass ChatGPT zwar schnelle und einfache Antworten auf Fragen liefern kann, das kritische Denken und die Problemlösungsfähigkeiten der Schüler jedoch nicht fördert sind wichtig für den akademischen und lebenslangen Erfolg.

Wenn der Zweck der Schule darin besteht, die Technologie hinter ChatGPT zu studieren, kann sie natürlich trotzdem einen Zugang beantragen.

Vorerst bleibt abzuwarten, welchen Einfluss ChatGPT auf das Risiko von Aufsatzbetrug haben wird, da Studierende weiterhin Zugriff auf ihre eigenen Geräte und Netzwerke außerhalb des Campus haben werden.

Die Haltung von Cobb County in Georgia ist nicht nur nicht so hart, sondern es besteht sogar großes Interesse an der Einführung von ChatGPT.

Ein Sprecher des Bezirks sagte: „In den Händen hochqualifizierter Lehrer aus Cobb County kann ChatGPT ein wertvolles Werkzeug sein, das das Verständnis der Schüler für akademische Inhalte ergänzt und den Schülern helfen kann, Fähigkeiten zum kritischen Denken zu entwickeln.“ In dieser Hinsicht glaubt auch Adam Stevens, der an der Brooklyn Tech, einer Elite-Highschool in New York, unterrichtet, dass die Deaktivierung von ChatGPT negative Auswirkungen haben wird.

Schließlich haben diese Leute vor 15 oder 20 Jahren, als Studenten „Antworten online finden“ konnten, Google auf diese Weise ins Visier genommen.

Stevens glaubt, dass der beste Weg, die Fähigkeiten von Schülern zum kritischen Schreiben zu entwickeln, darin besteht, „sie einzuladen, wissenswerte Dinge zu erkunden“ und sich vom formelhaften Schreibunterricht auf der Grundlage strenger Bewertungskriterien zu lösen.

„Natürlich, wenn Ihnen die Note am Ende des Semesters wichtiger ist, dann ist ChatGPT in der Tat eine Bedrohung.“

Ähnlich vertrat ein High-School-Englischlehrer in Sandy, Oregon, eine ähnliche Ansicht.

Teacher Shields verfügt über 25 Jahre Unterrichtserfahrung. Sie ist davon überzeugt, dass es nicht nötig ist, „über ChatGPT zu sprechen“.

Ihrer Meinung nach sollten Lehrer akzeptieren, dass KI ein Werkzeug ist, das Schüler nutzen können, so wie jeder Lehrer seinen Schülern den Umgang mit Suchmaschinen beibringt.

Viele Schüler haben Probleme damit, nichts zum Schreiben zu haben. Derzeit können Lehrer ChatGPT verwenden, um den Schülern zu zeigen, wie sie Aufforderungen generieren können, um ihr Schreiben anzuregen.

Teacher Shields hat ChatGPT einmal gebeten, über dasselbe Thema im Stil eines Siebtklässlers, eines Zehntklässlers und eines College-Studenten zu schreiben, und der Grad der Syntaxunterschiede zwischen den einzelnen Niveaus war erstaunlich. Es ist durchaus möglich, dieses KI-generierte Feedback zu nutzen, um Schülern zu zeigen, wie sie ihr Schreiben verbessern können.

ICML hat eine Klarstellung herausgegeben: Es dient hauptsächlich der Verhinderung von Plagiaten und hat keinen Einfluss auf das Polieren von Artikeln

Vor zwei Tagen gab die Internationale Konferenz für maschinelles Lernen ICML 2023 plötzlich bekannt, dass die Verwendung großer Sprachmodelle verboten ist ( B. ChatGPT), um den Inhalt von Aufsätzen zu generieren, es sei denn, diese Texte sind Teil der experimentellen Analyse.Schon als die Anfrage gestellt wurde, löste sie bei vielen Forschern Unmut aus: Rechtschreibprüfung und Textvorhersage basieren auf Sprachmodellen, warum dürfen wir sie nicht verwenden?

In diesem Zusammenhang kommentierte Turing-Preisträger Yann LeCun: „Große Sprachmodelle können nicht verwendet werden. Bedeutet das, dass sie durch mittlere und kleine Sprachmodelle ersetzt werden können?“

Dann tat er es nicht Vergessen Sie den Yin- und Yang-Satz: „Der ICML-Ethikkodex für das nächste Jahr sollte lauten: Forscher müssen verschiedene Berechnungen mit bloßen Händen und ohne die Hilfe von Computern durchführen; alle Arten von Grafiken müssen von Hand mit Stift und Papier gezeichnet werden; ab heute gilt …“ Amtssprache des ICML wird Schwedisch (Schweden:?)

Aufgrund der hitzigen Diskussion musste das ICML einen langen Artikel herausgeben, um diese Regelung zu erläutern. Zusammenfassend gibt es drei Hauptpunkte: Die

-Richtlinie verbietet Text, der vollständig von LLM „generiert“ wird, dies hat jedoch keinen Einfluss auf die Verwendung von LLM durch den Autor, um seinen eigenen Text zu bearbeiten oder zu polieren.

- Die Richtlinie besteht hauptsächlich darin, mögliche Probleme zu verhindern, die bei der Verwendung von LLM auftreten können, wie z. B. Plagiate.

- Derzeit gilt die Richtlinie nur für ICML2023. Diese Richtlinie kann sich bei zukünftigen Treffen ändern, wenn wir ein besseres Verständnis der LLMs und ihrer Auswirkungen auf das wissenschaftliche Publizieren erlangen.

Ankündigungslink: https://icml.cc/Conferences/2023/llm-policy

Ankündigungslink: https://icml.cc/Conferences/2023/llm-policy

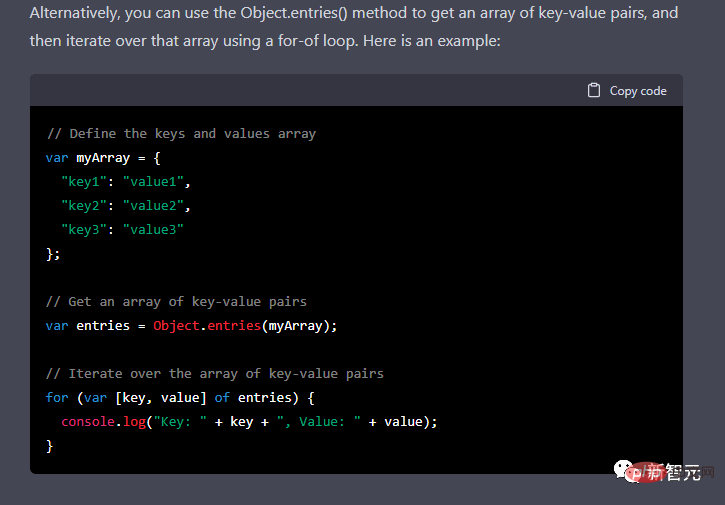

In den letzten Jahren haben sich groß angelegte Sprachmodelle (LLM) sehr schnell entwickelt. In letzter Zeit hat sich der Fortschritt nicht verlangsamt, sondern sogar beschleunigt. Wie Sie sehen, sind in den letzten Monaten veröffentlichte LLMs wie ChatGPT von OpenAI bereits in der Lage, Textausschnitte zu generieren, die von Menschen nicht zu unterscheiden sind. Es besteht kein Zweifel, dass dies ein aufregender Fortschritt in der Verarbeitung und Erzeugung natürlicher Sprache ist. Aber dieser schnelle Fortschritt geht oft mit unbeabsichtigten Konsequenzen und unbeantwortbaren Fragen einher. Entstehen beispielsweise die Texte und Bilder aus dem Modellroman oder sind sie Ableitungen bestehender Werke? Wem gehören außerdem die von diesen Modellen generierten Textausschnitte, Bilder und anderen Inhalte: der Benutzer, der das Modell generiert hat, der Entwickler, der das Modell trainiert hat, oder der Inhaltsersteller, der die Trainingsdaten erstellt hat? Sicherlich werden diese Fragen alle im Laufe der Zeit beantwortet, da großmaßstäbliche generative Modelle immer häufiger zum Einsatz kommen, aber noch nicht. Insbesondere sind seit der Veröffentlichung von ChatGPT (Ende November 2022) weniger als 2 Monate vergangen. Für ICML haben sie nicht genug Zeit, um die Auswirkungen von ChatGPT auf den Papierprüfungs- und Veröffentlichungsprozess zu beobachten und zu untersuchen. Die Berücksichtigung der Strategien, die für diese neue Technologie angenommen werden, wird sich direkt auf die Karrieren von Forschern auswirken. Daher sagte ICML, dass es nur vorsichtiger und sogar ein wenig konservativ sein könne. Obwohl ChatGPT oft als „dumm“ verspottet wird, haben sich in den mehr als einem Monat seit seiner Geburt die Arbeitsgewohnheiten vieler verändert Programmierer wurden dadurch tatsächlich verändert. Nachdem ChatGPT Anfang Dezember vorgestellt wurde, entdeckten Programmierer, dass es zum Generieren von Code verwendet werden kann, und waren sofort begeistert. ChatGPT kann nicht nur Fragen in jedem Bereich beantworten, sondern die generierten Antworten sind mit hoher Wahrscheinlichkeit auch sehr genau und detailliert. Als Sie beispielsweise fragten: „Wie man in Javascript über ein Schlüssel- und Wertearray iteriert“, wurde eine perfekte Antwort generiert. Das Tüpfelchen auf dem i ist, dass ChatGPT Ihnen durch ein unterstützendes Beispiel und eine Erklärung auch die beste Lösung für dieses häufige Problem in JavaScript nennen kann: Sie können es sogar zum Codieren von Fehlern verwenden Korrektur. Aber dann stellten die Programmierer sofort fest, dass der von ChatGPT generierte Code tatsächlich viele Probleme hatte. ChatGPT wird „dumm“ sein. Der Grund dafür ist eigentlich ganz einfach – die Ausgabe der KI ist probabilistisch. ChatGPT verfügt über keine internen Datensätze, die „richtig“ oder „falsch“ markieren. Es handelt sich tatsächlich um ein statistisches Modell. In diesem Modell handelt es sich um eine Kombination von Sprachen in verschiedenen Kontexten. Die Grundlage des Kontexts ist der Gesamtdatensatz, der für das GPT-3-Training verwendet wird, zusätzlicher Kontext aus dem RLHF-Training von ChatGPT, Eingabeaufforderungen und frühere Gespräche sowie Feedback, das in Kürze verfügbar sein wird. Die Antworten von ChatGPTs Antworten sind im Wesentlichen probabilistische Ergebnisse, die aus dem Internetdatenkorpus von GPT-3 gesammelt wurden. Innerhalb von 10 Sekunden erstellt ChatGPT eine möglichst genaue Einschätzung des Ergebnisses, das wahrscheinlich korrekt ist. Natürlich kann auch ein Fehler passieren. Als Internetnutzer den von ChatGPT generierten Code nutzten, um Stack Overflow mit falschen Antworten zu überschwemmen, erließ dieser über Nacht eine offizielle Verbotsanordnung. Obwohl die Fähigkeit von ChatGPT, Code zu schreiben, von vielen Leuten kritisiert wurde, kann es tatsächlich immer noch verwendet werden. Tatsächlich sollte ChatGPT am besten als Codierungsunterstützungstool eingesetzt werden. Laut OpenAI, dem Herausgeber von ChatGPT, besteht eine der wichtigen Verwendungsmöglichkeiten von ChatGPT darin, Programmierern bei der Überprüfung von Code zu helfen. Für Entwickler ist es nur ein Werkzeug in einer immer umfangreicher werdenden Werkzeugpalette. Und wie jedes selbstlernende Modell wird ChatGPT im Laufe der Zeit weiter lernen, sich selbst korrigieren und verbessern. Anstatt tagelang auf Stack OverFlow auf eine relativ einfache Frage zu warten (wie man den Neuaufbau von HookConsumerWidget in Flutter auslöst), ist es oft besser, die Frage direkt an ChatGPT zu stellen. Denn Entwickler haben bei ChatGPT eine hohe Wahrscheinlichkeit, einen Ausgangspunkt zu bekommen, der zur Lösung von Problemen genutzt werden kann——Groß angelegte Sprachmodelle voller Kontroversen

Von Zeit zu Zeit gibt es Fehler und Auslassungen, aber Programmierer lieben es immer noch

Das obige ist der detaillierte Inhalt von„ChatGPT wurde von Schulen und großen Unternehmen blockiert, was zu sozialer Panik führte.'. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr