Heim >Technologie-Peripheriegeräte >KI >Wang Wenbing, Leiter des Rokid-Algorithmus: „Sound' unter AR ist in einem „wunderbaren' Zustand

Wang Wenbing, Leiter des Rokid-Algorithmus: „Sound' unter AR ist in einem „wunderbaren' Zustand

- PHPznach vorne

- 2023-04-12 19:46:081637Durchsuche

Klang ist in unserem täglichen Leben allgegenwärtig und ein unverzichtbarer Bestandteil, und das Gleiche gilt auch in der Metaversum-Welt. Um ein umfassendes Eintauchen in die Szenen des Metaversums zu erreichen, ist eine kontinuierliche Aktualisierung und Weiterentwicklung verschiedener Tontechnologien erforderlich. Auf der kürzlich von 51CTO abgehaltenen „AISummit Global Artificial Intelligence Technology Conference“ hielt Wang Wenbing, der Leiter des Rokid-Algorithmus, in „Wonderful“ eine Grundsatzrede zum Thema „Sound“ unter AR. Land“, Es stellte das Konzept, die wichtigsten technischen Module, technische Schwierigkeiten, Entwicklungstrends der Kombination mit AR und die ursprüngliche Absicht der Entwicklung der Technologie des von Rokid selbst entwickelten 6DoF-Raumklangfelds vor und erläuterte die wichtige Verkörperung der Raumklangfeldtechnologie in die metaverse Welt.

Der Vorlesungsinhalt ist nun wie folgt organisiert:

Was ist das räumliche 6dof-Schallfeld?

Wenn Sie über dieses Thema sprechen, können Sie zunächst die technischen Einschränkungen beiseite legen und sich vorstellen, wie der Ton auf AR dargestellt werden soll. Tatsächlich verfügen die meisten Fernseher und Mobiltelefone, die wir heute verwenden, über zwei Kanäle wie Stereo. Heimkinos haben bereits Mehrkanalgeräte verwendet, und professionelle Szenen wie Kinos verfügen ebenfalls über Lautsprecher mit räumlicher Anordnung.

Wie soll es auf AR dargestellt werden? Wir können uns eine Szene wie Online-Meetings oder Online-Bildung vorstellen, die jetzt sehr beliebt sind. Wenn Sie die digitale Person auf der rechten Seite in der Metaversum-Welt die ganze Zeit reden sehen, die Stimme aber von links kommt, fühlt es sich dann seltsam an? diesmal?

Darüber hinaus können wir uns AR-Spiele vorstellen. In der bisherigen 2D-Sicht kann sich der Ton mit dem Sehfokus bewegen, im 360-Grad-Bereich der 3D-Szene kann das menschliche Auge jedoch nicht die gesamte Szene erfassen. Der visuelle Fokus liegt im Fokus, während der Ton einen globalen Fokus hat. Aus diesem Grund wechseln die Spieler in vielen Spielen je nach Klang die Perspektive. Daher können wir einige der Eigenschaften erkennen, die Sound in AR haben muss: Er muss der hohen Klangempfindlichkeit der Menschen, dem globalen Fokus von Sound und den Realismusanforderungen von Sound gerecht werden.

Als nächstes stellen wir die Entwicklung der Klangform aus drei Dimensionen vor.

Erstens die räumliche Ausdrucksdimension. Die Ausdrucksdimension des gesamten Klangs reicht von Mono/Stereo über Mehrkanal in einer Ebene wie 5.1/7.1/9.1/... bis hin zu Mehrkanal in einem Raum wie 5.1. Es gibt immer mehr und Auch die Platzierungsposition hat sich von der Ebene zum Raum vergrößert.

Zweitens die Dimension der Kodierungsmethode. Von Anfang an kanalbasiert (d. h. kanalbasierte Codierung, jeder Kanal verfügt über eine Vielzahl von Klängen, wie z. B. unsere üblichen Ausdrücke des linken und rechten Kanals) bis hin zu objektbasiert (d. h. für die Objekte). Wenn beispielsweise eine Kanonenkugel abgeschossen wird, wird das Objekt dieser Kanonenkugel speziell kodiert und ihre Bewegungsbahn in den Metadaten aufgezeichnet Basierend auf der entsprechenden Lautsprecherposition wird jedoch ein Effekt erzielt, der vollständig auf der Szene basiert, ähnlich der Panorama-Sound-Methode wie HOA, nicht nur der Kanonenkugeln, sondern auch des Fallens von Blumen, Gras und Blättern . Wir alle hoffen, dass es Raumgefühl haben kann.

Drittens die XR-Erlebnisdimension. In der Vergangenheit war der virtuelle Ton von der realen Welt getrennt. Was wir jetzt in XR, insbesondere in AR, tun, ist die Integration von virtueller und realer Welt.

Der Grund, warum Menschen Geräusche so detailliert unterscheiden können, ist der binaurale Modus. Technisch gesehen handelt es sich um ITD und ILD, also den Zeitunterschied und die Schallintensitätsdifferenz zwischen den beiden Ohren. Diese beiden Unterschiede helfen uns, die Richtung des Klangs des Objekts schnell zu lokalisieren.

Wie macht man also 3D-Sound populär? Wie kann man die Beschränkungen des Veranstaltungsortes überwinden? Wie können die Verbrauchskosten der Benutzer gesenkt werden? Wie kann jeder Spaß an der Technologie haben? Das von Rokid selbst entwickelte räumliche 6dof-Schallfeld wird zur Lösung dieser Probleme beitragen.

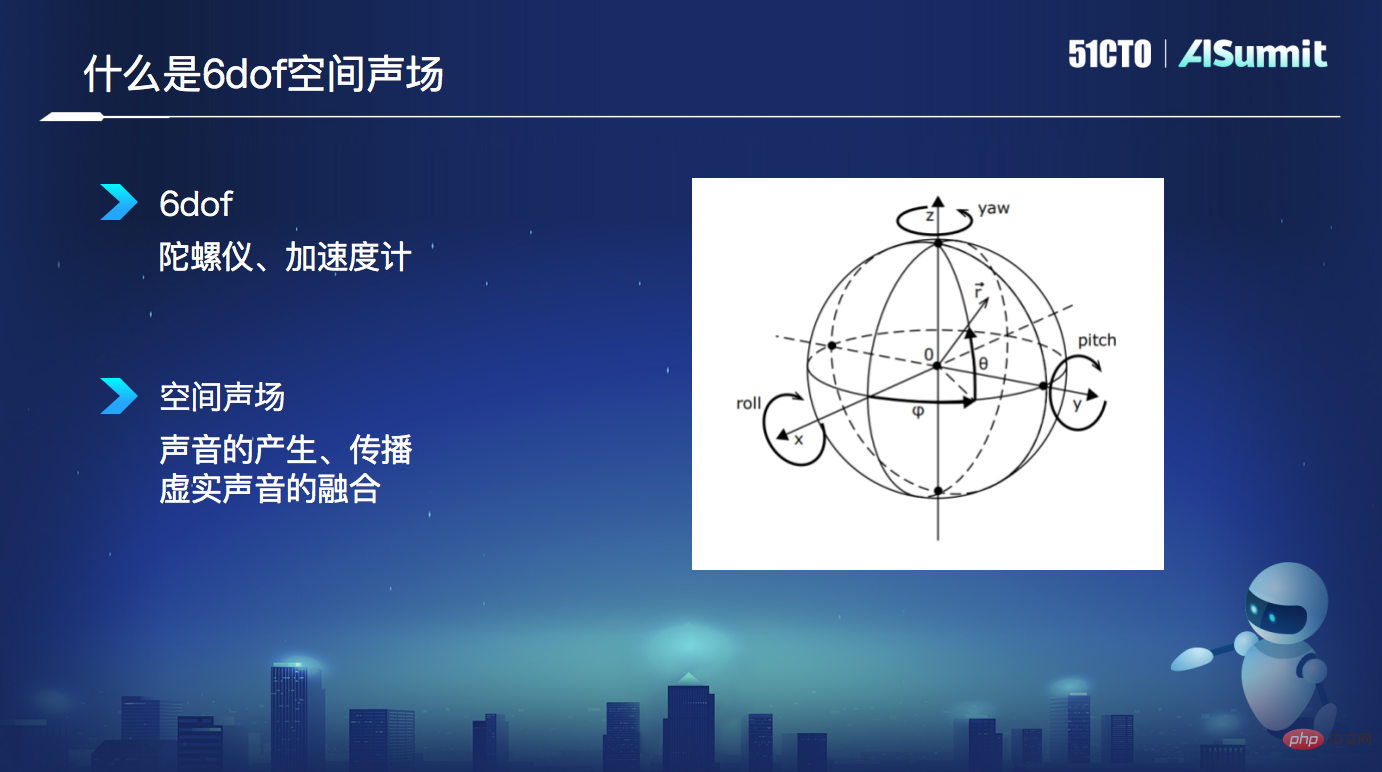

6dof räumliches Schallfeld kann vom Namen her in zwei Teile unterteilt werden: 6dof und räumliches Schallfeld. 6dof drückt hauptsächlich sechs Freiheitsgrade aus. Das Gyroskop sorgt für eine Drehung um die drei Richtungen von XYZ, und der Beschleunigungsmesser sorgt für eine Beschleunigung in den drei Richtungen von XYZ.

6dof räumliches Schallfeld umfasst die Erzeugung, Ausbreitung, Wiedergabe, Kodierung und Dekodierung von Schall sowie die Verschmelzung und Interaktion von virtuellen und realen Klängen während des gesamten Prozesses.

Die Haupttechnologie des räumlichen 6dof-Schallfelds

Zu den wichtigsten Technologiemodulen des räumlichen 6dof-Schallfelds gehören HRTFs, Schallfeldwiedergabe und Soundeffekte . HRTFs ist die Stoßfunktion der Schallquelle vom freien Feld zum Trommelfell. Dabei handelt es sich um den Prozess der Übertragung von Rundumschall an das menschliche Ohr in einer simulierten schalltoten Kammerumgebung. Durch die Schallfeldwiedergabe können Menschen die Position von Geräuschen durch Zuhören unterscheiden und virtuelle und reale Objekte verschmelzen, um die Auswirkungen realer Objekte auf virtuelle Schallquellen perfekt zu bewältigen. Der Soundeffekt soll die Klangqualität verbessern, indem offene Lautsprecher verwendet werden, die auf Privatsphäre ausgelegt sind, um Schallverluste zu reduzieren und die Lautstärke sicherzustellen.

Das SDK oben im Architekturdiagramm stellt externe räumliche Module bereit, nämlich räumliche Engine-Exporte und Sprach-Engine-Exporte. Es können räumliche Informationen erfasst und modelliert werden, die zur Integration der digitalen und physischen Welt beitragen.

Darüber hinaus haben wir auch einige Modifikationen am Room Effect vorgenommen. Sein Gesamtrahmen ähnelt der klassischen Netzwerkstruktur. Anschließend wird ein theoretisches verlustfreies Netzwerk erstellt. Anschließend werden auf der Grundlage dieser Theorie verschiedene Dämpfungs- und Verlusteinstellungen vorgenommen, darunter Absorption, Okklusion, Reflexion. usw. Tatsächlich besteht unser eigener Zweck nicht darin, verschiedene Soundeffekte zu erzeugen, die auf den Nutzungsszenarien des Produkts basieren, wie z. B. Theater oder Musik, damit Benutzer ein gutes audiovisuelles Erlebnis erzielen können über die AR-Brille der nächsten Generation Rokid Max.

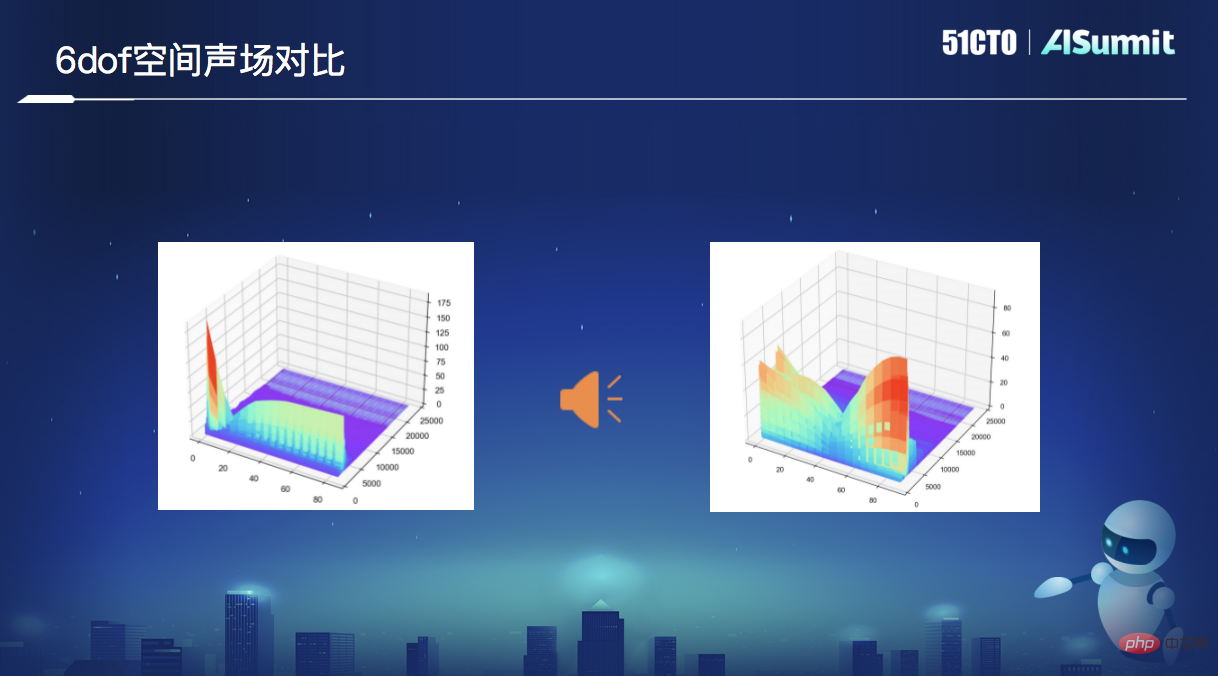

6dof räumlicher Schallfeldvergleich. Die linke Seite ist der Effekt eines SDK eines Drittanbieters. Beim Drehen von 0 Grad auf 90 Grad ist die Änderung jeder Frequenz nicht gleichmäßig, und die Abnahme ist zunächst stark, und die nachfolgenden Änderungen sind sehr gering. Das von Rokid erstellte räumliche 6dof-Schallfeld auf der rechten Seite weist offensichtliche Änderungen in verschiedenen Frequenzbändern auf, wenn sich Ihre Position ändert. Das Bild zeigt die Leistung verschiedener Winkel, verschiedener Frequenzbänder und verschiedener Amplituden.

... Der Entwicklungstrend räumlicher Klangfelder spiegelt sich hauptsächlich in drei Aspekten wider:

Der Entwicklungstrend räumlicher Klangfelder spiegelt sich hauptsächlich in drei Aspekten wider:

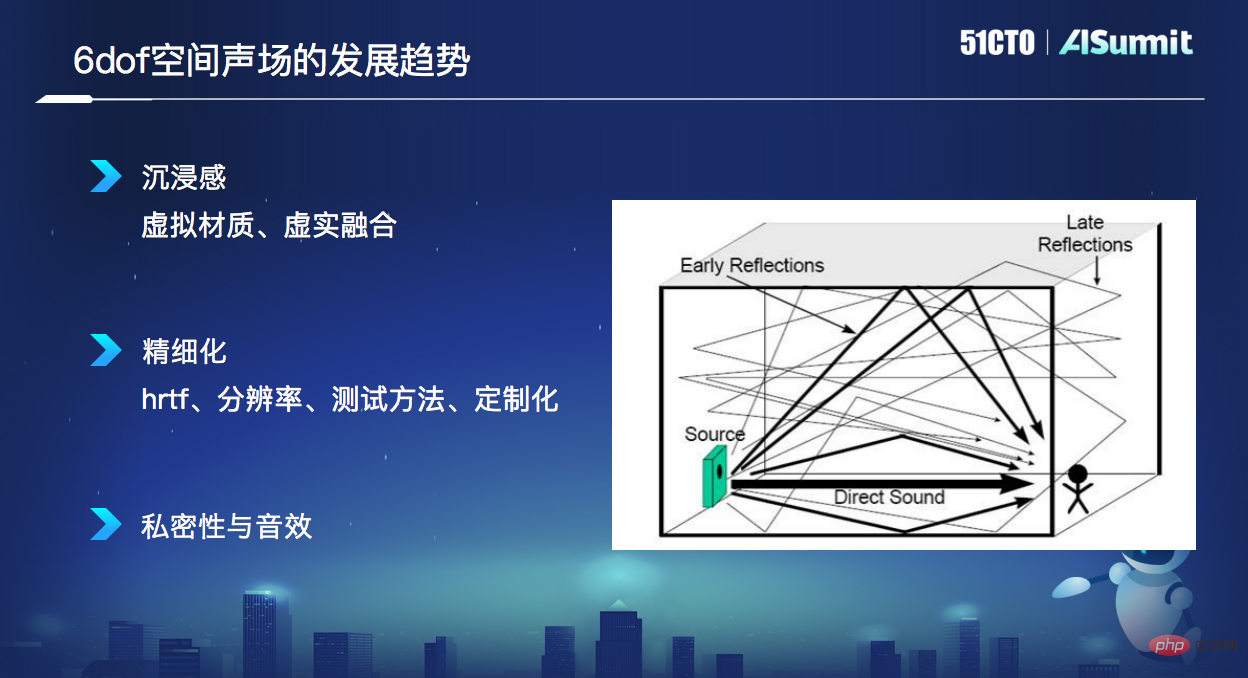

Alle Geräusche in der virtuellen Welt sollten nicht frei vom Einfluss irgendwelcher Objekte in der realen Welt sein, da dies den Menschen das Gefühl gibt, dass sie immer noch getrennt sind. Zusätzlich zur Integration ist auch Interaktion erforderlich. In der virtuellen Welt können Sie beispielsweise über verschiedene Methoden wie Sprache und Gesten mit dem verbesserten Sound auf dem AR-Terminal interagieren und zwischen verschiedenen Fenstern pausieren, abspielen oder wechseln Ebenen und Perspektiven, oder um Ihren eigenen Weg zu finden. Stimmen von Interesse und mehr.

Die zweite Stufe ist die Verfeinerung, die eine verfeinerte Erkundung und Übung verschiedener Aspekte wie HRTF, Auflösung, Testmethoden und Anpassung umfasst. Der Kopfpass ist schwieriger zu verfeinern, da die Erzeugungsmethode des Kopfpasses selbst zeitaufwändiger und mühsamer ist. Es muss jeder Punkt in unterschiedlichen Abständen im gesamten Kugelraum abgespielt und dann der Gehörgang abgetastet werden . Derzeit untersuchen einige Wissenschaftler, wie man mit weniger Abtastpunkten den gleichen Grad an Verfeinerung erzielen und gleichzeitig durch Interpolation oder andere technische Mittel eine höhere Genauigkeit erreichen kann. Aus einer längerfristigen Perspektive wird die Verfeinerung angepasst Durchführung.

Das dritte Thema sind Privatsphäre und Soundeffekte. Erleben Sie den Hörgenuss, der durch Klänge in verschiedenen Frequenzbändern entsteht. Unterschiedliche Harmonische oder unterschiedliche Frequenzbänder geben uns unterschiedliche Gefühle. Beispielsweise beeinträchtigt ein starker Nachhall das menschliche Gehör, während ein angemessener Nachhall ein reichhaltiges Hörerlebnis in Bezug auf die Klangqualität mit sich bringt. Er wird häufig zur Beurteilung der Klangfarbe verwendet, die niedriger als 3K ist. Der Nachhall und die seitliche Reflexion tragen zur Erzeugung bei ein besseres Raum- und Tiefengefühl, während die Hochfrequenzkomponente uns dabei hilft, ein Surround-Gefühl zu erreichen.

Die ursprüngliche Absicht, räumliche Klangfelder zu erforschen

Warum erzeugt Rokid räumliche Klangfelder? Es gibt drei Hauptgründe:

Erstens das Eintauchen. Wir haben die Integration der digitalen Welt und der physischen Welt angestrebt, beispielsweise die Lebendigkeit beim Spielen, die Realität bei Online-Meetings oder Online-Bildung.

Zweitens die Interaktion zwischen virtuell und real. Wir glauben, dass die Zukunft dieser Welt eine Verschmelzung von Realität und Realität sein wird. Auf der Grundlage der Verschmelzung können viele Interaktionen erfolgen, einschließlich des Prozesses der räumlichen Wahrnehmung, der Interaktion subjektiver Verhaltensweisen usw. Räumliche Wahrnehmung bezieht sich auf Aspekte der Welt wie die Größe von Objekten, die Größe des Raums, Materialien usw. Diese Wahrnehmung wirkt sich dann auf virtuelle Geräusche aus; die Interaktion von subjektivem Verhalten ist menschliches Eingreifen, Auswahl und Interaktion mit Geräuschen in die digitale Welt kommunizieren.

Drei, ultimative Qualität. AR Glass unterscheidet sich von Mobiltelefonen, Tablets, Fernsehern und anderen Produkten. Wenn Sie Ihr Mobiltelefon verwenden, sind Netzwerkunterbrechungen oder Verzögerungen tolerierbar, aber die Echtzeitanforderungen für AR-Glas, das Sie am Auge tragen, sind sehr hoch. Wie können wir diesen hohen Echtzeitanspruch erreichen? Dies beinhaltet die Gesamtoptimierung von Algorithmen, Technik, Systemen, Hardware und Anwendungen.

Dies sind die Missionen, die wir verfolgt haben, um diese Funktionen durch AR-Glass-Produkte direkt bekannt zu machen. Gleichzeitig hoffen wir, diese Technologien als grundlegende Funktionen in unserem Yoda-Betriebssystem freizugeben. um die Mehrheit der Benutzer zu erreichen. Die Verwendung durch Entwickler kommt den Benutzern indirekt zugute und stärkt alle Lebensbereiche. 🔜

Das obige ist der detaillierte Inhalt vonWang Wenbing, Leiter des Rokid-Algorithmus: „Sound' unter AR ist in einem „wunderbaren' Zustand. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr