Heim >Technologie-Peripheriegeräte >KI >Was soll ich tun, wenn die KI „er, sie, es' nicht verstehen kann? Verben sind zu einem neuen Durchbruch geworden. Wenn der Roboter Butter hört, weiß er, wie man Messer und Gabel aufnimmt.

Was soll ich tun, wenn die KI „er, sie, es' nicht verstehen kann? Verben sind zu einem neuen Durchbruch geworden. Wenn der Roboter Butter hört, weiß er, wie man Messer und Gabel aufnimmt.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-12 19:46:01924Durchsuche

Wenn Sie der KI Anweisungen geben, haben Sie immer das Gefühl, dass die Kommunikation mit Menschen anders ist?

Ja, KI kann einige spezifische menschliche Anweisungen verstehen, wie zum Beispiel:

Helfen Sie, einen Stuhl aus dem Restaurant zu bewegen.

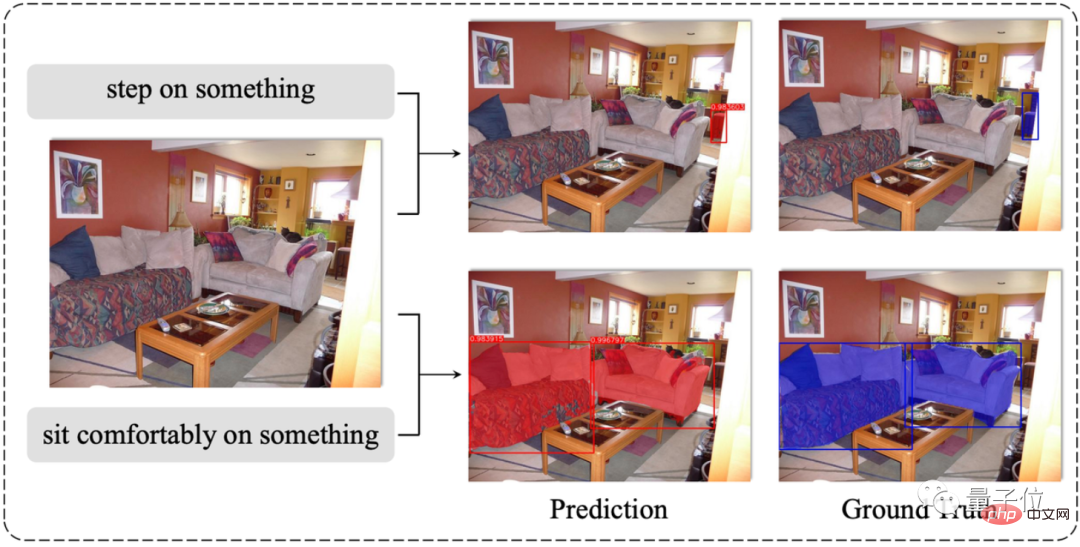

Aber wenn es durch vage Anweisungen mit nur Pronomen (er/sie/es/dies/das/das/Ding...) und Verben ersetzt würde, wäre die KI verwirrt:

Hilfe Finden Sie etwas, worauf Sie Ihre Füße legen können.

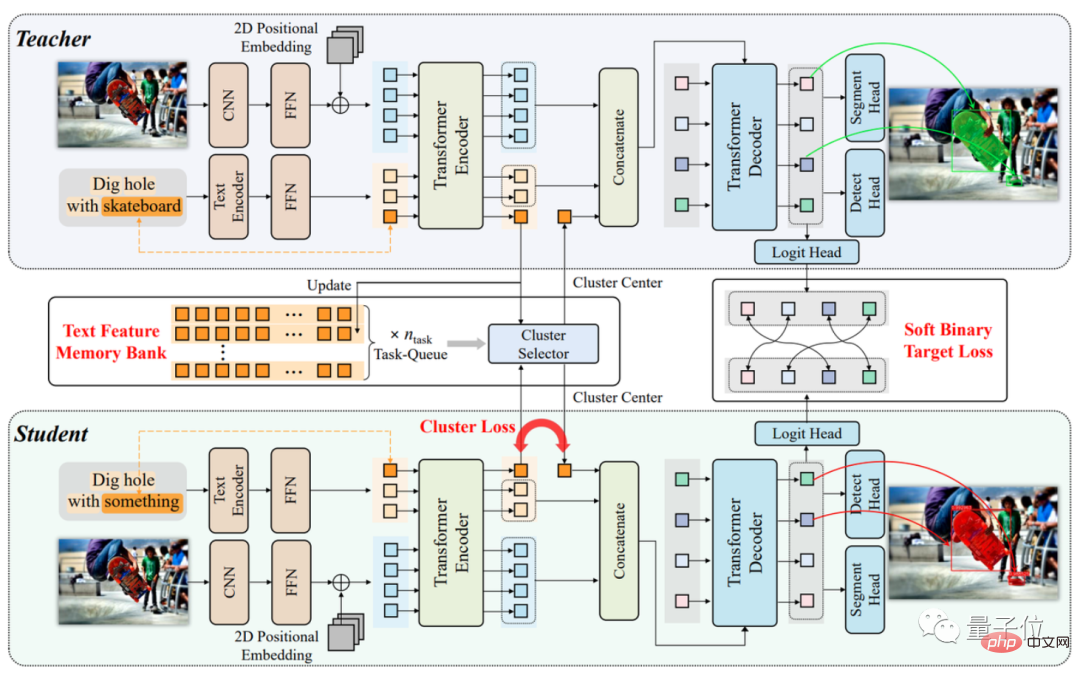

Jetzt haben einige Forscher endlich einen neuen Weg gefunden, damit umzugehen: Wäre es nicht genug, wenn die KI lernen würde, Verben zu verstehen?

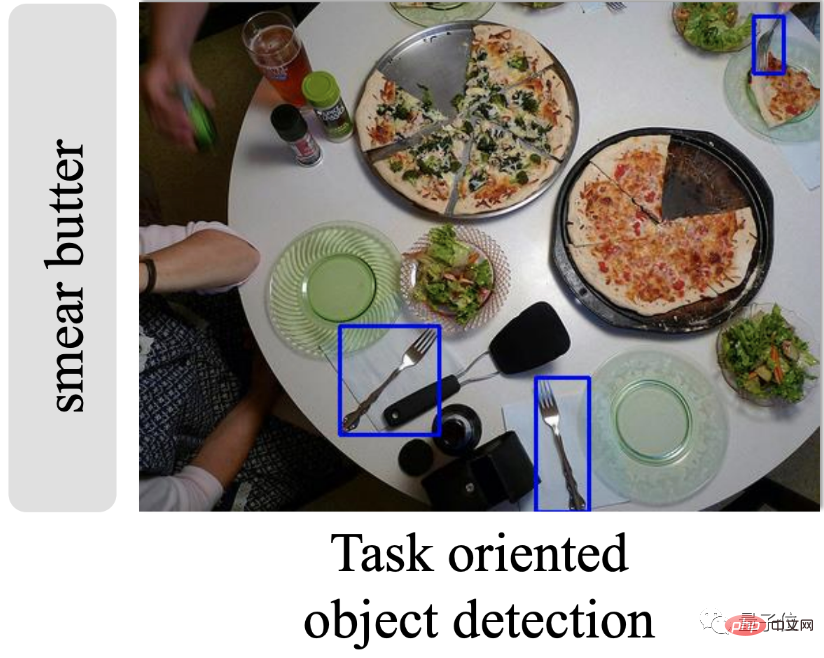

Das Verb selbst ist an einige bestimmte Substantive gebunden. Beispielsweise ist die Aktion „Butter verteilen“ definitiv untrennbar mit Substantiven wie „Messer“ und „Gabel“ verbunden.

Sie müssen sie nur zuordnen. Es sind auch keine Substantivbefehle wie „Messer und Gabel“ erforderlich, um das Zielobjekt genau zu finden:

# 🎜🎜 #

# 🎜🎜 #

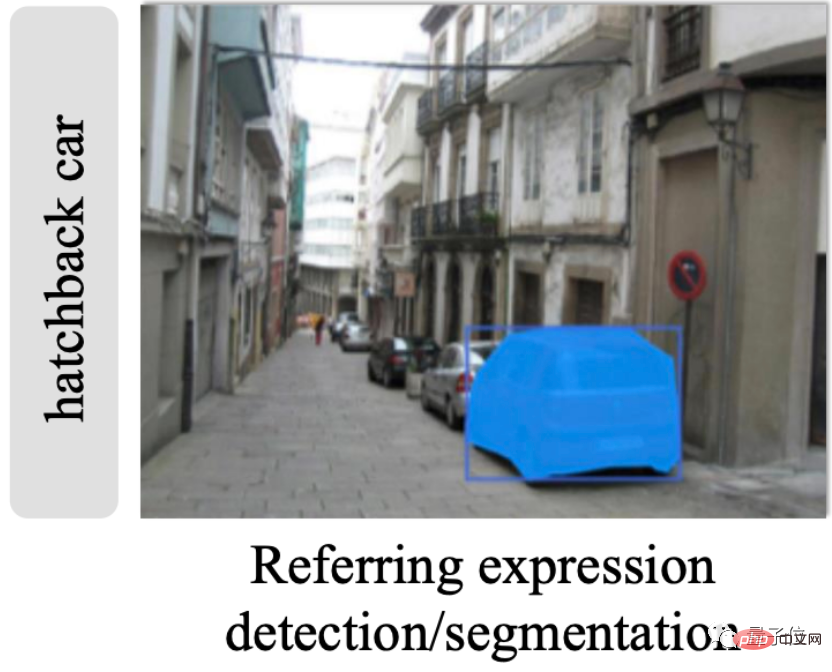

Die Instanzsegmentierung unterscheidet sich vom „vollständigen Bildausschnitt“ der semantischen Segmentierung. Im folgenden Bild wird beispielsweise das Substantiv „Fließheckauto“ verwendet direkt finden Geben Sie das entsprechende Objekt aus:

Auf diese Weise kann die KI das richtige Substantiv aus dem Nichts erraten und das richtige Ziel im Bild segmentieren: #🎜🎜 ##🎜🎜 #

Auf diese Weise kann die KI das richtige Substantiv aus dem Nichts erraten und das richtige Ziel im Bild segmentieren: #🎜🎜 ##🎜🎜 #

Zielerkennungsgenauigkeit um 10,9 % erhöht

Zielerkennungsgenauigkeit um 10,9 % erhöht

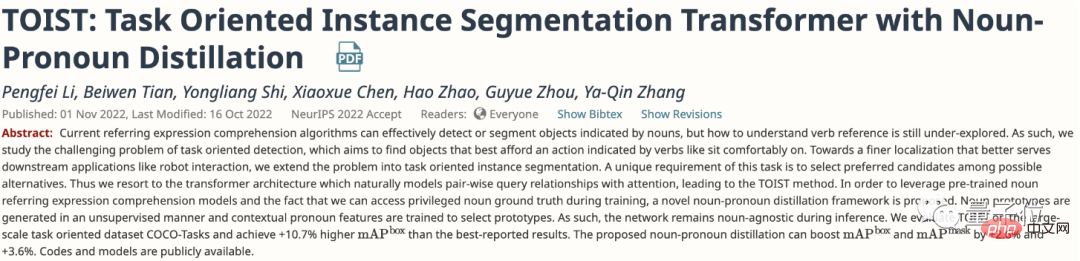

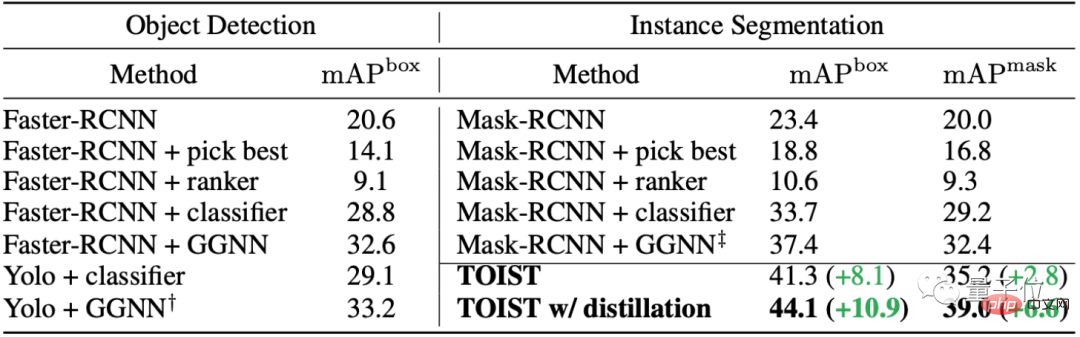

Das Papier testete TOIST am groß angelegten Aufgabendatensatz COCO-Tasks.

Die Bewertungsmethode verwendet mAP (mean Average Precision), was bei visuellen Aufgaben wie der Zielerkennung üblich ist.

Einfach ausgedrückt: TOIST schneidet besser ab als das vorherige Instanzsegmentierungs- und Zielerkennungsmodell SOTA, und mit der „erweiterten Version“ TOIST, die durch die Nomen-Pronomen-Destillationsmethode hinzugefügt wird, ist die Leistung sogar besser als TOIST . Gehen Sie eine Etage höher.

Unter anderem stieg bei der Zielerkennungsaufgabe die „erweiterte Version“ von TOISTs Entscheidungsbox-Genauigkeit mAP um 10,9 % und bei der Instanzsegmentierungsaufgabe die Maskengenauigkeit war 6,6 % höher als Mask-RCNN+GGNN.

Was die vorgeschlagene Nomen-Pronomen-Destillationsmethode betrifft, wurde die Genauigkeit der Instanzsegmentierungsaufgabe im Vergleich zur Originalversion von TOIST um 2.8 verbessert % bzw. 3,8 %.

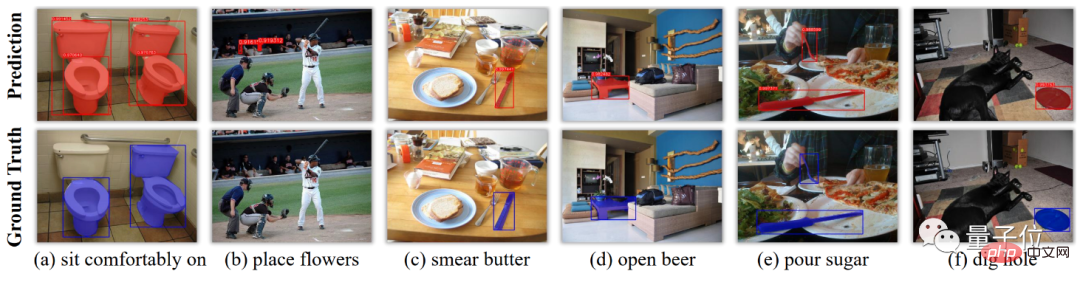

In Abbildung (d) hat der Algorithmus beispielsweise sogar erkannt, dass der Bierflaschenverschluss mithilfe eines Tisches geöffnet werden kann, was als perfekte Bewertung für das Verständnis bezeichnet werden kann:

Bezüglich der ursprünglichen Absicht, dies zu tun Nachforschungen antwortete der Autor:

Unser Labor ist eigentlich für die Erforschung von Robotern verantwortlich, aber bei täglichen Umfragen haben wir herausgefunden, dass Benutzer es manchmal vorziehen, dem Roboter „Bedürfnisse“ zu beschreiben, anstatt ihm direkt zu sagen, was er tun soll.

Mit anderen Worten, KI-Algorithmen werden verwendet, um den Roboter dazu zu bringen, „noch einen Schritt zu denken“, anstatt nur ein Assistent zu sein, der Befehle befolgt.

Vorstellung des Autors

Die Autoren dieses Artikels kommen vom Tsinghua University Intelligent Industry Research Institute (AIR), der Peking University und dem Intel Research Institute. Einer der Autoren ist auch der Dekan des AIR.

Li Pengfei, der Erstautor des Artikels, ist Doktorand am Institut für Intelligente Industrie der Tsinghua-Universität. Zu seinen Forschungsinteressen gehört das autonome Fahren und Computer Vision.

Der korrespondierende Autor Zhao Hao ist neuer Assistenzprofessor am Intelligent Industry Research Institute der Tsinghua-Universität, Forschungswissenschaftler am Intel China Research Institute und gemeinsamer Postdoktorand an der Peking-Universität. Er schloss sein Studium an der Fakultät für Elektrotechnik ab an der Tsinghua-Universität. Seine Forschungsinteressen sind Roboter und Computer.

Papieradresse: https://arxiv.org/abs/2210.10775

Projektadresse: https://github.com/AIR-DISCOVER/TOIST

Das obige ist der detaillierte Inhalt vonWas soll ich tun, wenn die KI „er, sie, es' nicht verstehen kann? Verben sind zu einem neuen Durchbruch geworden. Wenn der Roboter Butter hört, weiß er, wie man Messer und Gabel aufnimmt.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr