Heim >Technologie-Peripheriegeräte >KI >Überblick: Kollaborative Sensortechnologie für autonomes Fahren

Überblick: Kollaborative Sensortechnologie für autonomes Fahren

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-08 15:01:091469Durchsuche

arXiv-Rezensionspapier „Collaborative Perception for Autonomous Driving: Current Status and Future Trend“, 23. August 2022, Shanghai Jiao Tong University.

Die Wahrnehmung ist eines der Schlüsselmodule des autonomen Fahrsystems. Die begrenzten Fähigkeiten von Fahrrädern stellen jedoch einen Engpass für die Verbesserung der Wahrnehmungsleistung dar. Um die Beschränkungen der Einzelwahrnehmung zu durchbrechen, wird eine kollaborative Wahrnehmung vorgeschlagen, die es Fahrzeugen ermöglicht, Informationen auszutauschen und die Umgebung außerhalb der Sichtlinie und außerhalb des Sichtfelds wahrzunehmen. In diesem Artikel werden vielversprechende Arbeiten im Zusammenhang mit kollaborativer Sensortechnologie besprochen, einschließlich grundlegender Konzepte, kollaborativer Modelle sowie Schlüsselelemente und Anwendungen. Abschließend werden offene Herausforderungen und Fragestellungen in diesem Forschungsbereich diskutiert und weitere Richtungen aufgezeigt.

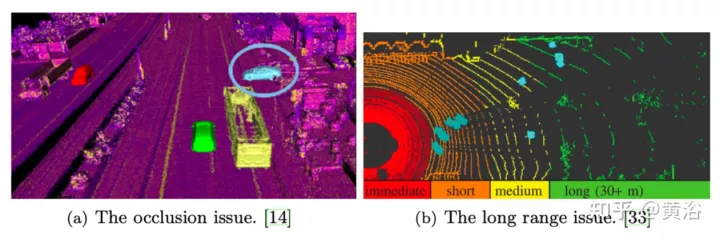

Wie in der Abbildung gezeigt, sind zwei wichtige Probleme bei der Einzelwahrnehmung Fernverdeckung und spärliche Daten. Die Lösung dieser Probleme besteht darin, dass Fahrzeuge im selben Bereich gemeinsame Wahrnehmungsinformationen (CPM, Collective Perception Message) miteinander teilen und die Umgebung gemeinsam wahrnehmen, was als kollaborative Wahrnehmung oder kooperative Wahrnehmung bezeichnet wird.

Dank des Aufbaus der Kommunikationsinfrastruktur und der Entwicklung von Kommunikationstechnologien wie V2X können Fahrzeuge zuverlässig Informationen austauschen und so eine Zusammenarbeit erreichen. Jüngste Arbeiten haben gezeigt, dass die kollaborative Sensorik zwischen Fahrzeugen die Genauigkeit der Umgebungswahrnehmung sowie die Robustheit und Sicherheit von Transportsystemen verbessern kann.

Außerdem sind autonome Fahrzeuge häufig mit hochpräzisen Sensoren für eine zuverlässige Wahrnehmung ausgestattet, was hohe Kosten verursacht. Durch kollaborative Sensorik können die strengen Anforderungen eines einzelnen Fahrzeugs an die Sensorausrüstung verringert werden.

Kooperative Sensorik teilt Informationen mit Fahrzeugen und Infrastruktur in der Nähe und ermöglicht es autonomen Fahrzeugen, bestimmte Wahrnehmungseinschränkungen wie Verdeckung und kurzes Sichtfeld zu überwinden. Um jedoch eine robuste kollaborative Erfassung in Echtzeit zu erreichen, müssen einige Herausforderungen gelöst werden, die durch Kommunikationskapazität und Rauschen verursacht werden. Kürzlich wurden in einigen Arbeiten Strategien für die kollaborative Wahrnehmung untersucht, darunter: Was ist Zusammenarbeit, wann sollte man zusammenarbeiten, wie sollte man zusammenarbeiten, Ausrichtung gemeinsamer Informationen usw.

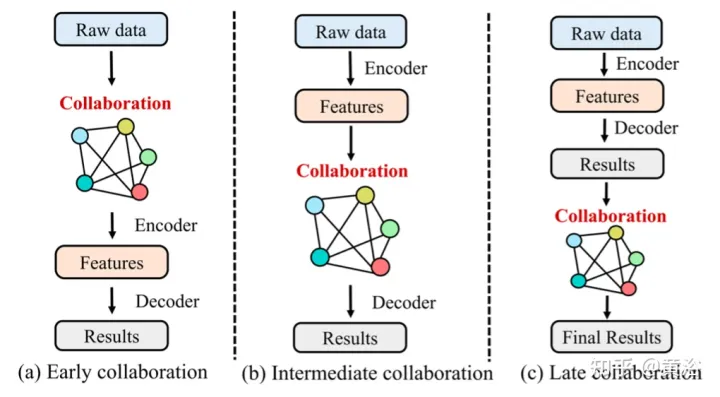

Ähnlich wie bei der Fusion gibt es 4 Kategorien der Zusammenarbeit:

1 Frühe Zusammenarbeit

Bei der frühen Zusammenarbeit wird im Eingaberaum zusammengearbeitet, wobei rohe Sensordaten zwischen Fahrzeugen und Infrastruktur ausgetauscht werden. Es fasst die Rohmessungen aller Fahrzeuge und Infrastruktur zusammen, um eine ganzheitliche Sicht zu erhalten. Daher kann jedes Fahrzeug die folgende Verarbeitung und vollständige Wahrnehmung basierend auf der Gesamtperspektive durchführen, wodurch die Okklusions- und Fernprobleme, die bei der Einzelwahrnehmung auftreten, grundsätzlich gelöst werden können.

Der Austausch roher sensorischer Daten erfordert jedoch umfangreiche Kommunikation und überlastet leicht das Kommunikationsnetzwerk durch übermäßige Datenlast, was in den meisten Fällen seine praktische Anwendung behindert.

2. Späte Zusammenarbeit

Späte Zusammenarbeit fördert die Verschmelzung der von jedem Agenten ausgegebenen Wahrnehmungsergebnisse und erreicht eine Verfeinerung.

Obwohl die Zusammenarbeit in der Spätphase bandbreitensparend ist, reagiert sie sehr empfindlich auf Fehler bei der Agentenpositionierung und leidet unter hohen Schätzfehlern und Rauschen aufgrund unvollständiger lokaler Beobachtungen.

3 Intermediate Collaboration

Intermediate Collaboration führt die Zusammenarbeit im Intermediate Feature Space durch. Es ist in der Lage, Zwischenmerkmale zu übertragen, die von einzelnen Agenten-Vorhersagemodellen generiert wurden. Nach der Zusammenführung dieser Merkmale dekodiert jeder Agent die zusammengeführten Merkmale und erzeugt ein Wahrnehmungsergebnis. Konzeptionell können repräsentative Informationen in diese Funktionen komprimiert werden, wodurch Kommunikationsbandbreite im Vergleich zur frühen Zusammenarbeit gespart und die Wahrnehmung im Vergleich zur späten Zusammenarbeit verbessert wird.

In der Praxis ist das Design dieser kollaborativen Strategie in zweierlei Hinsicht algorithmisch herausfordernd: i) wie man die effektivsten und kompaktesten Merkmale aus den Originalmessungen für die Übertragung auswählt und ii) wie man die Integration anderer Intelligenzmerkmale maximiert; den Körper, um die Wahrnehmungsfähigkeit jedes intelligenten Körpers zu verbessern.

4 Hybrid-Synergie

Wie oben erwähnt, hat jeder Synergiemodus seine Vor- und Nachteile. Daher nutzen einige Werke eine hybride Zusammenarbeit, bei der zwei oder mehr Kooperationsmodi kombiniert werden, um die Kooperationsstrategien zu optimieren.

Zu den Hauptfaktoren des Co-Awareness gehören:

1 Kollaborationsdiagramm

Das Diagramm ist ein leistungsstarkes Werkzeug für die Co-Awareness-Modellierung, da es nichteuklidische Datenstrukturen mit guter Interpretierbarkeit modelliert. In einigen Arbeiten bilden die an der kollaborativen Erfassung beteiligten Fahrzeuge einen vollständigen kollaborativen Graphen, in dem jedes Fahrzeug ein Knoten ist und die kollaborative Beziehung zwischen zwei Fahrzeugen die Kante zwischen den beiden Knoten darstellt.

2 Posenausrichtung

Da die kollaborative Erfassung die Zusammenführung von Daten von Fahrzeugen und Infrastruktur an verschiedenen Standorten und zu unterschiedlichen Zeiten erfordert, ist eine präzise Datenausrichtung für eine erfolgreiche Zusammenarbeit von entscheidender Bedeutung.

3 Informationsfusion

Informationsfusion ist die Kernkomponente des Multi-Agenten-Systems und ihr Ziel ist es, den größten Teil der Informationen anderer Agenten effektiv zu fusionieren.

4 Ressourcenzuweisung basierend auf Reinforcement Learning

Eine begrenzte Kommunikationsbandbreite in realen Umgebungen erfordert die vollständige Nutzung der verfügbaren Kommunikationsressourcen, weshalb die Ressourcenzuteilung und die gemeinsame Nutzung des Spektrums sehr wichtig sind. In Fahrzeugkommunikationsumgebungen machen sich schnell ändernde Kanalbedingungen und wachsende Serviceanforderungen die Optimierung von Zuordnungsproblemen sehr komplex und mit herkömmlichen Optimierungsmethoden schwer zu lösen. Einige Arbeiten nutzen Multi-Agent Reinforcement Learning (MARL), um Optimierungsprobleme zu lösen.

Anwendungen der kollaborativen Sensorik:

1 3D-Zielerkennung

Die 3D-Zielerkennung auf Basis der Lidar-Punktwolke ist das am meisten besorgniserregende Thema in der kollaborativen Sensorforschung. Die Gründe dafür sind folgende: i) LiDAR-Punktwolken haben mehr räumliche Dimensionen als Bilder und Videos. ii) LiDAR-Punktwolken können bis zu einem gewissen Grad persönliche Informationen wie Gesichter und Nummernschilder bewahren. iii) Punktwolkendaten sind ein geeigneter Datentyp für die Fusion, da sie weniger als Pixel verlieren, wenn sie aus verschiedenen Posen ausgerichtet werden. iv) Die 3D-Objekterkennung ist eine grundlegende Aufgabe für die autonome Fahrwahrnehmung, auf der viele Aufgaben wie Tracking und Bewegungsvorhersage basieren.

2 Semantische Segmentierung

Die semantische Segmentierung von 3D-Szenen ist ebenfalls eine Schlüsselaufgabe für das autonome Fahren. Kollaborative semantische Segmentierung von 3D-Szenenobjekten (Bilder, Lidar-Punktwolken usw.) von mehreren Agenten wird für jeden Agenten eine semantische Segmentierungsmaske generiert.

Herausfordernde Probleme:

1 Robustheit der Kommunikation

Eine effektive Co-Vereinigung beruht auf einer zuverlässigen Kommunikation zwischen Agenten. In der Praxis ist die Kommunikation jedoch nicht perfekt: i) Mit zunehmender Anzahl von Fahrzeugen im Netzwerk ist die verfügbare Kommunikationsbandbreite jedes Fahrzeugs begrenzt. ii) Aufgrund unvermeidlicher Kommunikationsverzögerungen ist es für Fahrzeuge schwierig, Echtzeitinformationen zu empfangen von anderen Fahrzeugen; iii) Die Kommunikation kann manchmal unterbrochen werden, was zu einer Kommunikationsunterbrechung führt; iv) Die V2X-Kommunikation ist beschädigt und es können nicht immer zuverlässige Dienste bereitgestellt werden. Obwohl sich die Kommunikationstechnologie weiterentwickelt und die Qualität der Kommunikationsdienste immer besser wird, werden die oben genannten Probleme noch lange bestehen bleiben. Die meisten vorhandenen Arbeiten gehen jedoch davon aus, dass Informationen in Echtzeit und verlustfrei ausgetauscht werden können. Daher ist es für die weitere Arbeit von großer Bedeutung, diese Kommunikationsbeschränkungen zu berücksichtigen und robuste kollaborative Sensorsysteme zu entwerfen.

2 Heterogenität und Cross-Modalität

Die meisten ko-vereinheitlichten Wahrnehmungsarbeiten konzentrieren sich auf die LiDAR-Punktwolken-basierte Wahrnehmung. Für die Erfassung stehen jedoch noch viele weitere Arten von Daten zur Verfügung, beispielsweise Bilder und Millimeterwellenradar-Punktwolken. Dies ist eine potenzielle Möglichkeit, multimodale Sensordaten für eine effektivere Zusammenarbeit zu nutzen. Darüber hinaus gibt es in einigen Szenarien unterschiedliche Ebenen autonomer Fahrzeuge, die unterschiedliche Informationsqualitäten bereitstellen. Daher stellt die Zusammenarbeit in heterogenen Fahrzeugnetzwerken ein Problem für die weitere praktische Anwendung der kollaborativen Sensorik dar. Leider konzentrieren sich nur wenige Arbeiten auf die heterogene und modalübergreifende kollaborative Wahrnehmung, die ebenfalls zu einer offenen Herausforderung wird.

3 große Datensätze

Die Entwicklung großer Datensätze und Deep-Learning-Methoden hat die Wahrnehmungsleistung verbessert. Allerdings sind die vorhandenen Datensätze im Bereich der kollaborativen Sensorforschung entweder klein oder nicht öffentlich verfügbar.

Der Mangel an öffentlichen, großen Datensätzen behindert die Weiterentwicklung der kollaborativen Sensorik. Darüber hinaus basieren die meisten Datensätze auf Simulationen. Obwohl Simulation eine wirtschaftliche und sichere Möglichkeit zur Verifizierung von Algorithmen ist, werden auch reale Datensätze benötigt, um kollaboratives Sensoring in der Praxis anzuwenden.

Das obige ist der detaillierte Inhalt vonÜberblick: Kollaborative Sensortechnologie für autonomes Fahren. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr