回归决策树是一种基于决策树算法的回归模型,用于预测连续型变量的取值。它通过构建一棵决策树,将输入的特征空间划分成若干个子空间,每个子空间对应一个预测值。在预测时,根据输入特征的取值,沿着决策树自顶向下递归地查找对应的叶节点,从而得到相应的预测值。回归决策树具有简单易解释、可处理多维特征、适应非线性关系等优点,常被应用于房价预测、股票价格预测、产品销量预测等领域。

回归决策树算法基于特征空间划分预测连续型变量,具体步骤如下:

1.根据数据集中的特征和目标变量,选择一个最优的特征作为根节点,将样本集分为不同的子集。

对于每个子集,重复步骤1,选择最佳特征作为子节点,继续将子集分为更小的子集,直到只剩下一个样本或无法再分。

3.对于每个叶节点,计算样本的平均值作为预测值。

4.在预测时,根据输入特征的取值,沿着决策树自顶向下递归地查找对应的叶节点,从而得到相应的预测值。

5.在选择最优特征时,通常使用信息增益、信息增益比或基尼指数等指标来度量特征的重要性。而在样本分裂时,可以采用贪心算法、剪枝算法等来降低模型的复杂度和泛化误差。

需要注意的是,回归决策树容易出现过拟合问题,因此常常需要进行剪枝等操作来提高预测性能。

以上是回归决策树的详细内容。更多信息请关注PHP中文网其他相关文章!

AI游戏开发通过Upheaval的Dreamer Portal进入其代理时代May 02, 2025 am 11:17 AM

AI游戏开发通过Upheaval的Dreamer Portal进入其代理时代May 02, 2025 am 11:17 AM动荡游戏:与AI代理商的游戏开发彻底改变 Roupheaval是一家游戏开发工作室,由暴风雪和黑曜石等行业巨头的退伍军人组成,有望用其创新的AI驱动的Platfor革新游戏创作

Uber想成为您的Robotaxi商店,提供商会让他们吗?May 02, 2025 am 11:16 AM

Uber想成为您的Robotaxi商店,提供商会让他们吗?May 02, 2025 am 11:16 AMUber的Robotaxi策略:自动驾驶汽车的骑车生态系统 在最近的Curbivore会议上,Uber的Richard Willder推出了他们成为Robotaxi提供商的乘车平台的策略。 利用他们在

AI代理玩电子游戏将改变未来的机器人May 02, 2025 am 11:15 AM

AI代理玩电子游戏将改变未来的机器人May 02, 2025 am 11:15 AM事实证明,视频游戏是尖端AI研究的宝贵测试场所,尤其是在自主代理和现实世界机器人的开发中,甚至有可能促进人工通用智能(AGI)的追求。 一个

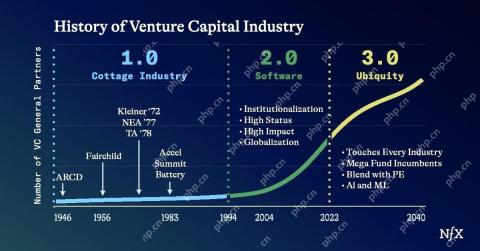

创业公司工业综合体VC 3.0和James Currier的宣言May 02, 2025 am 11:14 AM

创业公司工业综合体VC 3.0和James Currier的宣言May 02, 2025 am 11:14 AM不断发展的风险投资格局的影响在媒体,财务报告和日常对话中显而易见。 但是,对投资者,初创企业和资金的具体后果经常被忽略。 风险资本3.0:范式

Adobe在Adobe Max London 2025更新创意云和萤火虫May 02, 2025 am 11:13 AM

Adobe在Adobe Max London 2025更新创意云和萤火虫May 02, 2025 am 11:13 AMAdobe Max London 2025对Creative Cloud和Firefly进行了重大更新,反映了向可访问性和生成AI的战略转变。 该分析结合了事件前简报中的见解,并融合了Adobe Leadership。 (注意:Adob

Llamacon宣布的所有元数据May 02, 2025 am 11:12 AM

Llamacon宣布的所有元数据May 02, 2025 am 11:12 AMMeta的Llamacon公告展示了一项综合的AI策略,旨在直接与OpenAI等封闭的AI系统竞争,同时为其开源模型创建了新的收入流。 这个多方面的方法目标bo

关于AI仅仅是普通技术的主张的酿造争议May 02, 2025 am 11:10 AM

关于AI仅仅是普通技术的主张的酿造争议May 02, 2025 am 11:10 AM人工智能领域对这一论断存在严重分歧。一些人坚称,是时候揭露“皇帝的新衣”了,而另一些人则强烈反对人工智能仅仅是普通技术的观点。 让我们来探讨一下。 对这一创新性人工智能突破的分析,是我持续撰写的福布斯专栏文章的一部分,该专栏涵盖人工智能领域的最新进展,包括识别和解释各种有影响力的人工智能复杂性(请点击此处查看链接)。 人工智能作为普通技术 首先,需要一些基本知识来为这场重要的讨论奠定基础。 目前有大量的研究致力于进一步发展人工智能。总目标是实现人工通用智能(AGI)甚至可能实现人工超级智能(AS

模型公民,为什么AI值是下一个业务码May 02, 2025 am 11:09 AM

模型公民,为什么AI值是下一个业务码May 02, 2025 am 11:09 AM公司AI模型的有效性现在是一个关键的性能指标。自AI BOOM以来,从编写生日邀请到编写软件代码的所有事物都将生成AI使用。 这导致了语言mod的扩散

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

Atom编辑器mac版下载

最流行的的开源编辑器

MinGW - 适用于 Windows 的极简 GNU

这个项目正在迁移到osdn.net/projects/mingw的过程中,你可以继续在那里关注我们。MinGW:GNU编译器集合(GCC)的本地Windows移植版本,可自由分发的导入库和用于构建本地Windows应用程序的头文件;包括对MSVC运行时的扩展,以支持C99功能。MinGW的所有软件都可以在64位Windows平台上运行。

禅工作室 13.0.1

功能强大的PHP集成开发环境

SublimeText3汉化版

中文版,非常好用

安全考试浏览器

Safe Exam Browser是一个安全的浏览器环境,用于安全地进行在线考试。该软件将任何计算机变成一个安全的工作站。它控制对任何实用工具的访问,并防止学生使用未经授权的资源。