「GPU贫民」即将告别困境!

刚刚,英伟达发布了一款名为TensorRT-LLM的开源软件,可以加速在H100上运行的大型语言模型的推理过程

那么,具体能提升多少倍?

在添加了TensorRT-LLM及其一系列优化功能后(包括In-Flight批处理),模型总吞吐量提升8倍。

使用和不使用TensorRT-LLM的GPT-J-6B A100与H100的比较

另外,以Llama 2为例,相比独立使用A100,TensorRT-LLM能够将推理性能提升4.6倍

对比Llama 2 70B、A100和H100在使用和不使用TensorRT-LLM的情况下的比较

网友表示,超强H100,再结合上TensorRT-LLM,无疑将彻底改变大型语言模型推理现状!

TensorRT-LLM:大模型推理加速神器

当前,由于大模型有着巨大的参数规模,使得「部署和推理」难度和成本一直居高不下。

英伟达开发的TensorRT-LLM旨在通过GPU来显著提高LLM的吞吐量,并降低成本

具体而言,TensorRT-LLM将TensorRT的深度学习编译器、FasterTransformer的优化内核、预处理和后处理以及多GPU/多节点通信封装在一个简单的开源Python API中

英伟达对FasterTransformer进行了进一步的增强,使其成为一个产品化的解决方案。

可见,TensorRT-LLM提供了一个易用、开源和模块化的Python应用编程接口。

不需要深入了解C++或CUDA专业知识的码农们,可以部署、运行和调试各种大型语言模型,并且能够获得卓越的性能表现,以及快速定制化的功能

根据英伟达官方博客的报道,TensorRT-LLM采用了四种方法来提升Nvidia GPU上的LLM推理性能

首先,为当前10+大模型,引入TensorRT-LLM,让开发者们能够立即运行。

其次,TensorRT-LLM作为一个开源软件库,允许LLM在多个GPU和多个GPU服务器上同时进行推理。

这些服务器分别通过,英伟达的NVLink和InfiniBand互连连接。

第三点是关于「机内批处理」,这是一项全新的调度技术,它允许不同模型的任务独立于其他任务进入和退出GPU

最后,TensorRT-LLM经过优化,可以利用H100 Transformer Engine来降低模型推理时的内存占用和延迟。

下面我们来详细看一下TensorRT-LLM是如何提升模型性能的

支持丰富LLM生态

TensorRT-LLM为开源模型生态提供了出色的支持

需要重写的内容是:具有最大规模和最先进的语言模型,例如Meta推出的Llama 2-70B,需要多个GPU协同工作才能实时提供响应

以前,要实现LLM推理的最佳性能,开发人员必须手动重写AI模型,并将其分解成多个片段,然后在GPU之间进行协调执行

TensorRT-LLM使用张量并行技术,将权重矩阵分配到各个设备上,从而简化了这一过程,可以实现大规模高效推理

每个模型可以在通过NVLink连接的多个GPU和多个服务器上并行运行,无需开发人员干预或模型更改。

随着新模型和模型架构的推出,开发人员可以使用TensorRT-LLM中开源的最新NVIDIA AI内核(Kernal)来优化模型

需要进行改写的内容是:支持的内核融合(Kernal Fusion)包括最新的FlashAttention实现,以及用于GPT模型执行的上下文和生成阶段的掩码多头注意力等

此外,TensorRT-LLM还包括了目前流行的许多大语言模型的完全优化、可立即运行的版本。

这些模型包括Meta Llama 2、OpenAI GPT-2和GPT-3、Falcon、Mosaic MPT、BLOOM等十多个。所有这些模型都可以使用简单易用的TensorRT-LLM Python API来调用

这些功能可帮助开发人员更快、更准确地搭建定制化的大语言模型,以满足各行各业的不同需求。

In-flight批处理

现如今大型语言模型的用途极其广泛。

一个模型可以同时用于多种看起来完全不同的任务——从聊天机器人中的简单问答响应,到文档摘要或长代码块的生成,工作负载是高度动态的,输出大小需要满足不同数量级任务的需求。

任务的多样性可能会导致难以有效地批处理请求和进行高效并行执行,可能会导致某些请求比其他请求更早完成。

为了管理这些动态负载,TensorRT-LLM包含一种称为「In-flight批处理」的优化调度技术。

大语言模型的核心原理在于,整个文本生成过程可以通过模型的多次迭代来实现

通过in flight批处理,TensorRT-LLM运行时会立即从批处理中释放出已完成的序列,而不是等待整个批处理完成后再继续处理下一组请求。

在执行新请求时,上一批还未完成的其他请求仍在处理中。

通过进行机上批处理和进行额外的内核级优化,可以提高GPU的利用率,从而使得H100上LLM的实际请求基准的吞吐量至少增加一倍

使用FP 8的 H100 Transformer引擎

TensorRT-LLM还提供了一个名为H100 Transformer Engine的功能,能有效降低大模型推理时的内存消耗和延迟。

因为LLM包含数十亿个模型权重和激活函数,通常用FP16或BF16值进行训练和表示,每个值占用16位内存。

然而,在推理时,大多数模型可以使用量化(Quantization)技术以较低精度有效表示,例如8位甚至4位整数(INT8或 INT4)。

量化(Quantization)是在不牺牲准确性的情况下降低模型权重和激活精度的过程。使用较低的精度意味着每个参数较小,并且模型在GPU内存中占用的空间较小。

这样做可以使用相同的硬件对更大的模型进行推理,同时在执行过程中减少在内存操作上的时间消耗

通过H100 Transformer Engine技术,配合TensorRT-LLM的H100 GPU使户能够轻松地将模型权重转换为新的FP8格式,并能自动编译模型以利用优化后的FP8内核。

而且这个过程不需要任何的代码!H100引入的FP8数据格式使开发人员能够量化他们的模型并从大幅度减少内存消耗,而且不会降低模型的准确性。

与INT8或INT4等其他数据格式相比,FP8量化保留了更高的精度,同时实现了最快的性能,并且实现起来最为方便。 与INT8或INT4等其他数据格式相比,FP8量化保留了更高的精度,同时实现了最快的性能,并且实现起来最为方便

如何获取TensorRT-LLM

尽管TensorRT-LLM尚未正式发布,但用户现在已经可以提前体验了

申请链接如下:

https://developer.nvidia.com/tensorrt-llm-early-access/join

英伟达也说会将TensorRT-LLM很快集成到NVIDIA NeMo框架中。

这个框架是最近由英伟达推出的AI Enterprise的组成部分,为企业客户提供了一个安全、稳定、可管理性极强的企业级AI软件平台

开发人员和研究人员可以通过英伟达NGC上的NeMo框架或GitHub上的项目来访问TensorRT-LLM

但是需要注意的是,用户必须注册英伟达开发者计划才能申请抢先体验版本。

网友热议

Reddit上的用户对TensorRT-LLM的发布进行了激烈的讨论

难以想象专门针对LLM对硬件做出优化之后,效果将会有多大的提升。

但也有网友认为,这个东西的意义就是帮助老黄卖更多的H100。

有些网友对此持不同意见,他们认为Tensor RT对于本地部署深度学习的用户也是有帮助的。只要拥有RTX GPU,将来在类似的产品上也有可能受益

从更宏观的角度来看,也许对于LLM而言,会出现一系列专门针对硬件级别的优化措施,甚至可能会出现专门为LLM设计的硬件来提升其性能。这种情况在许多流行的应用中已经出现过,LLM也不会例外

以上是H100推理飙升8倍!英伟达官宣开源TensorRT-LLM,支持10+模型的详细内容。更多信息请关注PHP中文网其他相关文章!

AI游戏开发通过Upheaval的Dreamer Portal进入其代理时代May 02, 2025 am 11:17 AM

AI游戏开发通过Upheaval的Dreamer Portal进入其代理时代May 02, 2025 am 11:17 AM动荡游戏:与AI代理商的游戏开发彻底改变 Roupheaval是一家游戏开发工作室,由暴风雪和黑曜石等行业巨头的退伍军人组成,有望用其创新的AI驱动的Platfor革新游戏创作

Uber想成为您的Robotaxi商店,提供商会让他们吗?May 02, 2025 am 11:16 AM

Uber想成为您的Robotaxi商店,提供商会让他们吗?May 02, 2025 am 11:16 AMUber的Robotaxi策略:自动驾驶汽车的骑车生态系统 在最近的Curbivore会议上,Uber的Richard Willder推出了他们成为Robotaxi提供商的乘车平台的策略。 利用他们在

AI代理玩电子游戏将改变未来的机器人May 02, 2025 am 11:15 AM

AI代理玩电子游戏将改变未来的机器人May 02, 2025 am 11:15 AM事实证明,视频游戏是尖端AI研究的宝贵测试场所,尤其是在自主代理和现实世界机器人的开发中,甚至有可能促进人工通用智能(AGI)的追求。 一个

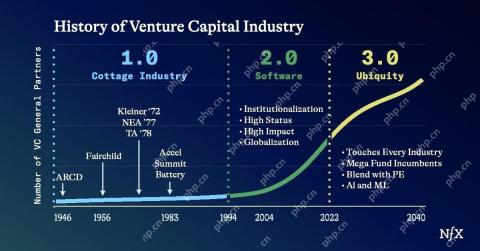

创业公司工业综合体VC 3.0和James Currier的宣言May 02, 2025 am 11:14 AM

创业公司工业综合体VC 3.0和James Currier的宣言May 02, 2025 am 11:14 AM不断发展的风险投资格局的影响在媒体,财务报告和日常对话中显而易见。 但是,对投资者,初创企业和资金的具体后果经常被忽略。 风险资本3.0:范式

Adobe在Adobe Max London 2025更新创意云和萤火虫May 02, 2025 am 11:13 AM

Adobe在Adobe Max London 2025更新创意云和萤火虫May 02, 2025 am 11:13 AMAdobe Max London 2025对Creative Cloud和Firefly进行了重大更新,反映了向可访问性和生成AI的战略转变。 该分析结合了事件前简报中的见解,并融合了Adobe Leadership。 (注意:Adob

Llamacon宣布的所有元数据May 02, 2025 am 11:12 AM

Llamacon宣布的所有元数据May 02, 2025 am 11:12 AMMeta的Llamacon公告展示了一项综合的AI策略,旨在直接与OpenAI等封闭的AI系统竞争,同时为其开源模型创建了新的收入流。 这个多方面的方法目标bo

关于AI仅仅是普通技术的主张的酿造争议May 02, 2025 am 11:10 AM

关于AI仅仅是普通技术的主张的酿造争议May 02, 2025 am 11:10 AM人工智能领域对这一论断存在严重分歧。一些人坚称,是时候揭露“皇帝的新衣”了,而另一些人则强烈反对人工智能仅仅是普通技术的观点。 让我们来探讨一下。 对这一创新性人工智能突破的分析,是我持续撰写的福布斯专栏文章的一部分,该专栏涵盖人工智能领域的最新进展,包括识别和解释各种有影响力的人工智能复杂性(请点击此处查看链接)。 人工智能作为普通技术 首先,需要一些基本知识来为这场重要的讨论奠定基础。 目前有大量的研究致力于进一步发展人工智能。总目标是实现人工通用智能(AGI)甚至可能实现人工超级智能(AS

模型公民,为什么AI值是下一个业务码May 02, 2025 am 11:09 AM

模型公民,为什么AI值是下一个业务码May 02, 2025 am 11:09 AM公司AI模型的有效性现在是一个关键的性能指标。自AI BOOM以来,从编写生日邀请到编写软件代码的所有事物都将生成AI使用。 这导致了语言mod的扩散

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

Dreamweaver CS6

视觉化网页开发工具

mPDF

mPDF是一个PHP库,可以从UTF-8编码的HTML生成PDF文件。原作者Ian Back编写mPDF以从他的网站上“即时”输出PDF文件,并处理不同的语言。与原始脚本如HTML2FPDF相比,它的速度较慢,并且在使用Unicode字体时生成的文件较大,但支持CSS样式等,并进行了大量增强。支持几乎所有语言,包括RTL(阿拉伯语和希伯来语)和CJK(中日韩)。支持嵌套的块级元素(如P、DIV),

禅工作室 13.0.1

功能强大的PHP集成开发环境

SublimeText3 Linux新版

SublimeText3 Linux最新版

ZendStudio 13.5.1 Mac

功能强大的PHP集成开发环境