2 月底,Meta 开源了一个大模型系列 LLaMA(直译为羊驼),参数量从 70 亿到 650 亿不等,被称为 Meta 版 ChatGPT 的雏形。之后斯坦福大学、加州大学伯克利分校等机构纷纷在 LLaMA 的基础上进行「二创」,陆续推出了 Alpaca、Vicuna 等多个开源大模型,一时间「羊驼」成为 AI 圈顶流。开源社区构建的这些类 ChatGPT 模型迭代速度非常快,并且可定制性很强,被称为 ChatGPT 的开源平替。

然而,ChatGPT 之所以能在文本理解、生成、推理等方面展现出强大的能力,是因为 OpenAI 为 ChatGPT 等大模型使用了新的训练范式 ——RLHF (Reinforcement Learning from Human Feedback) ,即以强化学习的方式依据人类反馈优化语言模型。使用 RLHF 方法,大型语言模型可与人类偏好保持对齐,遵循人类意图,最小化无益、失真或偏见的输出。但 RLHF 方法依赖于大量的人工标注和评估,通常需要数周时间、花费数千美元收集人类反馈,成本高昂。

现在,推出开源模型 Alpaca 的斯坦福大学又提出了一种模拟器 ——AlpacaFarm(直译为羊驼农场)。AlpacaFarm 能在 24 小时内仅用约 200 美元复制 RLHF 过程,让开源模型迅速改善人类评估结果,堪称 RLHF 的平替。

AlpacaFarm 试图快速、低成本地开发从人类反馈中学习的方法。为了做到这一点,斯坦福的研究团队首先确定了研究 RLHF 方法的三个主要困难:人类偏好数据的高成本、缺乏可信赖的评估、缺乏参考实现。

为了解决这三个问题,AlpacaFarm 构建了模拟注释器、自动评估和 SOTA 方法的具体实现。目前,AlpacaFarm 项目代码已开源。

- GitHub 地址:https://github.com/tatsu-lab/alpaca_farm

- 论文地址:https://tatsu-lab.github.io/alpaca_farm_paper.pdf

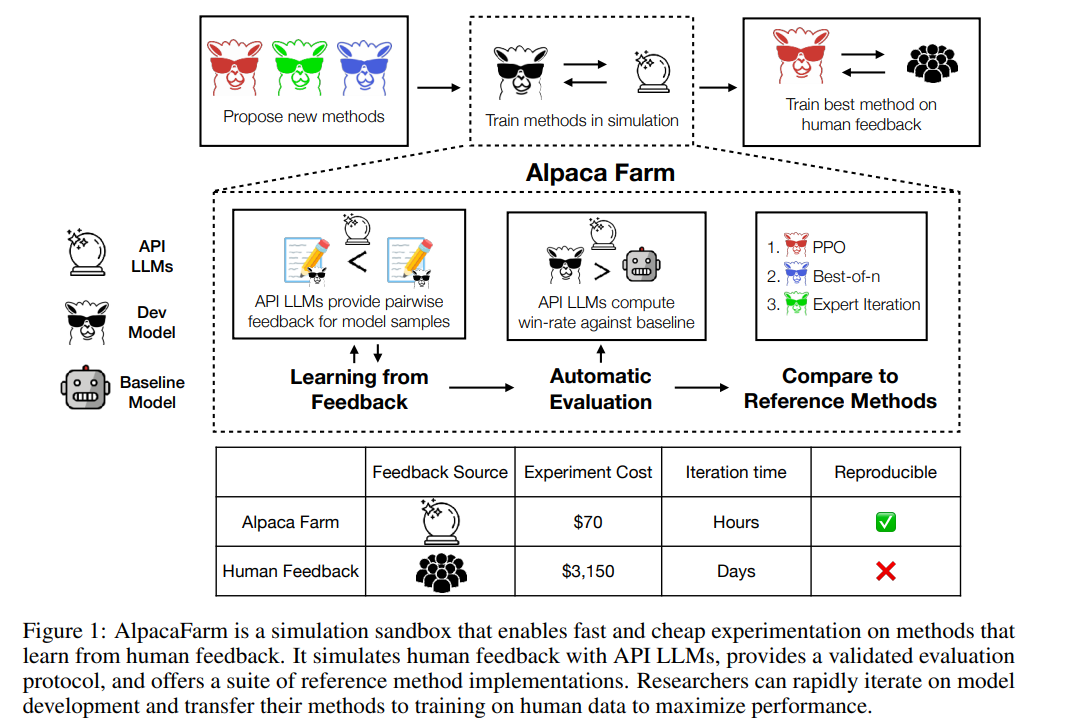

如下图所示,研究人员可以使用 AlpacaFarm 模拟器快速开发从人类反馈数据中学习的新方法,也能将已有 SOTA 方法迁移到实际的人类偏好数据上。

模拟注释器

AlpacaFarm 基于 Alpaca 数据集的 52k 指令构建,其中 10k 指令用于微调基本的指令遵循模型,剩余的 42k 指令用于学习人类偏好和评估,并且大部分用于从模拟注释器中学习。该研究针对 RLHF 方法的注释成本、评估和验证实现三大挑战,逐一提出解决方法。

首先,为了减少注释成本,该研究为可访问 API 的 LLM(如 GPT-4、ChatGPT)创建了 prompt,使得 AlpacaFarm 能够模拟人类反馈,成本仅为 RLHF 方法收集数据的 1/45。该研究设计了一种随机的、有噪声的注释方案,使用 13 种不同的 prompt,从多个 LLM 提取出不同的人类偏好。这种注释方案旨在捕获人类反馈的不同方面,如质量判断、注释器之间的变化性和风格偏好。

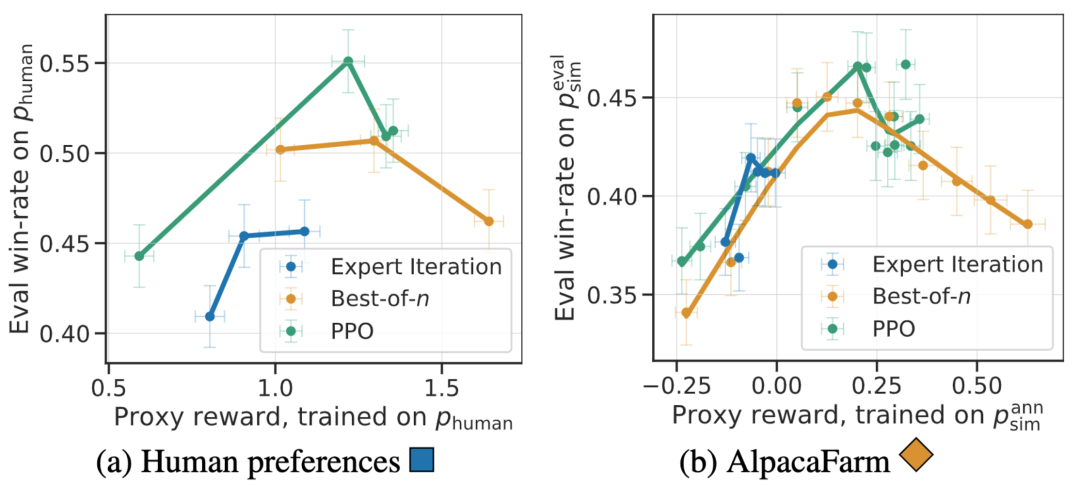

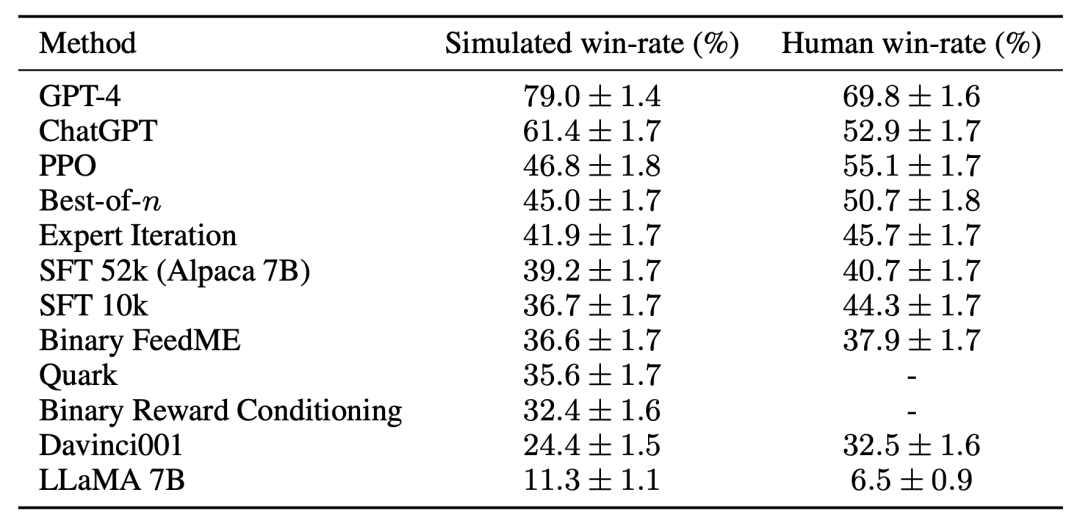

该研究通过实验表明 AlpacaFarm 的模拟是准确的。当研究团队使用 AlpacaFarm 训练和开发方法时,这些方法与使用实际人类反馈训练和开发的相同方法排名非常一致。下图显示了由 AlpacaFarm 模拟工作流和人类反馈工作流产生的方法在排名上的高度相关性。这一特性至关重要,因为它说明从模拟中得出的实验结论在实际情况下也有可能成立。

除了方法层面的相关性,AlpacaFarm 模拟器还可以复制奖励模型过度优化等定性现象,但以此针对代理奖励(surrogate reward)的持续 RLHF 训练可能会损害模型性能。下图是在人类反馈 (左) 和 AlpacaFarm (右) 两种情况下的该现象,我们可以发现 AlpacaFarm 最初捕获了模型性能提升的正确定性行为,然后随着 RLHF 训练的持续,模型性能下降。

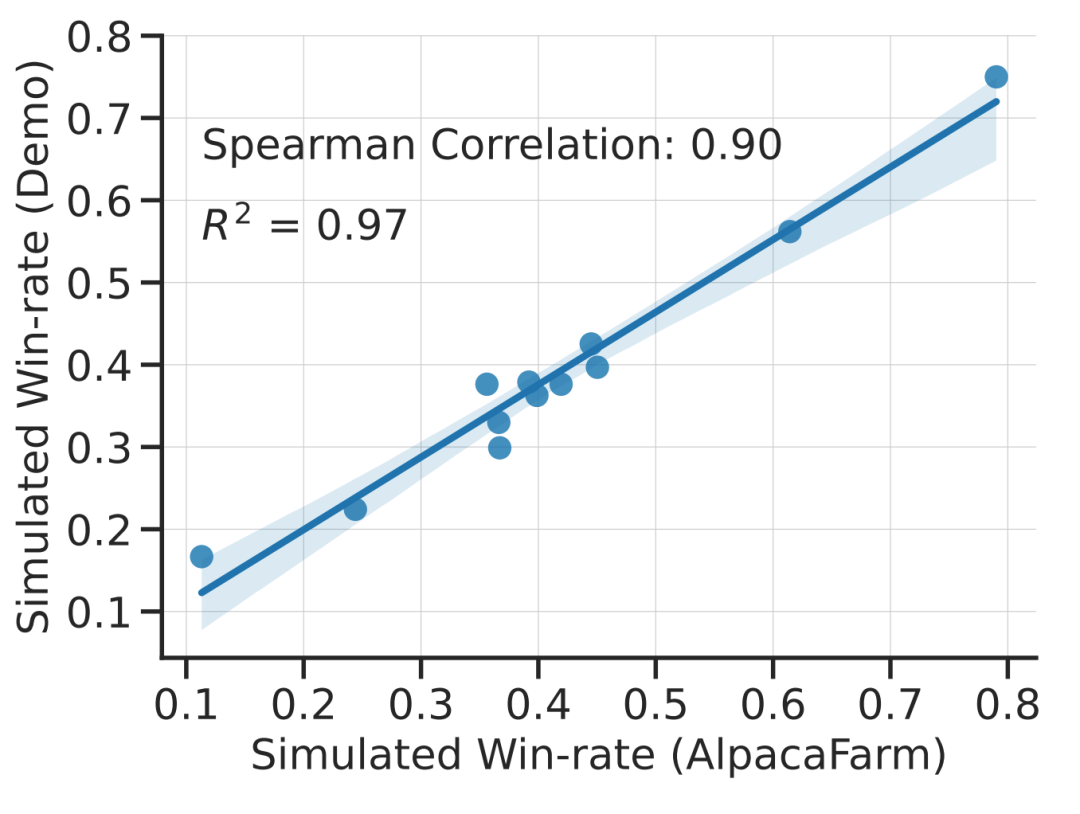

评估

在评估方面,研究团队使用与 Alpaca 7B 的实时用户交互作为指导,并通过结合几个现有公共数据集来模拟指令分布,包括 self-instruct 数据集、anthropic helpfulness 数据集和 Open Assistant、Koala 和 Vicuna 的评估集。使用这些评估指令,该研究比较了 RLHF 模型与 Davinci003 模型的响应(response)情况,并使用一个分值度量 RLHF 模型响应更优的次数,并将这个分值称为胜率(win-rate)。如下图所示,在该研究的评估数据上进行的系统排名量化评估表明:系统排名和实时用户指令是高度相关的。这一结果说明,聚合现有的公开数据能实现与简单真实指令相近的性能。

参考方法

对于第三个挑战 —— 缺少参考实现,研究团队实现并测试了几种流行的学习算法 (如 PPO、专家迭代、best-of-n 采样)。研究团队发现在其他领域有效的更简单方法并不比该研究最初的 SFT 模型更好,这表明在真实的指令遵循环境中测试这些算法是非常重要的。

根据人工评估,PPO 算法被证明是最有效的,它将模型与 Davinci003 相比的胜率从 44% 提高到 55%,甚至超过了 ChatGPT。

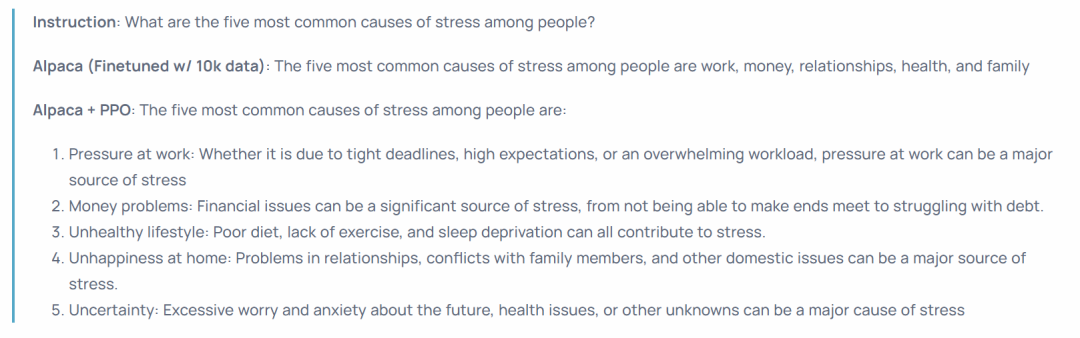

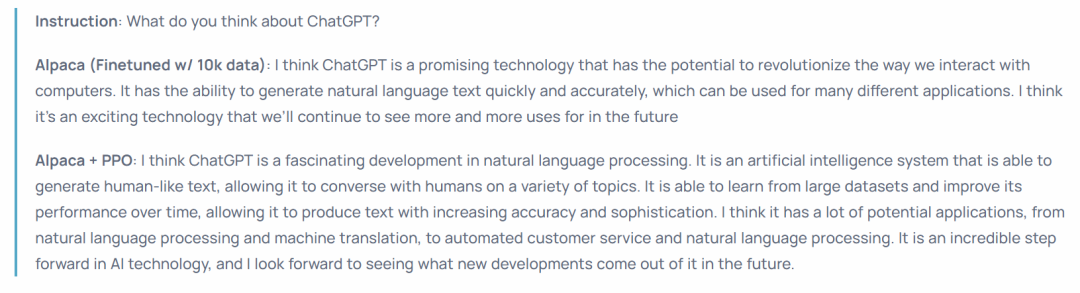

这些结果表明,PPO 算法在为模型优化胜率方面是非常有效的。需要注意的是,这些结果是特定于该研究的评估数据和注释器得出的。虽然该研究的评估指令代表了实时用户指令,但它们可能无法涵盖更具有挑战性的问题,并且并不能确定有多少胜率的改进来源于利用风格偏好,而不是事实性或正确性。例如,该研究发现 PPO 模型产生的输出要长得多,并且通常为答案提供更详细的解释,如下图所示:

总的来说,使用 AlpacaFarm 在模拟偏好上训练模型能够大幅改善模型的人类评估结果,而不需要让模型在人类偏好上重新训练。虽然这种迁移过程比较脆弱,并且在效果上仍略逊于在人类偏好数据上重新训练模型。但能在 24 小时内,仅用 200 美元就复制出 RLHF 的 pipeline,让模型迅速提升人类评估性能,AlpacaFarm 这个模拟器还是太香了,是开源社区为复刻 ChatGPT 等模型的强大功能做出的又一努力。

以上是24小时内、200美元复制RLHF过程,斯坦福开源「羊驼农场」的详细内容。更多信息请关注PHP中文网其他相关文章!

每个人都擅长使用AI:关于氛围编码的想法Apr 19, 2025 am 11:17 AM

每个人都擅长使用AI:关于氛围编码的想法Apr 19, 2025 am 11:17 AM您可以查看会议和贸易展览中正在发生的事情。您可以询问工程师在做什么,或咨询首席执行官。 您看的任何地方,事情都以惊人的速度发生变化。 工程师和非工程师 有什么区别

火箭发射模拟和分析使用Rocketpy -Analytics VidhyaApr 19, 2025 am 11:12 AM

火箭发射模拟和分析使用Rocketpy -Analytics VidhyaApr 19, 2025 am 11:12 AM模拟火箭发射的火箭发射:综合指南 本文指导您使用强大的Python库Rocketpy模拟高功率火箭发射。 我们将介绍从定义火箭组件到分析模拟的所有内容

5个免费数据分析课程 - 分析VidhyaApr 19, 2025 am 11:11 AM

5个免费数据分析课程 - 分析VidhyaApr 19, 2025 am 11:11 AM踏上数据驱动的职业旅程而不会破坏银行! 本文重点介绍了五个非凡的免费数据分析课程,非常适合两位经验丰富的专业人士,他们寻求扩大技能和好奇的新手渴望探索T

如何使用OpenAgi构建自主AI代理? - 分析VidhyaApr 19, 2025 am 11:10 AM

如何使用OpenAgi构建自主AI代理? - 分析VidhyaApr 19, 2025 am 11:10 AM利用AI代理商的力量与OpenAgi:综合指南 想象一下不懈的助手,总是可以简化您的任务并提供有见地的建议。这就是AI代理商的承诺,Openagi赋予您建造它们

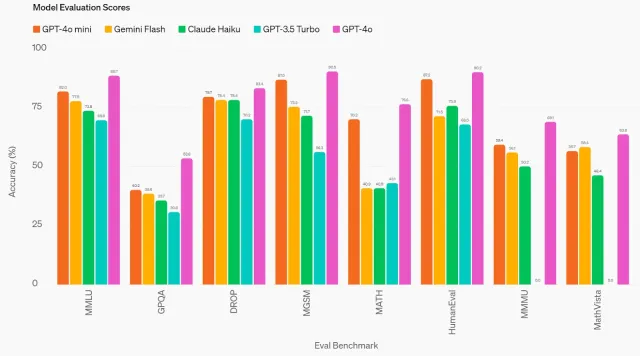

GPT-4O MINI:OpenAI的最新模型如何堆叠?Apr 19, 2025 am 11:09 AM

GPT-4O MINI:OpenAI的最新模型如何堆叠?Apr 19, 2025 am 11:09 AMOpenai的最新产品GPT-4O Mini标志着朝着负担得起且可访问的高级AI迈出的重要一步。 这种小型语言模型(SLM)直接挑战诸如Llama 3和Gemma 2之类的竞争对手,具有低潜伏期,成本效益和A

从技术创新者到医疗保健先驱:Geetha Manjunath博士的AI故事Apr 19, 2025 am 11:02 AM

从技术创新者到医疗保健先驱:Geetha Manjunath博士的AI故事Apr 19, 2025 am 11:02 AMNiramai Analytix的创始人兼首席执行官Geetha Manjunath博士的这一集由“领导数据”的剧集。 Manjunath博士拥有AI和Healthcare的25年以上的经验,并获得了印度科学学院的博士学位和MBA来回。

用Ollama -Analytics Vidhya简化本地LLM部署Apr 19, 2025 am 11:01 AM

用Ollama -Analytics Vidhya简化本地LLM部署Apr 19, 2025 am 11:01 AM利用Ollama本地开源LLMS的力量:综合指南 运行大型语言模型(LLMS)本地提供无与伦比的控制和透明度,但是设置环境可能令人生畏。 Ollama简化了这个过程

如何使用Monsterapi微调大语言模型Apr 19, 2025 am 10:49 AM

如何使用Monsterapi微调大语言模型Apr 19, 2025 am 10:49 AM利用微调LLM的功能与Monsterapi:综合指南 想象一个虚拟助手完美理解并预测您的需求。 由于大型语言模型(LLMS)的进步,这已成为现实。 但是,

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

MinGW - 适用于 Windows 的极简 GNU

这个项目正在迁移到osdn.net/projects/mingw的过程中,你可以继续在那里关注我们。MinGW:GNU编译器集合(GCC)的本地Windows移植版本,可自由分发的导入库和用于构建本地Windows应用程序的头文件;包括对MSVC运行时的扩展,以支持C99功能。MinGW的所有软件都可以在64位Windows平台上运行。

SublimeText3汉化版

中文版,非常好用

EditPlus 中文破解版

体积小,语法高亮,不支持代码提示功能

Atom编辑器mac版下载

最流行的的开源编辑器

禅工作室 13.0.1

功能强大的PHP集成开发环境