就在剛剛,Pika發布了一項新功能:

很抱歉我們之前一直處於靜音狀態。

今天起,大家可以給影片無縫產生音效了-Sound Effects!

產生的方式有兩種:

- 要么給一句Prompt,描述你想要的聲音;

- #要么直接讓Pika根據影片內容自動產生。

並且Pika非常自信地說:「如果你覺得音效聽起來很棒,那是因為它確實如此」。

車鳴聲、廣播聲、鷹叫聲、刀劍聲、歡呼聲……可謂是聲聲不息,並且從效果上來看,也是高度與視頻畫面匹配。

不僅是發布的宣傳片,Pika官網現在也放出了多個demo。

例如無需任何prompt,AI只是看了眼烤培根的視頻,便可以配出毫無違和感的音效。

再如給一句prompt:

Super saturated color, fireworks over a field at sunset.

超飽和色彩,日落時田野上的煙火。

Pika可以在生成影片的同時配上聲音,從效果中不難看出,煙火綻放的瞬間,聲音卡點也是相當的精準。

大週末的發布這樣一個新功能,網友們在高呼Pika「夠卷、夠Awesome」的同時,也有人認為:

它正在為多模態AI創作收集所有的“無限寶石”。

那麼Pika的Sound Effects具體要如何操作,我們繼續往下看。

給影片「make some noise」

Pika給影片產生音效的動作也是極!其!簡!單!

例如只需一句prompt,視訊和音效就能「一鍋出」:

Mdieval trumpet player .

中世紀小號手。

比起先前產生影片的動作,現在只需開啟下方「Sound effects」按鈕。

第二種操作方式,就是在生成了影片過後,可以單獨為它配音。

例如在下面這個視頻,點擊下方的“Edit”#,再選擇“Sound Effects”:

然後可以描述自己想要的聲音,例如:

Race car revving its engine.

賽車正在發動引擎。

然後短短幾秒鐘後,Pika可以根據描述和影片產生音效,而且還是6種聲音可選的那種!

值得一提的是,Sound Effects功能目前只對超級合作者(Super Collaborator)和Pro使用者開放測試。

不過Pika也表示:「我們很快就會向所有用戶推出該功能!」

接著現在已經有一群網友在開始測試這個Beta版本了,並且表示:

音效聽起來和影片很相配,而且增加了很多氣氛。

什麼原理?

至於Sound Effects背後的原理,雖然Pika此次並沒有公開,但在先前Sora大火之後,語音新創公司ElevenLabs就出過類似的配音功能。

當時,英偉達資深科學家Jim Fan就對此做過較為深入的分析。

他認為,AI學習準確的視訊到音訊映射還需要對潛在空間中的一些「隱式」物理進行建模。

他詳細說明了端對端Transformer在模擬聲波時需要解決的問題:

- 識別每個物件的類別、材料和空間位置。

- 辨識物體間的高階互動:例如,是木棍、金屬還是鼓面?以什麼速度擊打?

- 識別環境:是餐廳、太空站、還是黃石公園?

- 從模型的內在記憶中檢索物件和環境的典型聲音模式。

- 使用「軟性」的、透過學習得到的物理規則來組合和調整聲音模式的參數,甚至即時創造全新的聲音。這有點像遊戲引擎中的「程式化音訊」。

- 如果場景很複雜,模型需要根據物件的空間位置疊加多個聲音軌道。

所有這些都不是顯式的模組,而是透過大量的(視頻,音頻)對的梯度下降學習來實現的,這些視頻和音頻對在大多數互聯網視頻中自然地時間對齊。注意力層將在它們的權重中實現這些演算法,以滿足擴散目標。

除此之外,Jim Fan當時表示英偉達的相關工作並沒有這樣高品質的AI音訊引擎,不過他推薦了一篇MIT五年前的論文The Sound of Pixels:

有興趣的小夥伴可以戳文末連結詳細了解。

One More Thing

在多模態這件事上,LeCun在最新訪談中的觀點也很火爆,他認為:

語言(文字)是低寬頻的:小於12位元組/秒。現代LLM通常使用1x10^13個雙位元組標記(即 2x10^13 位元組)進行訓練。一個人閱讀大約需要 100000 年(每天 12 小時)。

視覺的頻寬高很多:約20MB/s。兩條視神經中的每一條都有 100 萬根神經纖維,每根神經纖維每秒攜帶約10個位元組。一個4歲的孩子在清醒狀態下大約是16000小時,換算成位元組大約是1x10^15。

視覺感知的資料頻寬大約是文字語言資料頻寬的1600萬倍。

一個4歲孩子看到的數據,是網路上公開的所有文字訓練的最大LLM數據的50倍。

因此,LeCun總結到:

如果不讓機器從高頻寬的感官輸入(如視覺)中學習,我們絕對不可能達到人類等級的人工智慧。

那麼,你贊成這種看法嗎?

以上是Pika放大招:今天起,影片和音效可以「一鍋出來」了!的詳細內容。更多資訊請關注PHP中文網其他相關文章!

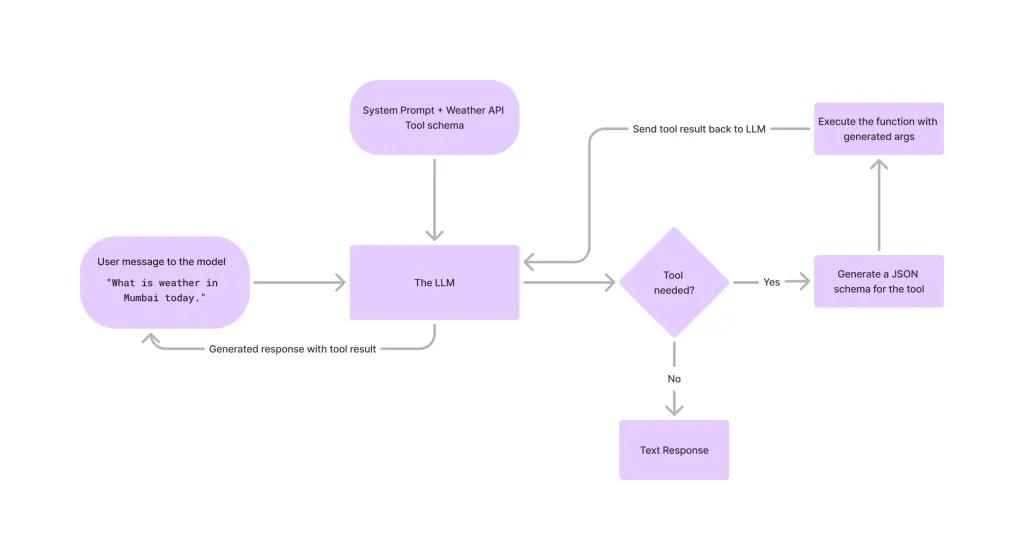

在LLMS中調用工具Apr 14, 2025 am 11:28 AM

在LLMS中調用工具Apr 14, 2025 am 11:28 AM大型語言模型(LLMS)的流行激增,工具稱呼功能極大地擴展了其功能,而不是簡單的文本生成。 現在,LLM可以處理複雜的自動化任務,例如Dynamic UI創建和自主a

多動症遊戲,健康工具和AI聊天機器人如何改變全球健康Apr 14, 2025 am 11:27 AM

多動症遊戲,健康工具和AI聊天機器人如何改變全球健康Apr 14, 2025 am 11:27 AM視頻遊戲可以緩解焦慮,建立焦點或支持多動症的孩子嗎? 隨著醫療保健在全球範圍內挑戰,尤其是在青年中的挑戰,創新者正在轉向一種不太可能的工具:視頻遊戲。現在是世界上最大的娛樂印度河之一

沒有關於AI的投入:獲勝者,失敗者和機遇Apr 14, 2025 am 11:25 AM

沒有關於AI的投入:獲勝者,失敗者和機遇Apr 14, 2025 am 11:25 AM“歷史表明,儘管技術進步推動了經濟增長,但它並不能自行確保公平的收入分配或促進包容性人類發展,”烏托德秘書長Rebeca Grynspan在序言中寫道。

通過生成AI學習談判技巧Apr 14, 2025 am 11:23 AM

通過生成AI學習談判技巧Apr 14, 2025 am 11:23 AM易於使用,使用生成的AI作為您的談判導師和陪練夥伴。 讓我們來談談。 對創新AI突破的這種分析是我正在進行的《福布斯》列的最新覆蓋範圍的一部分,包括識別和解釋

泰德(Ted)從Openai,Google,Meta透露出庭,與我自己自拍Apr 14, 2025 am 11:22 AM

泰德(Ted)從Openai,Google,Meta透露出庭,與我自己自拍Apr 14, 2025 am 11:22 AM在溫哥華舉行的TED2025會議昨天在4月11日舉行了第36版。它的特色是來自60多個國家 /地區的80個發言人,包括Sam Altman,Eric Schmidt和Palmer Luckey。泰德(Ted)的主題“人類重新構想”是量身定制的

約瑟夫·斯蒂格利茲(Joseph StiglitzApr 14, 2025 am 11:21 AM

約瑟夫·斯蒂格利茲(Joseph StiglitzApr 14, 2025 am 11:21 AM約瑟夫·斯蒂格利茨(Joseph Stiglitz)是2001年著名的經濟學家,是諾貝爾經濟獎的獲得者。斯蒂格利茨認為,AI可能會使現有的不平等和合併權力惡化,並在一些主導公司手中加劇,最終破壞了經濟上的經濟。

什麼是圖形數據庫?Apr 14, 2025 am 11:19 AM

什麼是圖形數據庫?Apr 14, 2025 am 11:19 AM圖數據庫:通過關係徹底改變數據管理 隨著數據的擴展及其特徵在各個字段中的發展,圖形數據庫正在作為管理互連數據的變革解決方案的出現。與傳統不同

LLM路由:策略,技術和Python實施Apr 14, 2025 am 11:14 AM

LLM路由:策略,技術和Python實施Apr 14, 2025 am 11:14 AM大型語言模型(LLM)路由:通過智能任務分配優化性能 LLM的快速發展的景觀呈現出各種各樣的模型,每個模型都具有獨特的優勢和劣勢。 有些在創意內容gen上表現出色

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

Dreamweaver Mac版

視覺化網頁開發工具

SublimeText3 英文版

推薦:為Win版本,支援程式碼提示!

記事本++7.3.1

好用且免費的程式碼編輯器

Atom編輯器mac版下載

最受歡迎的的開源編輯器

SAP NetWeaver Server Adapter for Eclipse

將Eclipse與SAP NetWeaver應用伺服器整合。