为了应对多模态大语言模型中视觉信息提取不充分的问题,哈尔滨工业大学(深圳)的研究人员提出了双层知识增强的多模态大语言模型-九天(JiuTian-LION)。

需要重新写的内容是:论文链接:https://arxiv.org/abs/2311.11860

GitHub: https://github.com/rshaojimmy/JiuTian

项目主页: https://rshaojimmy.github.io/Projects/JiuTian-LION

与现有的工作相比,九天首次分析了图像级理解任务和区域级定位任务之间的内部冲突,提出了分段指令微调策略和混合适配器来实现两种任务的互相提升。

通过注入细粒度空间感知和高层语义视觉知识,九天实现了在包括图像描述、视觉问题、和视觉定位等17个视觉语言任务上显著的性能提升( 比如Visual Spatial Reasoning 上高达5% 的性能提升),在其中13个评测任务上达到了国际领先水平,性能对比如图1所示。

图1:对比其他MLLMs,九天在大部分任务上都取得了最优的性能。

九天JiuTian-LION

通过赋予大型语言模型(LLMs)多模态感知能力,一些工作开始生成多模态大语言模型(MLLMs),并在许多视觉语言任务上取得了突破性进展。然而,现有的MLLMs主要采用图文对预训练得到的视觉编码器,如CLIP-ViT

这些视觉编码器的主要任务是学习图像层面的粗粒度图像文本模态对齐,但是它们缺乏全面的视觉感知和信息抽取能力,无法进行细粒度的视觉理解

在很大程度上,这种视觉信息提取不足和理解程度不够的问题会导致MLLMs存在视觉定位偏差、空间推理不足和物体幻觉等多个缺陷,如图2所示

请参考图2:九天(JiuTian-LION)是一种采用双层视觉知识增强的多模态大语言模型

九天相较于现有的多模态大语言模型(MLLMs),通过注入细粒度空间感知视觉知识和高层语义视觉证据,有效地提升了MLLMs的视觉理解能力,生成更准确的文本回应,减少了MLLMs的幻觉现象

双层视觉知识增强的多模态大语言模型-九天(JiuTian-LION)

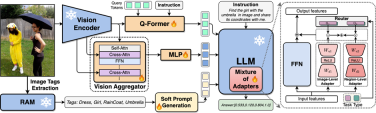

为了解决MLLMs在视觉信息提取和理解方面存在的不足,研究人员提出了一种双层视觉知识增强的MLLMs方法,被称为九天(JiuTian-LION)。具体的方法框架如图3所示

该方法主要从两方面增强MLLMs,渐进式融合细粒度空间感知视觉知识(Progressive Incorporation of Fine-grained Spatial-aware Visual knowledge)和软提示下的高层语义视觉证据(Soft Prompting of High-level Semantic Visual Evidence)。

具体来说,研究人员提出了一种分段指令微调策略,以解决图像级理解任务和区域级定位任务之间的内部冲突。他们逐步将细粒度的空间感知知识注入到MLLMs中。同时,他们将图像标签作为高层语义视觉证据加入MLLMs,并使用软提示方法来减轻不正确标签可能带来的负面影响

九天(JiuTian-LION)模型框架图如下所示:

此工作透過分段式訓練策略先分別基於Q-Former 和Vision Aggregator – MLP 兩個分支學習影像層級理解和區域層級定位任務,然後在最後訓練階段利用具有路由機制的混合適配器來動態融合不同分支的知識提升模型在兩種任務中的表現。

該工作也透過RAM提取圖像標籤作為高層語意視覺證據,然後提出軟提示方法來提高高層語意注入的效果

漸進式融合細粒度空間感知視覺知識

當直接將影像層級理解任務(包括影像描述和視覺問答)與區域層級定位任務(包括指示表達理解,指示表達生成等)進行單階段混合訓練時,MLLMs 會遭遇兩種任務之間存在的內部衝突,從而無法在所有任務上取得較好的綜合表現。

研究人員認為這種內在衝突主要由兩個問題引起。第一個問題是缺少區域級的模態對齊預訓練,目前具有區域級定位能力的MLLMs 大多先使用大量相關資料進行預訓練,不然很難在有限地訓練資源下讓基於圖像級模態對齊的視覺特徵適應區域層級任務。

另一個問題是影像層級理解任務和區域層級定位任務之間的輸入輸出模式差異,後者需要模型額外理解關於物體座標的特定短句(以 的形式)。為了解決上述問題,研究人員提出了分段式指令微調策略,以及具有路由機制的混合適配器。

的形式)。為了解決上述問題,研究人員提出了分段式指令微調策略,以及具有路由機制的混合適配器。

如圖4所示,研究者將單一階段指令微調過程拆分為三個階段:

##使用ViT、Q-Former和影像級適配器學習全局視覺知識的影像級理解任務;使用Vision Aggregator、MLP和區域級適配器學習細粒度空間感知視覺知識的區域級定位任務;提出了具有路由機制的混合適配器,動態融合不同分支中學習到的不同粒度的視覺知識。表3顯示了分段式指令微調策略相對於單階段訓練的效能優勢

圖4:分段式指令微調策略

對於注入軟提示下的高層語意視覺證據,需要進行重寫處理

研究人員提出使用圖像標籤作為高層語義視覺證據的有效補充,以進一步增強MLLMs的全局視覺感知理解能力

具體來說,先透過RAM 擷取影像的標籤,然後利用特定的指令模版「According to , you are allowed to use or partially use the following tags:」包裝圖片標籤。此指令模版中的「

配合模版中特定短語“use or partially use”,軟提示向量可以指導模型減輕不正確標籤帶來的潛在負面影響。

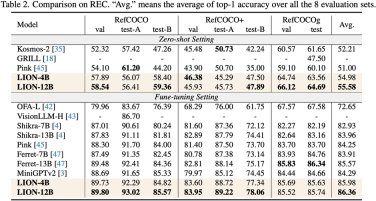

實驗結果研究人員在包含圖像描述(image captioning)、視覺問答(VQA)、和指示表達理解(REC)等17個任務基準集上進行了評測。

實驗結果表明,九天在13個評測集上達到了國際領先水準。特別的,相比較 InstructBLIP 和 Shikra,九天分別在圖像級理解任務和區域級定位任務上取得了全面且一致的性能提升,在 Visual Spatial Reasoning (VSR) 任務上可達到最高5%的提升幅度。

#

#

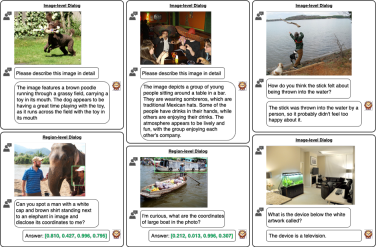

從圖5可以看出,在不同的視覺語言多模態任務中,九天和其他MLLMs的能力存在差異,顯示九天在細粒度視覺理解和視覺空間推理能力方面表現更優秀,並且能夠輸出具有較少幻覺的文字回應

#重寫的內容是:第五張圖展示了對九天大模型、InstructBLIP和Shikra的能力差異進行的定性分析

圖6透過樣本分析,顯示了九天模型在影像層級和區域層級視覺語言任務上都具有優秀的理解和辨識能力。

第六張圖:透過更多例子的分析,從圖像和區域級視覺理解的角度展示了九天大模型的能力

總結

(1)該工作提出了一個新的多模態大語言模型-九天:透過雙層視覺知識增強的多模態大語言模型。

(2)該工作在包括圖像描述、視覺問答和指示表達理解等17個視覺語言任務基準集上進行評測,其中13個評測集達到了當前最好的性能。

(3)這項工作提出了一種分段式指令微調策略,以解決影像層級理解和區域層級定位任務之間的內部衝突,並實現了兩種任務之間的相互提升

(4)該工作成功將圖像級理解和區域級定位任務進行整合,多層次全面理解視覺場景,未來可以將這種全面的視覺理解能力應用到具身智慧場景,幫助機器人更好、更全面地辨識和理解當前環境,做出有效決策。

以上是橫掃13個視覺語言任務!哈工深發布多模態大模型「九天」,性能直升5%的詳細內容。更多資訊請關注PHP中文網其他相關文章!

大多數使用的10個功率BI圖 - 分析VidhyaApr 16, 2025 pm 12:05 PM

大多數使用的10個功率BI圖 - 分析VidhyaApr 16, 2025 pm 12:05 PM用Microsoft Power BI圖來利用數據可視化的功能 在當今數據驅動的世界中,有效地將復雜信息傳達給非技術觀眾至關重要。 數據可視化橋接此差距,轉換原始數據i

AI的專家系統Apr 16, 2025 pm 12:00 PM

AI的專家系統Apr 16, 2025 pm 12:00 PM專家系統:深入研究AI的決策能力 想像一下,從醫療診斷到財務計劃,都可以訪問任何事情的專家建議。 這就是人工智能專家系統的力量。 這些系統模仿Pro

三個最好的氛圍編碼器分解了這項代碼中的AI革命Apr 16, 2025 am 11:58 AM

三個最好的氛圍編碼器分解了這項代碼中的AI革命Apr 16, 2025 am 11:58 AM首先,很明顯,這種情況正在迅速發生。各種公司都在談論AI目前撰寫的代碼的比例,並且這些代碼的比例正在迅速地增加。已經有很多工作流離失所

跑道AI的Gen-4:AI蒙太奇如何超越荒謬Apr 16, 2025 am 11:45 AM

跑道AI的Gen-4:AI蒙太奇如何超越荒謬Apr 16, 2025 am 11:45 AM從數字營銷到社交媒體的所有創意領域,電影業都站在技術十字路口。隨著人工智能開始重塑視覺講故事的各個方面並改變娛樂的景觀

如何註冊5天ISRO AI免費課程? - 分析VidhyaApr 16, 2025 am 11:43 AM

如何註冊5天ISRO AI免費課程? - 分析VidhyaApr 16, 2025 am 11:43 AMISRO的免費AI/ML在線課程:通向地理空間技術創新的門戶 印度太空研究組織(ISRO)通過其印度遙感研究所(IIR)為學生和專業人士提供了絕佳的機會

AI中的本地搜索算法Apr 16, 2025 am 11:40 AM

AI中的本地搜索算法Apr 16, 2025 am 11:40 AM本地搜索算法:綜合指南 規劃大規模活動需要有效的工作量分佈。 當傳統方法失敗時,本地搜索算法提供了強大的解決方案。 本文探討了爬山和模擬

OpenAI以GPT-4.1的重點轉移,將編碼和成本效率優先考慮Apr 16, 2025 am 11:37 AM

OpenAI以GPT-4.1的重點轉移,將編碼和成本效率優先考慮Apr 16, 2025 am 11:37 AM該版本包括三種不同的型號,GPT-4.1,GPT-4.1 MINI和GPT-4.1 NANO,標誌著向大語言模型景觀內的特定任務優化邁進。這些模型並未立即替換諸如

提示:chatgpt生成假護照Apr 16, 2025 am 11:35 AM

提示:chatgpt生成假護照Apr 16, 2025 am 11:35 AMChip Giant Nvidia週一表示,它將開始製造AI超級計算機(可以處理大量數據並運行複雜算法的機器),完全是在美國首次在美國境內。這一消息是在特朗普總統SI之後發布的

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

ZendStudio 13.5.1 Mac

強大的PHP整合開發環境

PhpStorm Mac 版本

最新(2018.2.1 )專業的PHP整合開發工具

SecLists

SecLists是最終安全測試人員的伙伴。它是一個包含各種類型清單的集合,這些清單在安全評估過程中經常使用,而且都在一個地方。 SecLists透過方便地提供安全測試人員可能需要的所有列表,幫助提高安全測試的效率和生產力。清單類型包括使用者名稱、密碼、URL、模糊測試有效載荷、敏感資料模式、Web shell等等。測試人員只需將此儲存庫拉到新的測試機上,他就可以存取所需的每種類型的清單。

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器