最近,LSTM之父Jürgen Schmidhuber一言不合又跟LeCun幹上了!

其實之前稍微熟悉這位暴脾氣大爺的同學都知道,特立獨行的Jürgen Schmidhuber和機器學習社群的幾位大佬級人物之間都有過不愉快。

尤其是當「那三個人」一起拿了個圖靈獎,而Schmidhuber卻沒有之後,這位老爺子就更氣了……

說到底Schmidhuber一直認為,現在這幾個ML領軍人物,什麼Bengio、Hinton、LeCun,包括「GAN」之父Goodfellow等人,他們的許多所謂「開創性成果」都是自己先提出來的,而這些人在論文中根本沒提過他。

為此,Schmidhuber曾經專門撰文把Bengio、Hinton、LeCun於2015年發在Nature上的綜述性文章「Deep Learning」一文拿出來批判過一番。

主要是說這篇文章裡的成果,哪些東西是他先提的,哪些東西是別的前輩先提的,反正不是這仨作者先提的。

怎麼又吵起來了?

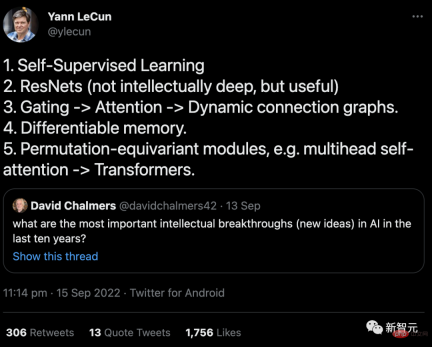

回到這次事件起因,實際上是LeCun在9月發的一條推文。

內容是對David Chalmers教授提問的回答:「在過去十年中,AI最重要的智力突破(新想法)是什麼?」

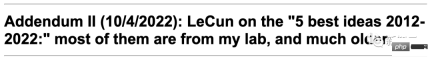

10月4日,Schmidhuber在他的部落格上撰文怒斥:這5個「best idea」大部分都來自於我的實驗室,而且提出的時間要遠早於「10年」這個時間節點。

文中Schmidhuber詳細列舉了六大證據來支撐自己的論述。

但估計是因為看到的人太少,Schmidhuber又在11月22日發推,重新把這個「冷飯」炒了一遍。

然而,相較於上一次還算激烈的爭辯,這回LeCun連理都沒理…

LSTM之父擺出「六大證據」

#1. 透過神經網路(NN)自動產生標註的「自我監督學習」:至少可以追溯到我1990-91年的工作。

(I) 透過預測編碼在一個循環神經網路(RNN)中進行自監督的目標生成,來學習在多個時間尺度和抽象層次上壓縮資料序列。

在這裡,一個「自動機」RNN學會了「預測下一個輸入」的前置任務,並將傳入資料流中的意外觀察值作為目標傳送給「分塊機」RNN,後者學習更高層次的規律性,隨後透過適當的訓練目標將其所獲得的預測知識提煉回自動機中。

這大大促進了先前無法解決的序列分類的下游深度學習任務。

(II) 透過GAN類型的內在動機進行自監督的標註生成,其中一個世界模型NN學習預測對抗性的、標註生成的、實驗發明的控制器NN的行為後果。

此外,在我於1990年發表的論文標題中,就已經出現了「自監督」的說法。

但是吧,在更早期(1978年)的論文中,也用到了這個字…

2. “ResNets”:其實就是我早期提出的Highway Nets。但LeCun卻認為ResNets的智力「不深」,這讓我非常難過。

在我提出Highway Nets之前,前饋網絡最多只有幾十層(20-30層),而Highway Nets是第一個真正的深度前饋神經網絡,有數百層。

在1990年代,我的LSTM為有監督的遞歸NN帶來了基本無限的深度。在2000年代,LSTM啟發的Highway Nets為前饋NN帶來了深度。

由此帶來的是,LSTM成為20世紀被引用最多的NN,而Highway Nets(ResNet)是21世紀被引用最多的NN。

可以說,它們代表了深度學習的精髓,而深度學習就是關於NN的深度。

3. 「門控->注意力->動態連結圖」:至少可以追溯到我的Fast Weight Programmers和1991-93年的Key -Value Memory Networks(其中的「Key-Value」稱為「FROM-TO」)。

1993年,我引入了現在使用的術語「注意力」。

不過值得注意的是,NN中的第一個乘法閘可以追溯到1965年Ivakhnenko & Lapa的深度學習機器。

4. “Differentiable memory”:同樣可以追溯到我的Fast Weight Programmers或1991年的Key-Value Memory Networks。

像傳統電腦中那樣分離儲存和控制,但以端到端差分、自適應、完全神經的方式(而不是以混合方式)。

5. 「置換等變模組,例如多頭自註意力->Transformer」:我在1991年發表了帶有線性化自註意的Transformer。相應的「注意力」術語(internal spotlights of attention)可以追溯到1993年。

6. 「GAN是過去10年中最好的機器學習理念」

你提到的這個GAN(2014年)的原理,實際上是我在1990年以人工智慧好奇心的名義提出的。

上次,還是在幾個月之前

其實這已經不是Schmidhuber和LeCun之間今年第一次發生爭執了。

在六七月間,兩人就關於LeCun發表的一篇「自主機器智慧未來方向」的展望報告有來有回地吵了一番。

6月27日,Yann LeCun發表了自己積蓄幾年的論文「A Path Towards Autonomous Machine Intelligence」,並稱之為「指明AI未來發展方向之作」。

這篇論文系統講述了關於「機器如何能像動物和人類一樣學習」的問題,長達60多頁。

LeCun表示,此文不僅是自己關於未來5-10年內關於AI發展大方向的思考,也是自己未來幾年打算研究的內容,並希望能夠啟發AI界的更多人來一起研究。

而Schmidhuber大概提前十幾天就得知這個消息,並拿到了這篇論文,當即就寫了一篇文章反駁。

依照Schmidhuber自己在部落格上文章的說法,當時事情是這樣的:

2022年6月14日,一家科學媒體發布消息,說LeCun在6月27日要發布一篇報告,給我發了一份報告的草稿(當時還在保密期),並請我發表評論。

我寫了一篇評論,告訴他們這基本上是我們以前工作的翻版,而LeCun的文章中並沒有提到。

然而,我的意見被置若罔聞。

實際上,早在他這篇東西發表以前,我們就提出了LeCun在這篇文中所謂的「主要原創貢獻」的大部分內容,主要有:

(1) 「認知架構,其中所有模組都是可分的,而且許多模組是可訓練的」(我們在1990年提出)。

(2) 「預測世界模式的分層結構,在多個抽象層次和多個時間尺度上學習表徵」 (我們在1991年提出)。

(3) 「自我監督的學習範式,產生同時具有資訊性和可預測性的表徵」(我們的模型自1997年起就用於強化學習和世界建構模了)

(4) 「用於不確定性下的分層規劃」的預測模型,包括基於梯度的神經子目標生成器(1990)、抽象概念空間的推理(1997年)、「主要透過觀察學習行動」的神經網路(2015年),以及學習思考(2015年),都是我們先提出的。

7月14日,Yann LeCun回應,說討論要有建設性,他是這麼說的:

我不想陷入一場關於「某個概念是誰發明的」這種無謂爭論中,也不想在你的回應文章中列出的160個參考文獻中深究。我認為更有建設性的做法是,指出你認為可能包含我列出的4項貢獻中的觀點和方法的4篇出版物。

正如我在論文的開頭所說,有許多概念已經存在了很長時間,你和我都不是這些概念的發明人:例如,可微調世界模型的概念,可以追溯到早期的最佳化控制工作。

訓練世界模型利用神經網路學習世界模型的系統識別,這個想法可以追溯到80年代末,由Michael Jordan, Bernie Widrow, Robinson & Fallside, Kumpathi Narendra, Paul Werbos進行的工作,都比你的工作早。

在我看來,這個稻草人式的回答似乎是LeCun在轉移話題,對他的所謂「主要原創貢獻」中貪他人之功的問題避而不談。

我在7月14日回覆:

關於你說的「你我都沒有發明的東西」:你的論文聲稱,用神經網路進行系統辨識可以追溯到20世紀90年代初。然而,在你的先前的回應中,你似乎同意我的觀點:這方面的第一篇論文出現在1980年代。

至於你的「主要原創貢獻」,其實都用了我早年間的工作成果。

(一) 關於你提出的「認知架構,其中所有模組都是可分化的,且許多模組都是可訓練的」,「透過內在動機驅動行為」:

我在1990年就提出了用於線上學習和規劃的可分化架構,這是第一個具有「內在動機」的控制器,用以改善世界模型,它既是生成性的,也是對抗性的;你文中引用的2014年的GAN是這個模型的一個衍生版本。

(二)關於你提出的「在多個抽象層次和時間尺度上學習表徵的預測性世界模型的分層結構」:

這是我1991年的神經歷史壓縮機實現的。它使用預測編碼,以自監督的方式學習長序列資料的分層內部表徵,大大促進了下游的學習。使用我1991年的神經網路提煉程序,這些表徵可以被折疊成一個單一的循環神經網路(RNN)。

(三)關於你在控制方面的「自監督學習範式,產生同時具有資訊性和可預測性的表徵」:

#這一點我在1997年提出建構的系統中已經提出。它不是預測未來輸入的所有細節,而是可以提出任意的抽象問題,並在你所說的「表徵空間」中給出可計算的答案。在這個系統中,兩個名為「左腦」和「右腦」的學習模型,選擇獎勵最大化的對手進行零和博弈,偶爾還會在這種計算實驗的結果上打賭。

(四)關於你的可用於不確定情況下的分層規劃預測性可微分模型,你的文章裡是這麼寫的:

「一個尚未回答的問題是,配置器如何學習將一個複雜的任務分解為一連串可以由智能體單獨完成的子目標。我將把這個問題留給未來的調查。」

就別說什麼未來了,實際上我在30多年前就發表過這樣的文章:

##一個控制器神經網路負責獲得額外的命令輸入,其形式為(開始,目標)。一個評估器神經網路負責學習預測從開始到目標的預期成本。一個基於可微調循環神經網路的子目標生成器看到了這個(開始,目標)的輸入,並使用評估器神經網絡,透過梯度下降學習一系列成本最小的中間子目標。

(五)你也強調了 「主要透過觀察來學習行為」的神經網路。 其實我們很早就解決了這個問題,比2015年這篇文章,討論了部分可觀察環境中強化學習(RL)的一般問題。

世界模型M可能擅長預測一些事情,但對其他事情不確定。控制器C透過學習透過自我發明的問題序列(激活模式)來查詢並解釋答案(更多的激活模式)來最大化其目標函數。

C可以從學習從M中提取任何類型的演算法資訊中獲益,例如用於分層規劃和推理,利用M中編碼的被動觀察等等。

以上是LSTM之父再次約戰LeCun:你那5點「創新」都是抄我的!卻慘遭「已讀不回」的詳細內容。更多資訊請關注PHP中文網其他相關文章!

大多數使用的10個功率BI圖 - 分析VidhyaApr 16, 2025 pm 12:05 PM

大多數使用的10個功率BI圖 - 分析VidhyaApr 16, 2025 pm 12:05 PM用Microsoft Power BI圖來利用數據可視化的功能 在當今數據驅動的世界中,有效地將復雜信息傳達給非技術觀眾至關重要。 數據可視化橋接此差距,轉換原始數據i

AI的專家系統Apr 16, 2025 pm 12:00 PM

AI的專家系統Apr 16, 2025 pm 12:00 PM專家系統:深入研究AI的決策能力 想像一下,從醫療診斷到財務計劃,都可以訪問任何事情的專家建議。 這就是人工智能專家系統的力量。 這些系統模仿Pro

三個最好的氛圍編碼器分解了這項代碼中的AI革命Apr 16, 2025 am 11:58 AM

三個最好的氛圍編碼器分解了這項代碼中的AI革命Apr 16, 2025 am 11:58 AM首先,很明顯,這種情況正在迅速發生。各種公司都在談論AI目前撰寫的代碼的比例,並且這些代碼的比例正在迅速地增加。已經有很多工作流離失所

跑道AI的Gen-4:AI蒙太奇如何超越荒謬Apr 16, 2025 am 11:45 AM

跑道AI的Gen-4:AI蒙太奇如何超越荒謬Apr 16, 2025 am 11:45 AM從數字營銷到社交媒體的所有創意領域,電影業都站在技術十字路口。隨著人工智能開始重塑視覺講故事的各個方面並改變娛樂的景觀

如何註冊5天ISRO AI免費課程? - 分析VidhyaApr 16, 2025 am 11:43 AM

如何註冊5天ISRO AI免費課程? - 分析VidhyaApr 16, 2025 am 11:43 AMISRO的免費AI/ML在線課程:通向地理空間技術創新的門戶 印度太空研究組織(ISRO)通過其印度遙感研究所(IIR)為學生和專業人士提供了絕佳的機會

AI中的本地搜索算法Apr 16, 2025 am 11:40 AM

AI中的本地搜索算法Apr 16, 2025 am 11:40 AM本地搜索算法:綜合指南 規劃大規模活動需要有效的工作量分佈。 當傳統方法失敗時,本地搜索算法提供了強大的解決方案。 本文探討了爬山和模擬

OpenAI以GPT-4.1的重點轉移,將編碼和成本效率優先考慮Apr 16, 2025 am 11:37 AM

OpenAI以GPT-4.1的重點轉移,將編碼和成本效率優先考慮Apr 16, 2025 am 11:37 AM該版本包括三種不同的型號,GPT-4.1,GPT-4.1 MINI和GPT-4.1 NANO,標誌著向大語言模型景觀內的特定任務優化邁進。這些模型並未立即替換諸如

提示:chatgpt生成假護照Apr 16, 2025 am 11:35 AM

提示:chatgpt生成假護照Apr 16, 2025 am 11:35 AMChip Giant Nvidia週一表示,它將開始製造AI超級計算機(可以處理大量數據並運行複雜算法的機器),完全是在美國首次在美國境內。這一消息是在特朗普總統SI之後發布的

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

MantisBT

Mantis是一個易於部署的基於Web的缺陷追蹤工具,用於幫助產品缺陷追蹤。它需要PHP、MySQL和一個Web伺服器。請查看我們的演示和託管服務。

SAP NetWeaver Server Adapter for Eclipse

將Eclipse與SAP NetWeaver應用伺服器整合。

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器

SublimeText3 英文版

推薦:為Win版本,支援程式碼提示!

ZendStudio 13.5.1 Mac

強大的PHP整合開發環境