昨天,千位大佬寫的暫停超強AI訓練六個月的聯名信,如同一枚炸彈一般,在國內外的互聯網上炸響。

經過了一天的唇槍舌劍,幾位關鍵人物以及其他各路大牛,都紛紛出來公開回應。

有的非常官方,有的十分個性,也有人沒有面對問題。但有一點可以肯定,不論這些大佬自己的觀點,還是背後所代表的利益集團,都值得細品。

有趣的是,在圖靈三巨頭中,一位帶頭簽名,一位強烈反對,還有一位不發一言。

Bengio簽名、Hinton沉默、LeCun反對

吳恩達(反對派)

這次事件中,前谷歌大腦成員、線上教育平台Coursera創始人吳恩達是旗幟鮮明的反對派。

他明確亮出了自己的態度:把「讓AI取得超越GPT-4的進展」暫停6個月,這個想法很糟糕。

他表示,自己已經在教育、醫療保健、食物等領域看到了許多新的AI應用,許多人將因此受益。而改進GPT-4也會有好處。

我們該做的,應該是在AI創造的巨大價值與現實風險之間,取得一個平衡。

對於聯名信中提到的「如果不能迅速暫停對超強AI的訓練,就應該讓政府介入」,吳恩達也表示這種想法很糟糕。

他表示,讓政府暫停他們不了解的新興技術是反競爭的,這樹立了一個糟糕的先例,是一個很可怕的政策創新。

他承認,負責任的AI很重要,AI也的確有風險。

但媒體渲染的「AI公司正在瘋狂發布危險的程式碼」,顯然太誇張了。絕大多數AI團隊,都非常重視負責任的AI和安全。不過他也承認,「遺憾的是,不是全部」。

最後他再次強調:

6個月的暫停期,不是一個切實可行的建議。為了提高人工智慧的安全性,圍繞透明度和審計的法規將更加實用,並產生更大的影響。在我們推進技術的同時,讓我們也更投入安全,而不是扼殺進步。

而他的推特下面,已經網友表示強烈反對:大佬之所以雲淡風輕,大概是因為失業的痛苦不會落到他們頭上。

LeCun(反對派)

聯名信一發出,就有網友奔走相告:圖靈獎巨擘Bengio和LeCun都在信上簽了名!

而時時衝浪在網路第一線的LeCun,立刻闢謠:沒,我沒簽,我不同意這封信的前提。

有網友表示,我也不同意這封信,但我很好奇:你不同意這封信的原因,是覺得LLM不夠先進,根本威脅不到人類嗎,還是其他原因?

但LeCun對於這些問題,都沒有回答。

在謎一般地沉默了20小時後,LeCun忽然轉發了一位網友的推文:

「OpenAI足足等了6個月,才發布了GPT4!他們甚至為此還寫了一份白皮書....」

對此,LeCun大讚道:說得對,所謂「暫停研發」,不過就是「秘密研發」罷了,這與一些簽名者所希望的恰恰完全相反。

看來,什麼都瞞不過LeCun的慧眼啊。

先前提問的網友也表示同意:這就是我什麼反對這個請願書的原因——沒有哪個「壞人」會真正停止。

「所以這就像一項沒有人遵守的武器條約?歷史上這樣的例子不多嗎?」

過一會,他又轉發了一位大佬的推特。

這位大佬說,「我也沒簽。這封信充斥著一堆可怕的修辭和無效/不存在的政策處方。」LeCun說,「我同意」。

Bengio和Marcus(贊成派)

公開信署名的第一位大佬,便是赫赫有名的圖靈獎得主Yoshua Bengio。

當然了,紐約大學教授馬庫斯也投了贊成票。他似乎是最早曝光這次公開信的人。

而討論聲逐漸喧囂之後,他也火速發了一篇博客解釋自己的立場,依然充滿亮點。

突發新聞:我之前提到的那封信現在公開了。這封信呼籲暫停「比GPT-4更強大」的AI的訓練6個月。許多知名人士簽了名。我也加入了。

我沒有參與起草它,因為還有一些別的事需要大驚小怪(例如,比GPT-4更強大的AI,究竟是指哪些AI?既然GPT-4的架構或訓練集的細節還沒公佈,那我們從何得知呢?)——但這封信的精神是我所支持的:在我們能更好地處理風險和收益之前,我們應該謹慎行事。

看看接下來會發生什麼,將會非常有趣。

而剛剛馬庫斯表示百分之百贊同的另一個觀點,也非常有趣,這一觀點稱:

GPT-5不會是AGI 。幾乎可以肯定,沒有GPT模型會是AGI。我們今天使用的方法(梯度下降)優化的任何模型完全不可能成為AGI。即將問世的GPT模型肯定會改變世界,但過度炒作是瘋狂的。

Altman(不置可否)

截至目前,對於這封公開信,Sam Altman並未作出明確表態。

不過呢,他倒是發表了一些關於通用人工智慧的觀點。

構成好的通用人工智慧的要素:

1.對齊超級智慧的技術能力

2.大多數領先的AGI工作之間的充分協調

3. 一個有效的全球監管架構

有網友質疑:「與什麼對齊?和誰對齊?與某些人對齊,就意味著與另外一些人不對齊。」

這篇評論亮了:「那你倒是讓它Open啊。」

#

而OpenAI的另一位創始人Greg Brockman轉發了Altman的推文,再次強調OpenAI的使命「是確保AGI惠及全人類。」

再次有網友指出華點:你們這些大佬整天說「與設計者的意圖對齊」,但除此之外誰都不知道究竟對齊是指什麼。

Yudkowsky(激進派)

還有一位名叫Eliezer Yudkowsky的決策理論家,態度更為激進:

暫停AI開發是不夠的,我們需要把AI全部關閉!全部關閉!

如果繼續下去,我們每個人都會死。

公開信一發布,Yudkowsky立刻寫了一篇長文發表於TIME雜誌上。

他表示,自己沒有簽字,原因是在他看來,這封信太溫和了。

這封信低估了事態的嚴重性,要求解決的問題太少了。

他說,關鍵問題並不在於「與人類競爭」的智能,很顯然,當AI變得比人更聰明,這一步是顯然的。

關鍵在於,包括他在內的許多研究人員都認為,建構一個擁有超人智慧的AI最有可能導致的後果就是,地球上的每個人都會死去。

不是「或許可能」,而是「必然會」。

如果沒有足夠的精確度,最有可能的結果就是,我們造出的AI不會做我們想做的事,也不會關心我們,也不會關心其他有知覺的生命。

理論上,我們應該可以教導AI學會這種關懷,但現在我們並不知道該怎麼做。

如果沒有這種關懷,我們得到的結果就是:AI不愛你,也不恨你,你只是一堆原子組成的材料,它可以拿來做任何事。

而如果人類想要反抗超人AI,必然會失敗,就好比「11世紀試圖打敗21世紀」,「南方古猿試圖打敗智人」。

Yudkowsky表示,我們想像中會做壞事的AI,就是一個住在網路上、每天給人類發送惡意郵件的思想家,但實際上,它可能是一個充滿敵意的超人AI,一個思考速度數百萬倍於人類的外星文明,在它看來,人類很愚蠢,很緩慢。

當這個AI夠聰明後,它不會只待在電腦裡。它可以把DNA序列透過郵件發給實驗室,實驗室將按需生產蛋白質,然後AI就擁有了生命形式。隨後,地球上的所有生物都會死亡。

這種情況下,人類該如何生存?目前我們毫無計劃。

OpenAI只是公開呼籲,未來的AI需要對齊。而另一個領先的AI實驗室DeepMind,根本沒有任何計畫。

來自OpenAI官方部落格

#不管AI有沒有意識,這些危險都存在。它強大的認知系統可以努力優化,並計算滿足複雜結果的標準輸出。

的確,目前的AI可能只是從訓練資料中模仿了自我意識。但我們實際上對這些系統的內部結構知之甚少。

如果我們依然對GPT-4無知,而GPT-5進化出了驚人的能力, 就像從GPT-3到GPT- 4一樣,那我們很難知道,究竟是人類創造了GPT-5,還是AI自己。

在2月7號,微軟CEO納德拉還幸災樂禍地公開表示,新必應逼得Google只能「出來跳一段舞」了。

他的行為很不理智。

早在30年前,我們就該思考這個問題了,6個月並不足以彌補差距。

從AI的概念提出到今天,已經有60多年了。我們應該至少用30年來保證超人AI「不會殺死任何一個人」。

我們根本無法從錯誤中學習,因為一旦錯了,你就已經死了。

如果暫停6個月,就能讓地球存活下來,我會贊同,但並沒有。

我們要做的事情,是這些:

#1. 新的大語言模型的訓練不僅要無限期暫停,還要在全球範圍內實施。

而且不能有任何例外,包括政府或軍隊。

2. 關閉所有大型GPU集群,這些都是訓練最強大AI的大型運算設施。

暫停所有正在訓練大型AI的模型,為所有人在訓練AI系統時使用的算力設定上限,並在未來幾年逐漸降低這個上限,以補償更有效率的訓練演算法。

政府和軍隊也不例外,立即制定多國協議,以防止被禁行為轉移到其他地方。

追蹤所有售出的GPU,如果有情報顯示協議之外的國家正在建設GPU集群,應該透過空襲摧毀這家違規的資料中心。

比起國家間的武裝衝突,更應該擔心的是暫停被違反。不要把任何事情都看作是國家利益之間的衝突,要清楚任何談論軍備競賽的人都是傻子。

在這方面,我們所有人要麼共存,要麼共亡,這不是政策,而是一項自然事實。

投票

由於簽名太過火爆,團隊決定暫停先暫停顯示,以便讓審核可以跟上。 (名單頂部的簽名都是直接經過驗證的)

以上是暫停GPT-5研發呼籲引激戰!吳恩達、LeCun帶頭反對,Bengio站隊支持的詳細內容。更多資訊請關注PHP中文網其他相關文章!

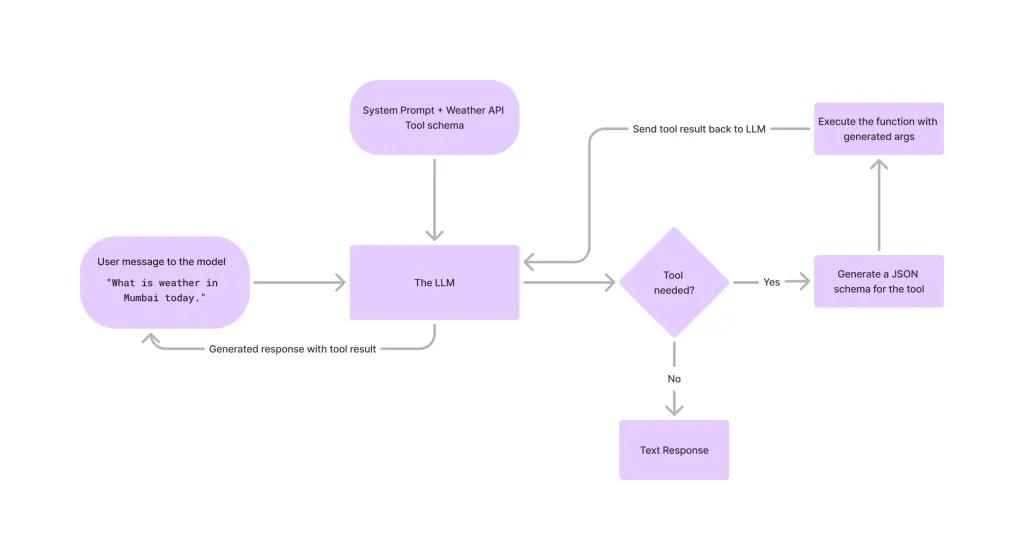

在LLMS中調用工具Apr 14, 2025 am 11:28 AM

在LLMS中調用工具Apr 14, 2025 am 11:28 AM大型語言模型(LLMS)的流行激增,工具稱呼功能極大地擴展了其功能,而不是簡單的文本生成。 現在,LLM可以處理複雜的自動化任務,例如Dynamic UI創建和自主a

多動症遊戲,健康工具和AI聊天機器人如何改變全球健康Apr 14, 2025 am 11:27 AM

多動症遊戲,健康工具和AI聊天機器人如何改變全球健康Apr 14, 2025 am 11:27 AM視頻遊戲可以緩解焦慮,建立焦點或支持多動症的孩子嗎? 隨著醫療保健在全球範圍內挑戰,尤其是在青年中的挑戰,創新者正在轉向一種不太可能的工具:視頻遊戲。現在是世界上最大的娛樂印度河之一

沒有關於AI的投入:獲勝者,失敗者和機遇Apr 14, 2025 am 11:25 AM

沒有關於AI的投入:獲勝者,失敗者和機遇Apr 14, 2025 am 11:25 AM“歷史表明,儘管技術進步推動了經濟增長,但它並不能自行確保公平的收入分配或促進包容性人類發展,”烏托德秘書長Rebeca Grynspan在序言中寫道。

通過生成AI學習談判技巧Apr 14, 2025 am 11:23 AM

通過生成AI學習談判技巧Apr 14, 2025 am 11:23 AM易於使用,使用生成的AI作為您的談判導師和陪練夥伴。 讓我們來談談。 對創新AI突破的這種分析是我正在進行的《福布斯》列的最新覆蓋範圍的一部分,包括識別和解釋

泰德(Ted)從Openai,Google,Meta透露出庭,與我自己自拍Apr 14, 2025 am 11:22 AM

泰德(Ted)從Openai,Google,Meta透露出庭,與我自己自拍Apr 14, 2025 am 11:22 AM在溫哥華舉行的TED2025會議昨天在4月11日舉行了第36版。它的特色是來自60多個國家 /地區的80個發言人,包括Sam Altman,Eric Schmidt和Palmer Luckey。泰德(Ted)的主題“人類重新構想”是量身定制的

約瑟夫·斯蒂格利茲(Joseph StiglitzApr 14, 2025 am 11:21 AM

約瑟夫·斯蒂格利茲(Joseph StiglitzApr 14, 2025 am 11:21 AM約瑟夫·斯蒂格利茨(Joseph Stiglitz)是2001年著名的經濟學家,是諾貝爾經濟獎的獲得者。斯蒂格利茨認為,AI可能會使現有的不平等和合併權力惡化,並在一些主導公司手中加劇,最終破壞了經濟上的經濟。

什麼是圖形數據庫?Apr 14, 2025 am 11:19 AM

什麼是圖形數據庫?Apr 14, 2025 am 11:19 AM圖數據庫:通過關係徹底改變數據管理 隨著數據的擴展及其特徵在各個字段中的發展,圖形數據庫正在作為管理互連數據的變革解決方案的出現。與傳統不同

LLM路由:策略,技術和Python實施Apr 14, 2025 am 11:14 AM

LLM路由:策略,技術和Python實施Apr 14, 2025 am 11:14 AM大型語言模型(LLM)路由:通過智能任務分配優化性能 LLM的快速發展的景觀呈現出各種各樣的模型,每個模型都具有獨特的優勢和劣勢。 有些在創意內容gen上表現出色

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器

Dreamweaver CS6

視覺化網頁開發工具

WebStorm Mac版

好用的JavaScript開發工具

Safe Exam Browser

Safe Exam Browser是一個安全的瀏覽器環境,安全地進行線上考試。該軟體將任何電腦變成一個安全的工作站。它控制對任何實用工具的訪問,並防止學生使用未經授權的資源。

禪工作室 13.0.1

強大的PHP整合開發環境