多年來,我們一直在透過語音助理、社群媒體、搜尋演算法、手機臉部辨識等方式悄悄地與人工智慧互動。但隨著ChatGPT等生成式人工智慧的出現,人工智慧佔據了前沿和中心位置。

突然間,我們開始發自內心地見證人工智慧,對所見所聞感到驚訝。人工智慧不再讓人感覺像是「某一天會出現的東西」。它現在是「存在於此,並準備好改變世界」。

改變會帶來風險。對於尚未制定AI風險管理計畫的企業和管理團隊而言,ChatGPT應該是一個令人震驚的警鐘。本文將探討廣泛實施人工智慧所帶來的風險。

以下是企業領導者應注意的5大人工智慧風險:

1、中斷風險

人工智慧將以前所未有的技術顛覆現有的商業模式和市場。最明顯的例子就是ChatGPT本身。誰會想到Google作為無可爭議的搜尋冠軍的地位會受到如此突然和不穩定的挑戰?

似乎就在一兩年前,大多數人都設想人工智慧會顛覆依賴相對低技能勞動力的產業,如卡車運輸和客戶服務,或在最壞的情況下,顛覆高度有條不紊的工作,例如金融交易和放射學。現在我們了解到,媒體和廣告等創意產業,以及教學和財務諮詢等個人化服務業,甚至是醫藥研發和電腦科學等精英技能領域,都面臨著風險。

根據Goldman Sachs 2023年3月的報告,像ChatGPT這樣的生成式人工智慧可能會在全球淘汰多達3億個工作崗位,其中包括美國現有工作崗位的19 %。無論從事何種行業或職業,幾乎可以肯定是,企業將在未來幾年內面臨巨大變化。與以往的科技顛覆不同,這次的賭注真的可能是「生死攸關」。

2、網路安全風險

保護組織資料、系統和人員免受駭客和其他破壞者的侵害,已經成為企業領導者面臨的一個日益嚴重的問題。 2022年,攻擊次數增加了38%,平均每個組織每週攻擊超過1,000次,每次資料外洩的平均成本激增至超過400萬美元。

人工智慧將倍增這項挑戰。想像一下,當像ChatGPT這樣複雜的AI向員工發送電子郵件時,這些電子郵件看似來自老闆,使用的信息通常只有老闆才知道,甚至還使用了老闆的寫作風格,這樣的網絡釣魚攻擊將有多大。

至少自2019年開始,就有通報稱在網路詐騙中使用語音複製等深度偽造技術。隨著人工智慧每天都在改進和多樣化,網路風險管理的問題只會越來越嚴重。

如果認為防火牆和其他當今的網路防禦技術可以拯救,請三思。 AI將幫助壞人找到防禦中最薄弱的環節,然後全天候工作,直到找到突破口。

3、聲譽風險

當ChatGPT首次出現在公眾視野時,Google高層最初以「聲譽風險」為理由,表示不會立即推出與之競爭的人工智慧。但幾天後就撤回了聲明,並宣布推出Bard。 Bing和其他生成AI領域出現的錯誤和尷尬,證明了Google最初的擔憂是有根據的。

大眾正在觀望。當AI以不符合價值觀的方式行事時,可能會導致公關災難。新興形式的人工智慧已經表現得像一個種族主義者、厭惡女性的怪物,導致了錯誤的逮捕,並放大了員工招募中的偏見。

有時,人工智慧會破壞人員關係。根據Forrester的數據,75%的消費者對客戶服務聊天機器人感到失望,30%的消費者在人工智慧驅動的客戶服務互動不佳後將業務轉移到別處。人工智慧還很年輕,容易出錯。然而,儘管風險很高,但我們希望許多商業組織在部署人工智慧時,會完全了解所涉及的聲譽風險。

4、法律風險

聯邦政府正準備應對人工智慧崛起帶來的社會挑戰。 2022年,拜登政府公佈了《人工智慧權利法案》藍圖,以保護隱私和公民自由。 2023年,美國國家標準技術研究院發布了人工智慧風險管理框架,以協助企業董事會和其他組織領導應對人工智慧風險。 《2022年的演算法問責法》仍然只是一項法案,旨在在廣泛的自動化決策機制中建立透明度。這只是聯邦立法。光是2022年,就有不少於17個州提出了管理人工智慧的立法,目標是臉部辨識、招募偏見、上癮演算法和其他人工智慧用例。對於跨國企業,歐盟擬議的《人工智慧法案》旨在禁止或適度使用生物辨識、心理操縱、剝削弱勢群體以及社會信用評分。

新法規即將出台,可能會在2023年內推出。企業面臨的風險不僅僅是合規性。如果使用AI的產品或服務出現問題,誰將承擔責任:產品或服務提供者?人工智慧開發者?數據供應商?還是企業法人?至少,這需要為AI的決策方式提供透明度,以遵守新法律中的透明度規定。

5、操作風險

人工智慧風險的最後一個領域可能是最明顯的,但在某些方面也是最危險的。如果員工不小心誤用了ChatGPT,導致商業機密洩露,會發生什麼?當AI沒有按預期工作時會發生什麼?過快採用人工智能的負面影響可能是巨大的。

ChatGPT是當今進人工智慧最著名的例子,全世界都在測試它,而且每天都在報告其缺點。但企業使用的人工智慧可能無法享受這種好處。當AI告知在特定供應商、材料或產品上加倍下注時,但卻做錯了——如何知道會發生什麼?

IBM的Watson曾為癌症患者提出不正確且危險的治療方法。英國Tyndaris Investments在其對沖基金AI每天損失高達2000萬美元後,被香港大亨李健勤起訴。還有,失控的特斯拉撞死了行人?這是企業領導者的職責-意識到這種操作風險,並加以管理。

以上是ChatGPT和生成式AI時代的五大AI風險的詳細內容。更多資訊請關注PHP中文網其他相關文章!

在LLMS中調用工具Apr 14, 2025 am 11:28 AM

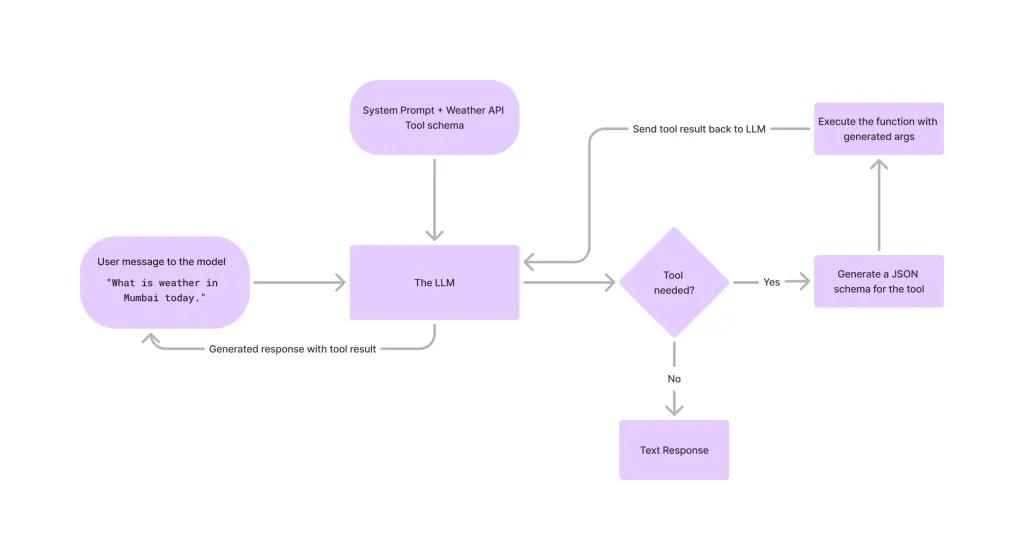

在LLMS中調用工具Apr 14, 2025 am 11:28 AM大型語言模型(LLMS)的流行激增,工具稱呼功能極大地擴展了其功能,而不是簡單的文本生成。 現在,LLM可以處理複雜的自動化任務,例如Dynamic UI創建和自主a

多動症遊戲,健康工具和AI聊天機器人如何改變全球健康Apr 14, 2025 am 11:27 AM

多動症遊戲,健康工具和AI聊天機器人如何改變全球健康Apr 14, 2025 am 11:27 AM視頻遊戲可以緩解焦慮,建立焦點或支持多動症的孩子嗎? 隨著醫療保健在全球範圍內挑戰,尤其是在青年中的挑戰,創新者正在轉向一種不太可能的工具:視頻遊戲。現在是世界上最大的娛樂印度河之一

沒有關於AI的投入:獲勝者,失敗者和機遇Apr 14, 2025 am 11:25 AM

沒有關於AI的投入:獲勝者,失敗者和機遇Apr 14, 2025 am 11:25 AM“歷史表明,儘管技術進步推動了經濟增長,但它並不能自行確保公平的收入分配或促進包容性人類發展,”烏托德秘書長Rebeca Grynspan在序言中寫道。

通過生成AI學習談判技巧Apr 14, 2025 am 11:23 AM

通過生成AI學習談判技巧Apr 14, 2025 am 11:23 AM易於使用,使用生成的AI作為您的談判導師和陪練夥伴。 讓我們來談談。 對創新AI突破的這種分析是我正在進行的《福布斯》列的最新覆蓋範圍的一部分,包括識別和解釋

泰德(Ted)從Openai,Google,Meta透露出庭,與我自己自拍Apr 14, 2025 am 11:22 AM

泰德(Ted)從Openai,Google,Meta透露出庭,與我自己自拍Apr 14, 2025 am 11:22 AM在溫哥華舉行的TED2025會議昨天在4月11日舉行了第36版。它的特色是來自60多個國家 /地區的80個發言人,包括Sam Altman,Eric Schmidt和Palmer Luckey。泰德(Ted)的主題“人類重新構想”是量身定制的

約瑟夫·斯蒂格利茲(Joseph StiglitzApr 14, 2025 am 11:21 AM

約瑟夫·斯蒂格利茲(Joseph StiglitzApr 14, 2025 am 11:21 AM約瑟夫·斯蒂格利茨(Joseph Stiglitz)是2001年著名的經濟學家,是諾貝爾經濟獎的獲得者。斯蒂格利茨認為,AI可能會使現有的不平等和合併權力惡化,並在一些主導公司手中加劇,最終破壞了經濟上的經濟。

什麼是圖形數據庫?Apr 14, 2025 am 11:19 AM

什麼是圖形數據庫?Apr 14, 2025 am 11:19 AM圖數據庫:通過關係徹底改變數據管理 隨著數據的擴展及其特徵在各個字段中的發展,圖形數據庫正在作為管理互連數據的變革解決方案的出現。與傳統不同

LLM路由:策略,技術和Python實施Apr 14, 2025 am 11:14 AM

LLM路由:策略,技術和Python實施Apr 14, 2025 am 11:14 AM大型語言模型(LLM)路由:通過智能任務分配優化性能 LLM的快速發展的景觀呈現出各種各樣的模型,每個模型都具有獨特的優勢和劣勢。 有些在創意內容gen上表現出色

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

Atom編輯器mac版下載

最受歡迎的的開源編輯器

記事本++7.3.1

好用且免費的程式碼編輯器

ZendStudio 13.5.1 Mac

強大的PHP整合開發環境

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器

WebStorm Mac版

好用的JavaScript開發工具