人工智慧的承諾、可能性和潛力

人工智慧的利用已經為當前及未來的社會帶來巨大好處,例如提高供應鏈效率、推進智慧自動化和機器人技術以支援我們的日常生活,以及在邊境提供無縫通關。人工智慧技術的進步如此之大,以至於它已經迅速接近,在某些情況下甚至超過了人類的智力。正如人類智能需要在具有良好道德和治理的人類社會中適當利用和協調一樣,我們也需要對人工智慧做同樣的事情。

人工智慧的黑暗面

有一些注意事項需要牢記。如果你聽過 GPT-4chan,那麼你也會聽到它存在的問題。 GPT-4chan 模型由人工智慧 (AI) 社群的一位 Youtuber (油管部落客)開發,是基於一個有爭議的論壇 4chan 的 /pol/(政治不正確)板塊開發的。 4chan的/pol/(「政治不正確」縮寫)板塊是仇恨言論、陰謀論和極右翼極端主義的家園,也是4chan最活躍的版塊。結果呢?由此打造了一個發出仇恨言論的人工智慧。

據報道,YouTube知名深度學習部落客Yannic Kilcher用1.345億個充滿語言暴力的帖子,訓練出一個名為「GPT-4chan」的AI模型,其透過訓練學會瞭如何在網站上發表評論,並在一天不到的時間內發布了超過15,000個充滿負面言論內容的貼文。

儘管這看起來令人不安,但人工智慧的基礎可能會不經意地鼓勵這種做法,使人們可以輕鬆地將技術用於邪惡目的。隨著社群越來越接受開源開發,這一點非常明顯。這不再將人工智慧應用的開發限制在少數特權公司,而是對所有人開放,當然這裡面也包括不良行為者。

我們應該感到驚訝嗎?包括比爾蓋茲、伊隆馬斯克和傑夫貝佐斯等名人都表達了擔憂,並就人工智慧的潛在危險發出了警告,尤其是圍繞著人工智慧在武器系統中的使用和失業問題。

然而,我們今天所經歷的大部分事情都在某種程度上涉及人工智慧,例如社交媒體上專門針對我們的所謂個人化推薦廣告,以及我們最喜歡的串流平台根據我們先前的選擇和習慣向我們推薦新內容。如果我們真的想將人工智慧的潛力變為現實,那麼我們必須先解決一些問題。

越來越多的擔憂

人工智慧系統近年來呈指數級增長。它產生了許多好處,但它並沒有遠離某些引發擔憂的缺陷,特別是關於合規、道德和治理等主題的缺陷。

- 偏見-消除偏誤對於更準確地反映社會是必要的。這需要識別所有潛在的偏見領域並校準人工智慧解決方案以解決這些問題。如果沒有接受過各種資料集的訓練,一個存在偏見的人工智慧系統將提供偏差的見解和建議。

- 失去控制-隨著人工智慧的使用越來越多,機器變得更有能力做出重要的決定。然而,在任何可能以任何方式影響人類的決策過程中,仍然有必要讓人類參與。人工智慧仍然無法正確解釋情緒、將同理心應用於需要它的情況、透過道德判斷或獲得創造性結果。

- 技術不是萬無一失的——創新是一項持續不斷的工作,如果決策完全委託給幾乎沒有監督或校準的人工智慧系統,那麼總是存在潛在嚴重錯誤的風險。技術畢竟不完美。

- 隱私-隱私長期以來一直是與人工智慧相關的主要倫理問題。例如,你的智慧型裝置會不斷從其環境中獲取線索,例如語音,然後可以挖掘這些線索以獲得洞察力和建議。基於人工智慧的玩具也可以收集兒童數據,這是一個真正值得關注的問題。

- 信任的侵蝕——生物特徵等敏感資料的無限收集和儲存引發了有關信任的問題——負責人是否可以對我們的隱私資料做任何其他事情?

僅僅合規性是不夠的

解決這些問題需要我們超越單純的法律合規性。相反,必須考慮各種因素,例如隱私、人權和社會可接受性。這種類型的問題解決不應僅限於參與人工智慧開發和行銷的企業。必須在整個供應鏈中處理與人工智慧相關的問題——包括提供基於人工智慧的服務的個人和組織。

這些包括:

- 遵守歐盟人工智慧法案、美國人工智慧風險管理框架、中國網路資訊服務演算法推薦管理規定、新加坡人工智慧倫理與治理知識體係等全球相關法律法規。

- 制定原則以指導和承認尊重人權是與人工智慧使用相關的業務運營所有階段的最高優先事項。

- 透過利用科技面對未來人工智慧使用所產生的社會問題。

在解決人工智慧問題時,技術人員並不是唯一的利害關係人。政策制定者也將在幫助我們解決人工智慧應用的潛在風險方面發揮重要作用。他們將負責:

- 加強現有的人工智慧監管和治理框架。

- 倡導反覆試驗、重複測試和沙盒,以微調和校準 AI 模型和系統,以消除偏見風險。

- 制定針對人工智慧在各行業的各種應用量身定制的行業特定法規。

最後,還必須進行投資以確保生態系統仍然可行,並且有一個深厚而強大的人才庫來持續為人工智慧相關角色配備人員。顧問公司 Korn Ferry估計,到 2030 年,亞太地區的 TMT 產業可能面臨 200 萬人才短缺——包括 AI 專業人員,每年的機會成本將超過 1,516 億美元。

例如,新加坡已承諾投入 1.8 億美元來加速 AI 研究和啟動計劃以提高具有 AI 技能的人的技能。雖然這些可能涉及人工智慧工程和開發等「硬」技能,但「軟」技能也很重要。新加坡南洋理工大學和新加坡電腦學會也相繼開設人工智慧倫理和治理課程,旨在認可和認證這些領域的專業人士。

偉大的希望,但需要更多的進步

最終,需要就人工智慧能做什麼和不能做什麼進行深入和公開的討論。組織和政府都需要確保它將用於使盡可能多的人受益。需要採取措施確保人工智慧不會有意或無意地忽略社會的某些子集,緩解隱私和信任問題,並實施賦予人類一定程度控制權的保障措施。

人工智慧在日常生活中越來越多的使用無疑將繼續引發有關道德、合規和治理的問題。人類的人工智慧目標是雄心勃勃的還是只是危險的?這是一個所有相關利害關係人——政府、監管機構、創新者、科技公司和消費者——都需要共同努力回答的問題。

以上是道德和治理對人工智慧的重要性的詳細內容。更多資訊請關注PHP中文網其他相關文章!

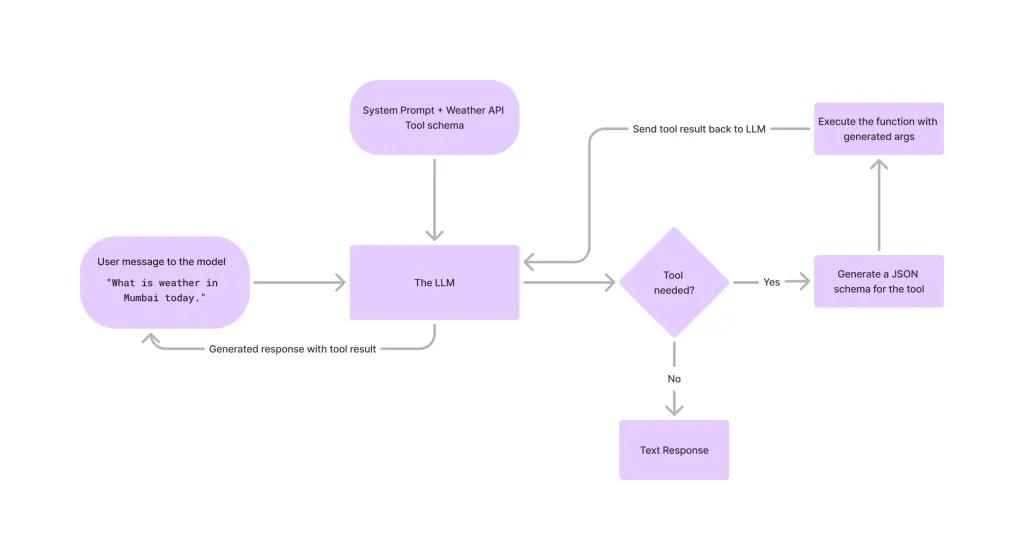

在LLMS中調用工具Apr 14, 2025 am 11:28 AM

在LLMS中調用工具Apr 14, 2025 am 11:28 AM大型語言模型(LLMS)的流行激增,工具稱呼功能極大地擴展了其功能,而不是簡單的文本生成。 現在,LLM可以處理複雜的自動化任務,例如Dynamic UI創建和自主a

多動症遊戲,健康工具和AI聊天機器人如何改變全球健康Apr 14, 2025 am 11:27 AM

多動症遊戲,健康工具和AI聊天機器人如何改變全球健康Apr 14, 2025 am 11:27 AM視頻遊戲可以緩解焦慮,建立焦點或支持多動症的孩子嗎? 隨著醫療保健在全球範圍內挑戰,尤其是在青年中的挑戰,創新者正在轉向一種不太可能的工具:視頻遊戲。現在是世界上最大的娛樂印度河之一

沒有關於AI的投入:獲勝者,失敗者和機遇Apr 14, 2025 am 11:25 AM

沒有關於AI的投入:獲勝者,失敗者和機遇Apr 14, 2025 am 11:25 AM“歷史表明,儘管技術進步推動了經濟增長,但它並不能自行確保公平的收入分配或促進包容性人類發展,”烏托德秘書長Rebeca Grynspan在序言中寫道。

通過生成AI學習談判技巧Apr 14, 2025 am 11:23 AM

通過生成AI學習談判技巧Apr 14, 2025 am 11:23 AM易於使用,使用生成的AI作為您的談判導師和陪練夥伴。 讓我們來談談。 對創新AI突破的這種分析是我正在進行的《福布斯》列的最新覆蓋範圍的一部分,包括識別和解釋

泰德(Ted)從Openai,Google,Meta透露出庭,與我自己自拍Apr 14, 2025 am 11:22 AM

泰德(Ted)從Openai,Google,Meta透露出庭,與我自己自拍Apr 14, 2025 am 11:22 AM在溫哥華舉行的TED2025會議昨天在4月11日舉行了第36版。它的特色是來自60多個國家 /地區的80個發言人,包括Sam Altman,Eric Schmidt和Palmer Luckey。泰德(Ted)的主題“人類重新構想”是量身定制的

約瑟夫·斯蒂格利茲(Joseph StiglitzApr 14, 2025 am 11:21 AM

約瑟夫·斯蒂格利茲(Joseph StiglitzApr 14, 2025 am 11:21 AM約瑟夫·斯蒂格利茨(Joseph Stiglitz)是2001年著名的經濟學家,是諾貝爾經濟獎的獲得者。斯蒂格利茨認為,AI可能會使現有的不平等和合併權力惡化,並在一些主導公司手中加劇,最終破壞了經濟上的經濟。

什麼是圖形數據庫?Apr 14, 2025 am 11:19 AM

什麼是圖形數據庫?Apr 14, 2025 am 11:19 AM圖數據庫:通過關係徹底改變數據管理 隨著數據的擴展及其特徵在各個字段中的發展,圖形數據庫正在作為管理互連數據的變革解決方案的出現。與傳統不同

LLM路由:策略,技術和Python實施Apr 14, 2025 am 11:14 AM

LLM路由:策略,技術和Python實施Apr 14, 2025 am 11:14 AM大型語言模型(LLM)路由:通過智能任務分配優化性能 LLM的快速發展的景觀呈現出各種各樣的模型,每個模型都具有獨特的優勢和劣勢。 有些在創意內容gen上表現出色

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

Atom編輯器mac版下載

最受歡迎的的開源編輯器

記事本++7.3.1

好用且免費的程式碼編輯器

ZendStudio 13.5.1 Mac

強大的PHP整合開發環境

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器

WebStorm Mac版

好用的JavaScript開發工具