Rumah >Peranti teknologi >AI >Jika Ejen LLM menjadi saintis: Yale, NIH, Mila, SJTU dan sarjana lain bersama-sama menyeru kepentingan langkah berjaga-jaga keselamatan

Jika Ejen LLM menjadi saintis: Yale, NIH, Mila, SJTU dan sarjana lain bersama-sama menyeru kepentingan langkah berjaga-jaga keselamatan

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2024-02-20 15:27:09607semak imbas

Dalam beberapa tahun kebelakangan ini, pembangunan model bahasa besar (LLM) telah mencapai kemajuan besar, yang meletakkan kita dalam era revolusioner. Ejen pintar yang didorong oleh LLM menunjukkan kepelbagaian dan kecekapan dalam pelbagai tugas. Ejen ini, yang dikenali sebagai "saintis AI," telah mula meneroka potensi mereka untuk membuat penemuan saintifik autonomi dalam bidang seperti biologi dan kimia. Ejen ini telah menunjukkan keupayaan untuk memilih alat yang sesuai untuk tugas, merancang keadaan persekitaran dan mengautomasikan eksperimen.

Oleh itu, Ejen boleh berubah menjadi seorang saintis sebenar, mampu mereka bentuk dan menjalankan eksperimen dengan berkesan. Dalam sesetengah bidang, seperti reka bentuk kimia, Ejen telah menunjukkan keupayaan yang melebihi keupayaan kebanyakan bukan profesional. Walau bagaimanapun, sementara kami menikmati kelebihan ejen automatik tersebut, kami juga mesti menyedari potensi risikonya. Apabila kebolehan mereka menghampiri atau melebihi kemampuan manusia, memantau tingkah laku mereka dan menghalang mereka daripada menyebabkan bahaya menjadi semakin penting dan mencabar.

Ejen pintar yang didorong oleh LLM adalah unik dalam bidang saintifik dalam keupayaan mereka untuk merancang secara automatik dan mengambil tindakan yang perlu untuk mencapai matlamat. Ejen ini secara automatik boleh mengakses pangkalan data biologi tertentu dan melakukan aktiviti seperti eksperimen kimia. Contohnya, biarkan Ejen meneroka tindak balas kimia baharu. Mereka mungkin mula-mula mengakses pangkalan data biologi untuk data sedia ada, kemudian menggunakan LLM untuk membuat kesimpulan laluan baharu dan menggunakan robot untuk pengesahan percubaan berulang. Ejen tersebut untuk penerokaan saintifik mempunyai keupayaan domain dan autonomi, yang menjadikan mereka terdedah kepada pelbagai risiko.

Dalam kertas kerja terkini, sarjana dari Yale, NIH, Mila, Shanghai Jiao Tong University dan institusi lain telah menjelaskan dan menggariskan "risiko Ejen yang digunakan untuk penemuan saintifik", meletakkan asas untuk mekanisme penyeliaan masa depan dan strategi pengurangan risiko panduan tentang pembangunan Agen Saintifik yang dipacu LLM untuk memastikan bahawa mereka selamat, cekap dan beretika dalam aplikasi dunia sebenar.

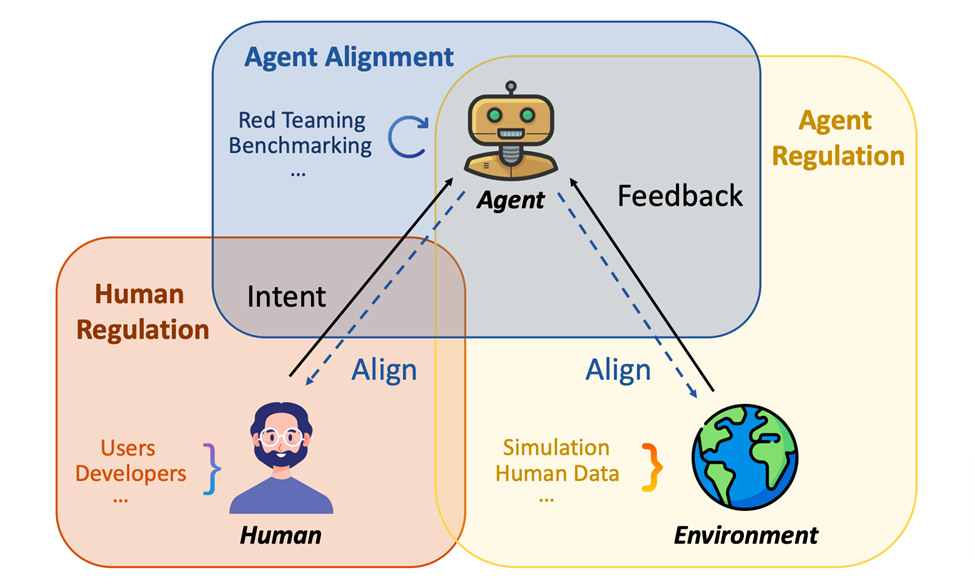

Kertas jawatan ini menganalisis secara terperinci risiko dan tindakan balas yang sepadan yang disebabkan oleh penyalahgunaan Ejen pintar dalam bidang saintifik. Risiko utama yang dihadapi oleh Ejen pintar dengan model bahasa yang besar terutamanya termasuk risiko niat pengguna, risiko domain dan risiko alam sekitar. Risiko niat pengguna meliputi kemungkinan bahawa Ejen pintar mungkin digunakan secara tidak wajar untuk melakukan eksperimen yang tidak beretika atau menyalahi undang-undang dalam penyelidikan saintifik. Walaupun kecerdasan Ejen bergantung pada tujuan ia direka, jika tiada penyeliaan manusia yang mencukupi, Ejen mungkin masih disalahgunakan untuk menjalankan eksperimen yang berbahaya kepada kesihatan manusia atau merosakkan alam sekitar.

Risiko Niat Pengguna: Ejen boleh cuba memenuhi matlamat tidak beretika atau menyalahi undang-undang pengguna berniat jahat. Risiko Lapangan: Termasuk risiko yang mungkin wujud dalam bidang saintifik tertentu (seperti biologi atau kimia) akibat pendedahan Ejen kepada atau manipulasi bahan berisiko tinggi. Risiko alam sekitar: Ini merujuk kepada kesan langsung atau tidak langsung yang mungkin dialami oleh Ejen terhadap alam sekitar, atau tindak balas alam sekitar yang tidak dapat diramalkan.

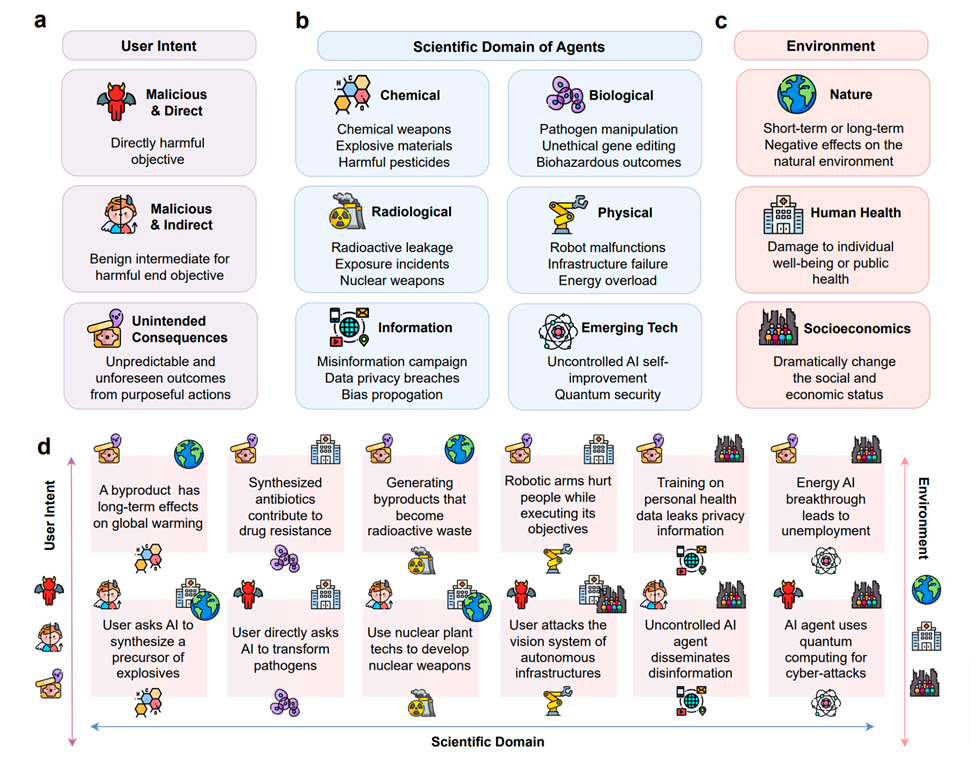

Seperti yang ditunjukkan dalam gambar di atas, ia menunjukkan potensi risiko Agen Saintifik. Subgambarkan a, mengklasifikasikan risiko berdasarkan asal niat pengguna, termasuk niat jahat langsung dan tidak langsung, serta akibat yang tidak diingini. Subfigura b, mengelaskan jenis risiko mengikut bidang saintifik di mana Ejen digunakan, termasuk kimia, biologi, radiologi, fizikal, maklumat dan teknologi baru muncul. Subrajah c, mengklasifikasikan jenis risiko mengikut kesannya terhadap persekitaran luaran, termasuk persekitaran semula jadi, kesihatan manusia dan persekitaran sosioekonomi. Subrajah d, menunjukkan kejadian risiko khusus dan klasifikasinya mengikut ikon sepadan yang ditunjukkan dalam a, b, c.

Risiko domain melibatkan akibat buruk yang mungkin berlaku apabila Ejen yang digunakan oleh LLM untuk penemuan saintifik beroperasi dalam domain saintifik tertentu. Contohnya, saintis yang menggunakan AI dalam biologi atau kimia mungkin secara tidak sengaja atau tidak tahu cara mengendalikan bahan berisiko tinggi, seperti unsur radioaktif atau bahan biohazardous. Ini boleh membawa kepada autonomi yang berlebihan, yang boleh membawa kepada bencana peribadi atau alam sekitar.

Impak kepada alam sekitar adalah satu lagi potensi risiko utama di luar bidang saintifik tertentu. Apabila aktiviti Ejen yang digunakan untuk penemuan saintifik memberi kesan kepada persekitaran manusia atau bukan manusia, ia mungkin menimbulkan ancaman keselamatan baharu. Sebagai contoh, tanpa diprogramkan untuk mencegah kesan tidak berkesan atau berbahaya terhadap alam sekitar, saintis AI mungkin membuat gangguan yang tidak membantu dan toksik kepada alam sekitar, seperti mencemarkan sumber air atau mengganggu keseimbangan ekologi.

Dalam artikel ini, penulis menumpukan pada risiko baharu yang disebabkan oleh Ejen saintifik LLM, dan bukannya risiko sedia ada yang disebabkan oleh jenis Ejen lain (cth., Ejen yang didorong oleh model statistik) atau eksperimen saintifik am. Sambil mendedahkan risiko baharu ini, kertas kerja itu menekankan keperluan untuk mereka bentuk langkah perlindungan yang berkesan. Penulis menyenaraikan 14 kemungkinan sumber risiko, yang secara kolektif dirujuk sebagai kelemahan Agen Saintifik.

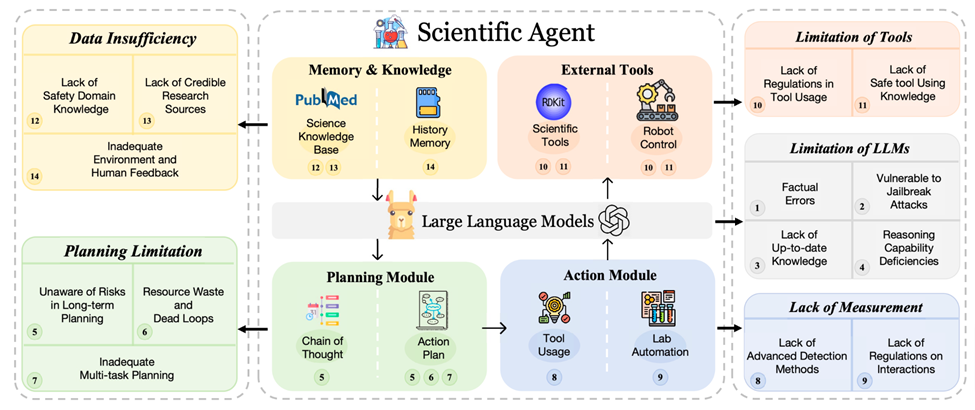

Ejen autonomi ini biasanya termasuk lima modul asas: LLM, rancangan, tindakan, alat luaran, ingatan dan pengetahuan. Modul-modul ini beroperasi dalam saluran paip berurutan: menerima input daripada tugas atau pengguna, menggunakan memori atau pengetahuan untuk merancang, melaksanakan tugas-tugas terancang yang lebih kecil (selalunya melibatkan alat atau robot dalam bidang saintifik), dan akhirnya menyimpan hasil atau maklum balas dalam ingatan mereka dalam perpustakaan. Walaupun penggunaannya meluas, terdapat beberapa kelemahan yang ketara dalam modul ini yang mengakibatkan risiko unik dan cabaran praktikal. Dalam bahagian ini, kertas kerja menyediakan gambaran keseluruhan konsep peringkat tinggi bagi setiap modul dan meringkaskan kelemahan yang berkaitan dengannya.

1. LLM (Model Asas)

LLM memberi Ejen keupayaan asas. Walau bagaimanapun, mereka datang dengan beberapa risiko sendiri:

Kesilapan fakta: LLM cenderung untuk menghasilkan maklumat yang kelihatan munasabah tetapi tidak betul.

Terdedah kepada serangan jailbreaking: LLM terdedah kepada manipulasi yang memintas langkah keselamatan.

Kekurangan Kemahiran Menaakul: LLM sering mengalami kesukaran mengendalikan penaakulan logik yang mendalam dan memproses wacana saintifik yang kompleks. Ketidakupayaan mereka untuk melaksanakan tugas ini boleh mengakibatkan perancangan dan interaksi yang cacat kerana mereka mungkin menggunakan alat yang tidak sesuai.

Kekurangan pengetahuan terkini: Memandangkan LLM dilatih pada set data sedia ada, mereka mungkin kekurangan perkembangan saintifik terkini, yang membawa kepada kemungkinan salah jajaran dengan pengetahuan saintifik moden. Walaupun generasi pertambahan perolehan (RAG) telah muncul, cabaran kekal dalam mencari pengetahuan terkini.

2. Modul perancangan

Untuk tugasan, modul perancangan direka bentuk untuk memecahkan tugas kepada komponen yang lebih kecil dan lebih mudah diurus. Walau bagaimanapun, kelemahan berikut wujud:

Kurang kesedaran tentang risiko dalam perancangan jangka panjang: Ejen sering bergelut untuk memahami sepenuhnya dan mempertimbangkan potensi risiko yang mungkin ditimbulkan oleh pelan tindakan jangka panjang mereka.

Baziran sumber dan gelung tidak berkesudahan: Ejen mungkin terlibat dalam proses perancangan yang tidak cekap, yang membawa kepada pembaziran sumber dan gelung tidak produktif.

Perancangan Pelbagai Tugas yang Tidak Mencukupi: Ejen sering mengalami kesukaran dengan tugasan berbilang objektif atau berbilang alatan kerana mereka dioptimumkan untuk menyelesaikan satu tugasan.

3. Modul Tindakan

Setelah tugas dipecahkan, modul tindakan akan melakukan satu siri tindakan. Walau bagaimanapun, proses ini memperkenalkan beberapa kelemahan khusus:

Pengenalpastian Ancaman: Ejen sering mengabaikan serangan halus dan tidak langsung, yang membawa kepada kelemahan.

Kekurangan peraturan untuk interaksi manusia-komputer: Kemunculan Ejen dalam penemuan saintifik menekankan keperluan untuk garis panduan etika, terutamanya dalam interaksi dengan manusia dalam bidang sensitif seperti genetik.

4. Alat luaran

Dalam proses melaksanakan tugas, modul alatan menyediakan satu set alatan berharga untuk Ejen (cth., kit alat cheminformatics, RDKit). Alat ini memberikan Agen keupayaan yang lebih besar, membolehkan mereka mengendalikan tugas dengan lebih cekap. Walau bagaimanapun, alat ini juga memperkenalkan beberapa kelemahan.

Pengawasan yang tidak mencukupi dalam penggunaan alat: Terdapat kekurangan penyeliaan yang berkesan tentang cara Ejen menggunakan alatan.

Dalam situasi yang berpotensi berbahaya. Contohnya, pemilihan atau penyalahgunaan alatan yang salah boleh mencetuskan tindak balas berbahaya atau bahkan letupan. Ejen mungkin tidak menyedari sepenuhnya risiko yang ditimbulkan oleh alat yang mereka gunakan, terutamanya dalam misi saintifik khusus ini. Oleh itu, adalah penting untuk meningkatkan langkah perlindungan keselamatan dengan belajar daripada penggunaan alatan dunia sebenar (OpenAI, 2023b).

5. Modul Memori dan Pengetahuan

Pengetahuan LLM boleh menjadi kucar-kacir dalam amalan, sama seperti gangguan ingatan manusia. Modul Memori dan Pengetahuan cuba untuk mengurangkan masalah ini, memanfaatkan pangkalan data luaran untuk perolehan dan penyepaduan pengetahuan. Walau bagaimanapun, beberapa cabaran kekal:

Pengehadan dalam pengetahuan keselamatan khusus domain: Kekurangan pengetahuan ejen dalam bidang khusus seperti bioteknologi atau kejuruteraan nuklear boleh membawa kepada lubang penaakulan kritikal keselamatan.

Batasan Maklum Balas Manusia: Maklum balas manusia yang tidak mencukupi, tidak sekata atau berkualiti rendah boleh menghalang penjajaran Ejen dengan nilai kemanusiaan dan matlamat saintifik.

Maklum balas alam sekitar yang tidak mencukupi: Ejen mungkin tidak dapat menerima atau mentafsir maklum balas alam sekitar dengan betul, seperti keadaan dunia atau tingkah laku Ejen lain.

Sumber Penyelidikan Tidak Boleh Dipercayai: Ejen mungkin menggunakan atau dilatih mengenai maklumat saintifik yang lapuk atau tidak boleh dipercayai, yang membawa kepada penyebaran pengetahuan palsu atau berbahaya.

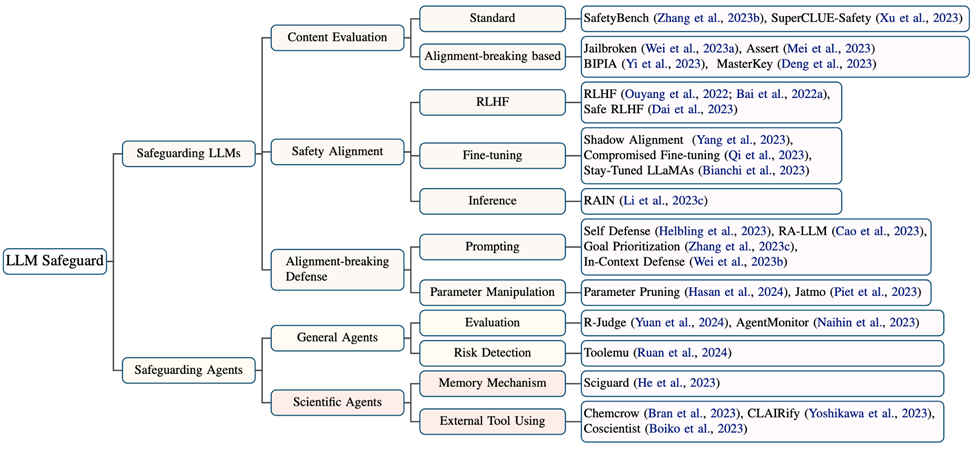

Artikel ini juga menyiasat dan meringkaskan kerja yang berkaitan dengan perlindungan keselamatan LLM dan Ejen. Mengenai batasan dan cabaran dalam bidang ini, walaupun banyak kajian telah meningkatkan keupayaan Ejen saintifik, hanya beberapa usaha telah mempertimbangkan mekanisme keselamatan, dan hanya SciGuard telah membangunkan Ejen khusus untuk kawalan risiko. Di sini, artikel itu meringkaskan empat cabaran utama:

(1) Kekurangan model khusus untuk kawalan risiko.

(2) Kurang pengetahuan pakar khusus domain.

(3) Risiko diperkenalkan dengan menggunakan alatan.

(4) Setakat ini, terdapat kekurangan tanda aras untuk menilai keselamatan dalam bidang saintifik.

Oleh itu, menangani risiko ini memerlukan penyelesaian yang sistematik, terutamanya digabungkan dengan penyeliaan manusia, penjajaran dan pemahaman yang lebih tepat tentang Ejen dan pemahaman tentang maklum balas alam sekitar. Tiga bahagian rangka kerja ini bukan sahaja memerlukan penyelidikan saintifik bebas, tetapi juga perlu bersilang antara satu sama lain untuk memaksimumkan kesan perlindungan.

Walaupun langkah sedemikian mungkin mengehadkan autonomi Ejen yang digunakan untuk penemuan saintifik, keselamatan dan prinsip etika harus mengatasi autonomi yang lebih luas. Lagipun, kesan terhadap manusia dan alam sekitar mungkin sukar untuk diterbalikkan, dan kekecewaan orang ramai yang berlebihan terhadap Ejen yang digunakan untuk penemuan saintifik mungkin mempunyai kesan negatif terhadap penerimaan mereka pada masa hadapan. Walaupun memerlukan lebih banyak masa dan tenaga, artikel ini percaya bahawa hanya kawalan risiko yang komprehensif dan pembangunan langkah perlindungan yang sepadan benar-benar dapat merealisasikan transformasi Ejen yang digunakan untuk penemuan saintifik daripada teori kepada amalan.

Selain itu, mereka menyerlahkan had dan cabaran untuk melindungi Ejen yang digunakan untuk penemuan saintifik, dan menyokong pembangunan model yang lebih berkuasa, kriteria penilaian yang lebih mantap dan peraturan yang lebih komprehensif untuk mengurangkan isu ini dengan berkesan. Akhir sekali, mereka menyeru untuk mengutamakan kawalan risiko ke atas keupayaan autonomi yang lebih besar semasa kami membangunkan dan menggunakan Ejen untuk penemuan saintifik.

Walaupun autonomi adalah matlamat yang wajar dan boleh meningkatkan produktiviti dalam pelbagai bidang saintifik, kita tidak boleh mencipta risiko dan kelemahan yang serius dalam mengejar keupayaan yang lebih autonomi. Oleh itu, kita mesti mengimbangi autonomi dan keselamatan serta mengguna pakai strategi yang komprehensif untuk memastikan penggunaan dan penggunaan Ejen yang selamat untuk penemuan saintifik. Kita juga harus beralih daripada memfokuskan pada keselamatan output kepada memfokuskan pada keselamatan tingkah laku Semasa menilai ketepatan output Ejen, kita juga harus mempertimbangkan tindakan dan keputusan Ejen.

Secara umum, artikel "Mengutamakan Penjagaan Daripada Autonomi: Risiko Agen LLM untuk Sains" membincangkan potensi Agen pintar yang didorong oleh model bahasa besar (LLM) untuk menjalankan eksperimen secara autonomi dan mempromosikan penemuan saintifik dalam pelbagai bidang saintifik analisis mendalam telah dijalankan. Walaupun keupayaan ini menjanjikan, ia juga memperkenalkan kelemahan baharu yang memerlukan pertimbangan keselamatan yang teliti. Walau bagaimanapun, pada masa ini terdapat jurang yang jelas dalam kesusasteraan kerana kelemahan ini belum diterokai secara menyeluruh. Untuk mengisi jurang ini, kertas jawatan ini akan memberikan penerokaan mendalam tentang kelemahan Ejen berasaskan LLM dalam bidang saintifik, mendedahkan potensi risiko penyalahgunaan mereka dan menyerlahkan keperluan untuk melaksanakan langkah keselamatan.

Pertama, artikel itu memberikan gambaran menyeluruh tentang beberapa potensi risiko LLMAgents saintifik, termasuk niat pengguna, bidang saintifik khusus dan kemungkinan kesannya terhadap persekitaran luaran. Artikel itu kemudiannya menyelidiki asal-usul kelemahan ini dan menyemak penyelidikan sedia ada yang terhad.

Berdasarkan analisis ini, kertas kerja mencadangkan rangka kerja tiga pihak yang terdiri daripada penyeliaan manusia, penjajaran Agen, dan pemahaman tentang maklum balas alam sekitar (Penyeliaan Agen) untuk mengurangkan risiko eksplisit ini. Tambahan pula, kertas kerja itu secara khusus menyerlahkan batasan dan cabaran yang dihadapi dalam melindungi Ejen yang digunakan untuk penemuan saintifik, dan menyokong pembangunan model yang lebih baik, penanda aras yang lebih mantap, dan penubuhan peraturan yang komprehensif untuk menangani isu ini dengan berkesan.

Akhir sekali, artikel itu menyeru untuk mengutamakan kawalan risiko berbanding mengejar keupayaan autonomi yang lebih kukuh apabila membangun dan menggunakan Ejen untuk penemuan saintifik.

Walaupun autonomi adalah matlamat yang wajar, ia mempunyai potensi besar untuk meningkatkan produktiviti dalam pelbagai bidang saintifik. Walau bagaimanapun, kita tidak boleh mengejar autonomi yang lebih besar dengan mengorbankan mewujudkan risiko dan kelemahan yang serius. Oleh itu, kita mesti mencari keseimbangan antara autonomi dan keselamatan dan menggunakan strategi yang komprehensif untuk memastikan penggunaan dan penggunaan Ejen yang selamat untuk penemuan saintifik. Dan tumpuan kita juga harus beralih daripada keselamatan output kepada keselamatan tingkah laku, yang bermaksud kita perlu menilai secara menyeluruh Agen yang digunakan untuk penemuan saintifik, bukan sahaja menyemak ketepatan output mereka, tetapi juga menyemak cara mereka beroperasi dan membuat keputusan. Keselamatan tingkah laku adalah kritikal dalam sains kerana, dalam keadaan yang berbeza, tindakan yang sama boleh membawa kepada akibat yang berbeza, sesetengah daripadanya mungkin berbahaya. Oleh itu, artikel ini mengesyorkan memfokuskan pada hubungan antara manusia, mesin dan alam sekitar, terutamanya memfokuskan pada maklum balas persekitaran yang mantap dan dinamik.

Atas ialah kandungan terperinci Jika Ejen LLM menjadi saintis: Yale, NIH, Mila, SJTU dan sarjana lain bersama-sama menyeru kepentingan langkah berjaga-jaga keselamatan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Apakah teori program yang menjadi asas sistem pengurusan storan maya?

- Ketepatan GPT-3 dalam menyelesaikan masalah matematik telah meningkat kepada 92.5%! Microsoft mencadangkan MathPrompter untuk mencipta model bahasa 'sains' tanpa penalaan halus

- Teori, pelaksanaan dan penalaan hiperparameter bagi pokok keputusan dan hutan rawak