Rumah >Peranti teknologi >AI >UC Berkeley Google memperbaharui LLM, melaksanakan model penyebaran terminal dan menggunakannya untuk IGN menjana imej realistik dalam satu langkah dan siri TV Amerika menjadi sumber inspirasi

UC Berkeley Google memperbaharui LLM, melaksanakan model penyebaran terminal dan menggunakannya untuk IGN menjana imej realistik dalam satu langkah dan siri TV Amerika menjadi sumber inspirasi

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2023-11-14 08:30:091294semak imbas

Model penyebaran yang menjadi popular di separuh dunia akan dihapuskan?

Pada masa ini, model AI generatif, seperti GAN, model resapan atau model ketekalan, menjana imej dengan memetakan input kepada output yang sepadan dengan pengedaran data sasaran Kandungan yang perlu ditulis semula ialah:

Biasanya, ini. jenis model perlu belajar banyak gambar sebenar, dan kemudian ia boleh cuba memastikan ciri-ciri sebenar gambar yang dihasilkan Kandungan yang perlu ditulis semula ialah:

Baru-baru ini, penyelidik dari UC Berkeley dan Google mencadangkan satu. model generasi baharu—— Kandungan yang perlu ditulis semula untuk Idempotent Generating Network (IGN) ialah:

Pictures

Pictures

Alamat kertas: https://arxiv.org/abs/2311.014

IGN boleh dipilih daripada pelbagai Input, seperti hingar rawak, grafik ringkas, dsb., menjana imej realistik dalam satu langkah tanpa memerlukan lelaran berbilang langkah Kandungan yang perlu ditulis semula ialah:

. Model ini bertujuan untuk menjadi projektor "pemeta global" (pemeta global), yang boleh memetakan sebarang data input kepada pengedaran data sasaran Kandungan yang perlu ditulis semula ialah:

Ringkasnya, model penjanaan imej umum. mesti jadi begini di masa hadapan. Kandungan yang perlu ditulis semula ialah:

Menarik Ya, adegan yang cekap dalam "Seinfeld" ternyata menjadi sumber inspirasi kepada penulis ialah:

Gambar

Gambar

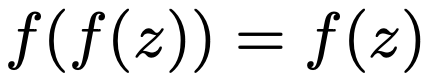

Adegan ini merumuskan "pengendali idempoten" dengan baik ) Konsep ini bermakna semasa proses operasi, input yang sama dikendalikan berulang kali, dan hasilnya sentiasa sama yang perlu ditulis semula ialah:

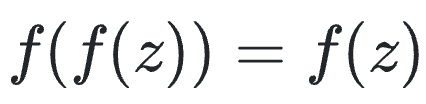

Iaitu,

gambar

gambar

perlu ditulis semula Kandungan yang ditulis semula ialah:

gambar

perlu ditulis semula Kandungan yang ditulis semula ialah:

Sesetengahnya tingkah laku jenaka juga boleh dianggap sebagai Jerry dalam keadaan berjenaka. idempotent Kandungan yang ditulis semula ialah:Rangkaian Generatif Impoten

IGN dengan Terdapat dua perbezaan penting antara GAN dan model penyebaran:

- Tidak seperti GAN, IGN tidak memerlukan penjana dan diskriminator yang berasingan -confrontation" model yang melengkapkan keperluan penjanaan dan diskriminasi pada masa yang sama. Apa yang perlu ditulis semula ialah:

- Tidak seperti model resapan yang melakukan langkah tambahan, IGN cuba memetakan input kepada pengagihan data dalam satu langkah Apa yang perlu untuk ditulis semula ialah:  IGN (model generatif idempoten ) Apakah sumbernya?

IGN (model generatif idempoten ) Apakah sumbernya?

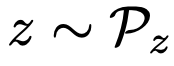

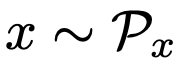

Memandangkan pengedaran sasaran  sampel input, perkara yang perlu ditulis semula untuk menjana sampel ialah:

sampel input, perkara yang perlu ditulis semula untuk menjana sampel ialah:  contoh set data

contoh set data

, setiap contoh Kedua-duanya diambil daripada

, setiap contoh Kedua-duanya diambil daripada  Kandungan yang perlu ditulis semula ialah: Kemudian, penyelidik melatih model

Kandungan yang perlu ditulis semula ialah: Kemudian, penyelidik melatih model

Andaikan bahawa pengedaran  dan

dan  terletak dalam ruang yang sama, iaitu kejadian mereka mempunyai dimensi yang sama: Perkara yang perlu ditulis semula ialah: Ini membolehkan untuk menggunakan

terletak dalam ruang yang sama, iaitu kejadian mereka mempunyai dimensi yang sama: Perkara yang perlu ditulis semula ialah: Ini membolehkan untuk menggunakan  kepada kedua-dua jenis kejadian

kepada kedua-dua jenis kejadian  . dan

. dan  Kandungan yang perlu ditulis semula ialah:

Kandungan yang perlu ditulis semula ialah:

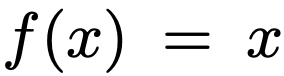

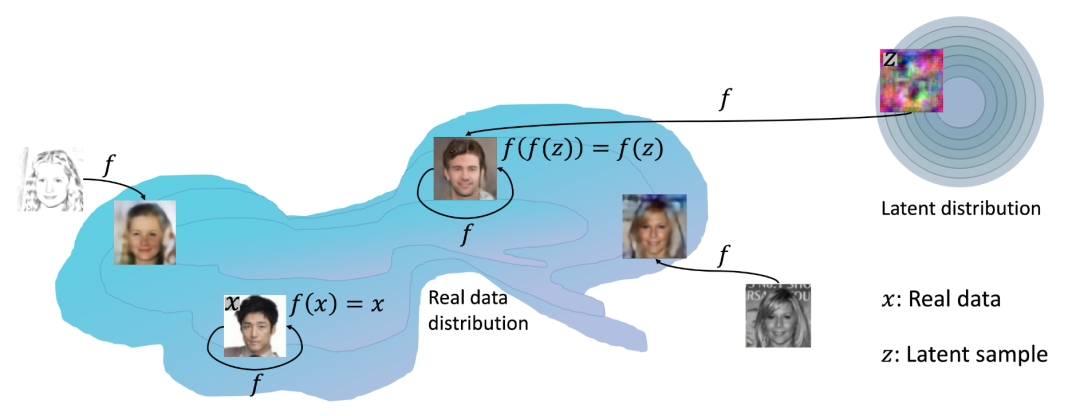

Gambar menunjukkan idea asas di sebalik IGN: contoh sebenar (x) tidak berubah kepada model f  Kandungan yang perlu ditulis semula ialah: input lain (z) dipetakan Kandungan yang perlu ditulis semula untuk memetakan f ke aliran contoh sendiri melalui pengoptimuman

Kandungan yang perlu ditulis semula ialah: input lain (z) dipetakan Kandungan yang perlu ditulis semula untuk memetakan f ke aliran contoh sendiri melalui pengoptimuman  ialah:

ialah:

Gambar

Gambar

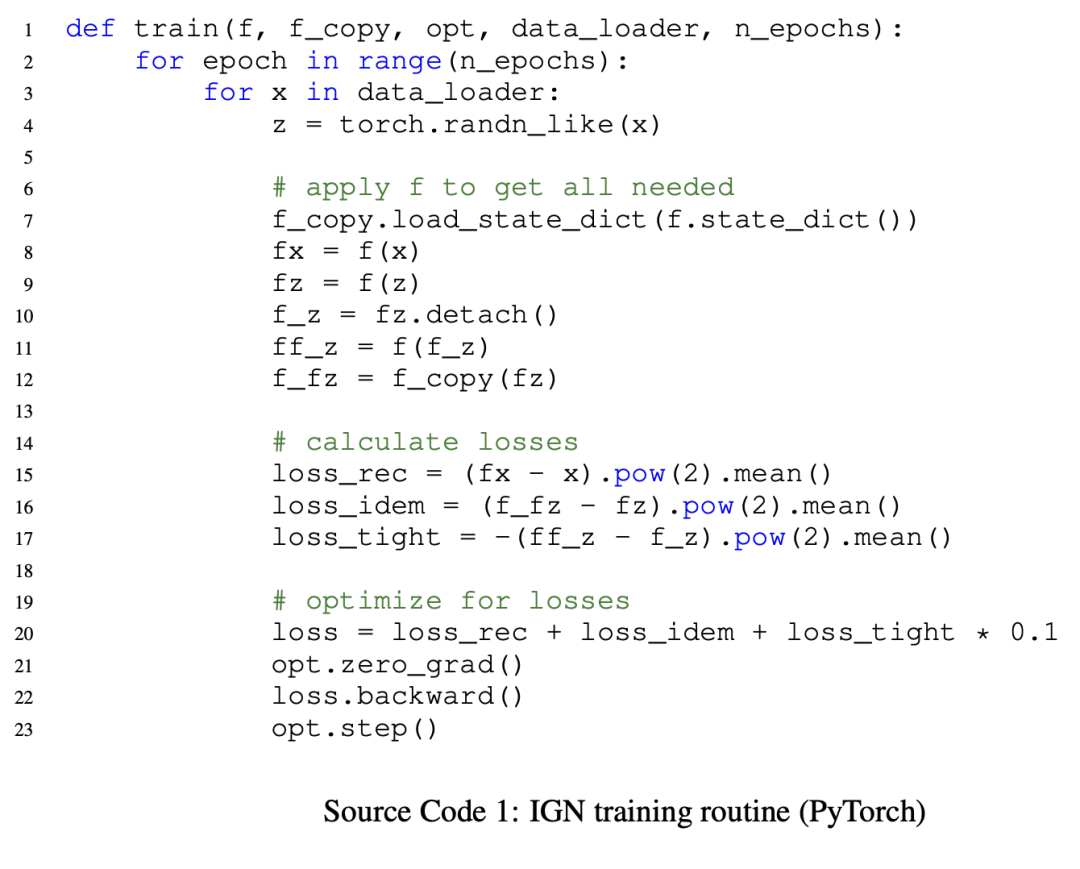

Sebahagian daripada contoh latihan PyTorch Kod yang perlu ditulis semula ialah:

Gambar

Gambar

Apakah kesan selepas mendapat IGN? . data telah digunakan Set, dan dalam penerokaan, kami memberi tumpuan terutamanya pada kaedah ringkas yang perlu ditulis semula:

Sudah tentu, teknologi pemodelan generatif asas, seperti model GAN dan penyebaran, juga mengambil masa yang lama untuk mencapai kematangan dan skala. Perkara yang perlu ditulis semula untuk prestasi ialah:

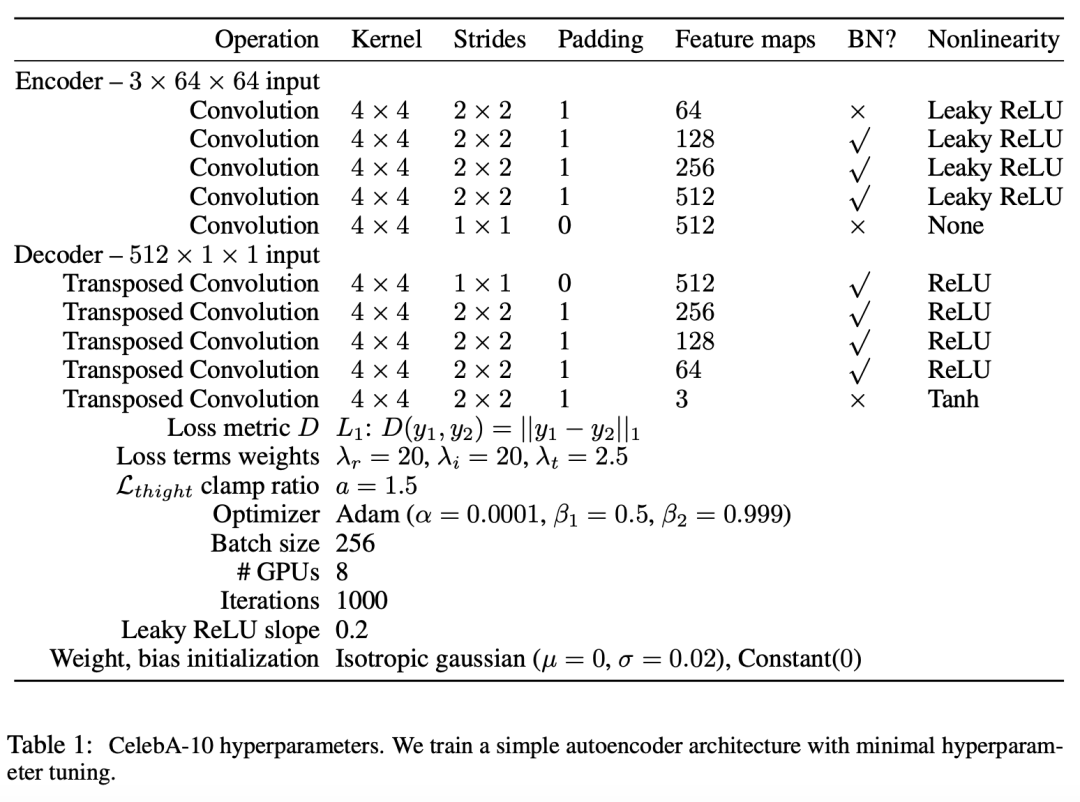

Persediaan eksperimen

Para penyelidik menilai IGN pada MNIST (set data digit tulisan tangan skala kelabu) dan CelebA (set data imej muka), masing-masing menggunakan 28×28 dan 64 Kandungan yang perlu ditulis semula untuk resolusi imej ×64 ialah:

Pengarang menggunakan seni bina autoenkoder yang mudah, di mana pengekod adalah tulang belakang diskriminator lima lapisan ringkas dari DCGAN, dan penyahkod ialah penjana yang perlu ditulis semula. Kandungannya ialah: Latihan dan hiperparameter rangkaian ditunjukkan dalam Jadual 1. Kandungan yang perlu ditulis semula ialah:

Gambar

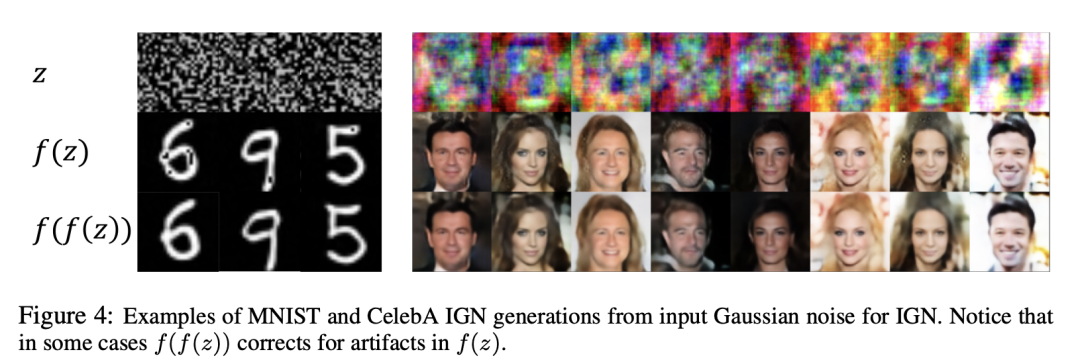

Hasil penjanaan

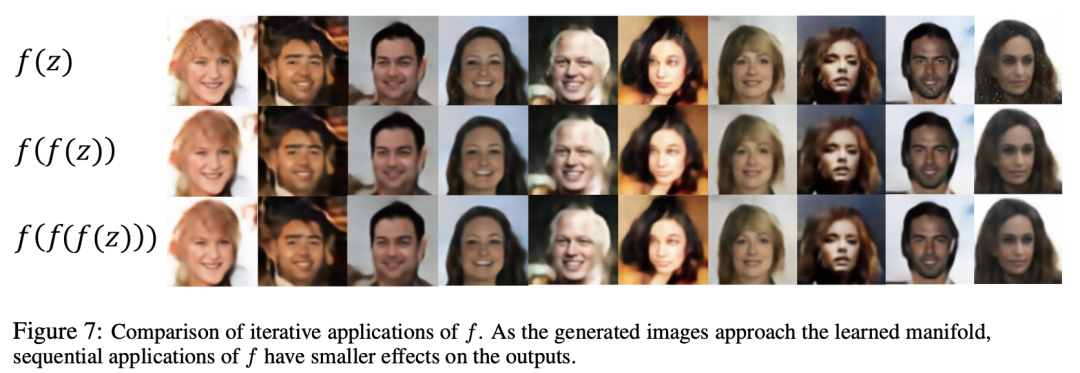

model sekali dan dua kali berturut-turut Hasil kualitatif untuk kedua-dua set data perlu ditulis semula sebagai:

Seperti yang ditunjukkan, menggunakan IGN sekali (f (z)) menghasilkan hasil penjanaan koheren yang perlu ditulis semula ialah: Walau bagaimanapun, artifak mungkin berlaku Bayang-bayang, seperti lubang dalam digit MNIST, atau piksel herot di bahagian atas kepala dan rambut dalam imej muka perlu ditulis semula:

Menggunakan f (f (f (z))) sekali lagi boleh membetulkan masalah ini , mengisi lubang, atau untuk mengurangkan jumlah variasi di sekitar tompok hingar muka Apa yang perlu ditulis semula ialah:

Gambar

Rajah 7 menunjukkan hasil tambahan serta keputusan permohonan f tiga kali Apa yang perlu ditulis semula ialah:

Rajah 7 menunjukkan hasil tambahan serta keputusan permohonan f tiga kali Apa yang perlu ditulis semula ialah:

Picture

Picture

Bandingkan  #🎜 dan #🎜🎜🎜##🎜 # menunjukkan bahawa apabila imej hampir dengan manifold yang dipelajari, penggunaan f sekali lagi menghasilkan perubahan yang minimum kerana imej itu dianggap diedarkan ialah:

#🎜 dan #🎜🎜🎜##🎜 # menunjukkan bahawa apabila imej hampir dengan manifold yang dipelajari, penggunaan f sekali lagi menghasilkan perubahan yang minimum kerana imej itu dianggap diedarkan ialah:  .

.

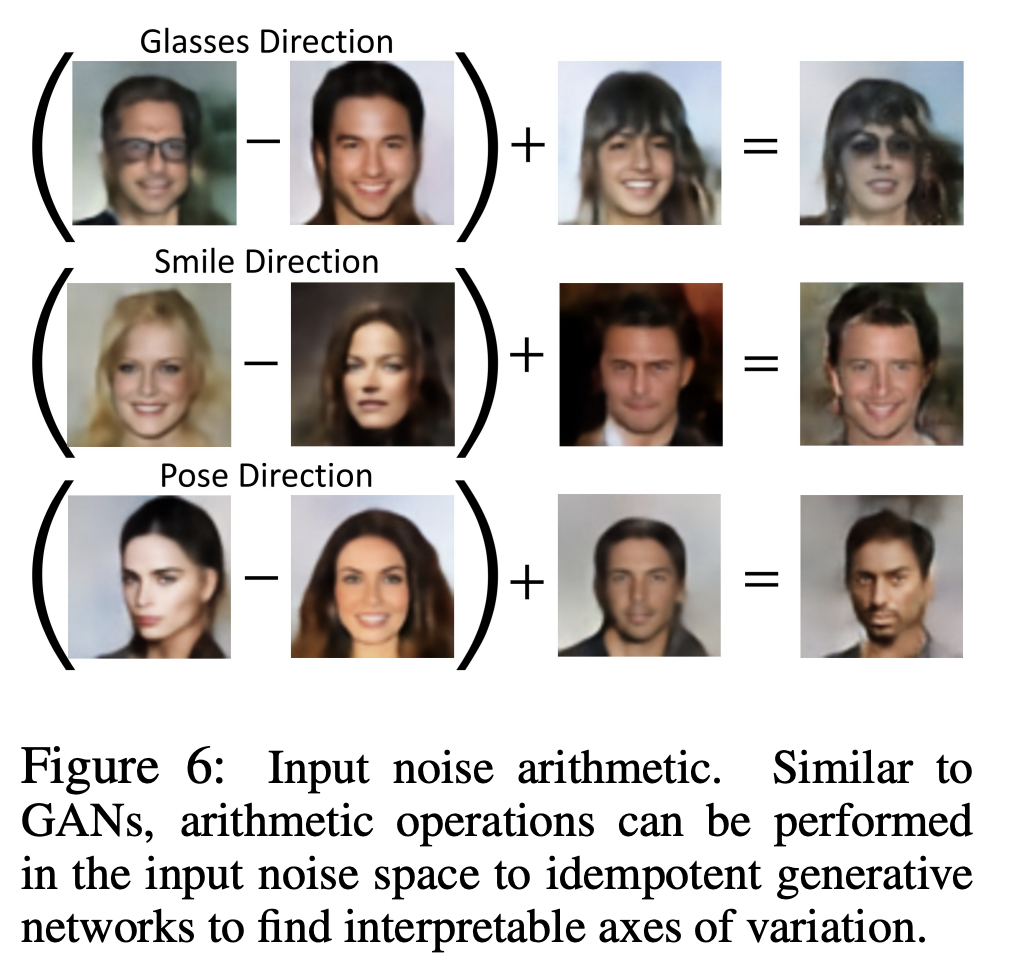

Pengarang menunjukkan bahawa IGN mempunyai ruang terpendam yang konsisten dengan melakukan operasi, sama seperti yang ditunjukkan untuk GAN, Rajah 6 menunjukkan perkara yang perlu ditulis semula untuk algoritma ruang terpendam: #Pemetaan luar pengedaran

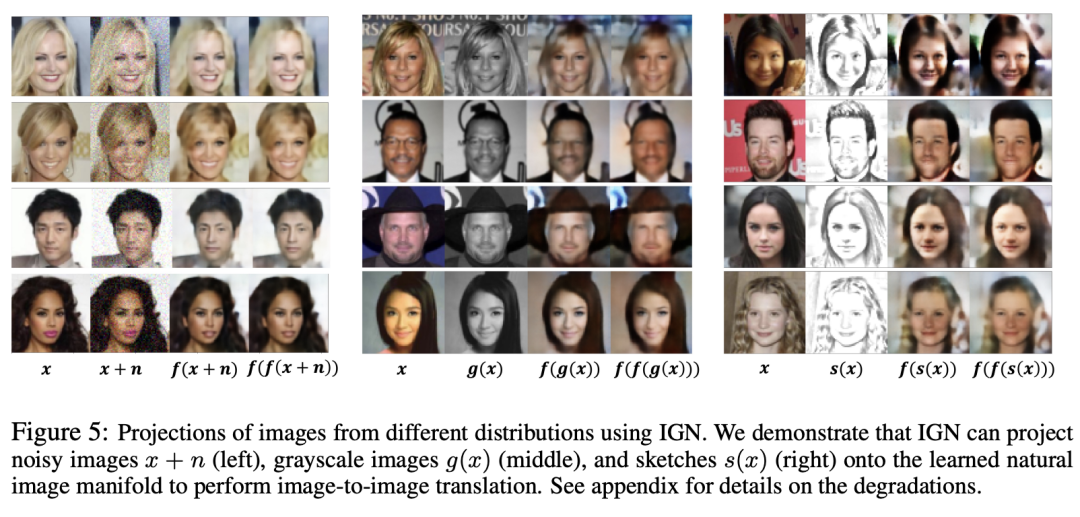

Pengarang juga mengesahkan bahawa dengan memasukkan imej daripada pelbagai pengedaran ke dalam model untuk menjana " "Imej semula jadi" yang setara dengannya, untuk mengesahkan potensi "pemetaan global" IGN, kandungan yang perlu ditulis semula ialah: # 🎜🎜#

Pengarang juga mengesahkan bahawa dengan memasukkan imej daripada pelbagai pengedaran ke dalam model untuk menjana " "Imej semula jadi" yang setara dengannya, untuk mengesahkan potensi "pemetaan global" IGN, kandungan yang perlu ditulis semula ialah: # 🎜🎜#

telah diwarnakan, serta lakaran #🎜🎜 🎜# telah ditukar kepada imej sebenar dalam Rajah 5 untuk membuktikan perkara ini ialah:

Imej asal Kandungannya ialah:

#🎜. 🎜#Seperti yang ditunjukkan, mengaplikasi f secara berterusan boleh meningkatkan kualiti imej (contohnya, ia menghilangkan artifak gelap dan asap dalam lakaran yang ditayangkan) dan perlu ditulis semula Kandungannya ialah:  #🎜🎜 #Picture

#🎜🎜 #Picture Google Next?

Google Next?

Dapat dilihat daripada keputusan di atas bahawa IGN lebih berkesan dalam inferens dan boleh menjana hasil hanya dalam satu langkah selepas latihan Kandungan yang perlu ditulis semula ialah: #🎜🎜 ##🎜 🎜#

Mereka juga boleh mengeluarkan hasil yang lebih konsisten, yang mungkin diperluaskan kepada lebih banyak aplikasi, seperti pembaikan imej perubatan Kandungan yang perlu ditulis semula ialah:#🎜 🎜##🎜 🎜#Pengarang kertas kerja menyatakan:

Kami percaya karya ini adalah langkah pertama ke arah model yang belajar untuk mengambil input sewenang-wenangnya Pemetaan kepada pengedaran sasaran, yang merupakan paradigma baharu pemodelan generatif, perkara yang perlu ditulis semula ialah: data untuk menskalakan IGN dengan harapan dapat memanfaatkan potensi penuh model AI generatif baharu Apa yang perlu ditulis semula ialah: Kandungan yang perlu ditulis semula ialah:

Kami percaya karya ini adalah langkah pertama ke arah model yang belajar untuk mengambil input sewenang-wenangnya Pemetaan kepada pengedaran sasaran, yang merupakan paradigma baharu pemodelan generatif, perkara yang perlu ditulis semula ialah: data untuk menskalakan IGN dengan harapan dapat memanfaatkan potensi penuh model AI generatif baharu Apa yang perlu ditulis semula ialah: Kandungan yang perlu ditulis semula ialah:

#🎜: /🎜 /www.php.cn/link/2bd388f731f26312bfc0fe30da009595

cs/f6dd 04457a6565a6#🎜 🎜#

Atas ialah kandungan terperinci UC Berkeley Google memperbaharui LLM, melaksanakan model penyebaran terminal dan menggunakannya untuk IGN menjana imej realistik dalam satu langkah dan siri TV Amerika menjadi sumber inspirasi. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!