Rumah >Peranti teknologi >AI >Tafsiran pelbagai contoh kod model pembelajaran mesin: Penjelasan dengan LIME

Tafsiran pelbagai contoh kod model pembelajaran mesin: Penjelasan dengan LIME

- PHPzke hadapan

- 2023-11-06 11:13:011171semak imbas

Model pembelajaran mesin menjadi semakin canggih dan tepat, tetapi kelegapannya kekal sebagai cabaran yang ketara. Memahami sebab model membuat ramalan khusus adalah penting untuk membina kepercayaan dan memastikan model itu berkelakuan seperti yang diharapkan. Dalam artikel ini, kami akan memperkenalkan LIME dan menggunakannya untuk menerangkan pelbagai model biasa.

LIME

Perpustakaan Python LIME (Penjelasan Model-agnostik yang Boleh Ditafsirkan Tempatan) boleh membantu menerangkan gelagat pengelas (atau model) pembelajaran mesin. Tujuan utama LIME adalah untuk menyediakan penjelasan yang boleh ditafsir dan boleh dibaca manusia untuk ramalan individu, terutamanya untuk model pembelajaran mesin yang kompleks. Dengan memberikan pemahaman terperinci tentang cara model ini beroperasi, LIME menggalakkan kepercayaan dalam sistem pembelajaran mesin

Apabila model pembelajaran mesin menjadi lebih kompleks, memahami kerja dalaman mereka mungkin menjadi Mencabar yang berharga. LIME menyelesaikan masalah ini dengan mencipta penjelasan tempatan untuk keadaan tertentu, memudahkan pengguna memahami dan mempercayai model pembelajaran mesin

Ciri Utama LIME:

- Cipta penjelasan mudah dan boleh ditafsir untuk memahami ramalan model ML yang kompleks.

- Periksa ramalan individu untuk mengenal pasti bias dan ralat yang berpotensi dalam model.

- Tingkatkan prestasi model dengan memahami ciri yang menyumbang kepada ramalan yang tepat.

- Memberikan ketelusan dan kebolehjelasan untuk meningkatkan kepercayaan pengguna dalam sistem pembelajaran mesin.

LIME beroperasi dengan menganggarkan model ML kompleks dengan model yang lebih ringkas dan boleh ditafsirkan secara tempatan yang dibina di sekeliling contoh tertentu. Langkah-langkah utama aliran kerja LIME boleh dibahagikan kepada langkah-langkah berikut:

- Pilih tika untuk diterangkan.

- Perturb kejadian dengan menjana satu set sampel bersebelahan.

- Gunakan model ML yang kompleks untuk mendapatkan ramalan bagi sampel yang terganggu.

- Sesuaikan model yang lebih ringkas dan boleh ditafsir (cth. regresi linear atau pepohon keputusan) pada sampel yang terganggu dan ramalannya.

- Terangkan model yang lebih ringkas yang memberikan penjelasan untuk contoh asal.

Menggunakan LIME dalam model yang berbeza

Sebelum anda mula menggunakan LIME, anda perlu memasangnya. LIME boleh dipasang dengan menggunakan arahan pip:

pip install lime

1. Model Klasifikasi

Untuk menggunakan LIME dengan model klasifikasi, anda perlu mencipta objek penterjemah dan kemudian menjana penjelasan untuk contoh tertentu. Berikut ialah contoh mudah menggunakan perpustakaan LIME dan model klasifikasi:

# Classification- Lime import lime import lime.lime_tabular from sklearn import datasets from sklearn.ensemble import RandomForestClassifier # Load the dataset and train a classifier data = datasets.load_iris() classifier = RandomForestClassifier() classifier.fit(data.data, data.target) # Create a LIME explainer object explainer = lime.lime_tabular.LimeTabularExplainer(data.data, mode="classification", training_labels=data.target, feature_names=data.feature_names, class_names=data.target_names, discretize_cnotallow=True) # Select an instance to be explained (you can choose any index) instance = data.data[0] # Generate an explanation for the instance explanation = explainer.explain_instance(instance, classifier.predict_proba, num_features=5) # Display the explanation explanation.show_in_notebook()

2. Model Regresi

Apabila menggunakan LIME untuk menerangkan model regresi, ia adalah serupa dengan menggunakan LIME untuk menerangkan model klasifikasi. . Objek penterjemah perlu dibuat dan tafsiran dijana untuk contoh tertentu. Berikut ialah contoh menggunakan perpustakaan LIME dan model regresi:

#Regression - Lime import numpy as np from sklearn.model_selection import train_test_split from sklearn.linear_model import LinearRegression from lime.lime_tabular import LimeTabularExplainer # Generate a custom regression dataset np.random.seed(42) X = np.random.rand(100, 5) # 100 samples, 5 features y = 2 * X[:, 0] + 3 * X[:, 1] + 1 * X[:, 2] + np.random.randn(100) # Linear regression with noise # Split the data into training and testing sets X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42) # Train a simple linear regression model model = LinearRegression() model.fit(X_train, y_train) # Initialize a LimeTabularExplainer explainer = LimeTabularExplainer(training_data=X_train, mode="regression") # Select a sample instance for explanation sample_instance = X_test[0] # Explain the prediction for the sample instance explanation = explainer.explain_instance(sample_instance, model.predict) # Print the explanation explanation.show_in_notebook()

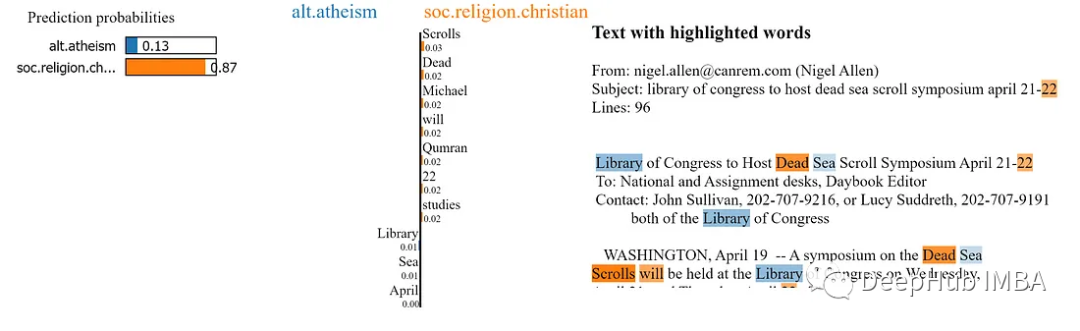

3. Menjelaskan teks

LIME juga boleh digunakan untuk menerangkan ramalan yang dibuat oleh model teks. Untuk menggunakan LIME dengan model teks, anda perlu mencipta objek penterjemah teks LIME dan kemudian menjana tafsiran untuk contoh tertentu. Berikut ialah contoh penggunaan perpustakaan LIME dan model teks:

# Text Model - Lime import lime import lime.lime_text from sklearn.feature_extraction.text import TfidfVectorizer from sklearn.naive_bayes import MultinomialNB from sklearn.datasets import fetch_20newsgroups # Load a sample dataset (20 Newsgroups) for text classification categories = ['alt.atheism', 'soc.religion.christian'] newsgroups_train = fetch_20newsgroups(subset='train', categories=categories) # Create a simple text classification model (Multinomial Naive Bayes) tfidf_vectorizer = TfidfVectorizer() X_train = tfidf_vectorizer.fit_transform(newsgroups_train.data) y_train = newsgroups_train.target classifier = MultinomialNB() classifier.fit(X_train, y_train) # Define a custom Lime explainer for text data explainer = lime.lime_text.LimeTextExplainer(class_names=newsgroups_train.target_names) # Choose a text instance to explain text_instance = newsgroups_train.data[0] # Create a predict function for the classifier predict_fn = lambda x: classifier.predict_proba(tfidf_vectorizer.transform(x)) # Explain the model's prediction for the chosen text instance explanation = explainer.explain_instance(text_instance, predict_fn) # Print the explanation explanation.show_in_notebook()

4 Model imej

LIME boleh digunakan untuk menerangkan hasil ramalan model imej. Anda perlu mencipta objek penterjemah imej LIME dan menjana penjelasan untuk contoh tertentu

import lime import lime.lime_image import sklearn # Load the dataset and train an image classifier data = sklearn.datasets.load_digits() classifier = sklearn.ensemble.RandomForestClassifier() classifier.fit(data.images.reshape((len(data.images), -1)), data.target) # Create a LIME image explainer object explainer = lime.lime_image.LimeImageExplainer() # Select an instance to be explained instance = data.images[0] # Generate an explanation for the instance explanation = explainer.explain_instance(instance, classifier.predict_proba, top_labels=5)

Tafsiran output LIME

Selepas menggunakan LIME untuk menjana penjelasan, anda boleh memvisualisasikan penjelasan untuk memahami sumbangan setiap ciri kepada ramalan. Untuk data jadual, anda boleh menggunakan kaedah show_in_notebook atau as_pyplot_figure untuk memaparkan penjelasan. Untuk data teks dan imej, anda boleh menggunakan kaedah show_in_notebook untuk memaparkan nota.

Dengan memahami sumbangan setiap ciri, kita boleh memperoleh pemahaman yang lebih mendalam tentang proses membuat keputusan model dan mengenal pasti bias atau kawasan masalah yang berpotensi

LIME menyediakan beberapa teknik lanjutan untuk meningkatkan kualiti penjelasan, Teknik ini termasuk:

Melaraskan bilangan sampel yang terganggu: Meningkatkan bilangan sampel yang terganggu boleh meningkatkan kestabilan dan ketepatan tafsiran.

Pilih model boleh tafsir: Memilih model boleh tafsir yang sesuai (cth., regresi linear, pepohon keputusan) menjejaskan kualiti penjelasan.

Pemilihan Ciri: Menyesuaikan bilangan ciri yang digunakan dalam penjelasan boleh membantu memfokuskan pada sumbangan terpenting kepada ramalan.

Penghadan dan alternatif LIME

Walaupun LIME ialah alat yang berkuasa untuk mentafsir model pembelajaran mesin, ia juga mempunyai beberapa batasan:

Tafsiran tempatan: LIME memfokuskan pada tafsiran tempatan, yang mungkin tidak menangkap keseluruhan model.

Mahal: Menjana penjelasan menggunakan LIME boleh memakan masa, terutamanya untuk set data yang besar dan model yang kompleks

Jika LIME tidak memenuhi keperluan anda, terdapat cara lain untuk menerangkan model pembelajaran mesin, seperti SHAP ( SHApley Additive exPlanations) dan sauh.

Ringkasan

LIME ialah alat yang berharga untuk menerangkan perkara yang dilakukan oleh pengelas (atau model) pembelajaran mesin. Dengan menyediakan cara praktikal untuk memahami model pembelajaran mesin yang kompleks, LIME membolehkan pengguna mempercayai dan menambah baik sistem mereka

Dengan memberikan penjelasan yang boleh ditafsir untuk ramalan individu, LIME boleh membantu membina kepercayaan dalam model pembelajaran mesin. Kepercayaan jenis ini penting dalam banyak industri, terutamanya apabila menggunakan model ML untuk membuat keputusan penting. Dengan lebih memahami cara model mereka berfungsi, pengguna dengan yakin boleh bergantung pada sistem pembelajaran mesin dan membuat keputusan berdasarkan data.

Atas ialah kandungan terperinci Tafsiran pelbagai contoh kod model pembelajaran mesin: Penjelasan dengan LIME. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!