Rumah >Peranti teknologi >AI >Artikel mengenai ramalan siri masa di bawah gelombang model berskala besar

Artikel mengenai ramalan siri masa di bawah gelombang model berskala besar

- 王林ke hadapan

- 2023-11-06 08:13:381243semak imbas

Hari ini saya akan bercakap dengan anda tentang aplikasi model besar dalam ramalan siri masa. Dengan pembangunan model besar dalam bidang NLP, semakin banyak usaha cuba untuk menggunakan model besar pada bidang ramalan siri masa. Artikel ini memperkenalkan kaedah utama untuk menggunakan model besar pada ramalan siri masa dan meringkaskan beberapa kerja berkaitan terkini untuk membantu semua orang memahami kaedah penyelidikan ramalan siri masa dalam era model besar.

1. Kaedah ramalan siri masa model besar

Dalam tiga bulan lalu, banyak kerja ramalan siri masa model besar telah muncul, yang pada asasnya boleh dibahagikan kepada dua jenis .

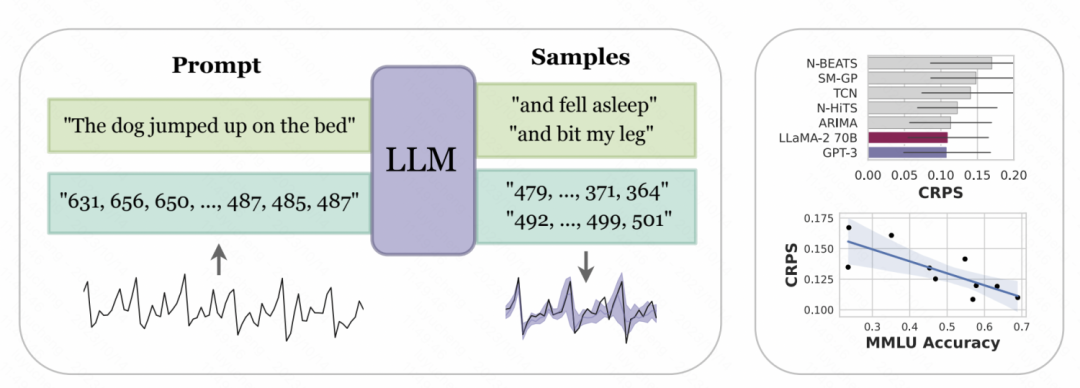

Kandungan yang ditulis semula: Satu kaedah ialah menggunakan model NLP berskala besar secara langsung untuk ramalan siri masa. Dalam kaedah ini, model NLP berskala besar seperti GPT dan Llama digunakan untuk ramalan siri masa Kuncinya terletak pada cara menukar data siri masa kepada data yang sesuai untuk input model berskala besar

Yang kedua. adalah untuk melatih siri masa Model besar domain. Dalam kaedah jenis ini, sebilangan besar set data siri masa digunakan untuk melatih bersama model besar seperti GPT atau Llama dalam medan siri masa dan digunakan untuk tugasan siri masa hiliran.

Mengenai dua jenis kaedah di atas, berikut ialah beberapa kerja perwakilan siri masa model besar klasik yang berkaitan.

2. Aplikasi model NLP yang besar kepada siri masa

Kaedah ini adalah kumpulan terawal kerja ramalan siri masa model besar

Universiti New York Dalam makalah "Model Bahasa Skala Besar sebagai Peramal Siri Masa Sifar Sampel" yang diterbitkan dengan kerjasama Universiti Carnegie Mellon, perwakilan digital siri masa direka bentuk untuk dijadikan token supaya ia boleh ditukar menjadi sesuatu yang boleh dikenali. oleh model besar seperti GPT dan LLaMa masuk. Memandangkan model berskala besar yang berbeza menandakan nombor secara berbeza, pemperibadian diperlukan apabila menggunakan model yang berbeza. Sebagai contoh, GPT akan membahagikan rentetan nombor kepada urutan yang berbeza, yang akan menjejaskan pembelajaran model. Oleh itu, artikel ini memaksa ruang antara nombor untuk menampung format input GPT. Untuk model besar yang dikeluarkan baru-baru ini seperti LLaMa, nombor individu biasanya dibahagikan, jadi tidak perlu menambah ruang. Pada masa yang sama, untuk mengelakkan jujukan input terlalu panjang disebabkan nilai siri masa yang terlalu besar, beberapa operasi penskalaan dilakukan dalam artikel ini untuk mengehadkan nilai siri masa asal kepada julat yang lebih munasabah

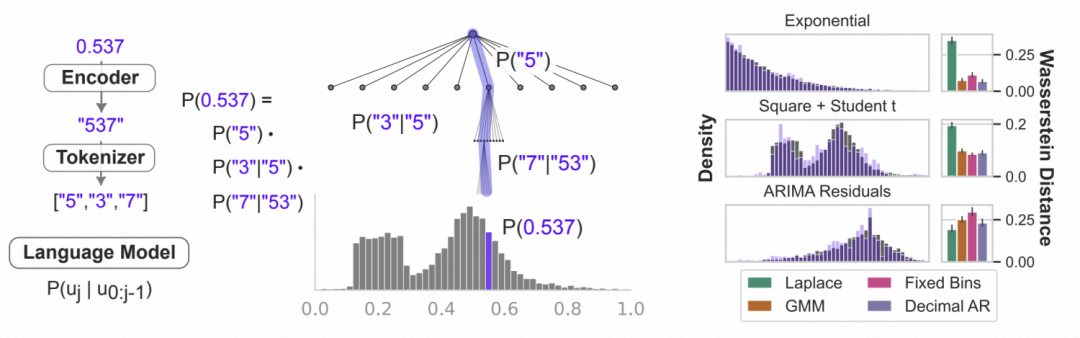

# 🎜🎜##🎜 🎜#Picture Rentetan digital yang diproses di atas dimasukkan ke dalam model besar, membolehkan model besar meramalkan nombor seterusnya secara autoregresif, dan akhirnya tukar nombor yang diramalkan kepada nilai siri masa yang sepadan. Rajah di bawah memberikan gambarajah skematik Menggunakan kebarangkalian bersyarat model bahasa untuk memodelkan nombor adalah untuk meramalkan kebarangkalian bahawa digit seterusnya adalah setiap nombor berdasarkan nombor sebelumnya Ia adalah struktur softmax hierarki lelaran, ditambah dengan perwakilan keupayaan model besar , boleh menyesuaikan diri dengan pelbagai jenis pengedaran, itulah sebabnya model besar boleh digunakan untuk ramalan siri masa dengan cara ini. Pada masa yang sama, kebarangkalian nombor seterusnya yang diramalkan oleh model juga boleh ditukar kepada ramalan ketidakpastian untuk mencapai anggaran ketidakpastian siri masa.

Rentetan digital yang diproses di atas dimasukkan ke dalam model besar, membolehkan model besar meramalkan nombor seterusnya secara autoregresif, dan akhirnya tukar nombor yang diramalkan kepada nilai siri masa yang sepadan. Rajah di bawah memberikan gambarajah skematik Menggunakan kebarangkalian bersyarat model bahasa untuk memodelkan nombor adalah untuk meramalkan kebarangkalian bahawa digit seterusnya adalah setiap nombor berdasarkan nombor sebelumnya Ia adalah struktur softmax hierarki lelaran, ditambah dengan perwakilan keupayaan model besar , boleh menyesuaikan diri dengan pelbagai jenis pengedaran, itulah sebabnya model besar boleh digunakan untuk ramalan siri masa dengan cara ini. Pada masa yang sama, kebarangkalian nombor seterusnya yang diramalkan oleh model juga boleh ditukar kepada ramalan ketidakpastian untuk mencapai anggaran ketidakpastian siri masa.

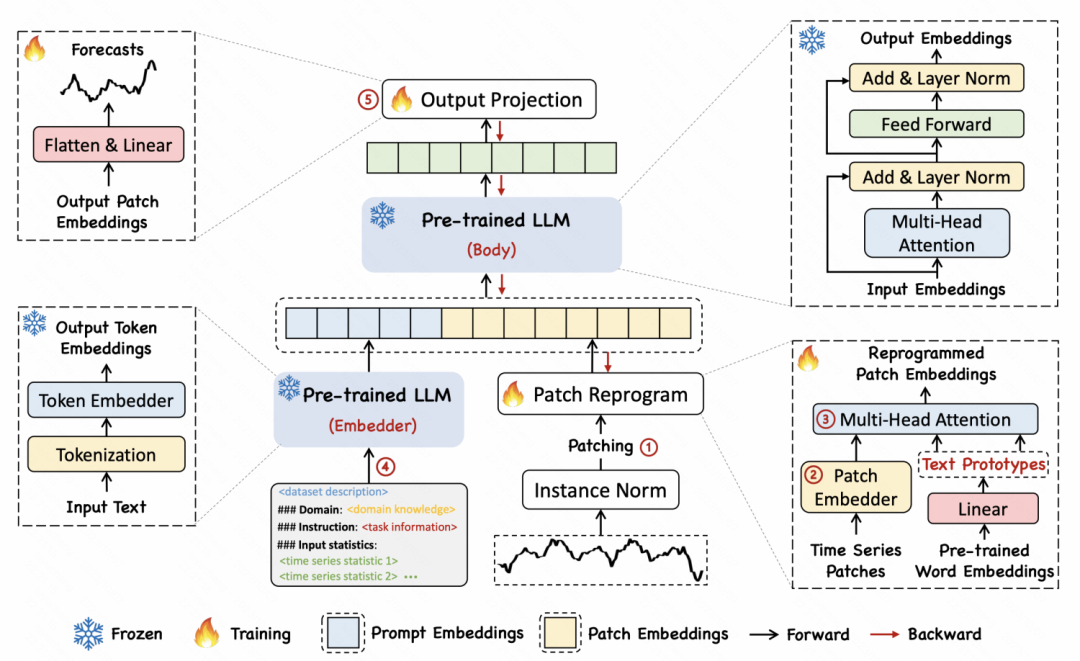

Picture Dalam artikel lain bertajuk "TIME-LLM: TIME SERIES FORECASTING BY REPROGRAMMING EL" , penulis mencadangkan kaedah pengaturcaraan semula untuk menukar siri masa kepada teks untuk mencapai penjajaran antara dua bentuk siri masa dan teks

Dalam artikel lain bertajuk "TIME-LLM: TIME SERIES FORECASTING BY REPROGRAMMING EL" , penulis mencadangkan kaedah pengaturcaraan semula untuk menukar siri masa kepada teks untuk mencapai penjajaran antara dua bentuk siri masa dan teks

Kaedah pelaksanaan khusus ialah menukar masa dahulu Urutan dibahagikan kepada beberapa tampalan , dan setiap tampung memperoleh pembenaman melalui MLP. Kemudian, pembenaman tampalan dipetakan kepada vektor perkataan dalam model bahasa untuk mencapai pemetaan dan penjajaran rentas mod bagi segmen dan teks siri masa. Artikel itu mencadangkan idea prototaip teks, yang memetakan berbilang perkataan kepada prototaip untuk mewakili semantik urutan tampalan dalam tempoh masa. Sebagai contoh, dalam contoh di bawah, perkataan yang ditembak dan ke atas dipetakan kepada segi tiga merah, yang sepadan dengan tompok urutan naik jangka pendek dalam siri masa.

Picture 3 model besar siri masa

3 model besar siri masa

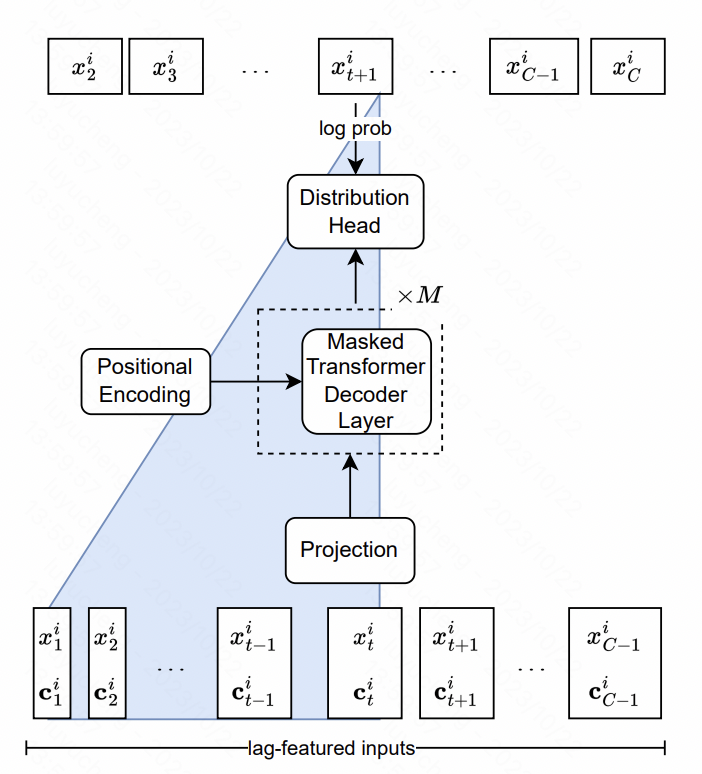

Dari segi ciri, artikel itu mengekstrak ciri lag berbilang skala dan berbilang jenis, yang kebanyakannya merupakan nilai statistik jujukan sejarah dalam tetingkap masa berbeza dari siri masa asal. Urutan ini dimasukkan ke dalam model sebagai ciri tambahan. Dari segi struktur model, teras struktur LlaMA dalam NLP ialah Transformer, di mana kaedah normalisasi dan bahagian pengekodan kedudukan telah dioptimumkan. Lapisan keluaran akhir menggunakan berbilang kepala untuk menyesuaikan parameter taburan kebarangkalian Sebagai contoh, taburan Gaussian sesuai dengan varians min Taburan pelajar-t digunakan dalam artikel ini, dan tiga parameter kebebasan, min dan skala yang sepadan adalah keluaran, dan akhirnya setiap kali diperoleh Hasil taburan kebarangkalian yang diramalkan.

Pictures

Pictures

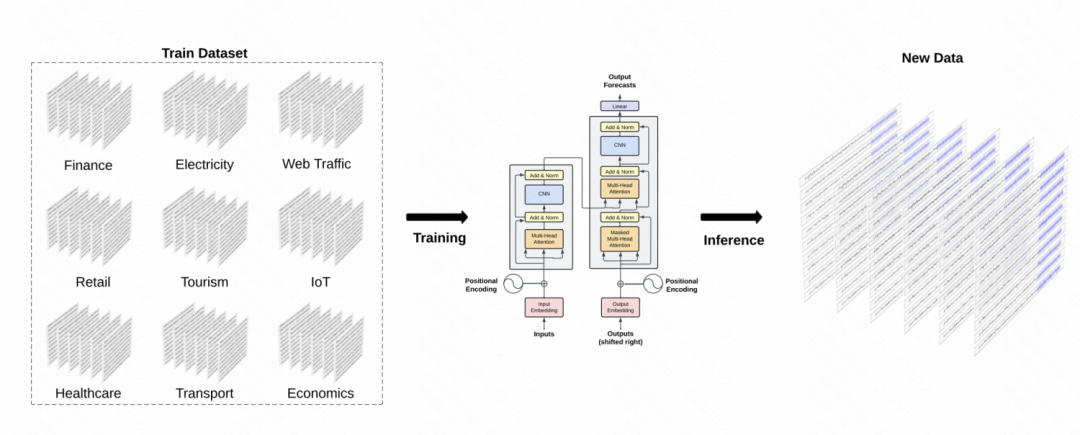

Satu lagi karya yang serupa ialah TimeGPT-1, yang membina model GPT dalam medan siri masa. Dari segi latihan data, TimeGPT menggunakan sejumlah besar data siri masa, mencapai sejumlah 10 bilion titik sampel data, melibatkan pelbagai jenis data domain. Semasa proses latihan, saiz kelompok yang lebih besar dan kadar pembelajaran yang lebih kecil digunakan untuk meningkatkan kemantapan latihan. Struktur utama model ialah model GPT klasik

gambar

gambar

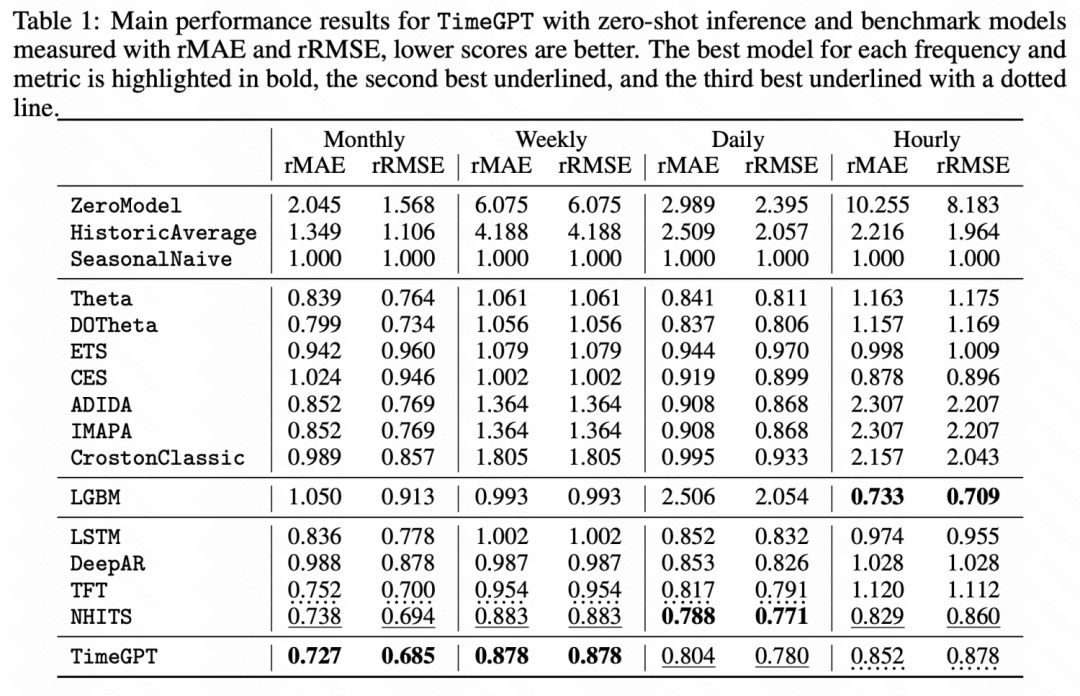

Ia juga boleh dilihat daripada keputusan eksperimen di bawah bahawa dalam beberapa tugasan pembelajaran sampel sifar, model besar pra-latihan siri masa ini telah mencapai hasil yang lebih baik. daripada model asas Peningkatan prestasi yang ketara.

Gambar

Gambar

4. Ringkasan bidang siri. Tidak kira kaedah yang digunakan, ia menunjukkan kepada kita potensi model besar + siri masa, dan ia adalah hala tuju yang patut dikaji secara mendalam.

Atas ialah kandungan terperinci Artikel mengenai ramalan siri masa di bawah gelombang model berskala besar. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!