Rumah >Peranti teknologi >AI >CLIP dipilih sebagai CVPR apabila digunakan sebagai RNN: ia boleh membahagikan banyak konsep tanpa latihan |

CLIP dipilih sebagai CVPR apabila digunakan sebagai RNN: ia boleh membahagikan banyak konsep tanpa latihan |

- PHPzasal

- 2024-06-09 12:53:28532semak imbas

Panggil CLIP dalam gelung untuk membahagikan konsep yang tidak terkira dengan berkesan tanpa latihan tambahan.

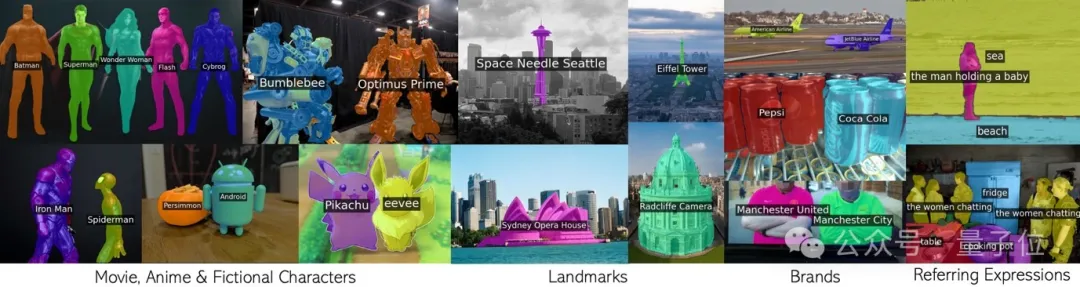

Sebarang frasa termasuk watak filem, tanda tempat, jenama dan kategori umum.

Keputusan baharu pasukan bersama Universiti Oxford dan Penyelidikan Google ini telah diterima oleh CVPR 2024 dan kod tersebut telah bersumberkan terbuka.

Pasukan mencadangkan teknologi baharu yang dipanggil CLIP sebagai RNN (pendek kata CaR), yang menyelesaikan beberapa masalah utama dalam bidang pembahagian imej kosa kata terbuka:

- Tiada data latihan diperlukan: kaedah tradisional memerlukan sejumlah besar anotasi topeng atau set data teks imej untuk penalaan halus, teknologi CaR berfungsi tanpa sebarang data latihan tambahan.

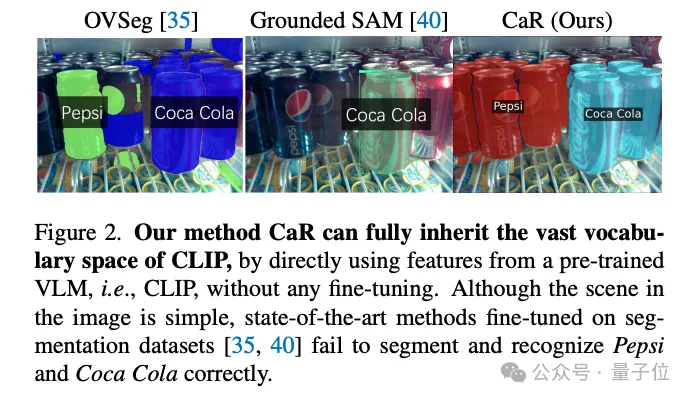

- Keterbatasan dalam Perbendaharaan Kata Terbuka: Model bahasa visual (VLM) pra-latihan terhad dalam keupayaan mereka untuk mengendalikan perbendaharaan kata terbuka selepas penalaan halus. Teknologi CaR mengekalkan ruang perbendaharaan kata yang luas bagi VLM.

- Pemprosesan pertanyaan teks untuk konsep yang bukan dalam imej: Tanpa penalaan halus, sukar bagi VLM untuk membahagikan konsep yang tidak wujud dalam imej dengan tepat secara beransur-ansur melalui proses berulang untuk meningkatkan kualiti pembahagian.

Diinspirasikan oleh RNN, secara kitaran memanggil CLIP

Untuk memahami prinsip CaR, anda perlu menyemak rangkaian saraf berulang RNN terlebih dahulu.

RNN memperkenalkan konsep keadaan tersembunyi, iaitu seperti "memori" yang menyimpan maklumat dari langkah masa lalu. Dan setiap kali langkah berkongsi set pemberat yang sama, yang boleh memodelkan data jujukan dengan baik.

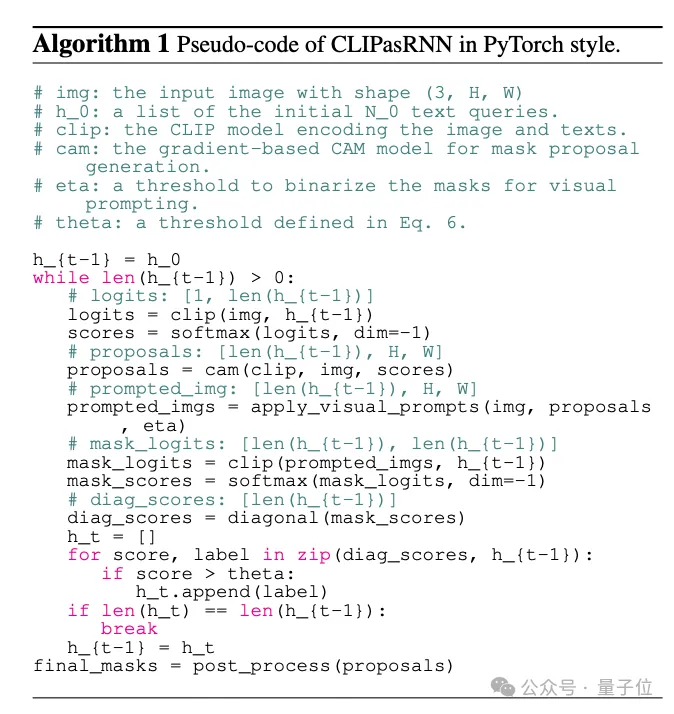

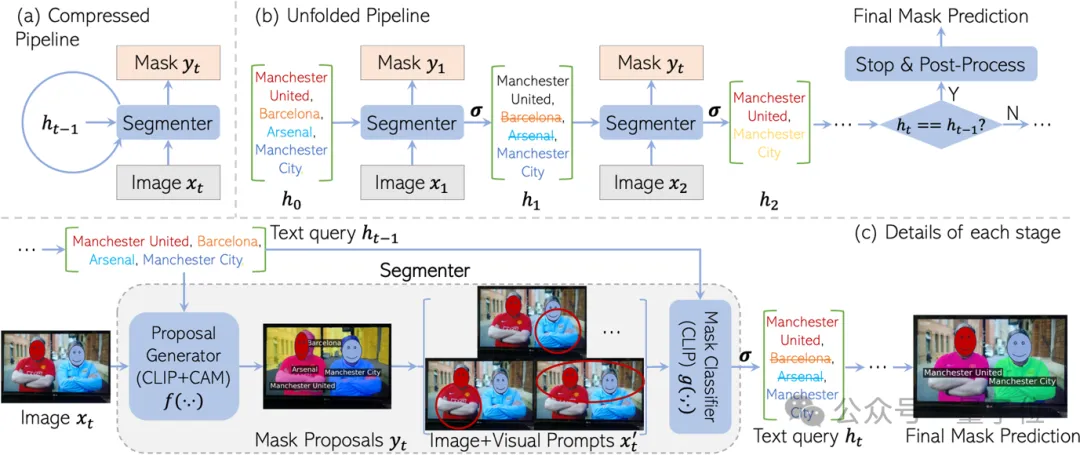

Diinspirasikan oleh RNN, CaR juga direka bentuk sebagai rangka kerja kitaran, terdiri daripada dua bahagian:

- Penjana cadangan topeng: menjana topeng untuk setiap pertanyaan teks dengan bantuan CLIP.

- Pengelas topeng: Kemudian gunakan model CLIP untuk menilai tahap padanan setiap topeng yang dijana dan pertanyaan teks yang sepadan. Jika tahap padanan adalah rendah, pertanyaan teks akan dihapuskan.

Dengan terus berulang seperti ini, pertanyaan teks akan menjadi lebih dan lebih tepat, dan kualiti topeng akan menjadi lebih tinggi dan lebih tinggi.

Akhirnya, apabila set pertanyaan tidak lagi berubah, hasil segmentasi akhir boleh dikeluarkan.

Sebab rangka kerja rekursif ini direka bentuk adalah untuk mengekalkan "pengetahuan" pra-latihan CLIP ke tahap maksimum.

Terdapat banyak konsep yang dilihat dalam pra-latihan CLIP, merangkumi segala-galanya daripada selebriti, mercu tanda kepada watak anime. Jika anda memperhalusi set data berpecah, perbendaharaan kata pasti akan mengecut dengan ketara.

Sebagai contoh, model SAM "bahagi segala-galanya" hanya boleh mengenali sebotol Coca-Cola, tetapi tidak sebotol Pepsi-Cola.

Tapi pakai CLIP terus untuk segmentasi, kesannya tak memuaskan.

Ini kerana objektif pra-latihan CLIP pada asalnya tidak direka untuk ramalan yang padat. Terutama apabila pertanyaan teks tertentu tidak wujud dalam imej, CLIP boleh menjana beberapa topeng yang salah dengan mudah.

CaR bijak menyelesaikan masalah ini melalui lelaran gaya RNN. Dengan menilai dan menapis pertanyaan berulang kali sambil menambah baik topeng, pembahagian kosa kata terbuka berkualiti tinggi akhirnya tercapai.

Akhir sekali, mari ikuti tafsiran pasukan dan pelajari tentang butiran rangka kerja CaR.

Butiran teknikal CaR

- Rangka Kerja Rangkaian Neural Berulang: CaR menggunakan rangka kerja kitaran baru untuk terus mengoptimumkan koresponden antara pertanyaan teks dan imej melalui proses berulang.

- Segmen dua peringkat: Ia terdiri daripada penjana cadangan topeng dan pengelas topeng, kedua-duanya dibina pada model CLIP yang telah dilatih dan pemberat kekal tidak berubah semasa proses lelaran.

- Penjanaan cadangan topeng: Menggunakan teknologi gradCAM, cadangan topeng dijana berdasarkan skor persamaan ciri imej dan teks.

- Isyarat visual: Gunakan isyarat visual seperti bulatan merah, latar belakang kabur, dsb. untuk meningkatkan fokus model pada kawasan tertentu imej.

- Fungsi ambang: Dengan menetapkan ambang persamaan, cadangan topeng yang sangat sejajar dengan pertanyaan teks ditapis keluar.

- Pasca pemprosesan: Penapisan topeng menggunakan medan rawak bersyarat padat (CRF) dan model SAM pilihan.

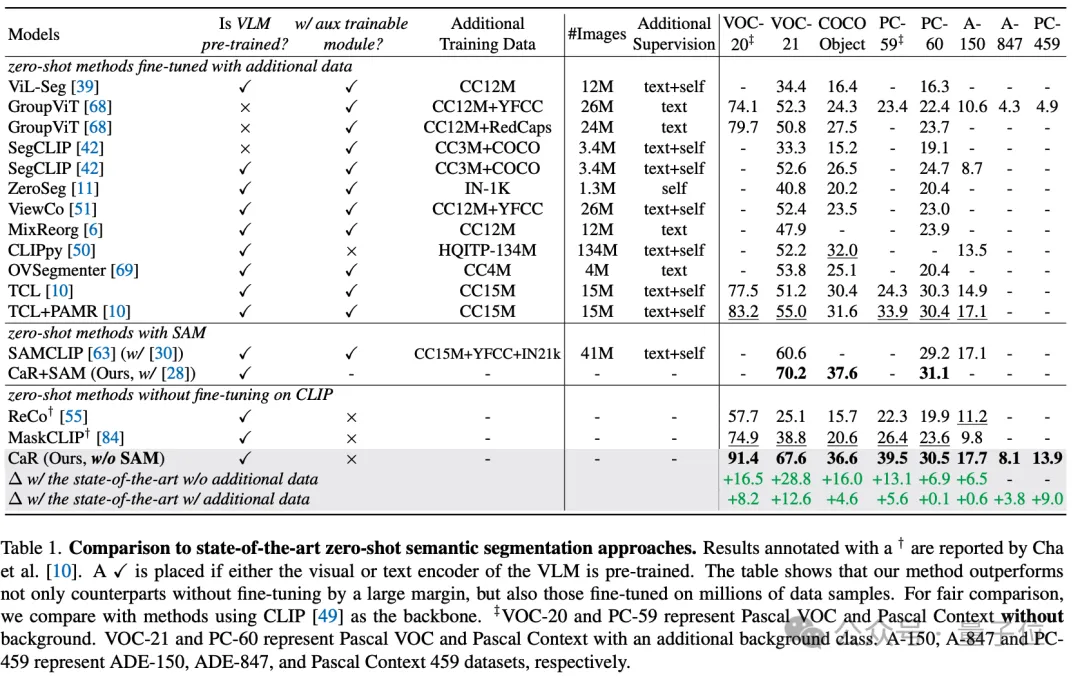

Melalui cara teknikal ini, teknologi CaR telah mencapai peningkatan prestasi yang ketara pada berbilang set data standard, mengatasi kaedah pembelajaran sifar pukulan tradisional, dan juga menunjukkan prestasi unggul jika dibandingkan dengan model yang telah mengalami peningkatan daya saing yang meluas. Seperti yang ditunjukkan dalam jadual di bawah, walaupun tiada latihan tambahan dan penalaan halus diperlukan, CaR menunjukkan prestasi yang lebih kukuh pada lapan penunjuk berbeza bagi pembahagian semantik sifar pukulan daripada kaedah sebelumnya yang diperhalusi pada data tambahan.

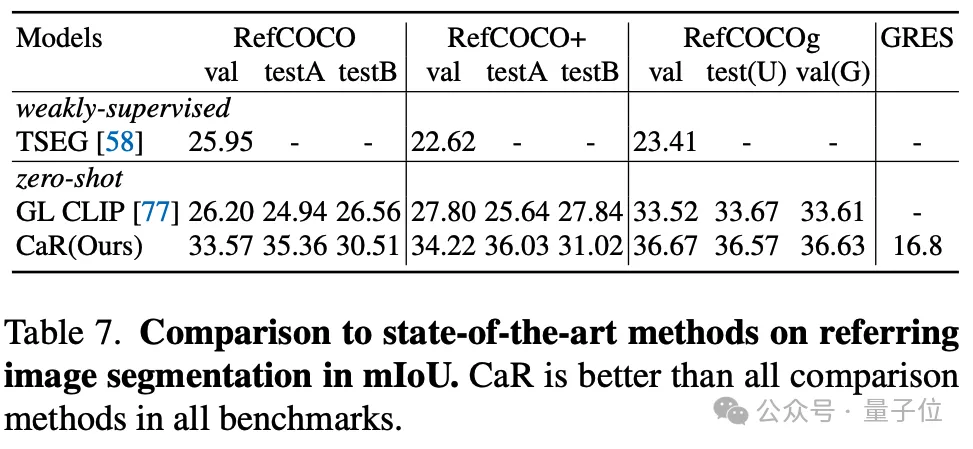

Penulis juga menguji kesan CaR pada segmentasi Rujukan sampel sifar juga menunjukkan prestasi yang lebih kukuh daripada kaedah sampel sifar sebelumnya.

Ringkasnya, CaR (CLIP sebagai RNN) ialah rangka kerja rangkaian saraf berulang yang inovatif yang boleh melaksanakan tugas pembahagian imej semantik dan rujukan sifar tangkapan secara berkesan tanpa data latihan tambahan. Ia meningkatkan kualiti pembahagian dengan ketara dengan mengekalkan ruang perbendaharaan kata yang luas bagi model bahasa visual yang telah dilatih dan memanfaatkan proses berulang untuk terus mengoptimumkan penjajaran pertanyaan teks dengan cadangan topeng.

Kelebihan CaR ialah keupayaannya untuk mengendalikan pertanyaan teks yang kompleks tanpa penalaan halus dan kebolehskalaannya kepada medan video, membawa kemajuan terobosan kepada bidang pembahagian imej kosa kata terbuka.

Pautan kertas: https://arxiv.org/abs/2312.07661.

Laman utama projek: https://torrvision.com/clip_as_rnn/.

Atas ialah kandungan terperinci CLIP dipilih sebagai CVPR apabila digunakan sebagai RNN: ia boleh membahagikan banyak konsep tanpa latihan |. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!