ホームページ >テクノロジー周辺機器 >AI >新しい Range View3D 検出アイデア: RangePerception

新しい Range View3D 検出アイデア: RangePerception

- 王林転載

- 2023-12-14 16:57:461474ブラウズ

タイトル書き換え: 範囲認識: 効率的かつ正確な 3D オブジェクト検出のための LiDAR 範囲ビューの調整

論文を表示するには、次のリンクをクリックしてください: https://openreview.net/pdf?id=9kFQEJSyCM

著者の所属: 復旦大学上海人工知能研究所 リライト後: 所属: 復旦大学上海人工知能研究所

論文アイデア:

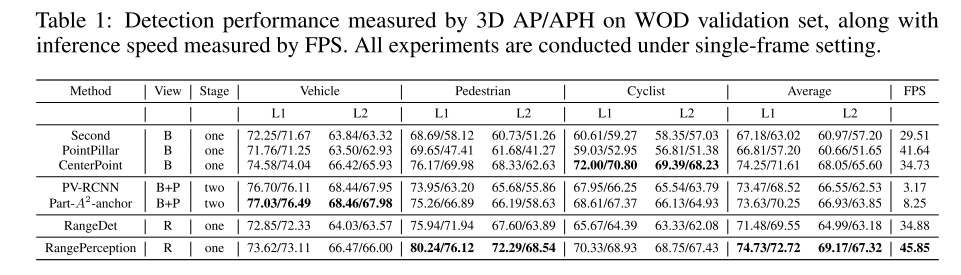

現在、LiDAR ベースの 3D 検出手法主にバーズアイビュー(BEV)またはレンジビュー(RV)をベースとして使用します。 BEV 手法はボクセル化と 3D 畳み込みに依存しているため、トレーニングと推論プロセスの効率が低下します。対照的に、RV 法は、そのコンパクトさと 2D 畳み込みとの互換性により高い効率を示しますが、その性能は依然として BEV 法に遅れをとっています。 RV 法の効率を維持しながらパフォーマンスのギャップを解消するために、この研究では RangePerception と呼ばれる効率的で正確な RV ベースの 3D オブジェクト検出フレームワークを提案します。この調査では、慎重な分析を通じて、既存の RV 手法のパフォーマンスを妨げる 2 つの重要な課題を特定しています。 1) 出力で使用される 3D ワールド座標と入力で使用される 2D 距離画像座標の間には自然なドメイン ギャップがあり、これにより次のことが起こります。距離からの変化 画像から情報を抽出することが困難になる; 2) 元の距離画像には視覚的な損傷の問題があり、距離画像の端にあるターゲットの検出精度に影響を与えます。これらの課題に対処するために、この論文では、Range Aware Kernel (RAK) と Vision Restoration Module (VRM) という 2 つの新しいアルゴリズムを提案します。これらのアルゴリズムは、距離画像表現と世界座標 3D 検出結果の情報フローを容易にします。 RAK と VRM の助けにより、RangePerception は、Waymo Open Dataset 上の以前の最先端の RV メソッド RangeDet と比較して、平均 L1/L2 AP を 3.25/4.18 改善します。 RangePerception は初の RV ベースの 3D 検出手法で、よく知られている BEV ベースの CenterPoint と比較して、平均 AP がわずかに高く、推論速度が CenterPoint の 1.3 倍です。設計:

このペーパーでは、RangePerception と呼ばれる効率的かつ正確な RV ベースの 3D 検出フレームワークを示します。上記の主要な課題を克服するために、Range Aware Kernel (RAK) と Vision Restoration Module (VRM) という 2 つの新しいアルゴリズムが提案され、RangePerception フレームワークに統合されています。どちらも、距離画像表現とテスト結果の世界座標 3D 情報フローを容易にします。 RAK と VRM の助けを借りて、当社の RangePerception は、車両、歩行者、自転車に WOD で 73.62、80.24、および 70.33 L1 3D AP を提供することにより、レンジビューベースの 3D 検出方法として最先端のパフォーマンスを実現します。この記事の寄稿者は以下の通りです。

RangePerception フレームワーク

この記事では、RangePerception と呼ばれる新しい高性能 3D 検出フレームワークを紹介します。 RangePerception は初の RV ベースの 3D 検出器であり、WOD 上で 74.73/69.17 の平均 L1/L2 AP を達成します。これは、平均 L1/L2 を持つ以前の最先端の RV ベースの検出器 RangeDet よりも優れています。 AP は 71.48/64.99 で、3.25/4.18 の改善を示しました。 RangePerception はまた、平均 L1/L2 AP 74.25/68.04 を達成する、広く使用されている BEV ベースの手法 CenterPoint [6] と比較してわずかに優れたパフォーマンスを示します。特に、RangePerception の推論速度は CenterPoint の推論速度よりも 1.3 倍速く、自動運転車でのリアルタイム展開により適していることが証明されています。Range Aware Kernel.

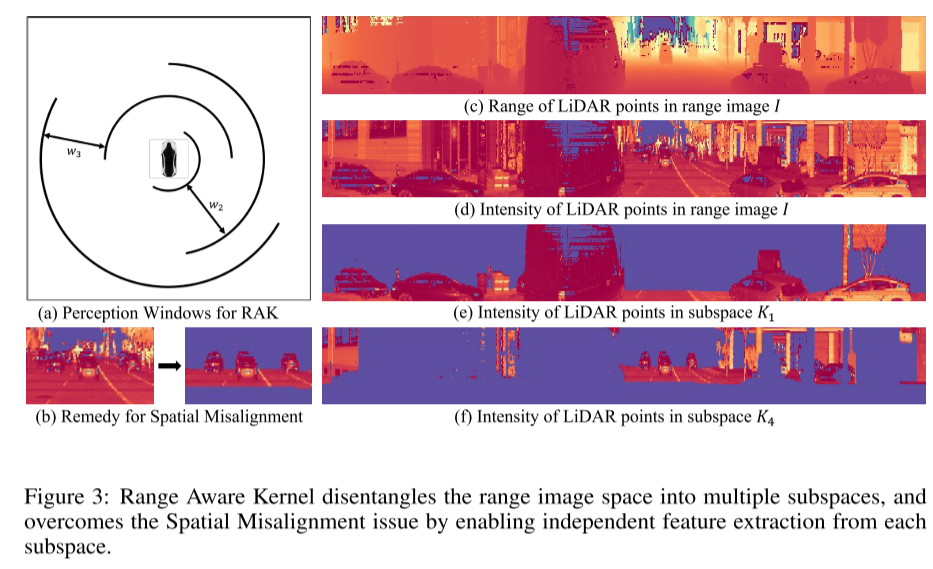

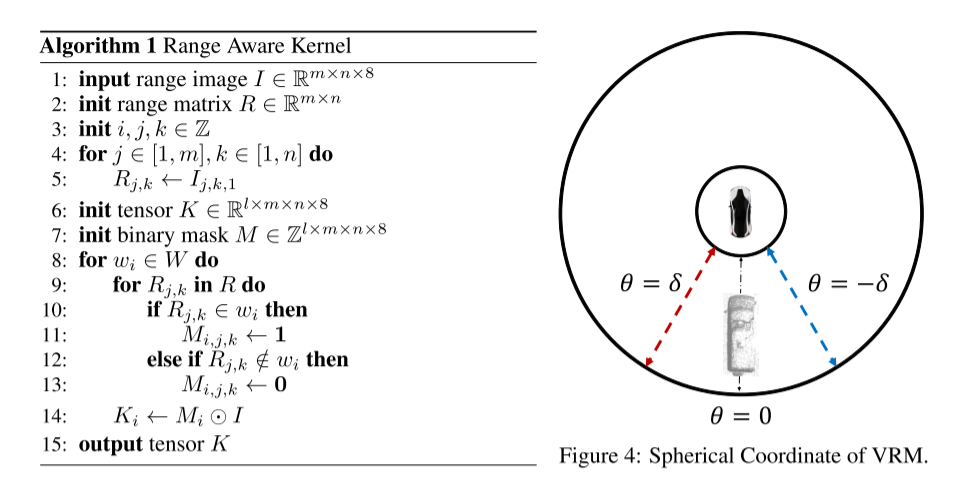

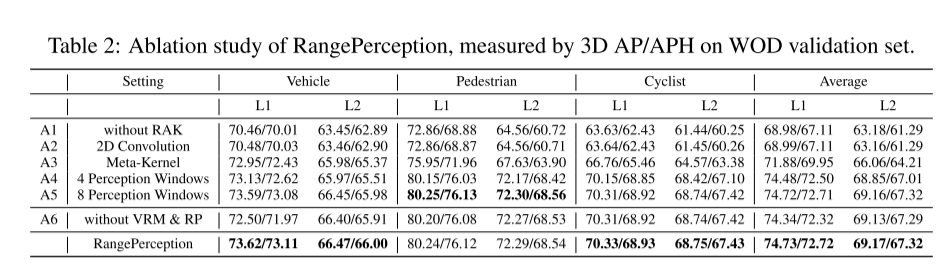

RangePerception 特徴抽出機能の一部である Range Aware Kernel (RAK) は、RV ベースのネットワーク向けに調整された画期的なアルゴリズムです。 RAK は、距離画像空間を複数の部分空間に分解し、各部分空間から独立して特徴を抽出することで空間的不整合の問題を克服します。実験結果は、RAK が無視できる計算コストで平均 L1/L2 AP を 5.75/5.99 改善することを示しています。視覚修復モジュール

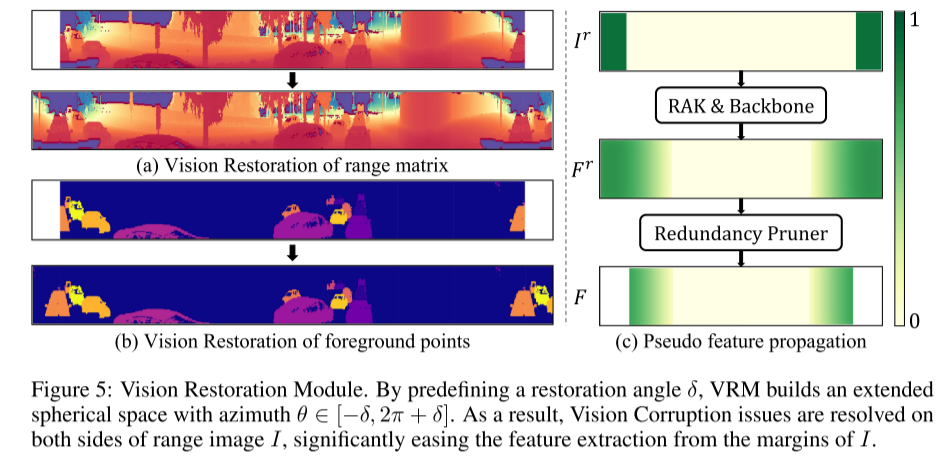

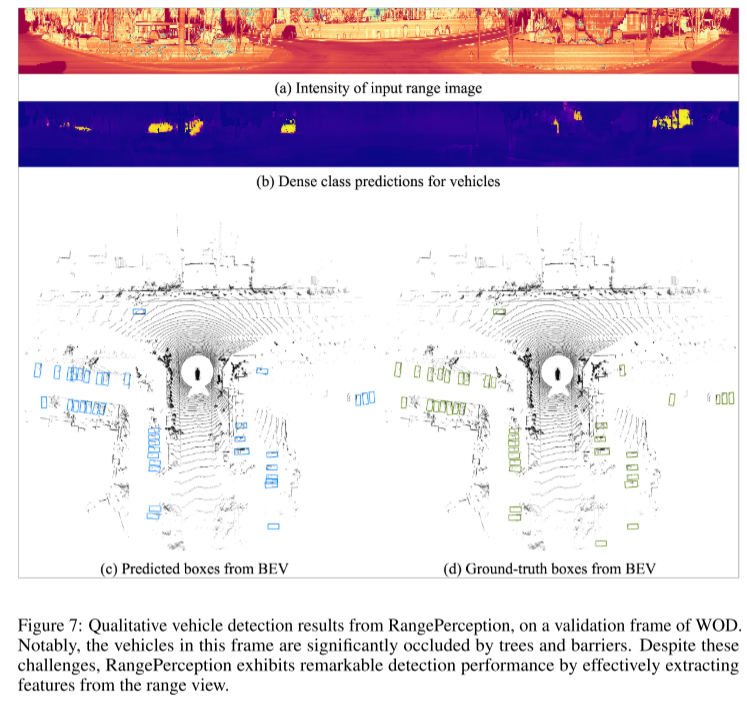

視覚障害の問題(視覚破壊問題)を解決するために、本研究では視覚修復モジュール(VRM)を提案します。 VRM は、以前に損傷した領域を復元することにより、バックボーン ネットワークの受信領域を拡張します。実験セクションで示したように、VRM は車両検出に特に役立ちます。

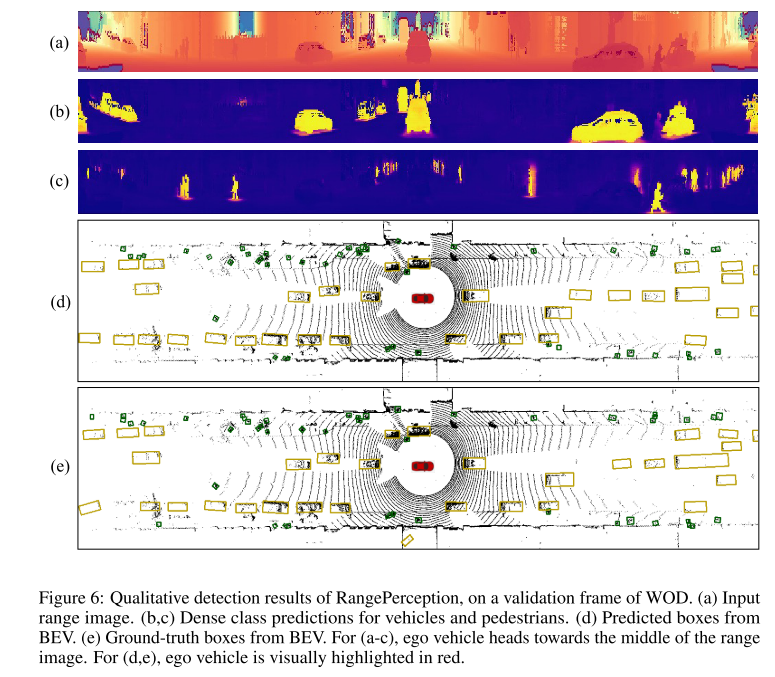

図 2: RangePerception フレームワークは、距離画像 I を入力として受け取り、密な予測を生成します。表現学習効果を向上させるために、フレームワークは Range Backbone の前に VRM モジュールと RAK モジュールを順番に統合します。次に、特別に設計された Redundancy Pruner を使用して深い機能の冗長性を排除し、後続のリージョン プロポーザル ネットワークと後処理レイヤーの計算コストを削減します。 ##

図 1: (a ~ d) それぞれ RV と BEV で表される、上部の LiDAR 信号のフレーム例。 (e) 空間的位置ずれ現象。 (f) 視覚破壊現象。

図 3: Range Aware カーネルは、距離画像空間を複数のサブ空間に分解し、各サブ空間から独立した特徴を抽出することで空間の不整合の問題を解決します。)。

図 5: 視力回復モジュール。回復角 δ を事前に定義することにより、VRM は方位角 θ ∈ [−δ, 2π δ] をもつ拡張球形空間を構築します。したがって、距離画像 I の両側の視覚的な破損の問題は解決され、I のエッジからの特徴抽出のプロセスが大幅に簡素化されます。 #########実験結果: ##################################### #

概要:

この記事では、空間的な位置ずれや視覚的損傷の問題を効果的に解決できる RV に基づく 3 次元検出フレームワークである RangePerception について説明します。 RAK および VRM テクノロジーを導入することにより、RangePerception は WOD 上で優れた検出機能を実証するとともに、その効率的かつ正確な実用的な展開の可能性を実証しました。

引用:

@inproceedings{bai2023rangeperception,title={RangePerception: Taming Li{DAR} Range View for Efficient and Accurate 3D Object Detection},author={Yeqi BAI and Ben Fei and Youquan Liu and Tao MA and Yuenan Hou and Botian Shi and Yikang LI},booktitle={Thirty-seventh Conference on Neural Information Processing Systems},year={2023},url={https://openreview.net/forum?id=9kFQEJSyCM}}

元のリンク: https://mp.weixin.qq.com/s/EJCl5kLxhHaa7lh98g2I6w

以上が新しい Range View3D 検出アイデア: RangePerceptionの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。