ホームページ >テクノロジー周辺機器 >AI >Microsoft の最新の HuggingGPT 論文の解釈、何を学びましたか?

Microsoft の最新の HuggingGPT 論文の解釈、何を学びましたか?

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2023-04-29 19:40:051036ブラウズ

Microsoft は最近、HuggingGPT に関する論文を発表しました。元のアドレス: HuggingGPT: Solving AI Tasks with ChatGPT and its Friends in Hugging Face[1]。この記事は論文の解釈です。

HuggingGPT: ChatGPT とハグフェイスで AI タスクを解決する中国語に翻訳: HuggingGPT: ChatGPT とハグフェイスで AI タスクを解決

その友達とは何ですか?論文を読むとGPT4に代表される大型言語モデルや各種エキスパートモデルが分かるはずです。この記事で言及されているエキスパート モデルは、一般モデルと相対的なものであり、医療分野のモデル、金融分野のモデルなど、特定の分野のモデルです。

Hugging Face は、オープンソースの機械学習コミュニティおよびプラットフォームです。

次の質問に答えると、論文の主な内容をすぐに理解できます。

- HuggingGPT の背後にある考え方とその仕組みは何ですか?

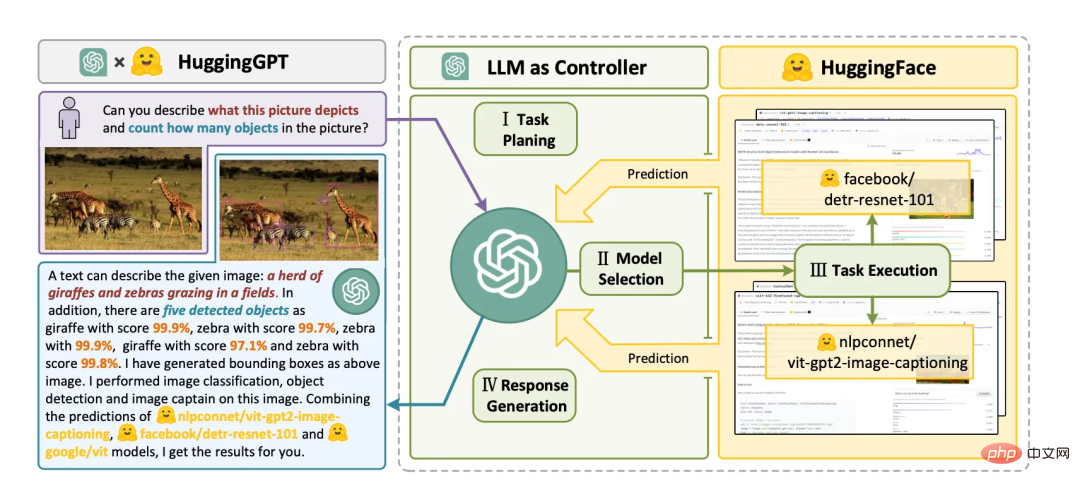

- ##HuggingGPT の背後にある考え方は、大規模言語モデル (LLM) をコントローラーとして使用することです。 AI モデルを管理し、複雑な AI タスクを解決します。 HuggingGPT は、理解と推論における LLM の強みを活用してユーザーのリクエストを分析し、それらを複数のサブタスクに分解することで機能します。次に、HuggingGPT は、エキスパート モデルの記述に基づいて、各タスクに最適なモデルを割り当て、異なるモデルの結果を統合します。 HuggingGPT のワークフローには、タスク計画、モデル選択、タスク実行、応答生成の 4 つの段階が含まれます。詳細については、PDF ファイルの 4 ページと 16 ページをご覧ください。

- HuggingGPT の背後にある考え方とその仕組みは何ですか?

- HuggingGPT の背後にある考え方は、Large Language Model (LLM) を使用することです。 AI モデルを管理し、複雑な AI タスクを解決するコントローラーとして機能します。 HuggingGPT の動作原理は、理解と推論における LLM の利点を利用して、ユーザーの意図を分析し、タスクを複数のサブタスクに分解することです。次に、HuggingGPT は、エキスパート モデルの記述に基づいて、各タスクに最適なモデルを割り当て、異なるモデルの結果を統合します。 HuggingGPT のワークフローには、タスク計画、モデル選択、タスク実行、応答生成の 4 つの段階が含まれます。詳細については、PDF ファイルの 4 ページと 16 ページをご覧ください。

- HuggingGPT は言語を共通インターフェイスとして使用して AI モデルを強化しますか?

- HuggingGPT は言語を共通インターフェイスとして使用して AI モデルを強化します。 Large Language Model (LLM) を使用すると、AI モデルを管理するコントローラーとして機能します。 LLM は、ユーザーの自然言語リクエストを理解して推論し、タスクを複数のサブタスクに分解します。 HuggingGPT は、エキスパート モデルの記述に基づいて、各サブタスクに最適なモデルを割り当て、異なるモデルの結果を統合します。このアプローチにより、HuggingGPT は、言語、視覚、音声、その他の困難なタスクを含む、さまざまなモダリティやドメインの複雑な AI タスクをカバーできるようになります。詳細はPDFファイルの1ページ目と16ページ目をご覧ください。

- HuggingGPT は大規模な言語モデルを使用して既存の AI モデルを管理しますか?

- HuggingGPT は大規模な言語モデルをインターフェイスとして使用し、ユーザーのリクエストを Expert にルーティングしますモデルは、大規模な言語モデルの言語理解機能と他のエキスパート モデルの専門知識を効果的に組み合わせます。大きな言語モデルは計画と意思決定の頭脳として機能し、小さなモデルはそれぞれの特定のタスクの実行者として機能します。このモデル間のコラボレーション プロトコルは、一般的な AI モデルを設計する新しい方法を提供します。 (ページ 3-4)

- HuggingGPT はどのような複雑な AI タスクを解決できますか?

- HuggingGPT は言語、画像、音声など幅広い問題を解決できます。検出、生成、分類、質問応答などのさまざまな形式のタスクを含む、ビデオやビデオなどのさまざまな形式のタスクの範囲。 HuggingGPT が解決できる 24 のタスクの例には、テキスト分類、オブジェクト検出、セマンティック セグメンテーション、画像生成、質問応答、テキスト音声変換、およびテキスト動画変換が含まれます。 (ページ 3)

- HuggingGPT はさまざまなタイプの AI モデルで使用できますか?それとも特定のモデルに限定されますか?

- HuggingGPT は使用できません特定のモデル AI モデルまたは視覚認識タスクに限定されます。大規模な言語モデルを通じてモデル間の連携を組織することで、あらゆるモダリティまたはドメインのタスクを解決できます。大規模な言語モデルの計画の下では、タスクのプロセスを効果的に指定でき、より複雑な問題を解決できます。 HuggingGPT はよりオープンなアプローチを採用し、モデルの説明に従ってタスクを割り当て、整理します。 (4 ページ目)

HuggingGPT のワークフローには 4 つの段階が含まれます:

- タスク計画: ChatGPT を使用してユーザーのリクエストを分析し、その意図を理解し、解決可能なタスクに分解します。

- モデルの選択: 計画されたタスクを解決するために、ChatGPT は説明に基づいて Hugging Face でホストされている AI モデルを選択します。

- タスクの実行: 選択した各モデルを呼び出して実行し、結果を ChatGPT に返します。

- 応答の生成: 最後に、ChatGPT を使用してすべてのモデルの予測を統合し、応答を生成します。

参考リンク

[1] HuggingGPT: ChatGPT とその仲間たちによる Hugging Face による AI タスクの解決: https://arxiv.org/pdf/2104.06674.pdf

以上がMicrosoft の最新の HuggingGPT 論文の解釈、何を学びましたか?の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

声明:

この記事は51cto.comで複製されています。侵害がある場合は、admin@php.cn までご連絡ください。