ホームページ >テクノロジー周辺機器 >AI >自動運転のための視覚認識技術ロードマップの簡単な分析

自動運転のための視覚認識技術ロードマップの簡単な分析

- 王林転載

- 2023-04-29 20:07:051649ブラウズ

01 背景

自動運転は予測段階から産業化段階へと段階的に移行しており、その具体的な性能は4つのポイントに分けられます。まず、ビッグ データの文脈では、データ セットの規模が急速に拡大しています。その結果、これまで小規模なデータ セットで開発されたプロトタイプの詳細は大幅に除外され、大規模なデータ セットで有効な作業のみが抽出されることになります。・スケールデータは残ります。 2 つ目は、単眼シーンから多視点シーンへの焦点の切り替えであり、これにより複雑さが増加します。次に、出力空間を画像空間から BEV 空間に移すなど、アプリケーションフレンドリーな設計への傾向があります。

最後に、純粋に精度を追求することから、徐々に推論速度も同時に考慮するように変更していきます。同時に、自動運転シナリオでは迅速な応答が求められるため、パフォーマンス要件では速度が考慮され、さらにエッジデバイスへの展開方法もより考慮されます。

背景のもう 1 つの部分は、過去 10 年間で視覚認識が深層学習によって急速に発展したことです。多くの研究が行われ、次のような主流の方向での研究もいくつかありました。分類、検出、セグメンテーション。かなり成熟したパラダイム。自動運転シナリオにおける視覚知覚の開発プロセスでは、特徴エンコーディングのターゲット定義、知覚パラダイム、監視などの側面が、これらの主流の方向に大きく依存しているため、自動運転の知覚に取り組む前に、これらの主流の方向を検討する必要があります。少し。

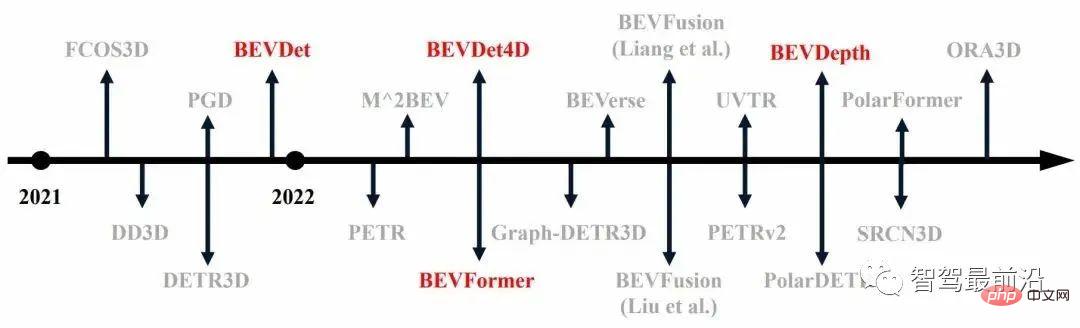

これらの背景に対して、図 1 に示すように、大規模なデータセットに対する多数の 3D ターゲット検出の研究が過去 1 年間に登場しました (赤色でマークされたものは、最初のもの) アルゴリズム)。

図 1 過去 1 年間の 3 次元ターゲット検出の開発

02 テクニカル ルート

2.1 リフティング

自動運転シナリオにおける視覚と主流の視覚の違いは、主に与えられたターゲット定義空間の違いにあります。主流の視覚のターゲットは画像空間で定義されますが、自動運転シナリオのターゲットは画像空間で定義されます。 3次元空間で。入力がすべて画像の場合、3 次元空間で結果を取得するにはリフト プロセスが必要であり、これは自動運転における視覚の中心的な問題です。

Lift オブジェクトの問題を解く方法は、入力、中間特徴、出力に分けることができます。入力レベルの例として、視点の変更があります。原理は、画像を使用して推論することです。深度情報を使用して画像の RGB 値を 3 次元空間に投影し、色付きの点群を取得します。点群検出の関連作業は後ほど続きます。

現在、より有望なものは、フィーチャレベルの変換またはフィーチャレベルのリフトです。たとえば、DETR3D では、これらはすべてフィーチャ レベルで空間変更を実行します。画像レベルの特徴を抽出するための計算量は少なく、出力レベルのルックアラウンド結果融合の問題も回避できます。もちろん、機能レベルの変換には、通常、奇妙な OP が使用され、デプロイメントが不親切になるなど、いくつかの典型的な問題もあります。

現在、特徴レベルでのリフト プロセスは、主に深度および注意メカニズム戦略に基づいて比較的堅牢であり、代表的なものはそれぞれ BEVDet と DETR3D です。深度ベースの戦略は、画像の各点の深度を計算し、カメラのイメージング モデルに従って特徴を 3 次元空間に投影することによってリフトのプロセスを完了します。注意メカニズムに基づく戦略は、3 次元空間内のオブジェクトをクエリとして事前定義し、内部パラメータと外部パラメータを通じて 3 次元空間の中点に対応する画像の特徴をキーと値として見つけます。注意を通じて 3 次元の物体を計算する、空間内の物体の特性。

現在のすべてのアルゴリズムは、基本的に、深度に基づいているか、注意メカニズムに基づいているかにかかわらず、カメラ モデルに大きく依存しており、そのため、キャリブレーションに対する感度が高く、一般に複雑な計算プロセスが発生します。カメラモデルを放棄するアルゴリズムは堅牢性に欠けることが多いため、この点はまだ完全に成熟していません。

2.2 時間的

時間的情報は、ターゲット検出の効果を効果的に向上させることができます。自動運転シナリオでは、ターゲットの速度が現在のシナリオにおける主要な認識ターゲットの 1 つであるため、タイミングはより深い意味を持ちます。速度の焦点は変化にあり、単一フレーム データには十分な変化情報が含まれていないため、時間次元で変化情報を提供するにはモデリングが必要です。既存の点群時系列モデリング方法は、複数のフレームの点群を入力として混合することで、比較的密度の高い点群を取得し、検出をより正確に行うことができます。さらに、マルチフレーム点群には連続情報が含まれており、その後のネットワーク トレーニング プロセス中に、BP を使用してこの連続情報を抽出し、連続情報を必要とする速度推定などのタスクを解決する方法を学習します。

視覚のタイミング モデリング手法は、主に BEVDet4D と BEVFormer から来ています。 BEVDet4D は、2 つのフレームの特徴を単純に融合することで、後続のネットワークに継続的な情報を提供します。もう 1 つのパスはアテンションに基づいており、単一時間フレームと反時計回りの両方の特徴をクエリのオブジェクトとして提供し、アテンションを通じてこれら 2 つの特徴を同時にクエリしてタイミング情報を抽出します。

2.3 深度

レーダー知覚と比較した自動運転視覚知覚の最大の欠点の 1 つは、深度推定です。正確さ。論文「確率的および幾何学的深さ: 遠近感のあるオブジェクトの検出」では、GT メソッドを置き換えることによって、さまざまな要因がパフォーマンス スコアに与える影響を研究しています。分析の主な結論は、正確な深度推定によりパフォーマンスが大幅に向上するということです。

しかし、奥行き推定は、現在の視覚認識における大きなボトルネックです。これを改善するには、現在、主に 2 つの方法があります。1 つは、PGD で幾何学的制約を使用して、奥行きマップ上で予測を実行することです。リファイン。もう 1 つは、LIDAR を監視として使用して、より堅牢な深度推定値を取得することです。

このプロセスにおいて優れている現在のソリューションである BEVDepth は、トレーニング プロセス中に LIDAR によって提供される深度情報を使用して、変化プロセス中の深度推定と知覚の主なタスクを監視します。同時に。

2.4 マルチモダリティ/マルチタスク

マルチタスクとは、複数のタスクを 1 回の作業で完了することを目的としています。統一フレームワーク この計算を通じて、さまざまな認識タスクにより、リソースの節約や計算推論の高速化という目的を達成できます。しかし、現状の手法は基本的に、統合された特徴量を取得した上で、異なるレベルの特徴量を処理するだけでマルチタスクを実現しているため、タスクのマージ後の性能低下という共通の問題があります。マルチモダリティは、判断全体の中で直接融合できる形式を見つけ、その後単純な融合を達成するという点でもほぼ普遍的です。

##03 BEVDet シリーズ

3.1 BEVDet

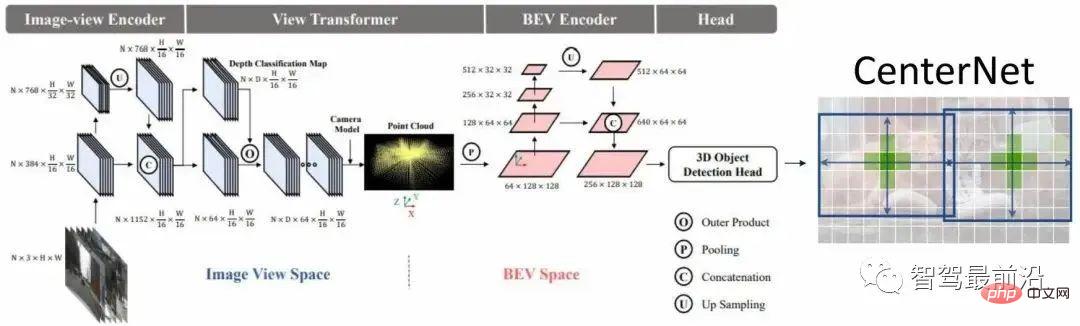

BEVDet ネットワークを図 2 に示します。特徴抽出プロセスでは、主に、抽出された画像空間の特徴を BEV 空間の特徴に変換し、この特徴をさらにエンコードして、予測に使用できる特徴を取得します。 、最後に密予測を使用してターゲットを予測します。

#図 2 BEVDet ネットワーク構造

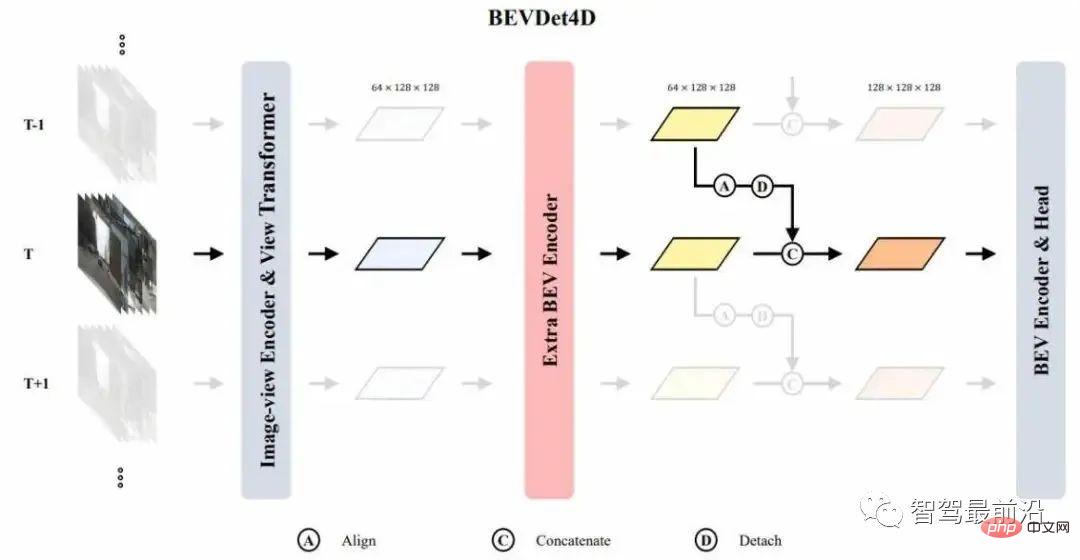

視点変更モジュールの処理は 2 つのステップに分かれており、まず、変換対象の特徴のサイズが VxCxHxW であると仮定し、画像空間での奥行きを分類的に予測します。 2 つの異なる深度のレンダリング特徴を使用して視覚特徴を取得し、カメラ モデルを使用してそれを 3 次元空間に投影し、3 次元空間をボクセル化し、スプラット プロセスを実行します。 BEV の特徴を取得します。視点変更モジュールの非常に重要な機能は、データの速度低下において相互分離の役割を果たすことです。具体的には、カメラの内部パラメータを通じて、カメラ座標系上の点を 3 次元空間に投影することで取得できますが、画像空間内の点にデータ拡張を適用する場合、座標を維持するために、カメラ座標系上の点が不変である場合は、逆変換を行う必要があります。つまり、カメラ座標系上の座標は拡張の前後で変化せず、相互分離効果があります。相互分離の欠点は、画像空間の拡張によって BEV 空間の学習が正規化されないことです。その利点により、BEV 空間学習の堅牢性が向上します。 私たちは、次のことから始めます。実験 上記からいくつかの重要な結論を導き出すことができます。まず、BEV 空間エンコーダを使用した後、アルゴリズムが過剰適合に陥る可能性が高くなります。もう 1 つの結論は、BEV 空間の拡大は画像空間の拡大よりもパフォーマンスに大きな影響を与えるということです。 BEV 空間のターゲット サイズとカテゴリの高さの間には相関関係もありますが、同時に、ターゲット間のオーバーラップ長が小さいと、いくつかの問題が発生することが観察されます。画像空間で設計された非極性オブジェクトは、大きな値の抑制方法が最適ではありません。同時アクセラレーション戦略の中核は、並列コンピューティング手法を使用して独立したスレッドをさまざまな小さなコンピューティング タスクに割り当て、並列コンピューティングのアクセラレーションの目的を達成することであり、追加のビデオ メモリのオーバーヘッドがないという利点があります。 ##BEVDet4D ネットワーク構造を図 3 に示します。このネットワークの主な焦点は、リバース タイム フレームの特徴を現在のフレームにどのように適用するかです。入力特徴を保持オブジェクトとして選択しますが、ターゲット変数がすべて定義されているため、この画像特徴は選択しません。 BEV 空間、および画像の特性は、直接タイミング モデリングには適していません。同時に、BEV エンコーダーで連続特徴を抽出する必要があるため、BEV エンコーダーの背後にある特徴は連続融合特徴として選択されません。 視点変更モジュールによって出力される特徴が比較的まばらであることを考慮して、視点変更後に追加の BEV エンコーダーを接続して予備的な BEV 特徴を抽出し、時系列モデリングを実行します。タイミング フュージョン中、反時計回りのフレームのフィーチャを現在のニードルと位置合わせしてスプライスし、タイミング フュージョンを完了します。実際、ここではタイミング フィーチャを抽出するタスクを後のものに任せます。BEV がそれを行います。 #3.2 BEVDet4D

図 3 BEVDet4D ネットワーク構造## 方法ネットワーク構造に適合するターゲット変数を設計するには?その前に, まずネットワークのいくつかの重要な特性を理解する必要があります. 1 つ目は特徴の受容野です. ネットワークは BP を通じて学習するため, 特徴の受容野は出力空間によって決まります.

自動運転知覚アルゴリズムの出力空間は、一般に車両周囲の一定範囲の空間として定義され、特徴マップは連続空間上の一様分布とみなすことができ、コーナーポイントを離散サンプルに合わせて配置します。特徴マップの受容野は自車を中心とした一定範囲内に定義されているため、自車の移動に応じて変化するため、異なる2つの時間ノードにおいて、特徴マップの受容野は一定の値を持つことになる。ワールド座標系の値、特定のオフセット。

2 つのフィーチャが直接結合されている場合、2 つのフィーチャ マップ内の静的ターゲットの位置は異なり、2 つのフィーチャ マップ内の動的ターゲットのオフセットは異なります。セルフテストのオフセットにワールド座標系の動的ターゲットのオフセットを加えたものに等しくなります。パターンの一貫性の原則によれば、スプライスされたフィーチャ内のターゲットのオフセットは自車両に関連しているため、ネットワークの学習目標を設定する際には、これらのフィーチャ内のターゲットの位置の変化である必要があります2 つの機能マップ。

次の式によると、学習ターゲットはセルフテストの動作とは関係がなく、ワールド座標でのターゲットの動作のみに関連していると推定できます。システム。

上記の結果から導き出された学習目標と現在の主流の方法の学習目標の違いは、時間成分が除去されていることと、速度が変位/時間に等しいことですが、これら 2 つの特徴は次のことを提供しません。したがって、この速度目標を学習したい場合、ネットワークは時間成分を正確に推定する必要があり、学習の難易度が高くなります。実際には、トレーニング プロセス中に 2 つのフレーム間の時間を定数値として設定することができ、BP を学習することで一定時間間隔のネットワークを学習できます。

タイム ドメインの拡張では、トレーニング プロセス中に異なる時間間隔をランダムに使用します。異なる時間間隔では、2 つの画像内のターゲットのオフセットが異なります。ターゲット オフセットは異なります。異なるオフセットでモデルのルパン効果を実現するために、学習の量も異なります。同時に、モデルはターゲットのオフセットに対して一定の感度を持っています。つまり、間隔が小さすぎると、2 つのフレーム間の変化を認識することが困難になります。したがって、テスト中に適切な時間間隔を選択すると、モデルの汎化パフォーマンスを効果的に向上させることができます。

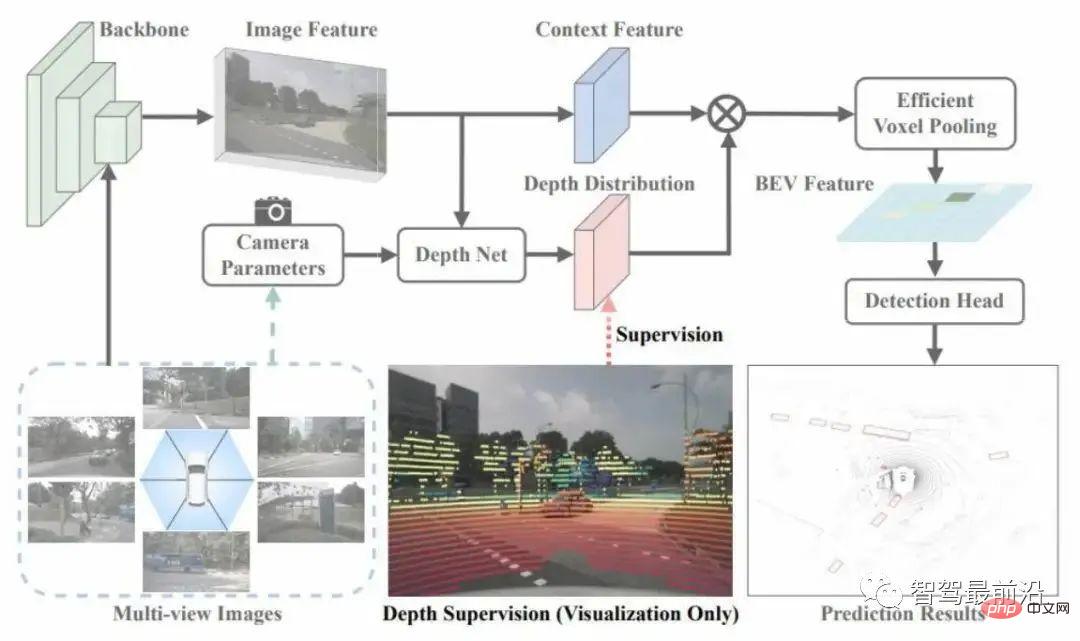

3.3 BEVDepth

この記事では、図 4 に示すように、レーダーを使用して確実な深度推定値を取得します。点群を使用して、変更モジュール内の深度分布を監視します。この監視は疎です。この疎性は、ターゲットによって提供される深度監視に比べて密ですが、すべてのピクセルに到達するわけではありません。正確な深さの監視も比較的疎です。ただし、この深さ推定の一般化パフォーマンスを向上させるために、より多くのサンプルを提供できます。

図 4 BEVDepth ネットワーク構造

もう 1 つこの研究の特徴は、特徴量と深度を推定のために 2 つのブランチに分割し、追加の残差ネットワークを深度推定ブランチに追加して、深度推定ブランチの受容野を増やすことです。研究者らは、カメラの内部パラメータと外部パラメータの精度によってコンテキストと深度のずれが生じると考えており、深度推定ネットワークが十分に強力でない場合、ある程度の精度が失われると考えています。

最後に、このカメラの内部パラメータが深度推定ブランチ入力として使用され、NSE と同様の方法がチャネル レベルで入力特徴のチャネルを調整するために使用されます。これにより、さまざまなカメラの内部パラメータに対するネットワークの堅牢性が効果的に向上します。

#04 制限と関連する議論第一に、自動運転の視覚的認識、それは最終的にはデータの問題とモデルの問題を伴うデプロイメントを提供します。データの問題には多様性の問題とデータ アノテーションが含まれます。手動によるアノテーションは非常に高価であるため、将来的には自動アノテーションが実現できるかどうかがわかります。

現時点では、動的ターゲットのラベリングは前例がなく、静的ターゲットの場合は、3D 再構成によって部分的または半自動のラベリングを取得できます。モデルに関して言えば、現在のモデル設計はキャリブレーションに対して堅牢ではないか、キャリブレーションに対して敏感であるため、モデルをキャリブレーションに対してロバストにする方法、またはキャリブレーションから独立させる方法も検討する価値のある問題です。

もう 1 つは、ネットワーク構造の高速化の問題です。一般的な OP を使用して視点の変更を実現できますか? この問題は、ネットワークの高速化プロセスに影響します。

以上が自動運転のための視覚認識技術ロードマップの簡単な分析の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。