ホームページ >テクノロジー周辺機器 >AI >CVPR\'24 口頭 | 純粋な疎点群検出器 SAFDNet の過去と現在の様子を見てみましょう。

CVPR\'24 口頭 | 純粋な疎点群検出器 SAFDNet の過去と現在の様子を見てみましょう。

- 王林オリジナル

- 2024-06-08 12:25:22694ブラウズ

前書きと著者の個人的な理解

3D 点群オブジェクト検出は自動運転の知覚にとって重要です。 まばらな点群データから特徴表現を効率的に学習する方法は、3D 点群オブジェクト検出の分野における重要な課題です。 。この記事では、NeurIPS 2023 でチームによって公開された HEDNet と CVPR 2024 で SAFDNet を紹介します。HEDNet は、既存のスパース畳み込みニューラル ネットワークが長距離特徴間の依存関係を捉えるのが難しいという問題の解決に焦点を当てていますが、SAFDNet は構築されています。 HEDNet に基づく純粋な疎点群検出器。 点群オブジェクトの検出では、従来の方法は手作業で設計された特徴抽出器に依存することが多く、まばらな点群データを処理する場合、その有効性は限られています。近年、深層学習ベースの手法がこの分野で大きな進歩を遂げています。 HEDNet は、畳み込みニューラル ネットワークを使用して、疎な点群データから特徴を抽出し、長距離の特徴間の依存関係のキャプチャなど、特定のネットワーク構造を通じて疎な点群データの主要な問題を解決します。この手法はNeurIPS 2023の論文に掲載されています

前世 - HEDNet

研究背景

主流の手法は通常、非構造化点群を通常の要素に変換し、スパース畳み込みニューラルネットワークまたはTransformerを使用して特徴を抽出します。既存のスパース畳み込みニューラル ネットワークのほとんどは、サブ多様体残差 (SSR) モジュールを積み重ねることによって構築されます。各 SSR モジュールには、小さな畳み込みカーネル (サブマニホールド スパース、SS) 畳み込みを使用する 2 つのサブ多様体畳み込みが含まれます。ただし、部分多様体畳み込みでは、入力および出力の特徴マップのスパース性を一定に保つ必要があるため、モデルが離れた特徴間の依存関係を捕捉することが妨げられます。考えられる解決策の 1 つは、SSR モジュールの部分多様体畳み込みを通常のスパース (RS) 畳み込みに置き換えることです。ただし、ネットワークの深さが増加すると、下位の特徴マップがまばらになり、計算コストが大幅に増加します。一部の研究では、遠距離特徴間の依存関係を捕捉するために、大規模な畳み込みカーネルに基づくスパース畳み込みニューラル ネットワークまたはトランスフォーマーを使用しようとしていますが、これらの方法では精度が向上しないか、より高い計算コストが必要になります。要約すると、遠く離れたフィーチャ間の依存関係を効率的に取得できる方法がまだ不足しています。

方法の紹介

SSRモジュールとRSRモジュール

モデル効率を向上させるために、ほとんどの既存の3D点群オブジェクト検出器はスパース畳み込みを使用して特徴を抽出します。スパース畳み込みには主に RS 畳み込みと SS 畳み込みが含まれます。 RS 畳み込みは、計算プロセス中にまばらな特徴を隣接する領域に分散させ、その結果、特徴マップのまばらさを軽減します。対照的に、SS 畳み込みでは、入力および出力の特徴マップのスパース性が変更されません。特徴マップのスパース性を低減することによる RS 畳み込みの計算コストのため、RS 畳み込みは通常、既存の方法では特徴マップのダウンサンプリングにのみ使用されます。一方、ほとんどの要素ベースの手法は、SSR モジュールをスタックして点群特徴を抽出することにより、スパース畳み込みニューラル ネットワークを構築します。各 SSR モジュールには、2 つの SS コンボリューションと、入力機能と出力機能を融合するスキップ接続が含まれています。

図1(a)は、単一のSSRモジュールの構造を示しています。図の有効なフィーチャはゼロ以外のフィーチャを指しますが、空のフィーチャの値はゼロです。これは、その位置に元々点群が含まれていないことを意味します。特徴マップの疎性を、特徴マップの総面積に対する空の特徴が占める面積の比率として定義します。 SSR モジュールでは、入力特徴マップを 2 つの SS 畳み込みによって変換して出力特徴マップを取得します。同時に、入力特徴マップの情報がスキップ接続 (Skip conn.) を通じて出力特徴マップに直接統合されます。 。 SS 畳み込みは、SSR モジュールの出力特徴マップが入力特徴マップと同じスパース性を持つことを保証するために、有効な特徴のみを処理します。ただし、このような設計では、切断された機能間の情報のやり取りが妨げられます。たとえば、上部の特徴マップでアスタリスクでマークされた特徴点は、下部の特徴マップの赤い点線のボックスの外側にある赤い三角形でマークされた 3 つの特徴点から情報を受け取ることができないため、長距離フィーチャ間の依存関係をモデル化するモデルの能力が制限されます。 。 能力。

図 1 SSR、RSR、および SED モジュールの構造比較

図 1 SSR、RSR、および SED モジュールの構造比較

上記の問題を考慮すると、考えられる解決策は、SSR モジュールの SS 畳み込みを RS 畳み込みに置き換えて、長距離特徴間の依存関係を捉えることです。この修正されたモジュールを標準スパース残差 (RSR) モジュールと呼び、その構造を図 1(b) に示します。図では、拡張されたフィーチャは、有効なフィーチャの近傍にある空のフィーチャです。 RS 畳み込みは、有効な特徴と拡散される特徴の両方を処理し、その畳み込みカーネルの中心がこれらの特徴領域を横断するため、出力特徴イメージのスパース性が低くなります。スタックド RS 畳み込みは、特徴マップのスパース性をより迅速に低減し、その結果、モデル効率が大幅に低下します。これは、既存の手法が通常、特徴ダウンサンプリングに RS 畳み込みを使用する理由でもあります。ここでは、拡張された特徴を拡散される特徴に変換する方が適切です。

SED モジュールと DED モジュール

SED モジュールの設計目標は、SSR モジュールの制限を克服することです。 SED モジュールは、特徴ダウンサンプリングを通じて遠く離れた特徴間の空間距離を短縮し、同時にマルチスケール特徴融合を通じて失われた詳細情報を復元します。図 1(c) は、2 つの特徴スケールを備えた SED モジュールの例を示しています。このモジュールでは、まず、特徴ダウンサンプリング (Down) にストライド 3 の 3x3 RS 畳み込みを使用します。特徴ダウンサンプリングの後、下部特徴マップ内の切り離された有効特徴は、中央の特徴マップおよび隣接する有効特徴に統合されます。次に、SSR モジュールを使用して中間特徴マップ上の特徴を抽出することにより、有効な特徴間の相互作用が実現されます。最後に、中間特徴マップがアップサンプリング (UP) されて、入力特徴マップの解像度と一致します。ここでは、サンプル特徴のみが入力特徴マップ内の有効な特徴に対応する領域にアップサンプリングされることに注意してください。したがって、SED モジュールは特徴マップのスパース性を維持できます。 SED モジュールの設計目標は、SSR モジュールの制限を克服することです。 SED モジュールは、特徴ダウンサンプリングを通じて遠く離れた特徴間の空間距離を短縮し、同時にマルチスケール特徴融合を通じて失われた詳細情報を復元します。図 1(c) は、2 つの特徴スケールを備えた SED モジュールの例を示しています。このモジュールでは、まず、特徴ダウンサンプリング (Down) にストライド 3 の 3x3 RS 畳み込みを使用します。特徴ダウンサンプリングの後、下部特徴マップ内の切り離された有効特徴は、中央の特徴マップおよび隣接する有効特徴に統合されます。次に、SSR モジュールを使用して中間特徴マップ上の特徴を抽出することにより、有効な特徴間の相互作用が実現されます。最後に、中間特徴マップがアップサンプリング (UP) されて、入力特徴マップの解像度と一致します。ここでは、サンプル特徴のみが入力特徴マップ内の有効な特徴に対応する領域にアップサンプリングされることに注意してください。したがって、SED モジュールは特徴マップのスパース性を維持できます。 SED モジュールの設計目標は、SSR モジュールの制限を克服することです。SED モジュールは、3 つの特徴的なスケールを持つ SED モジュールの具体的な実装を示しています。括弧内の数字は、入力特徴マップの解像度に対する対応する特徴マップの解像度の比率を表します。 SED モジュールは非対称コーデック構造を採用しており、エンコーダーを使用してマルチスケール特徴を抽出し、抽出されたマルチスケール特徴をデコーダーを通じて徐々に融合します。 SED モジュールは、RS コンボリューションを特徴ダウンサンプリング レイヤーとして使用し、スパース デコンボリューションを特徴アップサンプリング レイヤーとして使用します。 SED モジュールは、エンコーダー/デコーダー構造を使用することで、空間内の切断されたフィーチャ間の情報の相互作用を容易にし、それによってモデルが離れたフィーチャ間の依存関係をキャプチャできるようにします。

図 2 SED および DED モジュール構造 一方、現在主流の 3D 点群検出器は、予測のために主にオブジェクト中心特徴に依存していますが、スパース畳み込みネットワークによって抽出された特徴マップでは、オブジェクト中心領域が特に大きなオブジェクトには穴が存在します。この問題を解決するために、図 2(b) に構造を示す DED モジュールを提案します。 DED モジュールは SED モジュールと同じ構造を持ち、SED モジュールの SSR モジュールを Dense Residual (DR) モジュールに置き換え、特徴ダウンサンプリングに使用される RS 畳み込みをストライド 2 モジュールの DR に置き換え、スパース モジュールを置き換えます。高密度デコンボリューションによる特徴アップサンプリングのデコンボリューション。これらの設計により、DED モジュールはまばらな特徴をオブジェクトの中心領域に向かって効果的に拡散させることができます。

一方、現在主流の 3D 点群検出器は、予測のために主にオブジェクト中心特徴に依存していますが、スパース畳み込みネットワークによって抽出された特徴マップでは、オブジェクト中心領域が特に大きなオブジェクトには穴が存在します。この問題を解決するために、図 2(b) に構造を示す DED モジュールを提案します。 DED モジュールは SED モジュールと同じ構造を持ち、SED モジュールの SSR モジュールを Dense Residual (DR) モジュールに置き換え、特徴ダウンサンプリングに使用される RS 畳み込みをストライド 2 モジュールの DR に置き換え、スパース モジュールを置き換えます。高密度デコンボリューションによる特徴アップサンプリングのデコンボリューション。これらの設計により、DED モジュールはまばらな特徴をオブジェクトの中心領域に向かって効果的に拡散させることができます。

SEDモジュールとDEDモジュールに基づいて、階層型コーデックネットワークHEDNetを提案します。図 3 に示すように、HEDNet は 3D スパース バックボーン ネットワークを通じて高レベルのスパース特徴を抽出し、次に 2D デンス バックボーン ネットワークを通じてスパース特徴をオブジェクトの中心領域に拡散し、最後に 2D によって出力された特徴を送信します。タスク予測のための検出ヘッドへの高密度バックボーン ネットワーク。表現の便宜上、特徴マップとその後の特徴ダウンサンプリング層は図では省略されています。巨視的には、HEDNet は SECOND と同様の階層型ネットワーク構造を採用しており、その特徴マップの解像度は徐々に低下しますが、微視的には、HEDNet のコアコンポーネントである SED モジュールと DED モジュールは両方ともコーデック構造を採用しています。これが HEDNet という名前の由来です。

図 3 HEDNet 全体のフレームワーク

なぜコーデック構造の使用を考えるのでしょうか?実際、HEDNet は、以前の作品 CEDNet: A Cascade Encoder-Decoder Network for Dense Prediction (名前が変更される前は CFNet と呼ばれていました) からインスピレーションを受けています。ご興味がございましたら、私たちの論文をお読みください。

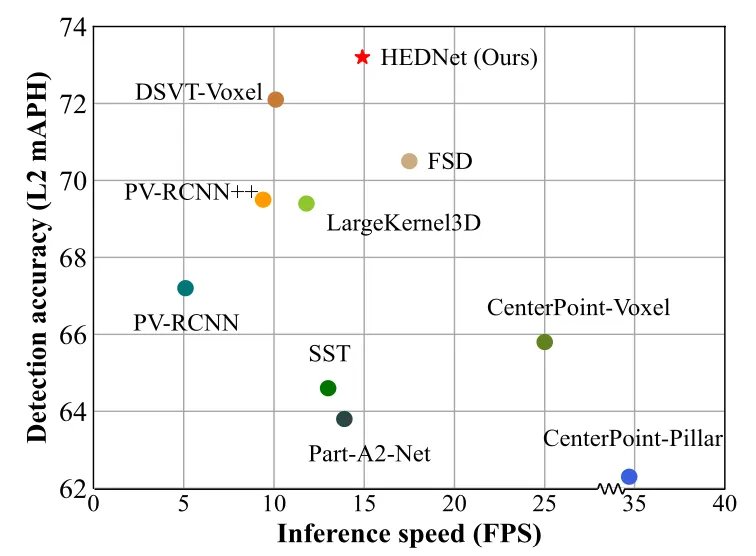

実験結果HEDNet の総合的なパフォーマンスを以前の主要な手法と比較しました。結果を図 4 に示します。大規模畳み込みカーネル CNN に基づく LargeKernel3D や Transformer に基づく DSVT-Voxel と比較して、HEDNet は検出精度とモデル推論速度の両方で優れた結果を達成します。以前の最先端の手法 DSVT と比較して、HEDNet はより高い検出精度を実現し、モデル推論速度が 50% 向上していることは注目に値します。より詳細な結果については、論文を参照してください。

図 4 Waymo Open データセットの包括的なパフォーマンス比較

This life - SAFDNet

研究の背景

ボクセルベースの手法は、通常、疎なボクセル特徴を密な特徴マップに変換し、その後、密な畳み込みニューラルを渡しますネットワークは予測のために特徴を抽出します。このタイプの検出器をハイブリッド検出器と呼び、その構造を図 5(a) に示します。このタイプの方法は、狭い範囲 (75 メートル未満) の検出シナリオではうまく機能しますが、検知範囲が拡大するにつれて、高密度の特徴マップを使用する計算コストが大幅に増加し、広い範囲 (200 メートル以上) での使用が制限されます。検出シナリオ。考えられる解決策は、既存のハイブリッド検出器の密な特徴マップを削除して純粋なスパース検出器を構築することですが、これはモデルの検出パフォーマンスの大幅な低下につながります。これは、現在、ほとんどのハイブリッド検出器がオブジェクト中心に依存しているためです。純粋なスパース検出器を使用して特徴を抽出する場合、通常、大きなオブジェクトの中心領域は空になります。これは、オブジェクト中心の特徴の欠落問題です。したがって、純粋にスパースな検出器を構築するには、適切なオブジェクト表現を学習することが重要です。

図 5 ハイブリッド検出器、FSDv1、SAFDNet の構造比較

物体中心特徴の欠落の問題を解決するために、FSDv1 (図 5(b)) は、まず元の点群を前景点と背景点に分割します。中心点投票メカニズムは、前景点をクラスター化し、初期予測のために各クラスターからインスタンスの特徴を抽出します。これは、グループ補正ヘッドを通じてさらに洗練されます。インスタンス フィーチャの手動抽出によってもたらされる誘導バイアスを軽減するために、FSDv2 では仮想ボクセル化モジュールを使用して、FSDv1 のインスタンス クラスタリング操作を置き換えます。 FSD シリーズの手法は、CenterPoint などの広く使用されている検出フレームワークとは大きく異なり、多数のハイパーパラメータが導入されているため、これらの手法を実際のシナリオに導入することが困難になります。 FSD シリーズの手法とは異なり、VoxelNeXt はオブジェクトの中心に最も近いボクセルの特徴に基づいて直接予測しますが、検出精度は犠牲になります。

では、私たちが求める純粋な疎点群検出器はどのようなものでしょうか?まず、実際のアプリケーションに直接導入できるように、構造が単純である必要があります。直感的なアイデアは、CenterPoint などの現在広く使用されているハイブリッド検出器アーキテクチャに基づいて純粋なスパース検出器を構築することです。少なくとも現在の主要なハイブリッド検出器に匹敵し、さまざまな範囲の検出シナリオに適用できる必要があります。

方法の紹介

上記の 2 つの要件から開始して、HEDNet に基づいて純粋なスパース 3D 点群オブジェクト検出器 SAFDNet を構築しました。そのマクロ構造は図 5(c) に示されています。 SAFDNet は、まずスパース ボクセル特徴エクストラクターを使用してスパース点群特徴を抽出し、次に適応特徴拡散 (AFD) 戦略と 2D スパース畳み込みニューラル ネットワークを使用してスパース フィーチャをオブジェクトの中心領域に拡散し、問題を解決します。オブジェクトの中心の問題、欠落した特徴の問題、そして最後に疎なボクセルの特徴に基づいた予測です。 SAFDNet は、スパースな特徴のみを使用して効率的な計算を実行でき、その構造設計とハイパーパラメータのほとんどはベースラインのハイブリッド検出器と一致しているため、実際のアプリケーション シナリオに適応して既存のハイブリッド検出器を置き換えることが容易になります。 SAFDNet の具体的な構造を以下に紹介します。

SAFDNet 全体のフレームワーク

図 6 は、SAFDNet の全体的なフレームワークを示しています。既存のハイブリッド検出器と同様に、SAFDNet は主に、3D スパース バックボーン ネットワーク、2D スパース バックボーン ネットワーク、スパース検出ヘッドの 3 つの部分で構成されます。 3D スパース バックボーン ネットワークは、3D スパース ボクセル フィーチャを抽出し、これらのフィーチャを 2D スパース BEV フィーチャに変換するために使用されます。 3D スパース バックボーン ネットワークは、3D-EDB モジュールを使用して、長距離フィーチャ間の情報対話を促進します (3D-EDB モジュールは、3D スパース コンボリューションに基づいて構築された SED モジュールであり、以下の 2D-EDB モジュールも同様です)。 2D スパース バックボーン ネットワークは、3D スパース バックボーン ネットワークによって出力されたスパース BEV フィーチャを入力として受け取り、まず各ボクセルを分類して、各ボクセルの幾何学的中心が特定のカテゴリのオブジェクト境界ボックス内にあるかどうか、またはカテゴリに属しているかどうかを判断します。次に、AFD 操作と 2D-EDB モジュールを通じて、まばらな特徴がオブジェクトの中心領域に拡散されます。この部分は SAFDNet のコア コンポーネントです。スパース検出ヘッドは、2D スパース バックボーン ネットワークによって出力されたスパース BEV 特徴に基づいて予測を行います。 SAFDNet は CenterPoint によって提案された検出ヘッド設計を採用しており、スパースな特徴に適応するためにそれにいくつかの調整を加えました。詳細については、論文を参照してください。

図 6 SAFDNet 全体のフレームワーク

図 6 SAFDNet 全体のフレームワーク

適応特徴拡散 (AFD)

LIDAR によって生成された点群は主にオブジェクトの表面に分布しているため、純粋なスパース検出器を使用して予測用の特徴を抽出すると、オブジェクト中心の特徴が欠落するという問題に直面します。それでは、検出器は、特徴のまばらさを可能な限り維持しながら、オブジェクトの中心に近い、または中心に位置する特徴を抽出できるでしょうか?直感的なアイデアは、まばらな特徴を隣接するボクセルに分散させることです。図 6(a) は、スパース フィーチャ マップの例を示しています。図内の赤い点は、オブジェクトの中心を表します。濃いオレンジ色の四角は、幾何学的中心が境界ボックス内にある空ではないボクセルを表します。濃い青色の四角形は空ではないボクセルで、その幾何学的中心はオブジェクトの境界ボックスの外側にあり、白い四角形は空のボクセルです。空ではない各ボクセルは、空ではないフィーチャに対応します。図 7(b) は、図 7(a) の空でないフィーチャを KxK (K は 5) の近傍に均一に拡散することによって得られます。拡散した空でないボクセルは、明るいオレンジ色または明るい青で表示されます。

図 7 均一特徴拡散と適応特徴拡散の概略図

図 7 均一特徴拡散と適応特徴拡散の概略図

3D スパース バックボーン ネットワークによって出力されたスパース特徴マップを分析することにより、次のことが観察されます: (a) ボクセルの 10% 未満が境界ボックス内に収まる(b) 小さなオブジェクトには、通常、中心ボクセルの近くまたはその上に非ヌル フィーチャがあります。この観察は、特に小さなオブジェクト境界ボックス内および背景領域内のボクセルの場合、すべての非ヌル特徴を同じサイズのドメインに分散する必要がない可能性があることを示唆しています。したがって、ボクセル特徴の位置に基づいて拡散範囲を動的に調整する適応特徴拡散戦略を提案します。図 7(c) に示すように、この戦略では、大きなオブジェクトのバウンディング ボックス内のボクセル フィーチャをオブジェクトの中心に近づけます。これは、これらのフィーチャにより大きな拡散範囲を割り当てると同時に、バウンディング ボックス内にボクセル フィーチャを割り当てることによって行われます。小さなオブジェクトと背景領域のボクセル フィーチャには、フィーチャのまばらさを可能な限り維持するために、より小さい拡散範囲が割り当てられます。この戦略を実装するには、空でないボクセルの幾何学的中心がオブジェクトの特定のカテゴリの境界ボックス内にあるか、背景領域に属しているかを判断するためにボクセル分類 (ボクセル分類) が必要です。ボクセル分類の詳細については、論文を参照してください。適応特徴拡散戦略を使用することにより、検出器は特徴の疎性を可能な限り維持することができるため、疎な特徴の効率的な計算の恩恵を受けることができます。

主な実験結果

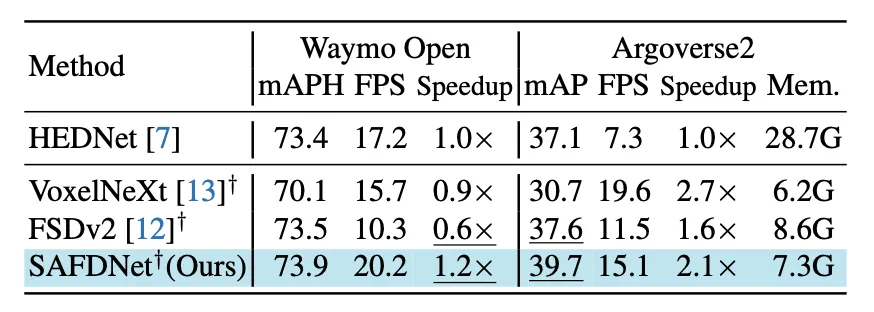

総合的なパフォーマンスの観点から SAFDNet をこれまでの最良の手法と比較しました。結果を図 8 に示します。検出範囲が狭い Waymo Open データセットでは、SAFDNet は、これまで最高の純粋なスパース検出器 FSDv2 と私たちが提案したハイブリッド検出器 HEDNet と同等の検出精度を達成しましたが、SAFDNet の推論速度は FSDv2 の 2 倍、HEDNet の 1.2 倍でした。検出範囲が広い Argoverse2 データセットでは、純粋なスパース検出器 FSDv2 と比較して、SAFDNet は指標 mAP を 2.1% 向上させ、ハイブリッド検出器 HEDNet と比較して推論速度は 1.3 倍に達しました。 mAP は 2.6% 増加し、推論速度は HEDNet の 2.1 倍に達しました。さらに、検出範囲が広い場合、ハイブリッド検出器 HEDNet のメモリ消費量は純粋なスパース検出器のメモリ消費量よりもはるかに大きくなります。要約すると、SAFDNet はさまざまな範囲の検出シナリオに適しており、優れたパフォーマンスを備えています。

図 8 主な実験結果

今後の課題

SAFDNet は純粋な疎点群検出器のソリューションですが、問題はありますか?実際、SAFDNet は、純粋なスパース検出器という私たちのアイデアの中間生成物にすぎず、乱暴すぎて、十分に簡潔でエレガントではないと思います。今後の作品にもご期待ください!

HEDNet と SAFDNet のコードはオープンソースであり、誰でも自由に使用できます。リンクはこちらです: https://github.com/zhanggang001/HEDNet

以上がCVPR\'24 口頭 | 純粋な疎点群検出器 SAFDNet の過去と現在の様子を見てみましょう。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。