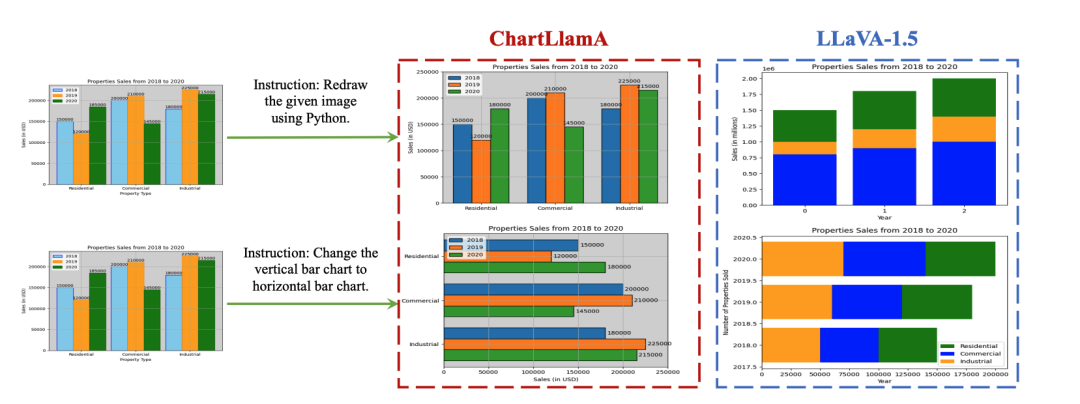

Maison >Périphériques technologiques >IA >Compréhension approfondie des graphiques : ChartLlama, géants des graphiques open source tels que Tencent et Nanyang Polytechnic

Compréhension approfondie des graphiques : ChartLlama, géants des graphiques open source tels que Tencent et Nanyang Polytechnic

- 王林avant

- 2023-12-03 11:22:481601parcourir

Dans le domaine de la compréhension d'images, les grands modèles multimodaux ont pleinement démontré leurs excellentes performances. Cependant, il reste encore des améliorations à apporter aux modèles multimodaux existants pour la compréhension des diagrammes et les tâches de génération qui sont souvent traitées dans le cadre du travail.

Bien que les modèles de pointe actuels dans le domaine de la compréhension des graphes fonctionnent bien sur des ensembles de tests simples, ils sont incapables de gérer des tâches de questions et réponses plus complexes en raison de leur manque de compréhension du langage et de capacités de sortie. D’un autre côté, les performances des grands modèles multimodaux entraînés sur la base de grands modèles de langage sont également insatisfaisantes, principalement en raison de leur manque d’échantillons d’entraînement pour les graphiques. Ces problèmes ont sérieusement limité la progression continue des modèles multimodaux dans les tâches de compréhension et de génération de graphiques

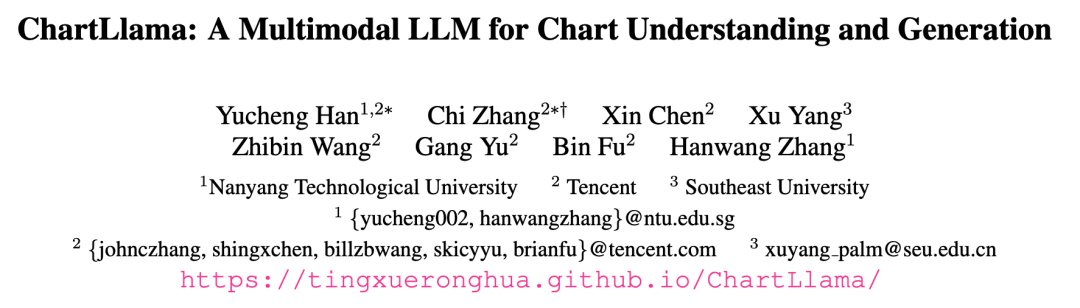

Récemment, Tencent, l'Université technologique de Nanyang et l'Université du Sud-Est ont proposé ChartLlama. L’équipe de recherche a créé un ensemble de données graphiques de haute qualité et formé un modèle de langage multimodal à grande échelle axé sur la compréhension des graphiques et les tâches de génération. ChartLlama combine plusieurs fonctions telles que le traitement du langage et la génération de graphiques pour fournir un outil de recherche puissant aux chercheurs scientifiques et aux professionnels associés.

Adresse papier : https://arxiv.org/abs/2311.16483

Adresse de la page d'accueil : https://tingxueronghua.github.io/ChartLlama/

L'équipe ChartLlama a conçu un Une stratégie intelligente de collecte de données diversifiées qui utilise GPT-4 pour générer des données avec des thèmes, des distributions et des tendances spécifiques afin de garantir la diversité de l'ensemble de données. L'équipe a combiné des bibliothèques de traçage open source avec les capacités de programmation de GPT-4 pour écrire un code graphique précis afin de produire des représentations graphiques précises des données. De plus, l'équipe utilise également GPT-4 pour décrire le contenu du graphique et générer des paires de questions et réponses, générant des échantillons de formation riches et diversifiés pour chaque graphique afin de garantir que le modèle formé peut pleinement comprendre le graphique

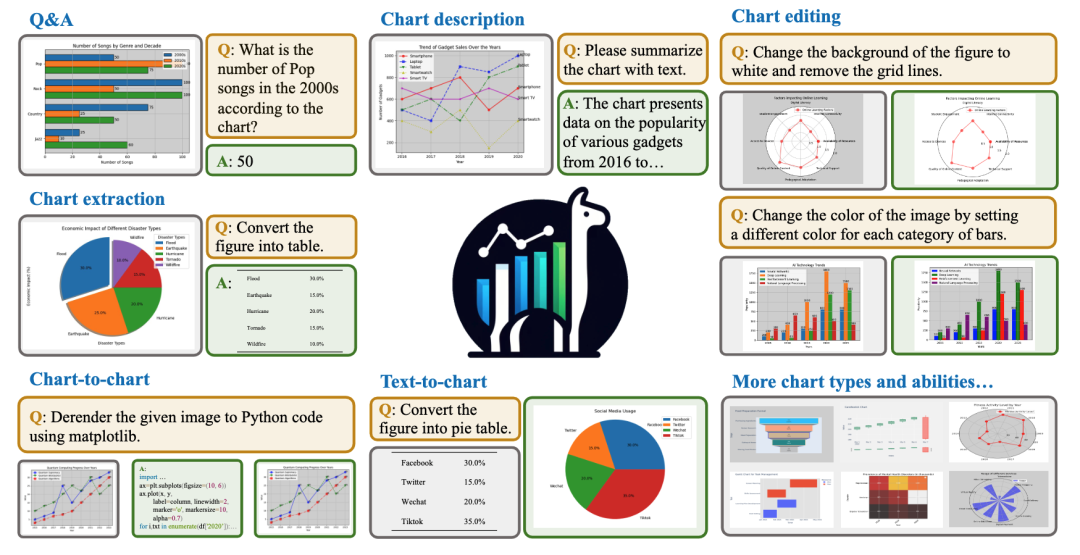

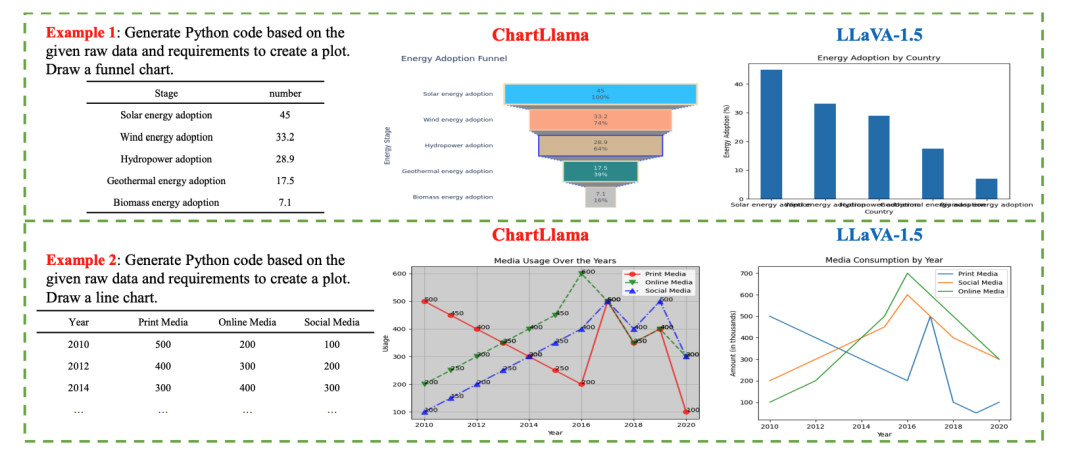

Dans le domaine de la compréhension des graphiques, les modèles traditionnels ne peuvent répondre qu'à quelques questions simples, telles que des tâches simples de questions et réponses telles que la lecture de chiffres, et ne peuvent pas répondre à des questions plus complexes. Ces modèles ont du mal à suivre de longues instructions et commettent souvent des erreurs dans les questions et réponses impliquant des opérations mathématiques. En revanche, ChartLlama peut efficacement éviter ces problèmes. La comparaison spécifique est la suivante :

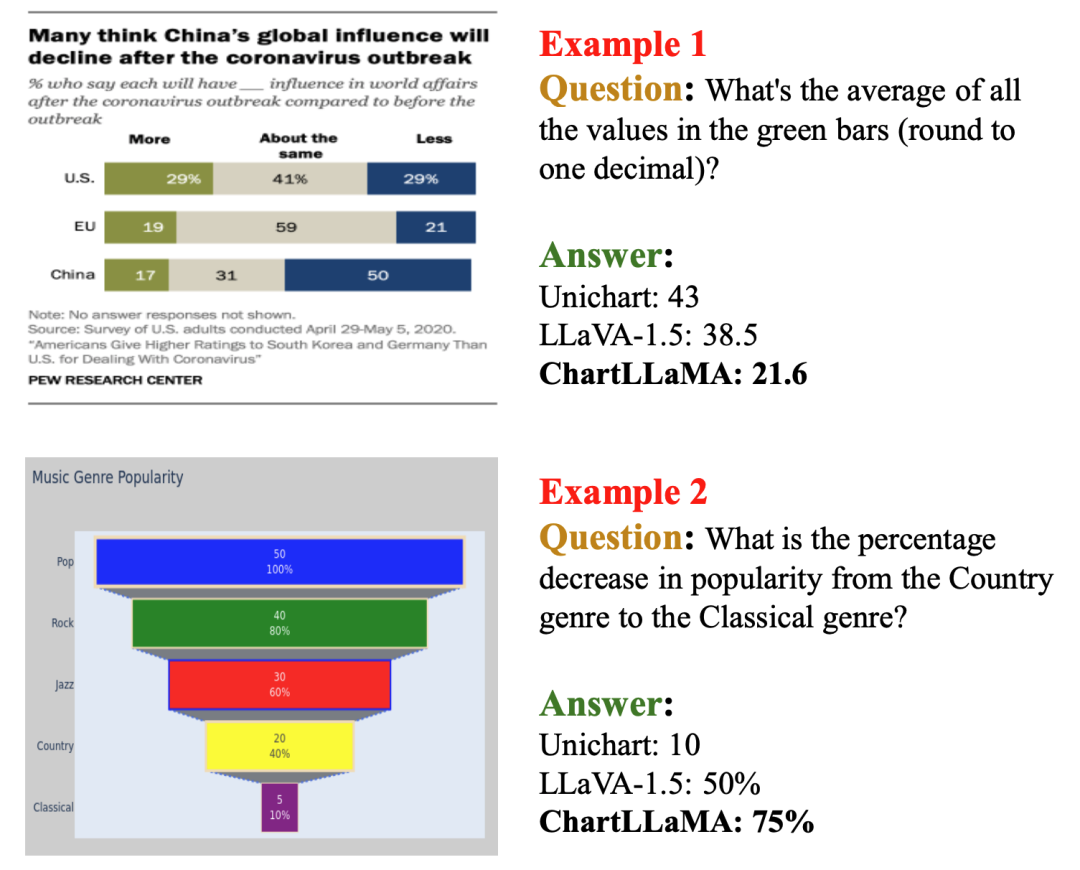

En plus des tâches traditionnelles, l'équipe de recherche a également défini plusieurs nouvelles tâches, dont trois tâches impliquant la génération de graphiques. Le document fournit des exemples pertinents :

Étant donné un graphique et des instructions, des exemples de reconstruction et d'édition de graphiques

Étant donné un graphique et des instructions, des exemples de reconstruction et d'édition de graphiques

Le processus de génération d'exemples de graphiques est basé sur des instructions et des données brutes

ChartLlama effectue bien sur divers ensembles de données de référence, atteignant des performances de pointe tout en nécessitant moins de données d'entraînement. Il adopte une méthode flexible de génération et de collecte de données, élargit considérablement les types de graphiques et les types de tâches dans les tâches de compréhension et de génération de graphiques, et favorise le développement du domaine

Aperçu de la méthode

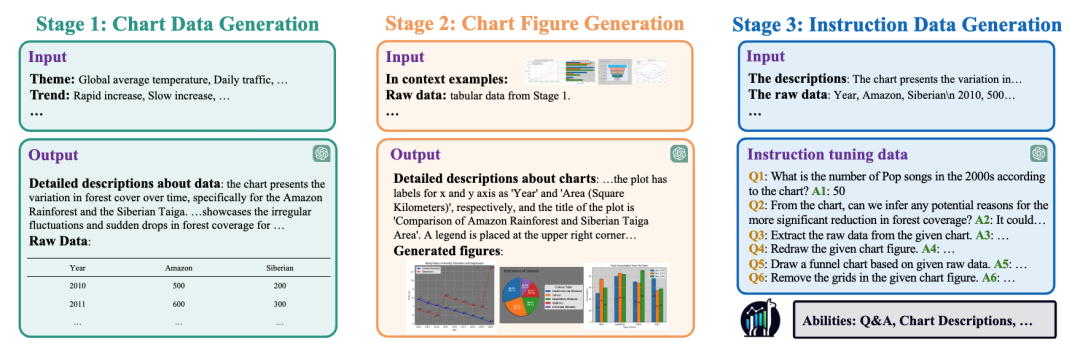

ChartLlama a conçu une collecte de données flexible méthodes, tirant parti du langage puissant et des capacités de programmation de GPT-4 pour créer de riches ensembles de données graphiques multimodaux. La collecte de données de

ChartLlama comprend trois étapes principales :

- Génération de données graphiques : ChartLlama collecte non seulement des données à partir de sources de données traditionnelles, mais exploite également la puissance de GPT-4 pour générer des données synthétiques. GPT-4 est guidé pour produire des données graphiques diverses et équilibrées en fournissant des fonctionnalités spécifiques telles que des sujets, des distributions et des tendances. Étant donné que les données générées contiennent des caractéristiques de distribution de données connues, cela rend la construction de données d'instructions plus flexible et plus diversifiée.

- Génération de graphiques : Ensuite, en utilisant les puissantes capacités de programmation de GPT-4, utilisez des bibliothèques open source (telles que Matplotlib) pour écrire des scripts de dessin de graphiques basés sur les données et les documents de fonctions générés, et générez une série de graphiques soigneusement graphiques rendus. Étant donné que le dessin de graphiques est entièrement basé sur des outils open source, cet algorithme peut générer davantage de types de graphiques pour la formation. Par rapport aux ensembles de données existants, tels que ChatQA, qui ne prend en charge que trois types de graphiques, l'ensemble de données créé par ChartLlama prend en charge jusqu'à 10 types de graphiques et peut être arbitrairement étendu.

-

Génération de données d'instruction : en plus du rendu du graphique, ChartLlama utilise en outre GPT-4 pour décrire le contenu du graphique et construire une variété de données de questions et réponses afin de garantir que le modèle formé peut pleinement comprendre le graphique. Ce corpus complet adapté aux instructions intègre du texte narratif, des paires de questions-réponses et du code source ou modifié pour les diagrammes. Les ensembles de données précédents ne prenaient en charge que 1 à 3 tâches de compréhension de graphiques, tandis que ChartLlama prend en charge jusqu'à 10 tâches de compréhension et de génération de graphiques, ce qui peut mieux aider à former de grands modèles graphiques et de texte pour comprendre les informations contenues dans les icônes

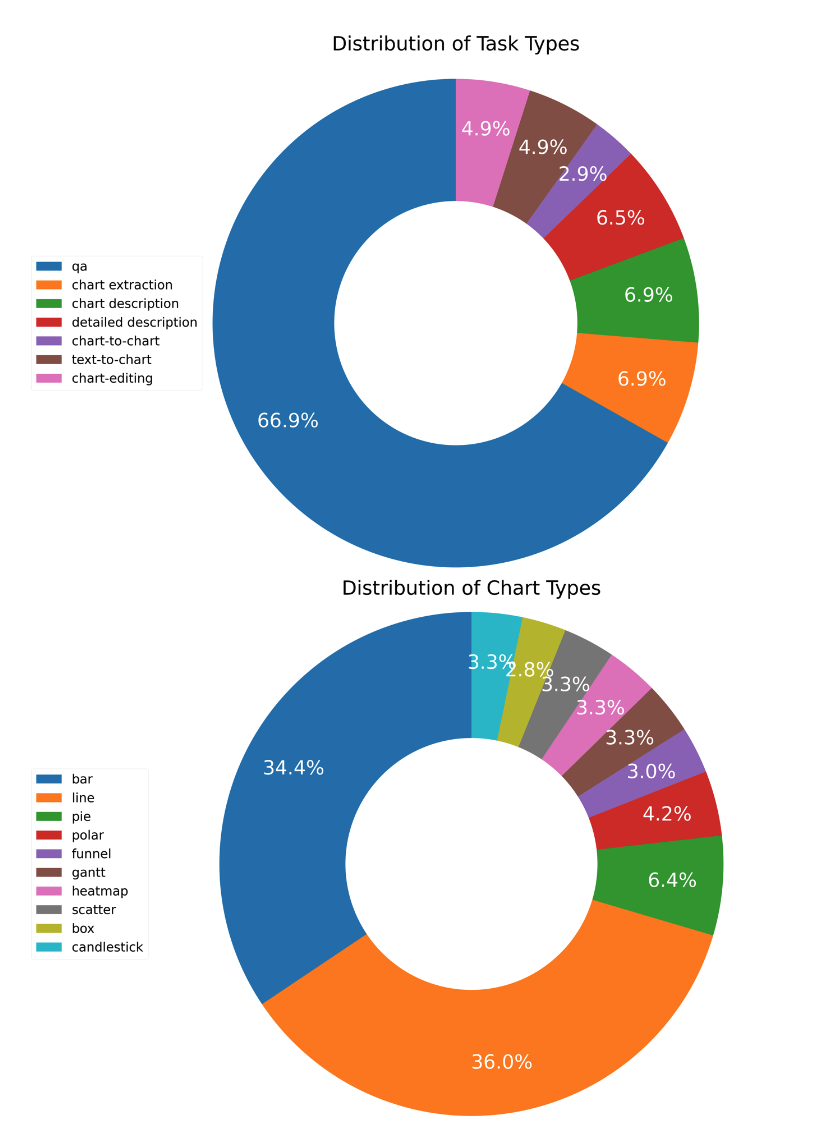

En utilisant les étapes ci-dessus, ChartLlama a créé un ensemble de données contenant plusieurs tâches et plusieurs types de graphiques. Les proportions des différents types de tâches et de graphiques dans l'ensemble total de données sont les suivantes :

Veuillez vous référer au texte original de l'article pour des instructions et des instructions plus détaillées

Résultats expérimentaux

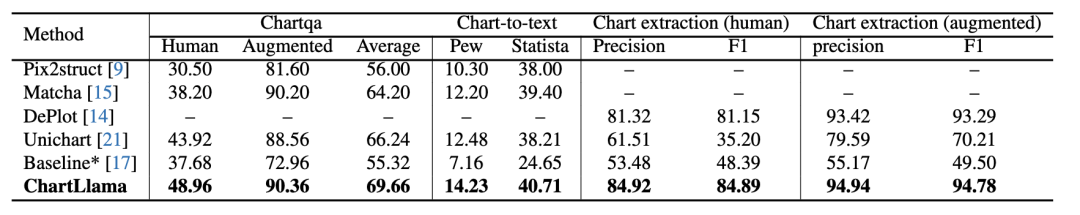

Qu'elle soit traditionnelle Que la tâche soit nouvelle ou nouvelle, ChartLlama affiche les meilleures performances. Les tâches traditionnelles incluent les questions et réponses sur les graphiques, le résumé des graphiques et l'extraction de données structurées des graphiques. En comparant ChartLlama avec les modèles de pointe précédents, les résultats sont présentés dans la figure ci-dessous :

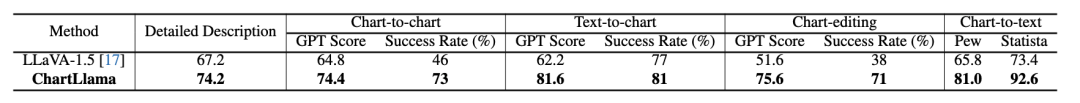

Les chercheurs ont également évalué les capacités de tâches uniques de ChartLlama, notamment la génération de code de graphique, la synthèse de graphiques et l'édition de graphiques. Ils ont également créé un ensemble de tests pour la tâche correspondante et l'ont comparé à LLaVA-1.5, le modèle graphique et textuel open source le plus puissant actuellement. Voici les résultats :

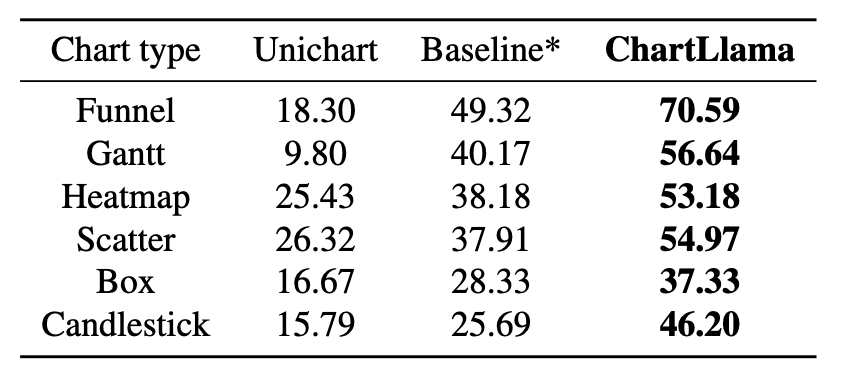

L'équipe de recherche a testé la précision des questions-réponses de ChartLlama dans une variété de différents types de graphiques et l'a comparée au modèle SOTA précédent d'Unichart et au modèle de base proposé. Les résultats sont les suivants :

Dans l'ensemble, ChartLlama repousse non seulement les limites de l'apprentissage multimodal, mais fournit également des outils plus précis et efficaces pour la compréhension et la génération de graphiques. Que ce soit dans la rédaction académique ou les présentations d'entreprise, ChartLlama rendra la compréhension et la création de graphiques plus intuitives et efficaces, franchissant ainsi une étape importante dans la génération et l'interprétation de données visuelles complexes.

Les lecteurs intéressés peuvent consulter le texte original de l'article pour plus de contenu de recherche

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Quelques projets open source PHP intéressants sur GitHub

- Dans le modèle de référence ISO/OSI, quelles sont les principales fonctions de la couche réseau ?

- Quels sont les trois éléments d'un modèle de données ?

- Quels sont les quatre modèles courants de développement de logiciels ?

- Le langage Go est-il open source ?