Maison >Périphériques technologiques >IA >Déplacez l'image là où vous la peignez ! La nouvelle fonctionnalité de Gen-2 « Magic Pen Ma Liang » est devenue populaire auprès des internautes : Urgent Urgent Urgent Urgent

Déplacez l'image là où vous la peignez ! La nouvelle fonctionnalité de Gen-2 « Magic Pen Ma Liang » est devenue populaire auprès des internautes : Urgent Urgent Urgent Urgent

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-11-13 08:14:11819parcourir

L'IA peut générer des vidéos, est-elle développée à ce stade ? !

Faites simplement glisser votre doigt sur une photo pour faire bouger la cible sélectionnée !

Évidemment, c'était un camion à l'arrêt, mais dès qu'il a été brossé, il a immédiatement commencé à voler, et même la lumière et l'ombre étaient parfaitement reproduites

Cette photo n'était à l'origine qu'une photo d'incendie, mais maintenant, il suffit d'un coup de pinceau aléatoire. Brossez, les flammes monteront dans le ciel et la chaleur vous frappera le visage

Si vous continuez comme ça, il sera difficile de faire la distinction entre les photos et les vidéos réelles !

Il s'agit d'une toute nouvelle fonction créée par Runway pour le logiciel vidéo AI Gen-2 Grâce à l'opération de peinture et de brossage, les objets de l'image peuvent être amenés à bouger. stylo magique Ma Liang

Bien qu'il ne s'agisse que d'un aperçu de fonction Chaud, mais dès que l'effet est sorti, il est devenu un succès sur Internet :

Les internautes se sont transformés un à un en rois anxieux, disant "peut" "J'ai hâte de l'essayer" :

Piste également Plus d'effets d'échauffement de fonction ont été publiés, jetons un coup d'œil ensemble

Les photos peuvent être transformées en vidéos et vous pouvez vous déplacer là où vous le souhaitez. La nouvelle fonctionnalité de Runway s'appelle

Motion Brush(Motion Brush). Comme son nom l'indique, il vous suffit d'utiliser ce pinceau pour « peindre » tous les objets de l'image afin de les faire bouger.

Non seulement il peut s'agir d'une personne immobile, même les mouvements de la jupe et de la tête sont très naturels

Il peut aussi s'agir d'un liquide qui coule comme une cascade, et même la brume peut être restaurée :

Il peut aussi s'agir d'un liquide qui coule comme une cascade, et même la brume peut être restaurée :

Ou une Une cigarette qui n'a pas été éteinte :

Ou une Une cigarette qui n'a pas été éteinte :

Un feu de joie allumé devant tout le monde :

Un feu de joie allumé devant tout le monde :

Des arrière-plans plus grands peuvent également être dynamisés, et même modifier les effets de lumière et d'ombre de l'image, comme comme un Wuyun se déplaçant rapidement :

Des arrière-plans plus grands peuvent également être dynamisés, et même modifier les effets de lumière et d'ombre de l'image, comme comme un Wuyun se déplaçant rapidement :

Bien sûr, ce qui précède n'est qu'une déclaration claire de Runway, ils vous disent de manière proactive qu'ils ont effectué un certain traitement sur les photos

Bien sûr, ce qui précède n'est qu'une déclaration claire de Runway, ils vous disent de manière proactive qu'ils ont effectué un certain traitement sur les photos

Les vidéos suivantes sans traces de maculage n'ont presque aucune trace. Modifications de l'IA du tout. Les ingrédients à l'intérieur :

Une série d'effets a explosé, ce qui a également fait que la fonction n'est pas encore officiellement publiée.

Une série d'effets a explosé, ce qui a également fait que la fonction n'est pas encore officiellement publiée.

Beaucoup de gens essaient de comprendre comment cette fonctionnalité est implémentée. Certains internautes s'inquiètent davantage de la date de sortie de cette fonctionnalité, espérant trouver le lien directement sur 321 (tête de chien manuelle)

Vous pouvez l'attendre avec impatience, il y a effectivement beaucoup de bonnes nouvelles

Vous pouvez l'attendre avec impatience, il y a effectivement beaucoup de bonnes nouvelles

De plus , Runway a également lancé D'autres nouvelles fonctionnalités ont été ajoutées

La récente série de progrès dans la génération d'IA semble indiquer que le domaine de la génération vidéo semble être sur le point d'inaugurer une explosion technologique.

Les vidéos générées par l'IA vont vraiment augmenter ?

Ces derniers jours, certains internautes ont découvert une nouvelle méthode populaire du logiciel d'animation Vincent Animatediff

Il ne faut que 7 secondes pour générer une vidéo animée de 16 images en la combinant avec la dernière recherche LCM-LORA time .

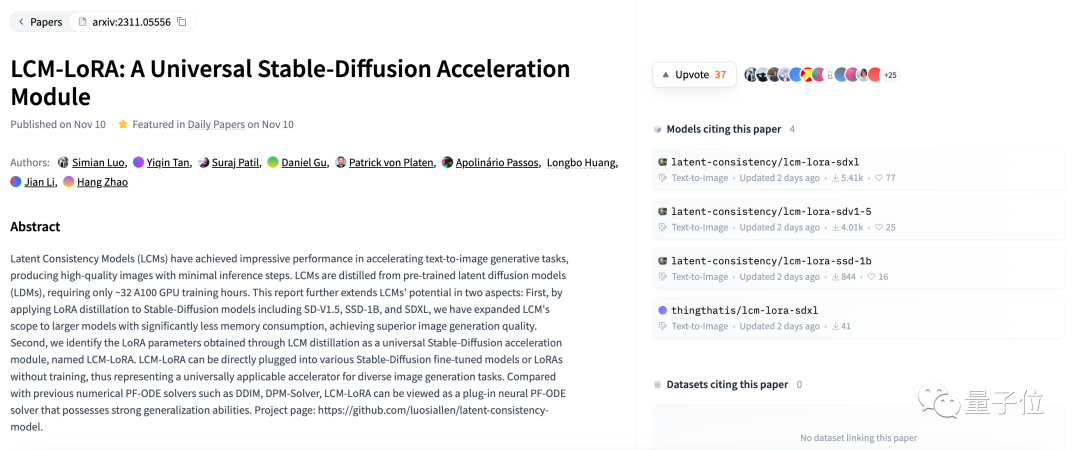

LCM-LORA est la dernière technologie de génération d'images IA lancée par BGI et Hugging Face, qui peut améliorer considérablement la vitesse de génération d'images de Stable Diffusion

Parmi eux, LCM (Latent Consistency Models) est basé sur le « modèle de cohérence » d'OpenAI plus tôt cette année "Une nouvelle méthode de génération d'images proposée qui peut générer rapidement des images haute résolution 768×768.

Cependant, le LCM n'est pas compatible avec les modèles existants, c'est pourquoi les membres de l'Université Tsinghua et de Huopuolian ont publié une nouvelle version du modèle LCM-LORA, qui est compatible avec tous les modèles à diffusion stable et accélère la vitesse de dessin.

Combiné au logiciel Animatediff, il ne faut que 7 secondes environ pour générer une telle animation :

Actuellement, LCM-LORA est open source sur Huohuangface.

Que pensez-vous des récents progrès de la génération de vidéos IA, et dans quelle mesure est-elle encore utilisable ?

Lien de référence :

[1]https://twitter.com/runwayml/status/1723033256067489937.

[2]https://twitter.com/op7418/status/1723016460220735748.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- 'À mi-parcours dans le domaine de la vidéo' ! Le travail de test bêta interne de la recrue de génération vidéo AI Gen-2 a été divulgué, les internautes ont déclaré que c'était trop réaliste

- La société d'IA Runway Video Editor Gen-2 démarre un essai gratuit et peut générer des vidéos basées sur des mots d'invite

- La communauté MoDa lance l'outil de génération vidéo AI Live Portait, qui peut faire parler les photos en un seul clic

- La technologie de génération vidéo IA a progressé à pas de géant : la qualité des films haute définition peut être appréciée gratuitement et est connue comme « la plus puissante de l'histoire »