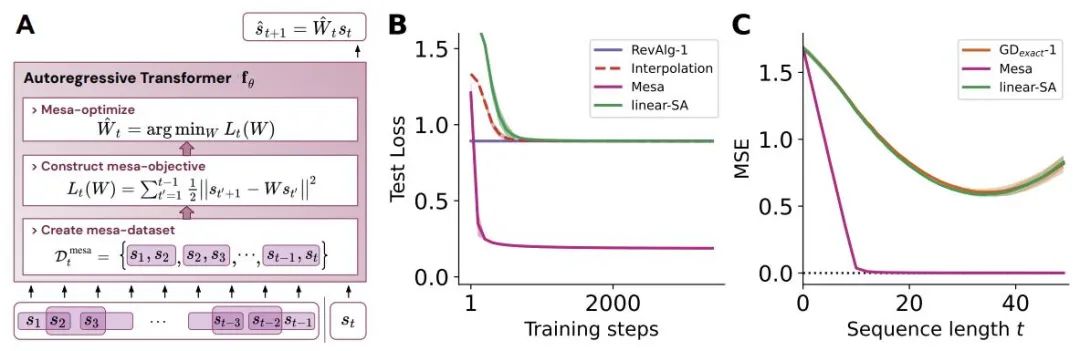

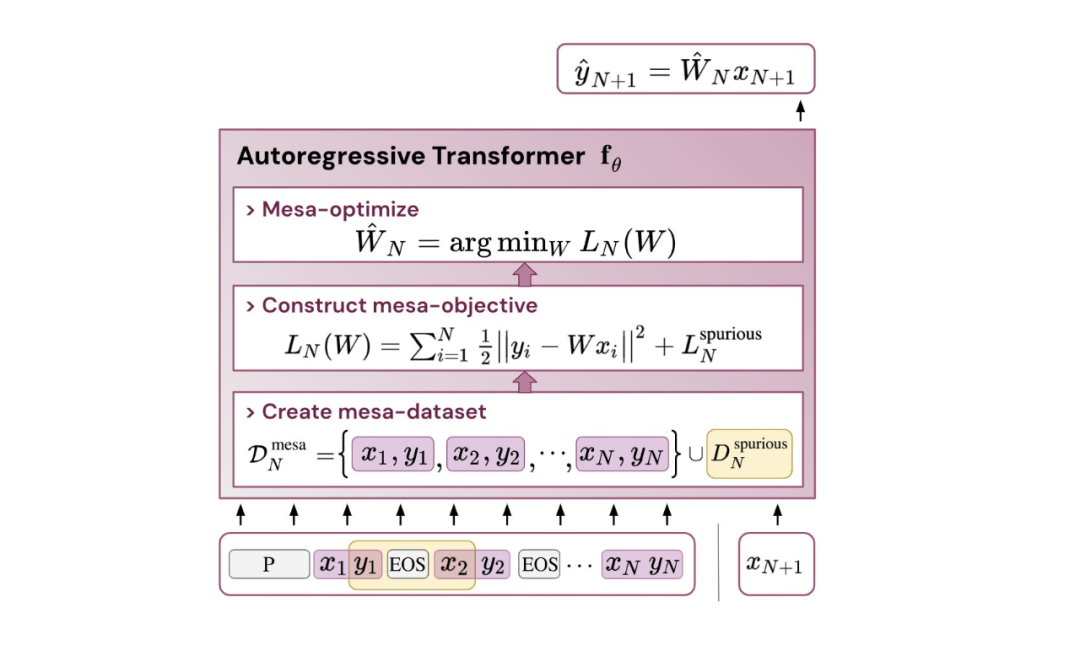

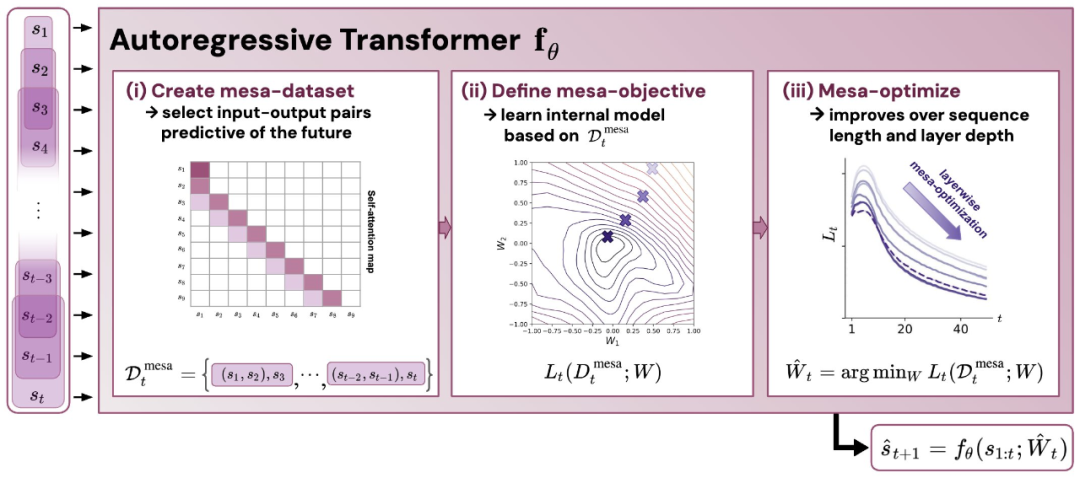

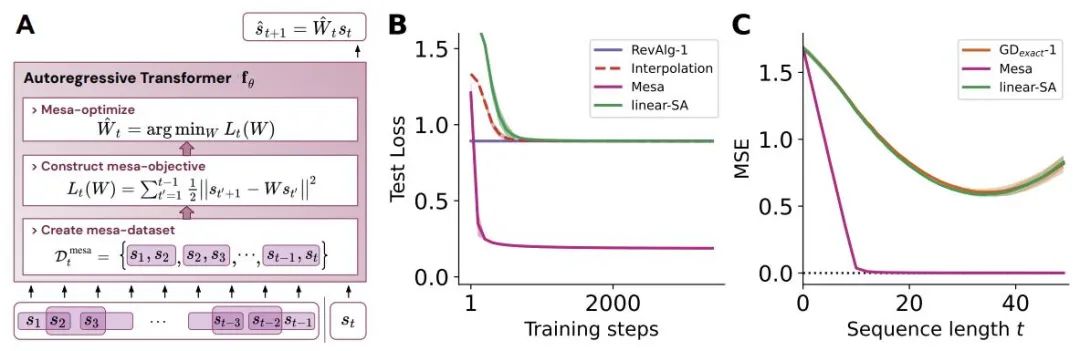

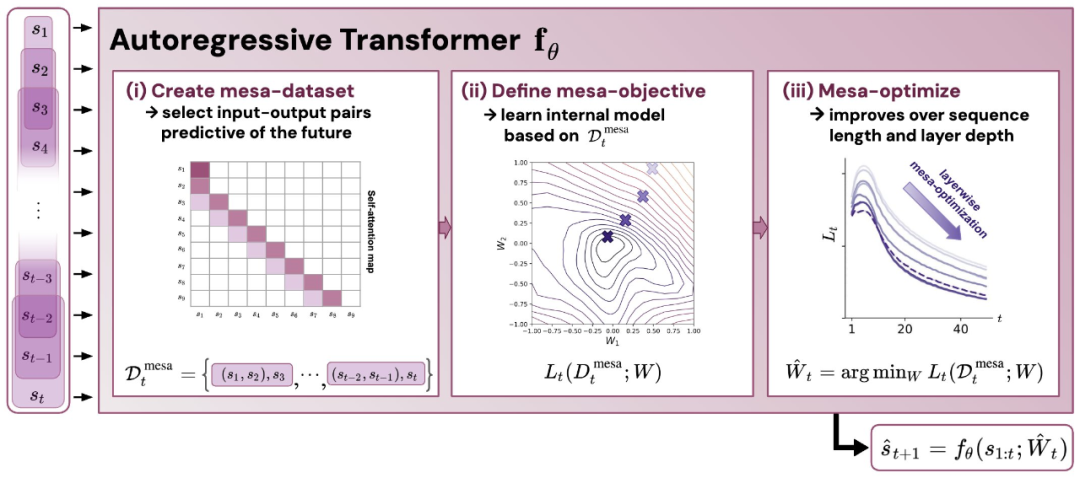

Pourquoi le transformateur fonctionne-t-il si bien ? D'où vient la capacité d'apprentissage en contexte qu'elle apporte à de nombreux grands modèles de langage ? Dans le domaine de l’intelligence artificielle, le transformateur est devenu le modèle dominant en matière d’apprentissage profond, mais les bases théoriques de ses excellentes performances n’ont pas été suffisamment étudiées. Récemment, de nouvelles recherches menées par des chercheurs de Google AI, de l'ETH Zurich et de Google DeepMind ont tenté de révéler la réponse au mystère. Dans le cadre de nouvelles recherches, ils ont procédé à une ingénierie inverse du transformateur et trouvé des méthodes d'optimisation. Article « Découvrir les algorithmes de mésa-optimisation dans Transformers » :  lien de l'article : https://arxiv.org/abs/2309.05858 L'auteur prouve que la minimisation de la perte autorégressive générale se produira lors de la passe avant de Transformer Algorithme d'optimisation auxiliaire basé sur le gradient exécuté dans . Ce phénomène a récemment été appelé « mésa-optimisation ». En outre, les chercheurs ont découvert que l’algorithme d’optimisation mesa résultant présentait des capacités d’apprentissage contextuel à petite échelle, indépendamment de la taille du modèle. Les nouveaux résultats complètent donc les principes d’apprentissage à petite échelle qui ont émergé précédemment dans les grands modèles de langage. Les chercheurs estiment que le succès de Transformers repose sur son parti pris architectural dans la mise en œuvre de l'algorithme d'optimisation mesa dans la passe avant : (i) définir des objectifs d'apprentissage internes, et (ii) les optimiser. ♥ . En tant que séquence d'entrée s_1, . . , s_t est traité au pas de temps t, Transformer (i) crée un ensemble d'entraînement interne composé de paires d'associations entrée-cible, (ii) définit une fonction objectif interne via l'ensemble de données de résultat, qui est utilisé pour mesurer les performances du modèle interne en utilisant les poids W, (iii) Optimiser cet objectif et utiliser le modèle appris pour générer des prédictions futures

lien de l'article : https://arxiv.org/abs/2309.05858 L'auteur prouve que la minimisation de la perte autorégressive générale se produira lors de la passe avant de Transformer Algorithme d'optimisation auxiliaire basé sur le gradient exécuté dans . Ce phénomène a récemment été appelé « mésa-optimisation ». En outre, les chercheurs ont découvert que l’algorithme d’optimisation mesa résultant présentait des capacités d’apprentissage contextuel à petite échelle, indépendamment de la taille du modèle. Les nouveaux résultats complètent donc les principes d’apprentissage à petite échelle qui ont émergé précédemment dans les grands modèles de langage. Les chercheurs estiment que le succès de Transformers repose sur son parti pris architectural dans la mise en œuvre de l'algorithme d'optimisation mesa dans la passe avant : (i) définir des objectifs d'apprentissage internes, et (ii) les optimiser. ♥ . En tant que séquence d'entrée s_1, . . , s_t est traité au pas de temps t, Transformer (i) crée un ensemble d'entraînement interne composé de paires d'associations entrée-cible, (ii) définit une fonction objectif interne via l'ensemble de données de résultat, qui est utilisé pour mesurer les performances du modèle interne en utilisant les poids W, (iii) Optimiser cet objectif et utiliser le modèle appris pour générer des prédictions futures

.  Les contributions de cette étude comprennent : Généralise la théorie de von Oswald et al et montre comment les Transformers peuvent théoriquement optimiser les objectifs construits en interne en utilisant des méthodes basées sur le gradient à partir de la régression prédisant le élément suivant de la séquence.

Les contributions de cette étude comprennent : Généralise la théorie de von Oswald et al et montre comment les Transformers peuvent théoriquement optimiser les objectifs construits en interne en utilisant des méthodes basées sur le gradient à partir de la régression prédisant le élément suivant de la séquence. Des transformateurs expérimentés par ingénierie inverse se sont entraînés sur des tâches de modélisation de séquence simples et ont trouvé des preuves solides que leur passe avant implémente un algorithme en deux étapes : (i) une couche d'auto-attention précoce via des marqueurs de regroupement et de copie construit l'ensemble de données de formation interne, donc l'ensemble de données de formation interne est construit implicitement. Définir les fonctions d'objectif internes et (ii) optimiser ces objectifs à un niveau plus profond pour générer des prédictions.

-

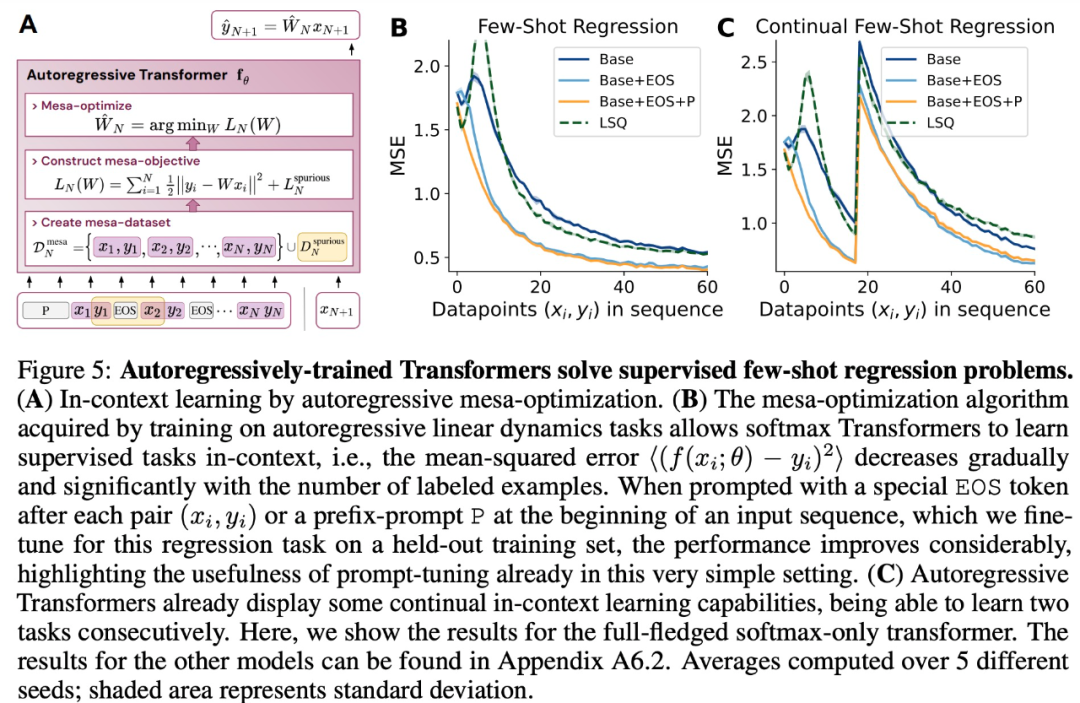

Semblable au LLM, les expériences montrent que de simples modèles de formation autorégressive peuvent également devenir des apprenants contextuels, et les ajustements à la volée sont cruciaux pour améliorer l'apprentissage contextuel du LLM et peuvent également améliorer les performances dans des environnements spécifiques.

-

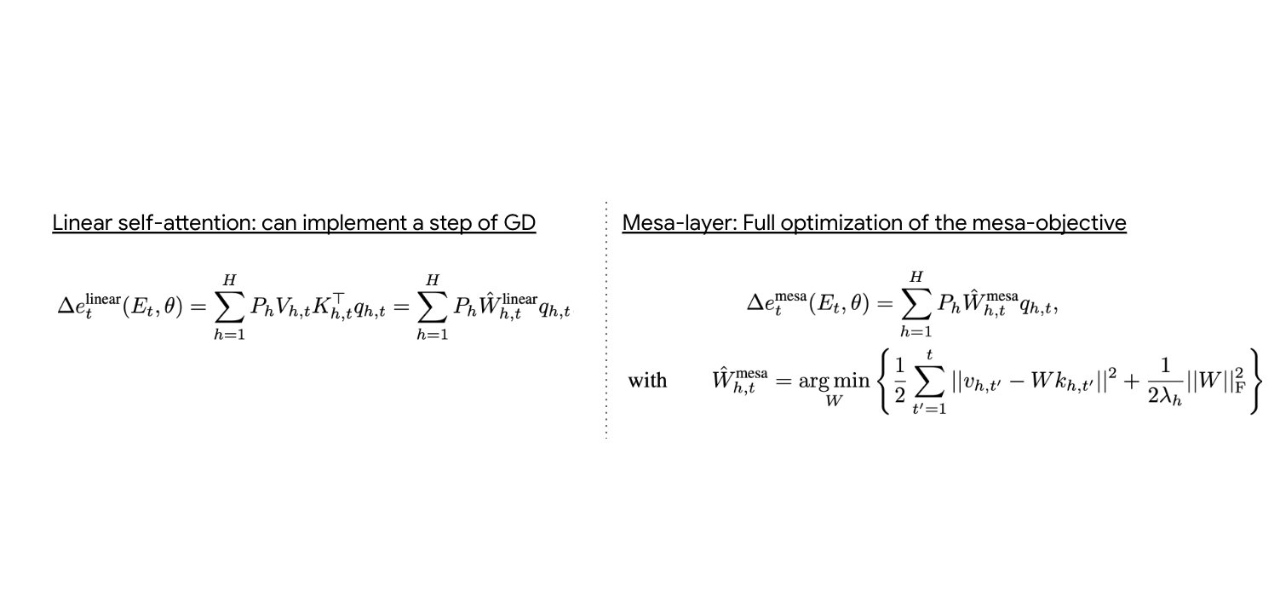

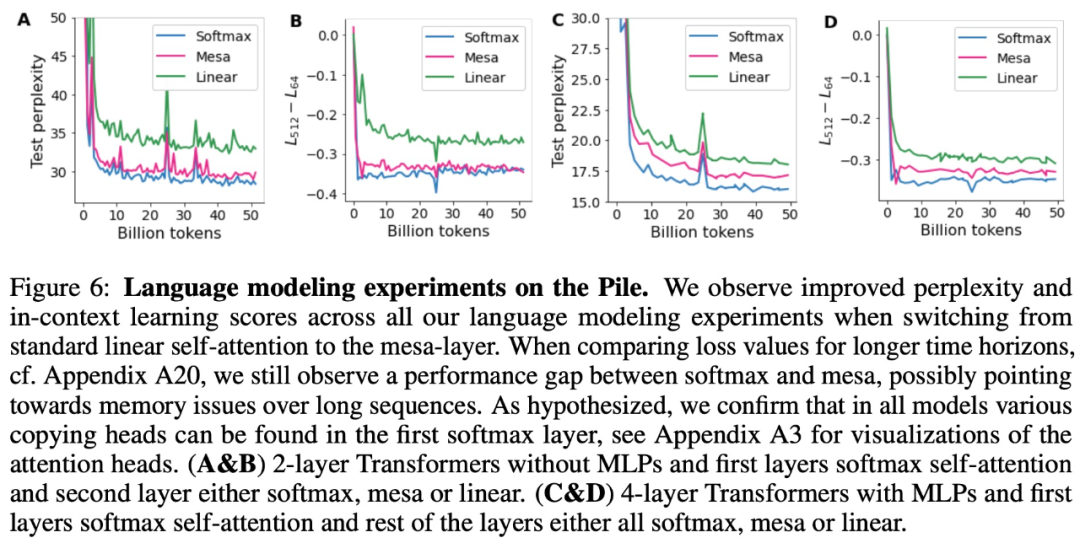

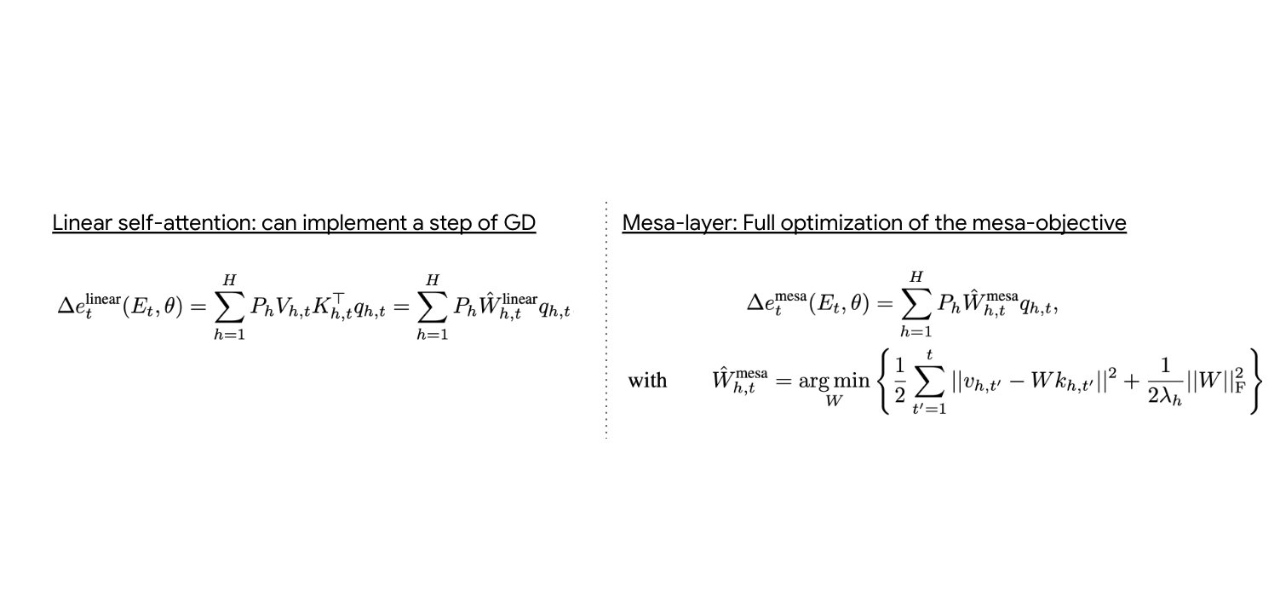

Inspiré par la découverte selon laquelle les couches d'attention tentent d'optimiser implicitement la fonction objectif interne, l'auteur présente la couche mesa, un nouveau type de couche d'attention qui peut résoudre efficacement le problème d'optimisation des moindres carrés au lieu de simplement prendre une seule étape de gradient. pour atteindre l’optimalité. Les expériences démontrent qu'une seule couche mesa surpasse les transformateurs d'auto-attention linéaires profonds et softmax sur des tâches séquentielles simples tout en offrant plus d'interprétabilité.

Après des expériences préliminaires de modélisation du langage, il a été constaté que le remplacement de la couche d'auto-attention standard par la couche mesa a donné des résultats prometteurs, prouvant que cette couche possède de puissantes capacités d'apprentissage contextuel.

- Basé sur des travaux récents montrant que les transformateurs explicitement formés pour résoudre de petites tâches en contexte peuvent implémenter des algorithmes de descente de gradient (GD). Ici, les auteurs montrent que ces résultats se généralisent à la modélisation de séquences autorégressives, une approche typique de la formation des LLM.

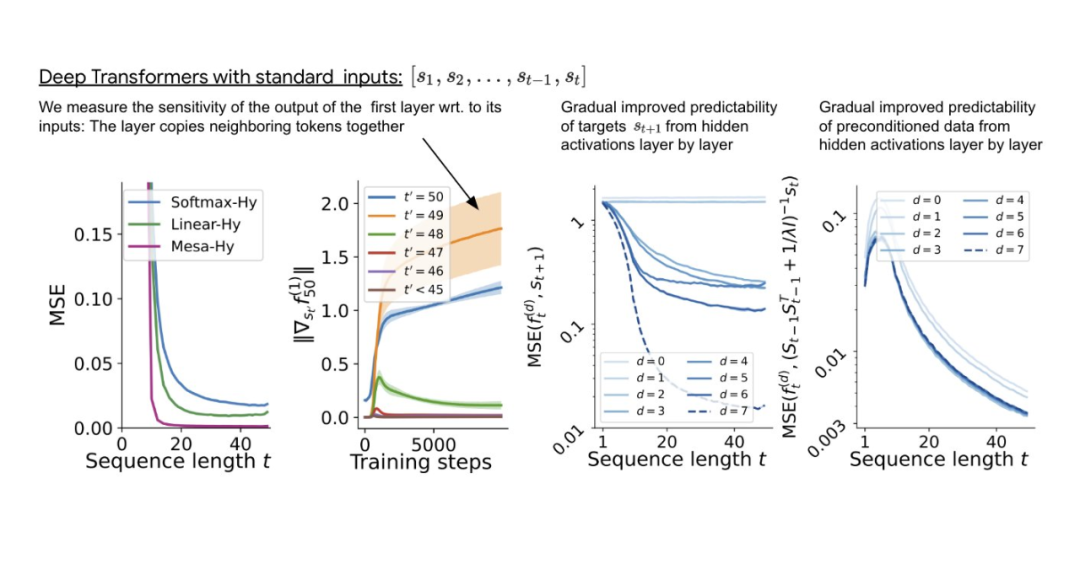

Analysez d'abord les transformateurs entraînés sur une dynamique linéaire simple, où chaque séquence est générée par un W* différent - pour éviter la mémorisation de séquences croisées. Dans cette configuration simple, les auteurs démontrent un transformateur qui crée un ensemble de données mesa, puis utilise le GD prétraité pour optimiser la cible mesa. Cette étude entraîne un transformateur profond sur une structure de jeton qui agrège des éléments de séquence adjacents. Il est intéressant de noter que ce simple prétraitement aboutit à une matrice de poids extrêmement clairsemée (moins de 1 % des poids sont différents de zéro), ce qui donne lieu à un algorithme d'ingénierie inverse.

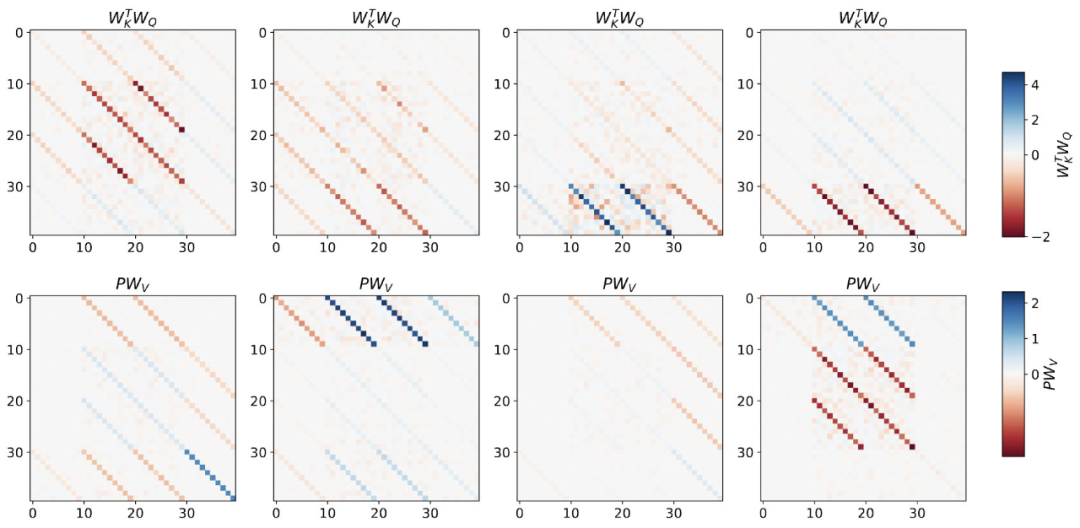

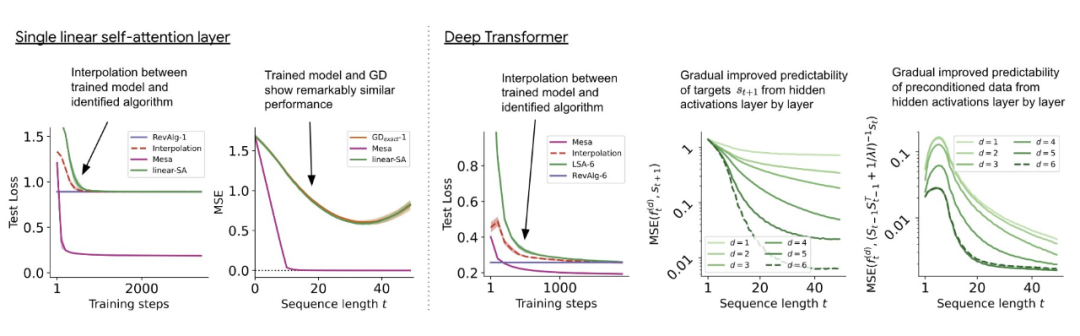

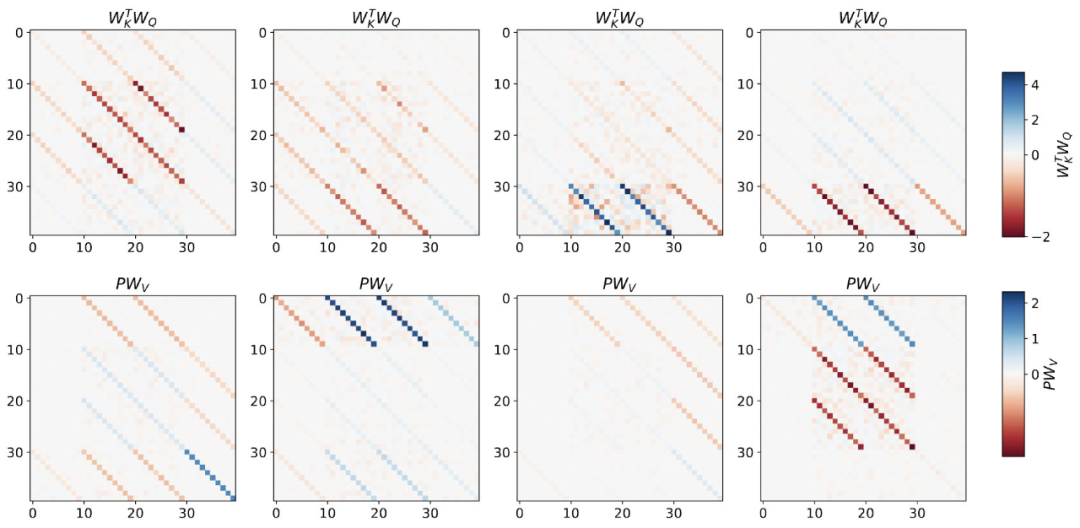

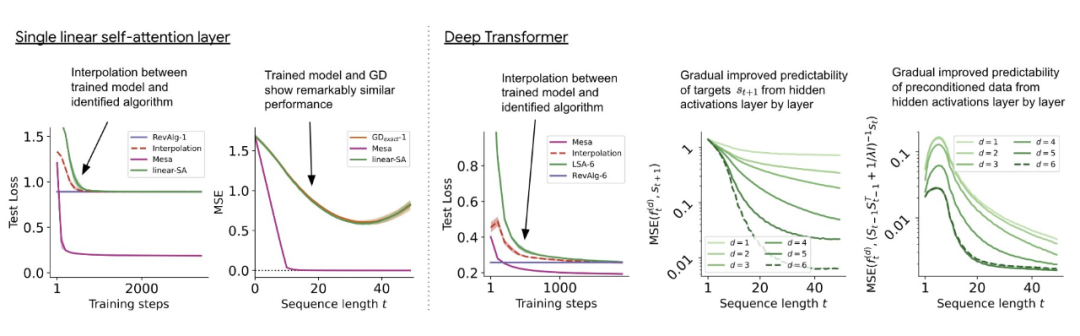

Pour une auto-attention linéaire monocouche, le poids correspond à un pas GD. Pour les transformateurs profonds, l’interprétabilité devient difficile. Cette étude s'appuie sur un sondage linéaire et examine si les activations cachées prédisent des cibles autorégressives ou des entrées prétraitées. Fait intéressant, la prévisibilité des deux méthodes de détection s'améliore progressivement à mesure que la profondeur du réseau augmente. Cette découverte suggère que le GD prétraité est caché dans le modèle. Figure 2 : Ingénierie inverse de la couche d’auto-attention linéaire entraînée.

L'étude a révélé que la couche d'entraînement peut être parfaitement ajustée lors de l'utilisation de tous les degrés de liberté dans la construction, y compris non seulement le taux d'apprentissage appris η, mais également un ensemble de poids initiaux appris W_0. Il est important de noter que, comme le montre la figure 2, l’algorithme en une étape appris fonctionne toujours bien mieux qu’une seule couche mesa.

Nous pouvons remarquer que sous de simples paramètres de poids, il est facile de découvrir grâce à une optimisation de base que cette couche peut résoudre de manière optimale la tâche étudiée ici. Ce résultat démontre l’avantage des biais inductifs codés en dur en faveur de l’optimisation mesa.

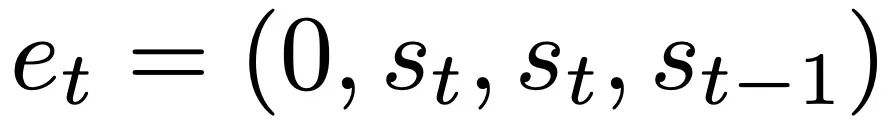

Avec des informations théoriques sur le cas multicouche, analysez d'abord Deep Linear et Softmax en prêtant uniquement attention à Transformer. Les auteurs formatent l'entrée selon une structure à 4 canaux, , ce qui correspond au choix W_0 = 0. Comme pour le modèle monocouche, les auteurs voient une structure claire dans les poids du modèle entraîné. Dans le cadre d'une première analyse d'ingénierie inverse, cette étude exploite cette structure et construit un algorithme (RevAlg-d, où d représente le nombre de couches) contenant 16 paramètres par en-tête de couche (au lieu de 3200). Les auteurs ont découvert que cette expression compressée mais complexe peut décrire le modèle entraîné. En particulier, il permet l'interpolation entre les poids Transformer et RevAlg-d réels d'une manière presque sans perte.

Bien que l'expression RevAlg-d explique un transformateur multicouche entraîné avec un petit nombre de paramètres libres, il est difficile de l'interpréter comme un algorithme d'optimisation mesa. Par conséquent, les auteurs ont utilisé une analyse par sondage par régression linéaire (Alain et Bengio, 2017 ; Akyürek et al., 2023) pour trouver les caractéristiques de l’algorithme d’optimisation mesa hypothétique.

Sur le transformateur d'auto-attention linéaire profond illustré à la figure 3, nous pouvons voir que les deux sondes peuvent être décodées de manière linéaire et que les performances de décodage augmentent avec l'augmentation de la longueur de la séquence et de la profondeur du réseau. Par conséquent, l’optimisation de base découvre un algorithme hybride qui descend couche par couche sur l’objectif mésa d’origine Lt (W) tout en améliorant le numéro de condition du problème d’optimisation mesa. Il en résulte une diminution rapide du Lt (W) mésa-objectif. On peut également constater que les performances s’améliorent considérablement avec l’augmentation de la profondeur.

On peut donc considérer que le déclin rapide de l'objectif mésa autorégressif Lt (W) est obtenu par une optimisation mesa étape par étape (cross-layer) sur de meilleures données prétraitées.建 Figure 3 : Formation sur les transformateurs multicouches pour les entrées intégrées par ingénierie inverse. Cela montre que si le transformateur est formé sur le jeton construit, il prédira avec l'optimisation mesa. Fait intéressant, lorsque des éléments de séquence sont donnés directement, le transformateur construira lui-même le jeton en regroupant les éléments, ce que l'équipe de recherche appelle « créer l'ensemble de données mesa ».

Conclusion Cette étude montre que le modèle Transformer est capable de développer des algorithmes d'inférence basés sur le gradient lorsqu'il est entraîné sur une tâche de prédiction de séquence sous un objectif autorégressif standard. Par conséquent, les résultats de pointe obtenus dans des contextes de méta-apprentissage multitâches peuvent également être transférés vers des contextes de formation LLM auto-supervisés traditionnels. De plus, l'étude a révélé que les algorithmes d'inférence autorégressive appris peuvent être réutilisés pour résoudre des tâches d'apprentissage contextuel supervisé sans avoir besoin de recyclage, expliquant les résultats dans un seul cadre unifié.

Cette étude montre que le modèle Transformer est capable de développer des algorithmes d'inférence basés sur le gradient lorsqu'il est entraîné sur une tâche de prédiction de séquence sous un objectif autorégressif standard. Par conséquent, les résultats de pointe obtenus dans des contextes de méta-apprentissage multitâches peuvent également être transférés vers des contextes de formation LLM auto-supervisés traditionnels. De plus, l'étude a révélé que les algorithmes d'inférence autorégressive appris peuvent être réutilisés pour résoudre des tâches d'apprentissage contextuel supervisé sans avoir besoin de recyclage, expliquant les résultats dans un seul cadre unifié.

Alors, qu'est-ce que cela a à voir avec l'apprentissage en contexte ? L'étude estime qu'après avoir entraîné le transformateur à la tâche de séquence autorégressive, il obtient une optimisation mesa appropriée et peut donc effectuer un apprentissage contextuel en quelques étapes sans aucun réglage fin.

Cette étude suppose que l'optimisation mesa existe également pour LLM, améliorant ainsi ses capacités d'apprentissage contextuel. Il est intéressant de noter que l’étude a également observé qu’une adaptation efficace des invites pour le LLM peut également conduire à des améliorations substantielles des capacités d’apprentissage contextuel.

Les lecteurs intéressés peuvent lire le texte original de l'article pour en savoir plus sur le contenu de la recherche. https://www.reddit.com/r/MachineLearning/comments/16jc2su/r_uncovering_mesaoptimization_algorithms_in/ https://twitter.com/ oswaldjoh/statut/1701873029100241241Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Les contributions de cette étude comprennent :

Les contributions de cette étude comprennent :