Maison >Périphériques technologiques >IA >Le point de vue de la nature : les tests de l'intelligence artificielle en médecine sont dans le chaos. Que faut-il faire ?

Le point de vue de la nature : les tests de l'intelligence artificielle en médecine sont dans le chaos. Que faut-il faire ?

- PHPzoriginal

- 2024-08-22 16:37:32530parcourir

Sur la base de données cliniques limitées, des centaines d'algorithmes médicaux ont été approuvés. Les scientifiques se demandent qui devrait tester les outils et comment le faire au mieux.

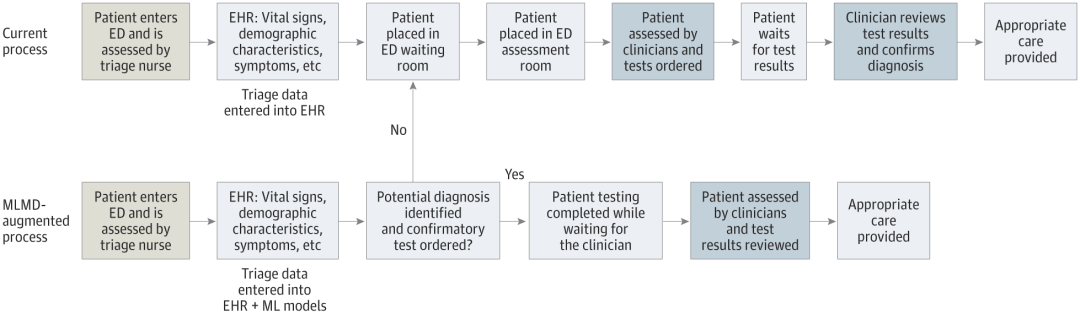

- Devin Singh a vu un patient pédiatrique faire un arrêt cardiaque aux urgences alors qu'il attendait longtemps un traitement, ce qui l'a incité à explorer l'utilisation de l'IA pour réduire les temps d'attente.

- En tirant parti des données de triage des salles d’urgence de SickKids, Singh et ses collègues ont construit une série de modèles d’IA pour fournir des diagnostics potentiels et recommander des tests.

- Une étude montre que ces modèles peuvent accélérer les visites chez le médecin de 22,3 %, accélérant le traitement des résultats de près de 3 heures par patient nécessitant un test médical.

- Cependant, le succès des algorithmes d’IA dans la recherche n’est que la première étape pour valider si de telles interventions aideront les gens dans la vie réelle.

Un moyen de commander de manière autonome des tests au service des urgences (SU) à l'aide des ordonnances médicales d'apprentissage automatique (MLMD) (Source : jamanetwork.com)

Qui teste les systèmes d'IA médicale ?

Les applications médicales basées sur l'IA, comme celle que Singh développe, sont souvent considérées comme des dispositifs médicaux par les organismes de réglementation des médicaments, notamment la FDA américaine et l'Agence britannique de réglementation des médicaments et des produits de santé. Par conséquent, les normes d’examen et d’autorisation d’utilisation sont généralement moins strictes que celles applicables aux produits pharmaceutiques. Seul un petit sous-ensemble de dispositifs, ceux qui peuvent présenter un risque élevé pour les patients, nécessitent des données d'essais cliniques pour être approuvés.

Beaucoup de gens pensent que le seuil est trop bas. Lorsque Gary Weissman, médecin de soins intensifs à l'Université de Pennsylvanie à Philadelphie, a examiné les appareils d'IA approuvés par la FDA dans son domaine, il a constaté que sur les dix appareils qu'il a identifiés, seuls trois citent des données publiées dans leur autorisation. Seuls quatre d'entre eux ont mentionné une évaluation de la sécurité, et aucun n'incluait une évaluation des biais, qui analyse si les résultats de l'outil sont équitables pour différents groupes de patients. "Le problème est que ces appareils peuvent avoir un impact sur les soins au chevet du patient", a-t-il déclaré. "La vie des patients peut dépendre de ces décisions.

Le manque de données rend difficile pour les hôpitaux et les systèmes de santé de décider d'utiliser ou non ces technologies." Dans une situation difficile. Dans certains cas, des incitations financières entrent en jeu. Aux États-Unis, par exemple, les régimes d’assurance maladie remboursent déjà aux hôpitaux l’utilisation de certains dispositifs médicaux d’IA, ce qui les rend financièrement attractifs. Ces institutions peuvent également être enclines à adopter des outils d’IA qui promettent des économies de coûts, même s’ils n’améliorent pas nécessairement les soins aux patients.

Ouyang a déclaré que ces incitations pourraient empêcher les entreprises d’IA d’investir dans les essais cliniques. « De nombreuses entreprises commerciales peuvent imaginer qu’elles vont travailler plus dur pour s’assurer que leurs outils d’IA sont remboursables », a-t-il déclaré.

La situation peut varier selon les marchés. Au Royaume-Uni, par exemple, un plan national de santé financé par le gouvernement pourrait fixer des seuils de preuve plus élevés avant que les centres médicaux puissent acheter des produits spécifiques, a déclaré Xiaoxuan Liu, chercheur clinicien à l'Université de Birmingham qui étudie l'innovation responsable en matière d'intelligence artificielle. une incitation à mener des essais cliniques. "

Une fois qu'un hôpital achète un produit d'IA, il n'a pas besoin de procéder à des tests supplémentaires et peut l'utiliser immédiatement comme les autres logiciels. Cependant, certaines agences reconnaissent que l’approbation réglementaire ne garantit pas que le dispositif sera réellement bénéfique. Ils ont donc choisi de le tester eux-mêmes. Actuellement, bon nombre de ces efforts sont menés et financés par des centres médicaux universitaires, a déclaré Ouyang.

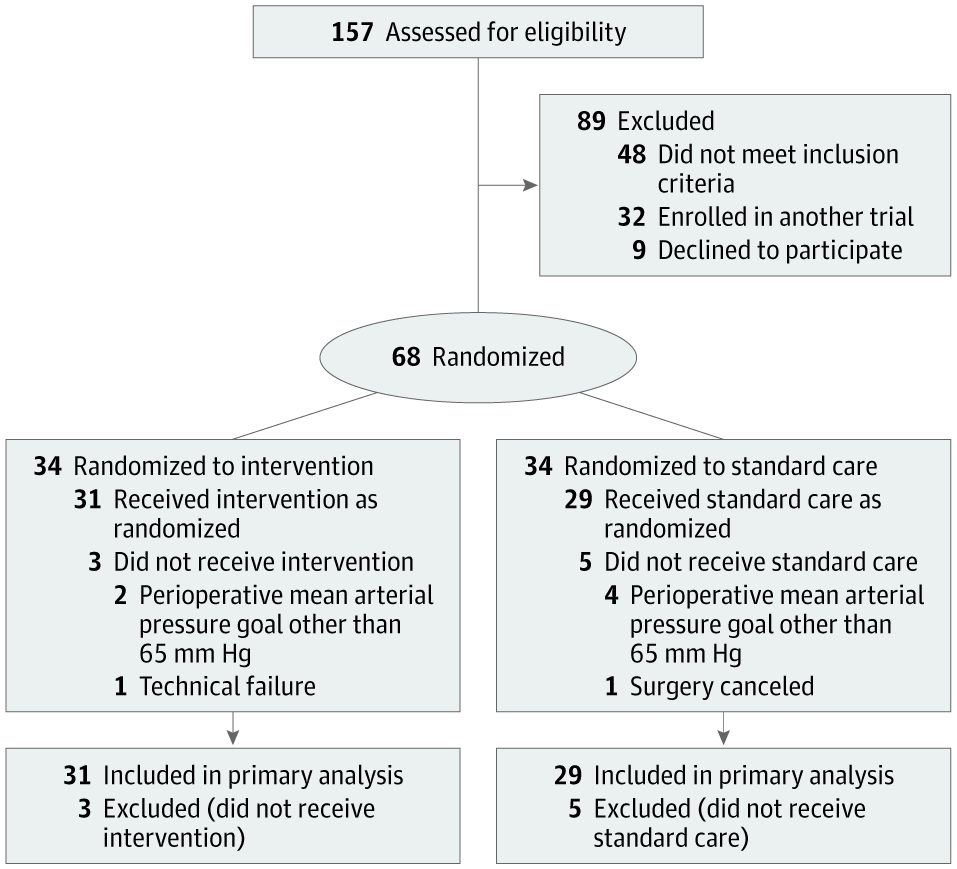

Alexander Vlaar, directeur médical des soins intensifs au centre médical universitaire d'Amsterdam, et Denise Veelo, anesthésiste dans la même institution, ont lancé une telle initiative en 2017. Leur objectif était de tester un algorithme conçu pour prédire la survenue d’une hypotension lors d’une intervention chirurgicale. Cette condition, connue sous le nom d'hypotension peropératoire, peut entraîner des complications potentiellement mortelles telles que des lésions du muscle cardiaque, une crise cardiaque et une insuffisance rénale aiguë, voire la mort.

L'algorithme, développé par Edwards Lifesciences, basé en Californie, utilise les données de forme d'onde artérielle – les lignes rouges avec des pics et des creux affichées sur les moniteurs des services d'urgence ou des unités de soins intensifs. La méthode peut prédire l’hypotension quelques minutes avant qu’elle ne se produise, permettant ainsi une intervention précoce.

Aliran peserta dalam percubaan Hypotension Prediction (HYPE). (Sumber: jamanetwork.com) Vlaar, Veelo dan rakan sekerja menjalankan percubaan klinikal rawak untuk menguji alat itu ke atas 60 pesakit yang menjalani pembedahan bukan jantung. Pesakit yang menggunakan peranti itu mengalami purata lapan minit hipotensi semasa pembedahan, manakala pesakit dalam kumpulan kawalan mengalami purata hampir 33 minit.

Pasukan menjalankan percubaan klinikal kedua, mengesahkan bahawa peranti itu juga berkesan dalam tetapan yang lebih kompleks, termasuk semasa pembedahan jantung dan dalam unit rawatan rapi, apabila digabungkan dengan rejimen rawatan yang jelas. Keputusan masih belum diumumkan.

Kejayaan bukan hanya disebabkan oleh ketepatan algoritma. Tindak balas pakar bius terhadap penggera juga penting. Jadi para penyelidik memastikan doktor bersedia dengan baik: "Kami mempunyai carta alir diagnostik yang menggariskan langkah-langkah yang perlu diambil apabila amaran diterima, " kata Veelo. Algoritma yang sama gagal menunjukkan manfaat dalam percubaan klinikal yang dijalankan oleh institusi lain. Dalam kes itu, "apabila penggera berbunyi, doktor sisi katil gagal mengikut arahan dan mengambil tindakan," kata Vlaar.

Manusia Terlibat Algoritma yang sangat baik mungkin gagal disebabkan oleh perubahan dalam tingkah laku manusia, sama ada profesional penjagaan kesihatan atau orang yang menerima rawatan.

Klinik Mayo di Rochester, Minnesota, sedang menguji algoritma yang dibangunkan secara dalaman untuk mengesan penyakit jantung dengan pecahan lenting yang rendah, dan Barbara Barry, seorang penyelidik interaksi manusia-komputer di pusat, bertanggungjawab untuk merapatkan pembangun dan pengguna jurang antara penyedia penjagaan primer.

Alat ini direka bentuk untuk menandakan individu yang mungkin berisiko tinggi menghidapi keadaan ini, yang boleh menjadi tanda kegagalan jantung dan boleh dirawat tetapi selalunya tidak didiagnosis. Percubaan klinikal menunjukkan bahawa algoritma itu meningkatkan kadar diagnosis. Walau bagaimanapun, dalam perbualan dengan pembekal, Barry mendapati bahawa mereka mahukan panduan lanjut tentang cara membincangkan keputusan algoritma dengan pesakit mereka. Ini membawa kepada cadangan bahawa apl itu, jika dilaksanakan secara meluas, harus memasukkan maklumat penting untuk berkomunikasi dengan pesakit supaya penyedia penjagaan kesihatan tidak perlu memikirkan cara mengadakan perbualan ini setiap kali. "Ini adalah contoh kita beralih daripada eksperimen pragmatik kepada strategi pelaksanaan, " kata Barry.

Satu lagi isu yang mungkin mengehadkan kejayaan sesetengah peranti AI perubatan ialah "keletihan amaran"—apabila doktor terdedah kepada sejumlah besar amaran yang dijana AI, mereka mungkin menjadi tidak peka terhadapnya. Itu harus diambil kira semasa proses ujian, kata David Rushlow, ketua bahagian perubatan keluarga di Mayo Clinic.

“Kami menerima makluman berkali-kali setiap hari tentang penyakit yang mungkin berisiko kepada pesakit, bagi doktor barisan hadapan yang sibuk, ini sebenarnya merupakan tugas yang sangat sukar,” katanya mereka tidak diperkenalkan dengan tepat, lalainya adalah untuk terus melakukan perkara dengan cara yang sama kerana kami tidak mempunyai lebar jalur untuk mempelajari perkara baharu." Rushlow menegaskan.

Pertimbangkan Bias

Satu lagi cabaran dalam menguji AI perubatan ialah keputusan percubaan klinikal sukar untuk digeneralisasikan merentas populasi yang berbeza. "Adalah diketahui umum bahawa algoritma kecerdasan buatan boleh menjadi sangat rapuh apabila ia digunakan pada data yang berbeza daripada data latihan, " kata Liu.

Dia menyatakan bahawa keputusan hanya boleh diekstrapolasi dengan selamat jika peserta ujian klinikal mewakili populasi yang alat itu akan digunakan.

Selain itu, algoritma yang dilatih mengenai data yang dikumpul di hospital yang kaya dengan sumber mungkin tidak berfungsi dengan baik apabila digunakan dalam tetapan yang tidak mempunyai sumber. Sebagai contoh, pasukan Kesihatan Google membangunkan algoritma untuk mengesan retinopati diabetik, keadaan yang menyebabkan kehilangan penglihatan pada penghidap diabetes, dengan ketepatan yang tinggi secara teori. Tetapi apabila alat itu digunakan di klinik di Thailand, prestasinya menurun dengan ketara.

Kajian pemerhatian menunjukkan bahawa keadaan pencahayaan di klinik Thai mengakibatkan kualiti imej mata yang lemah, mengurangkan keberkesanan alat.

Pada masa ini, kebanyakan alatan AI perubatan membantu profesional penjagaan kesihatan dengan pemeriksaan, diagnosis atau perancangan rawatan. Pesakit mungkin tidak menyedari bahawa teknologi ini sedang diuji atau digunakan secara rutin dalam penjagaan mereka, dan tiada negara pada masa ini memerlukan penyedia penjagaan kesihatan untuk mendedahkan perkara ini.

Perdebatan berterusan mengenai perkara yang perlu diberitahu kepada pesakit tentang teknologi kecerdasan buatan. Beberapa apl ini telah mendorong isu persetujuan pesakit menjadi perhatian pembangun. Begitulah halnya dengan peranti kecerdasan buatan yang sedang dibangunkan oleh pasukan Singh untuk menyelaraskan penjagaan kanak-kanak di bilik kecemasan SickKids.

Apa yang sangat berbeza tentang teknologi ini ialah ia menyingkirkan doktor daripada keseluruhan proses, membenarkan kanak-kanak (atau ibu bapa atau penjaga mereka) menjadi pengguna akhir.

“Apa yang dilakukan oleh alat ini ialah mengambil data percubaan kecemasan, membuat ramalan dan memberi kelulusan terus kepada ibu bapa — ya atau tidak — jika anak mereka boleh diuji,” kata Singh. Ini mengurangkan beban doktor dan mempercepatkan keseluruhan proses. Tetapi ia juga membawa banyak masalah yang tidak pernah berlaku sebelum ini. Siapa yang bertanggungjawab jika berlaku masalah kepada pesakit? Siapa yang membayar jika ujian yang tidak perlu dilakukan?

« Nous devons obtenir le consentement éclairé des familles de manière automatisée. » a déclaré Singh, et le consentement doit être fiable et authentique. "Cela ne peut pas être comme lorsque vous vous inscrivez sur les réseaux sociaux et que vous avez 20 pages de petits caractères et que vous cliquez simplement sur Accepter.

Pendant que Singh et ses collègues attendent un financement pour démarrer des essais sur des patients, l'équipe travaille avec les services juridiques." experts et Engager l'organisme de réglementation du pays, Santé Canada, à examiner ses propositions et à considérer les implications réglementaires. Actuellement, « le paysage réglementaire ressemble un peu au Far West », a déclaré Anna Goldenberg, informaticienne et coprésidente de la SickKids' Children's Medical Artificial Intelligence Initiative.

Les établissements médicaux adoptent prudemment les outils d'IA et effectuent des tests autonomes.

Les facteurs de coût ont incité les chercheurs et les établissements médicaux à explorer des alternatives.

Les grands établissements médicaux ont moins de difficultés, tandis que les petits établissements sont confrontés à de plus grands défis.

La Mayo Clinic teste un outil d’IA à utiliser dans les établissements de soins de santé communautaires.

La Health AI Alliance a créé un laboratoire de garantie pour évaluer le modèle.

Duke University propose des capacités de tests internes pour vérifier localement les modèles d'IA.

La radiologue Nina Kottler souligne l'importance d'une vérification locale.

Les facteurs humains doivent être pris en compte pour garantir l'exactitude de l'intelligence artificielle et des utilisateurs finaux.

Contenu de référence : https://www.nature.com/articles/d41586-024-02675-0

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI