HuggingFace all theme ranking one|

Weitere Ressourceninformationen finden Sie unter:

- Codeadresse: https://github.com/KwaiVGI/LivePortrait

- Papierlink: https://arxiv.org/ abs /2407.03168

- Projekthomepage: https://liveportrait.github.io/

- HuggingFace Space One-Click-Online-Erlebnis: https://huggingface.co/spaces/KwaiVGI/LivePortrait

Welche Art von Technologie nutzt LivePortrait, um schnell im gesamten Internet populär zu werden? Methodeneinführung LivePortrait konzentriert sich auf eine bessere Verallgemeinerung, Kontrollierbarkeit und praktische Effizienz. Um die Generierungsfähigkeiten und die Steuerbarkeit zu verbessern, verwendet LivePortrait 69 Millionen hochwertige Trainingsrahmen, eine Video-Bild-Hybrid-Trainingsstrategie, aktualisiert die Netzwerkstruktur und entwickelt bessere Methoden zur Aktionsmodellierung und -optimierung. Darüber hinaus betrachtet LivePortrait implizite Schlüsselpunkte als wirksame implizite Darstellung der Verformung der Gesichtsmischung (Blendshape) und schlägt darauf basierend sorgfältig Stitching- und Retargeting-Module vor. Bei diesen beiden Modulen handelt es sich um leichte MLP-Netzwerke, sodass die Steuerbarkeit zwar verbessert wird, der Rechenaufwand jedoch vernachlässigt werden kann. Selbst im Vergleich zu einigen bestehenden, auf Diffusionsmodellen basierenden Methoden ist LivePortrait immer noch sehr effektiv. Gleichzeitig kann die Einzelbildgenerierungsgeschwindigkeit von LivePortrait auf der RTX4090-GPU 12,8 ms erreichen. Bei weiterer Optimierung, wie z. B. TensorRT, wird erwartet, dass sie weniger als 10 ms erreicht. Die Modelausbildung von LivePortrait ist in zwei Phasen unterteilt. Die erste Stufe ist die grundlegende Modellschulung und die zweite Stufe ist die Schulung des Anpassungs- und Umleitungsmoduls.

Die erste Stufe der Grundmodellausbildung模 Die erste Phase des grundlegenden Modelltrainings

In der ersten Phase des Modelltrainings hat LivePortrait eine Reihe von Verbesserungen am auf versteckten Punkten basierenden Framework vorgenommen, z. B. Face vid2vid [1], darunter:

Hochwertige Trainingsdatenerfassung: LivePortrait übernimmt den öffentlichen Videodatensatz Voxceleb[2], MEAD[3], RAVDESS[4] und den stilisierten Bilddatensatz AAHQ[5]. Darüber hinaus werden großformatige Porträtvideos mit 4K-Auflösung verwendet, darunter verschiedene Gesichtsausdrücke und Körperhaltungen, mehr als 200 Stunden sprechende Porträtvideos, ein privater Datensatz LightStage [6] sowie einige stilisierte Videos und Bilder. LivePortrait teilt lange Videos in Segmente von weniger als 30 Sekunden auf und stellt sicher, dass jedes Segment nur eine Person enthält. Um die Qualität der Trainingsdaten sicherzustellen, verwendet LivePortrait Kuaishous selbst entwickeltes KVQ [7] (Kuaishous selbst entwickelte Methode zur Bewertung der Videoqualität, mit der Qualität, Inhalt, Szene, Ästhetik, Kodierung, Audio und andere Merkmale umfassend wahrgenommen werden können das Video, um eine mehrdimensionale Auswertung durchzuführen), um Videoclips mit geringer Qualität zu filtern. Die gesamten Trainingsdaten umfassen 69 Millionen Videos, darunter 18,9.000 Identitäten und 60.000 statische stilisierte Porträts.

Video-Bild-Hybrid-Training: Modelle, die nur mit Videos von echten Menschen trainiert wurden, schneiden bei echten Menschen gut ab, verfügen jedoch nicht über eine unzureichende Verallgemeinerungsfähigkeit für stilisierte Menschen (z. B. Anime). Stilisierte Porträtvideos sind seltener, wobei LivePortrait nur etwa 1,3.000 Videoclips von weniger als 100 Identitäten sammelt. Im Gegensatz dazu sind qualitativ hochwertige stilisierte Porträtbilder häufiger anzutreffen. LivePortrait hat etwa 60.000 Bilder mit unterschiedlichen Identitäten gesammelt und bietet vielfältige Identitätsinformationen. Um beide Datentypen zu nutzen, behandelt LivePortrait jedes Bild als Videoclip und trainiert das Modell gleichzeitig für Videos und Bilder. Dieses Hybridtraining verbessert die Generalisierungsfähigkeit des Modells.

Verbesserte Netzwerkstruktur: LivePortrait vereint das kanonische Netzwerk zur Schätzung impliziter Schlüsselpunkte (L), das Netzwerk zur Schätzung der Kopfhaltung (H) und das Netzwerk zur Schätzung der Ausdrucksverformung (Δ) in einem einzigen Modell (M). verwendet ConvNeXt-V2-Tiny [8] als Struktur, um die kanonischen impliziten Schlüsselpunkte, die Kopfhaltung und die Ausdrucksverformung des Eingabebildes direkt abzuschätzen. Darüber hinaus verwendet LivePortrait, inspiriert von der verwandten Arbeit von face vid2vid, den effektiveren Decoder von SPADE [9] als Generator (G). Die latenten Merkmale (fs) werden nach der Verformung fein in den SPADE-Decoder eingespeist, wo jeder Kanal der latenten Merkmale als semantische Karte zur Erzeugung des gesteuerten Bildes verwendet wird. Um die Effizienz zu verbessern, fügt LivePortrait außerdem die Ebene PixelShuffle[10] als letzte Ebene von (G) ein und erhöht so die Auflösung von 256 auf 512.

Flexiblere Aktionstransformationsmodellierung: Die Berechnungs- und Modellierungsmethode der ursprünglichen impliziten Schlüsselpunkte ignoriert den Skalierungskoeffizienten, was dazu führt, dass die Skalierung leicht in den Ausdruckskoeffizienten gelernt werden kann, was das Training schwieriger macht. Um dieses Problem zu lösen, führt LivePortrait Skalierungsfaktoren in die Modellierung ein. LivePortrait hat herausgefunden, dass die Skalierung regelmäßiger Projektionen zu übermäßig flexiblen erlernbaren Ausdruckskoeffizienten führen kann, was bei der Steuerung über Identitäten hinweg zu Texturanhaftungen führt. Daher ist die von LivePortrait übernommene Transformation ein Kompromiss zwischen Flexibilität und Fahrbarkeit.

Schlüsselpunktgesteuerte implizite Schlüsselpunktoptimierung: Dem ursprünglichen impliziten Punktrahmen scheint die Fähigkeit zu fehlen, Gesichtsausdrücke wie Augenzwinkern und Augenbewegungen anschaulich zu steuern. Insbesondere neigen die Augapfelrichtung und die Kopfausrichtung des Porträts in den Fahrergebnissen dazu, parallel zu bleiben. LivePortrait führt diese Einschränkungen auf die Schwierigkeit zurück, subtile Gesichtsausdrücke unbeaufsichtigt zu erlernen. Um dieses Problem zu lösen, führt LivePortrait 2D-Schlüsselpunkte zur Erfassung von Mikroausdrücken ein und verwendet dabei den schlüsselpunktgesteuerten Verlust (Lguide) als Leitfaden für die implizite Schlüsselpunktoptimierung. : LivePortrait verwendet den impliziten Schlüsselpunktinvariantenverlust (LE), den Schlüsselpunktpriorverlust (LL), den Kopfhaltungsverlust (LH) und den Deformationspriorverlust (LΔ) von Face vid2vid. Um die Texturqualität weiter zu verbessern, verwendet LivePortrait Wahrnehmungs- und GAN-Verluste, die nicht nur auf die globale Domäne des Eingabebildes angewendet werden, sondern auch auf die lokale Domäne von Gesicht und Mund, aufgezeichnet als Kaskaden-Wahrnehmungsverlust (LP, Kaskade) und Kaskaden-GAN-Verlust (LG, Kaskade). Die Gesichts- und Mundbereiche werden durch semantische 2D-Schlüsselpunkte definiert. LivePortrait nutzt außerdem den Verlust der Gesichtsidentität (Lfaceid), um die Identität des Referenzbildes zu bewahren. Alle Module in der ersten Stufe werden von Grund auf trainiert, und die gesamte Trainingsoptimierungsfunktion (Lbase) ist die gewichtete Summe der oben genannten Verlustterme.

Anpassungs- und Umleitungsmodulschulung der zweiten StufeLivePortrait kann implizite Schlüsselpunkte als implizite Mischdeformation betrachten und hat festgestellt, dass diese Kombination nur die Hilfe eines leichten MLP erfordert. Es kann besser gelernt werden und Der Rechenaufwand ist vernachlässigbar. Unter Berücksichtigung der tatsächlichen Bedürfnisse hat LivePortrait ein Anpassungsmodul, ein Augenumleitungsmodul und ein Mundumleitungsmodul entwickelt.Wenn das Referenzporträt zugeschnitten wird, wird das gesteuerte Porträt aus dem Zuschneidebereich wieder in den ursprünglichen Bildbereich eingefügt. Das Anpassungsmodul wird hinzugefügt, um eine Pixelfehlausrichtung während des Einfügevorgangs zu vermeiden, z. B. im Schulterbereich. Dadurch kann LivePortrait für größere Bildformate oder Gruppenfotos aktionsgesteuert sein. Das Eye-Retargeting-Modul soll das Problem des unvollständigen Augenschlusses beim Überqueren von Identitäten lösen, insbesondere wenn ein Porträt mit kleinen Augen ein Porträt mit großen Augen antreibt. Die Designidee des Mundumleitungsmoduls ähnelt der des Augenumleitungsmoduls, das die Eingabe normalisiert, indem es den Mund des Referenzbilds zur besseren Steuerung in einen geschlossenen Zustand versetzt. Die zweite Phase des Modelltrainings: Anpassen und Umleiten des Modultrainings

Folgen Sie dem Modul : Während des Trainingsprozesses ist die Eingabe des Moduls/der Module das Referenzdiagramm implizite Schlüsselpunkte (xd) eines anderen identitätsgesteuerten Rahmens und schätzen Sie die Ausdrucksänderung (Δst), die die impliziten Schlüsselpunkte (xd) antreibt. Es ist ersichtlich, dass LivePortrait im Gegensatz zur ersten Stufe identitätsübergreifende Aktionen verwendet, um identitätsübergreifende Aktionen zu ersetzen, um die Schwierigkeit des Trainings zu erhöhen und eine bessere Generalisierung des Anpassungsmoduls zu erreichen. Als nächstes wird der implizite Treiberschlüsselpunkt (xd) aktualisiert und die entsprechende Treiberausgabe ist (Ip,st). LivePortrait gibt in dieser Phase auch selbst rekonstruierte Bilder (Ip,recon) aus. Schließlich berechnet die Verlustfunktion (Lst) des Anpassungsmoduls den pixelkonsistenten Verlust des Schulterbereichs beider Schultern und den Regularisierungsverlust der Anpassungsvariation. Augen- und Mundumleitungsmodul: Die Eingabe des Augenumleitungsmoduls (Reyes) ist der implizite Schlüsselpunkt (xs) des Referenzbilds, das Referenzbild-Augenöffnungsbedingungstupel und ein zufälliger treibender Augenöffnungskoeffizient Wird verwendet, um die Verformungsänderung (Δeyes) des Antriebsschlüsselpunkts abzuschätzen. Das Tupel der Augenöffnungsbedingung stellt das Augenöffnungsverhältnis dar. Je größer es ist, desto größer ist der Grad der Augenöffnung. In ähnlicher Weise sind die Eingaben des Mundumleitungsmoduls (Rlip) die impliziten Schlüsselpunkte (xs) des Referenzbilds, der Mundöffnungsbedingungskoeffizient des Referenzbilds und ein zufälliger steuernder Mundöffnungskoeffizient, und die steuernden Schlüsselpunkte werden daraus geschätzt Dies ist der Betrag der Änderung (Δlip). Als nächstes werden die Antriebsschlüsselpunkte (xd) durch die Verformungsänderungen aktualisiert, die den Augen bzw. dem Mund entsprechen, und die entsprechenden Antriebsausgaben sind (Ip, Augen) und (Ip, Lippe). Schließlich sind die Zielfunktionen der Augen- und Mund-Retargeting-Module (Leyes) bzw. (Llip), die den Pixelkonsistenzverlust der Augen- und Mundbereiche, den Regularisierungsverlust der Augen- und Mundvariation und den Zufallsverlust berechnen. Der Verlust zwischen dem Antriebskoeffizienten und dem Öffnungszustandskoeffizienten des Antriebsausgangs. Die Augen- und Mundänderungen (Δeyes) und (Δlip) sind unabhängig voneinander, sodass sie während der Inferenzphase linear summiert und die treibenden impliziten Schlüsselpunkte aktualisiert werden können. Experimenteller Vergleich -basierte Methode, LivePortrait Mit besserer Generierungsqualität und Fahrgenauigkeit kann es die subtilen Ausdrücke der Augen- und Mund-Fahrbilder erfassen und gleichzeitig die Textur und Identität des Referenzbildes bewahren. Selbst bei größeren Kopfhaltungen bietet LivePortrait eine stabilere Leistung. Identitätsübergreifender Fahrer: Wie aus den obigen Ergebnissen des identitätsübergreifenden Fahrervergleichs hervorgeht, kann LivePortrait im Vergleich zu bestehenden Methoden die subtilen Augen- und Mundbewegungen im Fahrervideo genau erben und ist auch bei der Körperhaltung relativ stabil ist groß. . LivePortrait ist hinsichtlich der Generierungsqualität etwas schwächer als die auf Diffusionsmodellen basierende Methode AniPortrait [11], im Vergleich zu letzterer weist LivePortrait jedoch eine extrem schnelle Inferenzeffizienz auf und erfordert weniger FLOPs. Mehrpersonen-Fahrer: Dank des Anpassungsmoduls von LivePortrait kann LivePortrait für Gruppenfotos bestimmte Gesichter mit bestimmten Fahrervideos steuern und so eine Erweiterung des Mehrpersonen-Fotofahrers erreichen die praktische Anwendung von LivePortrait.  Tiergesteuert: LivePortrait bietet nicht nur eine gute Verallgemeinerung für Porträts, sondern kann nach einer Feinabstimmung der Tierdatensätze auch präzise für Tierporträts gesteuert werden. Tiergesteuert: LivePortrait bietet nicht nur eine gute Verallgemeinerung für Porträts, sondern kann nach einer Feinabstimmung der Tierdatensätze auch präzise für Tierporträts gesteuert werden.

Bearbeitung von Porträtvideos: Zusätzlich zu Porträtfotos kann LivePortrait bei einem Porträtvideo, beispielsweise einem Tanzvideo, das Fahrvideo verwenden, um eine Bewegungsbearbeitung im Kopfbereich durchzuführen. Dank des Anpassungsmoduls kann LivePortrait Bewegungen im Kopfbereich, wie Mimik, Körperhaltung usw., präzise bearbeiten, ohne die Bilder in Nicht-Kopf-Bereichen zu beeinträchtigen.  Implementierung und AussichtenDie damit verbundenen technischen Punkte von LivePortrait wurden in vielen Unternehmen von Kuaishou implementiert, darunter Kuaishou Magic Watch, Kuaishou Private Messaging, Kuaiyings KI-Emoticon-Gameplay und Live-Übertragung, und die von Kuaishou usw. ins Leben gerufene Puchi APP für junge Menschen und wird neue Implementierungsmethoden erkunden, um weiterhin Mehrwert für Benutzer zu schaffen. Darüber hinaus wird LivePortrait die multimodale Erstellung von Porträtvideos basierend auf dem Keling-Grundmodell weiter erforschen und dabei höherwertige Effekte anstreben. [1] Ting-Chun Wang, Arun Mallya und Ming-Yu Liu. One-Shot-Free-View-Neuronal-Talking-Head-Synthese für Videokonferenzen. In CVPR, 2021 .[2] Arsha Nagrani, Joon Son Chung und Andrew Zisserman: ein umfangreicher Sprecheridentifikationsdatensatz.[3] Kaisiyuan Wang, Qianyi Wu , Linsen Song, Zhuoqian Yang, Wayne Wu, Chen Qian, Ran He, Yu Qiao und Chen Change Loy: Ein umfangreicher audiovisueller Datensatz für die Erzeugung emotionaler sprechender Gesichter. [4] Steven R Livingstone und Frank A Russo. Die audiovisuelle Datenbank von Ryerson für emotionale Sprache und Gesang (Ravdess): Ein dynamischer, multimodaler Satz von Gesichts- und Stimmausdrücken in nordamerikanischem Englisch, 2018 [5] Mingcong Liu, Qiang Li, Zekui Qin, Guoxin Zhang, Pengfei Wan und Wen Zheng: Implizite Gan-Mischung für die Erzeugung beliebig stilisierter Gesichter.[ 6 ] Haotian Yang, Mingwu Zheng, Wanquan Feng, Haibin Huang, Yu-Kun Lai, Pengfei Wan, Zhongyuan Wang und Chongyang Ma. Auf dem Weg zur praktischen Erfassung von wiederaufladbaren Avataren mit hoher Wiedergabetreue, 2023 [7] Kai Zhao, Kun Yuan, Ming Sun, Mading Li und Xing Wen. Qualitätsbewusste vorab trainierte Modelle für blinde Bildqualitätsbewertung, 2023. 8] Sanghyun Woo, Shoubhik Debnath, Ronghang Hu, Xinlei Chen, Zhuang Liu, In So Kweon und Saining Xie. vnext v2: Co-Design und Skalierung von Convnets mit maskierten Autoencodern .[9] Taesung Park, Ming-Yu Liu, Ting-Chun Wang und Jun-Yan Zhu. In CVPR, 2019. 10] Wenzhe Shi, Jose Caballero, Ferenc Husz ´ar, Johannes Totz, Andrew P Aitken, Rob Bishop, Daniel Rueckert und Zehan Wang. Echtzeit-Einzelbild- und Video-Superauflösung unter Verwendung eines effizienten Subpixel-Faltungs-Neuronalen Netzwerks. In CVPR, 2016.[11] Huawei Wei, Zejun Yang und Zhisheng Wang Aniportrait: Audiogesteuerte Synthese fotorealistischer Porträtanimationen: 2403.17694, 2024. Implementierung und AussichtenDie damit verbundenen technischen Punkte von LivePortrait wurden in vielen Unternehmen von Kuaishou implementiert, darunter Kuaishou Magic Watch, Kuaishou Private Messaging, Kuaiyings KI-Emoticon-Gameplay und Live-Übertragung, und die von Kuaishou usw. ins Leben gerufene Puchi APP für junge Menschen und wird neue Implementierungsmethoden erkunden, um weiterhin Mehrwert für Benutzer zu schaffen. Darüber hinaus wird LivePortrait die multimodale Erstellung von Porträtvideos basierend auf dem Keling-Grundmodell weiter erforschen und dabei höherwertige Effekte anstreben. [1] Ting-Chun Wang, Arun Mallya und Ming-Yu Liu. One-Shot-Free-View-Neuronal-Talking-Head-Synthese für Videokonferenzen. In CVPR, 2021 .[2] Arsha Nagrani, Joon Son Chung und Andrew Zisserman: ein umfangreicher Sprecheridentifikationsdatensatz.[3] Kaisiyuan Wang, Qianyi Wu , Linsen Song, Zhuoqian Yang, Wayne Wu, Chen Qian, Ran He, Yu Qiao und Chen Change Loy: Ein umfangreicher audiovisueller Datensatz für die Erzeugung emotionaler sprechender Gesichter. [4] Steven R Livingstone und Frank A Russo. Die audiovisuelle Datenbank von Ryerson für emotionale Sprache und Gesang (Ravdess): Ein dynamischer, multimodaler Satz von Gesichts- und Stimmausdrücken in nordamerikanischem Englisch, 2018 [5] Mingcong Liu, Qiang Li, Zekui Qin, Guoxin Zhang, Pengfei Wan und Wen Zheng: Implizite Gan-Mischung für die Erzeugung beliebig stilisierter Gesichter.[ 6 ] Haotian Yang, Mingwu Zheng, Wanquan Feng, Haibin Huang, Yu-Kun Lai, Pengfei Wan, Zhongyuan Wang und Chongyang Ma. Auf dem Weg zur praktischen Erfassung von wiederaufladbaren Avataren mit hoher Wiedergabetreue, 2023 [7] Kai Zhao, Kun Yuan, Ming Sun, Mading Li und Xing Wen. Qualitätsbewusste vorab trainierte Modelle für blinde Bildqualitätsbewertung, 2023. 8] Sanghyun Woo, Shoubhik Debnath, Ronghang Hu, Xinlei Chen, Zhuang Liu, In So Kweon und Saining Xie. vnext v2: Co-Design und Skalierung von Convnets mit maskierten Autoencodern .[9] Taesung Park, Ming-Yu Liu, Ting-Chun Wang und Jun-Yan Zhu. In CVPR, 2019. 10] Wenzhe Shi, Jose Caballero, Ferenc Husz ´ar, Johannes Totz, Andrew P Aitken, Rob Bishop, Daniel Rueckert und Zehan Wang. Echtzeit-Einzelbild- und Video-Superauflösung unter Verwendung eines effizienten Subpixel-Faltungs-Neuronalen Netzwerks. In CVPR, 2016.[11] Huawei Wei, Zejun Yang und Zhisheng Wang Aniportrait: Audiogesteuerte Synthese fotorealistischer Porträtanimationen: 2403.17694, 2024.

|

Technology peripherals

Technology peripherals AI

AI Kuaishou open source LivePortrait, GitHub 6.6K Star, to achieve extremely fast migration of expressions and postures

Kuaishou open source LivePortrait, GitHub 6.6K Star, to achieve extremely fast migration of expressions and postures

have been collected on GitHub. It has received widespread praise and attention is still growing:

have been collected on GitHub. It has received widespread praise and attention is still growing:  Leading the list for one week in a row, recently topped the HuggingFace all theme ranking list

Leading the list for one week in a row, recently topped the HuggingFace all theme ranking list

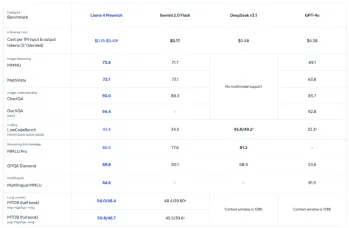

All About Open AI's Latest GPT 4.1 Family - Analytics VidhyaApr 26, 2025 am 10:19 AM

All About Open AI's Latest GPT 4.1 Family - Analytics VidhyaApr 26, 2025 am 10:19 AM What are LLM Benchmarks?Apr 26, 2025 am 10:13 AM

What are LLM Benchmarks?Apr 26, 2025 am 10:13 AM 7 Tasks Gemini 2.5 Pro Does Better Than Any Other Chatbot!Apr 26, 2025 am 10:00 AM

7 Tasks Gemini 2.5 Pro Does Better Than Any Other Chatbot!Apr 26, 2025 am 10:00 AM 6 o3 Prompts You Must Try Today - Analytics VidhyaApr 26, 2025 am 09:56 AM

6 o3 Prompts You Must Try Today - Analytics VidhyaApr 26, 2025 am 09:56 AM I Tried Canva Code and Here's How it Went..Apr 26, 2025 am 09:53 AM

I Tried Canva Code and Here's How it Went..Apr 26, 2025 am 09:53 AM AI Chatbot for Tasks: How AI Agents Are Quietly Replacing AppsApr 26, 2025 am 09:50 AM

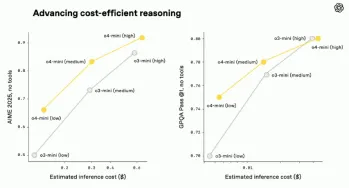

AI Chatbot for Tasks: How AI Agents Are Quietly Replacing AppsApr 26, 2025 am 09:50 AM o3 and o4-mini: OpenAI's Most Advanced Reasoning ModelsApr 26, 2025 am 09:46 AM

o3 and o4-mini: OpenAI's Most Advanced Reasoning ModelsApr 26, 2025 am 09:46 AM Building an AI Agent with Llama 4 and AutoGenApr 26, 2025 am 09:44 AM

Building an AI Agent with Llama 4 and AutoGenApr 26, 2025 am 09:44 AM