Heim >Technologie-Peripheriegeräte >KI >Das iPhone rendert einen 300 Quadratmeter großen Raum in Echtzeit und erreicht dabei eine Genauigkeit im Zentimeterbereich! Googles neueste Forschung: NeRF ist noch nicht bankrott

Das iPhone rendert einen 300 Quadratmeter großen Raum in Echtzeit und erreicht dabei eine Genauigkeit im Zentimeterbereich! Googles neueste Forschung: NeRF ist noch nicht bankrott

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2024-01-15 08:24:091261Durchsuche

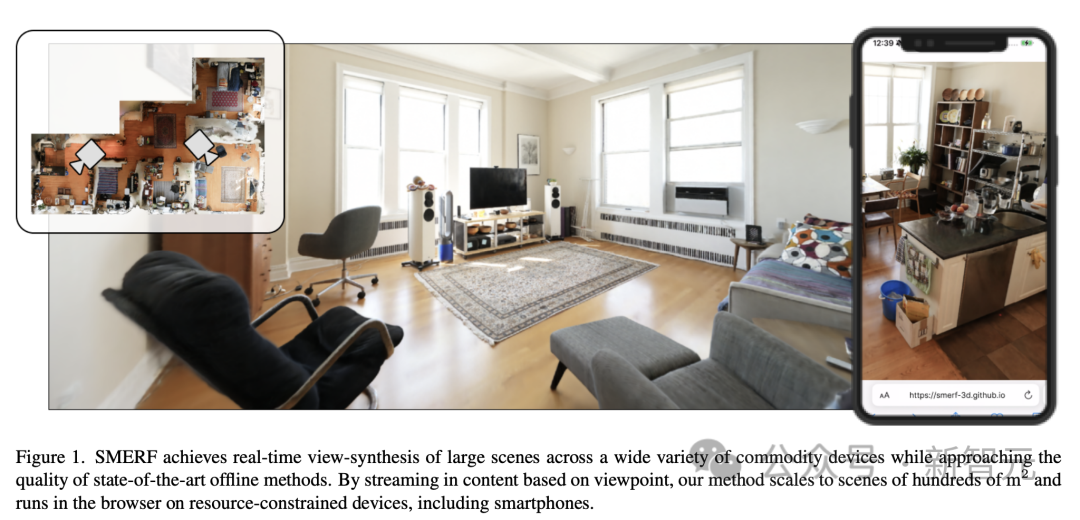

3D-Echtzeit-Rendering großer Szenen kann mit einem Computer oder sogar einem Mobiltelefon durchgeführt werden.

Jede blinde Ecke vom Wohnzimmer bis zum Hauptschlafzimmer, dem Abstellraum, der Küche und dem Badezimmer kann auf dem Computer realistisch gerendert werden, genau wie bei der Aufnahme eines echten Videos.

Darüber hinaus können Sie komplexe Szenenrenderings auch auf einem iPhone durchführen.

Forscher von Google, Google DeepMind und der Universität Tübingen haben kürzlich eine neue Technologie SMERF vorgeschlagen.

Es kann große Szenen in Echtzeit auf verschiedenen Geräten, einschließlich Smartphones und Laptops, rendern.

Papieradresse: https://arxiv.org/pdf/2312.07541.pdf

Im Wesentlichen ist SMERF eine NeRFs-basierte Methode, die auf dem speichereffizienteren MERF (Memory-Efficient Radiance) basiert Felder).

NeRF ist tot?

Derzeit haben sich Radiance-Felder als leistungsstarke und leicht zu optimierende Darstellung für die Rekonstruktion und Neudarstellung fotorealistischer 3D-Szenen in der realen Welt herausgestellt.

Im Gegensatz zu expliziten Darstellungen wie Netzen und Punktwolken werden Strahlungsfelder typischerweise als neuronale Netze gespeichert und mittels volumetrischem Ray Marching gerendert.

Bei einem ausreichend großen Rechenbudget können neuronale Netze komplexe Geometrien und ansichtsabhängige Effekte prägnant darstellen.

Als volumetrische Darstellung wird die Anzahl der zum Rendern eines Bilds erforderlichen Vorgänge anhand der Anzahl der Pixel und nicht anhand der Anzahl der Grundelemente (z. B. Dreiecke) gemessen, wobei die leistungsstärksten Modelle Dutzende Millionen Netzwerke erfordern Auswertungen.

Daher gehen Echtzeit-Ansätze für Strahlungsfelder Kompromisse in Bezug auf Qualität, Geschwindigkeit oder Darstellungsgröße ein, und es bleibt eine offene Frage, ob solche Darstellungen mit Alternativen wie dem Gaußschen Splatting konkurrieren können.

In der neuesten Forschung schlägt der Autor eine skalierbare Methode vor, um Echtzeit-Rendering großer Räume mit höherer Wiedergabetreue als je zuvor zu erreichen.

SMERF-Echtzeit-Rendering mit zentimetergenauer Genauigkeit

SMERF wurde speziell für das Erlernen großer 3D-Darstellungen, wie z. B. das Rendern von Häusern, entwickelt.

Google und andere Forscher haben ein hierarchisches Modellaufteilungsschema kombiniert, bei dem verschiedene Teile des Raums und Lernparameter durch verschiedene MERFs dargestellt werden.

Dies erhöht nicht nur die Modellkapazität, sondern begrenzt auch den Rechen- und Speicherbedarf. Denn große 3D-Darstellungen wie diese lassen sich mit klassischem NERF nicht in Echtzeit rendern.

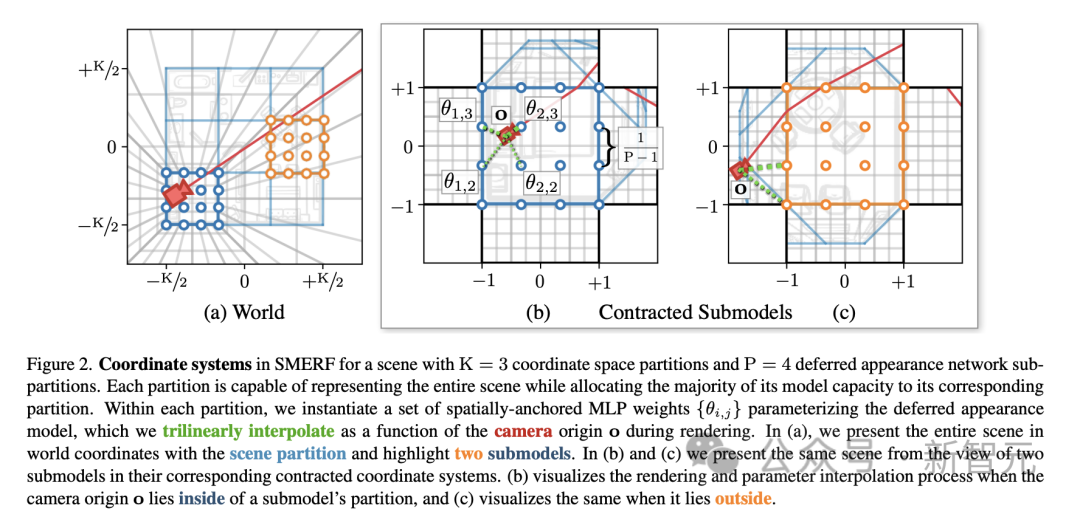

Das Koordinatensystem der Szene mit K=3 Koordinatenraumpartition und P=4 verzögerter Erscheinungsnetzwerk-Unterpartition in SMERF

Um die Renderqualität von SMERF zu verbessern, hat das Forschungsteam auch verwendete eine „Lehrer“-Schüler-Destillationsmethode.

Bei dieser Methode wird das bereits trainierte hochwertige Zip-Nerf-Modell (Lehrer) verwendet, um ein neues MERF-Modell (Schüler) zu trainieren.

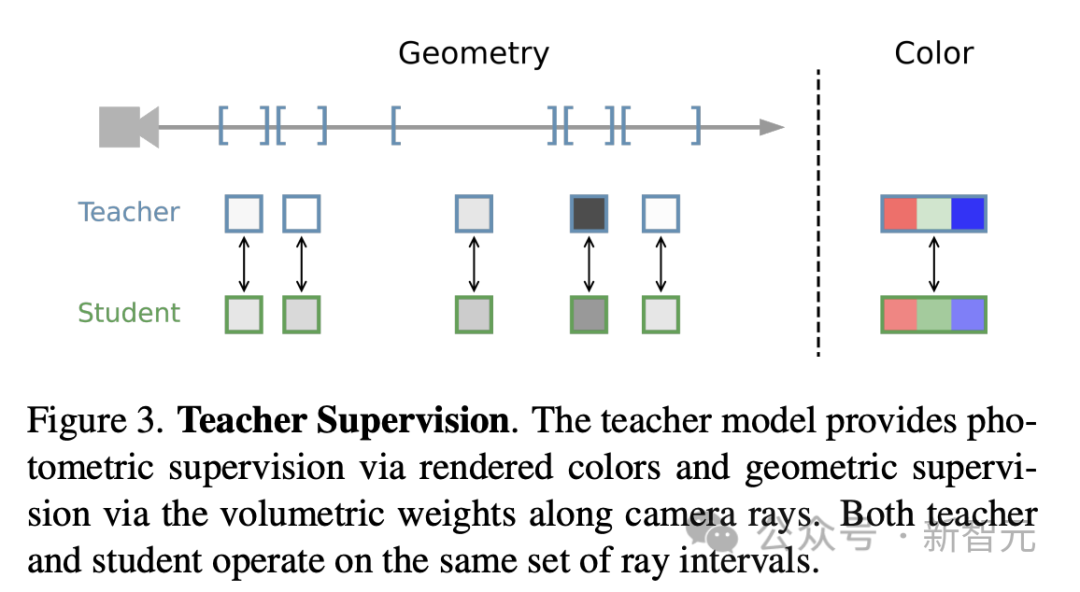

Wie unten gezeigt, der Gesamtprozess der „Lehreraufsicht“. Das Lehrermodell bietet eine fotometrische Überwachung durch Farbwiedergabe und eine geometrische Überwachung durch volumetrische Gewichtung entlang der Kamerastrahlen. Sowohl Lehrer als auch Schüler arbeiten mit denselben Lichtintervallen.

Dieser Ansatz ermöglicht es Forschern, die Detail- und Bildqualität leistungsstarker Zip-Nerf-Modelle auf effizientere und schnellere Strukturen zu übertragen.

Dies ist besonders nützlich für Apps auf leistungsschwächeren Geräten wie Smartphones und Laptops.

Experimentelle Bewertung

Die Forscher bewerteten die Methode zunächst anhand von vier von Zip-NeRF eingeführten Hauptszenarien: Berlin, Alameda, London und New York.

Jede dieser Szenen wurde aus 1.000–2.000 Fotos mit einem 180°-Fisheye-Objektiv aufgenommen. Für einen umfassenden Vergleich mit 3DGS haben die Forscher die Fotos auf 110° zugeschnitten und mithilfe von COLMAP die Kameraparameter neu geschätzt.

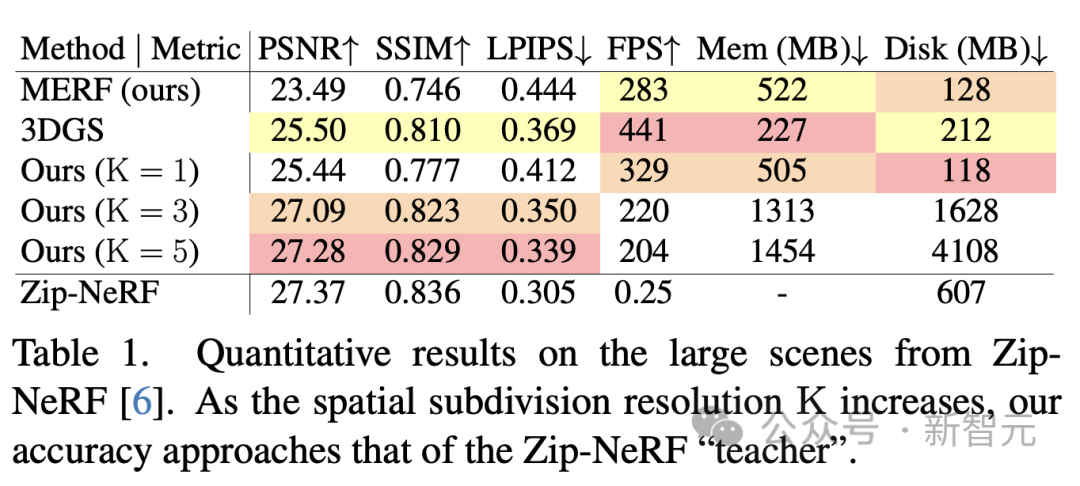

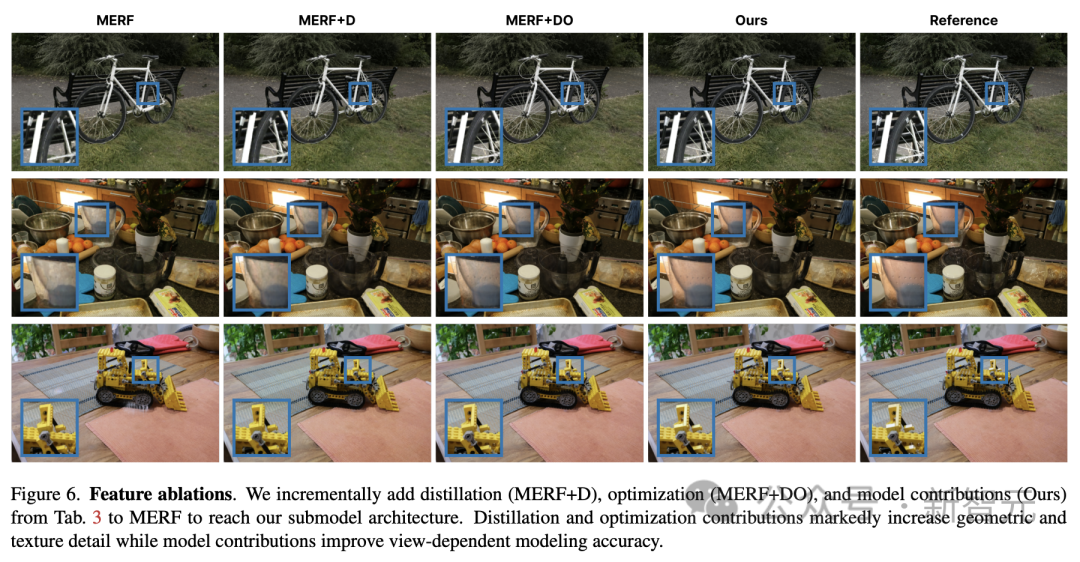

Die in Tabelle 1 dargestellten Ergebnisse zeigen, dass für moderate räumliche Unterteilungen K die Genauigkeit der modernsten Methoden MERF und 3DGS deutlich übertrifft.

Mit zunehmendem K verbessert sich die Rekonstruktionsgenauigkeit des Modells und kommt der Genauigkeit seines Zip-NeRF-Lehrers nahe. Der Unterschied beträgt weniger als 0,1 PSNR und 0,01 SSIM, wenn K=5.

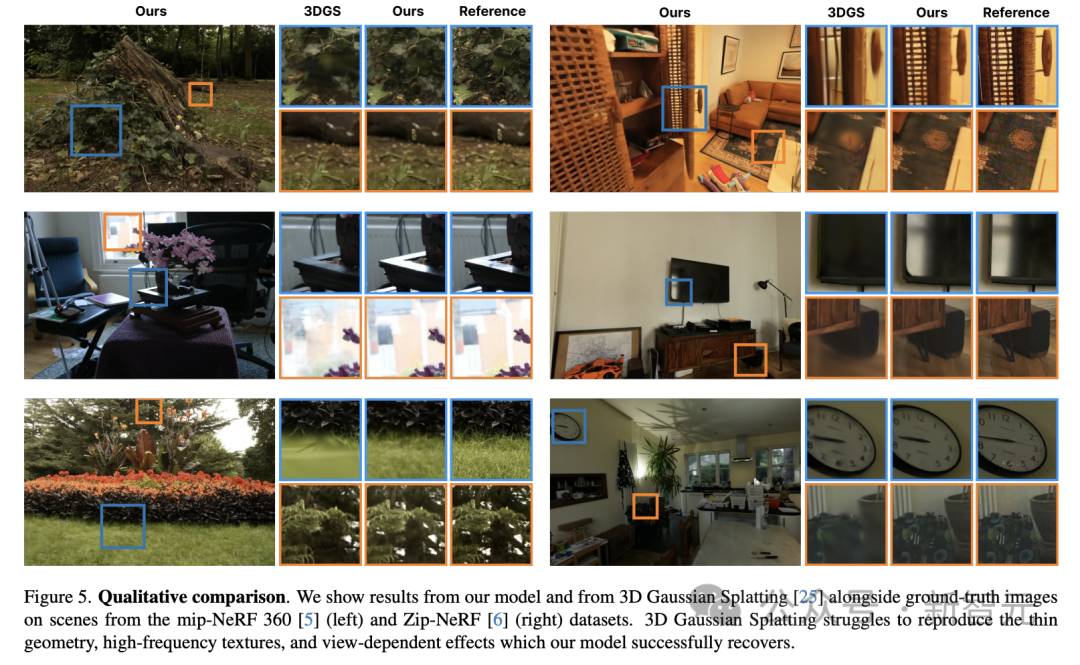

Die Forscher fanden außerdem heraus, dass diese quantitativen Verbesserungen die qualitativen Verbesserungen der Rekonstruktionsgenauigkeit unterschätzten, wie in Abbildung 5 dargestellt.

In großen Szenen modelliert die SMERF-Methode konsistent dünne Geometrie, Hochfrequenztexturen, Glanzlichter und entfernte Inhalte außerhalb der Reichweite von Echtzeit-Basislinien.

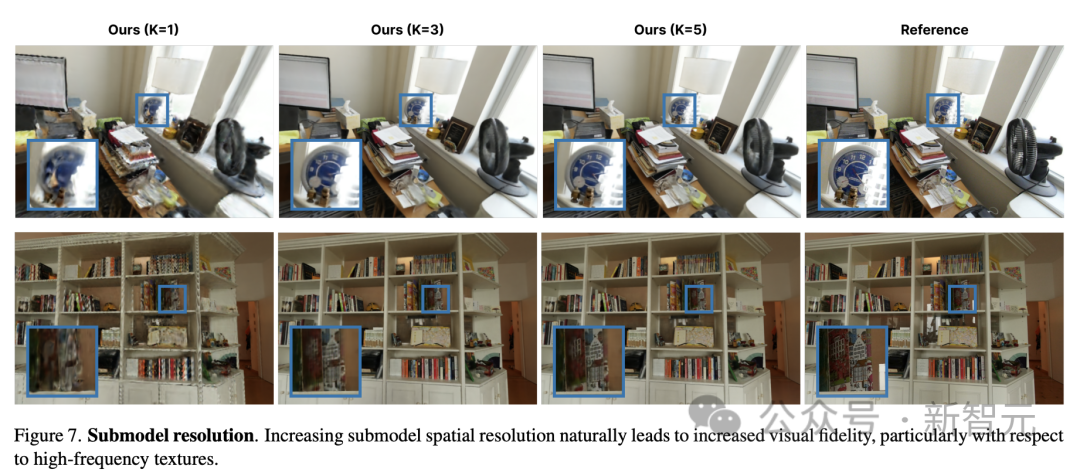

Gleichzeitig fanden Forscher heraus, dass eine Erhöhung der Submodellauflösung natürlich die Qualität verbessert, insbesondere im Hinblick auf Hochfrequenztexturen.

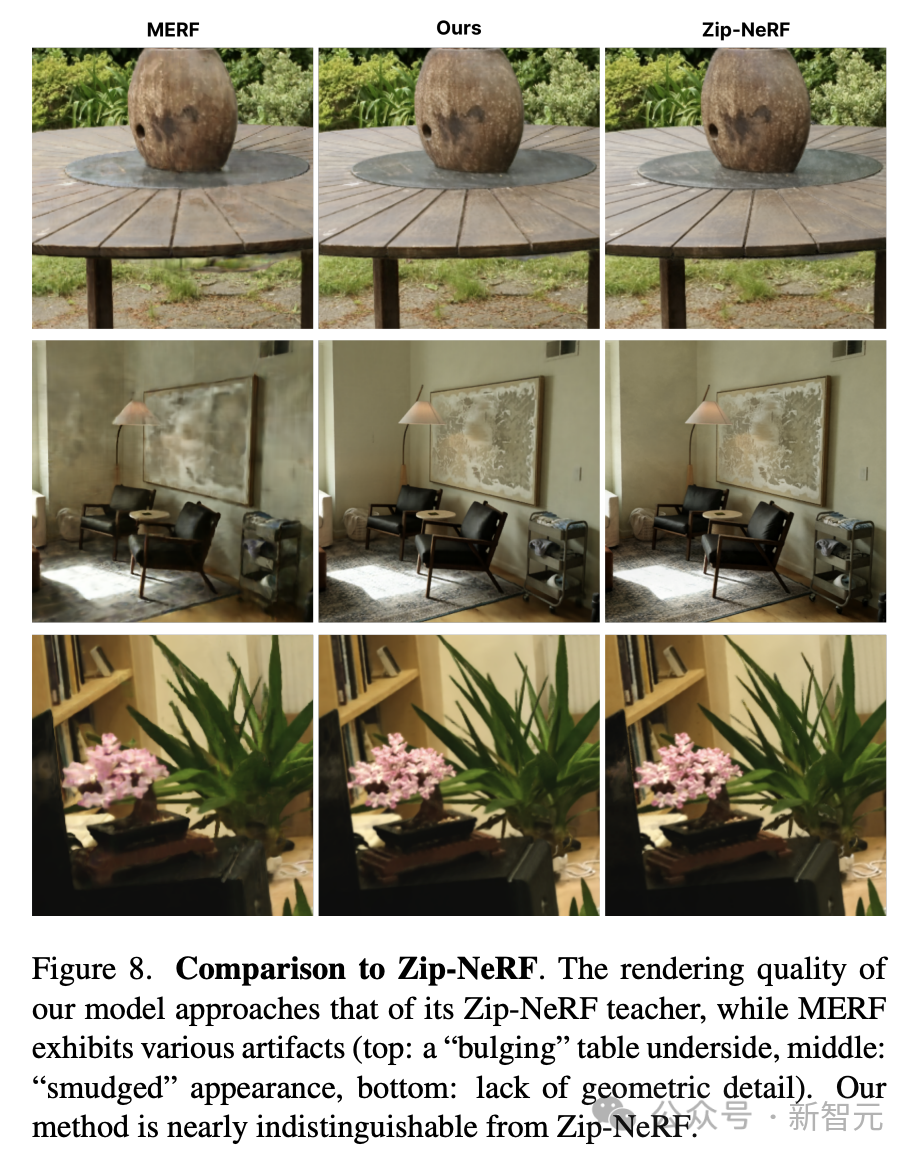

Tatsächlich fanden die Forscher heraus, dass die neueste Rendering-Methode kaum von Zip-NeRF zu unterscheiden ist, wie in Abbildung 8 dargestellt.

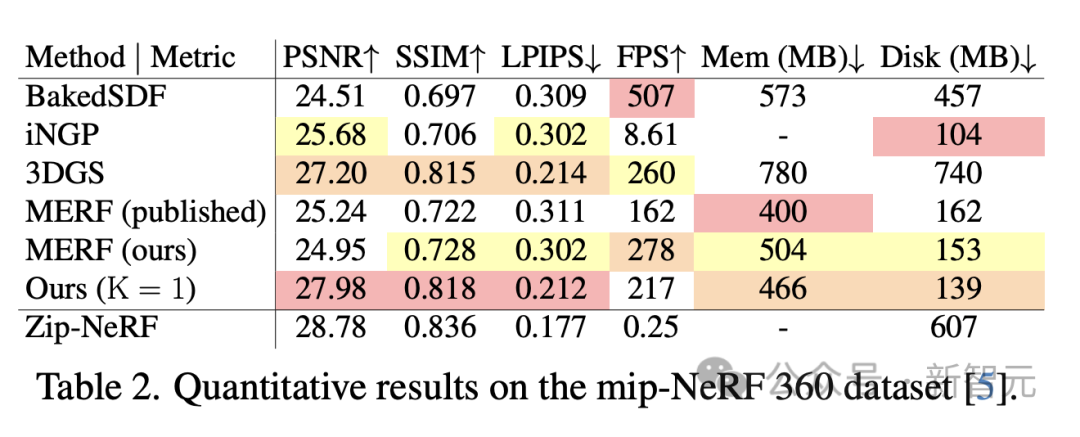

Darüber hinaus evaluierten die Forscher die hochmoderne Methode anhand des mip-NeRF 360-Datensatzes von Innen- und Außenszenen weiter.

Diese Szenen sind viel kleiner als die im Zip-NeRF-Datensatz, sodass keine räumliche Unterteilung erforderlich ist, um qualitativ hochwertige Ergebnisse zu erhalten. Wie in Tabelle 2 gezeigt, übertrifft die K=1-Version des Modells alle vorherigen Echtzeitmodelle in diesem Benchmark hinsichtlich der Bildqualität und rendert mit einer Geschwindigkeit, die mit 3DGS vergleichbar ist.

Die Abbildungen 6 und 8 veranschaulichen diese Verbesserung qualitativ, wobei die von den Forschern vorgeschlagene Methode viel besser in der Lage ist, hochfrequente Geometrie und Texturen darzustellen und gleichzeitig störende Floater und Nebel zu eliminieren.

Webseiten können realistische 3D-Räume übertragen

Nach dem Training kann SMERF volle 6 Freiheitsgrade beim Navigieren im Browser erreichen und in Echtzeit auf gängigen Smartphones und Laptops rendern.

Jeder weiß, dass die Fähigkeit, große 3D-Szenen in Echtzeit zu rendern, für eine Vielzahl von Anwendungen wichtig ist, darunter Videospiele, virtuelle Augmented Reality sowie professionelle Design- und Architekturanwendungen.

In Google Immersive Maps ist beispielsweise eine Echtzeitnavigation möglich.

Allerdings weisen die neuesten von Teams wie Google vorgeschlagenen Methoden auch gewisse Einschränkungen auf. Obwohl SMERF über eine hervorragende Rekonstruktionsqualität und Speichereffizienz verfügt, leidet es unter hohen Speicherkosten, langen Ladezeiten und hohem Schulungsaufwand.

Diese Studie zeigt jedoch, dass NeRFs und ähnliche Strahlungsfelder auch in Zukunft Vorteile gegenüber dreidimensionalen Gauß-Stitching-Methoden haben werden.

Das obige ist der detaillierte Inhalt vonDas iPhone rendert einen 300 Quadratmeter großen Raum in Echtzeit und erreicht dabei eine Genauigkeit im Zentimeterbereich! Googles neueste Forschung: NeRF ist noch nicht bankrott. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Was ist ein KI-Trainingscluster?

- Was sind die drei gängigen Datenbankdatenmodelle?

- Verwendung von Pytorch zur Implementierung des kontrastiven Lernens von SimCLR für selbstüberwachtes Vortraining

- Nicht zufrieden mit dem Mensch-Maschine-Dialog! Es wurde bekannt, dass Microsoft ChatGPT verwendet, um Roboter zu trainieren, damit sie Menschen im täglichen Leben dienen

- NUS und Byte arbeiteten branchenübergreifend zusammen, um durch Modelloptimierung ein 72-mal schnelleres Training zu erreichen, und gewannen den AAAI2023 Outstanding Paper.