Heim >Technologie-Peripheriegeräte >KI >Machen Sie eine Reise in die Zukunft, das erste Multi-View-Vorhersage- und Planungsmodell für autonomes Fahren ist da

Machen Sie eine Reise in die Zukunft, das erste Multi-View-Vorhersage- und Planungsmodell für autonomes Fahren ist da

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-12-04 08:37:271367Durchsuche

In letzter Zeit hat das Konzept des Weltmodells eine Welle der Begeisterung ausgelöst, doch der Bereich des autonomen Fahrens kann dem „Feuer“ nicht aus der Ferne zusehen. Ein Team des Instituts für Automatisierung der Chinesischen Akademie der Wissenschaften schlug erstmals ein neues Multi-View-Weltmodell namens Drive-WM vor, das darauf abzielt, die Sicherheit einer durchgängigen autonomen Fahrplanung zu verbessern.

Website: https://drive-wm.github.io

Papier-URL: https://arxiv.org/abs/2311.17918

Die erste Multi-View-Vorhersage und -Planung Autonomous Driving World Model

Auf dem CVPR2023 Autonomous Driving Seminar stellten die beiden großen Technologiegiganten Tesla und Wayve ihre schwarze Technologie vor und ein neues Konzept namens „Generative World Model“ wurde im Bereich des autonomen Fahrens populär. Wayve hat sogar das generative KI-Modell GAIA-1 veröffentlicht und damit seine beeindruckenden Fähigkeiten zur Videoszenengenerierung demonstriert. Kürzlich haben Forscher des Instituts für Automatisierung der Chinesischen Akademie der Wissenschaften auch ein neues Weltmodell für autonomes Fahren vorgeschlagen – Drive-WM, das erstmals ein prädiktives Weltmodell mit mehreren Ansichten realisiert und sich nahtlos in das aktuelle Mainstream-End integriert Durchgängiger Planer für autonomes Fahren.

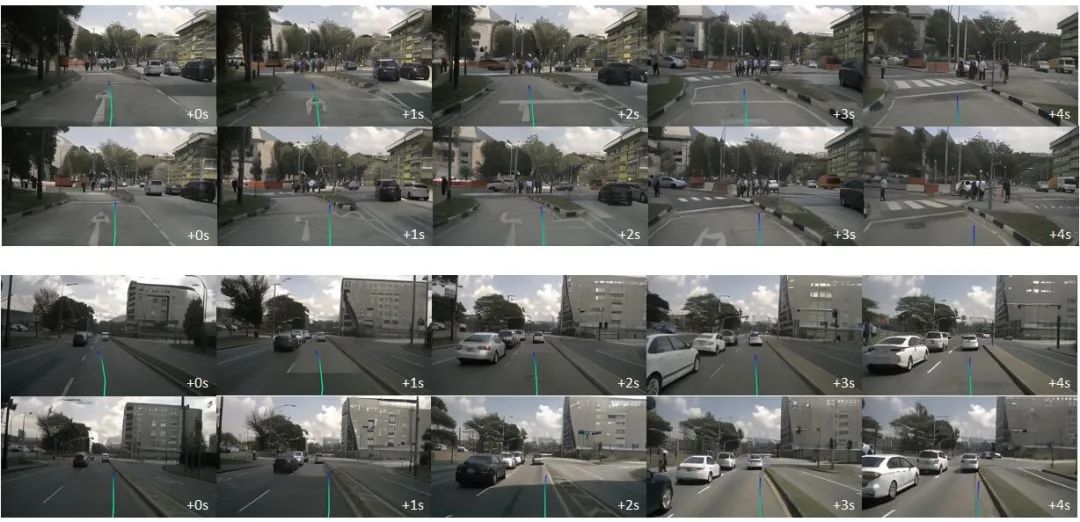

Drive-WM nutzt die leistungsstarken Generierungsfunktionen des Diffusionsmodells, um realistische Videoszenen zu generieren.

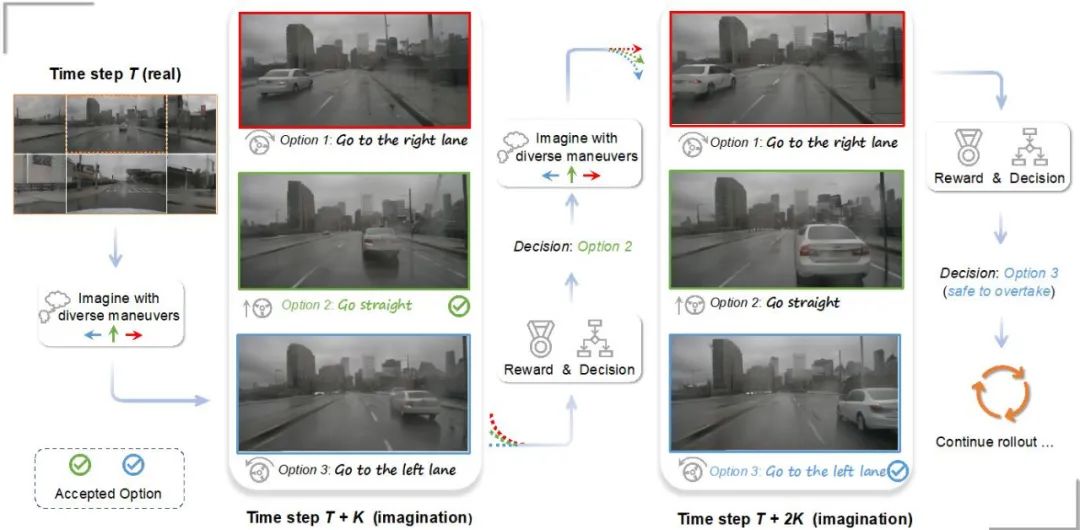

Stellen Sie sich vor, Sie fahren und Ihr Bordsystem prognostiziert zukünftige Entwicklungen basierend auf Ihren Fahrgewohnheiten und Straßenverhältnissen und generiert entsprechendes visuelles Feedback, um Sie bei der Auswahl der Flugrouten zu unterstützen. Diese Fähigkeit, die Zukunft vorherzusehen, kombiniert mit einem Planer, wird die Sicherheit des autonomen Fahrens erheblich verbessern!

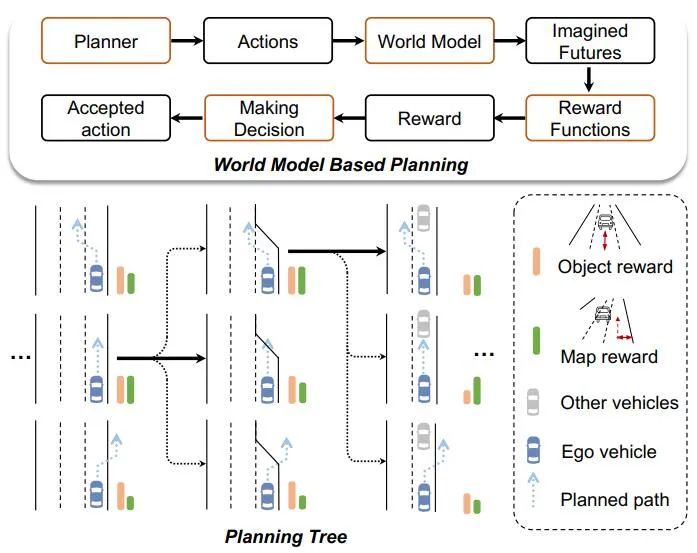

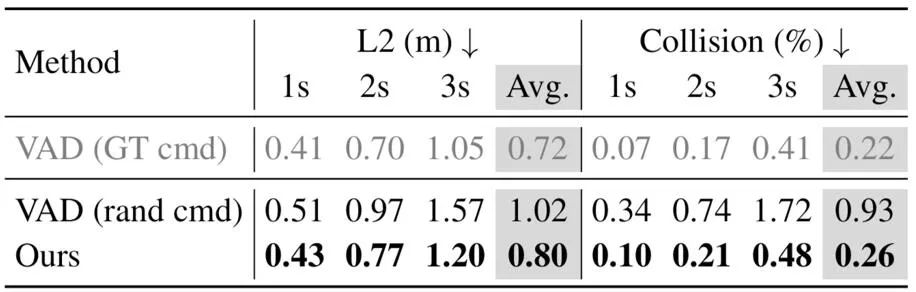

Prognose und Planung basierend auf Multi-View-Weltmodellen. Die Kombination aus Weltmodell und End-to-End-Autonomem Fahren verbessert die Fahrsicherheit -Ende des autonomen Fahrens. In jedem Zeitschritt kann der Planer mithilfe des Weltmodells mögliche Zukunftsszenarien vorhersagen und diese dann mithilfe der Bildbelohnungsfunktion vollständig bewerten.

Mit der besten Schätzmethode und der erweiterten Planungsbaumtechnologie kann eine effektivere und sicherere Planung erreicht werden

Drive-WM untersucht zwei Anwendungen von Weltmodellen in der End-to-End-Planung durch innovative Forschung.

1 Demonstriert die Robustheit von Weltmodellen bei der Bewältigung von OOD-Szenarien. Durch Vergleichsexperimente stellte der Autor fest, dass die Leistung des aktuellen End-to-End-Planers in OOD-Situationen nicht ideal ist.

Der Autor gibt das folgende Bild ab. Wenn ein leichter seitlicher Versatz zur Ausgangsposition gestört wird, hat der aktuelle End-to-End-Planer Schwierigkeiten, eine vernünftig geplante Route auszugeben.

Der End-to-End-Planer hat Schwierigkeiten, in OOD-Situationen vernünftige Planungsrouten auszugeben.

Die leistungsstarke Generierungsfähigkeit von Drive-WM liefert neue Ideen zur Lösung von OOD-Problemen. Der Autor verwendet die generierten Videos, um den Planer zu optimieren und aus den OOD-Daten zu lernen, damit der Planer bei der Bewältigung solcher Szenarien eine bessere Leistung erzielen kann.

2 Dies zeigt, dass die Einführung einer zukünftigen Szenariobewertung sehr wichtig ist End-to-End Der Verbesserungseffekt der Planung

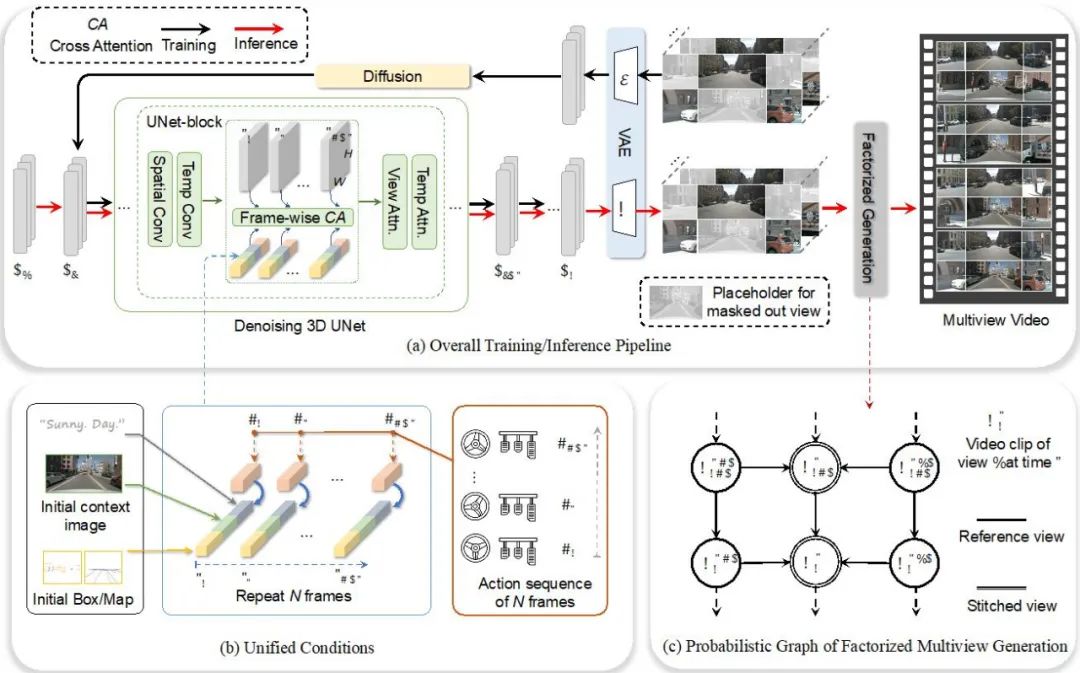

So erstellen Sie ein Multi-View-Videogenerierungsmodell

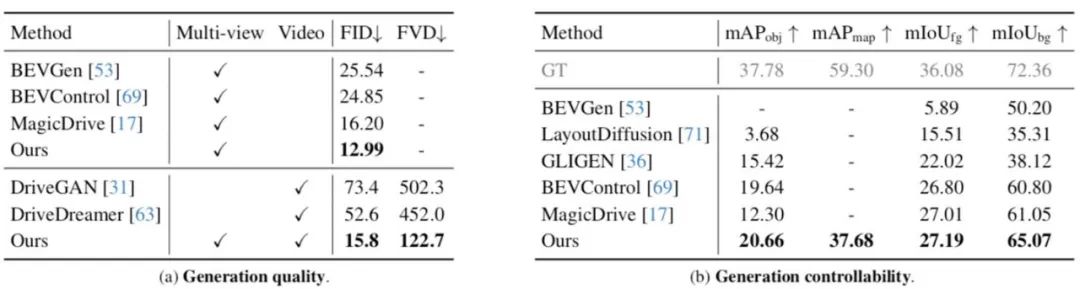

Die räumlich-zeitliche Konsistenz der Multiview-Videogenerierung war schon immer ein herausforderndes Problem. Drive-WM erweitert die Möglichkeiten der Videogenerierung durch die Einführung einer sequentiellen Layer-Codierung und erreicht die Generierung von Multiview-Videos durch View-Decomposition-Modellierung. Diese Generierungsmethode der Ansichtszerlegung kann die Konsistenz zwischen Ansichten erheblich verbessern.

Drive-WM-Gesamtmodelldesign Multi-View-Videoerzeugung mit hervorragender Steuerbarkeit. Es bietet eine Vielzahl von Steuerungsoptionen zur Steuerung der Erstellung von Multi-View-Videos durch Text, Szenenlayout und Bewegungsinformationen. Es bietet auch neue Möglichkeiten für zukünftige neuronale Simulatoren, wie z. B. die Verwendung von Text zum Ändern von Wetter und Beleuchtung:

Zum Beispiel Fußgängergenerierung und Vordergrundbearbeitung:

Verwenden Sie Methoden zur Geschwindigkeits- und Richtungssteuerung:

Erzeugen Sie seltene Ereignisse, z. B. das Wenden an einer Kreuzung oder das Einfahren in seitliches Gras

Fazit

Drive-WM demonstriert nicht nur seine leistungsstarken Multi-View-Videogenerierungsfunktionen, sondern zeigt auch das große Potenzial der Kombination von Weltmodellen mit End-to-End-Fahrmodellen auf. Wir glauben, dass Weltmodelle in Zukunft dazu beitragen können, ein sichereres, stabileres und zuverlässigeres durchgängiges autonomes Fahrsystem zu schaffen.

Das obige ist der detaillierte Inhalt vonMachen Sie eine Reise in die Zukunft, das erste Multi-View-Vorhersage- und Planungsmodell für autonomes Fahren ist da. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Überblick über das Technologie-Framework für autonomes Fahren

- Wie lange wird es dauern, bis autonomes Fahren realisierbar ist?

- Autonomes Fahren und intelligente Netzwerktechnologie in Java

- Ein Artikel zum Verständnis der Lidar- und visuellen Fusionswahrnehmung des autonomen Fahrens

- Verwenden Sie JavaScript, um 3D-Modelle und visuelle Effekte zu erstellen und anzuzeigen