Heim >Technologie-Peripheriegeräte >KI >Neuer Titel: Meta verbessert die Transformer-Architektur: ein neuer Aufmerksamkeitsmechanismus, der die Argumentationsfähigkeiten verbessert

Neuer Titel: Meta verbessert die Transformer-Architektur: ein neuer Aufmerksamkeitsmechanismus, der die Argumentationsfähigkeiten verbessert

- PHPznach vorne

- 2023-11-24 14:53:48905Durchsuche

Die Leistungsfähigkeit großer Sprachmodelle (LLM) ist eine unbestrittene Tatsache. Dennoch machen sie manchmal einfache Fehler und zeigen eine schwache Seite der Denkfähigkeit.

LLM kann beispielsweise aufgrund des Kontexts oder der Vorlieben oder Meinungen irrelevant sein Eingabeaufforderungen inhärent. Die letztere Situation stellt ein Problem dar, das als „Speichelei“ bekannt ist und bei dem das Modell mit der Eingabe konsistent bleibt. Gibt es eine Möglichkeit, diese Art von Problem zu lindern? Einige Wissenschaftler versuchen, das Problem zu lösen, indem sie mehr überwachte Trainingsdaten oder verstärkte Lernstrategien hinzufügen, aber diese Methoden können das Problem nicht grundsätzlich lösen Probleme, insbesondere mit seinem Aufmerksamkeitsmechanismus. Mit anderen Worten: Weiche Aufmerksamkeit tendiert dazu, dem größten Teil des Kontexts (einschließlich irrelevanter Teile) Wahrscheinlichkeit zuzuweisen und schenkt wiederholten Token zu viel Aufmerksamkeit

Daher schlugen die Forscher einen völlig anderen Ansatz für den Aufmerksamkeitsmechanismus vor: Das heißt, Aufmerksamkeit wird ausgeführt durch die Verwendung von LLM als Natural Language Reasoner. Insbesondere nutzten sie die Fähigkeit von LLM, Anweisungen zu befolgen, die sie dazu veranlassen, den Kontext zu generieren, auf den sie sich konzentrieren sollten, sodass sie nur relevantes Material einbeziehen, das ihre eigene Argumentation nicht verzerrt. Die Forscher nennen diesen Prozess System-2-Aufmerksamkeit (S2A) und betrachten den zugrunde liegenden Transformator und seinen Aufmerksamkeitsmechanismus als einen automatischen Vorgang, der dem menschlichen System-1-Denken ähnelt Wenn etwas schief geht, verteilt System 2 anstrengende geistige Aktivitäten und übernimmt die menschliche Arbeit. Daher verfolgt dieses Subsystem ähnliche Ziele wie das vom Forscher vorgeschlagene S2A, das den Ausfall der weichen Aufmerksamkeit des oben genannten Transformators durch zusätzliche Arbeit an der Inferenzmaschine lindern möchte. Der Inhalt, der neu geschrieben werden muss, ist: Papierlink : https://arxiv.org/pdf/2311.11829.pdf

Der Forscher beschrieb ausführlich die Kategorien, Motivationen und mehrere spezifische Implementierungen des S2A-Mechanismus. In der experimentellen Phase bestätigten sie, dass S2A ein objektiveres und weniger subjektives Voreingenommenheits- oder Schmeichelei-LLM erzeugen kann als ein standardmäßiges aufmerksamkeitsbasiertes LLM

insbesondere im modifizierten TriviQA-Datensatz, bei dem die Frage im Vergleich zu LLaMA störende Standpunkte enthält -2-70B-chat, S2A verbesserte die Faktizität von 62,8 % auf 80,3 %; bei der Aufgabe zur Erzeugung von Langformparametern, die ablenkende Eingabeemotionen enthielt, verbesserte sich die Objektivität von S2A um 57,4 % und wurde im Wesentlichen nicht durch die Auswirkung des Einfügens von Perspektiven beeinflusst. Darüber hinaus verbesserte S2A bei mathematischen Textaufgaben mit irrelevanten Sätzen in GSM-IC die Genauigkeit von 51,7 % auf 61,3 %.

Diese Studie wurde von Yann LeCun empfohlen.

System 2 Achtung

Abbildung 1 unten zeigt ein Beispiel einer Pseudokorrelation. Selbst das leistungsfähigste LLM ändert die Antwort auf eine einfache Faktenfrage, wenn der Kontext irrelevante Sätze enthält, da das Vorhandensein von Wörtern im Kontext unbeabsichtigt die Wahrscheinlichkeit einer falschen Antwort erhöht

Deshalb müssen wir arbeiten auf einem besser verstandenen, durchdachteren Aufmerksamkeitsmechanismus. Um ihn vom Aufmerksamkeitsmechanismus auf niedrigerer Ebene zu unterscheiden, schlugen die Forscher ein System namens S2A vor. Sie untersuchten eine Möglichkeit, LLM selbst zu nutzen, um diesen Aufmerksamkeitsmechanismus aufzubauen, und passten insbesondere das LLM an, indem sie irrelevanten Text entfernten, um kontextbezogene Anweisungen neu zu schreiben

Mit diesem Ansatz ist das LLM in der Lage, zu reagieren, bevor eine Antwort generiert wird. Sorgfältige Argumentation und Entscheidungsfindung über relevante Teile der Eingabe. Ein weiterer Vorteil der Verwendung von anweisungsangepasstem LLM besteht darin, dass es den Fokus der Aufmerksamkeit steuern kann, was in gewisser Weise der Art und Weise ähnelt, wie Menschen ihre Aufmerksamkeit steuern und zwei Schritte umfassen:

- Bei einem gegebenen Kontext x regeneriert S2A zunächst den Kontext x‘ und entfernt dadurch irrelevante Teile des Kontexts, die sich negativ auf die Ausgabe auswirken würden. Dieser Artikel drückt es als x ′ ∼ S2A (x) aus.

- Bei gegebenem x ′ wird dann der neu generierte Kontext anstelle des ursprünglichen Kontexts verwendet, um die endgültige Antwort des LLM zu generieren: y ∼ LLM (x ′ ).

Alternative Implementierungen und Variationen

In diesem Artikel haben wir uns mehrere verschiedene Versionen des S2A-Ansatzes

ohne Kontext- und Problemtrennung angesehen. In der Implementierung von Abbildung 2 entscheiden wir uns dafür, den in zwei Teile (Kontext und Frage) zerlegten Kontext neu zu generieren. Abbildung 12 zeigt eine Variation dieser Eingabeaufforderung.

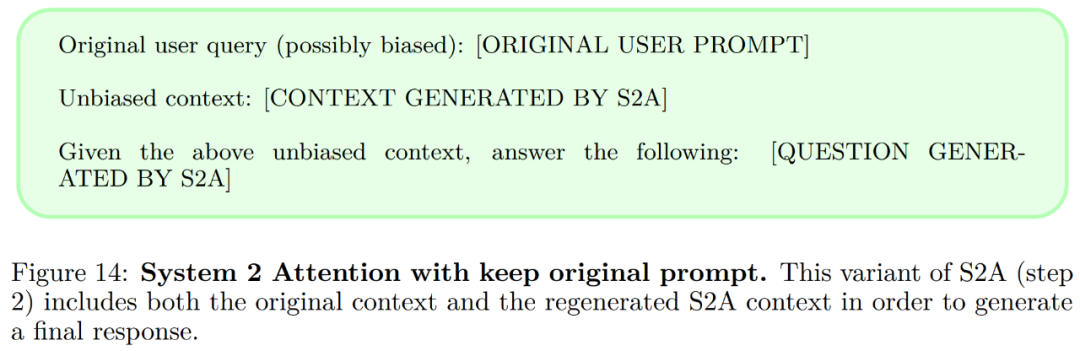

Ursprünglichen Kontext beibehalten In S2A sollten nach der Neugenerierung des Kontexts alle notwendigen Elemente, die berücksichtigt werden sollten, enthalten sein, dann reagiert das Modell nur auf den neu generierten Kontext, der ursprüngliche Kontext wird verworfen. Abbildung 14 zeigt eine Variation dieser Eingabeaufforderung.

Imperative Aufforderungen. Die in Abbildung 2 dargestellte S2A-Eingabeaufforderung ermutigt dazu, meinungsgebundenen Text aus dem Kontext zu entfernen und erfordert eine Antwort, die nicht meinungsgebunden ist, unter Verwendung der Anweisungen in Schritt 2 (Abbildung 13).

S2A-Implementierungen legen alle Wert auf die Regenerierung des Kontexts, um die Objektivität zu erhöhen und Speichelleckerei zu reduzieren. Der Artikel argumentiert jedoch, dass es noch andere Punkte gibt, die hervorgehoben werden müssen, zum Beispiel können wir Relevanz gegenüber Irrelevanz betonen. Die Eingabeaufforderungsvariante in Abbildung 15 zeigt ein Beispiel. Darüber hinaus verwendet dieser Artikel LLaMA-2-70B-chat als Basismodell, das in zwei Einstellungen ausgewertet wird . Die Modellgenerierung kann durch falsche Korrelationen in der Eingabe beeinträchtigt werden.

Oracle-Eingabeaufforderung: Eingabeaufforderungen ohne zusätzliche Meinungen oder irrelevante Sätze werden in das Modell eingespeist und im Zero-Shot-Verfahren beantwortet.

Oracle-Eingabeaufforderung: Eingabeaufforderungen ohne zusätzliche Meinungen oder irrelevante Sätze werden in das Modell eingespeist und im Zero-Shot-Verfahren beantwortet.

Abbildung 5 (links) zeigt die Bewertungsergebnisse zur Beantwortung von Faktenfragen. System 2 Attention stellt eine enorme Verbesserung gegenüber der ursprünglichen Eingabeaufforderung dar und erreicht eine Genauigkeit von 80,3 % – nahe der Leistung von Oracle Prompt.

- Die Gesamtergebnisse zeigen, dass Baseline, Oracle Prompt und System 2 Attention alle ähnlich hochwertige Auswertungen liefern können. Abbildung 6 (rechts) zeigt die Teilergebnisse:

Das obige ist der detaillierte Inhalt vonNeuer Titel: Meta verbessert die Transformer-Architektur: ein neuer Aufmerksamkeitsmechanismus, der die Argumentationsfähigkeiten verbessert. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Auf welcher Ebene des osi-Modells ist die Pfadauswahlfunktion abgeschlossen?

- Zurück in die Zukunft! Dieser Programmierer nutzte Kindheitstagebücher zum Trainieren der KI und nutzte GPT-3, um einen Dialog mit seinem „vergangenen Ich' zu erreichen.

- Das Training von ViT und MAE reduziert den Rechenaufwand um die Hälfte! Sea und die Peking-Universität haben gemeinsam den effizienten Optimierer Adan vorgeschlagen, der für tiefe Modelle verwendet werden kann

- Volcano Engine unterstützt Shenzhen Technology bei der Veröffentlichung des branchenweit ersten molekularen 3D-Vortrainingsmodells Uni-Mol

- Detaillierte Erläuterung des Deep-Learning-Pre-Training-Modells in Python