Heim >Technologie-Peripheriegeräte >KI >Von Matroschka-Puppen wird abgeraten: Forscher bestätigen, dass das Training von KI mit KI-generierten Ergebnissen zu einer Verschlechterung des Modells führt

Von Matroschka-Puppen wird abgeraten: Forscher bestätigen, dass das Training von KI mit KI-generierten Ergebnissen zu einer Verschlechterung des Modells führt

- 王林nach vorne

- 2023-06-15 21:27:501214Durchsuche

IT House News vom 14. Juni, Freunde des IT House haben sich vielleicht vorgestellt, welche Ergebnisse erzielt werden können, wenn die von der KI generierten Ergebnisse zum Trainieren der KI und zum Durchführen eines „Trainings im Matroschka-Stil“ verwendet werden? Derzeit gibt es ein Forschungsteam, das dies beobachtet und aufgezeichnet hat, und detaillierte Arbeiten und Ergebnisse wurden auf arXiv veröffentlicht.

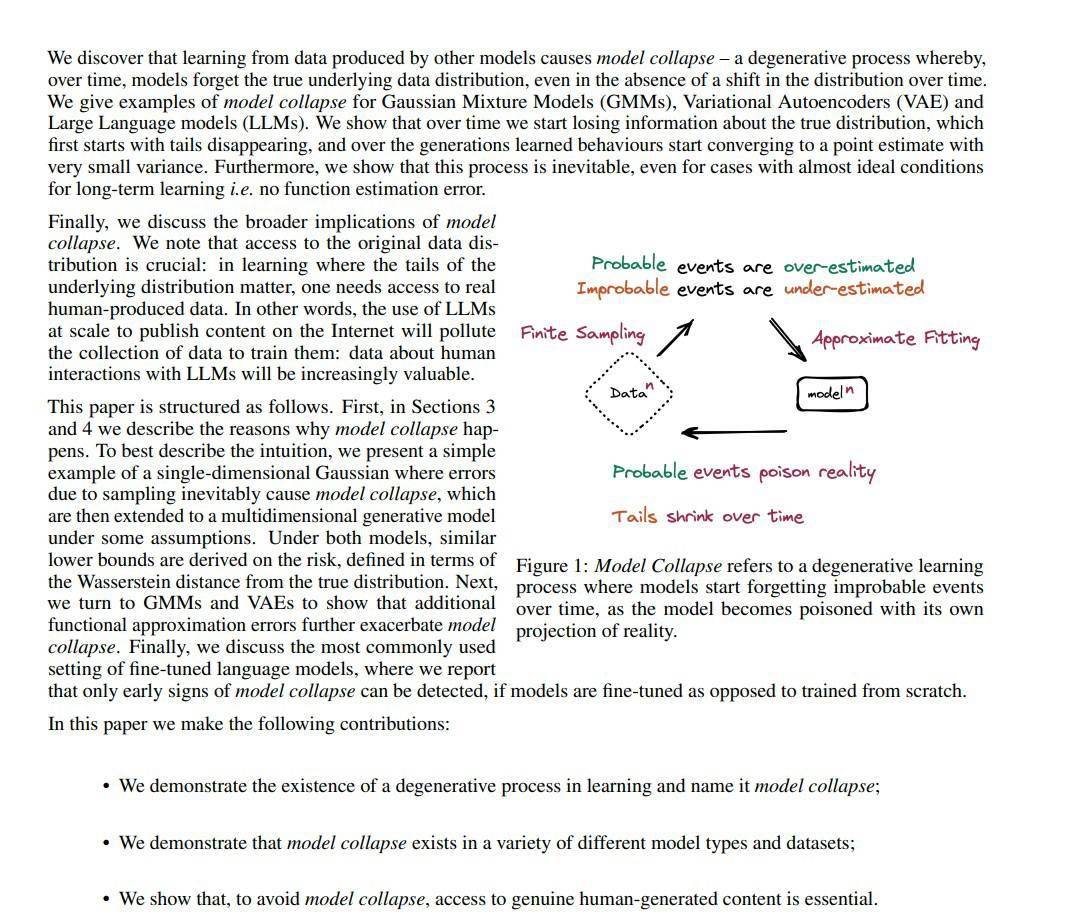

Zusammenfassung eines Satzes: „Die Verwendung von vom Modell generierten Inhalten im Training führt zu irreversiblen Fehlern im anschließend generierten Modell.“ es wird immer schlimmer.“

▲ Bildquelle arXiv

Es wird berichtet, dass die Forscher speziell die Wahrscheinlichkeitsverteilung von KI-Generierungsmodellen untersucht haben, wobei sie sich hauptsächlich auf „Text zu Text“ und „Bild zu Bild“ konzentrierten und schließlich zu dem Schluss kamen: „Da die von jedem Modell generierten Ergebnisse bestimmte Merkmale aufweisen, verwenden Sie KI.“ -Generierte Modelle zum Trainieren der KI, und mit der Zeit vergisst diese die tatsächliche zugrunde liegende Datenverteilung.“

▲ Bildquelle arXiv

Ilia Shumailov, eine der Hauptautorinnen des Papiers, sagte auch, dass „im Laufe der Zeit Fehler in den generierten Daten (IT Home Note: wie etwa falsche Beispiele) die KI dazu zwingen werden, die Realität weiter falsch wahrzunehmen, und wir waren überrascht, einen Modellzusammenbruch zu beobachten.“ . ist ziemlich schnell und Modelle können schnell viele der Originaldaten vergessen, aus denen sie ursprünglich gelernt haben.“

Aber Freunde haben vielleicht Fragen: Kann das Modell „degeneriert“ werden, wenn die von der KI generierten Ergebnisse manuell poliert und dann in das Modelltraining einfließen?

Die Antwort lautet „Nein“. Die Forscher fanden heraus, dass „der Modellverschlechterungsprozess unvermeidlich ist“, sodass das Modell selbst bei „polierten und idealisierten KI-Ausgabeinhalten“ nach langfristigem Lernen eine gewisse Verschlechterung erfahren wird.

Für jedes große Modell kommen sie aufgrund zu vieler Lerndaten unweigerlich mit Daten in Kontakt, die von anderen KIs generiert werden. Daher sagten die Forscher, dass „KI-Identifikation eingeführt werden sollte, um potenziell fehlerhafte Lerndaten herauszufiltern“, um das Lernen zu verbessern Fähigkeit und Genauigkeit des Modells.

Das obige ist der detaillierte Inhalt vonVon Matroschka-Puppen wird abgeraten: Forscher bestätigen, dass das Training von KI mit KI-generierten Ergebnissen zu einer Verschlechterung des Modells führt. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr