Heim >Technologie-Peripheriegeräte >KI >Sechs Trägheitssensoren und ein Mobiltelefon ermöglichen die Erfassung, Positionierung und Rekonstruktion der Umgebungsbewegung des menschlichen Körpers

Sechs Trägheitssensoren und ein Mobiltelefon ermöglichen die Erfassung, Positionierung und Rekonstruktion der Umgebungsbewegung des menschlichen Körpers

- 王林nach vorne

- 2023-05-17 21:16:261975Durchsuche

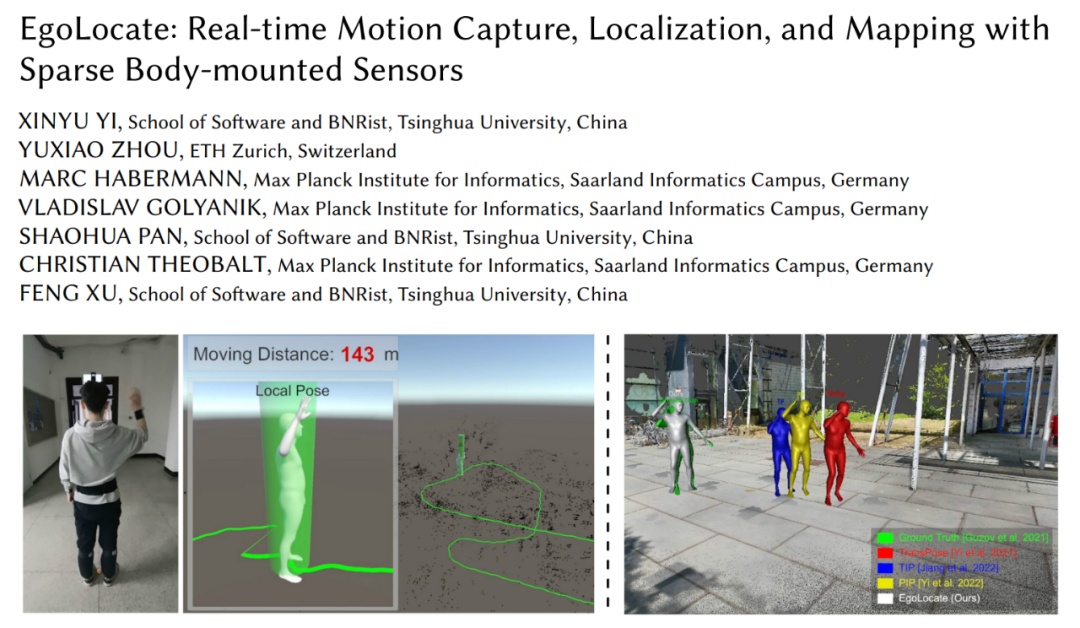

Dieser Artikel versucht, die „Augen“ der Trägheitsbewegungserfassung zu öffnen. Durch das Tragen einer zusätzlichen Handykamera erhält unser Algorithmus „Vision“. Es kann Umgebungsinformationen erfassen und gleichzeitig menschliche Bewegungen erfassen, wodurch eine präzise Positionierung des menschlichen Körpers erreicht wird. Diese Forschung stammt vom Team von Xu Feng an der Tsinghua-Universität und wurde von SIGGRAPH2023, der führenden internationalen Konferenz im Bereich Computergrafik, angenommen.

- Papieradresse: https://arxiv.org/abs/2305.01599

- Projekthomepage: https://xinyu-yi.github.io/EgoLocate/

- Open-Source-Code: https://github.com/Xinyu-Yi/EgoLocate

Einführung

Mit der Entwicklung der Computertechnologie sind die Wahrnehmung des menschlichen Körpers und der Umgebung zu zwei unverzichtbaren Bestandteilen moderner intelligenter Anwendungen geworden. Die Technologie zur Erfassung des menschlichen Körpers kann Mensch-Computer-Interaktion, intelligente medizinische Versorgung, Spiele und andere Anwendungen realisieren, indem sie Bewegungen und Aktionen des menschlichen Körpers erfasst. Mit der Umgebungssensorik können durch die Rekonstruktion von Szenenmodellen Anwendungen wie dreidimensionale Rekonstruktion, Szenenanalyse und intelligente Navigation realisiert werden. Die beiden Aufgaben sind voneinander abhängig, werden aber von den meisten im In- und Ausland vorhandenen Technologien unabhängig voneinander gelöst. Das Forschungsteam ist davon überzeugt, dass die kombinierte Wahrnehmung menschlicher Bewegung und Umwelt für Szenarien, in denen Menschen mit der Umwelt interagieren, sehr wichtig ist. Erstens kann die gleichzeitige Erfassung des menschlichen Körpers und der Umwelt die Effizienz und Sicherheit der menschlichen Interaktion mit der Umwelt verbessern. Bei selbstfahrenden Autos beispielsweise kann die gleichzeitige Erfassung des Verhaltens des Fahrers und der Umgebung die Sicherheit und den reibungslosen Fahrbetrieb besser gewährleisten. Zweitens kann durch die gleichzeitige Wahrnehmung des menschlichen Körpers und der Umgebung ein höheres Maß an Mensch-Computer-Interaktion erreicht werden. Beispielsweise kann in der virtuellen Realität und der erweiterten Realität durch die gleichzeitige Wahrnehmung der Aktionen des Benutzers und der Umgebung ein immersiveres Erlebnis erzielt werden . Daher kann uns die gleichzeitige Wahrnehmung des menschlichen Körpers und der Umwelt eine effizientere, sicherere und intelligentere Mensch-Computer-Interaktion und ein Anwendungserlebnis in der Umwelt ermöglichen. Auf dieser Grundlage schlug Das Team von Bild in 1). Die Inertial Motion Capture (Mocap)-Technologie erforscht „interne“ Informationen wie Bewegungssignale des menschlichen Körpers, während die Simultaneous Localization and Mapping (SLAM)-Technologie hauptsächlich auf „externen“ Informationen, also der von der Kamera erfassten Umgebung, basiert. Ersteres hat eine gute Stabilität, aber da es keine externe korrekte Referenz gibt, kommt es bei langfristigen Bewegungen zu einer globalen Positionsdrift. Letzteres kann die globale Position in der Szene mit hoher Genauigkeit schätzen, aber wenn die Umgebungsinformationen unzuverlässig sind (z. B keine Textur oder es liegt eine Okklusion vor), es ist leicht, die Verfolgung zu verlieren.

Daher kombiniert dieser Artikel effektiv diese beiden komplementären Technologien (Mocap und SLAM). Eine robuste und genaue menschliche Positionierung und Kartenrekonstruktion werden durch die Fusion menschlicher Bewegungsprioritäten und visueller Verfolgung auf mehreren Schlüsselalgorithmen erreicht.

Abbildung 1 Dieser Artikel schlägt eine Technologie zur gleichzeitigen Erfassung menschlicher Bewegungen und Umgebungskartierung vor

In unserem System fungiert die monokulare Kamera als menschliches Auge und liefert visuelle Signale für die Echtzeit-Szenenrekonstruktion und Selbstpositionierung für diese Technologie, während die IMU die Bewegung der menschlichen Gliedmaßen und des Kopfes misst. Dieses Setup ist mit vorhandener VR-Ausrüstung kompatibel und kann die Kamera im VR-Headset und eine zusätzliche IMU verwenden, um eine stabile, driftfreie Ganzkörper-Bewegungserfassung und Umgebungswahrnehmung durchzuführen.

Zum ersten Mal erreicht das gesamte System die gleichzeitige Erfassung menschlicher Bewegungen und die Rekonstruktion spärlicher Umgebungspunkte auf der Grundlage von nur 6 IMUs und 1 Kamera. Die Laufgeschwindigkeit erreicht 60 fps auf der CPU und die Genauigkeit übertrifft die fortschrittlichsten Technologien in beiden Bereichen zur gleichen Zeit.Echtzeitbeispiele dieses Systems sind in Abbildung 2 und Abbildung 3 dargestellt.

Abbildung 2 Bei der komplexen Bewegung von 70 Metern verfolgt dieses System genau die Position des menschlichen Körpers und erfasst die Bewegungen des menschlichen Körpers ohne offensichtliche Positionsabweichung.

Abbildung 3 Ein Echtzeitbeispiel dieses Systems, das gleichzeitig menschliche Bewegungen und spärliche Szenenpunkte rekonstruiert.

Methodeneinführung

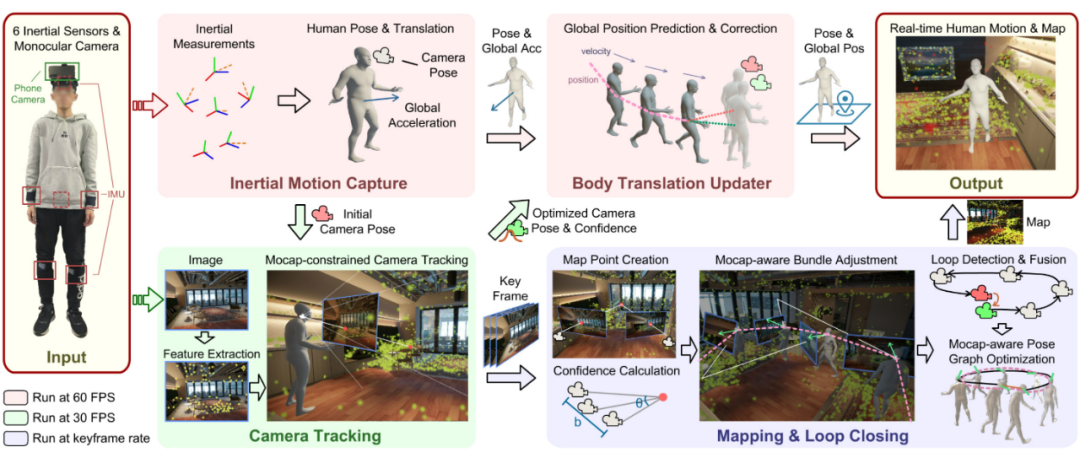

Abbildung 4 Gesamter Methodenablauf

Die Aufgabe des Systems besteht darin, Echtzeitinformationen aus den Orientierungs- und Beschleunigungsmessungen der 6 IMU-Sensoren zu gewinnen und die von der Kamera aufgenommenen Farbbilder rekonstruieren menschliche Bewegungen, spärliche Punktwolken dreidimensionaler Szenen und lokalisieren die Positionen von Personen in der Szene. Wir entwerfen ein tief gekoppeltes Framework, um die komplementären Vorteile der Sparse-Inertial-Motion-Capture- und SLAM-Technologien voll auszuschöpfen. In diesem Rahmen werden menschliche Bewegungsprioritäten mit mehreren Schlüsselkomponenten von SLAM kombiniert, und die Positionierungsergebnisse von SLAM werden auch an die menschliche Bewegungserfassung zurückgekoppelt. Wie in Abbildung 4 dargestellt, unterteilen wir das System entsprechend den Funktionen in vier Module: Trägheitsbewegungserfassungsmodul (Inertial Motion Capture), Kameraverfolgungsmodul (Camera Tracking), Mapping und Closed-Loop-Erkennungsmodul (Mapping). & Loop Closing) und das Aktualisierungsmodul für menschliche Bewegungen (Body Translation Updater). Jedes Modul wird im Folgenden vorgestellt.

Trägheitsbewegungserfassung

Das Modul zur Trägheitsbewegungserfassung schätzt die Körperhaltung und Bewegung des Menschen anhand von 6 IMU-Messungen. Das Design dieses Moduls basiert auf unserer vorherigen PIP-Arbeit [1], aber in dieser Arbeit gehen wir nicht mehr davon aus, dass es sich bei der Szene um einen flachen Boden handelt, sondern erwägen die Erfassung freier menschlicher Bewegungen im 3D-Raum. Zu diesem Zweck werden in diesem Artikel adaptive Änderungen am PIP-Optimierungsalgorithmus vorgenommen.

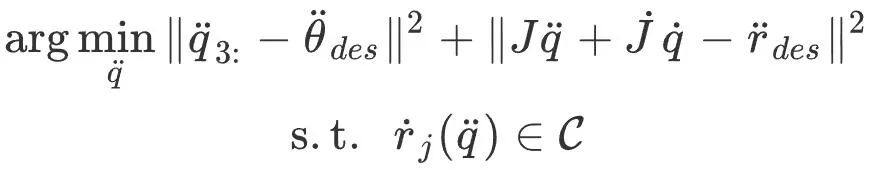

Konkret sagt dieses Modul zunächst die Rotation, Geschwindigkeit, Fuß- und Bodenkontaktwahrscheinlichkeit menschlicher Gelenke aus IMU-Messungen über ein mehrstufiges rekurrentes neuronales Netzwerk voraus. Der von PIP vorgeschlagene Dual-PD-Regler wird verwendet, um die optimale Steuerung der Winkelbeschleunigung  und der Linearbeschleunigung

und der Linearbeschleunigung  menschlicher Gelenke zu lösen. Anschließend optimiert dieses Modul die Haltungsbeschleunigung

menschlicher Gelenke zu lösen. Anschließend optimiert dieses Modul die Haltungsbeschleunigung  des menschlichen Körpers, sodass er die vom PD-Controller vorgegebene Beschleunigung erreichen und gleichzeitig die Kontaktbeschränkung C erfüllen kann:

des menschlichen Körpers, sodass er die vom PD-Controller vorgegebene Beschleunigung erreichen und gleichzeitig die Kontaktbeschränkung C erfüllen kann:

wo J ist die gemeinsame Jacobi-Matrix,  ist die lineare Geschwindigkeit des Fußes in Kontakt mit dem Boden und die Einschränkung C erfordert, dass die Geschwindigkeit des Fußes in Kontakt mit dem Boden klein sein sollte (Nr es kommt zum Gleiten). Um dieses quadratische Programmierproblem zu lösen, lesen Sie bitte PIP[1]. Nachdem die Haltung und Bewegung des menschlichen Körpers durch Integration der Haltungsbeschleunigung ermittelt wurde, kann die Haltung der an den menschlichen Körper gebundenen Kamera für nachfolgende Module ermittelt werden.

ist die lineare Geschwindigkeit des Fußes in Kontakt mit dem Boden und die Einschränkung C erfordert, dass die Geschwindigkeit des Fußes in Kontakt mit dem Boden klein sein sollte (Nr es kommt zum Gleiten). Um dieses quadratische Programmierproblem zu lösen, lesen Sie bitte PIP[1]. Nachdem die Haltung und Bewegung des menschlichen Körpers durch Integration der Haltungsbeschleunigung ermittelt wurde, kann die Haltung der an den menschlichen Körper gebundenen Kamera für nachfolgende Module ermittelt werden.

Kameraverfolgung

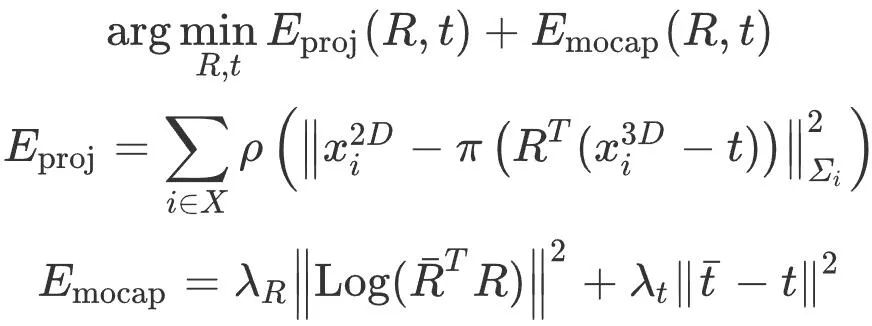

Das Kameraverfolgungsmodul verwendet die vom Trägheitsbewegungserfassungsmodul vorgegebene anfängliche Kameraposition und das von der Kamera erfasste Farbbild als Eingabe und verwendet die Bildinformationen, um die Kameraposition zu optimieren und Positionsabweichungen zu vermeiden. Konkret basiert dieses Modul auf ORB-SLAM3 [2]. Es extrahiert zunächst die ORB-Merkmalspunkte des Bildes und führt unter Verwendung der Merkmalsähnlichkeit einen Merkmalsabgleich mit den rekonstruierten spärlichen Kartenpunkten durch, um passende 2D-3D-Punkte zu erhalten Paare und optimieren Sie dann die Kameraposition durch Optimierung des Reprojektionsfehlers. Es ist zu beachten, dass die Optimierung nur des Reprojektionsfehlers durch falsche Übereinstimmungen beeinträchtigt werden kann, was zu schlechten Ergebnissen bei der Optimierung der Kameraposition führt. Daher Dieser Artikel integriert Vorabinformationen zur menschlichen Bewegung in die Kameraverfolgungsoptimierung, verwendet Trägheitsbewegungserfassungsergebnisse als Einschränkungen, begrenzt den Optimierungsprozess von Neuprojektionsfehlern und erkennt und beseitigt rechtzeitig fehlerhafte Feature-Point-Map-Punktzuordnung.

Merken Sie sich die Weltkoordinaten des Kartenpunkts als  und die Pixelkoordinaten der passenden 2D-Bildmerkmalspunkte als

und die Pixelkoordinaten der passenden 2D-Bildmerkmalspunkte als

, was alle übereinstimmenden Beziehungen anzeigt. Lassen Sie

, was alle übereinstimmenden Beziehungen anzeigt. Lassen Sie

die anfängliche Kameraposition vor der Optimierung darstellen, dann optimiert dieses Modul die Kameraposition R,t:

Darunter ist  robuster Huber Kernelfunktion,

robuster Huber Kernelfunktion,  ordnet dreidimensionale Drehung dem dreidimensionalen Vektorraum zu,

ordnet dreidimensionale Drehung dem dreidimensionalen Vektorraum zu,  ist die perspektivische Projektionsoperation,

ist die perspektivische Projektionsoperation,  steuert die Koeffizienten der Rotations- und Übersetzungsterme der Bewegungserfassung. Die Optimierung wurde dreimal durchgeführt, wobei jedes Mal 2D-3D-Übereinstimmungen basierend auf dem Reprojektionsfehler als richtig oder falsch klassifiziert wurden. Bei der nächsten Optimierung wurden nur korrekte Übereinstimmungen verwendet und falsche Übereinstimmungen gelöscht. Mit starkem Vorwissen, das durch Bewegungserfassungsbeschränkungen bereitgestellt wird, kann dieser Algorithmus besser zwischen richtigen und falschen Übereinstimmungen unterscheiden und dadurch die Genauigkeit der Kameraverfolgung verbessern. Nach dem Lösen der Kameraposition extrahiert dieses Modul die Anzahl der korrekt übereinstimmenden Kartenpunktpaare und verwendet sie als Glaubwürdigkeit der Kameraposition.

steuert die Koeffizienten der Rotations- und Übersetzungsterme der Bewegungserfassung. Die Optimierung wurde dreimal durchgeführt, wobei jedes Mal 2D-3D-Übereinstimmungen basierend auf dem Reprojektionsfehler als richtig oder falsch klassifiziert wurden. Bei der nächsten Optimierung wurden nur korrekte Übereinstimmungen verwendet und falsche Übereinstimmungen gelöscht. Mit starkem Vorwissen, das durch Bewegungserfassungsbeschränkungen bereitgestellt wird, kann dieser Algorithmus besser zwischen richtigen und falschen Übereinstimmungen unterscheiden und dadurch die Genauigkeit der Kameraverfolgung verbessern. Nach dem Lösen der Kameraposition extrahiert dieses Modul die Anzahl der korrekt übereinstimmenden Kartenpunktpaare und verwendet sie als Glaubwürdigkeit der Kameraposition.

Mapping- und Schleifenschlusserkennung

Das Mapping- und Schleifenschlusserkennungsmodul verwendet Schlüsselbilder, um spärliche Kartenpunkte zu rekonstruieren und zu erkennen, ob der menschliche Körper den Ort erreicht hat, an dem er sich aufgehalten hat, um den kumulativen Fehler zu korrigieren. Während des Kartierungsprozesses verwenden wir die bewegungserfassungsbeschränkte Bündelanpassung (Bundle Adjustment, BA), um gleichzeitig spärliche Kartenpunktpositionen und Keyframe-Kamerapositionen zu optimieren und Kartenpunktsicherheit einzuführen, um Bewegungserfassungsbeschränkungen und die relative Stärke der Neuprojektion dynamisch auszugleichen Fehlerterm, wodurch die Genauigkeit der Ergebnisse verbessert wird. Wenn in der menschlichen Bewegung ein geschlossener Regelkreis auftritt, wird eine durch Bewegungserfassung unterstützte Pose-Graph-Optimierung durchgeführt, um den Fehler im geschlossenen Regelkreis zu korrigieren . Schließlich werden die optimierten Punktpositionen und Schlüsselbildpositionen der spärlichen Karte erhalten, die zum Ausführen des Algorithmus im nächsten Bild verwendet werden.

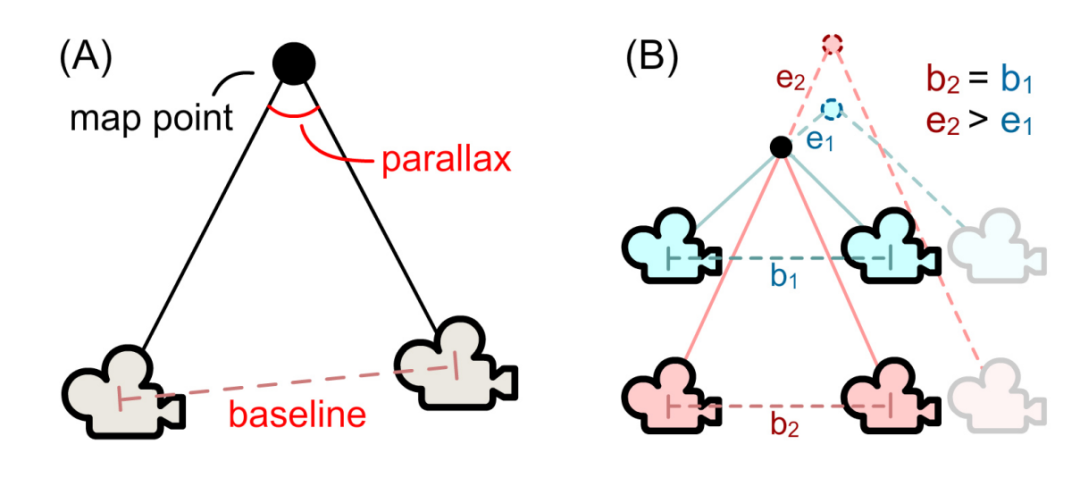

Konkret berechnet dieses Modul zunächst das Konfidenzniveau basierend auf der Beobachtung des Kartenpunkts, das für die anschließende BA-Optimierung verwendet wird. Wie in Abbildung 5 unten dargestellt, berechnet dieses Modul entsprechend der Position des Schlüsselrahmens des beobachteten Kartenpunkts die Grundlinienlänge bi des Schlüsselrahmens und den Beobachtungswinkel θi, um die Konfidenz des Kartenpunkts i zu bestimmen #🎜🎜 # , wobei k der Kontrollkoeffizient ist.

, wobei k der Kontrollkoeffizient ist.

#🎜🎜. #

Bild 5 (a) Berechnung der Kartenpunktzuverlässigkeit. (b) Bei gleicher Basislinienlänge b1=b2 kann ein größerer Beobachtungswinkel (blau) der Störung der Kameraposition besser widerstehen, was zu kleineren Kartenpunktpositionsfehlern führt (e1

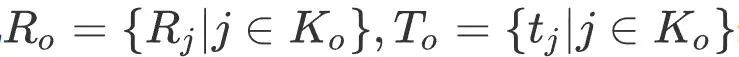

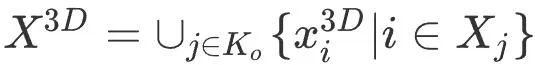

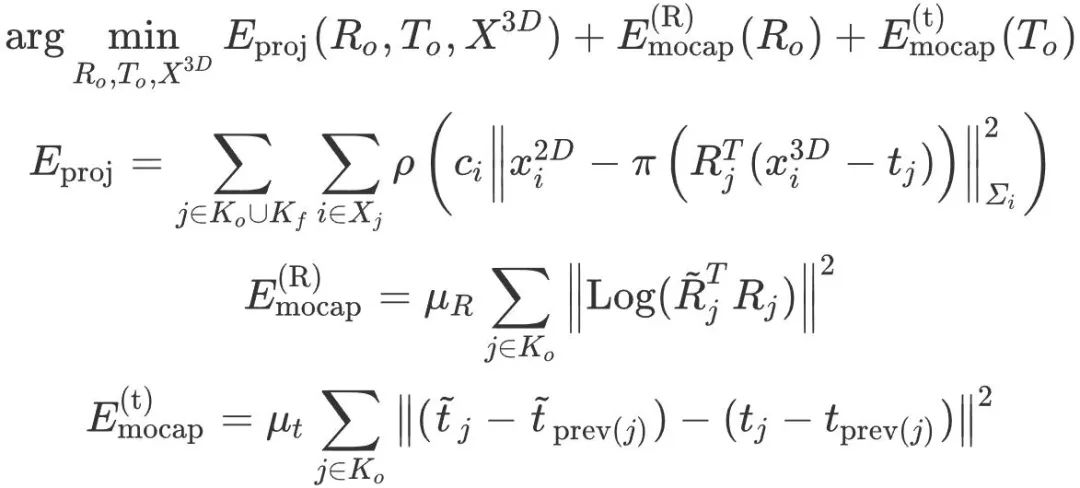

Anschließend werden die letzten 20 Keyframe-Kamerapositionen und ihre beobachteten Kartenpunkte gleichzeitig optimiert. Andere Keyframe-Posen, die diese Kartenpunkte sehen, werden während der Optimierung behoben. Bezeichnen Sie die Menge aller optimierbaren Schlüsselbilder als K0, die Menge aller festen Schlüsselbilder als Kf und die Menge der durch Schlüsselbild j gemessenen Kartenpunkte als Xj.

记

#🎜 🎜##🎜 🎜#

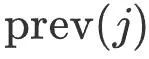

stellt die Position des Kartenpunkts dar. Dann ist die Strahlanpassungsoptimierung der Bewegungserfassungsbeschränkung wie folgt definiert: #🎜🎜 ## 🎜🎜 ## 🎜🎜#unter ihnen,#🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 # Stellt den vorherigen Schlüsselrahmen von Schlüsselrahmen j dar.

#

ist eine Bewegung Erfassen Sie den Einschränkungskoeffizienten des Termes. Diese Optimierung erfordert, dass der Neuprojektionsfehler der Kartenpunkte klein ist und die Drehung und relative Position jedes Schlüsselbilds den Ergebnissen der Bewegungserfassung ähneln sollte. Die Konfidenz der Kartenpunkte  ci

ci

Für Bereiche, die nicht vollständig rekonstruiert sind, ist es umgekehrt wahrscheinlicher, dass das System an die Ergebnisse der Bewegungserfassung glaubt Wenn ein Bereich wiederholt beobachtet wird, vertraut das System stärker auf die visuelle Verfolgung. Das optimierte Faktordiagramm ist in Abbildung 6 unten dargestellt.

# 🎜 🎜#

Abbildung 6 Optimierungsfaktordiagrammdarstellung der Strahlanpassungsmethode für Bewegungserfassungsbeschränkungen. Wenn der geschlossene Regelkreis der Flugbahn erkannt wird, führt das System eine geschlossene Regelkreisoptimierung durch. Basierend auf ORB-SLAM3[2] ist die Menge der Scheitelpunkte im Posendiagramm F und die Menge der Kanten ist C. Dann ist die Pose-Graph-Optimierung von Motion-Capture-Einschränkungen wie folgt definiert:

Unter ihnen ist  die Pose von Schlüsselbild j,

die Pose von Schlüsselbild j,  ist die Pose Karte Optimieren Sie vorher die relative Pose zwischen den Schlüsselbildern i und j. wird Die Pose wird einem sechsdimensionalen Vektorraum zugeordnet und

ist die Pose Karte Optimieren Sie vorher die relative Pose zwischen den Schlüsselbildern i und j. wird Die Pose wird einem sechsdimensionalen Vektorraum zugeordnet und  ist der relative Koeffizient der Bewegungserfassungsbeschränkung.

ist der relative Koeffizient der Bewegungserfassungsbeschränkung.  Diese Optimierung wird durch die vorherige Bewegungserfassung gesteuert und verteilt den Closed-Loop-Fehler auf jeden Keyframe.

Diese Optimierung wird durch die vorherige Bewegungserfassung gesteuert und verteilt den Closed-Loop-Fehler auf jeden Keyframe.  Human Motion Update

Human Motion Update

#🎜 ## # 🎜 🎜 # Vermeiden Sie den Teiler durch 0 für Dezimalzahlen. Das heißt, je größer die Anzahl erfolgreich abgeglichener Kartenpunkte bei der Kameraverfolgung ist, desto geringer ist die Varianz der Kamerapositionsbeobachtungen. Der Kalman-Filter-Algorithmus wird verwendet, um schließlich die globale Position des menschlichen Körpers vorherzusagen.

Experiment

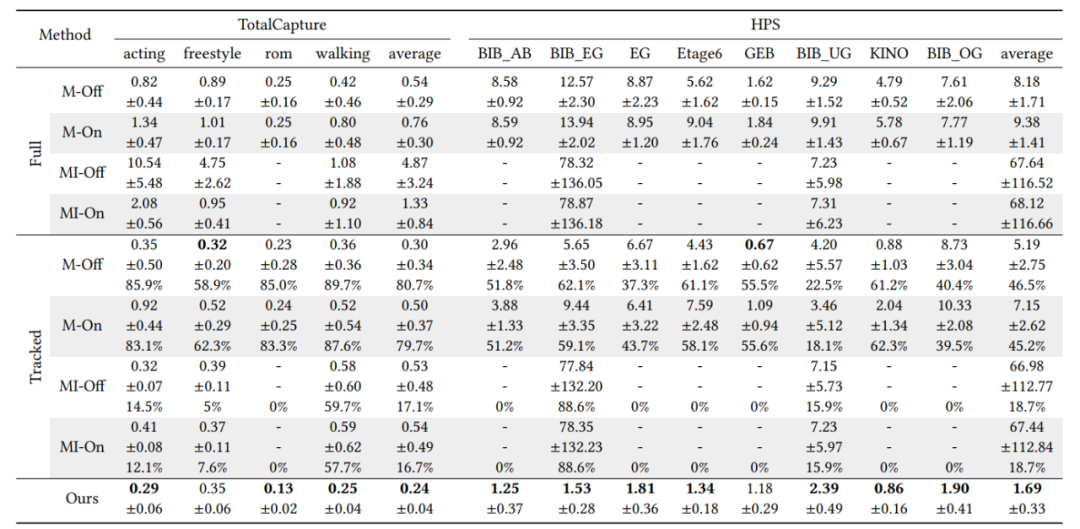

Diese Methode löst hauptsächlich die globale Position bei der Erfassung spärlicher Trägheitsbewegungen (Mocap). Um das Driftproblem zu lösen, wird der globale Positionsfehler des menschlichen Körpers als Haupttestindikator ausgewählt. Der Vergleich der quantitativen Testergebnisse mit den SOTA-Mocap-Methoden TransPose[3], TIP[4] und PIP[1] an zwei öffentlichen Datensätzen, TotalCapture und HPS, ist in Tabelle 1 unten dargestellt Abbildungen 7 und 8 unten zeigen. Es ist ersichtlich, dass die Methode in diesem Artikel frühere Methoden zur Trägheitsbewegungserfassung hinsichtlich der globalen Positionierungsgenauigkeit deutlich übertrifft (bei TotalCapture und HPS um 41 % bzw. 38 % erhöht) und die Flugbahn die höchste Ähnlichkeit mit dem wahren Wert aufweist.

Tabelle 1 und Trägheitsbewegungserfassung Quantitativer Vergleich globaler Positionsfehler von Arbeitsplätzen (Einheit: Meter). Der TotalCapture-Datensatz wird nach Aktionen klassifiziert, und der HPS-Datensatz wird nach Szenen klassifiziert. Für unsere Arbeit führen wir neun Tests durch und geben den Median und die Standardabweichung an.

Abbildung 7 Qualitativer Vergleich des globalen Positionsfehlers mit der Trägheitsbewegungserfassung. Der wahre Wert wird in Grün angezeigt und die Vorhersageergebnisse verschiedener Methoden werden in Blau angezeigt. Die Bewegungsbahn und die aktuelle Position des menschlichen Körpers (orangefarbene Punkte) werden in der Ecke jedes Bildes angezeigt.

Abbildung 8 Qualitativer Vergleich des globalen Positionsfehlers mit der Trägheitsbewegungserfassung (Video). Der wahre Wert wird in Grün angezeigt, die Methode in diesem Artikel ist in Weiß dargestellt und die Methoden früherer Arbeiten verwenden andere unterschiedliche Farben (siehe Legende).

Vergleich mit SLAM

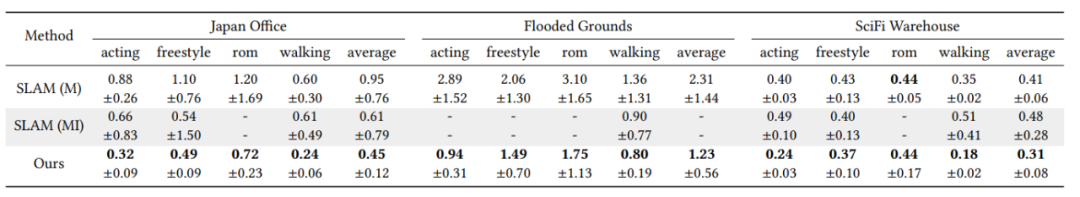

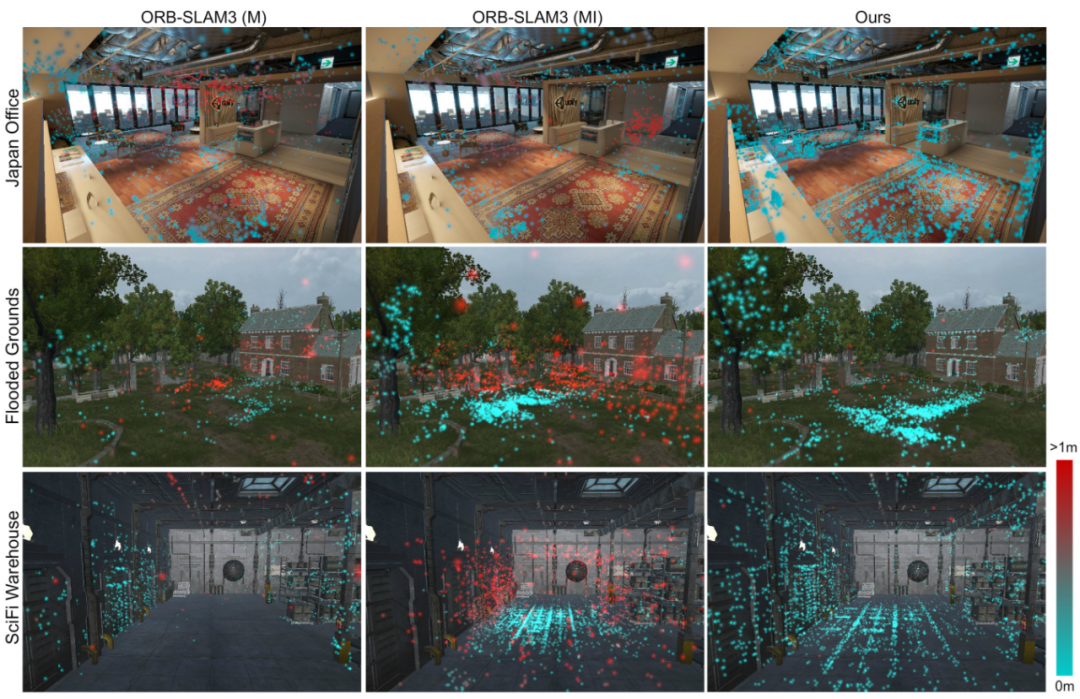

In diesem Artikel werden die monokularen und monokularen Trägheitsversionen der SOTA-SLAM-Arbeit ORB-SLAM3 [2] aus den beiden Perspektiven Positionierungsgenauigkeit und Kartenrekonstruktionsgenauigkeit verglichen. Die quantitativen Vergleichsergebnisse der Positionierungsgenauigkeit sind in Tabelle 2 dargestellt. Die quantitativen Vergleichsergebnisse der Kartenrekonstruktionsgenauigkeit sind in Tabelle 3 und die qualitativen Vergleichsergebnisse in Abbildung 9 dargestellt. Es ist ersichtlich, dass die Methode in diesem Artikel im Vergleich zu SLAM die Robustheit des Systems, die Positionierungsgenauigkeit und die Genauigkeit der Kartenrekonstruktion erheblich verbessert.

Tabelle 2 Quantitativer Vergleich von Positionierungsfehlern bei SLAM-Arbeit (Fehlereinheit: Meter). M/MI repräsentiert jeweils die monokulare/monokulare Trägheitsversion von ORB-SLAM3 und On/Off repräsentiert die Echtzeit- und Offline-Ergebnisse von SLAM. Da SLAM häufig das Tracking verliert, geben wir den durchschnittlichen Positionierungsfehler für die gesamte Sequenz (vollständig) und erfolgreich verfolgte Frames (Tracked) für SLAM an. Bei dieser Methode gibt es keinen Tracking-Verlust, sodass wir die Ergebnisse der gesamten Sequenz melden. Jede Methode wurde neunmal getestet und der Median und die Standardabweichung wurden angegeben. Bei Fehlern bei erfolgreich verfolgten Frames geben wir zusätzlich den Prozentsatz des Erfolgs an. Wenn eine Methode mehrmals fehlschlägt, markieren wir sie als fehlgeschlagen (angezeigt durch „-“).

Tabelle 3 Quantitativer Vergleich von Kartenrekonstruktionsfehlern mit SLAM-Arbeit (Fehlereinheit: Meter). M/MI repräsentieren jeweils die monokulare/monokulare Trägheitsversion von ORB-SLAM3. Für drei verschiedene Szenen (Büro, Außenbereich, Fabrik) testen wir den durchschnittlichen Fehler aller rekonstruierten 3D-Kartenpunkte aus der Oberflächengeometrie der Szene. Jede Methode wurde neunmal getestet und der Median und die Standardabweichung wurden angegeben. Wenn eine Methode mehrmals fehlschlägt, markieren wir sie als fehlgeschlagen (gekennzeichnet durch „-“).

Abbildung 9 Qualitativer Vergleich von Kartenrekonstruktionsfehlern mit SLAM-Arbeit. Wir zeigen Szenenpunkte, die mit verschiedenen Methoden rekonstruiert wurden, wobei die Farbe den Fehler für jeden Punkt anzeigt.

Darüber hinaus verbessert dieses System die Robustheit gegenüber visuellem Tracking-Verlust erheblich, indem es menschliche Bewegungen vorab einführt. Wenn die visuellen Funktionen schlecht sind, kann dieses System menschliche Bewegungsvorgaben nutzen, um die Verfolgung fortzusetzen, ohne die Verfolgung zu verlieren und wie bei anderen SLAM-Systemen neue Karten zurückzusetzen oder zu erstellen. Wie in Abbildung 10 unten dargestellt.

Abbildung 10 Vergleich der Okklusionsrobustheit mit SLAM-Arbeit. Die Ground-Truth-Trajektorienreferenz wird in der oberen rechten Ecke angezeigt. Aufgrund der Zufälligkeit der SLAM-Initialisierung sind das globale Koordinatensystem und der Zeitstempel nicht vollständig aufeinander abgestimmt.

Weitere experimentelle Ergebnisse finden Sie im Originaltext des Papiers, auf der Projekthomepage und im Papiervideo.

Zusammenfassung

Dieses Papier schlägt die erste Arbeit vor, die Trägheits-Mocap und SLAM kombiniert, um eine gleichzeitige Erfassung, Positionierung und Kartierung menschlicher Bewegungen in Echtzeit zu erreichen. Das System ist leicht genug, um nur einen spärlichen Satz an Sensoren zu benötigen, die der menschliche Körper trägt, darunter sechs Trägheitsmesseinheiten und eine Mobiltelefonkamera. Für die Online-Verfolgung werden Mocap und SLAM durch eingeschränkte Optimierung und Kalman-Filtertechniken zusammengeführt, um eine genauere menschliche Positionierung zu erreichen. Bei der Back-End-Optimierung werden Positionierungs- und Kartierungsfehler weiter reduziert, indem die menschliche Bewegung vorab in die Strahlanpassungsoptimierung und die Closed-Loop-Optimierung im SLAM integriert wird.

Diese Forschung zielt darauf ab, die Wahrnehmung des menschlichen Körpers mit der Wahrnehmung der Umwelt zu integrieren. Obwohl sich diese Arbeit hauptsächlich auf Lokalisierungsaspekte konzentriert, glauben wir, dass diese Arbeit einen ersten Schritt in Richtung gemeinsamer Bewegungserfassung und feinkörniger Umgebungswahrnehmung und -rekonstruktion darstellt.

Das obige ist der detaillierte Inhalt vonSechs Trägheitssensoren und ein Mobiltelefon ermöglichen die Erfassung, Positionierung und Rekonstruktion der Umgebungsbewegung des menschlichen Körpers. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr