Heim >Technologie-Peripheriegeräte >KI >Transformers Review: Von BERT zu GPT4

Transformers Review: Von BERT zu GPT4

- 王林nach vorne

- 2023-05-10 23:25:041331Durchsuche

Künstliche Intelligenz ist in den letzten Jahren zu einem der am meisten diskutierten Themen geworden, und Dienste, die einst als reine Science-Fiction galten, werden dank der Entwicklung neuronaler Netze nun Realität. Von Konversationsagenten bis hin zur Generierung von Medieninhalten verändert künstliche Intelligenz die Art und Weise, wie wir mit Technologie interagieren. Insbesondere Modelle des maschinellen Lernens (ML) haben im Bereich der Verarbeitung natürlicher Sprache (NLP) erhebliche Fortschritte gemacht. Ein entscheidender Durchbruch ist die Einführung der „Selbstaufmerksamkeit“ und der Transformers-Architektur für die Sequenzverarbeitung, die die Lösung mehrerer Schlüsselprobleme ermöglicht, die zuvor auf diesem Gebiet vorherrschten.

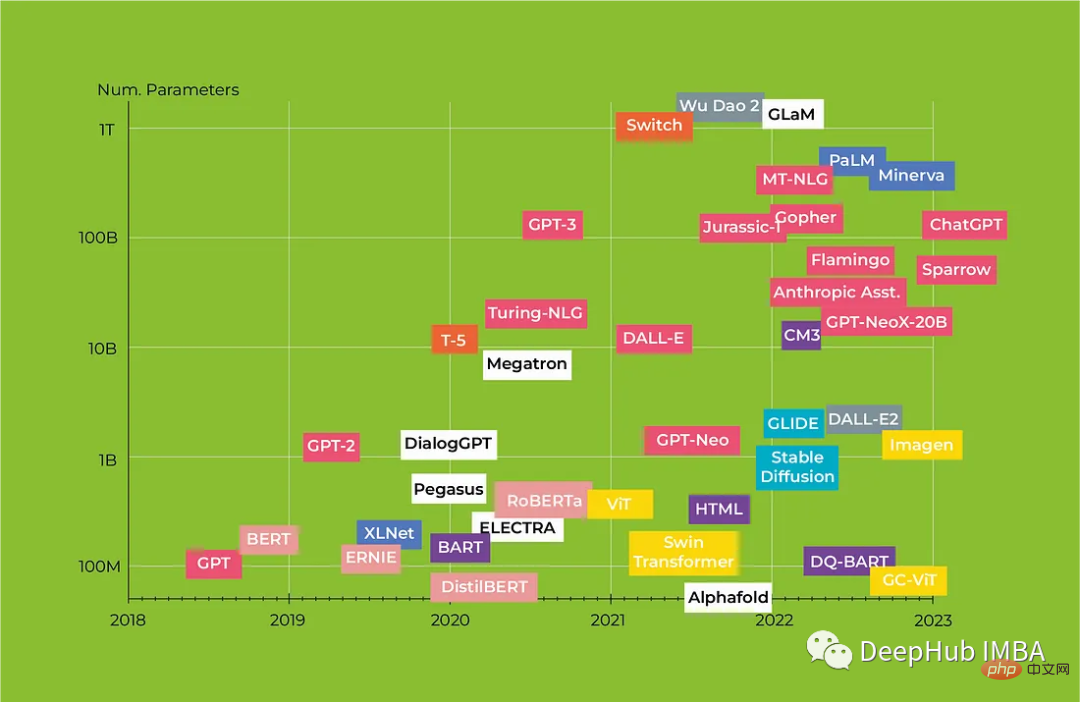

In diesem Artikel werfen wir einen Blick auf die revolutionäre Transformers-Architektur und wie sie NLP verändert. Wir werden auch einen umfassenden Überblick über die Transformers-Modelle von BERT bis Alpaca geben und uns dabei auf die Hauptmerkmale jedes Modells konzentrieren seine möglichen Anwendungen.

Bert-ähnliches Textmodell

Der erste Teil ist ein auf dem Transformer-Encoder basierendes Modell, das für Vektorisierung, Klassifizierung, Sequenzkennzeichnung, QA (Frage und Antwort), NER (Named Entity Recognition) usw. verwendet wird.

1. BERT Google / 2018

Transformer-Encoder, Wortstück-Tokenisierung (30.000 Vokabeln). Die Eingabeeinbettung besteht aus drei Vektoren: einem Beschriftungsvektor, einem trainierbaren Positionsvektor und einem Fragmentvektor (entweder erster Text oder zweiter Text). Die Modelleingaben sind die CLS-Token-Einbettung, die Einbettung des ersten Texts und die Einbettung des zweiten Texts.

BERT hat zwei Trainingsaufgaben: Masked Language Modeling (MLM) und Next Sentence Prediction (NSP). Im MLM werden 15 % der Token maskiert, 80 % werden durch MASK-Token ersetzt, 10 % werden durch zufällige Token ersetzt und 10 % bleiben unverändert. Das Modell sagt die richtigen Token voraus und der Verlust wird nur für diese 15 % der blockierten Token berechnet. In NSP sagt das Modell voraus, ob der zweite Text auf den ersten Text folgt. Es werden Vorhersagen über den Ausgabevektor von CLS-Tokens getroffen.

Um das Training zu beschleunigen, werden zunächst 90 % des Trainings mit einer Sequenzlänge von 128 Token durchgeführt und dann werden die restlichen 10 % der Zeit damit verbracht, das Modell mit 512 Token zu trainieren, um effektivere Positionseinbettungen zu erhalten.

2, RoBERTa Facebook / 2019

Eine verbesserte Version von BERT, die nur auf MLM trainiert wird (da NSP als weniger nützlich gilt) und die Trainingssequenz länger ist (512 Token). Mithilfe der dynamischen Maskierung (verschiedene Token werden maskiert, wenn dieselben Daten erneut verarbeitet werden) werden Trainingshyperparameter sorgfältig ausgewählt.

3. Im ursprünglichen XLM hatten alle Sprachen ein gemeinsames BPE-Vokabular.

XLM hat zwei Trainingsaufgaben: MLM und Übersetzung. Die Übersetzung eines Textpaars ist im Wesentlichen dasselbe wie MLM, aber die Texte sind parallele Übersetzungen voneinander, mit zufälligen Masken und Segmenteinbettungen, die die Sprache kodieren.

4. Transformer-XL Carnegie Mellon University / 2019

Dieses Modell ist für die Verarbeitung langer Sequenzen konzipiert und basiert auf zwei Hauptideen: Schleifenverarbeitung von Fragmenten und relative Positionskodierung.

Lange Texte werden in Segmente unterteilt und segmentweise abgearbeitet. Die Ausgabe des vorherigen Segments wird zwischengespeichert, und bei der Berechnung der Selbstaufmerksamkeit im aktuellen Segment werden die Schlüssel und Werte basierend auf der Ausgabe des aktuellen Segments und des vorherigen Segments (nur miteinander verkettet) berechnet. Auch der Gradient wird nur innerhalb des aktuellen Segments berechnet.

Diese Methode funktioniert nicht mit absoluten Positionen. Daher wird die Aufmerksamkeitsgewichtsformel im Modell neu parametrisiert. Der Codierungsvektor für die absolute Position wird durch eine feste Matrix ersetzt, die auf dem Sinus des Abstands zwischen Markerpositionen und einem trainierbaren Vektor basiert, der allen Positionen gemeinsam ist.

5. ERNIE Tsinghua University, Huawei / 2019

Betten Sie Informationen über benannte Entitäten im Wissensgraphen in BERT ein. Die Eingabe besteht aus einer Reihe von Text-Tokens und einer Reihe von Entitäts-Tokens (jedes Token stellt eine gesamte Entität dar). Texttokens werden von BERT codiert. Zusätzlich zu BERT gibt es einen Satz K Encoderblöcke (die etwa 3 % der Netzwerkparameter ausmachen). In diesen Blöcken:

Der Aktualisierungsvektor des Text-Tokens und der Originalvektor des Entitäts-Tokens werden zunächst unabhängig voneinander berechnet.- Die Entitätsvektoren werden mit dem ersten Token abgeglichen, das im Text erscheint.

- Aktivierung mit GeLU. und verwendet, um neue versteckte Darstellungen von Text-Tokens zu erhalten;

- Neue Vektoren von Text- und Entitäts-Tokens werden aus den versteckten Darstellungen erhalten und als Eingabe an den nächsten Encoderblock übergeben.

- Während des Vortrainings werden drei Verluste berechnet: MLM, NSP und Entitätsvorhersage aus Token (wie Autoencoder). Der Autoencoder verwendet die folgenden Regeln:

- In 15 % der Fälle wird die Übereinstimmung entfernt und das Modell muss die Entität nur basierend auf Text vorhersagen

- In anderen Fällen ist dies normal.

- Vorab trainierte Modelle können wie normale BERT-Modelle (mit CLS-Tokens) feinabgestimmt werden. Zur Feinabstimmung können auch zusätzliche Verfahren verwendet werden, um Beziehungen zwischen Entitäten und ihren Typen zu bestimmen.

6. XLNet Carnegie Mellon University / 2019

Weil es Probleme im BERT-Trainingsprozess gibt:

- Während des Trainings berechnet die Verlustberechnung nur die Maskennoten.

- Nur einzelne Markierungen werden blockiert und die Vorhersage einer blockierten Markierung hat keinen Einfluss auf die Vorhersage anderer Markierungen.

- In realen Anwendungen gibt es keine MASK-Tokens, die das Modell während des Trainings aktiv sieht.

XLNet basiert auf Transformer-XL, mit Ausnahme von PLM-Aufgaben (Replacement Language Modeling), bei denen es lernt, Token in kurzen Kontexten vorherzusagen, anstatt MASK direkt zu verwenden. Dadurch wird sichergestellt, dass Farbverläufe für alle Markierungen berechnet werden und keine speziellen Maskenmarkierungen erforderlich sind.

Die Token im Kontext sind verschlüsselt (zum Beispiel: Der i-te Token kann basierend auf den i-2- und i+1-ten Token vorhergesagt werden), aber ihre Positionen sind immer noch bekannt. Dies ist mit aktuellen Positionskodierungen (einschließlich Transformer-XL) nicht möglich. Beim Versuch, die Wahrscheinlichkeit eines Tokens in einem gegebenen Kontext vorherzusagen, sollte das Modell nicht das Token selbst kennen, sondern die Position des Tokens im Kontext. Um dieses Problem zu lösen, teilen sie die Selbstaufmerksamkeit in zwei Streams auf:

- An jeder Markierungsposition gibt es zwei Vektoren statt einem: den Inhaltsvektor und den Abfragevektor.

- Der Inhaltsvektor enthält vollständige Informationen zum Token, während der Abfragevektor nur Standortinformationen enthält.

- Beide Token-Vektoren werden basierend auf dem Kontextvektor berechnet, aber der Abfragevektor in der Selbstaufmerksamkeit wird unter Verwendung des vergangenen Inhaltsvektors berechnet, und der Inhaltsvektor wird unter Verwendung des vergangenen Abfragevektors berechnet.

- Abfragevektor erhält keine Informationen über den Inhalt des entsprechenden Tokens, kennt aber alle Informationen über den Kontext, während der Inhaltsvektor vollständige Informationen enthält.

Wenn Sie während der Feinabstimmung den Abfragevektor ignorieren, funktioniert das Modell wie ein normaler Transformer-XL.

In der Praxis erfordert das Modell, dass der Kontext lang genug sein muss, damit das Modell richtig lernen kann. Es lernte mit der gleichen Datenmenge wie RoBERTa und erzielte ähnliche Ergebnisse, aber aufgrund der Komplexität der Implementierung wurde das Modell nicht so populär wie RoBERTa.

7、ALBERT Google / 2019

Vereinfachen Sie BERT ohne Qualitätseinbußen:

- In verschiedenen Encoderblöcken werden gemeinsame Parameter verwendet, und es hat sich gezeigt, dass die Gewichte der Selbstaufmerksamkeit geteilt werden können, die Trennung der Gewichte vollständig verbundener Schichten jedoch zu einer Verschlechterung der Qualität führt.

- Im Vergleich zu BERT werden kleinere Eingabeeinbettungen und größere verborgene Ebenenvektoren verwendet. Dies kann durch die Verwendung einer zusätzlichen Projektionsmatrix am Netzwerkeingang erreicht werden, die auch die Größe der Einbettung von der Größe der verborgenen Darstellung entkoppelt.

- Die Parameter des Modells werden um das 18-fache reduziert und die Laufgeschwindigkeit um das 1,7-fache erhöht.

Das Modell ist auf MLM und Sentence Order Prediction (SOP) trainiert.

8、DistilBERT Google / 2019

Eine weitere Möglichkeit, BERT zu optimieren, ist die Destillation:

- Die Anzahl der Encoderblöcke wird um die Hälfte reduziert

- Drei Verlustkomponenten: MLM, Kreuzentropie mit der Ausgabe des Lehrermodells und der Kosinusabstand zwischen den entsprechenden Ebenenausgaben.

- Das Modell ist 40 % kleiner und 60 % schneller als das Lehrermodell und behält bei einer Vielzahl von Aufgaben eine Qualität von 97 % bei.

9, LaBSE Google / 2020

Mehrsprachiges Vektorisierungsmodell basierend auf BERT. Es wird auf MLM und TLM trainiert (20 % der Marker sind maskiert) und dann fein abgestimmt. Es unterstützt über 100 Sprachen und enthält 500.000 getaggte Vokabeln.

10, ELECTRA Google, Stanford University / 2020

Verwenden Sie die generative kontradiktorische Methode, um das BERT-Training zu beschleunigen:

- Trainierte zwei Klassen Bert-Modell: ein kleiner Generator und ein Hauptdiskriminator Vom Generator generierter Text (Ersatzerkennungsaufgabe)

- Entfernen Sie nach Abschluss des Trainings den Generator und verwenden Sie den Diskriminator zur Feinabstimmung

- Die Anzahl der Die Trainingsdaten stimmen mit RoBERTa oder XLNet überein und das Modell lernt schneller als BERT, RoBERTa und ALBERT mit einem ähnlichen Qualitätsniveau. Je länger es trainiert wird, desto besser ist seine Leistung.

- 11、DeBERTa Microsoft / 2020

Ein weiteres Modell, das den Inhalt und die Position des Markierungsvektors in zwei separate Vektoren trennt:

#🎜🎜 # Positionsvektoren werden von allen Ebenen gemeinsam genutzt und sind relativ, d. h. es gibt einen für jeden möglichen Abstand zwischen Markern.

Zwei neue Gewichtsmatrizen K_pos und Q_pos für sie hinzugefügt.

- Ändern Sie die Berechnung des Aufmerksamkeitsgewichts und vereinfachen Sie sie auf die Summe von drei Produkten: Q_cont * K_cont + Q_cont * K_pos + K_cont * Q_pos

- Verwenden Sie wie in ALBERT die Projektion der Matrix entkoppelt die Einbettungsgröße von der Größe des verborgenen Token-Darstellungsvektors.

- Ein Modell ähnlich GPT und T5

- Ein Modell, das auf vollständigen Transformers basiert. Sein Anwendungsspektrum ist sehr breit: Zusätzlich zu den Aufgaben des vorherigen Abschnitts umfasst es Konversationsagenten, maschinelle Übersetzung, logisches und mathematisches Denken, Codeanalyse und -generierung sowie im Wesentlichen die Textgenerierung. Die größten und „intelligentsten“ Modelle basieren normalerweise auf Decoder-Architekturen. Solche Modelle funktionieren im Wenig-Schuss- und Null-Schuss-Modus oft gut, ohne dass eine Feinabstimmung erforderlich ist.

wird verwendet

Der verwendete Tokenizer ist BPE auf Byte-Ebene (50K-Vokabular) und verwendet keine ähnlichen Teilzeichenfolgen wie („Hund“, „Hund!“, „Hund.“). Die maximale Sequenzlänge beträgt 1024. Die Layer-Ausgabe speichert alle zuvor generierten Tags zwischen. 2, T5 Google/2019 Ausgabevorhersagesequenz

< Relative Positionskodierung verwenden: Positionen werden durch lernbare Einbettungen kodiert, wobei jede „Einbettung“ nur ein Skalar ist, der bei der Berechnung der Aufmerksamkeitsgewichte den entsprechenden Logit hinzufügt.Matrix B wird auf allen Ebenen gemeinsam genutzt, ist jedoch für verschiedene Selbstaufmerksamkeitsköpfe unterschiedlich. Jede Schicht berücksichtigt 128 Abstände zwischen Token und Nullen, den Rest ausgenommen, was Rückschlüsse auf längere Sequenzen im Vergleich zu denen ermöglicht, die während des Trainings beobachtet wurden. Die Tokenisierung erfolgt mithilfe von Sentencepece (32K-Vokabular) mit einer maximalen Sequenzlänge von 512 während des Vortrainings. 3. BART Facebook / 2019

Ein weiterer vollständiger Transformator, der jedoch GeLU anstelle von ReLU verwendet. Trainieren Sie es, um Originaltext aus verrauschtem Text (AE-Entrauschen) mit den folgenden Rauschtypen vorherzusagen:Token-Maskierung

Token-Entfernung

Token-Auffüllen

Token-Reihenfolge in Sätzen umgekehrt

Zufällige Token erstellen Start der Sequenz

Verwenden Sie BPE auf Byte-Ebene (Vokabulargröße 50 KB)- 4, CTRL Salesforce / 2019

- Verwenden Sie Präfixcode-Tokens (z. B.

- Eingabetext…), um das resultierende Dekodiergerät zu steuern. Codes werden während des Trainings dem entsprechenden Text zugewiesen und dann während der Inferenz verwendet, um entsprechend gestalteten Text zu generieren. Das Modell wird auf kausalem LM trainiert und es wird kein zusätzlicher Verlust verwendet. Die verwendete Tokenisierung ist BPE und die Vokabulargröße beträgt 250 KB.

- 5. GPT-3 OpenAI / 2020

- Dies ist ein GPT-2-Modell mit Sparse Transformer-Architektur und einer erhöhten Sequenzlänge von 2048 Token. Erinnern Sie sich noch an den Satz: Fragen Sie nicht, fragen Sie, es ist GPT3 6, mT5 Google / 2020 basierend auf dem T5-Modell, mit ähnlichem Training, aber unter Verwendung mehrsprachiger Daten. ReLU-Aktivierungen wurden durch GeGLU ersetzt und das Vokabular auf 250.000 Token erweitert. 7, GLAM Google / 2021

- Das Ziel besteht darin, einen Satz von Task-Input-Output-Tripeln zu erhalten, wobei die Eingabe leer sein kann.

- Menschen generieren 175 Aufgabenaufforderungen mit Antworten, die in GPT-3 eingespeist werden, und GPT-3 generiert neue Aufgaben.

- Der Generierungsprozess ist iterativ und bei jedem Schritt werden einige Aufgabenbeispiele von Menschen und einige von zuvor generierten Aufgabenbeispielen bereitgestellt.

- GPT-3 unterteilt die generierten Aufgaben in Klassifizierungsaufgaben oder Nicht-Klassifizierungsaufgaben und generiert darauf basierend unterschiedliche Eingaben und Ausgaben.

- Tripel werden nach Qualität und Unähnlichkeit zu vorhandenen Tripeln in der Datenbank gefiltert.

- 30.000 Erklärungs- und Antwortbeispiele zu Mathematik, Poesie und Dialog;

- 52.000 Beispiele des Alpaka-Datensatzes;# 🎜 🎜# 160.000 Antworten auf Modelle mit Benutzerpräferenzen für Nützlichkeit und Schaden;

- 20.000 Antworten auf Modelle mit Benutzerfragen und -bewertungen;

- 93.000 Zusammengefasst: Benutzerbewertungen seine Qualität;

- Das Ergebnis geht in die DM-Dekodierung im latenten Raum: Wenn die Bedingung ein Vektor ist, wird sie mit dem latenten Vektor am Eingang des Schritts verkettet, wenn es sich um eine Folge von Vektoren handelt, ist sie es Wird für die Überkreuzung verschiedener U-Net-Schichten verwendet. Hinweis. Für Texthinweise verwenden Sie CLIP-Vektoren.

- Dieses allgemeine Modell kann für verschiedene Aufgaben trainiert werden: Text zu Bild, Kolorierung, Malen, Superauflösung.

-

2. PaLM-E Google / 2023

Das Bild wird von ViT kodiert, der Ausgabevektor sowie Text-Tokens und Befehle werden in PaLM eingespeist und PaLM generiert den Ausgabetext.

PaLM-E wird für alle Aufgaben einschließlich VQA, Objekterkennung und Roboterbedienung verwendet.

3. GPT-4 OpenAI/2023

Dies ist ein geschlossenes Modell mit wenigen bekannten Details. Vermutlich verfügt es über einen Decoder mit spärlicher Aufmerksamkeit und multimodalen Eingaben. Es verwendet autoregressives Training und Feinabstimmung von RLHF mit Sequenzlängen von 8K bis 32K.

Es wurde in menschlichen Untersuchungen mit null und wenigen Proben getestet und erreichte menschenähnliche Werte. Es kann bildbasierte Probleme (einschließlich mathematischer Probleme) sofort und Schritt für Schritt lösen, Bilder verstehen und interpretieren sowie Code analysieren und generieren. Auch für verschiedene Sprachen geeignet, auch für Minderheitensprachen.

Zusammenfassung

Das Folgende ist eine kurze Schlussfolgerung. Sie können unvollständig oder einfach falsch sein und dienen nur als Referenz.

Nachdem automatische Grafikkarten nicht mehr abgebaut werden konnten, schwärmten verschiedene Großmodelle ein und die Basis der Modelle wuchs, aber die einfache Erhöhung der Schichten und das Wachstum der Datensätze wurden durch verschiedene bessere Technologien ersetzt, die dies ermöglichen Qualitätsverbesserungen (Nutzung externer Daten und Tools, verbesserte Netzwerkstrukturen und neue Feinabstimmungstechniken). Eine wachsende Zahl von Arbeiten zeigt jedoch, dass die Qualität der Trainingsdaten wichtiger ist als die Quantität: Durch die richtige Auswahl und Bildung von Datensätzen kann die Trainingszeit verkürzt und die Qualität der Ergebnisse verbessert werden.

OpenAI geht jetzt zu Closed Source, sie haben versucht, die Gewichte von GPT-2 nicht zu veröffentlichen, sind aber gescheitert. Aber GPT4 ist eine Blackbox. Der Trend der letzten Monate, die Feinabstimmungskosten und die Inferenzgeschwindigkeit von Open-Source-Modellen zu verbessern, hat den Wert großer privater Modelle stark verringert, da auch Produkte von Open-Source-Modellen schnell aufholen Giganten in der Qualität, die das Überholen in Kurven wieder ermöglichen.

Die Zusammenfassung der endgültigen Open-Source-Modelle lautet wie folgt:

- Unter den Encoder-Modellblöcken gelten die Modelle XLM-RoBERTa und LaBSE als zuverlässige mehrsprachige Lösungen.

- Unter den offenen generativen Modellen sind sie die interessantesten sind LLaMA und Modelle von EleutherAI (alle haben fein abgestimmte Versionen), Dolly-2, BLOOM (haben auch Befehls-Feinabstimmungsoptionen);

- In Bezug auf den Code sind die Modelle von SantaCoder nicht schlecht, aber insgesamt ist die Qualität offensichtlich hinter ChatGPT/GPT -4 zurück;

- Transformer-XL und Sparse Transformer implementieren Technologien, die in anderen Modellen verwendet werden, und können sorgfältig untersucht werden

Die oben genannten Informationen dienen nur als Referenz.

Dieses Modell ähnelt konzeptionell dem Switch Transformer, konzentriert sich jedoch mehr auf die Arbeit im Modus mit wenigen Aufnahmen als auf die Feinabstimmung. Modelle unterschiedlicher Größe verwenden 32 bis 256 Expertenebenen, K=2. Verwenden Sie die relative Positionskodierung von Transformer-XL. Bei der Verarbeitung von Token werden weniger als 10 % der Netzwerkparameter aktiviert.

8, LaMDA Google / 2021Ein GPT-ähnliches Modell. Das Modell ist ein Konversationsmodell, das auf kausalem LM vortrainiert und auf Generierungs- und Unterscheidungsaufgaben abgestimmt ist. Das Modell kann auch externe Systeme aufrufen (Suche, Übersetzung). 9. GPT-NeoX-20B EleutherAI / 2022Dieses Modell ähnelt GPT-J und verwendet ebenfalls eine Rotationspositionskodierung. Modellgewichte werden durch float16 dargestellt. Die maximale Sequenzlänge beträgt 2048. 10, BLOOM BigScience / 2022Dies ist das größte Open-Source-Modell in 46 Sprachen und 13 Programmiersprachen. Zum Trainieren des Modells wird ein großer aggregierter Datensatz namens ROOTS verwendet, der etwa 500 offene Datensätze umfasst. 11, PaLM Google / 2022Dies ist ein großes mehrsprachiges Decodermodell, das mit Adafactor trainiert wurde, Dropout während des Vortrainings deaktiviert und während der Feinabstimmung 0,1 verwendet. 12, LLaMA Meta/2023Ein Open-Source-GPT-ähnlicher LM in großem Maßstab für die wissenschaftliche Forschung, der zum Trainieren mehrerer Unterrichtsmodelle verwendet wurde. Das Modell verwendet Pre-LayerNorm, SwiGLU-Aktivierung und RoPE-Positionseinbettung. Da es Open Source ist, ist dies eines der Hauptmodelle für das Überholen in Kurven. Leitmodelle für TextDiese Modellerfassungen werden zur Korrektur von Modellausgaben (z. B. RLHF) verwendet, um die Antwortqualität während des Dialogs und der Aufgabenlösung zu verbessern. 1. InstructGPT OpenAI/2022Diese Arbeit passt GPT-3 an, um Anweisungen effizient zu befolgen. Das Modell basiert auf einem Datensatz, der aus Hinweisen und Antworten besteht, die Menschen aufgrund einer Reihe von Kriterien für gut halten. Basierend auf InstructGPT hat OpenAI ein Modell erstellt, das wir heute als ChatGPT kennen. 2, Flan-T5 Google / 2022Leitmodell passend für T5. Bei einigen Aufgaben übertraf der Flan-T5 11B den PaLM 62B ohne diese Feinabstimmung. Diese Modelle wurden als Open Source veröffentlicht. 3. Sparrow DeepMind / 2022Das Grundmodell wird durch die Feinabstimmung von Chinchilla auf ausgewählte hochwertige Gespräche erhalten, wobei die ersten 80 % der Ebenen eingefroren werden. Anschließend wurde das Modell mithilfe einer großen Eingabeaufforderung weiter trainiert, um es durch das Gespräch zu führen. Zusätzlich zu Chinchilla werden auch mehrere Belohnungsmodelle trainiert. Das Modell kann auf eine Suchmaschine zugreifen und Snippets mit bis zu 500 Zeichen abrufen, die zu Antworten werden können. Während der Inferenz wird das Belohnungsmodell zur Einstufung der Kandidaten verwendet. Kandidaten werden entweder vom Modell generiert oder aus der Suche gewonnen, und dann wird der beste Kandidat zur Antwort.4, Alpaca Stanford University / 2023

Das Führungsmodell von LLaMA oben. Das Hauptaugenmerk liegt auf dem Prozess der Erstellung eines Datensatzes mit GPT-3:

Insgesamt wurden 52.000 einzigartige Triples auf LLaMA 7B generiert und verfeinert.

5, Koala Berkeley University / 2023

Dies ist eine Feinabstimmung von LLaMA auf Unterrichtsdaten, aber im Gegensatz zu Alpaca oben ist es nicht nur auf GPT feinabgestimmt. 3 usw. Feinabstimmung der von großen Modellen generierten Daten. Die Zusammensetzung des Datensatzes ist:

Ein VAE-Autoencoder zur Dimensionsreduzierung und Generierung aus dem latenten Raum

# 🎜🎜# DM für interne Darstellung- Autoencoder werden gan-artig trainiert, indem sie einen Diskriminator für ihre Ergebnisse verwenden und zusätzliche Regularisierung anwenden, um die Nähe zu einer Standardnormalverteilung darzustellen.

4, Imagen Google / 2022

Die Hauptidee hinter Imagen ist, dass eine Vergrößerung des Text-Encoders mehr Vorteile für das generative Modell bringen kann als eine Vergrößerung des DM. Daher wurde CLIP durch T5-XXL ersetzt.

Modelle zum Generieren von Text aus Bildern

Die Modelle in diesem Abschnitt werden oft als multimodale Modelle bezeichnet, da sie in der Lage sind, Daten unterschiedlicher Art beim Generieren von Text zu analysieren. Der generierte Text kann eine natürliche Sprache oder eine Reihe von Befehlen sein, beispielsweise für einen Roboter.

1、CoCa Google / 2022

Ein separater Bild-Encoder (ViT oder CNN) + ein gemeinsamer Decoder, wobei die erste Hälfte Text und die zweite Hälfte Bilder verarbeitet. Die Ausgabe von Der Encoder wird zusammen mit dem Text verarbeitet.

Das 288x288-Bild wird in 18x18-Blöcke geschnitten und der Encoder wandelt es in einen Vektor + einen gemeinsamen Aufmerksamkeitspool-Vektor basierend auf all diesen Vektoren um.

Die Ausgabe der ersten Hälfte des Decoders ist ein Textvektor und ein CLS-Token-Vektor am Ende der Sequenz, tokenisiert mit Sentencepece (64K-Vokabular). Text- und Bildvektoren werden in der zweiten Hälfte des Decoders über Kreuzaufmerksamkeit zusammengeführt.

Die Gewichte der beiden Verluste sind:

Die Ähnlichkeit zwischen dem Aufmerksamkeitspoolvektor des Bildes und dem CLS-Tag-Vektor des Textes der Bildbeschreibung Paar. Autoregressiver Verlust der gesamten Decoder-Ausgabe (bedingt durch das Bild).- Während des Feinabstimmungsprozesses kann der Bildencoder eingefroren werden und nur der Aufmerksamkeitspool kann feinabgestimmt werden.

Das obige ist der detaillierte Inhalt vonTransformers Review: Von BERT zu GPT4. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr