Heim >Technologie-Peripheriegeräte >KI >Solange das Modell groß genug und die Stichproben groß genug sind, kann KI intelligenter werden!

Solange das Modell groß genug und die Stichproben groß genug sind, kann KI intelligenter werden!

- 王林nach vorne

- 2023-04-29 15:25:061519Durchsuche

Es gibt keinen Unterschied im mathematischen Mechanismus zwischen dem KI-Modell und dem menschlichen Gehirn.

Solange das Modell groß genug und die Proben groß genug sind, kann KI intelligenter werden! Das Aufkommen von

chatGPT hat dies tatsächlich bewiesen.

1. Die zugrunde liegenden Details der KI und des menschlichen Gehirns basieren auf if else-Anweisungen

logischen Operationen, die die grundlegenden Operationen sind, die Intelligenz erzeugen.

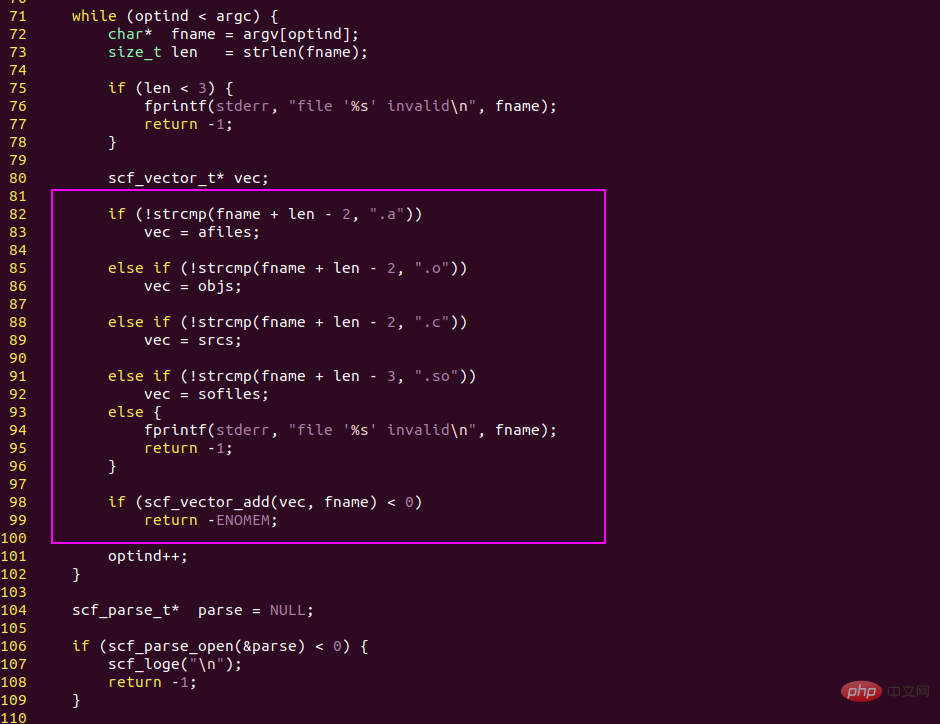

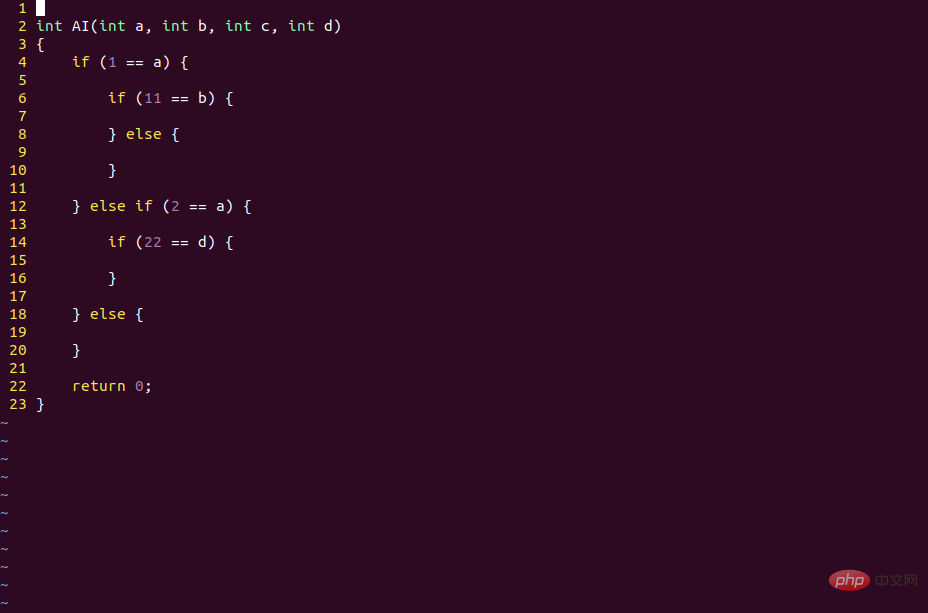

Die grundlegende Logik der Programmiersprache ist if else, die den Code basierend auf bedingten Ausdrücken in zwei Zweige unterteilt.

Auf dieser Basis können Programmierer sehr komplexe Codes schreiben und verschiedene Geschäftslogiken implementieren.

Die Grundlogik des menschlichen Gehirns ist auch if else. Die beiden Wörter if else stammen aus dem Englischen, und das entsprechende chinesische Vokabular lautet if...else...

#🎜🎜 #menschliches Gehirn Dies ist der gleiche logische Gedankengang beim Nachdenken über Probleme. In dieser Hinsicht unterscheidet es sich nicht von Computern.

Bei neuronalen Netzen ist dies jedoch nicht der Fall. Obwohl der Code geschrieben ist, müssen nur die Gewichtsdaten aktualisiert werden, um den logischen Kontext des Modells zu ändern.

Solange kontinuierlich neue Proben eingegeben werden, kann das KI-Modell die Gewichtsdaten mithilfe des BP-Algorithmus (Gradientenabstiegsalgorithmus) kontinuierlich aktualisieren, um sich an neue Geschäftsszenarien anzupassen.

Das Aktualisieren des KI-Modells erfordert keine Änderung des Codes, sondern nur eine Änderung der Daten, sodass dasselbe CNN-Modell unterschiedliche Objekte erkennen kann, wenn es mit unterschiedlichen Proben trainiert wird.

In diesem Prozess bleiben sowohl der Code des Tensorflow-Frameworks als auch die Netzwerkstruktur des KI-Modells unverändert. Was sich ändert, sind die Gewichtsdaten jedes Knotens.

Theoretisch kann ein KI-Modell intelligenter werden, solange es Daten durch das Netzwerk crawlen kann.

Unterscheidet sich das grundlegend davon, dass Menschen Dinge über einen Browser ansehen (und dadurch intelligenter werden)? Es scheint nicht.

4. Solange das Modell groß genug ist und die Proben groß genug sind, kann ChatGPT das menschliche Gehirn vielleicht wirklich herausfordern

Das menschliche Gehirn hat 15 Milliarden Neuronen und menschliche Augen und Ohren versorgen es jeden Moment mit neuen Daten KI-Modelle können dies sicherlich auch.

Vielleicht besteht der Vorteil des Menschen im Vergleich zur KI darin, dass die „Industriekette“ kürzer ist

Für die Geburt eines Babys sind nur seine Eltern erforderlich, aber die Geburt eines KI-Modells ist offensichtlich nicht etwas, das ein oder zwei Programmierer tun können .

Allein die Herstellung von GPUs erfordert mehr als Zehntausende Menschen.

Cuda-Programme auf GPUs sind nicht schwer zu schreiben, aber die Industriekette der GPU-Herstellung ist zu lang und der Geburt und dem Wachstum von Menschen weit unterlegen.

Das könnte der wahre Nachteil der KI im Vergleich zum Menschen sein.

Das obige ist der detaillierte Inhalt vonSolange das Modell groß genug und die Stichproben groß genug sind, kann KI intelligenter werden!. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr