Heim >Technologie-Peripheriegeräte >KI >Müssen Sie nach Sprachmodellen fragen, wenn Sie mit Ihrem Freund ausgehen? Natur: Ideen vorschlagen und Notizen zusammenfassen, GPT-3 ist zu einem zeitgenössischen „wissenschaftlichen Forscher' geworden.

Müssen Sie nach Sprachmodellen fragen, wenn Sie mit Ihrem Freund ausgehen? Natur: Ideen vorschlagen und Notizen zusammenfassen, GPT-3 ist zu einem zeitgenössischen „wissenschaftlichen Forscher' geworden.

- 王林nach vorne

- 2023-04-14 17:19:031124Durchsuche

Lassen Sie einen Affen zufällig Tasten auf einer Schreibmaschine drücken. Solange Sie ihm lange genug Zeit lassen, kann er die gesamten Werke von Shakespeare tippen.

Was wäre, wenn es ein Affe wäre, der Grammatik und Semantik versteht? Die Antwort ist, dass sogar wissenschaftliche Forschung für Sie erledigt werden kann!

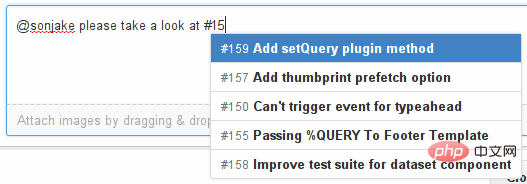

Vor einigen Jahren war es nur möglich, das nächste einzugebende Wort über die Eingabemethode automatisch zu vervollständigen , ist es bereits möglich, Forschern bei der Analyse und dem Schreiben wissenschaftlicher Arbeiten zu helfen und Code zu generieren.

Das Training großer Sprachmodelle (LLM) erfordert im Allgemeinen umfangreiche Textdaten für Unterstützung.

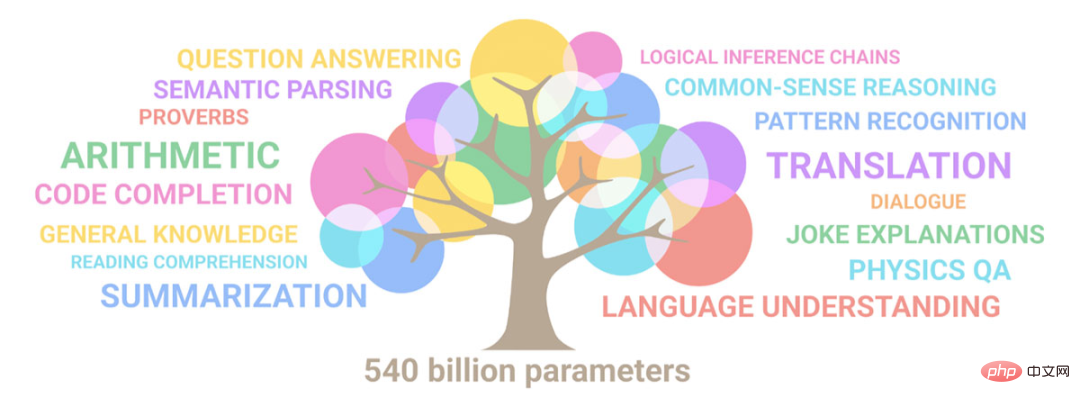

Im Jahr 2020 veröffentlichte OpenAI das GPT-3-Modell mit 175 Milliarden Parametern. Es kann Gedichte schreiben, mathematische Probleme lösen und fast alles, was das generative Modell kann, GPT -3 ist bereits da. Im Extremfall ist GPT-3 auch heute noch die Basis für viele Sprachmodelle, die verglichen und übertroffen werden müssen.

GPT-3 löste schnell heftige Diskussionen auf Twitter und anderen sozialen Medien aus. Viele Forscher waren überrascht.

GPT-3 Nach der Veröffentlichung des Onlinedienstes können Benutzer nach Belieben Text eingeben und das Modell Folgendes zurückgeben lassen. Die niedrigste Gebühr beträgt nur 0,0004 US-Dollar pro 750 Wörter verarbeitet, was erschwinglich ist. Angeblich von hoher Qualität und niedrigem Preis.

Kürzlich wurde in der Nature-Kolumne ein Artikel zum Thema Technologie veröffentlicht. Ich hätte nicht erwartet, dass diese Sprachmodelle Ihnen nicht nur beim Schreiben von Aufsätzen helfen können, sondern auch „Wissenschaftliche Forschung betreiben“!

Lassen Sie die Maschine Ihr Denken übernehmen. Sagte: Ich verwende GPT-3 fast jeden Tag, beispielsweise um die Zusammenfassung einer Arbeit zu überarbeiten.

Als Einarsson die Kopie bei einem Treffen im Juni vorbereitete, gab es zwar viele nutzlose Änderungsvorschläge von GPT-3, aber auch einige hilfreiche, wie zum Beispiel „Verwenden Sie die „Die Forschungsfrage ist am Anfang des Abstracts klarer“, und Sie werden ein solches Problem nicht erkennen, wenn Sie das Manuskript selbst lesen, es sei denn, Sie bitten jemand anderen, es für Sie zu lesen. Und warum kann diese andere Person das nicht sein? „GPT-3“?

Sprachmodelle können Ihnen sogar dabei helfen, Ihr experimentelles Design zu verbessern!

In einem anderen Projekt wollte Einarsson das Pictionary-Spiel nutzen, um Sprachdaten unter den Teilnehmern zu sammeln.

Nach einer Beschreibung des Spiels gab GPT-3 einige Vorschläge für Spielmodifikationen. Theoretisch könnten Forscher auch neue Versuche für experimentelle Protokolle fordern. Einige Forscher verwenden Sprachmodelle auch, um Papiertitel zu generieren oder Texte lesbarer zu machen.

Die von Mina Lee, einer Doktorandin und Professorin für Informatik an der Stanford University, verwendete Methode besteht darin, „Verwenden Sie diese Schlüsselwörter, um einen Papiertitel zu generieren“ einzugeben. in GPT-3. Tipp: Das Modell hilft Ihnen beim Entwurf einiger Titel.

Link: https://cohere.ai/generate

#🎜🎜 #

Generate wurde von Cohere, einem NLP-Unternehmen in Kanada, entwickelt. Der Workflow des Modells ist GPT-3 sehr ähnlich. Geben Sie einfach Notizen ein oder sprechen Sie einfach über einige Ideen und fügen Sie schließlich „Zusammenfassen“ oder „In ein abstraktes Konzept umwandeln“ hinzu, und das Modell hilft Ihnen automatisch Ordnen Sie Ihre Gedanken.

Warum den Code selbst schreiben?

OpenAI-Forscher trainierten GPT-3 anhand einer großen Textmenge, darunter Bücher, Nachrichten, Wikipedia-Einträge und Softwarecode.

Später bemerkte das Team, dass GPT-3 Code genauso vervollständigen konnte wie normaler Text.

Die Forscher haben eine fein abgestimmte Version des Algorithmus namens Codex erstellt, die auf mehr als 150 GB Text von der Code-Sharing-Plattform GitHub trainiert wurde. Jetzt ist Codex integriert in die Dienste von Copilot einbinden, um Benutzer beim Schreiben von Code zu unterstützen. Luca Soldaini, Informatiker bei AI2 am Allen Institute for Artificial Intelligence in Seattle, Washington, sagt, dass mindestens die Hälfte der Leute in ihrem Büro Copilot verwenden#🎜🎜 #

Soldaini sagte dass Copilot am besten für sich wiederholende Programmierszenarien geeignet ist. Eines seiner Projekte umfasste beispielsweise das Schreiben von Vorlagencode für die Verarbeitung von PDFs, den Copilot direkt fertigstellte.Der Vervollständigungsinhalt von Copilot macht jedoch oft Fehler, daher ist es am besten, ihn in Sprachen zu verwenden, mit denen Sie vertraut sind.

Literaturrecherche

Das vielleicht ausgereifteste Anwendungsszenario von Sprachmodellen ist das Suchen und Zusammenfassen von Dokumenten.

Die von AI2 entwickelte Semantic Scholar-Suchmaschine verwendet das TLDR-Sprachmodell, um eine Twitter-ähnliche Beschreibung jedes Artikels zu geben. Die Suchmaschine deckt rund 200 Millionen Artikel ab, die meisten davon aus den Bereichen Biomedizin und Informatik.

TLDR wurde auf der Grundlage des zuvor von Meta veröffentlichten BART-Modells entwickelt, und dann haben AI2-Forscher das Modell auf der Grundlage von von Menschen verfassten Zusammenfassungen verfeinert.

Manchmal haben Forscher Fragen, nachdem sie die Zusammenfassung einer wissenschaftlichen Arbeit gelesen haben, hatten aber keine Zeit, den vollständigen Text zu lesen.

Manchmal haben Forscher Fragen, nachdem sie die Zusammenfassung einer wissenschaftlichen Arbeit gelesen haben, hatten aber keine Zeit, den vollständigen Text zu lesen.

Auch im Bereich NLP hat ein Team von AI2 ein Tool entwickelt, das diese Fragen beantworten kann.

Das Modell bittet Forscher zunächst, die Zusammenfassung einer NLP-Arbeit zu lesen und stellt dann relevante Fragen (z. B. „Welche fünf Gesprächsattribute wurden analysiert?“)#🎜🎜 ##🎜 🎜#

Das Forschungsteam bat dann andere Forscher, diese Fragen zu beantworten, nachdem es den gesamten Artikel gelesen hatte.

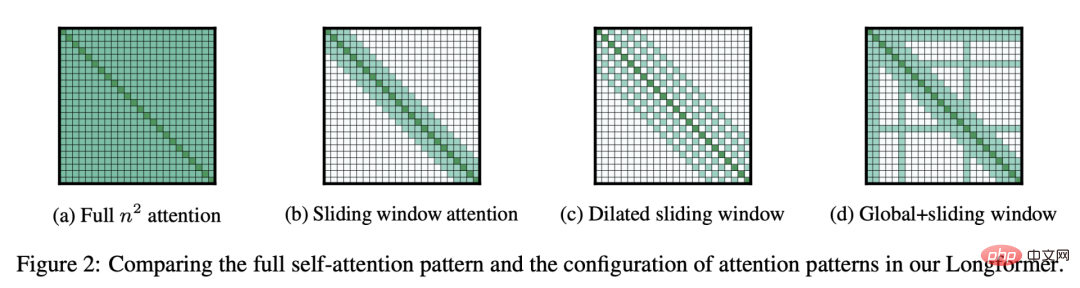

AI2 trainierte eine andere Version des Longformer-Sprachmodells mit einer Eingabe von eins Erstellen Sie eine vollständige Arbeit und verwenden Sie dann den gesammelten Datensatz, um Antworten auf verschiedene Fragen zu anderen Arbeiten zu generieren. Das ACCoRD-Modell kann Definitionen und Analogien für 150 wissenschaftliche Konzepte im Zusammenhang mit NLP generieren. MS2 ist ein Datensatz mit 470.000 medizinischen Dokumenten und 20.000 Zusammenfassungen mehrerer Dokumente. Nach der Feinabstimmung von BART mit MS2 konnten die Forscher eine Frage und einen Satz stellen des Dokuments und erstellen Sie eine kurze Metaanalyse-Zusammenfassung. Im Jahr 2019 verfeinerte AI2 BERT, das 2018 von Google erstellte Sprachmodell, und erstellte SciBERT mit 110 Millionen Parametern basierend auf der Arbeit von Semantic Scholar#🎜 🎜#Scite nutzte künstliche Intelligenz, um eine wissenschaftliche Suchmaschine zu erstellen und SciBERT weiter zu verfeinern, um Arbeiten zuzuordnen, die die Zielarbeit zitieren, wenn die Suchmaschine sie in der Kategorie unterstützt, kontrastiert oder auf andere Weise verweist zur These. Rosati sagte, diese Nuance helfe den Menschen, Einschränkungen oder Lücken in der wissenschaftlichen Literatur zu erkennen.

Das SPECTRE-Modell von AI2 basiert auch auf SciBERT, das Arbeiten in kompakte mathematische Darstellungen vereinfacht. Organisatoren von Konferenzen nutzen SPECTER, um eingereichte Beiträge den Peer-Reviewern zuzuordnen, und Semantic Scholar verwendet es, um Beiträge basierend auf den Bibliotheken der Benutzer zu empfehlen, sagte Weld.

Tom Hope, Informatiker an der Hebräischen Universität und AI2, sagte, dass sie Forschungsprojekte zur Feinabstimmung von Sprachmodellen haben, um wirksame Medikamentenkombinationen, Zusammenhänge zwischen Genen und Krankheiten sowie wissenschaftliche Herausforderungen und Richtungen in der COVID-19-Forschung zu identifizieren.

Aber können Sprachmodelle tiefere Einblicke oder sogar Entdeckungsmöglichkeiten bieten?

Im Mai verfassten Hope und Weld gemeinsam mit Eric Horvitz, Chief Science Officer von Microsoft, einen Kommentar, in dem sie die Herausforderungen beim Erreichen dieses Ziels darlegten, einschließlich der Vermittlung von Modellen, um „die Konsequenzen der Neukombination zweier Konzepte abzuleiten“.

Hope sagte, dass dies im Grunde dasselbe ist wie das DALL E 2-Bilderzeugungsmodell von OpenAI, „das ein Bild einer in den Weltraum fliegenden Katze erzeugt“, aber wie können wir abstrakte und hochkomplexe wissenschaftliche Konzepte kombinieren?

Dies ist eine offene Frage.

Heutzutage haben große Sprachmodelle einen echten Einfluss auf die Forschung, und wenn die Menschen nicht damit begonnen haben, diese großen Sprachmodelle zur Unterstützung ihrer Arbeit zu nutzen, werden sie diese Möglichkeiten verpassen.

Referenz:

https://www.nature.com/articles/d41586-022-03479-w

Das obige ist der detaillierte Inhalt vonMüssen Sie nach Sprachmodellen fragen, wenn Sie mit Ihrem Freund ausgehen? Natur: Ideen vorschlagen und Notizen zusammenfassen, GPT-3 ist zu einem zeitgenössischen „wissenschaftlichen Forscher' geworden.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr