Heim >Technologie-Peripheriegeräte >KI >Wirklich wichtige Forschung! 32 Artikel nehmen die KI-Hotspots im Jahr 2022 unter die Lupe

Wirklich wichtige Forschung! 32 Artikel nehmen die KI-Hotspots im Jahr 2022 unter die Lupe

- 王林nach vorne

- 2023-04-13 19:34:011964Durchsuche

Während sich die Welt immer noch erholt, hat die Forschung ihr rasantes Tempo nicht verlangsamt, insbesondere im Bereich der künstlichen Intelligenz.

Darüber hinaus gibt es dieses Jahr einen neuen Schwerpunkt auf KI-Ethik, Voreingenommenheit, Governance und Transparenz.

Künstliche Intelligenz und unser Verständnis des menschlichen Gehirns und seiner Verbindung zur künstlichen Intelligenz entwickeln sich ständig weiter, und in naher Zukunft werden diese Anwendungen, die die Qualität unseres Lebens verbessern, glänzen.

Der bekannte Blogger Louis Bouchard zählte in seinem Blog auch 32 (!) KI-Technologie-Durchbrüche im Jahr 2022.

Werfen wir einen Blick auf diese erstaunlichen Studien!

Artikeladresse: https://www.louisbouchard.ai/2022-ai-recap/

LaMA: Resolution Robust Large Mask Repair Based on Fourier Convolution

Sie müssen dabei gewesen sein Diese Situation: Sie und Ihre Freunde haben ein tolles Foto gemacht. Infolgedessen stellen Sie fest, dass jemand hinter Ihnen steht und die Fotos zerstört, die Sie an Moments oder Xiaohongshu senden möchten. Aber mittlerweile ist das kein Problem mehr.

Die auflösungsrobuste Inpainting-Methode für große Masken basierend auf der Fourier-Faltung ermöglicht es Benutzern, unerwünschte Inhalte einfach aus Bildern zu entfernen. Sowohl Menschen als auch Mülleimer können leicht verschwinden.

Es ist wie ein professioneller PS-Designer in Ihrer Tasche, er kann einfach mit nur einem Klick gelöscht werden.

Obwohl es scheinbar einfach ist, ist das Inpainting von Bildern ein Problem, das viele KI-Forscher schon seit langem lösen.

Papierlink: https://arxiv.org/abs/2109.07161

Projektadresse: https://github.com/saic-mdal/lama

Colab-Demo: https://colab.research.google.com/github/saic-mdal/lama/blob/master/colab/LaMa_inpainting.ipynb

Video-Erklärung: https://youtu.be/Ia79AvGzveQ

Kurzanalyse: https://www.louisbouchard.ai/lama/

STIT: Echte Video-Gesichtsbearbeitung auf Basis von GAN

So ein Erlebnis müssen Sie gehabt haben: beim Anschauen eines Films, Sie werden feststellen, dass die Schauspieler im Film viel jünger aussehen als sie selbst.

Will Smith in Gemini Man

Früher erforderte dies, dass Profis Hunderte oder sogar Tausende von Arbeitsstunden damit verbrachten, die Szenen, in denen diese Schauspieler auftraten, manuell zu bearbeiten. Aber mit KI können Sie es in wenigen Minuten erledigen.

Tatsächlich ermöglichen Ihnen viele Technologien, Ihr Lächeln zu verbessern und Sie jünger oder älter aussehen zu lassen, und das alles automatisch mithilfe von auf künstlicher Intelligenz basierenden Algorithmen. Es heißt im Video KI-basierte Gesichtsmanipulationen und stellt den Stand der Technik im Jahr 2022 dar.

Papierlink: https://arxiv.org/abs/2201.08361

Projektadresse: https://github.com/rotemtzaban/STIT

Video-Erklärung: https://youtu.be/mqItu9XoUgk

Kurzanalyse: https://www.louisbouchard.ai/stitch-it-in-time/

NeROIC : Mit neuronalem Rendering aus der Online-Galerie

Mit neuronalem Rendering können durch Bilder von Objekten, Personen oder Szenen realistische 3D-Modelle im Raum generiert werden.

Mit dieser Technologie benötigen Sie nur ein paar Bilder eines Objekts und können die Maschine bitten, das Objekt auf diesen Bildern zu verstehen und zu simulieren, wie es im Weltraum aussieht.

Die physische Form von Objekten anhand von Bildern zu verstehen, ist für Menschen einfach, weil wir die reale Welt verstehen. Aber für eine Maschine, die nur Pixel sehen kann, ist das eine ganz andere Herausforderung.

Wie kann das generierte Modell in neue Szenen integriert werden? Was passiert, wenn die Lichtverhältnisse und Winkel des Fotos unterschiedlich sind und sich das resultierende Modell entsprechend ändert? Dies sind Fragen, die Snapchat und die University of Southern California in dieser neuen Studie beantworten mussten.

Papierlink: https://arxiv.org/abs/2201.02533

Projektadresse: https://github.com/snap-research/NeROIC

Video-Erklärung: https://youtu.be/88Pl9zD1Z78

Kurzanalyse: https://www.louisbouchard.ai/neroic/

SpeechPainter: Sprachreparatur unter Textbedingungen

Für Bilder für Beispielsweise kann die auf maschinellem Lernen basierende Inpainting-Technologie nicht nur den Inhalt entfernen, sondern basierend auf Hintergrundinformationen auch die fehlenden Teile des Bildes ergänzen.

Bei der Videowiederherstellung besteht die Herausforderung nicht nur darin, die Konsistenz von Frame zu Frame aufrechtzuerhalten, sondern auch die Erzeugung fehlerhafter Artefakte zu vermeiden. Wenn Sie eine Person erfolgreich aus dem Video „schmeißen“, müssen Sie gleichzeitig auch ihre Stimme löschen.

Zu diesem Zweck haben Google-Forscher eine neue Sprachreparaturmethode vorgeschlagen, mit der Grammatik und Aussprache korrigiert und sogar Hintergrundgeräusche in Videos entfernt werden können.

Papierlink: https://arxiv.org/abs/2202.07273

Video-Erklärung: https://youtu.be/zIIc4bRf5Hg

Kurzanalyse: https:// www.louisbouchard.ai/speech-inpainting-with-ai/

GFP-GAN: Wiederherstellung blinder Gesichter in der realen Welt mit generativen Gesichtsprioritäten

Haben Sie einige alte Fotos, die Sie aufgrund des Alters schätzen? vor einiger Zeit und die Bildqualität ist verschwommen? Machen Sie sich keine Sorgen, mit der Blind Face Restoration bleiben Ihre Erinnerungen für immer erhalten.

Dieses neue und kostenlose KI-Modell kann die meisten Ihrer alten Fotos im Handumdrehen reparieren. Es funktioniert sehr gut, auch wenn das Foto vor der Restaurierung von sehr geringer Qualität ist. Früher war das eine ziemliche Herausforderung.

Was noch cooler ist, ist, dass du es nach Belieben ausprobieren kannst. Sie haben den Code als Open Source bereitgestellt und eine Demo- und Online-Anwendung erstellt, die jeder ausprobieren kann. Ich glaube, diese Technologie wird Sie überraschen!

Papierlink: https://arxiv.org/abs/2101.04061

Projektadresse: https://github.com/TencentARC/GFPGAN

Colab-Demo: https://colab.research.google.com/drive/1sVsoBd9AjckIXThgtZhGrHRfFI6UUYOo

Online-Bewerbung: https://huggingface.co/spaces/akhaliq/GFPGAN

. Video Erklärung: https://youtu.be/nLDVtzcSeqM

Kurzanalyse: https://www.louisbouchard.ai/gfp-gan/

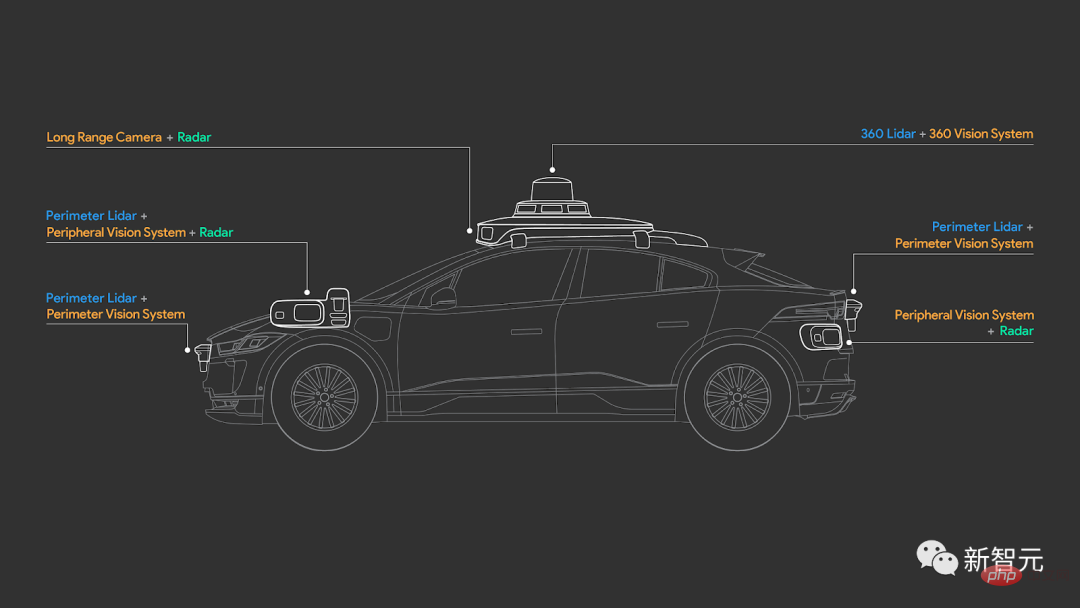

4D-Net: Lernen der multimodalen Ausrichtung

Wie sehen selbstfahrende Autos „sechs Richtungen“?

Vielleicht haben Sie schon von LiDAR-Sensoren oder anderen seltsamen Kameras gehört, die Automobilhersteller verwenden. Doch wie funktionieren sie, wie sehen sie die Welt und was genau sehen sie anders als wir?

Link zum Papier: https://arxiv.org/abs/2109.01066

Im Gegensatz zu Tesla, das nur Kameras verwendet, um die Welt zu verstehen, verwenden die meisten Hersteller selbstfahrender Autos wie Waymo Verwenden Sie eine normale Kamera und einen 3D-LiDAR-Sensor.

Sie erzeugen keine Bilder wie herkömmliche Kameras, sondern erzeugen 3D-Punktwolken, nutzen RGB-Erfassungsinformationen, messen den Abstand zwischen Objekten und berechnen die Laufzeit des gepulsten Lasers, den sie auf das Objekt projizieren.

Aber wie können wir diese Informationen effektiv kombinieren und dafür sorgen, dass das Fahrzeug sie versteht? Was wird das Fahrzeug letztendlich sehen? Ist autonomes Fahren sicher genug? Eine neue Forschungsarbeit von Waymo und Google wird diese Rätsel beantworten.

Video-Erklärung: https://youtu.be/0nJMnw1Ldks

Kurzanalyse: https://www.louisbouchard.ai/waymo-lidar/

Instant NeRF: basierend auf Multi -Auflösung Rate-Hash-codierte sofortige neuronale Grundelemente

Wie kann man anhand von Fotos simulieren, wie die Welt aussieht?

Mithilfe von KI-Modellen können Menschen aufgenommene Bilder in hochwertige 3D-Modelle umwandeln. Diese anspruchsvolle Aufgabe ermöglicht es Forschern, mithilfe von 2D-Bildern zu erstellen, wie ein Objekt oder eine Person in einer dreidimensionalen Welt aussehen würde.

Mit grafischen Grundelementen basierend auf Hash-Codierung erreichte NVIDIA 5 Sekunden Training von NeRF und erzielte bessere Ergebnisse. In weniger als zwei Jahren Forschung konnte die Trainingsgeschwindigkeit von NeRF um mehr als das Tausendfache gesteigert werden.

Papierlink: https://arxiv.org/abs/2201.05989

Projektadresse: https://github.com/NVlabs/instant-ngp

Video-Erklärung: https://youtu.be/UHQZBQOVAIU

Kurzanalyse: https://www.louisbouchard.ai/nvidia-photos-into-3d-scenes/

DALL· E 2: Text-zu-Bild-Generierungsmodell basierend auf CLIP-Funktionen

Letztes Jahr veröffentlichte OpenAI das Text-zu-Bild-Generierungsmodell DALL·E. Jetzt ist die aktualisierte Version von DALL·E 2 wieder da.

DALL·E 2 generiert nicht nur realistische Bilder aus Text, seine Ausgabe hat auch die vierfache Auflösung!

Allerdings scheint die Leistungsverbesserung nicht auszureichen, um OpenAI zufrieden zu stellen, weshalb sie DALL·E 2 auch eine neue Fähigkeit erlernen lassen: Bildreparatur.

Das heißt, Sie können Bilder mit DALL·E 2 bearbeiten oder beliebige neue Elemente hinzufügen, wie zum Beispiel einen Flamingo im Hintergrund.

Papierlink: https://arxiv.org/abs/2204.06125

Video-Erklärung: https://youtu.be/rdGVbPI42sA

. Kurzanalyse: https ://www.louisbouchard.ai/openais-new-model-dall-e-2-is-amazing/

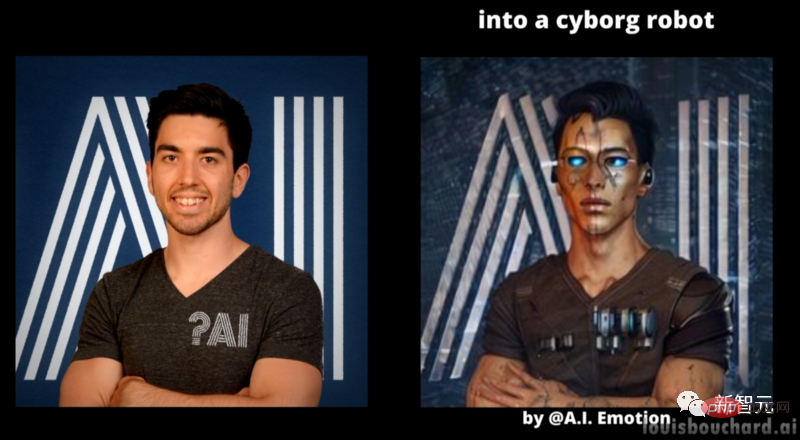

MyStyle: Personalisierte Generation vor

Google und die Universität Tel Aviv haben eine sehr leistungsstarke DeepFake-Technologie vorgeschlagen. Damit können Sie fast alles machen.

Machen Sie einfach Hunderte von Fotos einer Person, kodieren Sie deren Bild und korrigieren, bearbeiten oder erstellen Sie den gewünschten Look.

Es ist sowohl erstaunlich als auch beängstigend, besonders wenn man die erzielten Ergebnisse sieht.

Paper Link: https://arxiv.org/abs/2203.17272

project Adresse: https://mystyle-personalisierte-profic.github.io/

Video-Erklärung: https://youtu.be/BNWAEvFfFvQ

Kurze Analyse: https://www.louisbouchard.ai/mystyle/

OPT: offenes vorab trainiertes Transformer-Sprachmodell

Was GPT-3 so leistungsstark macht, ist seine Architektur und Größe.

Es verfügt über 175 Milliarden Parameter, doppelt so viele Neuronen wie das menschliche Gehirn! Ein so großes neuronales Netzwerk ermöglichte es dem Modell, nahezu das gesamte Internet zu erlernen und zu verstehen, wie wir Texte schreiben, austauschen und verstehen.

Gerade als die Leute von den leistungsstarken Funktionen von GPT-3 begeistert waren, machte Meta einen großen Schritt in Richtung Open-Source-Community. Sie haben ein ebenso leistungsstarkes Modell veröffentlicht, das jetzt vollständig Open Source ist!

Dieses Modell verfügt nicht nur über mehr als 100 Milliarden Parameter, sondern OPT-175B ist im Vergleich zu GPT-3 auch offener und zugänglicher.

Papierlink: https://arxiv.org/abs/2205.01068

Projektadresse: https://github.com/facebookresearch/metaseq

Videolink: https://youtu.be/Ejg0OunCi9U

Kurzanalyse: https://www.louisbouchard.ai/opt-meta/

BlobGAN: Räumlich diskrete Szenendarstellung

Für Wie man eine Szene beschreibt, hat das Adobe-Forschungsteam eine neue Methode entwickelt: BlobGAN.

BlobGAN verwendet „Blobs“, um Objekte in der Szene zu beschreiben. Die Forscher können die Blobs verschieben und sie so vergrößern, verkleinern oder sogar löschen, was den gleichen Effekt auf das Objekt hat, das sie im Bild darstellen.

Während die Autoren ihre Ergebnisse teilen, können Sie durch Duplizieren von Blobs neue Bilder im Datensatz erstellen.

Jetzt ist der Code von BlobGAN Open Source, interessierte Freunde, beeilt euch und probiert es aus!

Papierlink: https://arxiv.org/abs/2205.02837

Projektadresse: https://github.com/dave-epstein/blobgan

Colab Demo : https://colab.research.google.com/drive/1clvh28Yds5CvKsYYENGLS3iIIrlZK4xO?usp=sharing#scrollTo=0QuVIyVplOKu

Video-Erklärung: https://youtu.be/mnEzjpiA_4E

Kurzanalyse: https://www.louisbouchard.ai/blobgan/

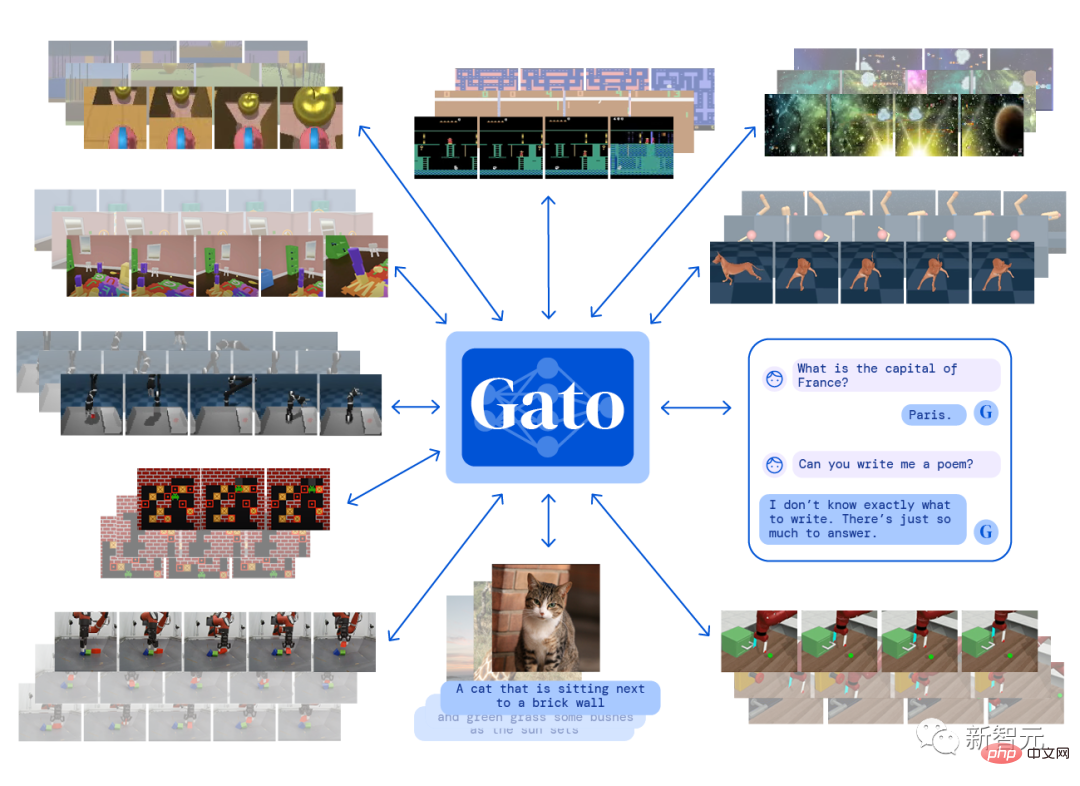

Gato: Generalist Agent

DeepMind hat einen einzigen „allgemeinen“ Agenten Gato erstellt. Sie können Atari-Spiele spielen, Untertitelbilder erstellen, mit Menschen chatten und Roboterarme steuern!

Was noch schockierender ist, ist, dass es alle Aufgaben nach nur einem Training und mit den gleichen Gewichten bewältigen kann.

Gato ist ein multimodaler Agent. Das bedeutet, dass es sowohl Bildunterschriften erstellen als auch als Chatbot zur Beantwortung von Fragen fungieren kann.

Obwohl GPT-3 auch mit Ihnen chatten kann, ist es offensichtlich, dass Gato mehr kann. Schließlich gibt es oft KIs, die chatten können, aber nicht viele, die mit ihnen Spiele spielen können.

Papierlink: https://arxiv.org/abs/2205.06175

Video-Erklärung: https://youtu.be/xZKSWNv6Esc

kurz Story-Analyse: https://www.louisbouchard.ai/deepmind-gato/

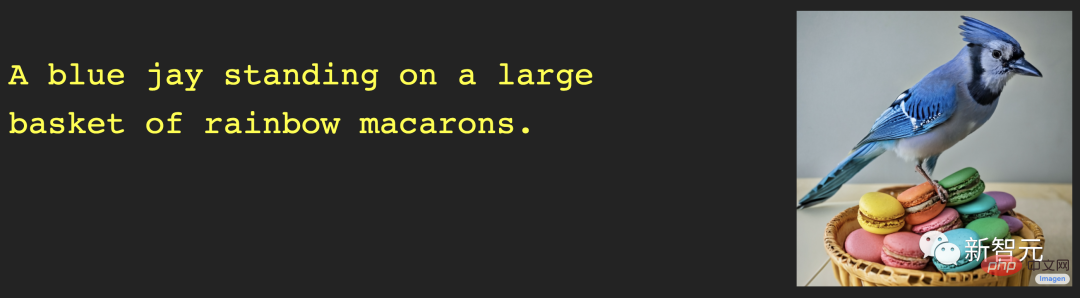

Bilder: Text-zu-Bild-Diffusionsmodell mit tiefem Sprachverständnis

Wenn Sie denken, dass DALL·E 2 ausgezeichnet ist, dann könnten Sie das vielleicht tun Werfen Sie auch einen Blick darauf. Dieses neue Modell von Google Brain – Imagen – kann etwas.

DALL·E ist erstaunlich, aber den erzeugten Bildern mangelt es oft an Realismus. Dies ist das Problem, das das vom Google-Team entwickelte Imagen lösen soll.

Benchmarks zum Vergleich von Text-Bild-Modellen zufolge hat Imagen bemerkenswerte Ergebnisse bei der Text-Bild-Synthese mit Texteinbettungen für große Sprachmodelle erzielt. Die resultierenden Bilder sind sowohl fantasievoll als auch realistisch.

Papierlink: https://arxiv.org/abs/2205.11487

Projektadresse: https://imagen.research.google/

Video-Erklärung: https://youtu.be/qhtYPhPWCsI

Kurze Analyse: https://www.louisbouchard.ai/google-brain-imagen/

DALL·E Mini

Ein Set Xiao Zhas gruselige Bilder waren eine Zeit lang auf Twitter beliebt. Diese Reihe von San-Werken mit gutem Preis-Leistungs-Verhältnis wurde von DALL·E mini erstellt.

Als „Youth Edition“ der DALL·E-Familie ist DALL·E mini kostenlos und Open Source. Der Code wurde verlassen. Wer wird der nächste Charakter sein, der magisch verändert wird?

Projektadresse: https://github.com/borisdayma/dalle-mini

Online-Erlebnis: https://huggingface.co/spaces/dalle-mini/dalle-mini

Video-Erklärung: https://youtu.be/K3bZXXjW788

Kurzanalyse: https://www.louisbouchard.ai/dalle-mini/

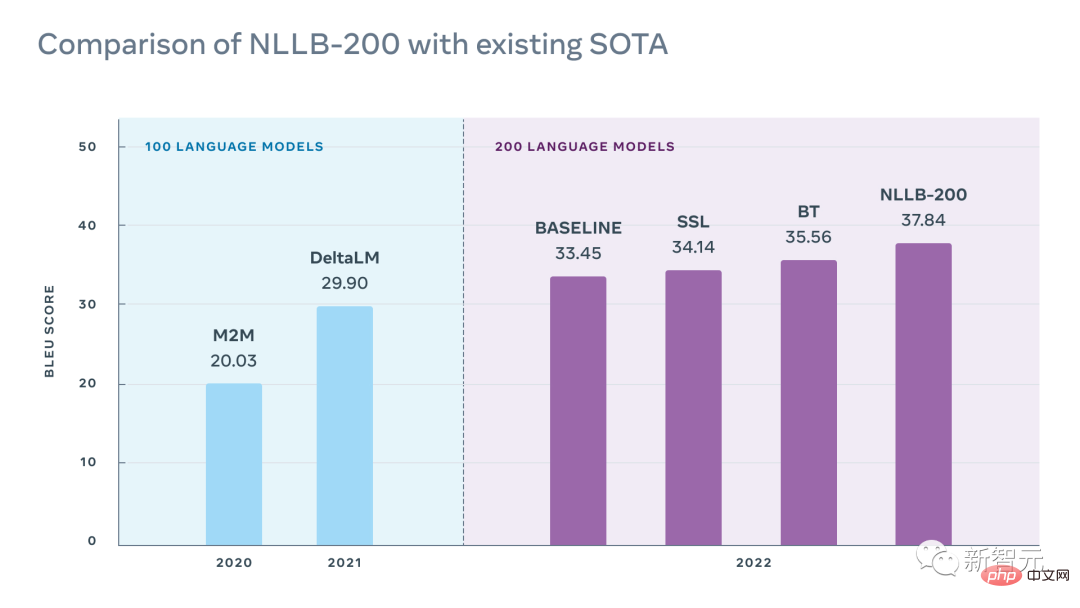

NLLB: No language left behind

The Das von Meta AI veröffentlichte NLLB-200-Modell stammt von „No Language Left Behind“ und ermöglicht eine beliebige Übersetzung in mehr als 200 Sprachen.

Der Höhepunkt der Forschung ist, dass Forscher die meisten ressourcenarmen Sprachtrainings um mehrere Größenordnungen verbessert und dabei SOTA-Ergebnisse für mehr als 200 Sprachübersetzungen erzielt haben.

Papierlink: https://research.facebook.com/publications/no-lingual-left-behind/

Projektadresse: https://github.com/facebookresearch/ fairseq/tree/nllb

Online-Erlebnis: https://nllb.metademolab.com/

Video-Erklärung: https://youtu.be/2G4NeG17Eis

. Kurze Analyse: https://www.louisbouchard.ai/no-lingual-left-behind/

Dual-Shutter optisches Vibrationssensorsystem

Kann man auch Geräusche sehen?

Diese Forschung, die mit dem CVPR 2022 Best Paper Honorary Award ausgezeichnet wurde, schlägt eine neuartige Dual-Shutter-Methode vor, um Hochgeschwindigkeitsoberflächen (bis zu 63 kHz) mehrerer Szenenquellen gleichzeitig zu erkennen, indem eine „langsame“ Kameravibration (130 FPS) verwendet wird , und zwar durch die Erfassung der von der Audioquelle verursachten Vibrationen.

So können verschiedene Anforderungen wie die Trennung von Musikinstrumenten und die Geräuschunterdrückung realisiert werden.

Papierlink: https://openaccess.thecvf.com/content/CVPR2022/papers/Sheinin_Dual-Shutter_Optical_Vibration_Sensing_CVPR_2022_paper.pdf

Projekt Adresse: https://imaging.cs.cmu .edu/vibration/

Video-Erklärung: https://youtu.be/n1M8ZVspJcs

Kurzanalyse: https://www.louisbouchard.ai/cvpr-2022-best -Papier/

Make-A-Scene: Szenenbasierte Text-zu-Bild-Generierung mit menschlichen Prioritäten

Make-A-Scene ist nicht nur „ein weiterer DALL·E“.

Es ist zwar wirklich cool, dass DALL·E zufällige Bilder basierend auf Textaufforderungen generieren kann, es schränkt aber auch die Kontrolle des Benutzers über die generierten Ergebnisse ein.

Metas Ziel ist es, den kreativen Ausdruck zu fördern, indem dieser Text-zu-Bild-Trend mit dem vorherigen Skizze-zu-Bild-Modell kombiniert wird, was zu „Make-A-Scene“ führt: einer Brücke zwischen Text und skizzenbedingter Bildgenerierung . Eine wunderbare Mischung.

Papierlink: https://arxiv.org/abs/2203.13131

Video-Erklärung: https://youtu.be/K3bZXXjW788

Kurzanalyse: https://www.louisbouchard.ai/make-a-scene/

BANMo: Aus jedem Video erstellen ein Ziel-3D-Animationsmodell

Basierend auf dieser Forschung von Meta müssen Sie nur ein beliebiges Video angeben, das verformbare Objekte erfasst, wie zum Beispiel mehrere Videos von Katzen und Welpen, und BANMo kann diese aus Tausenden von 2D-Hinweisen kombinieren in einen kanonischen Raum integriert, um ein bearbeitbares animiertes 3D-Modell zu rekonstruieren, ohne dass vordefinierte Formvorlagen erforderlich sind.

Papierlink: https://arxiv.org/abs/2112.12761

Projektadresse: https://github.com/facebookresearch/banmo

Video-Erklärung: https://youtu.be/jDTy-liFoCQ

Kurze Analyse: https://www.louisbouchard.ai/banmo/

Verwendung eines latenten Diffusionsmodells für hochauflösende Bildsynthese

Was haben die beliebten Bilderzeugungsmodelle DALL·E, Imagen und Stable Diffusion dieses Jahres gemeinsam, die populär geworden sind? Was haben diese leistungsstarken Bilderzeugungsmodelle gemeinsam? Abgesehen von hohen Rechenkosten und umfangreicher Trainingszeit basieren sie alle auf demselben Diffusionsmechanismus.

Diffusionsmodelle haben kürzlich bei den meisten Bildaufgaben SOTA-Ergebnisse erzielt, einschließlich Text-zu-Bild mit DALL·E und vielen anderen Aufgaben im Zusammenhang mit der Bilderzeugung wie Bildinpainting, Stilübertragung oder Bild-Superauflösung.

Papierlink: https://arxiv.org/abs/2112.10752

Projektadresse: https://github.com/CompVis/latent-diffusion

Video-Erklärung: https://youtu.be/RGBNdD3Wn-g

Kurzanalyse: https://www.louisbouchard.ai/latent-diffusion-models/

PSG: Szenenbasierte Bildgenerierung Modell

AI kann Ihnen dabei helfen, Objekte in Bildern genau zu identifizieren, aber die Beziehung zwischen Objekten und der Umgebung zu verstehen ist nicht so einfach.

Zu diesem Zweck schlugen Forscher des Nanyang Polytechnic eine panoptische Szenegraphgenerierungsaufgabe (PSG) vor, die auf Panoramasegmentierung basiert.

Im Vergleich zur herkömmlichen Szenendiagrammgenerierung basierend auf Erkennungsrahmen erfordert die PSG-Aufgabe die umfassende Ausgabe aller Beziehungen im Bild (einschließlich der Beziehung zwischen Objekten und Objekten, der Beziehung zwischen Objekten und Hintergrund und der Beziehung zwischen Hintergrund und Hintergrund). und die Verwendung präziser Segmentierungsblöcke zur Positionierung von Objekten.

Papierlink: https://arxiv.org/abs/2207.11247

Projektadresse: https://psgdataset.org/

Online-Bewerbung: https : //huggingface.co/spaces/ECCV2022/PSG

Video-Erklärung: https://youtu.be/cSsE_H_0Cr8

Kurze Analyse: https://www.louisbouchard.ai /psg/

Verwenden Sie die Textumkehr, um eine personalisierte Text-zu-Bild-Generierung zu erreichen

Man kann sagen, dass die Bilderzeugungsmodelle der großen Hersteller in diesem Jahr wie die Acht Unsterblichen sind, die das Meer überqueren und jeweils ihre magischen Kräfte zeigen, aber wie kann man das Modell dazu bringen, Bildwerke eines bestimmten Stils zu erzeugen?

Wissenschaftler der Universität Tel Aviv und NVIDIA haben zusammengearbeitet, um ein personalisiertes Bildgenerierungsmodell auf den Markt zu bringen, mit dem Sie die gewünschten Bilder selbst erstellen können.

Papierlink: https://arxiv.org/abs/2208.01618

Projektadresse: https://textual-inversion.github.io/

Video-Erklärung: https://youtu.be/f3oXa7_SYek

Kurzanalyse: https://www.louisbouchard.ai/imageworthoneword/

Sprachbild-Vortrainingsmodell für allgemeine Videoerkennung

Das Erlernen visueller Textmodelle hat zweifellos große Erfolge erzielt. Wie diese neue Methode zum Vortraining von Sprachbildern jedoch auf den Videobereich ausgeweitet werden kann, ist noch offen.

Wissenschaftler von Microsoft und der Chinesischen Akademie der Wissenschaften haben eine einfache und effektive Methode vorgeschlagen, um vorab trainierte Sprach-Bild-Modelle direkt an die Videoerkennung anzupassen, anstatt neue Modelle von Grund auf vorab zu trainieren.

Papierlink: https://arxiv.org/abs/2208.02816

Projektadresse: https://github.com/microsoft/VideoX/tree/master/X-CLIP

Video-Erklärung: https://youtu.be/seb4lmVPEe8

Kurzanalyse: https://www.louisbouchard.ai/general-video-recognition/

Make-A-Video: Videomodell zur Textgenerierung mit einem Klick

Der Maler kann frei auf der Leinwand malen. Können Sie sich vorstellen, dass bei einem so klaren und flüssigen Bild jedes Bild des Videos von KI generiert wird?

Make-A-Video, gestartet von MetaAI, kann durch einfache Eingabe einiger Wörter in wenigen Sekunden Videos verschiedener Stile erstellen. Es ist nicht übertrieben, es die „Videoversion von DALL·E“ zu nennen.

Papierlink: https://arxiv.org/abs/2209.14792

Video-Erklärung: https://youtu.be/MWwESVyHWto.

kurz Story-Analyse: https://www.louisbouchard.ai/make-a-video/

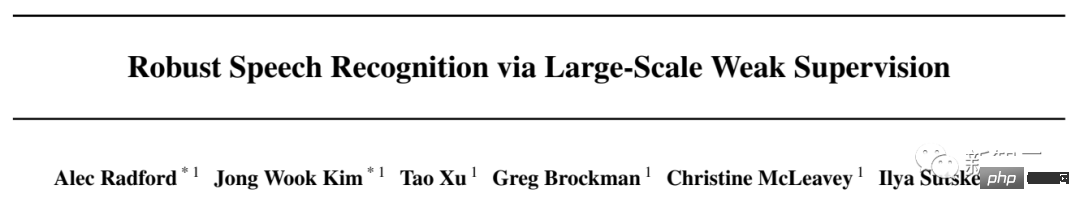

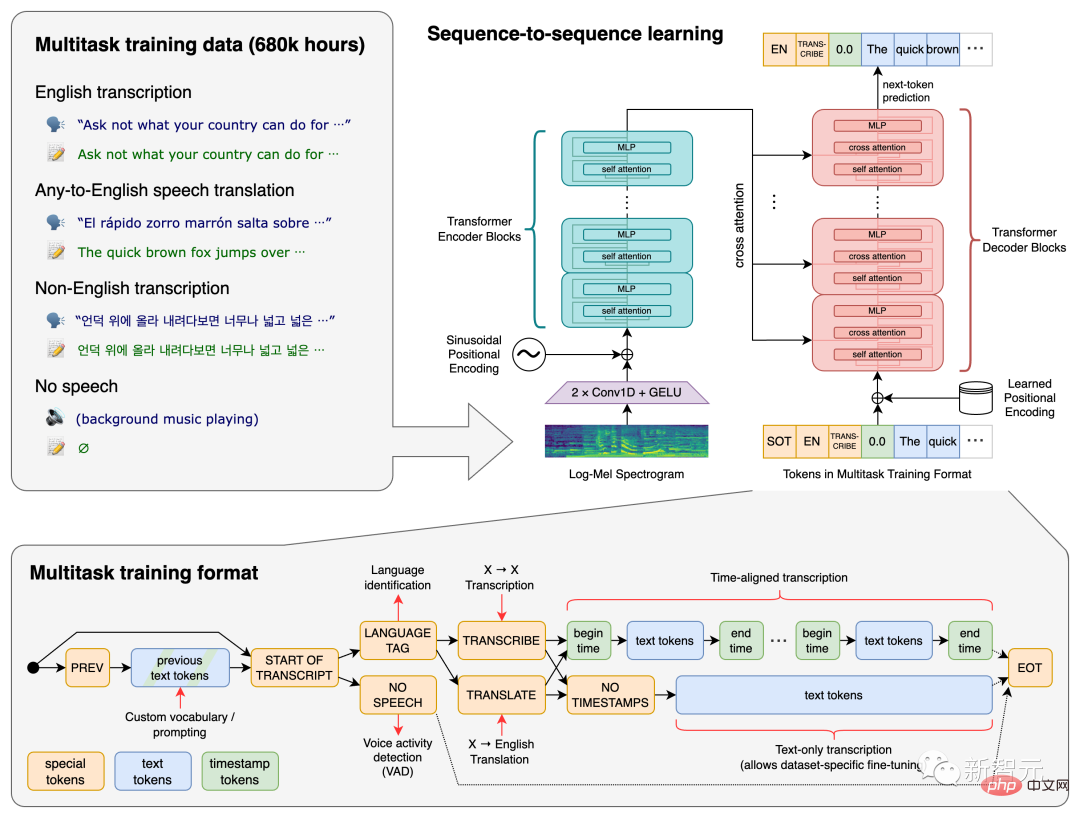

Whisper: Large-Scale Weakly Supervised Speech Recognition Model

Haben Sie jemals darüber nachgedacht, eine Übersetzungssoftware zu haben, die schnell übersetzen kann? Rede im Video? , auch die Sprachen, die du selbst nicht verstehst?

OpenAIs Open-Source-Whisper kann genau das.

Whisper wurde anhand von mehr als 680.000 Stunden mehrsprachiger Daten trainiert. Es kann mehrsprachige Geräusche in verrauschten Hintergründen erkennen und in Text umwandeln.

Papierlink: https://arxiv.org/abs/2212.04356

Projektadresse: https://github.com/openai/whisper

Video-Erklärung: https://youtu.be/uFOkMme19Zs

Kurzanalyse: https://www.louisbouchard.ai/whisper/

DreamFusion: 2D-Bilder zum Generieren verwenden 3D-Modell

Text kann Bilder, Videos und 3D-Modelle generieren ~

DreamFusion von Google kann 3D-Modelle mit einem Klick generieren, indem es ein vorab trainiertes 2D-Text-zu-Bild-Diffusionsmodell für Milliarden von Bild-Text-Paaren verwendet Trainierte Diffusionsmodelle treiben jüngste Durchbrüche in der Text-zu-3D-Modellsynthese voran.

Papierlink: https://arxiv.org/abs/2209.14988

Video-Erklärung: https://youtu.be/epuU0VRIcjE.

kurz Story-Analyse: https://www.louisbouchard.ai/dreamfusion/

Imagic: Eine echte Bildbearbeitungsmethode basierend auf dem Diffusionsmodell

Bei Verwendung von Textbildgenerierungsmodellen wie DALL·E müssen Sie nur eingeben Eine Textzeile, um das gewünschte Bild zu erhalten. Doch die von der KI erzeugten Bilder sind manchmal nicht so perfekt.

Forscher von Google, dem Israel Institute of Technology und dem Weizmann Institute of Science haben eine echte Bildbearbeitungsmethode basierend auf dem Diffusionsmodell Imagic eingeführt, mit der PS von echten Fotos nur mit Text realisiert werden können.

Zum Beispiel können wir die Pose und Zusammensetzung einer Person ändern und dabei ihre ursprünglichen Merkmale beibehalten, oder ich möchte, dass sich ein stehender Hund hinsetzt und ein Vogel seine Flügel ausbreitet.

Papierlink: https://arxiv.org/abs/2210.09276

Projektadresse: https://imagic-editing.github.io/

Video Erklärung: https://youtu.be/gbpPQ5kVJhM

Kurzanalyse: https://www.louisbouchard.ai/imagic/

eDiffi: Text-Bild-Synthesemodell mit höherer Qualität

als DALL· Die stärkeren Bildsynthesemodelle von E und Stable Diffusion sind da!

Dies ist NVIDIAs eDiffi, das Bilder in höherer Qualität genauer erzeugen kann. Darüber hinaus kann das Hinzufügen von Pinselvorlagen Ihren Arbeiten mehr Kreativität und Flexibilität verleihen.

Papierlink: https://arxiv.org/abs/2211.01324

Projektadresse: https://deepimagination.cc/eDiff-I/

Video-Erklärung: https://youtu.be/grwp-ht_ixo

Kurzanalyse: https://www.louisbouchard.ai/ediffi/

Unendliche Natur: Lernen aus einem einzigen Bild Unendlich Generierung natürlicher Szenen anzeigen

Haben Sie jemals darüber nachgedacht, ein Foto zu machen und dann in das Bild zu fliegen, als würde man eine Tür öffnen?

Wissenschaftler von Google und der Cornell University haben diese Vorstellung in die Realität umgesetzt. Das ist InfiniteNature-Zero, das aus einem einzigen Bild unbegrenzte Ansichten natürlicher Szenen generieren kann.

Papierlink: https://arxiv.org/abs/2207.11148

Projektadresse: https://infinite-nature.github.io/

Video-Erklärung: https://youtu.be/FQzGhukV-l0

Kurzanalyse: https://www.louisbouchard.ai/infinitenature-zero

Galactica: die große Sprache für das Wissenschaftsmodell

Galactica wurde von Meta entwickelt und ist ein großes Sprachmodell, dessen Größe mit GPT-3 vergleichbar ist, dessen Fachgebiet jedoch wissenschaftliche Erkenntnisse sind.

Das Modell kann Regierungs-Whitepapers, Nachrichtenrezensionen, Wikipedia-Seiten und Code schreiben, es kann auch zitieren und Gleichungen schreiben. Das ist eine große Sache für künstliche Intelligenz und Wissenschaft.

Papierlink: https://arxiv.org/abs/2211.09085

Video-Erklärung: https://youtu.be/2GfxkCWWzLU

kurz Story-Analyse: https://www.louisbouchard.ai/galactica/

RAD-NeRF: Echtzeit-Porträtsynthesemodell basierend auf räumlicher Audiozerlegung

Seit dem Aufkommen von DeepFake und NeRF scheint die KI das Gesicht zu verändern Aber es gibt ein Problem: Die durch KI ersetzten Gesichter offenbaren manchmal ihre Geheimnisse, weil sie nicht zur Form des Mundes passen.

Die Einführung von RAD-NeRF kann dieses Problem lösen. Es kann eine Porträtsynthese der im Video erscheinenden Sprecher in Echtzeit durchführen und unterstützt auch benutzerdefinierte Avatare.

Papierlink: https://arxiv.org/abs/2211.12368

Projektadresse: https://me.kiui.moe/radnerf/

Video Erklärung: https://youtu.be/JUqnLN6Q4B0

Kurzanalyse: https://www.louisbouchard.ai/rad-nerf/

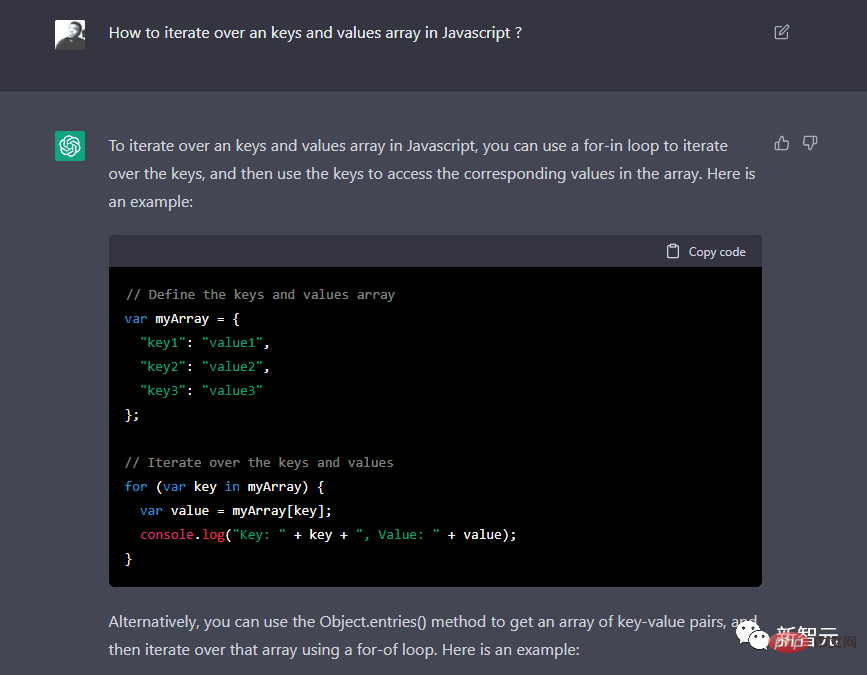

ChatGPT: Für den Dialog optimiertes Sprachmodell

2022 Wie Könnte das KI-Blockbuster-Werk des Jahres ohne ChatGPT auskommen? Dies ist im gesamten Internet populär geworden und wurde von Internetnutzern entwickelt, um pornografische Artikel, Code und andere Anwendungen zu schreiben. Wenn Sie es noch nicht wissen, kommen Sie schnell hierher. Schauen Sie mal vorbei!

Video-Erklärung: https://youtu.be/AsFgn8vU-tQ

Kurzanalyse: https://www.louisbouchard.ai/chatgpt/

kann verwendet werden Direkte Video-Gesichtsalterung für Produktionszwecke

Obwohl aktuelle Computer-Vision-Modelle Gesichtsalter, Stilübertragung usw. erzeugen können, sieht dies nur cool aus und hat in tatsächlichen Anwendungen fast keine Auswirkung. Die vorhandene Technologie leidet normalerweise unter dem Verlust von Gesichtsmerkmalen und der Diskriminierung. Das Problem ist eine niedrige Rate und instabile Ergebnisse in nachfolgenden Videobildern ist oft eine manuelle Nachbearbeitung erforderlich.

Vor Kurzem hat Disney mit FRAN (Face Re-Aging Network) die erste praktische, vollautomatische Methode zur Neualterung von Gesichtern in Videobildern für Produktionszwecke veröffentlicht und damit offiziell den Bedarf an Maskenbildnern in Filmen bekannt gegeben. Die Technologie, die das Alter verändert der Schauspieler ist visuell am Ende.

Papierlink: https://dl.acm.org/doi/pdf/10.1145/3550454.3555520

Projektadresse: https://studios.disneyresearch.com/2022/11 /30/produktionsfertiges-gesicht-re-alterung-for-visuelle-effekte/

Video-Erklärung: https://youtu.be/WC03N0NFfwk

Kurzanalyse: https ://www.louisbouchard.ai/disney-re-age/

Das obige ist der detaillierte Inhalt vonWirklich wichtige Forschung! 32 Artikel nehmen die KI-Hotspots im Jahr 2022 unter die Lupe. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr