Heim >Technologie-Peripheriegeräte >KI >Das Open-Source-Modell und das Einzelkarten-Training vermitteln Ihnen das Verständnis der beliebten textgesteuerten Audiogenerierungstechnologie AudioLDM

Das Open-Source-Modell und das Einzelkarten-Training vermitteln Ihnen das Verständnis der beliebten textgesteuerten Audiogenerierungstechnologie AudioLDM

- 王林nach vorne

- 2023-04-12 19:04:121537Durchsuche

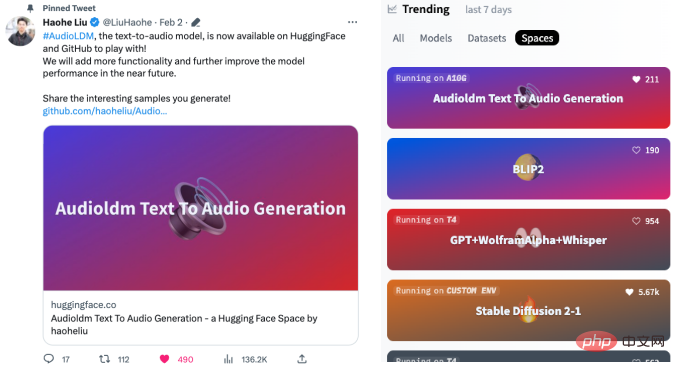

Anhand eines Textes kann künstliche Intelligenz Musik, Stimme, verschiedene Soundeffekte und sogar imaginäre Geräusche wie schwarze Löcher und Laserpistolen erzeugen. AudioLDM wurde kürzlich gemeinsam von der University of Surrey und dem Imperial College London ins Leben gerufen und erfreute sich nach seiner Veröffentlichung schnell großer Beliebtheit. Innerhalb einer Woche erhielt es fast 300 Retweets und 1.500 Likes auf Twitter. Am zweiten Tag, nachdem das Modell als Open-Source-Version veröffentlicht wurde, stürmte AudioLDM an die Spitze der Hot Search-Liste von Hugging Face, landete innerhalb einer Woche in der Liste der 40 beliebtesten Anwendungen von Hugging Face (insgesamt etwa 25.000) und tauchte schnell in vielen auf Abgeleitete Arbeit basierend auf AudioLDM.

Das AudioLDM-Modell weist folgende Highlights auf:

- Das erste Open-Source-Modell, das gleichzeitig Musik, Sprache und Soundeffekte aus Text generieren kann.

- Von der Wissenschaft entwickelt, verbraucht es weniger Daten, eine einzige GPU und kleinere Modelle, um derzeit die besten Ergebnisse zu erzielen.

- Schlägt vor, das generative Modell selbstüberwacht zu trainieren, sodass die textgesteuerte Audiogenerierung nicht mehr durch das Problem fehlender (Text-Audio-)Datenpaare eingeschränkt wird.

- Das Modell kann ohne zusätzliches Training (Zero-Shot) eine Audiostilübertragung, eine fehlende Audiofüllung und eine Audio-Superauflösung erreichen.

- Projekthomepage: https://audioldm.github.io/

- Papier: https://arxiv.org/abs/2301.12503

- Open-Source-Code und -Modell: https://github.com/haoheliu/AudioLDM

- Hugging Face Space: https://huggingface.co/spaces/haoheliu/audioldm-text-to-audio-generation

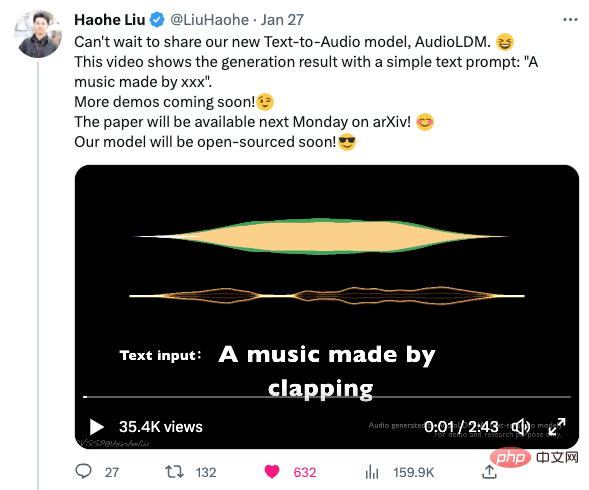

Der Autor veröffentlichte am 27. Januar erstmals eine Vorschau des Modells, die einen sehr einfachen Text zeigte: „Eine Musik von []“ (ein von [] generiertes Musikstück), um verschiedene Soundeffekte zu erzeugen. Das Video, das Musik zeigt, die mit verschiedenen Instrumenten und sogar einer Mücke gemacht wurde, fand auf Twitter schnell Anklang, wurde über 35,4.000 Mal abgespielt und über 130 Mal retweetet.

Dann veröffentlichte der Autor den Artikel und ein neues Video. In diesem Video demonstriert der Autor die meisten Funktionen des Modells sowie die Auswirkungen der Arbeit mit ChatGPT auf die Generierung von Sounds. AudioLDM kann sogar Geräusche aus dem Weltraum erzeugen.

Dann veröffentlichte der Autor ein Papier, ein vorab trainiertes Modell und eine spielbare Benutzeroberfläche, was die Begeisterung der Twitter-Internetnutzer entfachte und am nächsten Tag schnell ganz oben auf der Hot Search-Liste „Hugging Face“ stand:

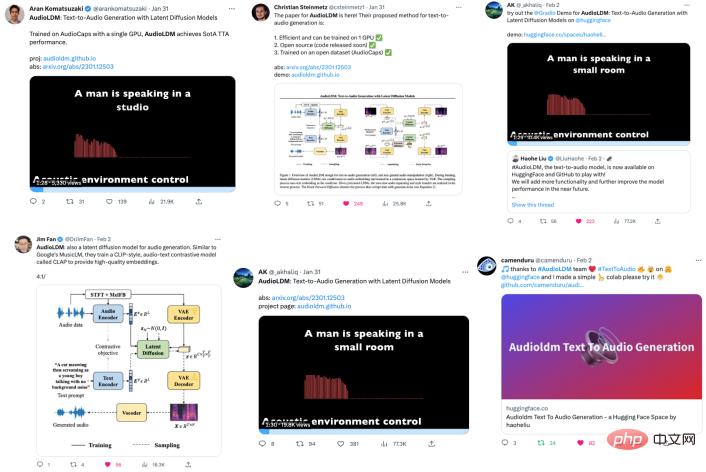

Diese Arbeit hat auf Twitter große Beachtung gefunden, und Wissenschaftler der Branche haben Folgendes weitergeleitet und kommentiert:

Internetnutzer haben AudioLDM verwendet, um eine Vielzahl von Sounds zu erzeugen.

Zum Beispiel gibt es erzeugte Geräusche des zweidimensionalen schnarchenden Katzenmädchens:

und Geistergeräusche:

Einige Internetnutzer synthetisierten: „Der Klang einer Mumie, niedrige Frequenz, mit einigen schmerzhaften Stöhnen.“

Einige Internetnutzer synthetisierten sogar: „Melodie-Furz-Sound“.

Ich muss die reiche Fantasie der Internetnutzer beklagen.

Einige Internetnutzer nutzten AudioLDM direkt, um eine Reihe von Musikalben in verschiedenen Stilrichtungen zu erstellen, darunter Jazz, Funk, Elektronik und Klassik. Teilweise ist die Musik recht einfallsreich.

Zum Beispiel „Erstellen Sie eine Ambient-Musik mit dem Thema des Universums und des Mondes“:

#🎜🎜 #

und „Erstelle eine Musik mit den Klängen der Zukunft“:

#🎜🎜 #

Interessierte Leser können diese Musikalbum-Website besuchen: https://www.latent.store/albums#🎜 🎜##🎜🎜 # Einige Internetnutzer nutzten auch ihre Fantasie, um eine Anwendung zu entwickeln, die Bilder verwendet, um die Erzeugung von Soundeffekten zu steuern, indem sie das Modell der Texterzeugung aus Bildern und AudioLDM kombiniert.

Wenn Sie AudioLDM beispielsweise diesen Text geben: „Ein Hund, der mit einem Frisbee im Wasser läuft“ (ein Hund, der mit einem Frisbee im Maul im Wasser läuft ):

kann das folgende Geräusch eines Hundes erzeugen, der auf das Wasser schlägt.

kann das folgende Geräusch eines Hundes erzeugen, der auf das Wasser schlägt.

Sie können sogar die Töne in alten Fotos wiederherstellen, wie zum Beispiel im Bild unten:

#🎜 🎜#

Nach Erhalt des Textes „Ein Mann und eine Frau sitzen an einer Bar“ (ein Mann und eine Frau sitzen an einer Bar) kann das Modell generieren Das folgende Geräusch ist zu hören, undeutliche Stimmen sind zu hören, außerdem ist im Hintergrund das Klirren von Weingläsern zu hören.

Einige Internetnutzer verwendeten AudioLDM, um den Klang des brennenden Hundes zu erzeugen, was sehr interessant ist.

Der Autor hat auch ein Video produziert, um die Fähigkeit des Modells zur Erzeugung von Soundeffekten zu demonstrieren und zu zeigen, wie AudioLDM Samples in der Nähe der Soundeffektbibliothek generiert.

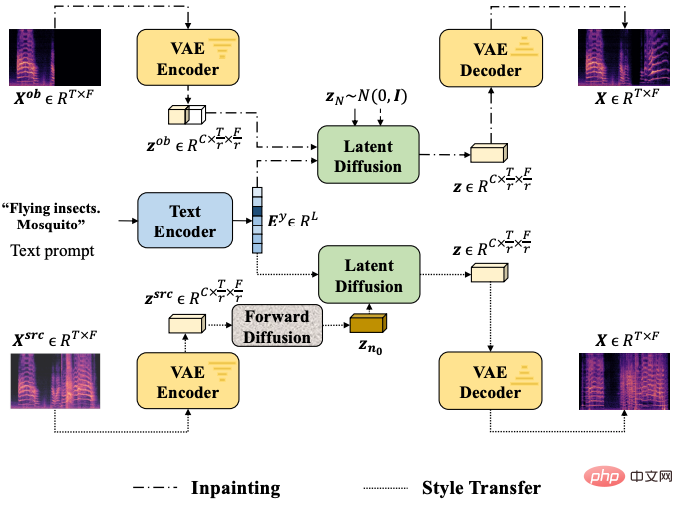

Tatsächlich ist die Text-Audio-Erzeugung nur ein Teil der Funktionen von AudioLDM. AudioLDM kann auch Klangfarbenkonvertierung, fehlende Füllung und Superauflösung erreichen.

Die beiden Bilder unten zeigen die Klangfarbentransformation von (1) Schlagzeug zu Ambient-Musik und (2) Trompete zu Kindergesang.

Das Folgende ist die Wirkung von Percussion auf Umgebungsmusik (progressive Konvertierungsintensität).

Nachfolgend zeigen wir die Auswirkung des Modells auf die Audio-Superauflösung, die fehlende Audiofüllung und die Steuerung des schallemittierenden Materials. Aufgrund der begrenzten Länge des Artikels wird der Ton hauptsächlich in Form von Spektrogrammen angezeigt. Interessierte Leser besuchen bitte die AudioLDM-Projekthomepage: https://audioldm.github.io/

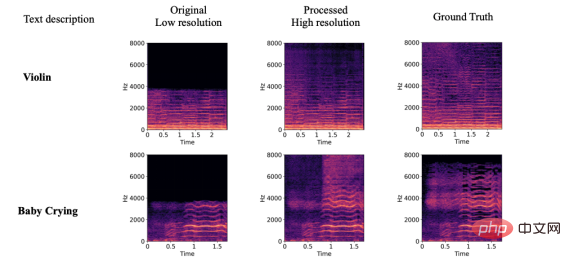

In Bezug auf die Audio-Superauflösung ist die Wirkung von AudioLDM ebenfalls sehr gut. Im Vergleich zum vorherigen Superauflösungsmodell ist AudioLDM ein universelles Superauflösungsmodell und ist nicht auf die Verarbeitung von Musik und Sprache beschränkt.

In Bezug auf das Ausfüllen fehlender Audioinhalte kann AudioLDM je nach gegebenem Text unterschiedliche Audioinhalte ergänzen, und der Übergang an der Grenze ist natürlicher.

Darüber hinaus zeigt AudioLDM auch starke Steuerungsfähigkeiten, wie z. B. die Fähigkeit, die akustische Umgebung, die Stimmung und Geschwindigkeit von Musik, Objektmaterialien, Tonhöhe und Reihenfolge usw. zu steuern. Interessierte Leser können zum AudioLDM-Papier gehen oder Projekt-Homepage zum Ansehen.

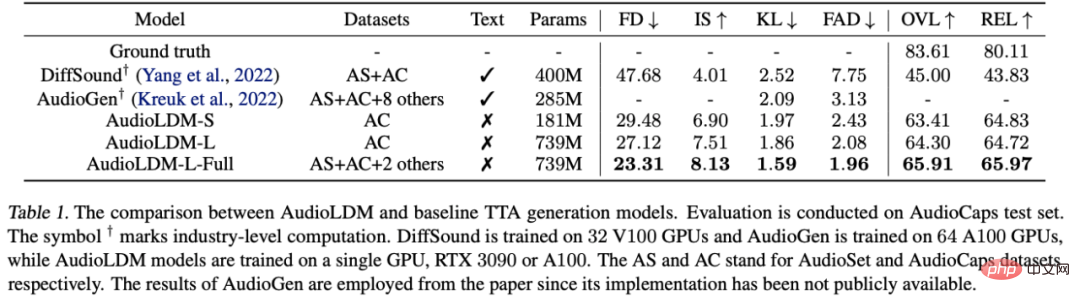

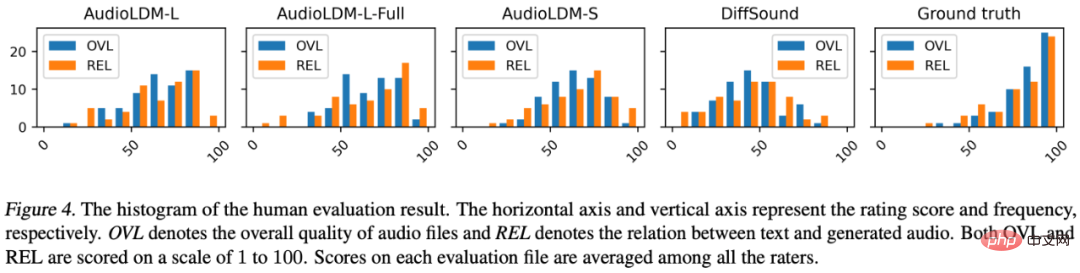

In dem Artikel führte der Autor eine subjektive Bewertung und eine objektive Indikatorbewertung des AudioLDM-Modells durch. Die Ergebnisse zeigten, dass es das vorherige optimale Modell deutlich übertreffen kann:

Unter ihnen AudioGen ist Facebooks 2022 Oktober Das vorgeschlagene Modell verwendet zehn Datensätze, 64 GPUs und 285 MB Parameter. Im Vergleich dazu kann AudioLDM-S mit einem einzigen Datensatz, 1 GPU und 181 MB Parametern bessere Ergebnisse erzielen.

Subjektive Bewertung zeigt auch, dass AudioLDM deutlich besser ist als die bisherige Lösung DiffSound. Welche Verbesserungen hat AudioLDM also vorgenommen, um dem Modell eine so hervorragende Leistung zu verleihen?

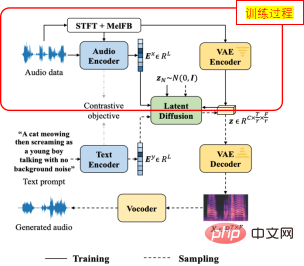

Um das Problem zu geringer Text-Audio-Datenpaare zu lösen, schlug der Autor zunächst eine selbstüberwachte Methode zum Trainieren von AudioLDM vor.

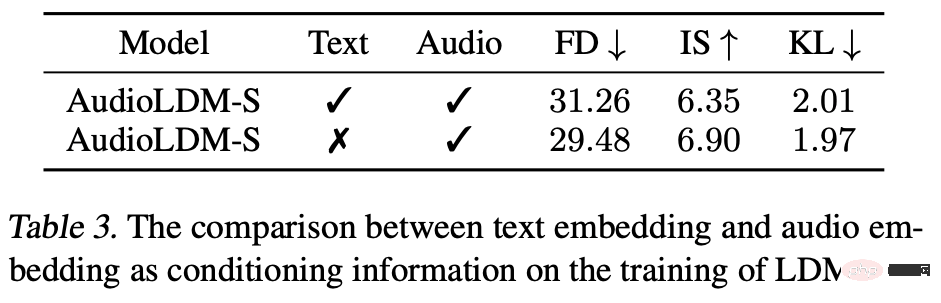

Insbesondere verwendet der Autor beim Training der Kernmodul-LDMs die Einbettung des Audios selbst als Bedingungssignal der LDMs. Der gesamte Prozess beinhaltet nicht die Verwendung von Text (wie in der Abbildung gezeigt). Abbildung oben). Dieses Schema basiert auf einem Paar vorab trainierter Audio-Text-Kontrastive-Learning-Encoder (CLAP), die im ursprünglichen CLAP-Text gute Generalisierungsfähigkeiten gezeigt haben. AudioLDM nutzt die hervorragenden Generalisierungsfähigkeiten von CLAP, um ein Modelltraining für große Audiodaten durchzuführen, ohne dass Textbezeichnungen erforderlich sind.

Tatsächlich stellte der Autor fest, dass die Verwendung von Audiotraining allein sogar noch besser ist als die Verwendung von Audio-Text-Datenpaaren:

Der Autor analysierte zwei Gründe: (1) Textanmerkungen selbst sind schwierig Alle Informationen wie akustische Umgebung, Frequenzverteilung usw. werden in den Text eingebunden, der den Ton nicht gut wiedergeben kann. (2) Die Qualität des Textes selbst ist beispielsweise nicht perfekt Anmerkung „Boote: Schlachtschiffe – 5,25 Förderraum“, diese Art von Anmerkung ist selbst für Menschen schwer vorstellbar, was der spezifische Klang ist, was zu Problemen beim Modelltraining führen wird. Im Gegensatz dazu kann die Verwendung des Audios selbst als LDM-Bedingung eine starke Korrelation zwischen dem Zielaudio und der Bedingung gewährleisten und so bessere Generierungsergebnisse erzielen.

Darüber hinaus ermöglicht die vom Autor übernommene Latent Diffusion-Lösung die Berechnung des Diffusionsmodells auf kleinerem Raum, wodurch der Rechenleistungsbedarf des Modells erheblich reduziert wird.

Viele detaillierte Untersuchungen zum Modelltraining und zur Modellstruktur verhelfen AudioLDM ebenfalls zu einer hervorragenden Leistung.

Der Autor hat auch ein einfaches Strukturdiagramm gezeichnet, um die beiden wichtigsten nachgelagerten Aufgaben vorzustellen:

Der Autor führte außerdem detaillierte Experimente mit verschiedenen Modellstrukturen, Modellgrößen, DDIM-Stichprobenschritten und verschiedenen klassifikatorfreien Leitskalen durch.

Während die Autoren das Modell veröffentlichten, legten sie auch die Codebasis ihres generativen Modellbewertungssystems offen, um die Bewertungsmethoden der akademischen Gemeinschaft zu solchen Themen in Zukunft zu vereinheitlichen . Um den Vergleich zwischen den Artikeln zu erleichtern, finden Sie den Code unter folgendem Link: https://github.com/haoheliu/audioldm_eval

Während diese Technologie boomt, gibt es einige Internetnutzer stellte auch die Sicherheit der Technologie in Frage:

#🎜🎜 ##🎜 🎜#

Autoreninformationen

Der Artikel hat zwei Co-Autoren: Liu Haohe (University of Surrey, UK) und Chen Zehua (Imperial College London). , Großbritannien).

# 🎜🎜 #

Das obige ist der detaillierte Inhalt vonDas Open-Source-Modell und das Einzelkarten-Training vermitteln Ihnen das Verständnis der beliebten textgesteuerten Audiogenerierungstechnologie AudioLDM. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr