Heim >Technologie-Peripheriegeräte >KI >Können Sie gefälschte Fotos erkennen, die von KI erstellt wurden?

Können Sie gefälschte Fotos erkennen, die von KI erstellt wurden?

- PHPznach vorne

- 2023-04-11 20:49:041916Durchsuche

Die Ära des Sehens ist Glauben ist vorbei und die KI hat gelernt, Realität zu erschaffen.

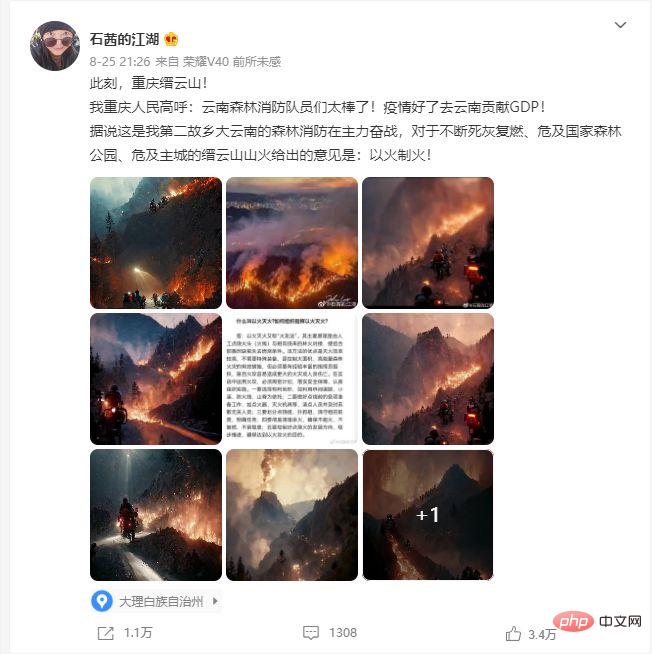

Am 21. August gab es einen Bergbrand im Berg Jinyun, Beibei, Chongqing. Das Feuer breitete sich einst auf die Dörfer und Städte am Fuße des Berges aus. Die Bergstraße ist steil und sandig, aber das Motorrad ist flink genug. Die Motorradfahrer, die Stück für Stück Vorräte den Berg hinaufschleppten, wurden zu den Protagonisten dieser Waldbrandrettung und rückten auch in den sozialen Medien in den Mittelpunkt der Aufmerksamkeit der Menschen.

Gleichzeitig wiesen Internetnutzer darauf hin, dass „8 von 10 Bildern der Waldbrände in Chongqing in den sozialen Medien von KI gemalt wurden, aber die Kommentare unten waren so bewegt, dass sie weinten.“

Tatsächlich ist es vielleicht gar nicht so einfach zu beurteilen, ob ein solches Bild wahr oder falsch ist. Unten können Sie es ausprobieren. KI kann auch mehr zeichnen. Bauen Sie einen Stuhl aus Avocado, öffnen Sie den Markt in den Himmel, setzen Sie eine Katze in eine mittelalterliche Szene, um WLAN zu finden ... das sind alles kleine Dinge. Jason Allen, der Präsident eines amerikanischen Brettspielunternehmens, nutzte das KI-Maltool Midjourney, um ein Stück „Space Opera“ zu erstellen, das er selbst verfeinerte. Es gewann auch den ersten Preis im Kunstwettbewerb des Colorado State Gerecht. Das Technologiemedium TechCrunch bewertete den unzensierten „AI Painter“ als „Deepfakes für alle (allmächtige Deep Fakes)“.

Wozu dient die KI-Gesichtsveränderung?

Die früher bekannte KI-„Fake“-Technologie ist Deep-Fake-Technologie, allgemein bekannt als KI-Gesichtsveränderung. Im Jahr 2019 hieß es in einem Bericht, dass es zu diesem Zeitpunkt bereits Zehntausende mit Deepfake-Technologie produzierte Videos im Internet gab.

Der Bericht schreibt auch, dass 96 % dieser Videos pornografische Videos sind und die Protagonisten dieser pornografischen Videos alle Frauen sind. Die beliebtesten sind europäische und amerikanische Schauspielerinnen sowie koreanische Frauen wurde millionenfach angeschaut.

Der Forscher Henry Ajder, der an dem Bericht beteiligt war, sagte, dass Benutzer von Deepfake-Foren Face-Swap-Pornos mit Videos von Frauen, die sie kennen (z. B. Ex-Freundinnen), anfordern oder darüber diskutieren. Sie wollen, dass sie in pornografischen Clips aufgenommen werden.

Bei der KI-Malerei geht es nicht nur darum, Gesichter zu verändern.

Öffne die Büchse der Pandora

Wir haben 5 dunkle Anweisungen eingegeben, um zu sehen, ob KI-Malen unbegrenzt ist?

KI scheint ein begrenztes Verständnis von Gewalt zu haben. Aber die Interpretation von Sex ist zutreffend – und das findet sie auch.

Stable Diffusion, dieser Open-Source-, leistungsstarke „KI-Maler“ hat für sich einen „Sicherheitschecker“ eingerichtet, der einer automatischen Überprüfung gleichkommt: Sobald festgestellt wird, dass das generierte Bild im Verdacht steht, gegen Vorschriften zu verstoßen Das heißt, in der Inhaltsrichtlinie heißt es, dass es nicht zur Erzeugung „unangenehmer, pornografischer, hasserfüllter, gewalttätiger und anderer Bilder“ verwendet werden darf und die Maschine das Bild blockiert.

Wir haben die von uns generierten „bösen Fotos“ zur Überprüfung gesendet und die Maschine hat nur sechs Nacktfotos von Justin Bieber als „Verstöße“ bewertet. Wir haben jedoch auch erfolgreich mehrere Fotos erstellt, auf denen Trump Churchill durch Zeit und Raum küsst, und die Fotos wurden vom Moderator als „sicher“ eingestuft.

Aus der Tatsache, dass wir gegen seinen Willen erfolgreich Nacktfotos von Justin Bieber erstellt haben, geht offensichtlich hervor, dass die automatische Überprüfung von Stable Diffusion ausgeschaltet werden kann. Auf diese Weise kann es Sie nicht mehr ablehnen.

Um die KI und die schlechten Gedanken, die Menschen vor der Büchse der Pandora haben, einzuschränken, unterliegt der berühmteste „KI-Maler“ DALL·E 2 einer strengeren Zensur.

Einige Internetnutzer sammelten alle Anweisungen, die dazu führten, dass er Warnungen wegen Verstößen gegen die Inhaltsrichtlinien erhielt, darunter „Britische Affen essen Fish and Chips“, „Tintenfisch fährt Einrad und Fahrerflucht“, „Jesus wird einer Nukleinsäure unterzogen“. Testen" Foto". Zu den verbotenen Wörtern in DALL·E 2 gehören alle Beschreibungen, die Hass, Gewalt, Pornografie und die Namen aller bekannten Persönlichkeiten beinhalten könnten. Sie können DALL·E 2 also nicht manipulieren, um ein Bild von Trump und Biden zu zeichnen, die sich küssen, aber Stable Diffusion kann es.

Die von KI erzeugten gefälschten Fotos weisen Lücken auf

Die aktuellen von KI erzeugten Fotos sind jedoch nicht perfekt.

Zheng Shujing, ein Reporter von Mingcha Studio, einem Faktenprüfungsprojekt von The Paper, sagte, dass KI-generierte Bilder einige Merkmale aufweisen werden, wie zum Beispiel Blasen, surreale Hintergründe, Zahngrößen der Charaktere und unnatürliche Haare Formen usw. Frühe KI-Gesichtsveränderungen waren anfällig für Probleme bei der Darstellung kontinuierlicher und wiederholter Muster, oft mit ungleichmäßiger Größe. Heutzutage haben sich einige Unternehmen durch kontinuierlich verbesserte generative gegnerische Netzwerke verbessert, und diese Probleme sind relativ seltener geworden, aber manchmal sind sie immer noch an Details wie Hintergrundverformung und Körperasymmetrie zu erkennen.

Details sind es, wo die KI oft zu kurz kommt. Beispielsweise hat der Hubschrauber im Bild unten kein Heck.

Darüber hinaus helfen Hintergrundinformationen auch dabei, zu unterscheiden, ob das Foto wahr oder falsch ist. „Zum Beispiel, wenn Sie mir ein Bild geben, das besagt, dass es wahr ist vom Waldbrand in Chongqing, wenn Sie feststellen, dass das letzte Änderungsdatum dieses Bildes nach dem Vorfall lag, es sich also definitiv um ein gefälschtes Bild handelt. Wir kontaktieren uns manchmal für Hintergrundinformationen, wie z. B. die Überprüfung des Modells des Hubschraubers auf dem Bild usw. „

Aber sie hat mich kontaktiert. Die meisten verfügbaren Tools können Ihnen nicht direkt sagen, ob ein Foto echt oder gefälscht ist. Es muss von Menschen anhand der spezifischen Situation beurteilt werden.

Da die KI-Malfähigkeiten immer besser werden, wird es immer schwieriger, zwischen wahr und falsch zu unterscheiden. Die Gewissheit der Realität lockert sich. Zu diesem Zeitpunkt hören die Menschen möglicherweise oft Stimmen wie diese: „Dieses Foto sieht zu echt aus, also ist es zu gefälscht.“

Das obige ist der detaillierte Inhalt vonKönnen Sie gefälschte Fotos erkennen, die von KI erstellt wurden?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr