Heim >Technologie-Peripheriegeräte >KI >Die neuen Regeln der Natur: Sie können ChatGPT zum Schreiben von Artikeln verwenden, aber Sie können sie nicht als Autoren auflisten

Die neuen Regeln der Natur: Sie können ChatGPT zum Schreiben von Artikeln verwenden, aber Sie können sie nicht als Autoren auflisten

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-11 13:13:031126Durchsuche

Dieser Artikel wird mit Genehmigung von AI New Media Qubit (öffentliche Konto-ID: QbitAI) nachgedruckt. Bitte wenden Sie sich für einen Nachdruck an die Quelle.

Angesichts von ChatGPT konnte die Natur endlich nicht still sitzen.

Diese Woche gab diese renommierte wissenschaftliche Verlagsorganisation eine qualitative Antwort auf eine Reihe von Problemen wie ChatGPT-Ghostwriting wissenschaftlicher Artikel und die Auflistung als Autor.

Insbesondere listet Nature zwei Prinzipien auf:

(1) Jedes große Sprachmodelltool (wie ChatGPT) kann nicht der Autor des Papiers werden#🎜 🎜 #; (2) Wenn bei der Erstellung des Papiers relevante Tools verwendet wurden, sollte der Autor

in den „Methoden“ oder „Danksagungen“ oder im entsprechenden Abschnitt klar angeben.

In letzter Zeit ist ChatGPT immer stärker in akademische und Forschungskreise involviert.

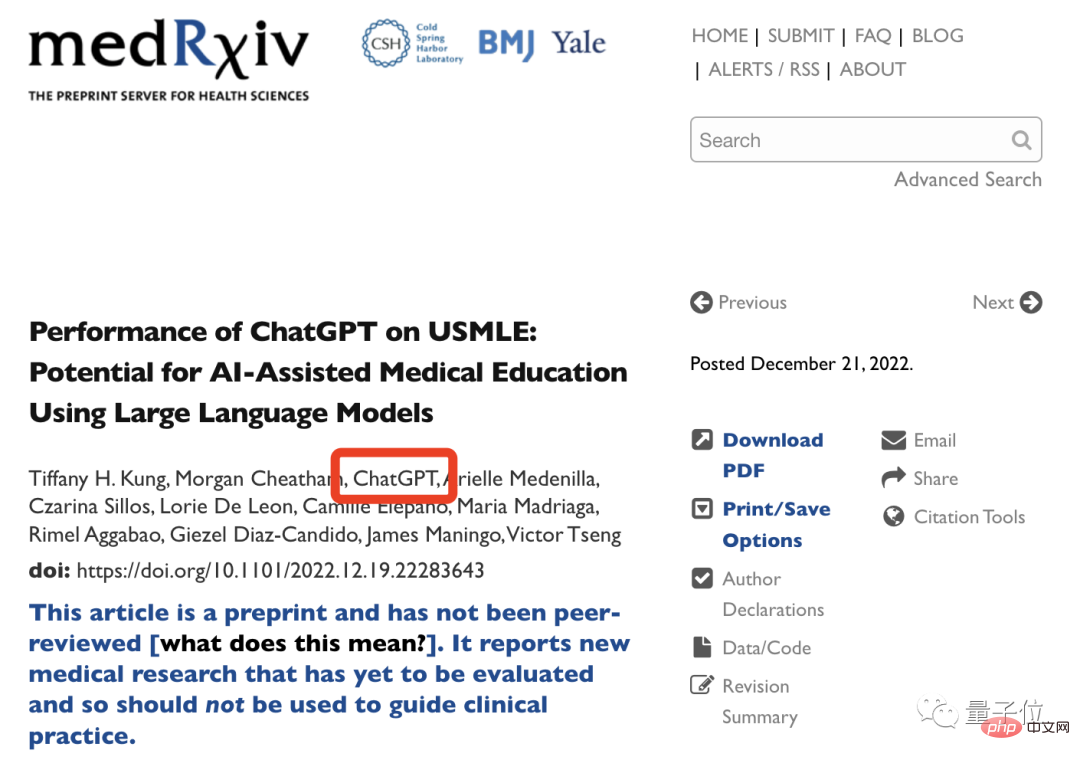

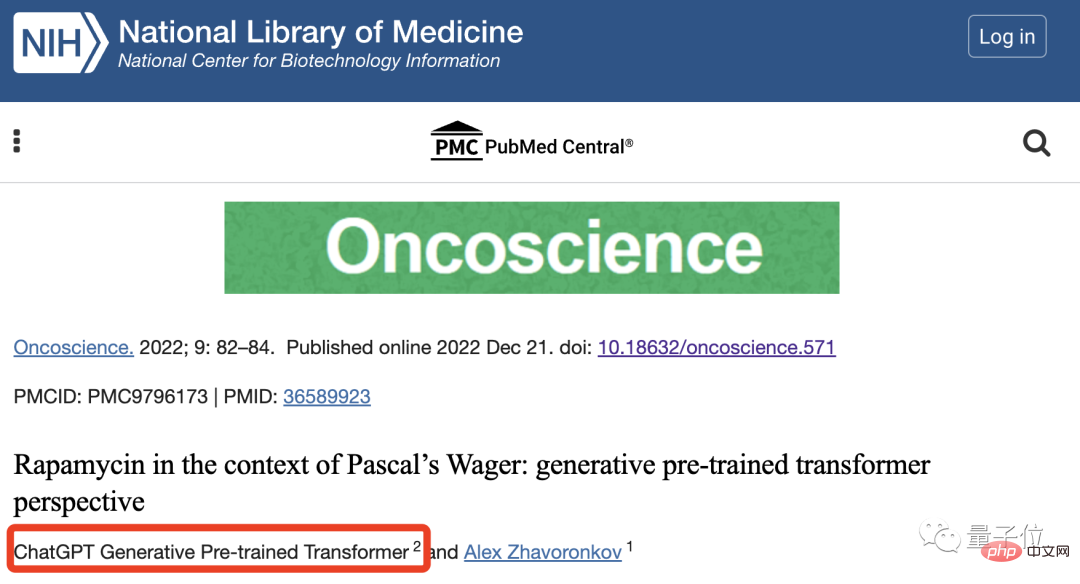

In einem Artikel über die Anti-Aging-Anwendung von Rapamycin im Dezember letzten Jahres wurde ChatGPT als Werk aufgeführt, was in der Branche zu Kontroversen führte. Zusätzlich zu diesem Artikel gibt es viele Studien, in denen ChatGPT als Autor aufgeführt ist. Nature hat diese Situation ebenfalls bemerkt. Sie führten im Dezember eine Umfrage durch und zeigten, dass 20 % der 293 befragten Professoren entdeckt oder beobachtet hatten, dass Studenten ChatGPT zum Erledigen von Hausaufgaben oder Hausarbeiten nutzten, mehr Menschen äußerten Bedenken darüber .Dieses Mal möchte die von Nature herausgegebene Erklärung verschiedene Kontroversen charakterisieren.

Und auch wenn AI nicht als Autor aufgeführt ist, findet der Einsatz von ChatGPT in akademischen Kreisen immer häufiger statt.

Wie bereits erwähnt, gab Alex Zhavoronkov, CEO von Insilico Medicine, einem Forschungs- und Entwicklungsunternehmen für KI-Arzneimittel, bekannt, dass seine Institution mehr als 80 mit KI-Tools erstellte Artikel veröffentlicht hat. Der britische Professor Mike Sharples hat sich mit den Auswirkungen generativer KI auf die akademische Forschung beschäftigt. Vor nicht allzu langer Zeit demonstrierte er persönlich auf Twitter, wie man mithilfe eines großen Sprachmodells in 10 Minuten eine wissenschaftliche Arbeit erstellt. Er beschrieb Schritt für Schritt, wie er mithilfe von KI eine Zusammenfassung basierend auf dem Titel erstellte, was ebenfalls viele Diskussionen auslöste .

Erst letzte Woche verließ sich ein Student der Northern Michigan University auf ChatGPT, um einen Aufsatz mit der höchsten Punktzahl in der Klasse zu schreiben.

Interessanterweise wurde der Student erwischt, weil der von ihm eingereichte Artikel so logisch schlüssig und gut strukturiert war, dass der Dozent die Wahrheit erst nach einer Befragung erfuhr. #🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜#△#🎜🎜 ## 🎜🎜 ## 🎜🎜##Northern Michigan University#🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜 🎜#Es sollte klar sein, dass die oben erwähnte Paketerfassung nur ein Zufall ist. Häufiger ist es für Wissenschaftler aufgrund des generierten Inhalts schwierig, die Echtheit von der Fälschung zu unterscheiden.

Nature In einem früheren Artikel wurde darauf hingewiesen, dass ein Forschungsteam an der Northwestern University in Illinois nach der Veröffentlichung von ChatGPT untersuchte, ob Wissenschaftler die Zusammenfassungen medizinischer Arbeiten erkennen könnten, die mit diesem KI-Tool erstellt wurden.

Es wurde festgestellt, dass die von der KI generierten Zusammenfassungen alle den Plagiatsdetektor bestanden haben, und bei der manuellen Überprüfung wurden 32 % der von der KI generierten Zusammenfassungen als von echten Menschen ausgefüllt angesehen. Entwickelt bereits IdentifikationstoolsDas Ende der Natur zeigt, dass sie den durch ChatGPT verursachten Problemen große Bedeutung beimessen. In den neuesten Inhalten gab Nature an, dass die akademischen und Forschungskreise befürchten, dass Studenten und Forscher Inhalte, die von großen Sprachmodellen generiert wurden, als von ihnen selbst geschriebene Texte verwenden könnten oben erwähnt Der Prozess kann auch zu unzuverlässigen Forschungsergebnissen führen.

Insbesondere für ChatGPT sind das Nature-Team und viele Verlage und Plattformen der Ansicht, dass dieses Tool nicht für die Integrität und den Inhalt wissenschaftlicher Arbeiten verantwortlich sein kann.

Ein Nebenbeweis ist, dass das Technologiemedium CNET in den letzten zwei Tagen enthüllte, dass 41 der 77 von der KI der Plattform geschriebenen Inhalte Fehler enthielten, und erklärte dies Dadurch wird diese Methode angehalten.

Gerade aufgrund der Besorgnis über die oben genannte Situation hat die Natur entsprechende Vorschriften eingeführt.

Wie unterscheidet man KI-generierte Inhalte?Nature sagte, dass derzeit die Rohausgabe von ChatGPT durch sorgfältige Prüfung entdeckt werden kann, insbesondere wenn es um spezifische wissenschaftliche Arbeiten geht, kann der Inhalt einfachste Fehler und allgemein langweilige Formulierungen enthalten. Darüber hinaus gab Nature an, dass noch entsprechende Erkennungstechnologien entwickelt werden.

Es ist erwähnenswert, dass auch entsprechende Identifizierungstools entwickelt wurden.

Zum Beispiel kann der OpenAI-eigene GPT-2-Ausgabedetektor KI-generierten Text durch die Eingabe von mehr als 50 Zeichen (Tokens) genauer identifizieren.

Ein weiteres Beispiel ist Edward Tian, Student an der Princeton University, der auch ein verwandtes Tool GPTZero erstellt hat.

Allerdings haben nicht alle Universitätsprofessoren und -lehrer eine negative Einstellung gegenüber KI-Generierungstools. Zum Beispiel ging Ethan Mollick, Professor an der Wharton School der University of Pennsylvania, den umgekehrten Weg und verlangte von den Schülern, ChatGPT zu verwenden, um Unterrichtsaufgaben zu erledigen, da er glaubte, dass dadurch neue Technologietools berücksichtigt würden. Ein Mitarbeiter von medRxiv, einer Papierveröffentlichungsplattform, sagte auch, dass ChatGPT kein neues Problem sei. Er glaubt, dass Forscher schon früher versucht haben, die Namen von Haustieren und fiktiven Charakteren einzuschleusen. Daher glauben sie, dass der Kern des

-Problems in der Notwendigkeit liegt, die Kontrollen weiter zu verstärken

.

Das obige ist der detaillierte Inhalt vonDie neuen Regeln der Natur: Sie können ChatGPT zum Schreiben von Artikeln verwenden, aber Sie können sie nicht als Autoren auflisten. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr