Heim >Technologie-Peripheriegeräte >KI >Das Google RT-1-Modell fordert einen Roboter auf, mehrere Aufgaben zu erledigen, mit einer Erfolgsquote von 97 % für 700 Anweisungen

Das Google RT-1-Modell fordert einen Roboter auf, mehrere Aufgaben zu erledigen, mit einer Erfolgsquote von 97 % für 700 Anweisungen

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-11 11:34:031345Durchsuche

Viele aktuelle Fortschritte in mehreren Teilbereichen der Forschung zum maschinellen Lernen (ML), wie z. B. Computer Vision und Verarbeitung natürlicher Sprache, basieren auf der Nutzung großer, vielfältiger Datensätze und Darstellungsmodelle, die alle Daten effizient absorbieren können.

Diese Hochleistungsmodellmethode hat jedoch relativ wenige Anwendungen im Bereich der Robotik.

Der Grund ist einfach: Das Fehlen umfangreicher und vielfältiger Roboterdaten schränkt die Fähigkeit des Modells ein, ein breites Spektrum an Robotererfahrungen aufzunehmen.

Zweitens mangelt es an ausdrucksstarken, skalierbaren und ausreichend schnellen Echtzeit-Inferenzmodellen, die aus solchen Datensätzen lernen und effektiv verallgemeinern können.

Und dieses Mal ist Googles Robotics Transformer 1 (kurz RT-1) ein Multitasking-Modell, das Eingabe- und Ausgabeaktionen des Roboters (wie Kamerabilder, Aufgabenanweisungen und Motorbefehle) kennzeichnen kann, um eine effiziente Ausführung zu erreichen Argumentation und ermöglichen eine Echtzeitkontrolle.

RT-1 absorbiert eine große Datenmenge, um den Roboter für eine Vielzahl von Aufgaben in verschiedenen Umgebungen kompetent zu machen, wodurch die Maschinenleistung und die Generalisierungsfähigkeiten verbessert werden.

Um es einfach auszudrücken bedeutet es Einen Roboter gleichzeitig mehrere Aufgaben erledigen lassen.

Das Modell wurde anhand eines großen realen Robotikdatensatzes aus 130.000 Episoden trainiert, der mehr als 700 Aufgaben abdeckt und über 17 Monate mit 13 Robotern von Everyday Robots (EDR) gesammelt wurde.

Die Ergebnisse zeigen, dass RT-1 die Zero-Shot-Generalisierung auf neue Aufgaben, Umgebungen und Objekte im Vergleich zu bestehenden Techniken deutlich verbessern kann.

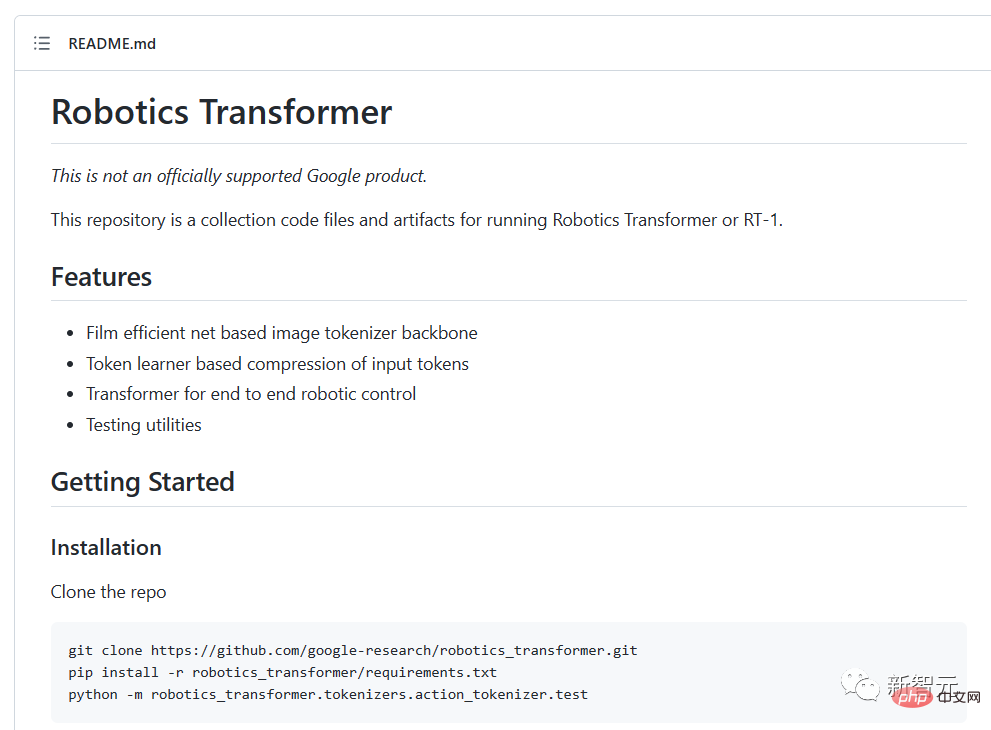

Der Herausgeber hat auch den Github-Link unten sorgfältig platziert. Wenn Sie interessiert sind, schauen Sie bitte vorbei.

https://github.com/google-research/robotics_transformer

RT-1 modellspezifisches Prinzip

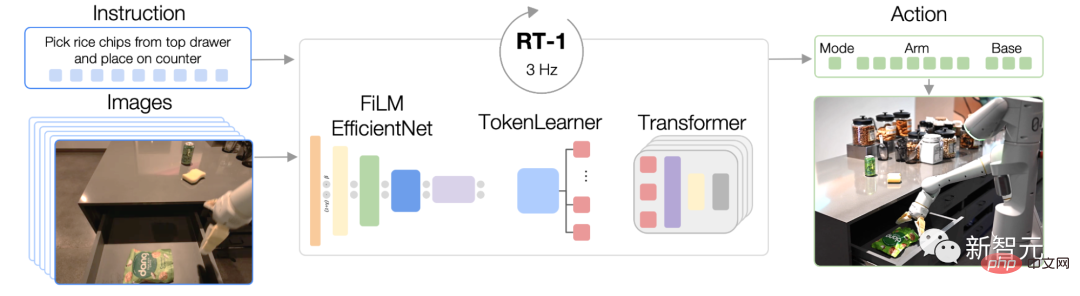

RT-1 basiert auf der Transformer-Architektur, die das transformieren kann Der Bildverlauf des Roboters wird von der Kamera abgerufen und die in natürlicher Sprache ausgedrückte Aufgabenbeschreibung wird als Eingabe verwendet, während die markierten Aktionen direkt ausgegeben werden. Die Architektur von

RT-1 ähnelt der eines Nur-Decoder-Sequenzmodells, das auf einem standardmäßigen kategorialen Kreuzentropieziel mit kausaler Maskierung trainiert wird.

Das Modell verwendet Textanweisungen und eine Reihe von Bildern als Eingabe, codiert sie über das vorab trainierte FiLM EfficientNet-Modell in Token, komprimiert sie über TokenLearner und gibt dann Aktionstoken über Transformer aus.

Zu seinen Hauptfunktionen gehören: Bild-Tokenisierung, Aktions-Tokenisierung und Token-Komprimierung.

- Bild-Tokenisierung: Wir leiten das Bild durch das auf ImageNet vorab trainierte EfficientNet-B3-Modell und reduzieren dann die resultierende räumliche 9×9×512-Feature-Map in 81 Token. Der Bild-Tokenizer basiert auf Aufgabenanweisungen in natürlicher Sprache und extrahiert frühzeitig aufgabenrelevante Bildmerkmale mithilfe einer auf Identität initialisierten FiLM-Ebene.

- Aktionstokenisierung: Die Aktionsdimensionen des Roboters sind 7 Variablen der Armbewegung (x, y, z, Rollen, Nicken, Gier, Klammeröffnung) und 3 grundlegende Bewegungsvariablen (x, y, Giernavigation). ) und eine zusätzliche diskrete Variable zum Umschalten zwischen den drei Modi.

- Token-Komprimierung: Das Modell wählt adaptiv weiche Kombinationen von Bild-Token aus, die basierend auf ihrer Auswirkung auf das Lernen mithilfe des Element-Aufmerksamkeitsmoduls TokenLearner komprimiert werden können, was zu einer über 2,4-mal schnelleren Inferenz führt.

Wir verwenden Demos, die von Menschen per Fernbedienung bereitgestellt werden, und kommentieren jede Episode mit Textbeschreibungen der Roboter, die Anweisungen ausführen.

Und dieser Roboter verlässt sich bei der Ausführung von Aufgaben auf „einen Arm mit 7 Freiheitsgraden, einen Zwei-Finger-Greifer und eine mobile Basis“.

Zu den im Datensatz dargestellten hochqualifizierten Fertigkeiten gehören Vorgänge wie das Aufnehmen und Platzieren von Gegenständen, das Öffnen und Schließen von Schubladen, das Einlegen und Herausnehmen von Gegenständen in Schubladen, das Aufrichten schlanker Gegenstände, das Umstoßen von Gegenständen usw.

Integration heterogener Datenquellen

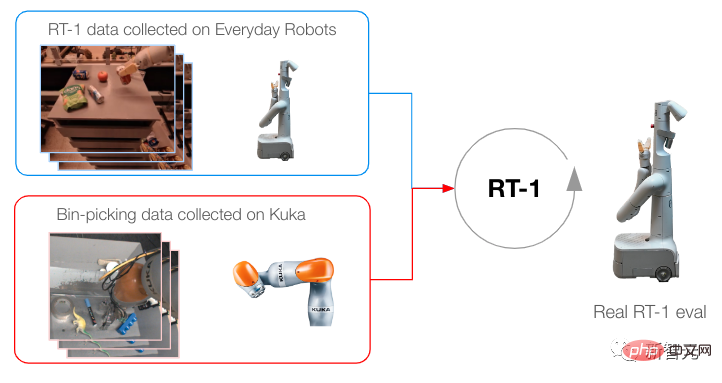

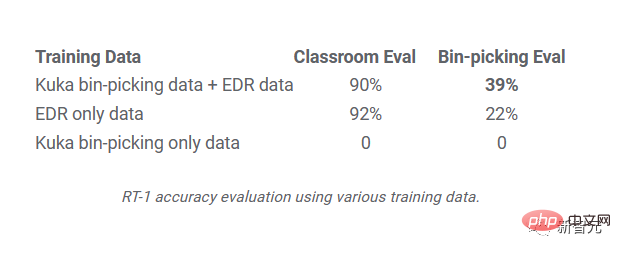

Um RT-1 weiter voranzutreiben, haben wir es mithilfe der von einem anderen Roboter gesammelten Daten trainiert, um (1) zu testen, ob das Modell seine Leistung bei der ursprünglichen Aufgabe beibehält, wenn neue Datenquellen präsentiert werden. und (2) ob sich das Modell bei der Generalisierung mit neuen und unterschiedlichen Daten verbessert.

Wir transformieren die gesammelten Daten so, dass sie den Aktionsspezifikationen und Grenzen der ursprünglichen Datensätze entsprechen, die wir mithilfe von EDR gesammelt haben, und kennzeichnen jeden Datensatz mit Aufgabenanweisungen.

Mischen Sie dann die Kuka-Daten mit den EDR-Daten in einem Verhältnis von 1:2 in jedem Trainingsstapel, um die Regression der ursprünglichen EDR-Fähigkeit zu steuern.

Das Bild zeigt die Trainingsmethode beim Sammeln von Daten von mehreren Robotern

Die Ergebnisse zeigen, dass RT-1 in der Lage ist, neue Fähigkeiten zu erwerben, indem er die Erfahrungen anderer Roboter beobachtet.

Als RT-1 mit Kukas Bin-Picking-Daten und vorhandenen EDR-Daten aus dem Robotik-Klassenzimmer trainiert wurde, stieg die Genauigkeit um fast das Zweifache auf 39 %, verglichen mit 22 %, wenn nur mit EDR-Daten trainiert wurde.

Beim Training des RT-1 allein anhand der Kommissionierungsdaten von Kuka und der Auswertung anhand der Kommissionierungsdaten des EDR-Roboters lag die Genauigkeit bei 0 %.

Experimentelle Ergebnisse

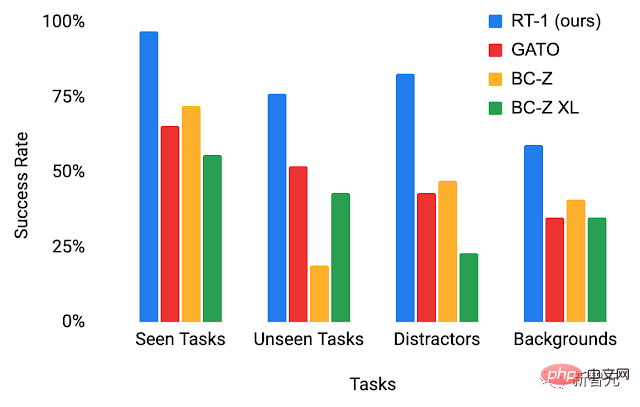

Um die Generalisierungsfähigkeit von RT-1 besser zu verstehen, haben wir seine Leistung anhand von drei Basislinien untersucht: Gato, BC-Z und BC-Z XL (d. h. mit demselben BC-Z für quantitative Parameter).

und unterteilte es in vier Kategorien:

Das Bild zeigt die Leistung von RT-1 und der Kontrollgruppe in der Testumgebung

- Gesehene Aufgabenleistung: während des Trainings beobachtete Aufgabenleistung;

-

Unsichtbare Aufgabenleistung: Leistung bei unsichtbaren Aufgaben, bei denen Fähigkeiten und Objekte im Trainingssatz getrennt sind; Störfaktoren und Leistung von Hintergrundänderungen (neue Küche, Beleuchtung, Hintergrundszenen)

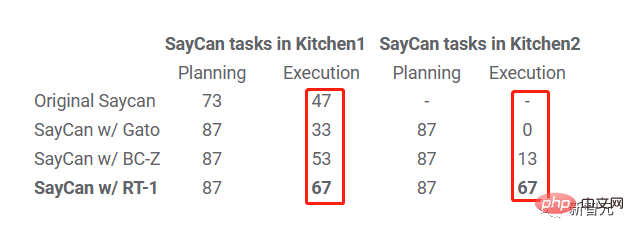

Szenarien mit langem Horizont): Ausführung von SayCan-ähnlichen Anweisungen in natürlicher Sprache in echten Küchen - Die hohen Leistungs- und Generalisierungsfähigkeiten von RT-1 kann über SayCan Fern- und mobile Einsatzaufgaben realisieren.

- SayCan funktioniert, indem es ein Sprachmodell in die Möglichkeiten des Roboters einfügt und eine Handvoll Hinweise nutzt, um die langfristige Aufgabe, natürliche Sprache auszudrücken, in eine Reihe von Fertigkeiten auf niedrigem Niveau zu zerlegen.

Wir evaluieren SayCan in zwei echten Küchen mit RT-1 und zwei weiteren Basislinien (SayCan mit Gato und SayCan mit BC-Z).

Im Folgenden stellt „Küche2“ ein anspruchsvolleres Verallgemeinerungsszenario dar als „Küche1“. Die simulierte Küche, die zum Sammeln der meisten Trainingsdaten verwendet wurde, wurde nach Kitchen1 modelliert.

Es ist ersichtlich, dass die Ausführungserfolgsrate von SayCan mit RT-1 in Kitchen1 67 % beträgt, was besser ist als bei anderen Basislinien.

Aufgrund der durch die neue unsichtbare Küche verursachten Generalisierungsschwierigkeiten verringerte sich die Leistung von SayCan mit Gato und SayCan mit BCZ, die Erfolgsquote von RT-1 verringerte sich jedoch nicht.

Aufgrund der durch die neue unsichtbare Küche verursachten Generalisierungsschwierigkeiten verringerte sich die Leistung von SayCan mit Gato und SayCan mit BCZ, die Erfolgsquote von RT-1 verringerte sich jedoch nicht.

Das obige ist der detaillierte Inhalt vonDas Google RT-1-Modell fordert einen Roboter auf, mehrere Aufgaben zu erledigen, mit einer Erfolgsquote von 97 % für 700 Anweisungen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr