Heim >Technologie-Peripheriegeräte >KI >Ein neues Paradigma für die Text- und Bildbearbeitung: Ein einziges Modell ermöglicht die durch mehrere Texte geführte Bildbearbeitung

Ein neues Paradigma für die Text- und Bildbearbeitung: Ein einziges Modell ermöglicht die durch mehrere Texte geführte Bildbearbeitung

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-10 19:41:021320Durchsuche

Kurzer Überblick über den Artikel

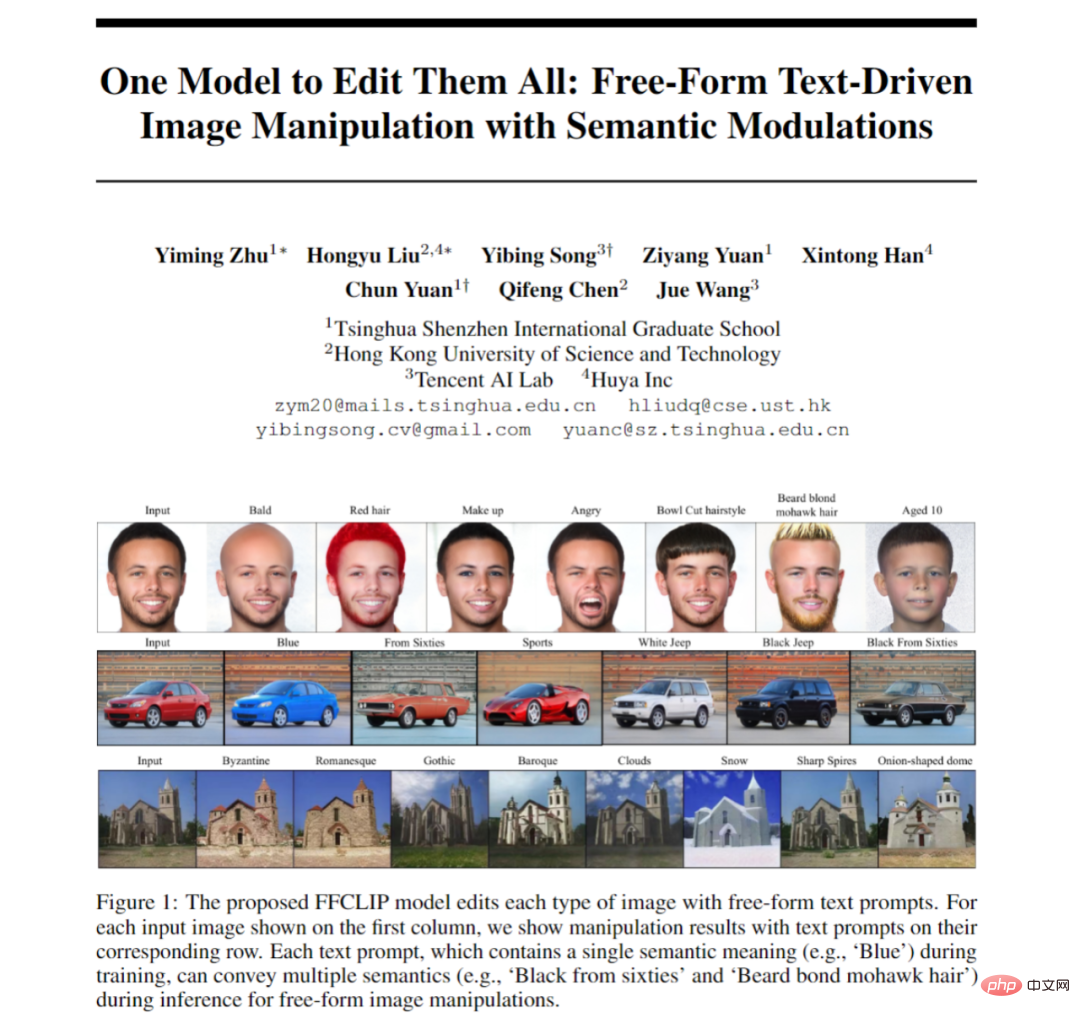

Die Forschung im Zusammenhang mit der Verwendung von Text zum Bearbeiten von Bildern ist sehr heiß begehrt. In letzter Zeit basieren viele Studien auf Entrauschungsdiffusionsmodellen, um den Effekt zu verbessern, aber nur wenige Wissenschaftler widmen der verwandten Forschung weiterhin Aufmerksamkeit auf GAN. Dieser Artikel basiert auf dem klassischen StyleGAN und CLIP und schlägt ein semantisches Modulationsmodul vor, sodass für verschiedene Texte nur ein einziges Modell für die Text-Bild-Bearbeitung erforderlich ist.

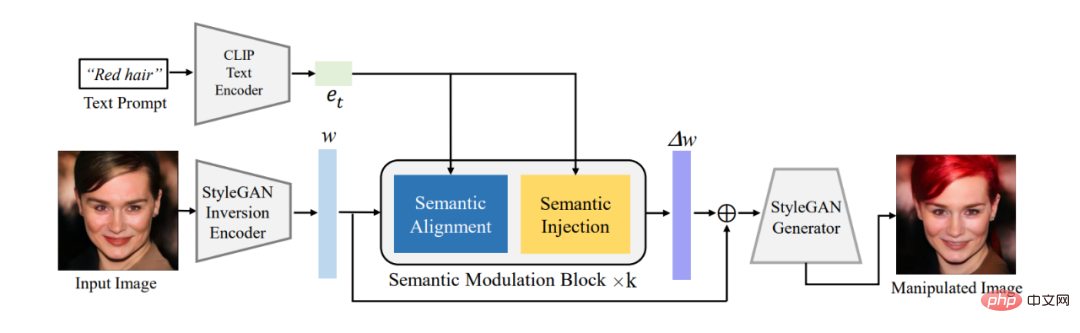

Dieser Artikel verwendet zunächst den vorhandenen Encoder, um das zu bearbeitende Bild in den latenten Code w im semantischen Raum W^+ von StyleGAN umzuwandeln, und moduliert dann den latenten Code adaptiv durch das vorgeschlagene semantische Modulationsmodul. Das semantische Modulationsmodul umfasst semantische Ausrichtungs- und semantische Injektionsmodule. Es richtet zunächst die Semantik zwischen der Textkodierung und der latenten Kodierung von GAN über den Aufmerksamkeitsmechanismus aus und fügt dann die Textinformationen in die ausgerichtete latente Kodierung ein, um sicherzustellen, dass die Cain-Kodierung vorliegt den Text und ermöglicht so die Bearbeitung von Bildern mithilfe von Text.

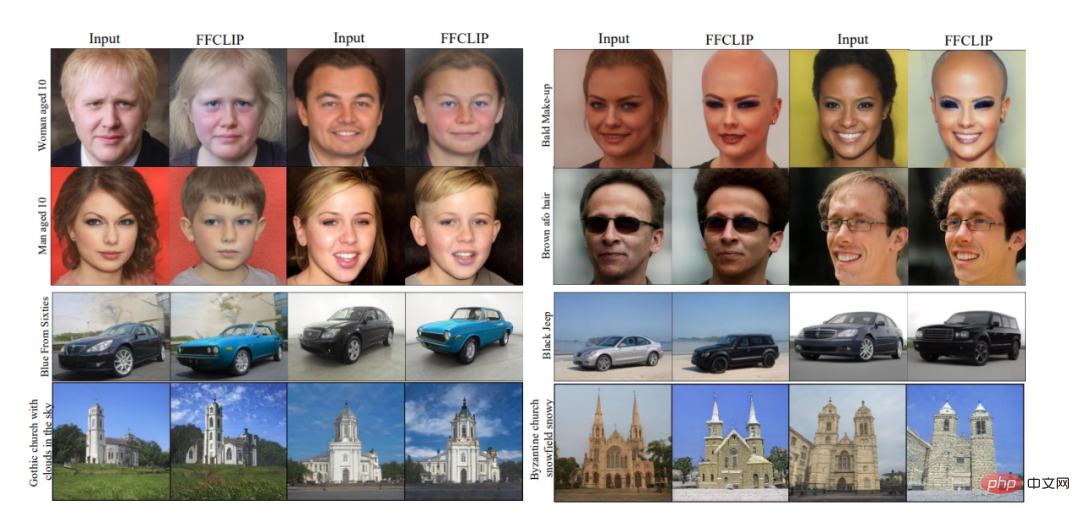

Im Gegensatz zum klassischen StyleCLIP-Modell muss unser Modell nicht für jeden Text ein separates Modell trainieren, um Bilder effektiv zu bearbeiten, sodass unser Modell zur FFCLIP-freien Text-gesteuerten Bildmanipulation wird . Gleichzeitig hat unser Modell bei den klassischen Kirchen-, Gesichts- und Autodatensätzen sehr gute Ergebnisse erzielt.

- Papieradresse: https://arxiv.org/pdf/2210.07883.pdf

- Github-Adresse: https://github.com/KumapowerLIU/FFCLIP

Hintergrund und Implikationen

Kürzlich wurden Freitextaufforderungen zur Beschreibung von Benutzerabsichten verwendet, um latente StyleGAN-Räume für Bildbearbeitungsvorgänge zu bearbeiten [1, 2]. Diese Methoden nehmen als Eingabe einen Satz (z. B. „Blau“) oder eine Phrase (z. B. „Mann im Alter von 10 Jahren“) und bearbeiten die beschriebenen Bildattribute entsprechend, indem sie die latente Kodierung im latenten StyleGAN-Raum modulieren.

Genauer Text – Die Bildbearbeitung basiert auf einer genauen latenten Zuordnung zwischen dem visuellen semantischen Raum von StyleGAN und dem textuellen semantischen Raum von CLIP. Wenn die Textaufforderung beispielsweise „Überraschung“ lautet, identifizieren wir zunächst den zugehörigen semantischen Unterraum (d. h. „Ausdruck“, da Überraschung zum Attribut „Ausdruck“ gehört) im visuellen semantischen Raum. Nachdem wir den semantischen Unterraum gefunden haben, der dem Text entspricht, teilt uns der Text mit, in welche Richtung sich die latente Kodierung ändert, vom aktuellen Ausdruck zum überraschenden Ausdruck. Pionierstudien wie TediGAN [1] und StyleCLIP [2] haben empirisch vordefiniert, welcher latente visuelle Unterraum der Einbettung des Zieltexthinweises entspricht (d. h. spezifische Attributauswahl in TediGAN und Gruppierungszuordnung in StyleCLIP). Diese empirische Erkenntnis schränkt ein, dass sie bei einer Textaufforderung ein entsprechendes Bearbeitungsmodell trainieren müssen.

Unterschiedliche Texthinweise erfordern unterschiedliche Modelle, um die latenten Codes im latenten visuellen Unterraum von StyleGAN zu modulieren. Obwohl die globale Ausrichtungsmethode in StyleCLIP einen solchen Prozess nicht verwendet, werden Parameteranpassungen und Bearbeitungsausrichtungen manuell vordefiniert. Aus diesem Grund haben wir Grund zu untersuchen, wie der implizite visuelle semantische Unterraum durch expliziten Text automatisch gefunden werden kann, sodass ein einzelnes Modell mehrere Texte verarbeiten kann.

In diesem Artikel schlagen wir FFCLIP-Free Form CLIP vor, das automatisch den entsprechenden visuellen Unterraum für verschiedene Texte finden kann. FFCLIP besteht aus mehreren semantischen Modulationsmodulen, die als Eingabe die latente Kodierung w^+ und die Textkodierung e im latenten StyleGAN-Raum W^+ verwenden.

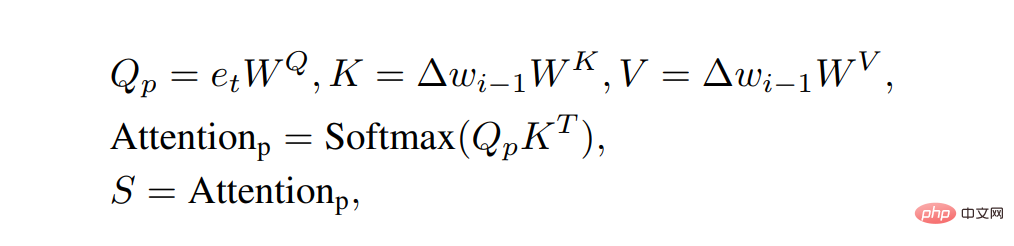

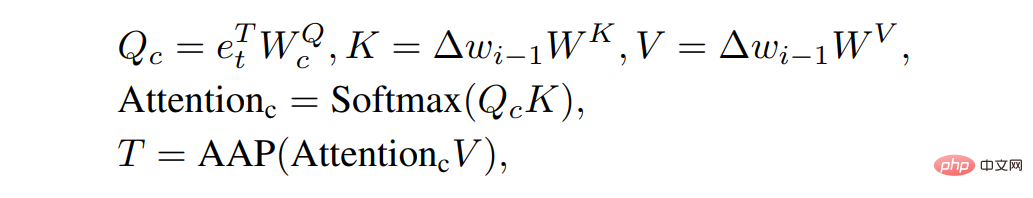

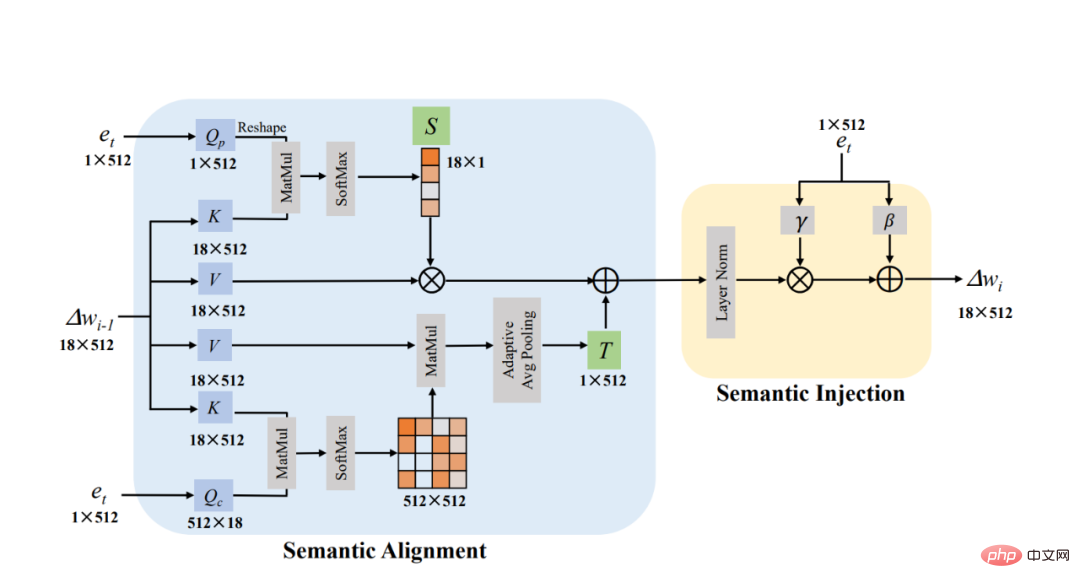

Das semantische Modulationmodul besteht aus einem semantischen Ausrichtungsmodul und einem semantischen Injektionsmodul. Das semantische Ausrichtungsmodul verwendet die Textkodierung e als Abfrage und die latente Kodierung w als Schlüssel und Wert. Dann berechnen wir die Queraufmerksamkeit in den Positions- und Kanaldimensionen, was zu zwei Aufmerksamkeitskarten führt. Dann verwenden wir eine lineare Transformation, um den aktuellen visuellen Raum in den dem Text entsprechenden Unterraum zu transformieren, wo die linearen Transformationsparameter (d. h. Übersetzungs- und Skalierungsparameter) basierend auf diesen beiden Aufmerksamkeitskarten berechnet werden. Durch diese Ausrichtung können wir automatisch den entsprechenden visuellen Unterraum für jeden Text finden. Schließlich modifiziert das semantische Injektionsmodul [3] den latenten Code im Unterraum, indem es einer weiteren linearen Transformation folgt.

Aus FFCLIP-Sicht ist die [1, 2] empirische Neutronenraumauswahl eine spezielle Form unserer linearen Transformation im semantischen Ausrichtungsmodul. Ihre Gruppenauswahloperation ähnelt den Binärwerten unserer Skalierungsparameter, um die Verwendung jeder Positionsdimension von w anzuzeigen. Andererseits beobachten wir, dass die Semantik des W^+-Raums immer noch verwickelt ist und das empirische Design keine genaue Zuordnung zwischen dem latenten Raum von StyleGAN und dem textuellen semantischen Raum von CLIP finden kann. Stattdessen modifiziert der Skalierungsparameter in unserem semantischen Ausrichtungsmodul den latenten Code w adaptiv, um verschiedene Einbettungen von Texthinweisen abzubilden. Über unsere Übersetzungsparameter wird das Alignment dann noch weiter verbessert. Wir evaluieren unsere Methode anhand von Benchmark-Datensätzen und vergleichen FFCLIP mit modernsten Methoden. Die Ergebnisse zeigen, dass FFCLIP in der Lage ist, sinnvollere Inhalte zu generieren und gleichzeitig die Absicht des Benutzers zu vermitteln.

FFCLIP

Abbildung 1 zeigt unser Gesamtgerüst. FFCLIP erhält zunächst die latente Kodierung von Bildern und Texten durch den vorab trainierten GAN-Inversionskodierer und Textkodierer. Die latente Kodierung des Bildes ist w im zuvor erwähnten visuellen semantischen Raum von StyleGAN W^+, während die Textkodierung e_t ist. Wie StyleCLIP verwenden wir den e4e GAN-Inversions-Encoder [4] und den Text-Encoder in CLIP, um jeweils die entsprechende latente Codierung zu erhalten. Dann verwenden wir e_t und w als Eingabe des Modulationsmoduls und geben den Versatz Δw von w aus. Addieren Sie schließlich Δw zum ursprünglichen w und fügen Sie es in das vorab trainierte StyleGAN ein, um das entsprechende Ergebnis zu erhalten.

Abbildung 1: Gesamtrahmendiagramm

Die zweite Abbildung unten ist unser semantisches Modulationsmodul. Im semantischen Ausrichtungsmodul (Semantic Alignment) können wir deutlich sehen, dass wir Δw auf Schlüssel und Wert und e_t auf Abfrage setzen. Die Größen dieser beiden Aufmerksamkeitskarten betragen 18 × 1 bzw. 512 × 512 . Dann verwenden wir die 18×1-Aufmerksamkeitskarte als Skalierungskoeffizienten S in der linearen Transformation. Unser Prozess zur Berechnung der Aufmerksamkeitskarte ist wie folgt:

Gleichzeitig multiplizieren wir die 512×512-Aufmerksamkeitskarte durch Wert und dann übergeben Die Pooling-Operation erhält den Übersetzungskoeffizienten T in der expliziten Transformation. Unser Prozess zur Berechnung der Aufmerksamkeitskarte ist wie folgt:

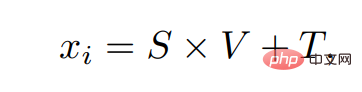

Nachdem wir die Übersetzungs- und Skalierungskoeffizienten haben, können wir den entsprechenden visuellen Unterraum für den aktuellen Text e_t durch lineare Transformation finden. Die Berechnungsschritte sind wie folgt:

Midterm x_i ist das Ausgabeergebnis unseres i-ten semantischen Modulationsmoduls. Da die Größe von Δw 18×512 beträgt, werden die Aufmerksamkeitskarten von 18×1 und 512×512 in den beiden Dimensionen Position und Kanal von Δw berechnet. Diese Operation ähnelt Dual Attention [5]. Abbildung 2: Semantisches Modulationsmodul Um das Endergebnis zu erhalten, nennen wir diese Operation das semantische Injektionsmodul (Semantic Injection). Die Implementierungsschritte des gesamten Moduls sind wie folgt:

Am Ende wurden in unserem FFCLIP insgesamt 4 semantische Modulationsmodule gestapelt und schließlich der endgültige Offset Δw erhalten.

Experimentelle Ergebnisse

Abbildung 3: Visuelle Vergleichstabelle

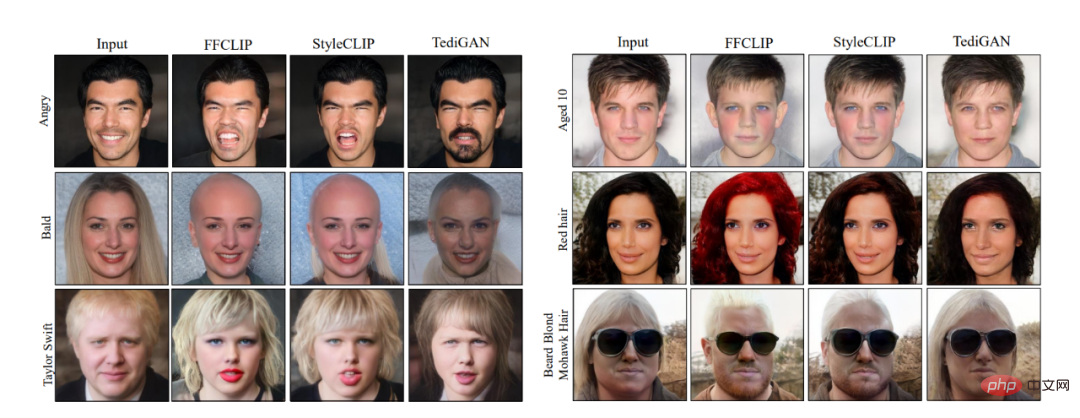

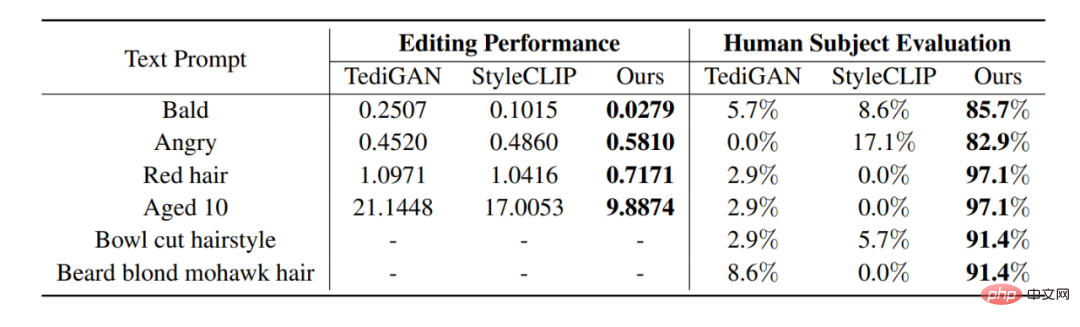

Wie in Abbildung 3 gezeigt, haben wir visuelle Vergleiche mit StyleCLIP [1], TediGAN [2] und HairCLIP [3] durchgeführt. Vergleich: Es ist ersichtlich, dass FFCLIP die Semantik von Text besser widerspiegeln und realistischere bearbeitete Bilder erzeugen kann. Gleichzeitig sind die entsprechenden numerischen Vergleichsergebnisse in der folgenden Tabelle aufgeführt. Unsere Methode kann sowohl bei objektiven als auch bei subjektiven Werten die besten Ergebnisse erzielen. Tabelle 1: Numerischer Vergleich Wird für das Training verwendet, aber im Test kann das Bild entsprechend der Semantik der Phrase bearbeitet werden. Der visuelle Effekt ist in Abbildung 4 dargestellt.

Abbildung 4: Phrasenbearbeitung

Weitere experimentelle Ergebnisse und Ablationsexperimente finden Sie im Originaltext.

Zusammenfassung

In diesem Artikel schlagen wir FFCLIP vor, eine neue Methode zur effizienten Bildbearbeitung, die auf verschiedene Texte abzielen kann, aber nur ein einziges Modell erfordert. Die Motivation dieses Artikels besteht darin, dass vorhandene Methoden basierend auf vorhandenen Erfahrungen mit dem aktuellen Text und dem semantischen Unterraum von GAN übereinstimmen, sodass ein Bearbeitungsmodell nur eine Textaufforderung verarbeiten kann. Wir verbessern die latente Abbildung durch Ausrichtung und injizierte semantische Modulation. Es ermöglicht ein Bearbeitungsmodell für die Bearbeitung mehrerer Textaufforderungen. Experimente mit mehreren Datensätzen zeigen, dass unser FFCLIP effektiv semantisch relevante und visuell realistische Ergebnisse liefert.

Das obige ist der detaillierte Inhalt vonEin neues Paradigma für die Text- und Bildbearbeitung: Ein einziges Modell ermöglicht die durch mehrere Texte geführte Bildbearbeitung. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr