Heim >Technologie-Peripheriegeräte >KI >Datenquellen sind nach wie vor der größte Engpass der künstlichen Intelligenz

Datenquellen sind nach wie vor der größte Engpass der künstlichen Intelligenz

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-09 10:41:031168Durchsuche

Laut dem diese Woche veröffentlichten Bericht „State of Artificial Intelligence and Machine Learning“ von Appen haben Agenturen immer noch Schwierigkeiten, gute, saubere Daten zu erhalten, um ihre Programme für künstliche Intelligenz und maschinelles Lernen aufrechtzuerhalten.

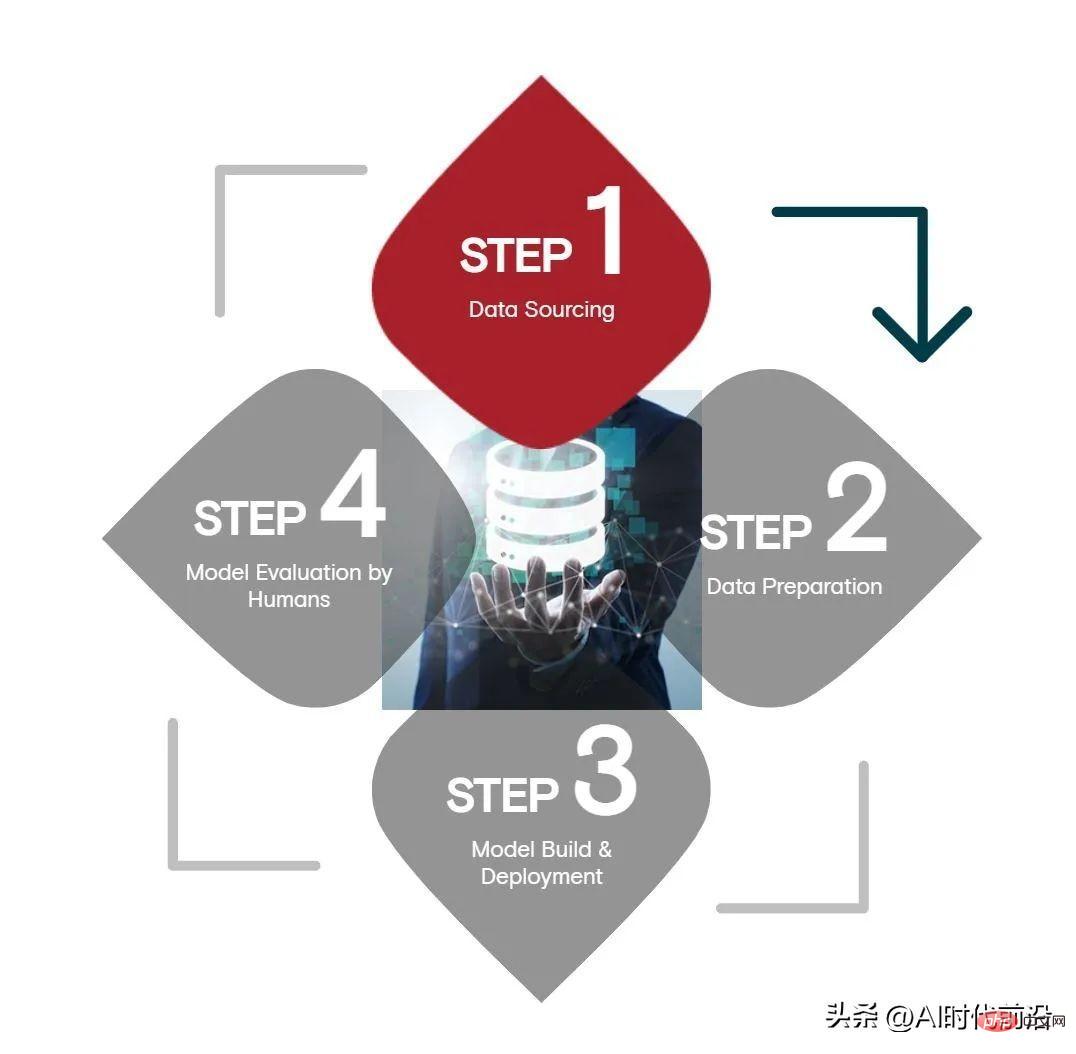

Laut Appens Umfrage unter 504 Unternehmensleitern und technischen Experten werden Datenquellen, Datenvorbereitung, Modellschulung und -bereitstellung verwendet benötigt die meisten Ressourcen, dauert am längsten und ist die größte Herausforderung.

Laut Appens Umfrage verbrauchen Datenquellen durchschnittlich 34 % des KI-Budgets eines Unternehmens, wobei Datenvorbereitung, Modelltests und -bereitstellung jeweils 24 % und die Modellevaluierung 15 % ausmachen. Die Umfrage wurde von Harris Poll durchgeführt und umfasste IT-Entscheidungsträger, Unternehmensführer und -manager sowie Technologiepraktiker aus den Vereinigten Staaten, dem Vereinigten Königreich, Irland und Deutschland.

In Bezug auf die Zeit nehmen Datenquellen etwa 26 % der Zeit in Anspruch, die Zeit für die Datenvorbereitung beträgt 24 %, die Zeit für Modelltests, -bereitstellung und -bewertung beträgt jeweils 23 %. Schließlich glauben 42 % der Techniker, dass die Datenbeschaffung die schwierigste Phase im KI-Lebenszyklus ist. Die anderen Phasen sind: Modellbewertung (41 %), Modelltests und -bereitstellung (38 %) und Datenvorbereitung (34 %). ).

Trotz der Herausforderungen arbeiten Organisationen hart daran, dass es funktioniert. Laut Appen gaben vier Fünftel (81 %) der Befragten an, über genügend Daten zu verfügen, um ihre KI-Initiativen zu unterstützen. Der Schlüssel zum Erfolg könnte folgender sein: Die überwiegende Mehrheit (88 %) der Unternehmen ergänzen ihre Daten durch den Einsatz externer Anbieter von KI-Trainingsdaten wie Appen.

Die Genauigkeit der Daten ist jedoch noch fraglich. Appen stellte fest, dass nur 20 % der Befragten eine Datengenauigkeit von mehr als 80 % angaben. Nur 6 % (ungefähr einer von 20 Personen) gaben an, dass ihre Daten zu 90 % oder besser seien.

Vor diesem Hintergrund glaubt laut Appens Umfrage fast die Hälfte (46 %) der Befragten, dass Datengenauigkeit wichtig ist. Nur 2 % glauben, dass Datengenauigkeit kein großes Bedürfnis ist, während 51 % glauben, dass es sich um ein entscheidendes Bedürfnis handelt.

Appens CTO Wilson Pang hat eine andere Meinung zur Bedeutung der Datenqualität: 48 % seiner Kunden sind der Meinung, dass Datenqualität nicht wichtig ist.

„Datengenauigkeit ist entscheidend für den Erfolg von KI- und ML-Modellen, da qualitativ hochwertige Daten zu einer besseren Modellausgabe und einer konsistenten Verarbeitung und Entscheidungsfindung führen“, heißt es in dem Bericht. „Um gute Ergebnisse zu erzielen, müssen Datensätze genau und umfassend sein.“

Der Aufstieg von Deep Learning und datenzentrierter KI hat die Macht des KI-Erfolgs von guter Datenwissenschaft und maschineller Lernmodellierung hin zu gutem Datenmanagement und Tags verlagert. Dies zeigt sich besonders deutlich in den heutigen Transferlerntechniken. Praktiker der künstlichen Intelligenz werden eine große vorab trainierte Sprache oder ein Computer-Vision-Modell aufgeben und einen kleinen Teil davon anhand ihrer eigenen Daten neu trainieren.

Bessere Daten können auch dazu beitragen, das Eindringen unnötiger Verzerrungen in KI-Modelle zu verhindern und schlechte Ergebnisse zu verhindern, zu denen KI führen kann. Dies gilt insbesondere für große Sprachmodelle.

In dem Bericht heißt es: „Mit dem Aufkommen großer Sprachmodelle (LLMs), die auf mehrsprachigen Web-Scraping-Daten trainiert werden, stehen Unternehmen vor einer weiteren Herausforderung, da Schulungskorpora mit toxischer Sprache sowie rassischen, geschlechtsspezifischen und religiösen Vorurteilen gefüllt sind.“ Modelle zeigen häufig unerwünschtes Verhalten. „

Verzerrungen in Netzwerkdaten werfen heikle Probleme auf, es gibt zwar einige Problemumgehungen (Änderung von Trainingsplänen, Filterung von Trainingsdaten und Modellausgaben und Einholung von Feedback durch Lernen durch Testen). ist erforderlich, um einen „menschenzentrierten LLM“-Benchmark und gute Standards für Modellbewertungsmethoden zu schaffen.

Appen sagte, dass das Datenmanagement weiterhin das größte Hindernis für künstliche Intelligenz sei. Die Umfrage ergab, dass 41 % der Menschen glauben, dass das Datenmanagement den größten Engpass im Zyklus der künstlichen Intelligenz darstellt. An vierter Stelle steht der Mangel an Daten, den 30 % der Befragten als größtes Hindernis für den KI-Erfolg nennen.

Aber es gibt eine gute Nachricht: Die Zeit, die Unternehmen mit der Verwaltung und Aufbereitung von Daten verbringen, nimmt ab. Die diesjährige Rate lag bei knapp über 47 %, verglichen mit 53 % im Vorjahresbericht, sagte Appen.

„Da die Mehrheit der Befragten externe Datenanbieter nutzt, lässt sich schlussfolgern, dass Datenwissenschaftler durch die Auslagerung der Datenbeschaffung und -aufbereitung Zeit sparen, die für die ordnungsgemäße Verwaltung, Bereinigung und Kennzeichnung ihrer Daten erforderlich ist“, sagt das Datenkennzeichnungsunternehmen.

Angesichts der relativ hohen Fehlerquoten in den Daten sollten Organisationen ihre Datenquellen und Aufbereitungsprozesse (ob intern oder extern) vielleicht nicht reduzieren. Beim Aufbau und der Wartung von KI-Prozessen gibt es viele konkurrierende Anforderungen – die Notwendigkeit, qualifizierte Datenexperten einzustellen, war ein weiterer wichtiger Bedarf, den Appen identifizierte. Bis jedoch wesentliche Fortschritte im Datenmanagement erzielt werden, sollten Unternehmen ihre Teams weiterhin unter Druck setzen, die Bedeutung der Datenqualität weiter voranzutreiben.

Die Umfrage ergab außerdem, dass 93 % der Organisationen voll und ganz oder eher der Aussage zustimmen, dass KI-Ethik die „Grundlage“ von KI-Projekten sein sollte. Mark Brayan, CEO von Appen, sagte, es sei ein guter Anfang gewesen, aber es gebe noch viel zu tun. „Das Problem besteht darin, dass viele vor der Herausforderung stehen, mit schlechten Datensätzen eine großartige KI aufzubauen, was große Hindernisse für das Erreichen ihrer Ziele schafft“, sagte Brayan in einer Pressemitteilung Daten innerhalb von Unternehmen bleiben der primäre Datensatz, der für künstliche Intelligenz verwendet wird und 38 % bis 42 % der Daten ausmacht. Synthetische Daten zeigten eine überraschend starke Leistung und machten 24 bis 38 % der Daten einer Organisation aus, während vorab gekennzeichnete Daten (normalerweise von Datendienstanbietern) 23 bis 31 % der Daten ausmachten.

Insbesondere synthetische Daten haben das Potenzial, das Auftreten von Verzerrungen in sensiblen KI-Projekten zu reduzieren. 97 % der Umfrageteilnehmer von Appen gaben an, dass sie synthetische Daten bei der „Entwicklung inklusiver Trainingsdatensätze“ verwenden.

Weitere interessante Ergebnisse im Bericht sind:

Weitere interessante Ergebnisse im Bericht sind:

- 42 % der Organisationen gaben an, dass künstliche Intelligenz „weitgehend“ eingeführt wurde, und im State of Artificial Intelligence Report 2021 lag dieser Anteil bei 51 % (Interpretation von der Spitze der KI). Ära: Anwendungen der künstlichen Intelligenz werden immer weiter verbreitet.)

- 7 % der Institutionen geben an, dass die KI-Budgets 5 Millionen US-Dollar übersteigen, verglichen mit 9 % im letzten Jahr. (Interpretation aus der Spitze der KI-Ära: Einerseits kann dies auf die allmähliche Reife der künstlichen Intelligenz zurückzuführen sein, die die Kosten senkt, zeigt aber auch, dass künstliche Intelligenz kein „Luxusprodukt“ mehr ist und allmählich zu einem wird ein „Must-have“ für Unternehmen.)

Das obige ist der detaillierte Inhalt vonDatenquellen sind nach wie vor der größte Engpass der künstlichen Intelligenz. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr