Heim >Technologie-Peripheriegeräte >KI >Das traditionelle GAN kann nach Modifikation interpretiert werden und stellt die Interpretierbarkeit des Faltungskerns und die Authentizität der generierten Bilder sicher.

Das traditionelle GAN kann nach Modifikation interpretiert werden und stellt die Interpretierbarkeit des Faltungskerns und die Authentizität der generierten Bilder sicher.

- 王林nach vorne

- 2023-04-08 14:21:101261Durchsuche

- Papieradresse: https://www.aaai.org/AAAI22Papers/AAAI-7931.LiC.pdf

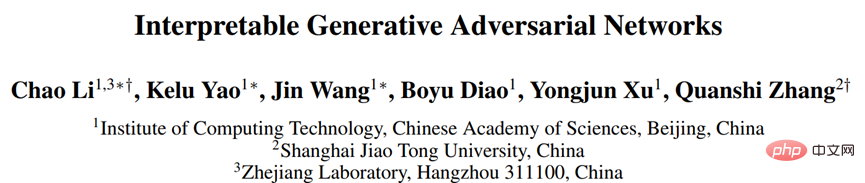

- Autorenzugehörigkeiten: Institut für Computertechnologie, Chinesische Akademie der Wissenschaften, Shanghai Jiao Tong University, Zhijiang Laboratory

Forschungshintergrund und Forschungsaufgaben

Generative Adversarial Networks (GANs) haben große Erfolge bei der Generierung hochauflösender Bilder erzielt, und auch die Forschung zu deren Interpretierbarkeit hat in den letzten Jahren große Aufmerksamkeit erregt.

In diesem Bereich ist es immer noch eine große Herausforderung, GAN dazu zu bringen, eine entkoppelte Darstellung zu lernen. Die sogenannte entkoppelte Darstellung von GAN bedeutet, dass jeder Teil der Darstellung nur bestimmte Aspekte des generierten Bildes beeinflusst. Frühere Forschungen zur entkoppelten Darstellung von GANs konzentrierten sich auf unterschiedliche Perspektiven.

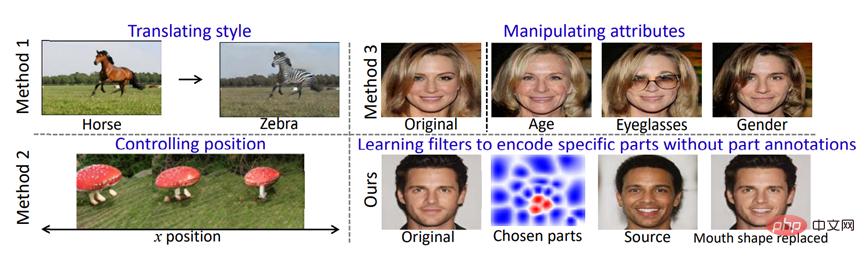

In Abbildung 1 unten beispielsweise entkoppelt Methode 1 die Struktur und den Stil des Bildes. Methode 2 lernt die Merkmale lokaler Objekte im Bild. Methode 3 lernt entkoppelte Merkmale von Attributen in Bildern, wie z. B. Altersattribute und Geschlechtsattribute von Gesichtsbildern. Diese Studien konnten jedoch keine klare und symbolische Darstellung verschiedener visueller Konzepte (z. B. Gesichtsteile wie Augen, Nase und Mund) in GANs liefern. Abbildung 1: Visueller Vergleich mit anderen GAN-entkoppelten Charakterisierungsmethoden

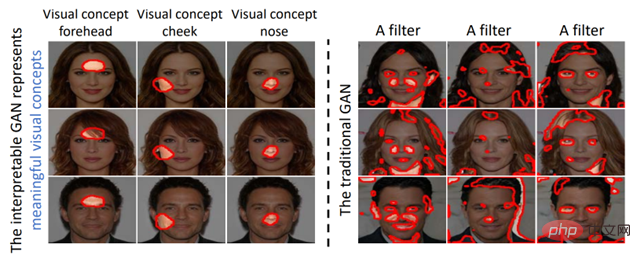

, wodurch sichergestellt wird, dass die Faltungskerne in der mittleren Schicht des Generators entkoppelte lokale visuelle Konzepte lernen können. Wie in Abbildung 2 unten gezeigt, repräsentiert im Vergleich zum herkömmlichen GAN jeder Faltungskern in der mittleren Schicht des interpretierbaren GAN beim Generieren unterschiedlicher Bilder immer ein bestimmtes visuelles Konzept, und unterschiedliche Faltungskerne repräsentieren unterschiedliche Visionskonzepte. Abbildung 2: Visueller Vergleich zwischen interpretierbarem GAN und traditioneller GAN-Codierungsdarstellung Interpretierbarkeit des Kernels und die Authentizität des generierten Bildes

Interpretierbarkeit des Faltungskerns: Die Forscher hoffen, dass der Faltungskern in der mittleren Schicht automatisch aussagekräftige visuelle Konzepte lernen kann, ohne dass visuelle Konzepte manuell mit Anmerkungen versehen werden müssen. Insbesondere sollte jeder Faltungskern beim Erzeugen verschiedener Bilder stabil Bildbereiche erzeugen, die demselben visuellen Konzept entsprechen. Verschiedene Faltungskerne sollten Bildbereiche erzeugen, die unterschiedlichen visuellen Konzepten entsprechen.

Authentizität der generierten Bilder: Der interpretierbare GAN-Generator kann weiterhin realistische Bilder erzeugen. Um die Interpretierbarkeit der Faltungskerne in der Zielschicht sicherzustellen, stellten die Forscher fest, dass mehrere Faltungskerne, wenn sie ähnliche Regionen erzeugen, die einem bestimmten visuellen Konzept entsprechen, dieses visuelle Konzept normalerweise gemeinsam darstellen.

Daher verwenden sie eine Reihe von Faltungskernen, um gemeinsam ein bestimmtes visuelles Konzept darzustellen, und verwenden unterschiedliche Sätze von Faltungskernen, um jeweils unterschiedliche visuelle Konzepte darzustellen.

Daher verwenden sie eine Reihe von Faltungskernen, um gemeinsam ein bestimmtes visuelles Konzept darzustellen, und verwenden unterschiedliche Sätze von Faltungskernen, um jeweils unterschiedliche visuelle Konzepte darzustellen.

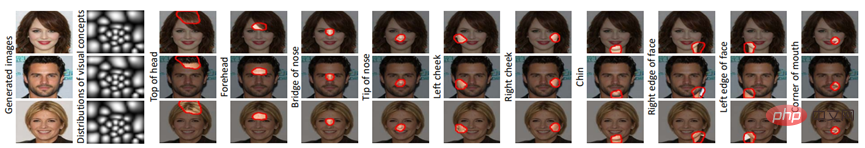

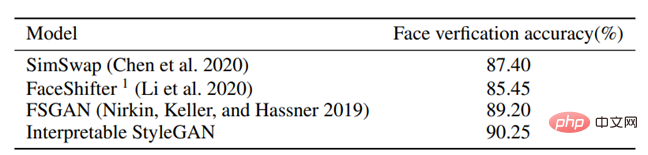

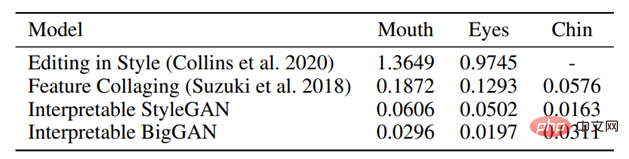

Um gleichzeitig die Authentizität der generierten Bilder sicherzustellen, haben die Forscher die folgende Verlustfunktion entworfen, um das traditionelle GAN in ein interpretierbares GAN umzuwandeln. Für die qualitative Analyse visualisierten sie die Feature-Map jedes Faltungskerns, um die Konsistenz der vom Faltungskern dargestellten visuellen Konzepte auf verschiedenen Bildern zu bewerten. Wie in Abbildung 3 unten dargestellt, generiert im interpretierbaren GAN jeder Faltungskern bei der Generierung unterschiedlicher Bilder immer Bildbereiche, die demselben visuellen Konzept entsprechen, während unterschiedliche Faltungskerne Bildbereiche erzeugen, die unterschiedlichen visuellen Konzepten entsprechen. Abbildung 3: Visualisierung von Feature-Maps in interpretierbarem GAN. Der Unterschied ist in Abbildung 4(a) unten dargestellt. Abbildung 4(b) zeigt den Anteil der Anzahl der Faltungskerne, die verschiedenen visuellen Konzepten im interpretierbaren GAN entsprechen. Abbildung 4(c) zeigt, dass bei unterschiedlicher Anzahl der zur Teilung ausgewählten Faltungskerngruppen die visuellen Konzepte, die das interpretierbare GAN erlernt, umso detaillierter sind, je mehr Gruppen vorhanden sind. Abbildung 4: Qualitative Bewertung von erklärbarem GAN Beispielsweise kann die Interaktion spezifischer visueller Konzepte zwischen Bildern durch den Austausch der entsprechenden Feature-Maps in der interpretierbaren Ebene erreicht werden, d. h. der lokale/globale Gesichtsaustausch wird abgeschlossen. Abbildung 5 unten zeigt die Ergebnisse des Austauschs von Mund, Haaren und Nase zwischen Bildpaaren Abbildung 6: Austauschen des gesamten Gesichts des generierten Bildes Insbesondere wird bei einem Paar von Gesichtsbildern das Gesicht des Originalbilds durch das Gesicht des Quellbilds ersetzt, um ein modifiziertes Bild zu erzeugen. Testen Sie dann, ob das Gesicht im geänderten Bild und das Gesicht im Quellbild dieselbe Identität haben. Tabelle 1 unten zeigt die Genauigkeit der Gesichtsüberprüfungsergebnisse verschiedener Methoden Ihre Methode ist hinsichtlich der Identitätserhaltung besser als andere Methoden zum Gesichtsaustausch. Tabelle 1: Genauigkeitsbewertung der Face-Swapping-Identität Darüber hinaus wurde im Experiment auch die Lokalität der Methode bei der Modifizierung spezifischer visueller Konzepte bewertet. Konkret berechneten die Forscher den mittleren quadratischen Fehler (MSE) zwischen dem Originalbild und dem modifizierten Bild im RGB-Raum und verwendeten das Verhältnis des MSE außerhalb der Region und des MSE innerhalb der Region eines bestimmten visuellen Konzepts als Experiment Index zur Ortsbewertung. Die Modifikationsmethode des Forschers weist eine bessere Lokalität auf, das heißt, es gibt weniger Änderungen im Bildbereich außerhalb des modifizierten visuellen Konzepts.

Tabelle 2: Lokalitätsbewertung modifizierter visueller KonzepteWeitere experimentelle Ergebnisse finden Sie im Artikel. Zusammenfassung Experimente zeigen, dass interpretierbares GAN es Menschen auch ermöglicht, bestimmte visuelle Konzepte auf den generierten Bildern zu ändern, was eine neue Perspektive auf die kontrollierbare Bearbeitungsmethode von GAN-generierten Bildern bietet.

. Die letzte Spalte gibt den Unterschied zwischen dem geänderten Bild und dem Originalbild an. Dieses Ergebnis zeigt, dass die Methode der Forscher nur das lokale visuelle Konzept veränderte, ohne andere irrelevante Bereiche zu verändern. Abbildung 5: Spezifische visuelle Konzepte für den Austausch generierter Bilder

. Die letzte Spalte gibt den Unterschied zwischen dem geänderten Bild und dem Originalbild an. Dieses Ergebnis zeigt, dass die Methode der Forscher nur das lokale visuelle Konzept veränderte, ohne andere irrelevante Bereiche zu verändern. Abbildung 5: Spezifische visuelle Konzepte für den Austausch generierter Bilder

Diese Arbeit schlägt eine allgemeine Methode vor, mit der traditionelle GANs in interpretierbare GANs umgewandelt werden können, ohne dass visuelle Konzepte manuell annotiert werden müssen. In einem interpretierbaren GAN kann jeder Faltungskern in der mittleren Schicht des Generators beim Generieren unterschiedlicher Bilder stabil dasselbe visuelle Konzept generieren.

Diese Arbeit schlägt eine allgemeine Methode vor, mit der traditionelle GANs in interpretierbare GANs umgewandelt werden können, ohne dass visuelle Konzepte manuell annotiert werden müssen. In einem interpretierbaren GAN kann jeder Faltungskern in der mittleren Schicht des Generators beim Generieren unterschiedlicher Bilder stabil dasselbe visuelle Konzept generieren.

Das obige ist der detaillierte Inhalt vonDas traditionelle GAN kann nach Modifikation interpretiert werden und stellt die Interpretierbarkeit des Faltungskerns und die Authentizität der generierten Bilder sicher.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr