Heim >Technologie-Peripheriegeräte >KI >Beseitigen Sie den „Clickbait', ein weiteres Open-Source-Meisterwerk des Tsinghua-Teams!

Beseitigen Sie den „Clickbait', ein weiteres Open-Source-Meisterwerk des Tsinghua-Teams!

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-08 12:51:181089Durchsuche

Als jemand, der Probleme mit der Namensgebung hat, ist es für mich beim Schreiben von Aufsätzen in der High School am schwierigsten, dass ich gute Artikel schreiben kann, aber nicht weiß, wie der Titel lautet. Nachdem ich angefangen habe, einen öffentlichen Account zu erstellen, habe ich viel verloren jedes Mal, wenn ich an einen Titel dachte...

Kürzlich habe ich endlich das Licht der „Namensverschwendung“ auf GitHub entdeckt, einer großen modellhaften interessanten Anwendung, die von der Tsinghua-Universität und der OpenBMB-Open-Source-Community ins Leben gerufen wurde: „Title Capture“. ". Geben Sie den Textinhalt ein, um mit einem Klick ein aktuelles Thema zu generieren. Titel!

Sofort einsatzbereit Nach dem Ausprobieren kann ich nur sagen: Es riecht großartig!

Online-Erlebnis: https://live.openbmb.org/ant

GitHub: https://github.com/OpenBMB/CPM-Live

erwähnt für Bei diesem Artefakt, das Schlagzeilen macht, müssen wir zunächst über seinen „Körper“ sprechen – das große Modell CPM-Ant.

CPM-Ant ist das erste Zehn-Milliarden-Modell, das in China live trainiert wurde. Das Training dauerte 68 Tage und wurde am 5. August 2022 abgeschlossen und offiziell von OpenBMB veröffentlicht!

- Fünf herausragende Merkmale

- Vier große innovative Durchbrüche

- Der Trainingsprozess ist kostengünstig und umweltfreundlich!

- Das Wichtigste ist – komplett Open Source!

Als erstes Live-Übertragungstraining chinesischer Großmodelle bietet CPM-Ant eine praktikable praktische Lösung für das Training, die Feinabstimmung, die Komprimierung, das Denken, die Anwendung usw. großer Modelle. Wir hoffen, verschiedenen Followern etwas anderes bieten zu können Hilfe und Referenzen.

Werfen wir nun einen Blick auf den Inhaltsbericht zu den Ergebnissen der CPM-Ant-Veröffentlichung!

Modellübersicht

CPM-Ant ist ein vorab trainiertes Open-Source-Sprachmodell für Chinesisch mit 10B-Parametern. Es ist auch der erste Meilenstein im CPM-Live-Live-Trainingsprozess.

Der gesamte Trainingsprozess ist kostengünstig und umweltfreundlich. Er erfordert keine hohen Hardwareanforderungen und Betriebskosten. Er basiert auf der Delta-Tuning-Methode und hat im CUGE-Benchmark-Test hervorragende Ergebnisse erzielt.

CPM-Ant-bezogener Code, Protokolldateien und Modellparameter sind vollständig Open Source und unterliegen einer offenen Lizenzvereinbarung. Zusätzlich zum Vollmodell bietet OpenBMB auch verschiedene komprimierte Versionen für unterschiedliche Hardwarekonfigurationen.

Die fünf herausragenden Funktionen von CPM-Ant:

(1) Recheneffizienz

Durch das BMTrain[1]-Toolkit kann es die Fähigkeit verteilter Rechenressourcen voll ausnutzen, große Mengen effizient zu trainieren Modelle.

Die Schulung von CPM-Ant dauerte 68 Tage und kostete 430.000 Yuan, was einem Zwanzigstel der etwa 1,3 Millionen US-Dollar entspricht, die für die Schulung des T5-11B-Modells durch Google anfallen. Die Treibhausgasemissionen des CPM-Ant-Trainings betragen etwa 4872 kg CO₂e, während die Emissionen des T5-11B-Trainings 46,7 t CO₂e betragen[9]. Die CPM-Ant-Lösung beträgt etwa 1/10 ihrer Emissionen.

(2) Hervorragende Leistung

Mit dem OpenDelta[3]-Tool ist es sehr bequem, CPM-Ant durch inkrementelle Feinabstimmung an nachgelagerte Aufgaben anzupassen.

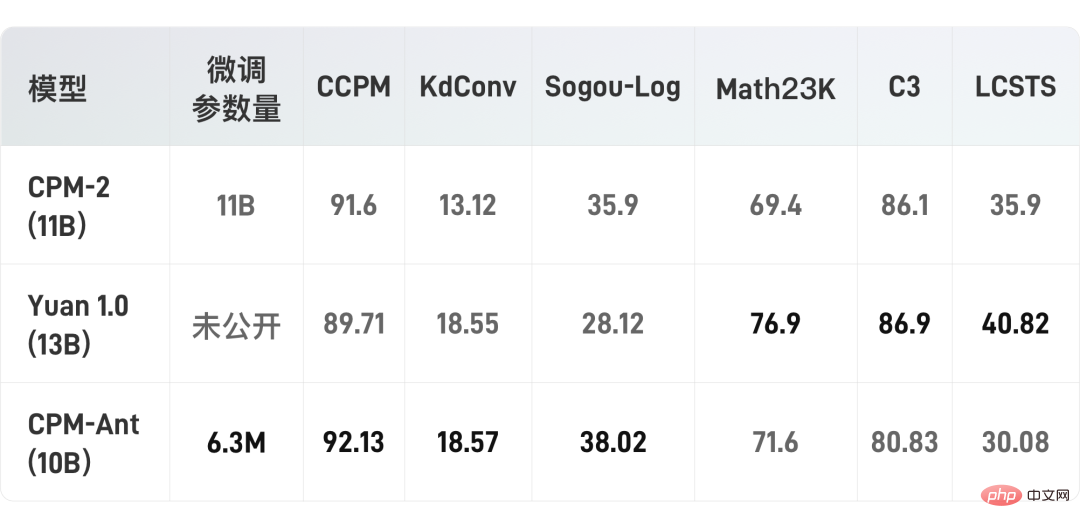

Experimente zeigen, dass CPM-Ant die besten Ergebnisse bei 3/6 CUGE-Aufgaben erzielt, indem nur 6,3 Millionen Parameter feinabgestimmt werden. Dieses Ergebnis übertrifft andere vollständig auf Parameter abgestimmte Modelle. Beispielsweise beträgt die Anzahl der fein abgestimmten Parameter von CPM-Ant nur 0,06 % von CPM2 (fein abgestimmte 11B-Parameter).

(3) Bereitstellungsökonomie

Mit Hilfe der Toolkits BMCook[7] und BMInf[4] kann CPM-Ant mit begrenzten Rechenressourcen betrieben werden.

Basierend auf BMInf kann es den Rechencluster ersetzen und große Modellinferenzen auf einer einzelnen GPU (sogar einer Consumer-Grafikkarte wie der GTX 1060) durchführen. Um den Einsatz von CPM-Ant wirtschaftlicher zu gestalten, verwendet OpenBMB BMCook, um das ursprüngliche 10B-Modell weiter in verschiedene Versionen zu komprimieren. Das komprimierte Modell (7B, 3B, 1B, 300M) kann sich an die Anforderungen verschiedener Szenarien mit geringen Ressourcen anpassen.

(4) Einfach zu verwenden

Ob es sich um das ursprüngliche 10B-Modell oder die zugehörige komprimierte Version handelt, es kann mit ein paar Zeilen Code einfach geladen und ausgeführt werden.

OpenBMB wird auch CPM-Ant zu ModelCenter[8] hinzufügen, was die weitere Entwicklung des Modells erleichtert.

(5) Offene Demokratie

Der Trainingsprozess von CPM-Ant ist völlig offen.

OpenBMB veröffentlicht alle Codes, Protokolldateien und Modellarchive als Open Access. CPM-Ant übernimmt außerdem eine offene Lizenz, die eine Kommerzialisierung ermöglicht.

Eine vollständige Trainingspraxis für große Modelle

Für Hersteller und Forschungseinrichtungen, die in der Lage sind, große Modelle zu trainieren, bietet der CPM-Ant-Trainingsprozess eine vollständige, tatsächliche Aufzeichnung der chinesischen Schulung großer Modelle.

OpenBMB hat das Modelldesign, das Trainingsschema, die Datenanforderungen und den Implementierungscode der CPM-Live-Modellreihe veröffentlicht. Basierend auf der Modellarchitektur von CPM-Live ist es möglich, schnell und einfach große Modelltrainingslösungen zu entwerfen und zu implementieren sowie relevante Geschäftsdaten zu organisieren, um die Modellvorforschung und Datenvorbereitung abzuschließen.

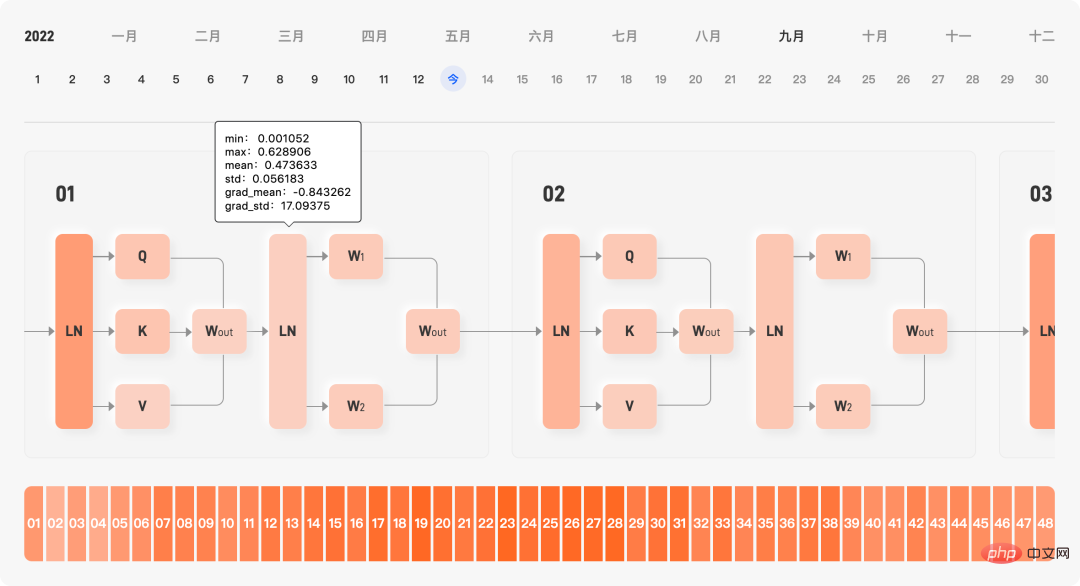

Die offizielle Website zeichnet alle Trainingsdynamiken während des Trainingsprozesses auf, einschließlich Verlustfunktion, Lernrate, gelernte Daten, Durchsatz, Gradientengröße, Kostenkurve und Echtzeitanzeige des Mittelwerts und der Standardabweichung der internen Parameter von Durch diese Trainingsdynamik können Benutzer schnell diagnostizieren, ob es Probleme im Modelltrainingsprozess gibt.

Echtzeitanzeige der internen Parameter des Modelltrainings

Darüber hinaus aktualisieren die F&E-Studenten von OpenBMB die Trainingsaufzeichnungszusammenfassung jeden Tag in Echtzeit. Die Zusammenfassung enthält Verlustwert und Gradientenwert , den Gesamtfortschritt und zeichnet auch Begegnungen auf. Einige während des Trainingsprozesses aufgetretene Probleme und Fehler helfen Benutzern, die verschiedenen „Gruben“ zu verstehen, die während des Modelltrainings auftreten können.

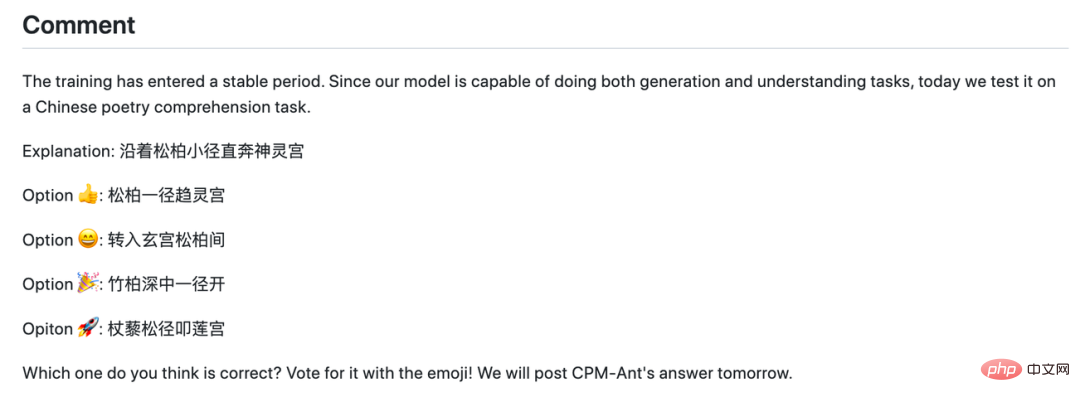

An Tagen, an denen das Modelltraining „ruhig“ ist, wirft der F&E-Mitarbeiter auch einige berühmte Zitate heraus, stellt einige neueste Veröffentlichungen vor und startet sogar eine Rateaktivität.

Eine Rateaktivität im Protokoll

Darüber hinaus bietet OpenBMB durch entsprechende Trainingsbeschleunigungstechnologie auch kostengünstige Schulungslösungen auf ein akzeptables Maß reduziert.

Mit dem BMTrain[1]-Toolkit kostet die Rechenleistung von zig Milliarden großen CPM-Ant-Trainingsmodellen nur 430.000 Yuan (die aktuellen Kosten werden anhand der öffentlichen Cloud-Preise berechnet, die tatsächlichen Kosten werden niedriger sein), Das ist 11B großes Modell T5 extern. Ungefähr 1/20 der geschätzten Kosten von 1,3 Millionen US-Dollar!

Eine effiziente Feinabstimmungslösung, die SOTA immer wieder geschaffen hat

Wie kann CPM-Ant uns bei der nachgelagerten Aufgabenanpassung helfen?

Für große Modellforscher bietet OpenBMB eine Lösung zur Bewertung der Leistung großer Modelle, die auf einer effizienten Feinabstimmung der Parameter basiert und eine schnelle nachgelagerte Aufgabenanpassung und Bewertung der Modellleistung ermöglicht.

Verwenden Sie eine Parameter-effiziente Feinabstimmung, bekannt als Delta-Tuning, um die Leistung von CPM-Ant bei sechs Downstream-Aufgaben zu bewerten. Im Experiment wurde LoRA [2] verwendet, das in jede Aufmerksamkeitsschicht zwei anpassbare Low-Rank-Matrizen einfügt und alle Parameter des Originalmodells einfriert. Mit diesem Ansatz wurden nur 6,3 Millionen Parameter pro Aufgabe feinabgestimmt, was nur 0,067 % der Gesamtparameter ausmacht.

Mit Hilfe von OpenDelta[3] führte OpenBMB alle Experimente durch, ohne den Code des Originalmodells zu ändern. Es ist zu beachten, dass bei der Bewertung des CPM-Ant-Modells für nachgelagerte Aufgaben keine Methoden zur Datenerweiterung verwendet wurden. Die experimentellen Ergebnisse sind in der folgenden Tabelle dargestellt:

Es ist ersichtlich, dass die Leistung des OpenBMB-Modells mit nur der Feinabstimmung einiger Parameter CPM-2 und Quelle 1.0 bei drei Datensätzen übertroffen hat.

Einige Aufgaben (z. B. LCSTS) können schwierig zu erlernen sein, wenn nur sehr wenige fein abgestimmte Parameter vorhanden sind. Der Trainingsprozess von CPM-Live wird fortgesetzt und die Leistung bei jeder Aufgabe wird weiter verbessert.

Interessierte Studenten können den GitHub-Link unten besuchen, um CPM-Ant und OpenDelta zunächst kennenzulernen und die Fähigkeiten von CPM-Ant bei anderen Aufgaben weiter zu erkunden!

https://github.com/OpenBMB/CPM-Live

Eine Reihe hardwarefreundlicher Inferenzmethoden

Die Leistung großer Modelle ist erstaunlich, aber hohe Hardwareanforderungen und laufende Kosten sind die Folge war schon immer ein Problem für viele Benutzer. Für Benutzer großer Modelle bietet OpenBMB eine Reihe hardwarefreundlicher Nutzungsmethoden, mit denen verschiedene Modellversionen in unterschiedlichen Hardwareumgebungen einfacher ausgeführt werden können.

Mit dem BMInf[4]-Toolkit kann CPM-Ant in einer Umgebung mit geringen Ressourcen wie einer Einzelkarte 1060 ausgeführt werden!

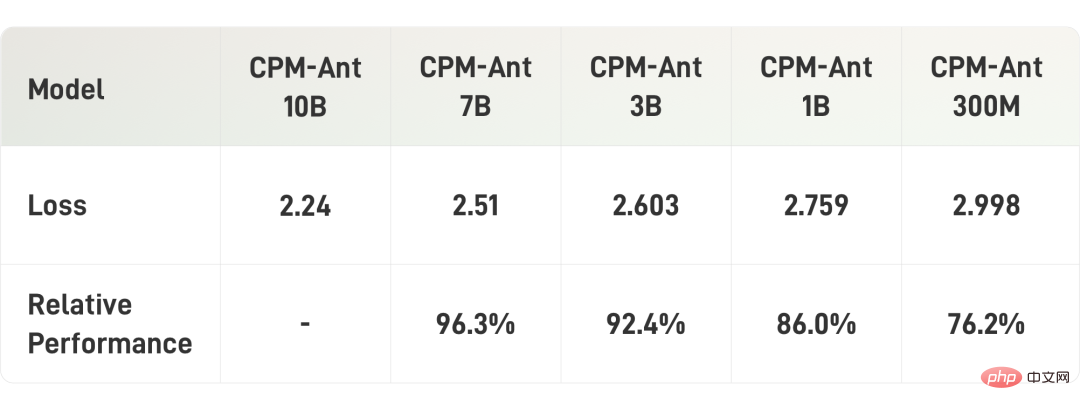

Darüber hinaus komprimiert OpenBMB auch CPM-Ant. Zu diesen komprimierten Modellen gehört CPM-Ant-7B/3B/1B/0.3B. Alle diese Modellkomprimierungsgrößen können den klassischen Größen bestehender vorab trainierter Open-Source-Sprachmodelle entsprechen.

Angesichts der Tatsache, dass Benutzer möglicherweise weitere Entwicklungen an freigegebenen Prüfpunkten durchführen, verwendet OpenBMB hauptsächlich aufgabenunabhängiges strukturiertes Bereinigen, um CPM-Ant zu komprimieren. Der Beschneidungsprozess erfolgt ebenfalls schrittweise, d. h. von 10B auf 7B, von 7B auf 3B, von 3B auf 1B und schließlich von 1B auf 0,3B.

Im spezifischen Bereinigungsprozess trainiert OpenBMB eine dynamische lernbare Maskenmatrix und verwendet diese Maskenmatrix dann zum Beschneiden der entsprechenden Parameter. Abschließend werden die Parameter entsprechend dem Schwellenwert der Maskenmatrix beschnitten, der auf der Grundlage der Zielsparsity bestimmt wird. Weitere Komprimierungsdetails finden Sie im technischen Blog [5].

Die folgende Tabelle zeigt die Ergebnisse der Modellkomprimierung:

Wie kann uns das große Modell helfen, „den Titel zu bekommen“, nachdem der Hardcore-Inhalt vorbei ist?

Eine unerwartete Spaßanwendung für große Modelle

Basierend auf CPM-Ant können alle Entwickler und Enthusiasten großer Modelle interessante und interessante Textanwendungen entwickeln.

Um die Wirksamkeit des Modells weiter zu überprüfen und Beispiele bereitzustellen, hat OpenBMB einen auf CPM-Ant basierenden Hot-Title-Generator verfeinert, um die Modellfunktionen zu demonstrieren.

Sie müssen nur den Textinhalt in das Textfeld unten einfügen, klicken, um ihn zu generieren, und schon erhalten Sie den aufregenden Titel des großen Modells!

Der Titel des ersten Artikels des CPM-Ant-Ergebnisberichts wird vom Generator generiert

Diese Demo wird kontinuierlich verbessert und in Zukunft werden weitere Spezialeffekte hinzugefügt, um das Benutzererlebnis zu verbessern

Interessierte Benutzer können CPM-Ant auch verwenden, um ihre eigenen Anzeigeanwendungen zu erstellen. Wenn Sie Anwendungsideen haben, technische Unterstützung benötigen oder bei der Nutzung der Demo auf Probleme stoßen, können Sie jederzeit eine Diskussion im CPM-Live-Forum [6] starten!

Die Veröffentlichung von CPM-Ant ist der erste Meilenstein von CPM-Live, aber es ist nur die erste Phase der Schulung. OpenBMB wird auch in Zukunft eine Reihe von Schulungen durchführen.

Ein kurzer Spoiler, in der nächsten Schulungssitzung werden neue Funktionen wie Mehrsprachenunterstützung, strukturierte Ein- und Ausgabe usw. hinzugefügt. Herzlich willkommen, weiterhin aufmerksam zu sein!

Portal|Projektlink

Projekt-GitHub-Adresse:

https://github.com/OpenBMB/CPM-Live

Demo-Erlebnisadresse (nur PC-Zugriff):

https: //live.openbmb.org/ant

Das obige ist der detaillierte Inhalt vonBeseitigen Sie den „Clickbait', ein weiteres Open-Source-Meisterwerk des Tsinghua-Teams!. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr