Heim >Technologie-Peripheriegeräte >KI >Li Zhifei: Acht Beobachtungen zu GPT-4, der multimodale Großmodellwettbewerb beginnt

Li Zhifei: Acht Beobachtungen zu GPT-4, der multimodale Großmodellwettbewerb beginnt

- 青灯夜游nach vorne

- 2023-03-31 22:39:55971Durchsuche

In standardisierten Tests und anderen Benchmarks übertrifft GPT-4 frühere Modelle, funktioniert in Dutzenden von Sprachen und kann auch Bilder als Eingabeobjekte verwenden, was bedeutet, dass es Fotos oder die Absicht und Logik des Diagramms verstehen kann.

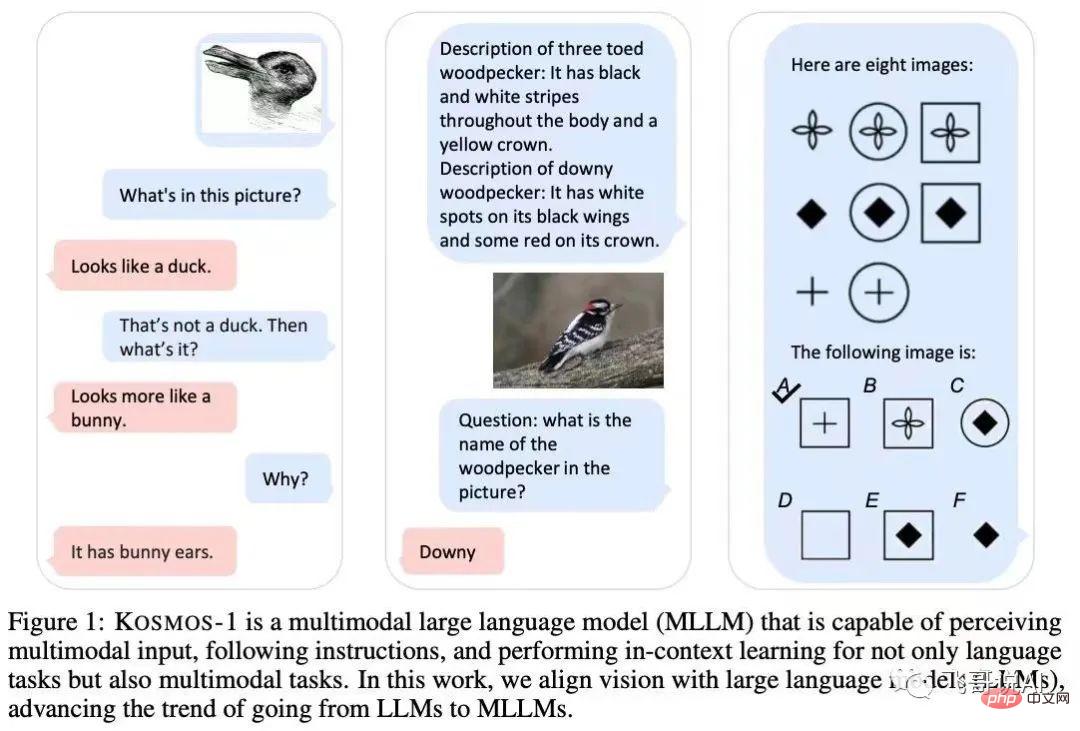

Seit Microsoft Anfang März das multimodale Modell Kosmos-1 veröffentlicht hat, testet und passt das Unternehmen das multimodale Modell von OpenAI an und macht es besser kompatibel mit Microsofts eigenen Produkten.

Wie erwartet hat Microsoft mit der Veröffentlichung von GPT-4 auch offiziell gezeigt, dass New Bing GPT-4 bereits verwendet hat.

Das von ChatGPT verwendete Sprachmodell ist GPT-3.5 Als OpenAI darüber sprach, dass GPT-4 leistungsfähiger ist als die Vorgängerversion, sagte OpenAI, dass die beiden Versionen in lockeren Gesprächen zwar ähnlich aussehen, aber „der Unterschied deutlich wird.“ die Komplexität der Aufgabe erreicht einen ausreichenden Schwellenwert.“ GPT-4 ist zuverlässiger, kreativer und in der Lage, differenziertere Anweisungen zu verarbeiten.

Der König ist gekrönt? Acht Beobachtungen zu GPT-4

1. Wiederumwerfend, besser als Menschen

Wenn die Modelle der GPT-3-Serie allen beweisen, dass KI mehrere Aufgaben in einem Modell erledigen kann und den Weg zur Erreichung von AGI, GPT-4, aufzeigen hat bei vielen Aufgaben die Leistung eines Menschen erreicht oder ist sogar besser als der Mensch. GPT-4 hat in vielen professionellen akademischen Prüfungen 90 % der Menschen übertroffen. Bei der Schein-Bar-Prüfung liegt seine Punktzahl beispielsweise unter den besten 10 % der Testteilnehmer. Wie sollten verschiedene Grund- und weiterführende Schulen, Universitäten und Berufsschulen darauf reagieren?

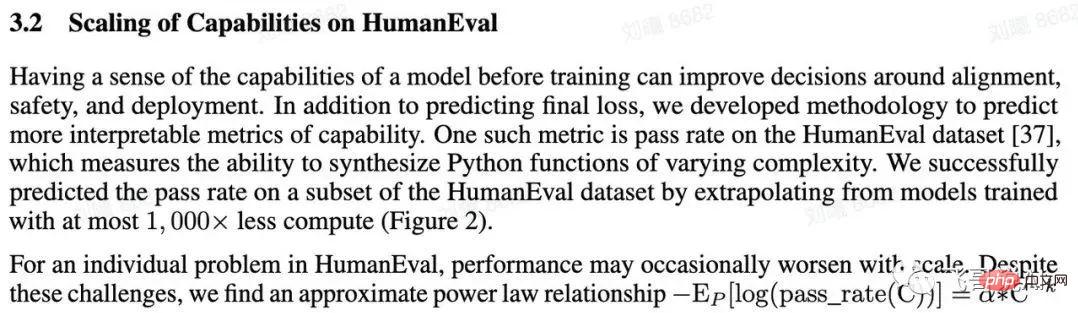

2. „Wissenschaftliche“ Alchemie

Obwohl OpenAI dieses Mal keine spezifischen Parameter bekannt gegeben hat, kann man davon ausgehen, dass das GPT-4-Modell ziemlich groß sein muss, was hohe Trainingskosten bedeutet. Gleichzeitig ähnelt das Training eines Modells auch stark dem „Verfeinern eines Elixiers“ und erfordert viele Experimente. Wenn diese Experimente in einer realen Umgebung trainiert werden, kann nicht jeder den hohen Kostendruck ertragen.

Zu diesem Zweck hat OpenAI auf geniale Weise eine sogenannte „vorhersehbare Skalierung“ entwickelt. Kurz gesagt, es verwendet ein Zehntausendstel der Kosten, um die Ergebnisse jedes Experiments (Verlust und menschliche Bewertung) vorherzusagen. Auf diese Weise wurde die ursprünglich groß angelegte „Glücks“-Alchemieausbildung zur „halbwissenschaftlichen“ Alchemie aufgewertet.

3. Crowdsourcing-Evaluierung, die zwei Fliegen mit einer Klappe schlägt

Dieses Mal bieten wir eine Open-Source-OpenAI-Evaluierung auf sehr „intelligente“ Weise an, die allen Entwicklern oder Enthusiasten durch Crowdsourcing offen steht, und laden alle ein, Evals zu nutzen Testmodell zu entwickeln und gleichzeitig das Entwickler-Ökosystem anzulocken. Diese Methode gibt nicht nur jedem das Gefühl, mitzumachen, sondern ermöglicht es auch jedem, kostenlos bei der Bewertung und Verbesserung des Systems mitzuhelfen. OpenAI erhält direkt Fragen und Feedback und schlägt so zwei Fliegen mit einer Klappe.

4. Technische Leckreparatur

Dieses Mal haben wir auch eine Systemkarte veröffentlicht, ein offenes „Patch“-Tool, das Lücken finden und das „Unsinn“-Problem des Sprachmodells reduzieren kann. Zur Vor- und Nachbearbeitung wurden verschiedene Patches auf das System angewendet, und der Code wird später geöffnet, um die Patch-Funktionen für alle zugänglich zu machen. Möglicherweise kann OpenAI in Zukunft jedem dabei helfen. Dies markiert, dass LLM endlich von einer eleganten und einfachen Aufgabe zur Vorhersage des nächsten Tokens zu verschiedenen chaotischen technischen Hacks übergegangen ist.

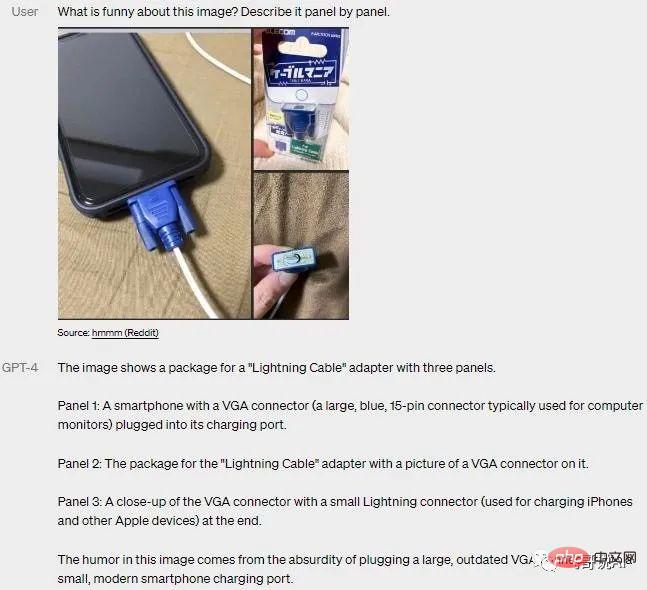

5. Multimodal

Seit Microsoft in Deutschland letzte Woche bekannt gegeben hat, dass GPT-4 multimodal ist, wurde die Öffentlichkeit mit Spannung erwartet.

GPT-4 gibt es schon seit langem. Die Multimodalität, die als „vergleichbar mit dem menschlichen Gehirn“ bezeichnet wird, unterscheidet sich eigentlich nicht wesentlich von den in vielen aktuellen Veröffentlichungen beschriebenen multimodalen Fähigkeiten Der Textmodell-Shot wird mit der logischen Kette (COT) kombiniert. Dabei wird davon ausgegangen, dass ein Text-LLM mit guten Grundfähigkeiten und Multimodalität erforderlich ist, der gute Ergebnisse liefert.

6. „King Explosion“ auf geplante Weise veröffentlichen

Laut dem Demovideo von OpenAI, das GPT-4 demonstriert, hat GPT-4 das Training bereits im August letzten Jahres abgeschlossen, es wurde jedoch erst heute veröffentlicht Der Rest der Zeit wird für umfangreiche Tests, verschiedene Fehlerbehebungen und vor allem für die Entfernung gefährlicher Inhalte aufgewendet.

Während alle immer noch in die erstaunlichen Generierungsfunktionen von ChatGPT vertieft sind, hat OpenAI GPT-4 bereits gelöst. Diese Welle von Google-Ingenieuren muss wahrscheinlich lange aufbleiben, um wieder aufzuholen?

7. OpenAI ist nicht mehr offen

OpenAI erwähnt in der öffentlichen Veröffentlichung keine Modellparameter und Datenskalen (die online übertragenen GPT-4-Parameter haben 100 Billionen erreicht), und es gibt kein technisches Prinzip erklärte, dass es zum Wohle der Öffentlichkeit sei, und ich befürchte, dass jeder, nachdem er gelernt hat, wie man GPT-4 herstellt, es dazu nutzen wird, Böses zu tun und einige unkontrollierbare Dinge auszulösen. Ich persönlich bin mit so etwas nicht einverstanden überhaupt kein silberfreier Ansatz.

8. Konzentrieren Sie sich auf große Dinge

Neben verschiedenen „Angeberfähigkeiten“ listet das Papier auf drei Seiten auch alle Personen auf, die zu verschiedenen Systemen von GPT-4 beigetragen haben. Eine grobe Schätzung dürfte bei mehr als hundert Personen liegen, was noch einmal die Einigkeit widerspiegelt und ein hohes Maß an Zusammenarbeit zwischen den internen Teammitgliedern von OpenAI. Liegt es im Vergleich zu den Teamkampffähigkeiten anderer Unternehmen in Bezug auf die gemeinsamen Anstrengungen etwas weit zurück?

Derzeit sind multimodale große Modelle zum Trend und zur wichtigen Richtung für die Entwicklung des gesamten großen KI-Modells geworden. In diesem großen KI-„Wettrüsten“ starten Technologiegiganten wie Google, Microsoft und DeepMind aktiv multimodale große Modelle (MLLM) oder großes Modell (LLM).

Eröffnung einer neuen Runde des Wettrüstens: Multimodale große Modelle

Microsoft: Kosmos-1

Microsoft hat Anfang März das multimodale Modell Kosmos-1 mit 1,6 Milliarden Parametern veröffentlicht basiert auf dem kausalen Sprachmodell von Transformer. Unter anderem wird der Transformer-Decoder als universelle Schnittstelle für multimodale Eingaben verwendet.

Zusätzlich zu verschiedenen Aufgaben in natürlicher Sprache ist das Kosmos-1-Modell in der Lage, eine Vielzahl wahrnehmungsintensiver Aufgaben nativ zu bewältigen, wie z. B. visueller Dialog, visuelle Erklärung, visuelle Beantwortung von Fragen, Bilduntertitel, einfache mathematische Gleichungen, OCR und Null -Shot-Bildklassifizierung mit Beschreibung.

Google: PaLM-E

Anfang März startete das Forschungsteam von Google und der Technischen Universität Berlin das derzeit größte visuelle Sprachmodell – PaLM-E, mit einem Parametervolumen von bis zu 562 Milliarden (PaLM-540B+ViT-22B).

PaLM-E ist ein großes Nur-Decoder-Modell, das in der Lage ist, Textvervollständigungen auf autoregressive Weise mit einem Präfix oder einer Eingabeaufforderung zu generieren. Durch das Hinzufügen eines Encoders zum Modell kann das Modell Bild- oder Sensordaten in eine Reihe von Vektoren mit der gleichen Größe wie die Sprach-Tags codieren und diese als Eingabe für die nächste Token-Vorhersage für ein End-to-End-Training verwenden.

DeepMind: Flamingo

DeepMind hat im April letzten Jahres das visuelle Sprachmodell Flamingo eingeführt. Das Modell verwendet Bilder, Videos und Texte als Eingabeaufforderungen und gibt relevante Sprachen aus Lösen Sie viele Probleme, ohne dass eine zusätzliche Schulung erforderlich ist.

Trainieren Sie das Modell durch die gegenseitige Eingabe von Bildern (Videos) und Text, sodass das Modell über Funktionen zur multimodalen Sequenzbegründung mit wenigen Schüssen verfügt und verschiedene Aufgaben wie „Vervollständigung der Textbeschreibung, VQA / Text-VQA“ ausführt.

Derzeit haben multimodale große Modelle mehr Anwendungsmöglichkeiten gezeigt. Neben dem relativ ausgereiften Vincentian-Diagramm sind nacheinander zahlreiche Anwendungen wie Mensch-Computer-Interaktion, Robotersteuerung, Bildsuche und Spracherzeugung entstanden .

Zusammengenommen wird GPT-4 kein AGI sein, aber multimodale große Modelle sind bereits eine klare und eindeutige Entwicklungsrichtung. Die Etablierung eines einheitlichen, szenarioübergreifenden, multimodalen Basismodells mit mehreren Aufgaben wird zu einem der Mainstream-Trends in der Entwicklung künstlicher Intelligenz werden.

Hugo sagte: „Wissenschaft trifft im Endstadium auf Vorstellungskraft.“ Die Zukunft multimodaler Großmodelle könnte jenseits der menschlichen Vorstellungskraft liegen.

Das obige ist der detaillierte Inhalt vonLi Zhifei: Acht Beobachtungen zu GPT-4, der multimodale Großmodellwettbewerb beginnt. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr