AIxivコラムは、当サイトが学術的・技術的な内容を掲載するコラムです。過去数年間で、このサイトの AIxiv コラムには 2,000 件を超えるレポートが寄せられ、世界中の主要な大学や企業のトップ研究室がカバーされ、学術交流と普及を効果的に促進しています。共有したい優れた作品がある場合は、お気軽に寄稿するか、報告のために当社までご連絡ください。提出メール: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com

Wu Yi、清華大学学際情報研究所助教授、元 OpenAI 常勤研究員、研究分野には強化学習が含まれる、大規模モデルのアライメント、人間とコンピューターの相互作用、ロボット学習など。スチュアート・ラッセル教授に師事し、2019年にカリフォルニア大学バークレー校で博士号を取得、2014年に清華大学学際情報研究所(ヤオクラス)を卒業。代表的な著作には、NIPS2016 の最優秀論文、Value Iteration Network、マルチエージェント深層強化学習の分野で最も引用された論文、MADDPG アルゴリズム、などがあります。 大規模なモデルを人間の指示や意図によりよく従わせるにはどうすればよいでしょうか?大規模なモデルに優れた推論機能を持たせるにはどうすればよいでしょうか?大型モデルでの幻覚を回避するにはどうすればよいですか?これらの問題を解決できるかどうかは、大規模なモデルを真に広く利用できるようにし、さらには超知能を実現するための最も重要な技術的課題です。これらの最も困難な課題は、Wu Yi チームの長期的な研究焦点でもあり、大規模モデルのアライメント技術 (アライメント) によって克服されるべき問題です。 アライメント技術において、最も重要なアルゴリズムフレームワークは、人間のフィードバックに基づく強化学習 (RLHF、人間のフィードバックからの強化学習) です。 RLHFは、大規模モデルの出力に対する人間の嗜好フィードバックに基づいて人間のフィードバックに基づいて報酬関数(報酬モデル)を学習し、さらに大規模モデルに対して強化学習トレーニングを実行して、大規模モデルが応答の品質を区別できるように学習します。反復を繰り返して、モデル機能の向上を達成します。現在、OpenAI の GPT モデルや Anthropic の Claude モデルなど、世界で最も強力な言語モデルは、RLHF トレーニングの重要性を重視しています。 OpenAI と Anthropic は、大規模モデルの調整のための大規模 PPO アルゴリズムに基づいた RLHF トレーニング システムも社内で開発しました。 しかし、PPOアルゴリズムの複雑なプロセスと高いコンピューティングパワーの消費のため、アメリカのAI企業の大規模なRLHFトレーニングシステムは、PPOアルゴリズムは非常に優れていますが、これまでオープンソース化されていませんでした。学術界におけるアライメント作業では、複雑な手法がほとんど使用されていません。PPO アルゴリズムは RLHF 研究に使用されており、より単純で直接的な SFT (教師あり微調整) や DPO (直接ポリシー最適化) などのアライメント アルゴリズムが一般的に使用されています。 、トレーニングシステムの要件が低くなります。 それでは、単純な位置合わせアルゴリズムのほうが確実にうまく機能するのでしょうか? ICML 2024 で Wu Yi のチームによって発表された著作「Is DPO Superior to PPO for LLM Alignment? A Comprehensive Study」では、DPO および PPO アルゴリズムの特性について注意深く議論し、RLHF アルゴリズムの効果を向上させるための重要なポイントを指摘しました。この研究では、独自に開発した大規模 RLHF トレーニング システムに基づいて、Wu Yi のチームは PPO アルゴリズムとパラメータの少ないオープンソース モデルを初めて使用し、クローズドソースの大規模コード生成タスク CodeContest を上回りました。最も困難な課題として認識されているモデル AlphaCode 41B。

関連する結果は、ICML 2024 の口頭発表として受理され、OpenAI や人間的。

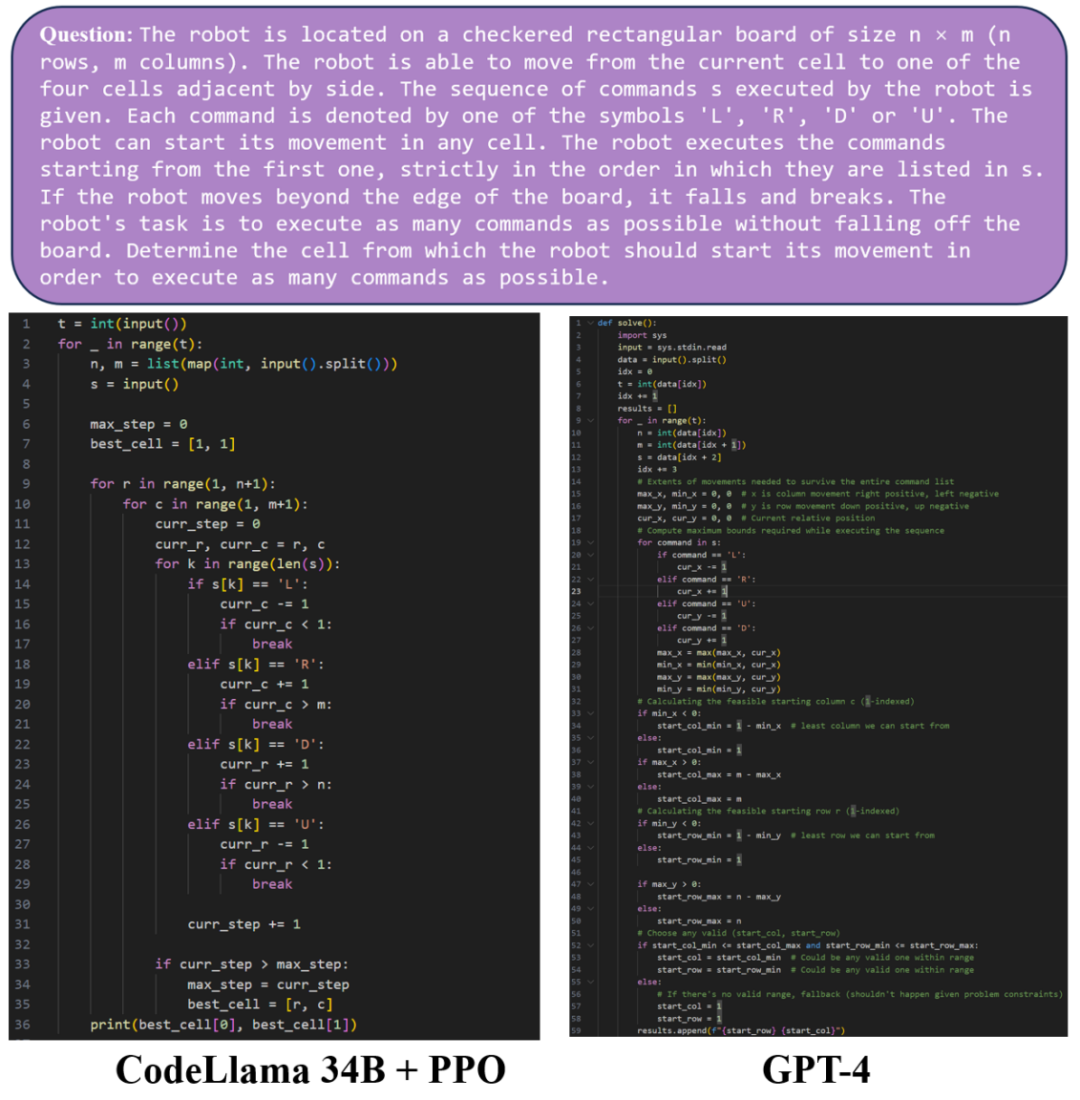

次に、GPT-4 と PPO アルゴリズムでトレーニングされた CodeLlama 34B モデルのコード生成効果を比較してみましょう。例 1 では、PPO アルゴリズムでトレーニングされた CodeLlama 34B モデルと GPT-4 モデルが生成されます。同等の品質のコード。

例 2 では、PPO アルゴリズムによってトレーニングされた CodeLlama 34B モデルと GPT-4 モデルの両方が、完全で実行可能な Python コードを生成できることがわかります。ただし、この例では、GPT-4 が間違ったコードを生成し、テスト データを正しく出力できませんでした。 PPO アルゴリズムによってトレーニングされた CodeLlama 34B モデルによって生成されたコードは、テストに合格できます。

In diesem Artikel von ICML 2024 diskutierte das Forschungsteam ausführlich die Eigenschaften von DPO- und PPO-Algorithmen und wies auf die wichtigsten Punkte zur Verbesserung der Fähigkeiten von DPO und PPO hin.

-

Papiertitel: Ist DPO PPO für die LLM-Ausrichtung überlegen? DPO-Algorithmus Einschränkungen

Im Vergleich zu PPO verwendet DPO Offline-Daten anstelle von Online-Stichprobendaten für das Training. Nach der Analyse führt der DPO-Algorithmus dazu, dass das trainierte Modell Ausgaben außerhalb der Trainingsdatenverteilung bevorzugt und in einigen Fällen unvorhersehbare Antworten erzeugt.

Um die Fähigkeiten des DPO-Algorithmus zu verbessern, hat das Forschungsteam zwei Schlüsseltechnologien zusammengefasst: Führen Sie vor dem RLHF-Training ein zusätzliches SFT-Training durch und verwenden Sie Online-Sampling-Daten anstelle von Offline-Daten.

Experimente zeigen, dass die Verwendung zusätzlicher SFT-Schulungen dazu führen kann, dass das Basismodell und das Referenzmodell stärker auf die Verteilung innerhalb des Datensatzes ausgerichtet werden, wodurch die Wirkung des DPO-Algorithmus, der Online-Sampling verwendet, erheblich verbessert wird Daten für iteratives Training können Es wurde stetig verbessert und seine Leistung ist weitaus besser als die des grundlegenden DPO-Algorithmus.

Die wichtigsten Punkte des PPO-Algorithmus

Mit Ausnahme von DPO fasst das Papier auch drei wichtige Punkte zusammen, um die Fähigkeiten von PPO zu maximieren:

Verwenden Sie eine große Chargengröße (groß). Batchgröße)

und aktualisieren Sie das Referenzmodell unter Verwendung des exponentiellen gleitenden Durchschnitts (exponentieller gleitender Durchschnitt für das Referenzmodell).

- Das Forschungsteam nutzte den PPO-Algorithmus erfolgreich, um SOTA-Ergebnisse für die Dialogaufgaben Safe-RLHF/HH-RLHF und die Codegenerierungsaufgabe APPS/CodeContest zu erzielen.

-

Bei der Dialogaufgabe stellte das Forschungsteam fest, dass der PPO-Algorithmus, der drei Schlüsselpunkte kombiniert, deutlich besser ist als der DPO-Algorithmus und der Online-Sampling-DPO-Algorithmus DPO-Iter.

Bei den Codegenerierungsaufgaben APPS und CodeContest, basierend auf dem Open-Source-Modell Code Llama 34B, hat der PPO-Algorithmus ebenfalls das stärkste Niveau erreicht und den vorherigen SOTA, AlphaCode 41B im CodeContest, übertroffen.

Um eine umfassende Modellausrichtung mit besseren Ergebnissen zu erreichen, ist ein hocheffizientes Trainingssystem unerlässlich. Das Team von Wu Yi verfügt über langjährige Erfahrungen bei der Umsetzung groß angelegter Reinforcement-Learning-Schulungen und hat seit 2021 ein proprietäres verteiltes Reinforcement-Learning-Framework aufgebaut .

- NeurIPS 2022 The Surprising Effectiveness of PPO in Cooperative Multi-Agent Games [1]:提出並開源了用於多智能體的強化學習並行訓練框架MAPPO,支持合作場景下的多智能體訓練,該工作被用於多智能體的強化學習並行訓練框架MAPPO,支持合作場景下的多智能體訓練,該工作被大量多智能體領域工作採用,目前論文引用量已超過1k。

- ICLR 2024 Scaling Distributed Reinforcement Learning to Over Ten Thousand Cores [2]: 提出了用於強化學習的分散式訓練框架,可輕鬆擴展至上萬個核心,加速比超越OpenAI 的大規模強化學習系統Rapid 。

- ReaLHF: Optimized RLHF Training for Large Language Models through Parameter Reallocation [3]: 最近,吳翼團隊進一步實現了分散式 RLHF 訓練框架 ReaLHF。吳翼團隊的 ICML Oral 論文正是基於 ReaLHF 系統產出的。 ReaLHF 系統經過長時間的開發,經歷大量的細節打磨,達到最優效能。相較於先前的開源工作,ReaLHF 可以在RLHF 這個比預訓練更複雜的場景下達到近乎線性的拓展性,同時具有更高的資源利用率,在128 塊A100 GPU 上也能穩定快速地進行RLHF訓練,相關工作已開源:https://github.com/openpsi-project/ReaLHF

除了提升大語言模型程式碼能力之外,吳翼團隊還採用多種將強化學習演算法和大模型結合的方式,實現了多種複雜LLM Agent,並且可以和人類進行複雜互動。 在 MiniRTS 中使用強化學習既能聽從人類指令也能做出最優決策的語言智能體 [4]。

在狼人殺中訓練策略多樣化的強化學習策略以提升大模型的決策能力 [5]。

在 Overcooked 遊戲中結合小模型與大模型實現能進行即時回饋的合作 Language Agent [6]。

結合強化學習訓練的機器人控制策略與大語言模型推理能力讓機器人能夠執行一系列複雜任務 [7]。

為了使大模型能真正走進千家萬戶,對齊技術是至關重要的,對於學術界和大模型從業者來說,好的開源工作和論文無疑會大大降低實驗成本和開發難度,也期待隨著科技發展,會有更多服務人類的大模型出現。 [1] Yu, Chao, Akash Velu, Eugene Vinitsky, Jiaxuan Gao, Yu Wang, Alexandre Bayen, and Yi Wu. "The surprising effectiveness of ppo in cooper

[2] Mei, Zhiyu, Wei Fu, Guangju Wang, Huanchen Zhang, and Yi Wu. "SRL: Scaling Distributed Reinforcement Learning to Over Ten Thousand Cores."

Wei Fu, Kaiwei Li, Guangju Wang, Huanchen Zhang, and Yi Wu. "ReaLHF: Optimized RLHF Training for Large Language Models through Parameter Reallocation."[4; Yutao Ouyang, Chao Yu, and Yi Wu. "Language-guided generation of physically realistic robot motion and control."[5] Xu, Zel, Chau, Zelel, Chajei 和 Yein, Yun, Zel, Chau* 「Language agents with reinforcement learning for strategic play in the werewolf game."[6] Liu, Jijia, Chao Yu, Jiaxuan Gao, Yuing X powered hierarchical language agent for real-time human-ai coordination."[7] Ouyang, Yutao, Jinhan Li, Yunfei Li, Zhongyu Li, horo, Koush Sreeu. Locomotion and Manipulation on a Quadrupedal Robot with Large Language Models."Das obige ist der detaillierte Inhalt vonICML 2024 Oral |. Ist DPO besser für LLM geeignet als die neueste Enthüllung des Tsinghua Wuyi-Teams?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!